-

Fototrend

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

#45185024

törölt tag

válasz

Oliverda

#26298

üzenetére

Oliverda

#26298

üzenetére

Oli áruld már el nekem miért bánt téged ennyire hogy Abu a GCN4et nagyobb változásnak tartja mint a GCN5-t ??

Áttanulmányozta mind a kettőt és neki az jött be...

Ez olyan meddő VITA hogy melyik a fontosabb egy ház alapja vagy a padlástér ?

Csomó dolog már ott van bent aminek most lesz meg az értelme.

A Ház alapja uncsi ...tele sok sziklával , a tetőn meg sok szép ablak hegyi kilátással. Most akkor az fontosabb ?

Vagy mindenkinek azt kell gondolni amit Lisa Sue mond ? Amúgy Doktor de itt nem számít.

Legalább 10 éve nem emlékszünk promó bemutatón olyanra hogy minden valós lenne (egyik oldalon sem), egy reklám és kész. -

Abu85

HÁZIGAZDA

válasz

Oliverda

#26296

üzenetére

Oliverda

#26296

üzenetére

Írtam már korábban, hogy az uncore rész nagy előrelépés, de a core rész tekintetében a GCN4 nagyobb volt, hiszen abban jött az utasítás-előbetöltés. A gyártok egyébként minden új termékre azt mondják, hogy ez a legjobb, akár öt éves távlatban. Azért vannak az újságírók, hogy ezeket a kijelentéseket megfelelő helyiértéken kezeljék.

-

stratova

veterán

válasz

Yutani

#26294

üzenetére

Yutani

#26294

üzenetére

Notebooknál ez már bevett szokás. [A linken egy 17,3"-os gamer Samsung noti adalapja látható.]

Másrészt tudtommal még nem került forgalomba Polaris 10 alapú RX 4xx névre hallgató GPU-val szerelt notebook. Azt sem ártana tudni, hogy ez most Polaris 10 vagy Polaris 10 xt2, ahogy ezt már egyszer felvetettük a hír első felbukkanásakor. -

Yutani

nagyúr

AMD Radeon RX 570 spotted, features up to 8GB of VRAM

Egy érdekes részlet:

It looks the Radeon RX 500 series is a rebranding of the Radeon RX 400 series cards, with someone visiting AMD's booth at CES and writing on Reddit: "The card IS an OEM version of the 470. I asked an AMD rep at their booth about it. The 500 series is an OEM rebadge of the 400 series, like how the 8000 series was to the 7000 series".

Ez most azt jelenti, hogy az AMD kihagyja az RX 500-as szériát retail tekintetben, ahogy a HD 8000-est is?

-

#45185024

törölt tag

Az látszik a képen is hogy egy 8 pines de szerintem nem ezért volt leragasztva hanem mert be volt az oda forrasztva azt meg ciki lett volna mutogatni. Hacsak nem valami olyan alkatrészt láttál volna ami még nincs lekommunikálva és cégtitok fogalmát alkotja.

Nem hiszem hogy bárki 180 Wattot várna a Vegától, Jó lesz az bőven 225Wattig inkább fordítsa a HBMből nyert pluszt BOOSTra , 8+6 pinig vagyis 300 wattig engedélyezem a dolgot

De hogy miért ragasztották le a venti nyílásokat mikor megmutatták a kártyát OMG

OMG -

Fapomogacs

tag

Sziasztok!

Lenne egy problémám amit mind ezidáig nem sikerült megoldanom, ezért segítségért fordulok hozzátok.

A konfig:

G2020 CPU

2x4gb 1333MHz memória

Sapphire 7870 GHz Edition VGA

CFT 750 14CS tápA probléma:

War Thunder alatt, miután elindítom a játékot rendszeresen a következő üzenetet dobja:

" video driver hung and was restarted." Tehát lefagyott a driver majd újraindult.

16.12.2-es drivert használok, de visszamenőlegesen kipróbáltam a 15.7-es azt hiszem driverig mindent és ua.Amiért nem értem a dolgot, hogy a World of Tanks, FHD-ben majdnem max. grafon hibátlanul megy, soha nem fagy, minden OK.

Heroes VII szintén hiba nélkül + egy órát futtattam Unigine Heaven benchmark tesztet és minden hibátlan.

GPU-Z és a Radeon programja szerint is max. 63°C az elért hőmérséklet feljebb nem megy.

Előtte R9 380-as VGA volt a gépben, a feszültség értékek is rendben.

Memóriát kivettem átraktam másik slot-ba, semmi, játékot leszedtem újratelepítettem, semmi.

Grafot visszavettem HD-re ua. az eredmény. Vírusírtót, anti-malware programot futtattam, semmi.Lehet csak utálja a WT-t?

-

Petykemano

veterán

válasz

Jack@l

#26266

üzenetére

Jack@l

#26266

üzenetére

Nem szúrtam el. Csak jóindulatúan ebből indultam ki. Itt a gpu only fogyasztás 1288mhz-en 90-100. A többi a gddr5 és a vrm veszteség. Talán utóbbira lehet mondani, hogy nagyvonalúan hagytam ki. Hogy a gddr5 mennyit fogyaszt, nagyjából mindegy, bár szerintem simán van 40w. A polaris egy pipe cleaner volt, feltehetőleg tényleg tudnak ilyen chipeket készíteni.

De ha ott volt a 8 pines tápcsati, akkor lényegtelen, tárgytalan. 😃

-

Komplikato

veterán

Csak nekem fura, hogy miért hangsúlyozták némelyik tesztnél, hogy a sample kártya jelenleg még CSAK Fiji drivert használ, nincs sajátja? Azt hiszem az SW Battlefront Vulkan tesztnél mondták. Ha akkora nagy architektúra váltás volt, akkor ez nem ellentmondás?

-

HSM

félisten

válasz

Jack@l

#26275

üzenetére

Jack@l

#26275

üzenetére

Dehogynem, nyilván elterveznek valamit, de sajnos a gyakorlatban is van egy csomó mérnivaló, hogyan is sikerültek a dolgok, milyen órajelet lehet végül beállítani, milyen feszültségen, milyen fogyasztás mellett, milyen kihozatallal. Ezért lett pl. a Polarisból is tudtommal 7 revízió, mert elsőre nem úgy sikerült, ahogy szerették volna.... Sajnos a csipgyártás már csak egy ilyen sajátos szakma.

-

HSM

félisten

válasz

Jack@l

#26268

üzenetére

Jack@l

#26268

üzenetére

A 480-nál az utolsó centig kicentizett költségek (NYÁK-méret korlát) és az utolsó pillanatban kb. 150Mhz-el megemelt órajelek eredménye volt ez. Eredeti órajeleivel simán befért volna a keretbe. (Ahogy eredetileg a mérnökök megtervezték.) A Vega mostani állapota még bőven az a stádium, amikor éppen tervezhetik az órajeleket, kialakítást, hűtést, feszültségeket. A Polarisnál nem itt hoztak rossz döntést, hanem amikor ez már rég kész volt, akkor még belenyúltak utólag valamiért (management?), annak lett az eredménye, ami. De ennek semmi köze ahhoz, hogy a Vega-n még bármi lehet a végleges változaton. Egyszerűen ez még nem releváns állapot ebből a szempontból. Gondolhatod, hogy a NYÁK is még messze van a véglegestől, ha mindenféle jel ki van még vezetve arra az USB mérőeszközre a kártya végén...

-

Jack@l

veterán

Ja, a 480 nál is tök lényegtelen volt, csak épp utólag már nem igazították hozzá a megemelt feszhez és órajelhez a gyári nyákot. Perpill ez ennyit tud, nem hiszem hogy lustaságból nem raktak rá még egy tápcsatit.

Lehet tippelni vajon ugynúgy elszúrják ezzel amint a 480-at és várhat a userek nagy része a gyártók custom 2 csatis verziójára? -

Jack@l

veterán

válasz

Petykemano

#26258

üzenetére

Petykemano

#26258

üzenetére

A 480 -as számolást elszúrtad, 160 wattból indulj ki.

Azt irják a tápba egy 8 pines meg egy sata tápcsati van bedugva csak (tök jó hogy eltakarták felül

)

)

Szóval a max 225 watt az elég szerény tuningra és órajelre lesz elég... (vagy megint nem kap pci express plecsnit ha így marad) -

#45185024

törölt tag

válasz

TESCO-Zsömle

#26261

üzenetére

TESCO-Zsömle

#26261

üzenetére

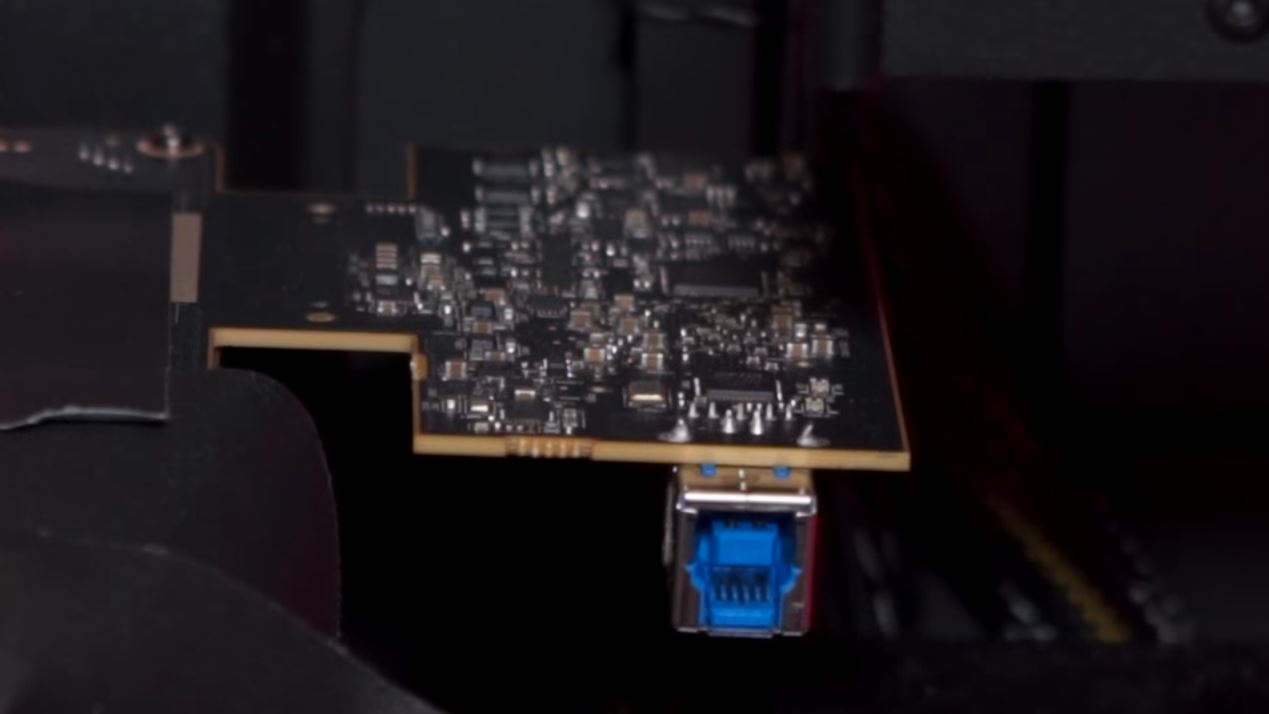

Nagyon szakszerűen fogalmaztál !

És már meg is jelent cikkben

Amúgy mi ez a kék cápaszáj csatlakozó (csak így szakszerűen ugye ) ?

Olyan mint mikor az Alien szájából kijön mégegy száj.

-

TESCO-Zsömle

titán

válasz

#45185024

#26254

üzenetére

#45185024

#26254

üzenetére

A special edition-t arra értette, hogy a VGA hátulján meg van hosszabbítva a nyák és elmondása szerint egy komplett monitorozó szerv van ott, ami lehetővé teszi a GPU minden adatának valós idejű megfigyelését. Erre a verzióra mondta, hogy mérnöki példány, így természetesen nem lesz elérhető, de majd csinálnak 2 speciális kiadást...

-

gyiku

nagyúr

válasz

Petykemano

#26258

üzenetére

Petykemano

#26258

üzenetére

valami megy bele, mert 2db modularis csatlakozo van bedugva a tapba. egy az ssd-nek, a masik a vga lesz.

vicces, hogy a hatuljat is beragasztottak, meg a ventit is

-

Petykemano

veterán

Biztos megy oda kábel?

Nem tudom, 6 vagy 8 pines kábeleket felesleges lenne takargatni. 6+8-et igen, de az nagy baj. Vagy azt, ha nincs kábel.<on the hype train>

Végy egy fury x-et

- tudvalevő, hogy minden magasabb speckó ellenére visszafogja a geometria.

- utoljára azt olvastam, hogy egy bug miatt nem is jön ki belőle az 512GB/s, csak kB 370

Így tud a doomban mennyit? 45fps

Igazából tényleg alig jön ki belőle több, mint a 390xNamost tegyük fel, hogy javítják a hibákat:

- geometria 4 -> 11

- memória sávszélesség bug javítása + továbfejlesztett DCC

Ezzel minimum elimináltad a szűk keresztmetszeteket. Az persze kérdés, hogy így többet fogyasztana-e. De tételezzzük fel, hogy nem, mert ha van dolga, csak erőforrásra vár, akkor mondjuk nem kapcsol le...

Így kijönne +25-30%, amit a 390x-től 40%-kal több shader indokolna.Ha semmi más nem változna, akkor csak +25% órajel kellene a 70fps-hez.

- induljunk ki abból az xfx 480 gtrből, ami 1288mhz-et tudott 90-100w-ból. Ha ezt a 90w asic powert arányosítom 2304 shaderről 4096 shaderre, akkor 160w.

- ha levonjuk a memóriavezérlőket (4 csoport gddr helyett 2 csoport hbm2), figyelembe vesszük a variable length simd unitkat, valamint azt, hogy az architektúrát a korábbiakhoz képest magasabb órajelre tervezték, és további újítások, bár meredeken hangzik, de nem elképzelhetetlen, hogy becsússzanak 75w alá beleértve ebbe a 5-10w hbm2 fogyasztást is. -

#45185024

törölt tag

válasz

#02119936

#26253

üzenetére

#02119936

#26253

üzenetére

Az még a régebbi közös interjújukban ejtette el a Nanót és gondolom poénból vágták be.

Mindegy milyen kábel jön ki belőle mert ez mérnöki példány ,

vicces a nyák vágás a közepén

és milyen minőségi szigszalagos HIDDEN megoldás

szigszalagos HIDDEN megoldás

"Special edition For you and For me" nyomja a hülyeséget rendesen Raja

nyomja a hülyeséget rendesen Raja

-

gyiku

nagyúr

ez meg milyen vega nyak? [link]

kesobb Raja elmagyarazza.mennyi juicet kap a kartya? a tapbol 1db kabel jon ki, attol meg lehet minden, 6pin, 8+6pin, 2x8pin

-

stratova

veterán

-

füles_

őstag

AMD Radeon RX 570 spotted in Samsung notebook

Már jönnek a mobil RX500-asok. Bár ez is Polaris rebrand -

namaste

tag

válasz

Petykemano

#26238

üzenetére

Petykemano

#26238

üzenetére

Nem hiszem, hogy hátrányba kerülne a kevesebb VRAM miatt, a legalább 8 GB HBM2 mindenre elég, a pro változat kap 16 GB-ot, most is csak a 2-3 GB VRAM-mal vannak akadások az új API-kkal.

Szerintem is első körben csak a pro programok fogják használni az SSD-t/rendszer memóriát és nem lesz teljesen automatikus a másolgatás, bele kell kódolni a programba. -

válasz

Petykemano

#26238

üzenetére

Petykemano

#26238

üzenetére

nem zsákutca. csak úgy tűnik, hogy nagyobbat haraptak, mint amekkorát le tudnak nyelni. ezentúl is ki lehet optimalizálni memelérésre/stb. a hardvereket minden uarchra, és nyilván kell is, mert a többi ezt nem fogja tudni. csak amikor kijön egy új játék, tele 0day bugokkal, félig (ez egy optimista feltételezés) megcsinált optimalizációval, ez az uarch a vramoptimalizáció hiányosságait jobban fogja tolerálni. ez egy cheat, mint a polaris utasítás-előbetöltés a polarisnál.

-

#45185024

törölt tag

Interjú Rajával figyeljetek ide Gémorszok

[ 25:27 ] The only demo you let people see was Doom where it was beating 1080, but that was a Vulkan API. Would it still beat the pants off 1080 if that was running DirectX11?[ Raja says doom only has OpenGL and Vulkan, but he thinks it WOULD at that resolution since it’s more GPU bound. Doom has some console optimizations, which are not available for OpenGL ]

[ 27:00 ] That was running Vega 10? Was it high-end Vega10 or entry-level Vega10?

[ Raja is laughing, but admits it’s Vega 10, he’s not ready to answer this question in detail ] -

#02119936

törölt tag

-

HSM

félisten

-

Petykemano

veterán

Tehát azt mondod

1.) Az eddig piedesztálra emelt low level irány, legalább memóriamenedzsment szempontjából zsákutca. De ezt a háta közepére kívánja a fejlesztő egy idő után a folyamatos igazítást azért nem olyan nehéz kiterjeszteni mindenre. Olyan, hogy figyu változtatunk valamit a driveren, igazítsátok hozzá, bármivel lehet, nem csak a memóriával.2.) A hiper-szuper hbc működés nem lesz automatikus, tehát aki vesz egy vega kártyát - a szuper cache megoldés miatt potenciálisan kevesebb vrammal, mint amúgy vett volna - a következő hónapokban, 1-2 évet várnia kell majd, mire lesz program, ami így működik, hogy kihasználja ezt a hardveres lehetőséget.

-

HSM

félisten

"Attól, hogy nincs swap állományod semmivel sem leszel gyorsabb, úgyis ott lesz minden a memóriába, amire szükséges van."

Pont ezért gyorsabb ez a mód, mert minden a memóriában van, ami gyors, semmi nem kényszerül a lassú (mert a rendszermemóriához képest az SSD is csigalassú) háttértárra.

"Annyi a különbség, hogy swap állomány nélkül kockáztatod a programfuttatás összeomlását a memóriából való kifutás miatt."

Pontosan. Nincs hova kipakolja a memóriából a cuccokat, de pont ez a lényeg. Nem szivatom vele magam, havi egyszer belefér egy programösszeomlás emiatt cserébe a megnyert igencsak nem kevés sebességért.

Úgyis mindig csak a játék fut túl a ramon és omlik össze, nem nagy szám. Tudom, hogy nem lenne jelentősen baja az SSD-nek így 12GB ram mellett, de nekem jobb így, hogy vigyázok rá. Drága móka ez, és nem RAM-nak való. Nekem megnyugtató, hogy 3 év intenzív használattal is kevesebb, mint a 10%-át használtam csak el a várható élettartamának. SWAP-nak is használva lényegesen rosszabb állapotban lenne.

Nekem megnyugtató, hogy 3 év intenzív használattal is kevesebb, mint a 10%-át használtam csak el a várható élettartamának. SWAP-nak is használva lényegesen rosszabb állapotban lenne.

"hogy a GPU-ra vonatkozó virtuális memória hasonlítson arra, amilyet a CPU alkalmaz"

Akkor semmi gond nem lesz, mert mehet ugyanúgy a fizikai címtérbe, ahogy a CPU-nál is lehet 1:1 mapping a fizikai és virtuális címtér között. Csak legyen elég fizikai ramod hozzá. Nekem ez így tetszik, és szerintem így sok alaposabb usernek is tetszeni fog így.

Csak legyen elég fizikai ramod hozzá. Nekem ez így tetszik, és szerintem így sok alaposabb usernek is tetszeni fog így. -

Abu85

HÁZIGAZDA

Az aktuális WDDM 2-vel a GPU-kra vonatkozó virtuális memória eléggé egyszerű. Jóval egyszerűbb, mint amit a CPU-ra használ az OS. Effektíve csak azért van rá szükség, hogy maga a rendszer jobban passzoljon a hardverek működéséhez, mert hiába alkalmazott a Windows a 10-es verzióig szegmentált fizikai címzést, a kernel driver már ezt átfordította a háttérben virtuálisra. A WDDM 2 csak ehhez igazodott, mert az új hardverek így működnek. Persze behozta még az IOMMU címzést, ami tényleges előny.

Attól, hogy nincs swap állományod semmivel sem leszel gyorsabb, úgyis ott lesz minden a memóriába, amire szükséges van. Annyi a különbség, hogy swap állomány nélkül kockáztatod a programfuttatás összeomlását a memóriából való kifutás miatt. Ahogy írtad, ez többször is előjött nálad. Magadat szívatod vele, csak azért, mert félsz, hogy elhasználja az SSD-d, de marhára nem fogja. Meg sem érzi majd az SSD, amit egyébként eleve arra vettél, hogy használd.

Az új modell egyébként sokkal inkább olyasmi váltás, hogy a GPU-ra vonatkozó virtuális memória hasonlítson arra, amilyet a CPU alkalmaz. A CPU-nak bevált, nincs okunk azt feltételezni, hogy nem válna be a GPU-ra.

-

Abu85

HÁZIGAZDA

válasz

letepem

#26201

üzenetére

letepem

#26201

üzenetére

Nagyon leegyszerűsítve azért kevés a VRAM, ha kevés persze, mert nincs elég idejük a fejlesztőknek normálisan kialakítani egy hatékony menedzsmentet. DX11-ben azért, mert nem rajtuk múlik, DX12-ben pedig azért, mert minden rajtuk múlik, és így már túl bonyolult. A konzol az teljesen más tészta. Ott konkrétan az van, hogy a fejlesztőnek van adva x (5-6 tökmindegy) GB memória és ahhoz hozzá nem nyúl az OS, driver, semmi. Ez egy nagyon egyszerű modell így, mert van egy fix géped, fix képességekkel, és csak arra kell dolgozni. Még ha a gépek számát kettőre emelik, akkor is bőven jó.

A PC teljesen más, mert milliónyi konfiguráció van, tehát nem tudsz egy fix konfigot kiválasztani, amire szénné optimalizálod a programot, arról nem is beszélve, hogy az OS/UMD meg sem engedi, hogy egy alkalmazásnak teljes kontrollja legyen az allokáció felett. Itt bonyolódik nagyon a dolog, és ezen a ponton veszik oda egy rakás erőforrás.

A PC-ben is kínálnak a gyártók különböző szabványon kívüli extrákat, hogy valamit, amit a konzolon ki lehet használni, azt PC-n is ki lehessen, de ezek beépítése mind idő, azután az így keletkező speciális kódot is karban kell tartani, tehát végeredményben, ha ezt megcsinálja egy fejlesztő mondjuk mindegyik gyártó legújabb architektúráira, akkor persze javul a program futtatásának hatékonysága, de végeredményben lesz egy rakás gyártó-, sőt hardverspecifikus optimalizálása, aminek a karbantartása rohadt drága lesz, tehát bármennyire is jó ötletnek tűnt az elején, mondjuk egy év után már a háta közepére kívánja a fejlesztő az egészet, amikor dobja össze az utolsó frissítést. És ez anyagilag sem kellemes ám. Főleg amiatt, hogy a gyártók leszólhatnak, hogy "fugyimá, csinálunk némi módosítást a meghajtóban, és a ti kódotok már nem lesz kompatibilis, írjátok má át eszerint, köszi-puszi".Végeredményben mindig oda lyukad ki az ipar, hogy vagy legyen egy működő szabvány, vagy ha ez bizonyos dolgokra nehezen megvalósítható, akkor legyen egy hardveres megoldás.

A Vega a legtöbb programban eleve ebben a legacy módban fog működni. A hardveres lapmenedzsmenthez kellenek eszközök, hogy kihasznált, elsődlegesen API-k, vagy API módosítások. Esetleg API interoperability. Utóbbi a legvalószínűbb, tehát DX12-Mantle és Vulkan-Mantle. Ezzel a programod szabványos maradhat, miközben ki lehet használni a hardveres lapmenedzsmentet a Vegán. Most is van ilyen modulja az AMD-nek, ami a LiquidVR. Az is DX11-Mantle interoperability-vel működik.

Szóval, ha nem használod ezt a képességet, akkor a HBM2 egy sima VRAM lesz. Ha viszont használod, akkor már az új konstrukció is bevethető.A VRAM törléssel az a gond, hogy DX11-ben nagyon drága művelet. DX12 és Vulkan alatt ez már kedvezőbb, de kevés a tapasztalat arról, hogy mikor mi az ideális feldolgozási modell. Itt már meg lehet oldani egy relatíve hatékony rendszert, de biztosan jóval tovább tart a kifejlesztése, mint szimplán rábízni a hardverre az egész problémát.

-

válasz

#45185024

#26231

üzenetére

#45185024

#26231

üzenetére

Nem feltétlenül az egyetlen cég, aminek vannak megkérdőjelezhető minőségű kártyái esetenként, ugye? Ne írjunk már badarságot tényként. Igencsak volt már mellényúlás szinte minden gyártónál.(Asus, giga, sapphire,msi( a csodálatos hawk széria ugye, ami hűvös volt ugyan, de levitte a fejed a venti) )

Szóval beszállhatott volna akár az amd piacra is az evga, lett volna olyan jó, mint a többi. (mondom ezt úgy, hogy a sapphire cuccait ugyancsak csípem, és várom is, hogy mit hoznak ki a vegából)

-

HSM

félisten

válasz

#45185024

#26231

üzenetére

#45185024

#26231

üzenetére

A 290/290X WF3-asaik teljesen korrekt kártyák voltak. Tuninghoz kevés volt a hűtő, de gyári állapotában teljesen vállalható volt. A 390-es az tényleg elég vicces lett. A 470/480-nál viszont ismét korrekt munkát végeztek Gigáék.

Én meg csak annyit akartam volna mondani, hogy az XFX MSI kártyákból azért jópár Giga 390-el összehasonlítható "jólsikerültségű" lett.

Szóval erősen túlzónak találom azt a hype felhőt, ami most a jól összerakott Polarisok miatt ezt a két gyártót övezi. De már itt is tudok kellemetlen pontokat, pl. MSI 470-en kopaszon hagyott ramok... Tök jó a 60 fokos GPU, miközben megfőzöd a ramokat. Pedig pont a ramokat kéne jól tuningolhatóvá tenni egy memóriasávszélesség limites kártyán....

Szóval erősen túlzónak találom azt a hype felhőt, ami most a jól összerakott Polarisok miatt ezt a két gyártót övezi. De már itt is tudok kellemetlen pontokat, pl. MSI 470-en kopaszon hagyott ramok... Tök jó a 60 fokos GPU, miközben megfőzöd a ramokat. Pedig pont a ramokat kéne jól tuningolhatóvá tenni egy memóriasávszélesség limites kártyán.... -

#45185024

törölt tag

Furyn a Sapphire vitte el a Prímet pedig volt Powercolor csak minta nem is lett volna, vagy akarsz a 390 390x es Gigabyte kártyákat dicsérni ?

Én csak annyit akartam sugallni hogy a leírt "szentháromság" XFX MSI Sapphire mellé ami itt számít nem tudna kívülről betörni egy megkérdőjelezhető kártyákat is gyártó cég... csak ennyit... -

#85552128

törölt tag

Az EVGA meg is cáfolta twitteren [link]

-

Komplikato

veterán

válasz

TTomax

#26225

üzenetére

TTomax

#26225

üzenetére

No meg ott volt a híres GF7600GT Rev2 a dupla órajelével.

![;]](//cdn.rios.hu/dl/s/v1.gif)

Amúgy volt olyan gyártó, akinek nem volt befürdős szériája? MSI féle elszabott firmware-es Radeonok? Az Asus hírhedt HD4870 kártyája amire a 4850-re IS túl kicsi hűtést tették és sorban megsültek? Persze mindenki csak a szépre emlékezik vagy mi. -

#45185024

törölt tag

válasz

TTomax

#26225

üzenetére

TTomax

#26225

üzenetére

XFX meg MSI gyártja AMD-n a legjobb kártyákat őket akkor köszönjük.szépen

65 fok körül működve. Rajtuk kívül szinte csak a Sapphire számít itt.

Sok az olyan gyártó aki Nvidián megél és rossz az itt nem tud.

Nem mennek a referencia kártyák,

A Giga minősíthetetlen 380 fölött nem volt értelmezhető kártyájuk.

Asus is csak a nevéből él meg , túlárazott kártyákkal.

Itt nem fogynak az MSI armorok, Asus duálok,

Sokszor hallom hogy de hát lehet kapni 1070et ennyiért meg ennyiért,

De milyet ? Olyan márkákhoz itt hozzá sem nyúlnak !

(és most ez nem VS csak a hűtésekről van szó!) -

seolwon

tag

Szerintem 100% hogy igaz!

Ha felcseréljük az első két betűt az EVGA-ban akkor mit kapunk?? Na mit??

-

füles_

őstag

Nem tudom ti hogy vagytok vele, de én ilyen haver mondta, hogy... pletykákat nem tudok komolyan venni

Semmi valóságalapja nincs -

keIdor

titán

EVGA és AMD házasság?[link]

Újabb jel arra, hogy talán feltámadnak.

-

#45185024

törölt tag

ez nagyon nagy

-

stratova

veterán

válasz

Petykemano

#26200

üzenetére

Petykemano

#26200

üzenetére

Tán túl nagy az űr P11 és P10 között. Applenek kellett most egy kis GPU megkapta a selejt ment asztalira és kisebb lapkaként lenyomta a GP107.

-

HSM

félisten

Egy dologban vagyok teljesen biztos, mégpedig hogy ez így egy eszméletlen marhaság, és 99%, hogy nem így lesz, csak valami félreértés van a dolog hátterében.

Jelenleg is használja a VGA a virtuális memóriát, mégpedig ha letiltod az OS-ben, akkor is, ugyanis olyankor is van "virtuális memóriád", csak a fizikai címtartománnyal egyezik meg és valós fizikai memória. Pazarló, de piszok gyors.

(#26198) leviske: Áhh, ők sem hülyék, 99%, hogy ilyen eszetlenséget nem vállanának be. Ilyen 8-16GB-os VGA-k mellett úgy halnának be az olcsó vacak belépő consumer SSD-k, hogy öröm lenne nézni.

Ekkora presztízsveszteséget majd megengednének maguknak. Ugyan. Nem hülyék dolgoznak ott.

Ekkora presztízsveszteséget majd megengednének maguknak. Ugyan. Nem hülyék dolgoznak ott.(#26201) letepem: Jó meglátások. Mondon, itt valami csúnyább félreértés lesz.

(#26202) leviske: Szvsz az Nv is használja már most is a virtuális memóriát. Sok hardver foglal benne magának címet, amit utána használhat. Igazából a programok számára az OS-ben csak virtuális memória létezik, ugyanis az OS menedzseli, hogy egy kiosztott memóriacím fizikailag a RAM-ban vagy a SWAP területén legyen....

(#26203) Jack@l: Ennek az SSD-s mókának csak HPC szektorban van értelme, amikor az értelmesen megvalósítható memóriaméreteknél jóval nagyobb adatállományokkal kell dolgozni. Gondolok mondjuk egy 128GB-os rendszermemóriájú sokprocesszoros szerverre, amibe beraksz mondjuk 4-10db GPU-t számolni, na ott komoly hatása lehet, ha minden GPU mondjuk 512GB-os helyi SSD-jében megtalálható az adat, amin éppen dolgoznak....

-

füles_

őstag

Ha nagyon ügyesek akarnak lenni, akkor a V10XT-t brutális teljesítménnyel (ha tényleg a Volta lesz majd az ellenfele) pofátlanul beárazzák akár 1000 dollárra is, vagyis megcsinálják a Titan AMD-s megfelelőjét. Így teljesen elfújtják a TXP mozgásterét. Majd a V10PRO-t ami még mindig brutális teljesítménnyel fog bírni beárazzák 600-700 dollár környékére, ha netán az NV árat csökkentene, vagy ha megérkezne a 1080Ti.

Ha ezt meglépik, akkor teljesen kiüthetik az NV-t a felsőházból.

A performance kategóriába pedig érkezne egy V11XT és egy V11PRO GTX 1080 körüli teljesítménnyel 400-500 dollár környékén.

És ha jönne egy P10XT2 magas órajelekkel, esetleg még GDDR5X-szel, beárazva 250-300 dollárra akkor sarokba szórítható lenne a 1070.Tudom sweet dreams

-

Jack@l

veterán

válasz

letepem

#26201

üzenetére

letepem

#26201

üzenetére

Most amd kiatlálta hogy neked kell az ssd a videokártyára, csak azt felejtette el mondani hogy játékokban kb semmivel se lesz jobb mintha normál ssd-re irogatná (jellemzően pálya betöltéskor) a temporális cuccokat.

HPC-hez kellhet, spéci compute alkalmazásokhoz, hogy a végeredményt gyorsabban helyben eltárolják.Én se láttam még kevesebb vramot használó dx12es játékot, pedig direkt a fejlesztők kérték a memória menedzsmentet...

-

leviske

veterán

Azzal nincs gond, hogy a Vega-ra nem kell optimalizálni. Viszont már csak az elmúlt 5 év is azt mutatja, hogy a fejlesztők nehezen engedik el egy-egy nVidia architektúra kezét. Nézzünk csak az API szinten mindent elindító Frostbite team-re, akik még a BF1 kapcsán is gondoltak évekkel ez előtti GeForce-ok tulajdonosaira.

Amíg az nVidia nem érdekelt a virtuális memória használata kapcsán, nehezen hihető, hogy ebből komoly előnyt tud majd az AMD kifacsarni. Amennyiben meg driverből lesz erőltetve a virtuális memória, sokan elfognak tántorodni a Radeonoktól, ahogy HSM aggodalmait is láthatod.

(#26201) letepem: +1

-

letepem

aktív tag

Eddig azt mondtad, hogy erőforrás-pazarló dx11 miatt kevés az x vram(legyen az 2-4-8 GB-os). Eljött a Vulkan, dx12, ami állításod szerint akár tizedelheti ezt az igényt (volt valami ps4es példa: elég volt fél-egy GB a textúráknak adott játéknál, míg ez pc-n 5 környékén mozgott?!), mindezt a kvázi ingyenes törlés miatt.

Akkor a vegának az ún. legacy módban miért kevés a 8/16 GB? Nyilván elérjük azt a határt, amikor ez a swap módszer hatékonyabb lesz a felesleges vram hízlalásánál, bár, akkor miért nem törölnek A FEJLESZTŐK és miért nem a rendszermemóriába swappel, ami gyorsabb, kisebb latenciája, stb??

Szerintem a te okfejtésed a gyorsítók piacán prognosztizálható, nem a játékiparban és megint a tech verziót adod elő a nem megfelelő célcsoportnak (ami nyílván érdekes, csak lehet megint felesleges támadásokat szül)

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- One otthoni szolgáltatások (TV, internet, telefon)

- Milyen monitort vegyek?

- Elektromos cigaretta 🔞

- The Division 2 (PC, XO, PS4)

- Luck Dragon: Asszociációs játék. :)

- Call of Duty: Black Ops 7

- SSD kibeszélő

- sziku69: Fűzzük össze a szavakat :)

- Hat év támogatást csomagolt fém házba a OnePlus Nord 4

- Robotporszívók

- További aktív témák...

- Játékra vagy Munkára! Csere-Beszámítás! I7 3930K / Nvida GTX Titan X / 16GB DDR3 / 500GB SSD!

- BESZÁMÍTÁS! SAPPHIRE B650M R7 8700F 32GB DDR5 512GB SSD RX 6800 16GB Zalman S2 TG GIGABYTE 750W

- Eladó egy Clevo PA71HS-G i7 7700hq Gtx1070 Kérlek olvasd végig a hirdetést

- Apple iPhone 13 Pro Max 128GB,Újszerű,Dobozával,12 hónap garanciával

- Apple iPhone XR 64GB, Kártyafüggetlen, 1 Év Garanciával

Állásajánlatok

Cég: ATW Internet Kft.

Város: Budapest

Cég: PCMENTOR SZERVIZ KFT.

Város: Budapest

OMG

OMG

![;]](http://cdn.rios.hu/dl/s/v1.gif)

szigszalagos HIDDEN megoldás

szigszalagos HIDDEN megoldás  nyomja a hülyeséget rendesen Raja

nyomja a hülyeséget rendesen Raja