-

Fototrend

Ebben a topicban tehetitek fel a videokártyákkal kapcsolatos azonnali, sürgős kérdéseiteket! Javasoljuk, hogy mielőtt kérdeztek töltsétek ki az adatlapotokon a konfigurációra vonatkozó részt!

Új hozzászólás Aktív témák

-

válasz

#82860288

#82748

üzenetére

#82860288

#82748

üzenetére

Sajna nincs DP csatlakozós 4k60Hz kijelzőm hogy direktbe ki tudjam próbálni az integrált UHD630 DP csatlakozóját.

Adapteren átalakítót ért, mert más kommentekbe az volt írva hogy más átalakítóval ment a 4k60. Amúgy ugyanolyan érthetetlen mint ahogy a linken lévő kérdés.

[link] -

-

-

Aprósólyom

addikt

válasz

gabo860518

#82729

üzenetére

gabo860518

#82729

üzenetére

Ilyen jellegű összehasonlításra szerintem jó kiindulási pont lehet a 3DMark online listája: Search (3dmark.com)

3DMark benchmarknál rákattintottam párra. 60-64 fok körül lehet találni többet, de természetesen van alatta felette is. Sajna nem tudni, ha nem tölti ki a leírást, hogy custom looppal hűti vagy egy fülledt házban üzemel a kártya.

Úgy is teszteld le szerintem, hogy leveszed a gépház oldallapját, hogy a szellőzés biztos ne legyen bottleneck. Az egy faktor mínusz, a hibakeresésénél/feltárásnál és ha végül garis, az az infó a szervizesnek is többet segíthet szerintem.Jevons paradox

-

válasz

Aprósólyom

#82756

üzenetére

Aprósólyom

#82756

üzenetére

Alaplap pdfje szerint igen.

-

modflow

veterán

válasz

Grave_444

#82670

üzenetére

Grave_444

#82670

üzenetére

Hú... jól megszivattatok!

Lehúztam a fehér csatit, ami annyit tett, hogy az egyik ventit kiiktatta, a másik működött, világított, míg egyik, a lehúzott ugye nem világított, de nem is forgott.Nem az van, hogy a két venti külön-külön kábelen kapja az áramot/Rgb világítást.

Tehát az áram és venti fordulat szabályozás és az RGB egy - egy külön csatin megy a két ventibe?

Egyik fejér, másik fekete. De egyiket se túl célszerű lehúzni, mert leég a kártya.[ Szerkesztve ]

-

-

Csupingo

veterán

válasz

modflow

#82758

üzenetére

modflow

#82758

üzenetére

Régebben az experience része volt a LED Visualizer, elvileg azzal is lehetett kapcsolgatni a világítást a kártyákon. Nem tudom, hogy ebben a férmában még létezik e. Vagy feltelepíted a programját, kikapcsolod, majd letörlöd. Sok esetben ilyenkor is megtartotta a beállításokat.

[ Szerkesztve ]

Villám Shakesespeare... Főnök, ha zavarja a fogsora, vegye ki! (M-N)

-

válasz

Aprósólyom

#82762

üzenetére

Aprósólyom

#82762

üzenetére

médincsájna

-

bacsalmasi57

friss újonc

Sziasztok,

Az alábbi problémába ütköztem,most vettem egy Gigabyte RTX 3060 12gb vga-t,amikor valami komolyabb igényű játékot indítok el,például RDR2,pár perc játék után randim elmegy a kép,a kijelzőn No Signal felirat,mintha leállna a kártya,kb fél perc és újra van kép,de a játék már leállt.Nemtudom hogy nálam van-e a hiba,vagy küldhetem vissza a kártyát?

-Nincs overclockolva

-legfrissebb driver újratelepítve

-az egész gépet is újrataktam 🙃

-újracsatlakoztattam a kábeleket

-terhelés alatt ~65°C ,48%teljesítményen pörög

A slussz poén az,hogy először vettem egy ilyen kártyát,amit vissza is küldtem kb 1,5 hónap után mert pixelhibái voltak és csíkozta a képet,de nem voltak olyan problémái mint a fentebb leírtak,nagy nehezen kaptam egy másikat,annak ez a baja.

Köszönöm a Segítséget.

Ryzen 7 5800x

Asus TUF B450-plus II alaplap

32 GBKingston Fury DDR4 3200Mt/s

Cooler Master MWE Gold 650v2 modular táp -

ricsi99

addikt

válasz

bacsalmasi57

#82765

üzenetére

bacsalmasi57

#82765

üzenetére

Ha van lehetősége ,másik táppal is meg kellene nézni.

Ezek a vga-k iszonyat áramot képesek felvenni

A hibatünet meg azt jelenti hogy a win ujraindítsa a vga-t valamilyen okbólEgy Gyűrű mind fölött, Egy Gyűrű kegyetlen, Egy a sötétbe zár, bilincs az Egyetlen...

-

Benhill

senior tag

Sziasztok.

Mely típus fölötti nVidia illetve AMD videokártyáról megy ki a hang HDMI-n?

(anélkül hogy bármilyen SPDIF kábelt csatlakoztatni kellene alaplapról videokártyára)[ Szerkesztve ]

-

-

Csupingo

veterán

válasz

Benhill

#82768

üzenetére

Benhill

#82768

üzenetére

Elvileg a gt 210, 220-tól felfelé, de mintha rémlene valamilyen gtx 4xx-es kivétel is, de azt most hirtelen nem találom, bár az is lehet, hogy rosszul emlékszem. Úgy tudom, az amd-nél ezt kicsit előbb megoldották, ott az ezeknél régebbi kártyák is tudták már.

Villám Shakesespeare... Főnök, ha zavarja a fogsora, vegye ki! (M-N)

-

-

twine

addikt

Sziasztok...

Régóta mocorog bennem a kérdés, de soha ne tettem fel, és most úgy éreztem itt az ideje

A kérdés az lenne, hogy egy játékra alkalmas VGA, (mint mondjuk nekem a notebookban van egy 1660ti) amikor játékot futtat, és közben a képernyő tükrözés(aka. megkettőzés)van beállítva...tehát ugyanazon a felbontáson, és képfrissítési frequencián jeleníti meg a tartalmat az elsődleges(notebook beépített) valamint másodlagos (tv) kijelzőn, akkor a VGA-nak kétszeres számítási teljesítményre van szüksége, azaz duplán számolja ki mind a két kijelzőn megjelenő tartalmat, vagy van erre a GPU-ban (vagy valahol másol) erre "dedikált" eszköz, ami csak mint egy "HDMI splitter" dobja szét az egyszer kiszámolt tartalmat?Gyerek könyörög néha, hogy játsszak vele MInecraft Dungeont, és ezt úgy szoktuk(xbox controllerekkel) abszolválni, ahogy fent vázoltam a technikát...(notebook+tv)..És bár semmi problémám nincs, és gond nélkül fut minden a "tech vénámban" mindig felmerül ilyenkor a fent említett kérdés...

Köszönöm, ha valaki ki tudja elégíteni a kíváncsiságom...

-

Csak nagyon minimális vagy semmi teljesítményveszeteséget okozhat.

Notinál alapból ha több gpu van akkor az elergiatakarékosra van bekötve fizikailag a kijelző (pl intel vagy AMD IGP) és a plusz GPU amikor használod akkor át van a kép irányítva. (magyarán a plusz gpu-nak nincs is kimenete) Onnantól mindegy hogy az integrált mennyi felé osztja azt szét.

Asztali gépeknél is ugyanez működik ha mondjuk valamiért az integrált gpu-ra kötöd a kijelzőt de a nagyobb GPU-n futtatod a játékot. Ez annyi teljesítményveszteséget okoz hogy a pcie csatornát amelyen a két gpu kommunikál kissé terheli hiszen ott megy át a kép. Ma már win11 natívan támogatja is a több gpu-t azaz még driveres támogatás sem kell neki. (igaz van pár bug benne amit a mai napig csesztek megcsinálni de használhatónak nevezhető)Ha csak egy GPU van akkor a kártya megoldja magától hogy több kijelzőn jelenítse meg ugyan azt szintén 0 vagy max pár % teljesítményvesztéssel.

Nem számolja a képet ki kétszer, a kész kép egy bufferben van amit akár melyik kimenetre vagy többre át lehet irányítani.Kissé tovább is lehet gondolni mondjuk hogy a videókártyának nem is kell kijelző ahhoz hogy képet adjon ki magától. Lehet virtuálisan is akár több játékot futtatni egy kártyán és távolról valamilyen megoldással azt streamelni. (pl: geforce now)

[ Szerkesztve ]

Vintage Story PH szervere újra fut!

-

Kerygam

csendes újonc

válasz

bacsalmasi57

#82765

üzenetére

bacsalmasi57

#82765

üzenetére

Ha előző kártya óta nem lett cserélve semmi és az jól működött, akkor sajnos lehet, hogy maga a kártya a gond. Ha garancia/14 napos akkor visszaküldeném, ha megoldható.

Kitartást és sok sikert!"A számítógép embertelen: egyrészt tökéletesen programozott és szabályosan működik, ráadásul teljesen őszinte."

-

twine

addikt

válasz

MasterDeeJay

#82775

üzenetére

MasterDeeJay

#82775

üzenetére

Köszönöm szépen...Tehát akkor valami hasonló módon oldja meg, mint ahogy gondoltam, hogy a kimenet van duplázva ilyenkor valamilyen formában...(nyiláván én egészen amatőr paraszt módon fogalmazok )

)

(Igen, nekem is van egy intel , és egy Nvidia gtx1660ti a notebookban.)

Viszont ez teljesen újdonság volt számomra.:

"az elergiatakarékosra van bekötve fizikailag a kijelző (pl intel vagy AMD IGP) és a plusz GPU amikor használod akkor át van a kép irányítva."

Ma is tanultam valamit, ez merőben új nekem...Én azt gondoltam a HDMI kimenetet mind a két GPu használja...valahogy "közösítve"...Köszönöm a választ

[ Szerkesztve ]

-

twine

addikt

Akkor ha már így belelendültem, kihasználom a topic türelmét, és még egy kérdés....

Múltkor indítottam egy PinballFX3-at a pc-n, és megnézve a terheléseket, azt láttam hogy az INtel IGp-t terheli a játék...(Nvidia "vezérlőpultban" az "automatikus mód"ot használtam alapértelmezetten, hogy a rendszer döntse el mikor melyiket használja)

Gondoltam akkor legyen a mindig a GTX-et használja opció, terhelje inkább azt nézzük mit mutat a játék....

Ujraindítás után a beállítások megmaradtak, de a játék mégis a az INtel IGP-t terhelte, a GTX mondhatni meg sem mozdult...MI lehet az oka, miért nem tudom ezt a számítást a GTX-re terhelni?

[ Szerkesztve ]

-

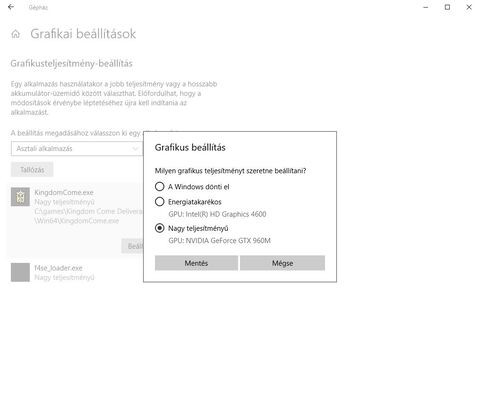

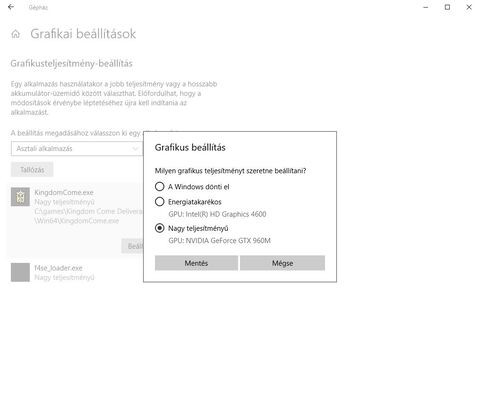

Win10/11 esetén asztalra jobb gomb képernyő beállítások, legörgetsz a több kijezőig és alatta grafikai beállítások és ott válaszd ki a játék indítóját majd kézzel választ ki hogy melyik gpu-n fusson. Nekem sem működött mindig az nvidia féle megoldás.

A fenti választó windows verziónként eltérhet, az újabb win11-eknél már legördülő menü van, némely win10 kiadásban meg csak az integrált gpu-t hozza elő valamiért.

Esetleg a játék indítójára jobb gomb futtatás nagy teljesítményű gyorsítón ha van olyan menü.Ha GTX futtatja akkor is látsz majd valamennyi de minimális aktivitást a integrálton is mert azon keresztül megy a kép.

[ Szerkesztve ]

Vintage Story PH szervere újra fut!

-

twine

addikt

válasz

MasterDeeJay

#82779

üzenetére

MasterDeeJay

#82779

üzenetére

Win11, minden legal

Köszönöm, kipróbálom...úgy látom kicsit össze kell kapni magam...nem gondoltam ,hogy a VGA-k területén ennyire le vagyok maradva...Ez is új nekem ,hogy a 10-11 már igy kezeli a VGA-kat

köszönöm a türelmes segítséget, információkat

köszönöm a türelmes segítséget, információkat

[ Szerkesztve ]

-

Gambito

tag

Sziasztok

napokban írtam 2080ti fekete kép problémáról.

piros pöttyös kép fogadott egy reggel, par oraig úgy lehetett a gép, le volt fagyva, újraindítás után ez fogadott.

boot után fekete a kép, venti nem megy a kartya melegedik.

biosban a kartya ventije nem talalható.

csökkentett mód bejön.

friss windows telepítése után van kép, gf exp telepitése után megint ugyanaz.

mindkét slotban ugyanaz.

A kártya áramot kap és világit, bekapcsnál a venti is felpörög.

szétszedtem és semmi különöset nem találtam.

teljesen halott vagy javítható?

köszi -

-

Kerygam

csendes újonc

válasz

Gambito

#82781

üzenetére

Gambito

#82781

üzenetére

Szia.

Radeon kártyámmal volt nagyon hasonló probléma, csökkentett módban és driverek nélkül "futott", de néha még úgy se mentek a ventik.

Sajnos a vége az lett, hogy hibásként eladtam, mert mindent IS megpróbáltam vele.

Remélem valaki tud okosabbat mondani, de bajtársként mondva, sajnos én "kukáztam"

"A számítógép embertelen: egyrészt tökéletesen programozott és szabályosan működik, ráadásul teljesen őszinte."

-

Gambito

tag

Sziasztok

3080 rtx vagy 6800xt

és miért ?

-

Aprósólyom

addikt

válasz

Gambito

#82785

üzenetére

Gambito

#82785

üzenetére

Ezt már inkább ide: Milyen videókártyát?

A bevezetőt ne felejtsd el elolvasni, hogy miként kérdezz, különben mérgesek lehetnek a srácok vagy szimplán nem kapsz választ.

Jevons paradox

-

Gambito

tag

válasz

Aprósólyom

#82786

üzenetére

Aprósólyom

#82786

üzenetére

Ja bocsi, hát egy kicsit az előtti posztomhoz szolt inkább, meghalt a kártyám és így a beszelgetés vég csak rákérdeztem, de értelek.

-

Benhill

senior tag

Sziasztok.

Lenne egy 2080 super hybrid vga, amire nincs hutesem.

Van itthon Arctic Acc xtreme 3, ami szépen felmegy rá, viszont 3db vramra(a 8ból) nem tudok sünit tenni.

Baj-e ha esetleg extra passziv hutes nélkül megy a kártya?! Aliról majd veszek 3-4mm magas réz bordát mert kb akkora fér el max.

-

Teasüti

nagyúr

válasz

M0ng00se

#82489

üzenetére

M0ng00se

#82489

üzenetére

Videóra és fényképre teljesen felesleges az ipari kártya. Nem ad hozzá semmit egy Davinci vagy Adobe munkafolyamathoz. Általános számítással vannak gyorsítva ezek a szoftverek és a saját futószalagjaikat használják (Davinci pl 32 bit RGB-ben számol mindent), a kártya precizitása nem oszt vagy szoroz.

-

Shoburo

újonc

Sziasztok,

Az lenne a kérdésem, hogy mennyire probléma ha a bus interface egyel kisebb szintű mint a vga-jé?(pl pcie 4.0 helyett 3.0-s vagy kovi generacional 5.0 helyett csak 4.0-s csati van az alaplapon)

-

Teasüti

nagyúr

válasz

Shoburo

#82790

üzenetére

Shoburo

#82790

üzenetére

Attól függ mennyi pcie eszközt használsz egyszerre.

Nálam az 5700g 3.0-s csak és 4.0-ás VGA van a gépben. Kb annyi különbség lehet max, mint mikor 16x helyett csak 8 sávot kap egy kártya: pár százalék max. Az is csak a top kártyáknál szokott kijönni.

Ha viszont elaprózod a sávokat, mert a VGA osztozik még két SSD-vel a buszokon egy switch mögött, akkor lehet kijön nagyobb különbség is. Mondjuk egy 3090 Ti lehet megérzi, ha csak 8x 3.0-t kap a 16x 4.0 helyett. Egy 3060 meg lehet vígan elvan 4 sávval is, kivéve szintetikus teszteken.

Nem mindegy az alaplap se, mert egyiknél lehet közvetlen a cpu-ba van bekötve dedikált sávokon az első pcie slot. Más lapoknál meg lehet osztozkodik még egyéb slotokkal is.

Feltéve persze ha az első slot-ba teszed a VGA-t.

[ Szerkesztve ]

-

Shoburo

újonc

válasz

Teasüti

#82791

üzenetére

Teasüti

#82791

üzenetére

Első slotban lesz és egy pcie 3.0s ssd meg egy 4.0s ssd lesz a gépben. Új gépet raknék össze és nem figyeltem oda, hogy milyen pcie csati lesz a kövi amd-s gpuknak(persze csak rumored az egész) és vettem egy 5900x-et meg egy asus rog strix b550-a-t. De ha nem nagy gond akkor lehet marad a terv és 7800xt/7900xt lesz nem 4080.

-

Aprósólyom

addikt

válasz

Benhill

#82788

üzenetére

Benhill

#82788

üzenetére

Egyetlen 1db VRAM modul, kb. 2,5 wattos egy ici pici műanyag tokozásban.

Kapjon folyamatos direkt légáramot a ventillátortól. Nem finomkodnék a légárammal. Legalább 800-1000RPM körül tartanám a min. fordulatot, "tűzön-vízen" desktop idleben is. Gamingben és egyéb terhelés alatt meg még magasabbon, legalább 1200-1300RPM. Biztos, ami biztos.

Mellette pedig alkalmaznék VRAM underclockot. Mondjuk legalább mínusz 10% - 15%-ot, amíg nem jönnek meg a VRAM sünik. Biztos, ami biztos alapon.

Ha így jársz el, akkor szerintem nyugodtan dőlhetsz hátra. A -15% VRAM tempó sem fogja hazavágni a játékélményt, de jelentősen csökkenti a VRAM fogyasztása, ami jót tesz a háthetőségnek és az élettartamnak.Jah... jut eszembe, a TDP keretet is korlátozhatod erre az ideiglenes időszakra. Ha kevésbé dolgozik a GPU, kevésbé dolgoztatja a VRAM-t is. Nyugodtan lehetsz szigorú, -25% -40%. Kísérletezhetsz. Meg fogsz lepődni, hogy nem fog annyival csökkenni az fps, mint amennyivel csökkented a TDP limitet.

Ui.: Én egyébként -5%-on járatom a VRAM-t a gyári defaulthoz képest. A teljes kártyát pedig 54% TDP limiten. Pusztán az energiahatékonyság növelése végett és a szűkre vett TDP keret miatt. Játékokban úgy sem érezni.

Bár én sosem játszom high grafon.

Bár én sosem játszom high grafon.

Video beállításokkal tovább optimalizálhatod a terhelhetőséget, miközben alig látszódik a különbség a grafikán.

Erről csinált egy videót anno a hardware unboxed csatorna is: https://youtu.be/inF-z_Td9YQ?t=328Jevons paradox

-

Teasüti

nagyúr

válasz

Shoburo

#82792

üzenetére

Shoburo

#82792

üzenetére

Ha minden B550 ugyanúgy van bekötve (mint az enyém), akkor a blokkdiagram szerint ha a második/harmadik M.2 slotba teszel SSD-t, az megfelezi az elsődleges pcie slotot (az első M.2 dedikált sávokat kapott a CPU-ba). Vagyis lesz 8x 4.0 az 5900x-el. Szerintem emiatt kár aggódni, hacsak nem akarod szénné hajtani a kártyádat azért a plusz három fps-ért.

Ha minden B550 ugyanúgy van bekötve (mint az enyém), akkor a blokkdiagram szerint ha a második/harmadik M.2 slotba teszel SSD-t, az megfelezi az elsődleges pcie slotot (az első M.2 dedikált sávokat kapott a CPU-ba). Vagyis lesz 8x 4.0 az 5900x-el. Szerintem emiatt kár aggódni, hacsak nem akarod szénné hajtani a kártyádat azért a plusz három fps-ért.

Vagy nem teszel oda SSD-t, csak az első slot-ba. Így megmarad a 16 sávod.

De nem gondolom, hogy valódi előnyöd származna ebből, főleg ha egy SSD-vel többre mennél, mint extra három százalékkal vga fronton - mint én, aki videót vág és hozzád hasonlóan van két M.2 ssd a gépben egy 3060 társaságában.[ Szerkesztve ]

-

Teasüti

nagyúr

válasz

Aprósólyom

#82796

üzenetére

Aprósólyom

#82796

üzenetére

Ez szarkasztikus akar lenni? Mert akkor nem egészen értem miért kóstolgat vki, aki letekeri a TDP-t a kártyáján. Ott már teljesen mindegy, hogy 8 vagy 16 sávot kap az a kártya.

-

Aprósólyom

addikt

válasz

Teasüti

#82797

üzenetére

Teasüti

#82797

üzenetére

Egyébként messze nem nincs visszafojtva annyira, mint gondolhatod elsőre. Minden GPU gyárilag jelentősen túl van boostolva az ideális perf/watt tartományhoz képest.

63%-os TDP-re belőtt teszt: 3dmark.com/spy/30561283 (Time Spy graphics score: 3782)

Gyári GTX 1060 6GB kártyák Time Spy Graphics score 4400 pont körül teljesítenek.

15% per. loss @ 37% power loss. Szerintem nem rossz arány ez.

Amikkel én játszogatok, azokhoz még ez a performance is overkill.

Jevons paradox

-

Teasüti

nagyúr

válasz

Aprósólyom

#82799

üzenetére

Aprósólyom

#82799

üzenetére

Jah, hogy ez újdonság volt, hogy a pcie buszok fel vannak darabolva switch-ekkel? Mea culpa.

Akinek fontos az abszolút teljesítmény, annak érdemes figyelni a bekötési diagrammokat. Többek közt ennyivel tud többet X570-es deszka, hogy ott dedikált sávokat kapnak a VGA slotok tudtommal. Meg egy zajkeltőt a chipset.

Szóval jah, vérpistikék örömmel adnak ki nem kevés felárat azért a pár százalékért. Ezen kívül nemigen jut eszembe más felhasználás, ahol szükség van a teljes sávszélességre - esetleg két kártyán is. Vmi brutál render masinán talán, vagy nemtom. Mert amúgy már a 4x sebesség se kevés ha mondjuk SAS kártyákkal akarná vki telerakni a gépét és vmiért egyszerre írja az összes meghajtót.

Egy belépő szintű VGA-t még a 4 sáv is kiszolgál általában. Ezért se kell nagyon fennakadni a verziókon se, mert csak a top kártyáknál lehet ez szűk keresztmetszet.Hmm érdekes. Miből áll tologatni a TDP-t egy VGA-n? Nv control panelen ilyet még nem láttam. Bios-t kell hozzá frissíteni talán? Mert amúgy 15% nekem se számít ha cserébe jóval halkabb lehet a gép. Víz sajnos nincs ezekre a belépő kártyákra.

[ Szerkesztve ]

)

)