Új hozzászólás Aktív témák

-

-

ddekany

veterán

Ha nincs iCloud szinkronizáció, akkor ezzel a módszerrel amit dokumentáltak nem tudják megállapítani, hogy tiltott dolog van-e a képeden. Meg eleve csak már korábban feketelistázott képeket tudnak kiszúrni ezzel a módszerrel, tehát ha te csinálsz egy új képet, akkor eleve tudhatod, hogy nem fogják felismerni.

Amúgy én azt sem értem, hogy ki az, aki ilyen képeket iCloudon akar tartani, méghozzá simán képként? Ha backupnak kell, akkor is azt gondolnám beteszi egy jelszavas zip-be minimum. Szóval mi az use case?

-

Mondjuk szerintem eddig is áttúrták az iCloud-ot

Az vajon gáz, ha nekem helyből le van tiltva a teljes iCloud szinkronizáció? Semmi nem megy felhőbe (legalábbis elvileg), képeket számítógépre mentem...

Semmi nem megy felhőbe (legalábbis elvileg), képeket számítógépre mentem...@bambano : A villogó rendőrautós egy bug, tök felesleges általánsnak beállítani. Amúgy ha megnézel egy bármilyen basic AI-t, ami képeket ismer fel, elég jól kitalálja, hogy ott van-e, amit keresel.

-

nuke7

veterán

Nem, a szerver oldali szűrés nem para, mert a szerver nem a tied, a többi ceg is csinálja, könnyen el tudod dönteni h akarod-e használni és sokkal könnyebb kiszűrni h használod e vagy nem

nincs olyan h titokban feltölti a kepeidet a cloud-ba h scannelje

nincs olyan h titokban feltölti a kepeidet a cloud-ba h scannelje

az adatbázis meg valsz. Azért kell, mert azon train-elik az AI-t, hogy felismerje a azokon a képeken szereplő részleteket más képeken is. Enélkül totál értelmetlen a rendszer, ahogy már beszéltük is.

-

nuke7

veterán

ezt most nem ertem, de amivel én dolgoztam pl. Olyat tudott, hogy egy felhőkarcoló ablaka ha látszott egy képen akkor mindegyik képen megtalálta, kb. Bármilyen szögből… vagy pl esküvői képeken ha valakinek volt egy szép órája, azt is megtalálta, bármi volt a képeken mellette…

ezt most nem ertem, de amivel én dolgoztam pl. Olyat tudott, hogy egy felhőkarcoló ablaka ha látszott egy képen akkor mindegyik képen megtalálta, kb. Bármilyen szögből… vagy pl esküvői képeken ha valakinek volt egy szép órája, azt is megtalálta, bármi volt a képeken mellette… -

ddekany

veterán

Ez, amit az Apple leírt abban a PDF-ben, csak adott képre tud keresni. Azért is kell mögé a CSAM adatbázis. Nem mondja senki, hogy NN-ön megvalósított szoftverrel csak adott képre tudsz keresni, mert nyilván, végtelen féle dolgot megvalósíthatsz rajta.

Lehet, hogy csak annyi az értelme az egésznek (sőt, én erre is számítok), hogy ha nem rejtegetés céljából dolgozol át egy képet, akkor megtalálja. Ezzel alighanem teljesítették, amit a legtöbb képszűrő rendszer, letudták a kötelezőt.

Kiszagoló kutya telepítésre bérelt lakásba... Ha szerver oldalon át tudják nézni a képeidet, az még nagyobb para lenne. De te azt mondod, hogy akkor nem használod a szerver oldalt, azaz iCloud-ot. De, eddigi logikáddal, honnan tudod, hogy titokban néha nem tölti fel mégis valahova a képeidet az iPhone? 100%-osan nem tudhatod. Mint ahogy 100%-osan nem lehetsz abban biztos, hogy ez az új szűrő azt csinálja, amit az Apple állít róla.

-

nuke7

veterán

"...csak adott képeket tudnak keresni" - nem egészen.

5éve dolgoztam egy digitális kép feldolgozó ML startuppal.

Bármilyen részletet megjelölhetsz, az "AI" az ahhoz eléggé hasonló részletet megtalálja bármilyen képen. (cigi, fegyver, bármi)"...de csak konkrétan azokat, megtalálja bárki telefonján" - pont ez a lényeg, hogy az apple nem csak azokat a konkrét képeket keresi, hanem olyan képeket keres. (amin ugyanaz a gyerek van mondjuk vagy ugyanaz a helyzet)

Ha nem így lenne, a rendszernek az égvilágon semmi értelme nem lenne, mert akkor konkrétan kis képszerkesztéssel ki lehetne játszani."De amíg a pedókat az definiálja, hogy CSAM képeket gyűjtenek, amiket be lehet azonosítani..." - pont ez az - szerintem már írták is ebben vagy a másik topikban - ha ez így lenne, akkor ez a rendszer csak a nagyon butákat és a tech analfabétákat tudná detektálni, hiszen ahogy fentebb írtam, nagyon könnyen kijátszható lenne, ha az apple nem képtartalomra keresne, hanem konkrét képre...

"Mondjuk az első videó készítésekor még nem találták meg az AI modellt, lehet hogy csak feltételezte az Apple leírása alapján, hogy hogyan fog működni, és azért mondta/gondolta, hogy visszaállítható. Az viszont biztos, hogy a másnapi videójával ezt ő is cáfolja." - okés, a másodikat nem néztem meg asszem, ennyire nem mentem bele

és mitől lenne más, ha ezt iCloud-on csinálná? Erről is volt már szó, többek között az, hogy biztosan opt-outolni tudsz belőle, és a cloud más mint a privát, offline tárhely/teló.

Hogy tudod-e ellenőrizni, hogy küld-e hash-t a képekről amiket nem akarsz icloud-ba feltölteni... biztos, hogy tudod? Van amit feltöltesz, és van amit nem - de az apple megnézni azt is, amit nem... akkor mi van. Ki tudod-e mérni a különbséget?

Van amit feltöltesz, és van amit nem - de az apple megnézni azt is, amit nem... akkor mi van. Ki tudod-e mérni a különbséget?De, amúgy az összes tech részlettől eltekintve, bambano tök jól leírta, hogy ha te bérelsz egy lakást, akkor a tulaj nem jöhet be és tehet be a lakásodba egy drog kiszagoló kutyát prevenció néven. A kutya csak akkor ugat, ha heroint szagol. Akkor már rögtön jogos...?

-

ddekany

veterán

Amúgy mit kellett módosítani a képen, hogy megváltozzon a NeuroHash? Tehát pl. van a képen egy zsiráf, és zsiráfokat nézegetni, mint tudjuk, tilos. Ha oda teszel egy feltűnő kutyát a kép sarkába (de persze ettől még a zsiráf ugyan úgy látszik, szóval továbbra is baj van), akkor az szerinte még mindig ugyan az a kép? És még több kutyával? Sőt, ha egy többszörösen nagyobb kép közepébe egy az egyben beteszed az eredetit?

-

Ksix

tag

De attól a felhasználó oldalán mi lenne jobb, mi lenne a különbség?! Semmi. Ugyanez az NeuralHash ott is kereshetne a kormány által kényszerített, nem csak CSAM képeket, ha hibásan nézne valakit pedónak, pont ugyanolyan kellemetlen lenne stb. Ami viszont rosszabb lenne, fogalmad se lehetne, hogy mi történik. Ami a telefonon történik azt vissza lehet fejteni, meg lehet figyelni, bele lehet hallgatózni a hálózati forgalomba stb., ez mind elveszne azzal. Most is, ha nem a telefonon/számítógépen van a NeutralHash model, amit ki lehet másolni, meg lehet nézni, lehet vele kísérletezni, hanem a felhőben, akkor sosem lehetett volna leellenőrizni, hogy mit is csinál pontosan. És lehet, hogy sosem lesz titkosított iCloud, de így legalább a lehetőség adott. Szerintem, ha már kell ilyen ellenőrzés, akkor jobb megoldás a telefonon csinálni, mint a felhőben.

-

Ksix

tag

Nem, és nem, és nem. Kérdezz meg bárkit, aki egy kicsit is otthon van AI/ML területen. Nincs paraméter, egyedül konkrét képekhez hasonló képeket tud megjelölni. Tehát az lehet, hogy nem csak CSAM képeket keresnek, mert erre az Apple szaván kívül semmi biztosíték sincs. De akkor is csak adott képeket tudnak keresni, nem tudják azt megcsinálni ezzel, hogy ismerjen fel általánosságban pl. marihuána ültetvényekről készített képeket. Össze kell gyűjteni az összes létező marihuánás képet, és akkor azokat, de csak konkrétan azokat, megtalálja bárki telefonján.

De amíg a pedókat az definiálja, hogy CSAM képeket gyűjtenek, amiket be lehet azonosítani, addig, ha te elnyomó kormány lennél, és ellenzékieket akarnál levadászni, akkor milyen képeket tudnál összegyűjteni, hogy aztán megkeressék, hogy kinek a telefonján van meg, mert az illető a képből következően ellenzéki kell hogy legyen? Az ellenzékiség, a marihuána termesztés nem a képek gyűjtögetéséről szól, ellentétben a pedofíliával, ezért nem igazán lehet képekkel megtalálni ezeket a csoportokat, szerintem ezért sem kell annyira aggódni a képek bővítése miatt. -

Ksix

tag

Tényleg nem értettem, amit írtál, de próbálkozom, és most már azt hiszem igen, és ennek fényében próbálom én is érthetőbben elmondani, hogy én mire gondoltam.

A sima hash mindkettőnknek megvan és világos. Amit én szerettem volna megértetni veled, hogy van egy úgynevezett perceptual hash is, amit a sima hashoz hasonló módon a kép bájtjaiból számolnak ki, egyszerű matematikai módszerekkel, mindenféle AI nélkül, teljesen ugyanúgy, mint az md5, sha1 hash-eket. Csak amíg az md5 számítás eredménye olyan, hogy egy bit változtatás az eredeti adatokon új md5 hash-t eredményez, addig ezek a számítások mondjuk a képet fele felbontásra összenyomva, és az így keletkező teljesen új bájtokon végigszámolva pontosan ugyanazt a hash-t fogják adni. Mert így találták ki az algoritmusukat. Tehát nem azért kell a NeuralHash, mert csak értelmzéssel/felismeréssel lehet előállítani egy képre vonatkozó, képmanipulációt tűrő hash-t, ilyet sima matekkal is létre lehet hozni, ahogy az md5-öt. Csak egyszerűen azok a számítások túl lassúak, nagyon terhelnék a telefon, lemerítenék stb. Az AI meg hardveresen gyorsított, egyszerűbb azt betanítani egy csomó képpel és egy csomó hash-hal, hogy ez a kép, ez a hash, hasonló kép, ugyanaz a hash, teljesen más kép, teljesen más hash. (Oké, van itt egy óriási leegyszerűsítés, de az a valóságot nem torzítja.)

„Pont azt a techinkát használják, ami megmondja, hogy kutya, melltartó vagy Kovács Pisti van-e az adott képen, csak ezt kvázi titkosítják, ez a neural hash.”

Na ez az, ami totális tévedés, és semennyire sem igaz, és mégis ezt ismételgeti itt mindenki, én meg úgy érzem, hogy hiába is magyarázom, hogy de hát ez nagyon nem így működik, mert úgy tűnik, nincs meg a szükséges AI ismeret hozzá (pedig aztán én sem tudok túl sokat). Úgyhogy most próbálom két különböző hasonlattal is megvilágítani, hogy ez miért tévedés. Az első, a mondatod kifordítása:

Pont azt a technikát, a számítógépet használják arra, hogy táblázatot lehessen kezelni Excelben, csak ezt kvázi titkosítják, és ez a Fortnite.

Attól, hogy egy számítógéppel lehet Excelezni, meg Fortnite-ozni, attól még nem lehet Excelben Fortnite-ozni, és a Fortnite-ban sem táblázatkezelni. És nincs olyan paraméter, amit az Excelbe beírva Fortnite lesz belőle, és a Fortnite-nak sincsen titkos billentyűkombinációja az Excellé váláshoz.

Az AI csak egy üres vászon, semmit nem tud, meg kell tanítani mindenre. Az az AI, amit macskák, melltartók és emberek felismerésére tanítottak, az nem tud NeuralHash-t produkálni, és fordítva, teljesen máshogy van huzalozva, teljesen más a kimenete, teljesen más az egész. Nem lehetséges olyan csodaparaméter, amit átállítva ilyen történhetne, a komplett AI modellt le kellene cserélni ehhez, egy olyanra, ami azt tanulta. A képfelismerő és a NeuralHash AI-ban csak annyi közös, hogy mind a kettő AI, pontosan, ahogy az Excelben és a Fortnite-ban is csak az közös, hogy mind a kettő program.

Második hasonlat, az ember. Veszünk egyet, és hosszú évek alatt megtanítjuk a teljes történelemre, fejből tud minden eseményt, évszámot stb. Bármilyen történelmi kérdésre azonnal tudja a választ. Aztán adunk neki egy kétismeretlenes egyenletet. Pontosan annyira fogja tudni megmondani az eredményt, mint amennyire a NeuralHash meg tudja mondani, hogy mi van a képen. És hiába rugdosod, viszel be akármilyen paramétert, nem fogja tudni megoldani. (De amíg egy embert meg lehet tanítani több dologra, addig egy AI-t nem igazán, ezért is nem kell tartani attól, hogy öntudatra ébrednek és átveszik a hatalmat. Egy-egy dolgot nagyon jól megtanulnak, de képtelenek a különböző tudást kombinálni.)

De ez is egy olyan dolog, amit bárki le tud ellenőrizni, hiszen ez az AI modell letölthető, ki lehet próbálni, be lehet tölteni egy modell megjelenítőbe, meg lehet nézni a neurális hálózatot, hogy nincs rejtett paraméter, egyetlen kép bemenete van, tesztelni lehet, hogy mi történik ha vizuálisan hasonló tartalmú képeket kap (ugyanazt a hash-t dobálja ki), és mi lesz, ha mondjuk 8 db vizuálisan teljesen különböző, de macskát tartalmazó képet adunk neki (totálisan különböző hash-okat fog adni). És én erről beszéltem eddig, hogy a NeuralHash generálásba az Apple nem tud észrevétlenül beleavatkozni, mert amint változtat, lecseréli a modellt, rögtön megint meg lehet nézni, hogy mi változott, mit csinál máshogy az AI.És értem a perspektívát, így másodszorra, de én sem vontam sosem kétségbe, hogy kizárólag az Apple tudja, hogy valóban csak CSAM hash-ra szűrnek-e, vagy más képek is bekerülnek. Hiszen ez nem csak a dokumentációból derül ki pontosan, hanem az első pillanatban ők is bejelentették, hogy igen, ők gondoskodnak erről, és nem engednek majd később sem a kormányzati nyomásnak. Amit ízlés szerint, vagy elhisz az ember, vagy nem. Mint ahogy azt is valaki vagy elhiszi a Microsoftnak, hogy ők a saját ilyen PhotoDNA algoritmusukat csak a felhőben használják, vagy ellenkezőleg, azt hiszi, hogy kormányzati nyomásra már rég beépítették a Windowsba is, és évek óta kutatják már vele a felhasználók gépeit. Az IT-ben elég sok dolog szól a bizalomról.

Olyan viszont nem lehet, hogy nem csak az iCloudba feltöltött képeket ellenőrzik, mert vagy az összes kép felmegy, vagy egy sem. A hálózati forgalmat nagyon jól meg lehet figyelni, rögtön lebukna az a telefon, ami kikapcsolt iCloud mellett is küldözget ilyen adatokat.

„és amúgy a te általad linkelt videóban hangzik el, hogy a perceptual hash-ből rekrálható a kép, ezért titoksítják tovább.”

Ez totálisan kizárt, lehetetlen, úgyhogy ha tudod, írd már meg az időpontot, hogy mikor hangzik ez, hogy meghallgassam, mit mond valójában. Hacsak nem egyszerű szótévesztés volt. De azért is biztos, hogy nem ezt mondta, mert a második videó pont ennek az ellenkezőjéről szól. Mert azzal, hogy megvan az AI modell, neki lehetett állni a gyenge pontok támadásának, és pont ezt csinálja abban a videóban. Szintén ott a letölthető, kipróbálható kód, ami forced hash collisiont generál, azaz előállít egy olyan képet, ami ugyanazt a NeuralHash-t eredményezi, mint egy emberi szem számára ránézésre teljesen más kép. A második videóban az alsó kutyás kép, és a Titanic kép NeuralHash értéke teljesen ugyanaz. Ha ebből a hash-ből tényleg visszaállítható lenne a kép, akkor melyik jönne vissza, a Titanic, vagy a kutyák? De feltölthetem ide azt is, amivel én kísérletezem, egy kép, meg a vízjelezett változata, ugyanaz a NeuralHash-ük, ha abból vissza lehetne állítani, melyik jönne vissza, a vízjeles, vagy az anélküli?

Mondjuk az első videó készítésekor még nem találták meg az AI modellt, lehet hogy csak feltételezte az Apple leírása alapján, hogy hogyan fog működni, és azért mondta/gondolta, hogy visszaállítható. Az viszont biztos, hogy a másnapi videójával ezt ő is cáfolja. -

ddekany

veterán

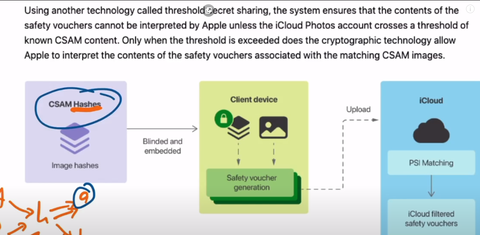

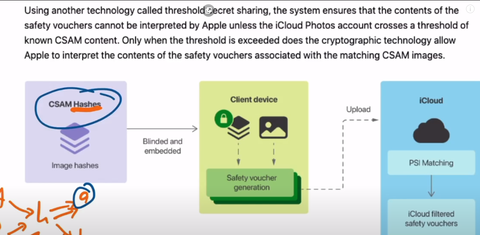

Tehát, van egy matematikai/kriptográfiai módszer, és az az állítás, hogy ők ezt fogják alkalmazni. Csak összefoglalásként, a kliens (a telefonod) nem tudja megállapítani, hogy feketelistás-e egy kép. Csak a szerver tudja megállapítani. Viszont ha nem az, akkor meg szerver nem tud semmit a képedről. Ez a "matematikai" ötlet, és ennél többet nem tudom mit lehetne tenni az ügy érdekében. Persze, ha átmegy Dr. Evilbe az Apple, akkor lazán csinálhat bármit, hiszen ő telepíti a szoftvere a telefonodra, meg mellékesen ő készíti a SoC-ot amin fut minden. Igazából az tartja vissza bármitől, hogy ha ilyet csinál, és ez kiderül, akkor a jelenlegi nyugati világban lehúzhatja a rolót. Ez persze akkor is egy veszélyes játék (főleg attól tartanék, hogy az állam mire "kéri"), mint ahogy az egész high-tech behálózott világ az, az egyre durvább lehetőségekkel. De nem tudom miért pont a fent vázolt megoldás veri ki a biztosítékot.

-

bambano

titán

még mindig arról van szó, hogy egy orbitális maffiózó azzal az állítással próbálja csökkenteni a bűnét és a kiborult bili miatti pr katasztrófát, hogy azt állítja, hogy csak akkor néz bele a képbe, ha feltöltenéd. vagyis most, vagyis csak az amcsiknak.

és mi van akkor, ha idejön nyaralni egy amcsi, és a fotóját feltöltené a cloudba? a telefonján futó kém/adatrabló szoftver tudni fogja, hogy eu-ban tartózkodik?

tehát az a program, ami most csak ezt csinálja és csak az usában, az később soha semmi mást sem fog csinálni? -

#79734528

törölt tag

a technológiát nem tudod megmondani, hogy az apple például mire fogja használni, azt a technológiát amire még törvény sincs.

a telefonod is egy technológia.

olyan technológia kellene mint a blokklánc amibe ilyen apple féle cégek nem igen tudnak beleszólni

apple M1 processzor na abba a technológiába szóljál bele. (ugye azt is megveszed tiéd, de ki tudja mi van benne

)

)

intel proci hátsó kapu pld.

vagy a facebook saját krypto, na abba szóljál bele, vagy államilag szabályozd le.

vagy a vakcina technológiába ami ugye nélkülözhetetlen. -

bambano

titán

"De hát ezzel mégis mit lehetne kezdeni? Vagy nincs kép szűrés, vagy pedig van ez a feszkó,"

eléggé egyértelmű.

a gond az, hogy ez egy technológia, ami valamire jó. letiltod vagy nem. de van mellette egy rakás másik technológia, aminek mindegyike jó egy valamire, vagy letiltod, vagy nem, de azt soha senki nem gondolta végig, hogy ezek *együtt* mire jók.

például ha ble-vel kommunikálhatnak a telefonok, akkor egy nagyobb tömegben elegendő egyetlen telefon, amelyiken nincs rendesen letiltva minden, máris kimehet az összes adat a teljes bandáról.vagyis ha tartani akarod a törvényeket, egyetlen megoldásod marad: kitiltani az összes apple telefont az országból. aki megvette, leadhatja a rendőrségen, a boltokba pedig nem szállítani többet, a határon pedig bezacskózni minden idelátogató külföldi telefonját.

-

ddekany

veterán

"Pont azt a techinkát használják, ami megmondja, hogy kutya, melltartó vagy Kovács Pisti van-e az adott képen, csak ezt kvázi titkosítják"

De nem. Sehol nem fér el egy telefonban egy akkora neurális háló, ami érdemi szemantikai leírást tud adni egy képről (sőt, elég korlátosan tudunk úgy általában ilyet csinálni... lásd pl. önvezető autók vergődését a látvány értelmezésében). Illetve mekkora az a hash, hogy ez szerinted beleférne? És ha így is benne lenne túl sok információ, nem küldi el a telefon a neural hash-t a szerverre. Csak azt tudja ellenőrizni a szerver oldal, hogy fekete listázva lett-e olyan neural hash, mint ami a te képedé, de ha erre az a válasz, hogy nem, akkor nem fogja tudni a képed hash-ét sem (mert, Private Set Intersection).

Mint mondtam, igen, nyilván nem tudhatod, hogy milyen képeket feketelistáztak, azaz nyilván nincs arra technikai/matematikai garancia, hogy csak a CSAM-al foglalkozó hivatalos szervektől kapottakat veszik fel. Vagy hogy holnap nem kopog az állam, hogy heló Tim, ezeket Bástya elvtársat gúnyoló képeket is vegyétek fel. De hát ezzel mégis mit lehetne kezdeni? Vagy nincs kép szűrés, vagy pedig van ez a feszkó, hogy na vajon holnap még mit akarnak detektálni.

Ha persze az a kérdés, hogy majd a disztropikus jövőben mi lesz... Tippre, nem fognak igyekezni még a látszatot sem fenntartani. Az arra feljogosított szervek megnézhetik mindenedet, kész. De itt még az Apple a jelek szerint épp küzd, gondolom hogy egy kis PR előnye legyen belőle. Persze eléggé fordítva sül el a dolog, mert a kriptorgárfia túl nagy brainfuck, és nem értik a felhasználók. De ismét, ha kell szűrni, akkor mit lehet még tenni?

-

nuke7

veterán

nem nézted akkor végig a videót, vagy nem értetted - azt se amit írok akkor.

A sima hash - amit eddig is használtunk file integritás ellenőrzéséhez - nem működik a CSAM célra.

azért kell a neural hash-nek értelmeznie a képet - és ezért is reprodukálható a képe a neural hash alapján - mert a sima hash nem fog egyezni, ha bármit módosítasz a képen. Tehát nagyon könnyű lenne kijátszani.

Pont azt a techinkát használják, ami megmondja, hogy kutya, melltartó vagy Kovács Pisti van-e az adott képen, csak ezt kvázi titkosítják, ez a neural hash.#37 & #38: miért nem érted, hogy az apple rendszer most csak a CSAM adatbázis alapján keres. De nem fogod tudni, hogyha esetleg más adatbázis alapján is keresni fog, mert megtehetik, az ai megvan rá, és ez bassza nagyon sok embernek a csőrét (többek között) mert most azt mondják, hogy csak azokat a képeket nézik, amiket te feltöltenél icloud-ba.

De a körítés a linkelt videón, pont arról szól, hogy ezt egyáltalán nem tudod, hogy betartják-e.

Nem tudod, hogy csak CSAM adatbázissal hasonlítják-e össze a képeidet, és nem tudod, hogy csak azokat, amiket icloud-ba feltöltesz.

És igen, eddig is létezett már képfelismerő az apple-nél ami a telefonon futott, de eddig nem volt ellenőrzés, és ezek nem kerültek be (titkosítva se) egy adatbázisba. Erre épült most ki az infrastruktúra, nem a kép értelmezése a nagy wasistdas itt

és amúgy a te általad linkelt videóban hangzik el, hogy a perceptual hash-ből rekrálható a kép, ezért titoksítják tovább.#42 ddekany : hát igen, és van aki ezt elhiszi nekik, van aki nem...(hogy nem küldi el nekik)

disclaimer: én - habár foglalkozom fejlesztéssel - nem vagyok cryptographic szakértő, csak tolmácsolom neked a videót, és azt a perspektívát amit nem szeretnél valami miatt megérteni.

-

Ksix

tag

Oké, sejtem már, hol van a félreértés. A felsorolt cégek nem a konkrét CSAM képeket kezelik, az tényleg törványsértő lenne, hanem csak a képek hash értékeit, amiben viszont már nincsen semmi törvénytelen. A hash-t minden esetben a képeket törvény alapján kezelő NCMEC készíti el a cégeknek.

-

bambano

titán

a másik topicban linkelték.

azért törvénytelen, mert aki csam képet talál, az kizárólag az illetékes hatóságnak jelentheti és semmi mást nem tehet vele.az, hogy az ms, a google, a facebook meg a többi ostoba adathörcsög évek óta törvényt sért, nem menti az apple-t, csak annyit jelent, hogy szégyellhetjük magunkat, hogy még nem vágtuk pofán őket egy bazi nagy szeneslapáttal.

hagy válaszoljak a #27-re is: alapszabály, hogy aki indokolatlanul eltakarja a szemét, az hazudik. Tehát a hsz-ben másodiknak linkelt videó helyes nézési módszere a következő: elindítod, meglátod, hogy bazi nagy napszemüveg van a képén, bezárod a böngésző tabot.

-

Ksix

tag

Miért lenne törvénysértő, hol van ez a linkelt poszt? Microsoft már több mint 10 éve feketelistázza a CSAM képeket, és nincs olyan nagy internetes közösségi, tartalom, vagy tárhely szolgáltató, aki ne csinálná ugyanezt. Embereket tartóztattak le ilyen bejelentések alapján, csak szólt volna már a rendőrség, hogy ne csinálják, mert törvénytelen.

-

Ksix

tag

Továbbra se értem, hogy mi a hazugság, hol az ellentmondás a videóban? Az első pillanattól kezdve azt mondta az Apple, hogy a pedo képek hash értékeit csak ő kezeli, és nyilván csak ő juttathatja el a telefonokra az összehasonlításhoz. Mit köze van ehhez a NeuralHash-nak, és mit hazudnak erről a 6. percnél?

Nem jól érted a rendszer működését. Az AI modellnek semmi köze a CSAM képekhez, az csak arra lett betanítva, hogy perceptual hash-t generáljon a képből, hogy össze lehessen hasonlítani egy másik kép perceptual hash-ével. Ami egyezni fog, ha eléggé hasonló a két kép. Az AI nem csinál semmilyen összehasonlítást, csak kiköp egy számot. Töltsd le, próbáld ki!

Ez egy NeuralHash érték: a08c853d711ee3edb362f40b. Ha ebből vissza lehetne állítani az eredeti, néhány MB-os képet, akkor rögtön meg is lenne a világ leghatékonyabb tömörítési eljárása. -

Ksix

tag

Igen, innen indultunk, hogy nem kriptográfiai hash-ról („sima” hash) van szó, hanem perceptual hash-ról:

Perceptual Hashing

Perceptual Hashing

Perceptual image hashes

Erre van többféle módszer, egyik sem „értelmezi” a képet, csak kiszámolnak rá egy olyan hash-t, ami hasonló képek esetén hasonló lesz.

Hogy az Apple módszere mit csinál, azt itt lehet megnézni:

https://github.com/AsuharietYgvar/AppleNeuralHash2ONNX

Letöltöd, adsz neki egy képet, és kiköpi a NeuralHash értéket. Raksz a képre vízjelet/átméretezed/újratömöríted, és megnézheted, hogy mennyire változik. Semennyire. -

Ksix

tag

Mit értesz azon, hogy értelmezni?! A NeuralHash model nem értelmez, megnézi a képet, és generál hozzá egy hash értéket. Mint ahogy az md5sum program sem értelmezi a fájlt, csak megnézi a benne lévő bájtokat és azok alapján kiszámolja az md5 értéket. És nyilván az összes (iCloudba feltöltendő) képet átnézi, ez a módszer lényege, mindegyiket megnézi, mindegyikhez generál egy hash értéket, amit aztán majd össze lehet hasonlítani a pedofil képek hash értékeivel. Hol van itt a hazugság?!

-

Ksix

tag

Akkor miért nem arról beszél? Miért a kriptográfiai hash-ról beszél, amikor ahhoz ennek semmi köze, miért arról beszél, hogy mit csinál a Facebook, Google, Tesla? Mi köze van ezeknek a cégeknek az Apple CSAM megoldásához? Tipikus politikusi érveléstechnika, soroljunk fel egy csomó, a tárgyhoz hasonló, de valójában semmilyen formában nem kapcsolódó, ellenőrizhetően igaz állítást, azzal majd a mi teljesen alaptalan állításunk is alátámasztottnak tűnik. Szerinte a telefon kamerája valós időben felismer dolgokat, és azonnal jelenti az Apple felé, ezt ő honnan tudja, megtalálta a kódot a telefonon, megfigyelte a hálózati forgalmat? Nem hinném, mert láthatóan IT alapokkal sincsen tisztában, összekever két teljesen különböző technológiát (BLE, UWB), olyan dolgokról hazudik, amit otthon minimális IT tudással bárki le tud ellenőrizni, hogy nem is úgy van stb. Miért nincsen semmi indoklás, magyarázat a kijelentéseire? Így van, csak azért, mert én ezt mondom, demagógia csúcsra járatva.

Egyébként az iPhone-okon, Apple által is bejelentve, az iOS 10 óta vannak képfelismerő algoritmusok, amik megmondják, hogy ez egy cica, az egy melltartó, az meg ott a Kovács Pista, tehát már ~5 éve folytathatnák ezt a világkémkedést, ha az lenne a cél, ezeket már nem kell belerakni. De a fickó szerint nem ezeket az évek óta meglévő dolgokat használják csendben és titokban, hanem most, nagy felhajtással bejelentenek egy új módszert, amit jelenleg is bárki letölthet és ellenőrizhet, hogy mit csinál, és azzal akarnak kémkedni. Aha, ez így tök logikus, értem, biztos így is van, hiszen ő azt mondja! -

ddekany

veterán

Nyilván nem tarthatod te kézben, hogy mit feketelistáznak. Úgy nem lenne értelme. Sőt, azt se tudhatod, hogy valami bejelzett-e vagy sem (különben könnyebben megtanulhatnád kijátszani). Viszont csak azokat a képeidet tudják megnézni matematikai okból, amivel megegyező hash-űt már korábban feketelistáztak.

-

nuke7

veterán

ott az ellentmondás, hogy nem tudod - mivel nem nyilvános - hogy mire jelez be.

azt az apple dönti el - ott is gondolom viszonylag magasan - hogy mit flageljen pozitív találatnak.

Ez a probléma, hogy megnézi az összes fotód és nem tudod hogy mi alapján flaggeli, csak elhiszed, hogy csak a CSAM adatbázison edzett neural network értelmezésében létrehozott dolgokat csekkolja. De miután ez működik, ki mondja meg, hogy csekkolja-e más adatbázishoz képest is a képeidet vagy nem..?

Az ezek mellett már totál részletkérdés, hogy akik nézik / felügyelik a rendszert, azok látják-e konkrétan vagy tudják-e rekonstruálni a képet vagy nem. (nyilván benne van a videóban, hogy a sima neural hash-ből rekonstruálható a kép...) -

nuke7

veterán

How Apple scans your phone (and how to evade it) - itt már a 6. percben tetten érhető egy hazugság..

ennél a résznél, ahol a neural hash jön, ott van a lényeg. A neural hash-nek értelmeznie kell a képet - tehát meg kell vizsgálnia a képeidet, különben nem tudja értelmezni. Tehát át kell néznie azokat a képeidet is, amik nincsenek benne a CSAM adatbázisban. -

Ksix

tag

Ez valami rossz vicc?! Egy digitális laposföld hívő?! Ordas nagy tárgyi tévedések, szakmai ismeretek teljes hiánya (hash = kriptográfiai hash), nem értem hogy működik, nem nézem meg hogy működik, de én olvasok a sorok között, ezért tudom, hogy így működik, teljesen biztosan ezt és ezt csinálja, 0 szakamai érv, bármilyen minimális ténnyel való alátámasztás nélkül?! Azt a rohadt életbe, ennyi demagóg bullshit egy kupacban, nem semmi!

Könyörgöm, szakemberek videóít nézzük, ha valaminek a működésére vagyunk kíváncsiak, ne kuruzslókét. Ugyan ebben is vannak apró tárgyi tévedések, de legalább szakmailag alapos:

How Apple scans your phone (and how to evade it) - NeuralHash CSAM Detection Algorithm Explained

Mert már annyira pontosan lehet tudni, hogy hogyan működik, hogy reprodukálták is, ahogy azt már pár hozzászólással előbb linkeltem is, és aki ért hozzá, az demózni is tudja:

NeuralHash is BROKEN - How to evade Apple's detection and forge hash collisions (w/ Code)

Így néznek ki a megalapozott, szakmai videók, ellentétben azzal, amikor valaki fog egy mikrofont, és folyamatosan ismételgeti, hogy a föld az lapos, mert a föld az lapos, érted, lapos. -

Köszönöm, nagyon jó előadás!

Nagyjából ettől tartottam eredetileg is.

Tehát az azonosítás magán a telefonon történik, és a HASH nem a képek tartalmával kapcsolatban kerül elő, hanem a keresési szabályok elrejtésében -- és ezek a szabályok, tehát az, hogy éppen milyen tartalmat keres a rendszer a fájljaimban vagy a kamera élőképén, baromi könnyen és diszkréten módosíthatók, finomíthatók.

MaCS

-

-

Ksix

tag

Pl. az Apple oldalán is ott vannak az infók, ők NeuralHash márkanéven futtatják a saját hash algoritmusukat, úgy szerepel ezekben a doksikban:

https://www.apple.com/child-safety/

Általánosságban pedig perceptual hashing, vagy perceptual image hashing néven futnak ezek a módszerek, arra érdemes rákeresni (én olvasni jobban szeretek, de a YouTube-on is vannak videók a témában), két random rövid oldal:

http://www.bertolami.com/index.php?engine=blog&content=posts&detail=perceptual-hashing

https://jenssegers.com/perceptual-image-hashes

A elsőn jók a mintaképek, hogy milyen torzítások után minősül még hasonlónak 2 kép, a másodikon meg jól látszanak egy lehetséges hash számolás lépései.

De már az Apple által jelenleg használt konkrét módszert is visszafejtették:

https://github.com/AsuharietYgvar/AppleNeuralHash2ONNX

Azt mondja az Apple, hogy ez még nem a végleges, de majd ha készen lesz, azt is nyilvánosságra hozzák. -

Ksix

tag

Ez nem olyan hash, mint ami a fájlok vagy jelszavak ellenőrzésére szolgál (MD5, SHA1, BCrypt stb.), amiknél már egyetlen bit változásának hatására új hash érték keletkezik. Pont ellenkezőleg, jól tűri az egyszerűbb képszerkesztéseket is, és azok után is ugyanazt a hash-t eredményezi, mint amit az eredeti kép.

-

strogov

senior tag

"a saját intim dolgait tárolja ott és tegyük fel bejelez a rendszer és egy munkatárs nézi meg más személyes dolgait és vigyük tovább a dolgot, mi van ha a munkatárs letölti és megosztja más személyes tartalmát?"

Itt nem arról van szó, hogy betanított gépi látás algoritmus keres valamit. Ebben a mostani esetben a risztás konkrét képekre vonatkozik nem elvont tartalomra. Az apple olyan képek hash-ét futtatja végig a rendszeren amiket pedofil tartalomként hatóságilag megjelöltek már. Mint a cikk írja több országban. Ha egyezés van akkor jön egy manuális ellenőrzés.

-

arnyekxxx

veterán

válasz

craftsman01

#12

üzenetére

craftsman01

#12

üzenetére

Gondolom párhuzamosan legalább 2 külső vinyón hiszen fontos dolgok

-

craftsman01

senior tag

Soha nem töltenék fel felhőbe semmit,se kép se dokumentum,még saját gépen sem biztonságos tárolni.Ezért képeket és dokukat is külső vinyón tárolok,ha kell valami rádugom gépre mejd egyből kihúzom.De ez én vagyok.

-

Ksix

tag

1. Mert amíg 2019-2020-ban a Facebook 36 191 727, a Google 995 987, addig az Apple csak 470 bejelentést tudott tenni az esetleges pedofíliával kapcsolatban, nagyon ideje volt kitalálniuk erre valamit.

2. Az Apple nem a felhasználói adatainak az eladásából él, mint a Google/Facebook, így nincs jelenleg infrastruktúrája az iCloud tartalom szkennelésére. (Ebből is adódnak a fenti számok, a többiek nyilván amúgy is folyamatosan elemzik a profilozáshoz az összes feltöltött adatot, nulla erőforrás igénye van, hogy eközben még pedofil képeket is keressenek.) Ha már csinálnak erre valamit, miért ne a telefonra készüljön? A macskás képek felismerését sem a felhőben oldották meg, mint mások, hanem a telefonon.

3. Ha a telefonon történő ellenőrzéssel még a feltöltés előtt ki tudják szűrni a pedofil képeket, akkor a későbbiekben sem lesz szükségük arra, hogy hozzáférjenek a felhőben tárolt tartalomhoz. Így majd úgy tudják bevezetni az Apple által sem elérhető, titkosított iCloud szolgáltatást, hogy nem lehet majd arra felhozni azt az érvet, hogy de hát a titkosítás miatt majd odamegy az összes pedofil, és igazából őket védi az Apple, amikor nem hajlandó feltörni/kiskaput építeni a szolgáltatásba. Persze ez a legutolsó csak egy elmélet, de nem lenne meglepő, ha jövőre bejelentenének egy ilyen szolgáltatást. -

ddekany

veterán

Miért vezette ezt be az Apple? Mármint ez miért jó nekik?

-

Cathfaern

nagyúr

"Mi van ha ahogy a Macs_70 írta valaki a saját intim dolgait tárolja ott"

Nyilván lesz egy szerződés módosítás amit el kell fogadnod. Szóval akkor vagy nem fogadod el, és nem használhatod az iCloud-ot, vagy elfogadod és a) nem töltesz fel ilyen képet, b) elfogadod hogy lehet azt valaki átnézi.

Ez amúgy a legtöbb kép/videófeltöltőre igaz, hogy bármikor lehet hogy ellenőrzés céljából ember át fogja nézni amit feltöltesz oda (igen, mindegyiknél elfogadod ezt). -

Ksix

tag

„egyáltalán hogyan ellenőrizhetik a tulajdonomat képező eszköz tartalmát”

Úgy, hogy aktívan a hozzájárulásodat adod, amikor igénybe veszed az opcionális iCloud szolgáltatáson belül a szintén opcionális iCloud Fotók szolgáltatást. Része lesz a felhasználási feltételeknek, amit el kell fogadnod, majd még külön be is kell kapcsolnod, hogy igen, te szeretnéd hogy feltöltse az eszköz a képeidet a felhőbe, ahol az Apple és a hatóságok törvényben meghatározott módon amúgy is hozzáférnek, az összeshez, nem csak a pedofilnak jelöltekhez.„kizárólag engem illető adatokhoz egy szabályozott és garanciákkal ellátott jogi eljáráson kívül bárkinek hozzáférése legyen -- különösen egy adatokra éhes magáncégnek”

Ha el is tekintünk az előzőtől, akkor is, az eszközön történő ellenőrzés pont arról szól, hogy a magáncégnek ne legyen hozzáférése. Nem a magáncég kapja meg a képeket, és ellenőriz, hanem az oprendszer. Ha én feltelepítem a Windowst egy számítógépre, az nyilván hozzáfér a gépen tárolt összes adathoz, de ez még egyáltalán nem jeleni azt, hogy a Microsoft is hozzáférne azokhoz. Vagy, az Android is hozzáfér a telefonon készített összes képhez, hiszen vissza tudom nézni azokat a telefonon, akkor ezzel egyben az adatokra éhes Google-nek is hozzáférése lenne az összes képhez?!„Ha pedofil tartalmat tudnak keresni, akkor a sima és a házi pornót is, akár csak a templomi felvételeket, a politikai tartalmakat és az orvosi anyagaimat”

Nem, mert a keresés nem a látható tartalom elemzésével dolgozik, nem képfelismerő algoritmus. Csak generál egy azonosítót a képekről, amit összevet a már ismert pedofil képek adatbázisában tárolt képekről ugyanígy generált azonosítókkal. Amíg a házi pornó, templomi, politikai és orvosi anyagok nem kerülnek be a pedofil adatbázisba, addig nem tud keresni azokra.„és ha már egy Apple jellegű cég is jogosultságokat kaphat, ott szerintem megjósolható a sok ártatlan meghurcolásával járó túlkapások sorozata.”

A Google/Facebook/Microsoft/stb. több mint 10 éve használja ezeket a jogosultságokat, és keresi a pedofil tartalmakat, ennyi idő alatt hány ártatlant hurcoltak meg miattuk, és milyen túlkapások voltak eddig? Másrészt, ha a telefon beazonosít 30 db olyan képet, amik már léteznek és szerepelnek a pedofil képek adatbázisában, és amiket csak ekkor, megnéz egy Apple alkalmazott is, és ő is azt látja, hogy valóban azokról a pedofil képekről van szó, és csak ezután kerül elő a hatóság, hogyan fordulhatna elő ilyen esetben „ártatlan meghurcolása”? És, ha mégis előfordul, a hatóságokon kívül ki tudná ezt megállapítani? Döntse el az Apple/Google/Facebook/Microsoft/stb., hogy áh, ez biztos csak egy ártatlan illető? -

KISDUCK

addikt

Szép és jó dolog a pedofília ellen harcolni, de gondolom akkor ezeket a felhőben tárolt adatokat "robot" fogja átnézni. Mi van ha ahogy a Macs_70 írta valaki a saját intim dolgait tárolja ott és tegyük fel bejelez a rendszer és egy munkatárs nézi meg más személyes dolgait és vigyük tovább a dolgot, mi van ha a munkatárs letölti és megosztja más személyes tartalmát? Akkor mosakodhat majd az apple rendesen...

Nem rég volt egy hasonló eset amikor az illető beadta a telefonját szervízbe és a kolléga a telefonon tárolt intim anyagokat közszemlére tette. [forrás]

Nincs apple eszközöm, nem tudom hogy működik ott a felhő, de nem lepődnék meg ha ennek hatására más felhő szolgáltatást keresnének azok akik használják. Persze tudom most ez elég szélsőséges példa volt, de sajnos benne van a pakliban hogy olyan fog szenvedni miatta akinek nem kéne. -

A fő gond nem az, hogy mit, mennyit és milyen szigorral keresnek -- ezek gyakorlatilag részletkérdések ahhoz képest, hogy egyáltalán hogyan ellenőrizhetik a tulajdonomat képező eszköz tartalmát.

Én speciel nem tartozom a vérmesebb adatvédők közé (bár a munkám miatt ismernem kell ezt a területet), és a ma divatos szintnél nagyobb toleranciát tanúsítok a hatósági hozzáférések irányában, de azt elfogadhatatlannak tartom, hogy az elméletben kizárólag engem illető adatokhoz egy szabályozott és garanciákkal ellátott jogi eljáráson kívül bárkinek hozzáférése legyen -- különösen egy adatokra éhes magáncégnek.

Ha pedofil tartalmat tudnak keresni, akkor a sima és a házi pornót is, akár csak a templomi felvételeket, a politikai tartalmakat és az orvosi anyagaimat. Ezek alapvető elvi kérdések, és nem a részleteiknél, hanem az alapvető kereteiknél kell kezdeni a vizsgálódást.

Ja, és még valami, bár ez már nem közvetlenül az adatokhoz kapcsolódik: több esetben is volt szerencsém (hálistennek nem a saját bőrömön) megtapasztalni, hogy milyen az, amikor valakit pedofil tartalmakért vesznek elő. Ezekben az esetekben végül tisztázódott, hogy a meggyanúsított személyeknek bizonyíthatóan semmi kapcsolatuk nem volt kiskorúakkal kapcsolatos intim tartalmakhoz, de eddig sok (szintén tiszta) ember nagyon személyes adatainak a megismerésén keresztül vitt az út. Ezeknek az embereknek a legintimebb, addig megfelelően bizalmasan kezelt képeiben, videófelvételeiben, szöveges anyagaiban vállig turkált egy csomó illetéktelen. A pedofil tartalmak kiszűrése nyilván brutálisan komoly prioritás kell, hogy élvezzen -- csakhogy ennek az arányait nagyon könnyű elszabni, és ha már egy Apple jellegű cég is jogosultságokat kaphat, ott szerintem megjósolható a sok ártatlan meghurcolásával járó túlkapások sorozata.

MaCS

Új hozzászólás Aktív témák

- Game Pass Ultimate előfizetések 4 - 19 hónapig azonnali kézbesítéssel a LEGOLCSÓBBAN! AKCIÓ!

- Eladó Steam kulcsok kedvező áron!

- Adobe Előfizetések - Adobe Creative Cloud All Apps - 12 Hónap

- Eredeti Microsoft termékek - MEGA Akciók! Windows, Office Pro Plus, Project Pro, Visio Pro stb.

- Játékkulcsok olcsón: Steam, Uplay, GoG, Origin, Xbox, PS stb.

- Samsung Galaxy A23 128GB Kártyafüggetlen 1 év Garanciával

- Telefon felvásárlás!! Honor 90 Lite/Honor 90/Honor Magic5 Lite/Honor Magic6 Lite/Honor Magic5 Pro

- ÚJ HP OmniBook Ultra Flip 14"OLED 2,8 K 120Hz - Ultra 7 256V - 16GB - 1TB - 2,5 év gari - MAGYAR

- Telefon felvásárlás!! iPhone 11/iPhone 11 Pro/iPhone 11 Pro Max

- ÁRGARANCIA!Épített KomPhone i7 14700KF 32/64GB RAM RTX 5090 32GB GAMER PC termékbeszámítással

Állásajánlatok

Cég: PCMENTOR SZERVIZ KFT.

Város: Budapest

Cég: CAMERA-PRO Hungary Kft.

Város: Budapest

ezt most nem ertem, de amivel én dolgoztam pl. Olyat tudott, hogy egy felhőkarcoló ablaka ha látszott egy képen akkor mindegyik képen megtalálta, kb. Bármilyen szögből… vagy pl esküvői képeken ha valakinek volt egy szép órája, azt is megtalálta, bármi volt a képeken mellette…

ezt most nem ertem, de amivel én dolgoztam pl. Olyat tudott, hogy egy felhőkarcoló ablaka ha látszott egy képen akkor mindegyik képen megtalálta, kb. Bármilyen szögből… vagy pl esküvői képeken ha valakinek volt egy szép órája, azt is megtalálta, bármi volt a képeken mellette…