Új hozzászólás Aktív témák

-

HSM

félisten

"Szerver procikat nem akartam idekeverni, tehát a HEDT vonalat hagyjuk"

Akkor legyen itt példának a 3800XT vagy a 3900X szemben az 5600X-el vagy 3300X-el. Magszám * erőben is jobb a 3800XT, hát még a 3900, mégis az 5600X arat a legtöbb játékban a 3300X meg ott van a nyakukon."de a gyakorlat ma még kevésbé mutatja ezt"

A gyakorlat azt mutatja, hogy nyilván ha 2 mag is megoldja erőből a 60 FPS-t, akkor az már egy alap szintre elég. Persze, én és amúgy sokan mások sem 60 FPS-re gyúrunk, én jobban szeretem, ha azért 100 környéke megvan átlagban, és ez a 144Hz-es monitorom előtt is így volt már. Illetve én kényes vagyok a mikrolaggokra, így inkább 60 FPS minimumra célzok, míg sokakat egyáltalán nem zavar pár beesés.

Pont linkeltem pár napja ide egy controlos videót, hiába átlagosan jó, ha egy nagyobb csete-paté így néz ki: [link] . És persze ez konzol, de PC-n kb ugyanez a hatás, ha elkezd fogyni a CPU a játék alól. Többen tapasztalták egyébként az elmúlt években, hogy sok játékban bizony van érezhető különbség egy erős 8 magos (pl. 9900K) és egy gyengébb hatmagos között (pl. Ryzen 3600) akár magasabb felbontásban is, pl. [link] .

Nem mondom, hogy vegyen mindenki gyorsan drága 8 magos CPU-t, de azt sem merném kijelenteni, hogy aki vesz, az csak feleslegesen elszórta a pénzét... -

HSM

félisten

"Azért, mert 1 magon gyengébbek"

Pont erre utaltam, nem úgy van a, hogy tetszőlegesen összeszorzod a magok erejét a magszámmal és megvan a proci "ereje".

"akkor 1 magra 2db program szál megy, például a hang és tárhely kezelés egyszerre."

Amit kiagytál, hogy tipikusan ez az a pont, amikor vadul beindul a mikrolaggolás, mert lkezdik ölni egymást a szálak az erőforrásért, a játék pedig nem futhat tovább, amíg nincs kész minden részfolyamat."de ez azért nem annyira sok erőforrás egy jó architektúra esetén sok cache-sel."

Sajnos ez sem így van. Gyorsan megnéztem, Cinebench R15 nálam -5%-ot veszít a Ryzen 3600-asomon, ha 12 helyett 24 szálon futtatom, és ez messze a legideálisabb eset, mert a Cinebench jól optimalizált, és egy játékkal ellentétben független szálakat futtat. Ehhez képest egy játékban durván borulhat a tempó, ha nem megfelelő a szálak közötti szinkron, ami pedig csúnyán elromolhat, ha nem annyi szál van a CPU-n, amire a játékot optimalizálták. A te példáddal, ha a hang és tárhely kezelés egy szálra kényszerül, és emiatt nem készül el időre az jelentős lassulás lehet, hiába volt a többi szál gyors, végül a képkocka "lassan" fog elkészülni.

Gyorsan megnéztem, Cinebench R15 nálam -5%-ot veszít a Ryzen 3600-asomon, ha 12 helyett 24 szálon futtatom, és ez messze a legideálisabb eset, mert a Cinebench jól optimalizált, és egy játékkal ellentétben független szálakat futtat. Ehhez képest egy játékban durván borulhat a tempó, ha nem megfelelő a szálak közötti szinkron, ami pedig csúnyán elromolhat, ha nem annyi szál van a CPU-n, amire a játékot optimalizálták. A te példáddal, ha a hang és tárhely kezelés egy szálra kényszerül, és emiatt nem készül el időre az jelentős lassulás lehet, hiába volt a többi szál gyors, végül a képkocka "lassan" fog elkészülni. -

HSM

félisten

"a magonkénti teljesítmény szorozva magszám adja meg bármely proci össz. teljesítményét"

Ennél azért sokkal árnyaltabb a kép. Gondolj a nagyon sok magos szerver processzorokra, nem fog rajtuk különösebben futni a legtöbb játék.

A 8 magnak akkor lehet jelentősége, ha kifejezetten arra van optimalizálva erősen a motor. Hiába a 6 erős mag, ha a feladatok 8 végrehajtóra vannak kiosztva. Általában a motorok dinamikusan terpeszkednek a minél több magra, de ez nem feltétlen az ideális megoldás minden esetben."Ha az 1 mag elég erős, ugyanannyi idő alatt végez, mint 2 fele olyan erős mag."

A probléma, hogy 1 dupla olyan erős mag két szál futtatásával nem ugyanannyi idő alatt végez, mint két fele olyan erős mag, mivel a szálak közötti válogatás is plusz erőforrást von el. Ideális esetben 1 logikai (néhány esetben fizikai) szál egy feladatot futtat. -

HSM

félisten

válasz

keIdor

#43417

üzenetére

keIdor

#43417

üzenetére

"A Zen 4 is többet fog kérni az előzetes infók alapján."

Azért várjuk ki azt is, mit fog ez jelenteni a gyakorlatban.

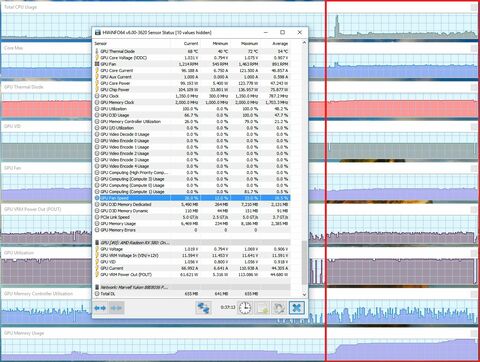

Azt nem tudom, ezt a fajta CPU-t mennyire lehet majd takarékosra beállítani, de már a Zen2 is extrém takarékos tud lenni, ha nem BOOST-ol, megmértem a 3600-asomon: [link] és a teljesítmény így is teljesen rendben van.

De persze a régi Coffee/Comet CPU-k esetén is be lehetett azért állítani megfelelő limitekkel egy egész jó perf/watt arányt, de nyilván nem hoztak úgy sem Zen2-es perf/watt-ot.

#43418 Devid_81: Van egy sejtésem, hogy így 16 maggal kb. annyi watt lesz TURBO alatt, amit meg bírsz hűteni vagy amit megenged a beállított power limit.

#43419 koko52 : Nekem a fényképezőgépek megapixel háborúja jut erről eszembe... Mindegy milyen áron, de lehessen rá nagyobb számot írni.

A VGA-k terén egyébként én pont látok fejlődést, a zöldek RTX-eit is jól be lehet állítani, mennyire szedjék a lábukat az étvágyuk kárára (curve editor + power limit), illetve AMD oldalon is kifejezetten energiahatékony fejlesztés lett az RDNA2, főleg a sima 6800-as, de a 6700XT-ből is lehetne jóval takarékosabb verziót paraméterezni. Lásd pl. Cyberpunk perf/watt lista [link] . A mai kártyák szépen fejlődtek, és a listáról hiányzik pl. a korábbi RX590, ami elég sokat kért mai szemmel nem túl nagy tempóért, a 6800-as tesztjükben még az is ott volt, főleg 1440P azért eléggé látszik a fejlődés: [link] . -

HSM

félisten

válasz

keIdor

#43415

üzenetére

keIdor

#43415

üzenetére

Igen, ennek a felépítésnek a Cinebench kb. a legideálisabb eset, ahogy a több CCX-es Ryzeneknek is.

A Golden Cove amúgy nekem is tetszik így első benchmark eredményre, de a fogyasztás még mindig nem ismert. Ha nagyon torkosan jön csak össze ennyi pont azért az némileg árnyalná a képet. Legalábbis nekem fontos a perf/watt is.

A Golden Cove amúgy nekem is tetszik így első benchmark eredményre, de a fogyasztás még mindig nem ismert. Ha nagyon torkosan jön csak össze ennyi pont azért az némileg árnyalná a képet. Legalábbis nekem fontos a perf/watt is. -

HSM

félisten

válasz

Busterftw

#43403

üzenetére

Busterftw

#43403

üzenetére

És épp most volt különösen a 3080-nál, hogy panaszkodtak a gyártók, hogy nem igazán tartható az ajánlott 700 dolláros MSRP egy ilyen kaliberű kártyánál...

Ez sem feltétlenül ideális, hogy ki van rakva a kirakatba az MSRP, pár darab FE kártyával, csak éppen pár szerencsésen kívül mégsem lehet venni annyiért. -

HSM

félisten

válasz

gejala

#43381

üzenetére

gejala

#43381

üzenetére

"Normális fizikához nem kell sok mag, 4 bőven elég."

Igen, 4 erős PC-s mag elég sokmindenre, de az előző generációs konzolok 8 gyenge magja az kb. egy modern négymagos erejének a felét tudja."Control hasít 4 magon"

A control épp remek példa, meg lehet nézni, mennyire csetlik-botlik a régi konzolokon, amikor beindul a rombolható környezet pár NPC-vel: [link] . Tipikusan nem ez a gyakorlatilag játszhatatlan 10-20FPS tartomány, amire céloznak egy játékot, főleg, hogy a fizika nehezen skálázható, különösképpen ha a játékmenet részévé tetted, legfeljebb a részecske-effekteket tudod visszafogni.Nem véletlen írtam, hogy remélhetőleg azért ez lassan változni fog (#43375), ha már az erősebb új konzolok lesznek az alap, nem a régiek, mert akkor a fizikát már nem feltétlen kell ennyire gyenge CPU-hoz igazítani.

-

HSM

félisten

válasz

Petykemano

#43383

üzenetére

Petykemano

#43383

üzenetére

"De lehet, hogy a)-hoz a jelenlegi vega még túl erős is, b)-hez meg túl kevés."

Elfelejtitek, hogy nem mindenki az aktuális top grafikájú játékokkal akar játszani. Sokaknak elég, ha az általa kedvelt akár 5-10 éves játék némi kompromisszummal elfut, arra pedig egy ilyen IGP tökéletes, és nem kell akkor költeni GPU-ra vagy konzolra, hanem a PC processzora letudja az egészet.Notebookba, SFF PC-be is jó opció lehet kompromisszumokkal, ahova nem ideális külön GPU-t tenni, főleg, hogy a CPU-rész kifejezetten erős lett.

-

HSM

félisten

válasz

olymind1

#43376

üzenetére

olymind1

#43376

üzenetére

Igen, említettem én is.

#43377 Kolbi_30 : "Ha akartak volna akkor megtudtak volna csinalni.."

Mégis hogyan? Ha a szerencsétlen konzol CPU még ezzel a fizikával is alig bír értelmes képkockasebességet, akkor mire raknál bele extrábbat? Illetve PC-n is sokáig a max 4 mag volt a standard a középkategóriában, nehéz lett volna úgy értékesíteni egy játékot, ha csak a legdrágább, HEDT gépeken fut normálisan. -

HSM

félisten

válasz

tisztelturam

#43374

üzenetére

tisztelturam

#43374

üzenetére

Ebben azért szerintem az is gond lehetett, hogy amíg a régebbi konzolokon is futnia kellett a legtöbb címnek azok meglehetősen gyenge CPU-ja mellett, addig nem is nagyon lehetett ezen gondolkoznia a fejlesztőnek. Ilyen téren azért ez változhat a mostani generációnál, ahol már igen korrekt CPU teljesítmény áll rendelkezésre mindkét konzolban, és a PC-s táborban is azért már elérhető áron vannak 6-8 magos megoldások is.

Én mindenesetre örülnék, ha jelentősen fejlődne akár a fizika, akár az AI az új címeknél, szerintem ezek igen fontos, sokszor elhanyagolt részek. És ha már itt tartunk, a hangok is.

-

HSM

félisten

-

HSM

félisten

válasz

Devid_81

#43332

üzenetére

Devid_81

#43332

üzenetére

"Gondolod ha 2GB/module tobbet enne mint az 1GB-s verzio"

Biztos vagyok benne. Kétszerannyi cellát kell frissítgetni.

Kétszerannyi cellát kell frissítgetni.Szerintem nem generáció-függő, mennyi VRAM az elég, inkább a piacon lévő játékok függvénye. És az alapján nekem ma a 8GB szűkösnek, 12GB elégnek tűnik egy top kártyára. 2017-ben szerintem igencsak túlzás volt a 1080Ti-ra 11GB-ot tenni, de nem volt más választás ehhez a busz-szélességhez.

Az RDNA2 nekem is igen szimpatikus, elég takarékosak tudnak lenni [link] , miközben igen gyorsak is.

A kérdés csak a driver, ehhez milyeneket sikerül majd írni. De úgy látom, a jó irányba haladnak, kevesebb új feature, de jobban működő alapok, ideje volt már.#43333 keIdor : "fogyaszthat ugyanannyit, vagy akár kevesebbet is"

Én ilyet még a gyakorlatban sosem láttam.

-

HSM

félisten

válasz

Petykemano

#43317

üzenetére

Petykemano

#43317

üzenetére

"$200-ért még ma is azt a teljesítményt kapod meg, amit a 2016-os polaris is hozott."

A polaris igen agresszívan árazott termék volt. A referencia modell az RX480-on a végletekig ki volt centizve költség oldalról minden tekintetben, talán emlékszünk még, hogy zsonglőrködni is kellett utólag driverből, mert kicsit sok lett az áramfelvétel a PCIE slotból... Illetve a 4GB-os modell olcsóbb, lassabb ramokat is kapott.

Egy normálisabban megépített modell pedig inkább közel 300 dolláros áron ment, mintsem 200-ért [link] [link] .

Manapság ugyanezért az MSRP 230 dollárért GTX1660 Super-t kapni, ami azért 30%-ot hoz rajta, miközben fele annyit fogyaszt [link] . Illetve picit többért, 330 dollárért már minőségi RTX3060 is akad, 12GB rammal. Ha nem is tökéletes, de szvsz elég jó budget opció lesz MSRP áron. Egy ilyen kártya pedig gyakorlatilag dupla olyan erős, mint egy Polaris [link] , miközben tud RT-t, DLSS-t és valamivel takarékosabb is.#43318 Devid_81: Több ramnak a fogyasztása több lesz, egyértelműen. Viszonyításnak ott a 3090.

#43325 Devid_81 : A 3080 Ti-on szerintem idővel hasznos lehet a +2Gb VRAM.

Bár az MSRP ára eléggé vicces szerintem, főleg az "ajándék" bányazárral...

Bár az MSRP ára eléggé vicces szerintem, főleg az "ajándék" bányazárral...

Az RDNA2 esetén az lesz még izgalmas, hogyan fognak alakulni az erőviszonyok, ha bejön a Traversal shader, és az Nv kicsit kevesebbet fog tudni profitálni a saját fixfunkciós RT gyorsítóiból.

-

HSM

félisten

A másodlagos sugarak koherenciáját hogyan gondolnák megoldani?

Amúgy én első ránézésre naívan azt gondolnám, hogy a traversal shader mivel képes dinamikusan gyorsító struktúrák között váltani, így nem csak a ram igényen, de a metszéspontok megtalálását is gyorsítania kellene nagyobb távolságok esetén.

-

HSM

félisten

válasz

Petykemano

#43281

üzenetére

Petykemano

#43281

üzenetére

"Az éttermes példa lényege épp az, hogy a porsche/Tesla mutatja, hogy a biznissz mennyire nyereséges"

Pont ez a hibája. A sportautó azt is mutathatja, hogy vagy jól ment a bolt valamikor régen, vagy van másik három másmilyen boltja, ami jól megy, vagy csak örökölt esetleg hitelt vett fel vagy akár nem is az övé...

Lehet, amikor a sportautóra futotta a szelet hús is rendben tudott lenni az éttermében, mert olyan volt a gazdasági helyzet...."Lényegesen egyszerűbb, ha van egy versenytárs szemközt, ahol összehasonlíthatóan ugyanaz összehasonlíthatóan olcsóbb."

Hahaha, ez sem nyert. Hányszor láttunk már olyat, hogy a versenytárs veszteséggel alacsonyan tartotta az árat tönkretenni a másikat... Aztán meg lehet duplán drágítani, ha az becsődölt.

"Mert akkor beijed és bármennyit kifizet érte még ma, mert holnap még többet kéne, nincs értelme a halasztásnak."

Én a régi RX580-am helyett terveztem fejleszteni egy RTX2060S-re kicsivel a bányászláz előtt, csak vártam, hátha olcsóbb lesz, ahogy jönnek az új típusok... Nem lett, kb. duplaannyiba került végül. Mikor futott fel a bányászláz, hétről hétre lett drágább, pedig nem gondoltam volna, hogy még annál a nagyon drágánál is drágább lehet, és lehetett... Se te, se én nem tudhatom előre, holnap mennyibe fog kerülni egy adott VGA. Az egyetlen biztos pont az aktuális készleten lévő termék ára. Ez van, akármilyen kellemetlenül hangzik. Lehet, hogy holnap beszennyeződnek a szilícium lapok az egyik gyárban, elfogynak a készletek és dupla akkora árak lesznek megint, de az is lehet, hogy megunják a bányászok a dolgaikat és tele lesz az apró olcsó kártyákkal. Nesze, légy okos.... Itt sejtések vannak és spekuláció, aztán vagy bejön vagy nem.

Itt sejtések vannak és spekuláció, aztán vagy bejön vagy nem. -

HSM

félisten

"Ezek elsősorban szoftveres fejlesztések."

Azért elég fontos, hogy egy adott szoftverkörnyezet mennyire teszi kihasználhatóvá egy adott hardver architektúráját. A jelenlegi DXR RTX barát, mert azok fixfunkciós egységeire van szabva. Az AMD az "általánosabb" megvalósításával itt némi hátrányt szenved, mert bizonyos lépéseket shaderekkel kell meglépni hardver helyett, ugyanakkor ebben a környezetben a shaderes bejárás előnyeit sem élvezik (traversal shader). Tehár a mostani tesztelésekből csak az derül ki, szigorúan a mostani környezetben melyik mit tud, és már most sejthető, hogy traversal shaderek mellett az RDNA2 kártyák RT hátránya olvadni fog. -

HSM

félisten

válasz

paprobert

#43279

üzenetére

paprobert

#43279

üzenetére

A szabadságnak is megvan az ára, nemigaz?

![;]](//cdn.rios.hu/dl/s/v1.gif)

"nincs modern gaming $350 alatt"

Az RTX3060 amúgy szerintem annyira nem rossz belépő holmi a 330 dolláros MSRP-jén, azzal némi kompromisszummal azért meg lehet próbálkozni mai címekkel is. Majdnem olyan fürge, mint egy régi 1080 Ti, azért az nem olyan rossz. Főleg, hogy egy éve 280 dollár volt egy 5600XT is. Házon belül is sokkal barátságosabb vétel, mint annak idején 350 dollárért a sima 6GB-os 2060 volt.

Főleg, hogy egy éve 280 dollár volt egy 5600XT is. Házon belül is sokkal barátságosabb vétel, mint annak idején 350 dollárért a sima 6GB-os 2060 volt. -

HSM

félisten

válasz

paprobert

#43277

üzenetére

paprobert

#43277

üzenetére

"Ha ma több folyik be, abból leginkább bónusz és osztalék lesz."

Ennek ellentmond a pénzügyi beszámoló, mindkét cég jelentősen többet költött R&D-re, mint egy évvel ezelőtt ugyanebben a negyedévben. Persze azzal nyilván egyetértek, hogy a sok pénz önmagában nem garancia a következő jó termékekre."két betűvel is tudom érzékeltetni hogy mi volt a gond"

Pont erről beszéltem, hogy extrém "kockázatos" befektetés egy ilyen cég, elég volt egy picit rosszul időzíteni egy terméket (a szoftverek még nem álltak készen ilyen sok szálat hatékonyan használni) és még némi gyártástechnológiai pech (az órajel se jött össze) és már akkora volt a baj, hogy majdnem magával vitte az egész céget."Előbbi esetben a cégek a helyzet elszenvedői, és csak úsznak az árral, míg utóbbi esetben az okozói."

Nyilvánvalóan van/volt ráhatásuk. De a usernek is van ám ráhatása elég komolyan a pénztárcájával. Megveszi-e, kifizeti-e, avagy szépen megvárja, míg a számára megfelelő árszintre nem süllyed a termék. Ez a szabad piac, nem igaz?

Ez a szabad piac, nem igaz? -

HSM

félisten

válasz

paprobert

#43275

üzenetére

paprobert

#43275

üzenetére

A céges racionalitás ha tetszik, ha nem az, hogy a cég működőképes és profitábilis legyen, amihez az kell, hogy tartósan versenyképes maradjon.

Én azt látom, hogy a 2021Q1 nem mutat jelentős eltérést az "árrobanás" előtti 2020Q4-es számokhoz képest [link] . Az is szépen látszik, hogy az összes bevétel 54%-a volt a termékek önköltsége, ami nagyon nagyon nem 5%, mint amit említettél (főleg, hogy egy VGA esetén még költség a PCB, hűtés, VRM és egyebek is, az AMD úgy tudom csak a GPU-t és a ramokat hozzá biztosítja a partnereknek). Ha az egyéb költségeket is hozzáveszed, mint pl. R&D, marketing, akkor úgy látom, a végén a 3445 millió USD árbevételből keletkezett 662 millió dollár tiszta profit. Azért az szvsz nem feltétlen az "úszunk a pénzben" esete egy ekkora cégnél.

"Visszatérnek a teljesen normális, büszkeségre okot adó profitrátához, ami 25 évig elég volt."

Arra gondolsz, amikor egyik veszteséges negyedév követte a másikat?

Ha már vs. topik érdekes lehet összevetni a konkurencia beszámolójával [link] . Úgy látom, náluk azért valamivel vastagabban fogott azért a ceruza.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

HSM

félisten

válasz

paprobert

#43273

üzenetére

paprobert

#43273

üzenetére

Egyébként úgy tudom nem az AMD/Nvidia hajtotta fel az árakat, ők elvileg nem emeltek árat a partnereik felé, ha vaalkinek van erről biztos információja, jelezze.

Természetesen nekik így is pokoli jó most, hogy kb. mindent eladnak, amit le tudtak gyártani. De azért vegyük észre azt is, hogy nemrég még az AMD pl. a csőd szélén állt. És lehet, pár év múlva ismét nem lesz olyan fényes a helyzetük, nyilván az Intel, az Nv és most már az Apple sem nézi tétlenül a történéseket és az egyéb, RISC alapú versenytársak is erősödnek. Tehát most nagyon is fontos profitot termelni, és a jövőbeli termékek fejlesztésére fordítani, hogy megmaradjon a versenyképességük. A lapka fejlesztési költségeiről pedig manapság fontosabb beszélni, mint valaha, mert pokoli drága lett egy lapkát piacra vinni. Lásd pl. [link] .

És még arról sem árt filozofálgatni, hogy mi fog történni, ha mondjuk negyed- fél év múlva komolyabban alább hagy az idei nagy bányász idény, és a korábbiakhoz hasonlóan ellepi az aprót a használt VGA dömping... Az AMD egyszer már megütötte ezzel a bokáját az R9 390-es lapkával, alig győzték kisöpörni őket a raktárból, pedig előtte mekkora üzletnek tűnt, hogy mindent elvittek míg szezon volt.....

-

HSM

félisten

Gyors kiegészítés...

"...de éppen nem a mostani MSRP-k vagy MSRP-n számolt $/ FPS."

Közben még eszembe jutott, ebben a viszonylag frissen megjelent 3080Ti kivétel, annak az 1200 dollár MSRP-je elég "érdekes" még úgy is, hogy elvileg azt beszélik, a sima 3080-at kicsit túl agresszívan (nehezen tarthatóan) árazták 700 dollár MSRP-re. Főleg a "bányazárral"...

-

HSM

félisten

válasz

GeryFlash

#43269

üzenetére

GeryFlash

#43269

üzenetére

Lesz nem pro is.

Mondjuk szerintem a sima 3060-at sem fogja utolérni, nagyon megvágták az Infinity Cache-t benne és a 128bit sem túl harcias 192-vel szemben. De az biztos, hogy nagyon olcsó lesz gyártani.

#43270 Petykemano : "arról győződ meg a fogyasztókat, hogy az árak indokoltak és tessék csak inkább kifizetni"

Dehogyis, még véletlenül sem célom ez. Különösen nem célom bármiféle módon támogatni a mostani mesterségesen felpumpált "scalper" árakat. Én kizárólag az MSRP árakra gondoltam, ami nagyságrendileg a fele annak, amik most a boltokban láthatóak.

Én kizárólag az MSRP árakra gondoltam, ami nagyságrendileg a fele annak, amik most a boltokban láthatóak.Én amellett érveltem, hogy úgy vélem, a jelenlegi generációk MSRP árazása nem "irreális". Illetve amellett próbáltam érvelni, hogy a korábbi évek gyakorlata, hogy generációról generációra nőtt a $/ FPS mutató jelentős részben annak volt köszönhető, hogy az egyre javuló gyártástechnológiák révén a gyártó adott előállítási költség és profit mellett egyre gyorsabb és gyorsabb kártyákat tudott azonos áron adni. Illetve nem volt szükség beépíteni olyan extra funkciók gyorsítóit sem, amik a "nyers erő" elől vették volna el a tranzisztor-keretet, mint most pl. az RT vagy az AI feladatok megvalósítása.

A gyártói oldalt csupán azért próbálom bemutatni, mert ezek profitorientált vállalatok. Azért dolgoznak, hogy a (csipfejlesztéssel járó) kegyetlen sok befektetett pénzük és a vállalt óriási kockázatok mellett egy idő után profitot termeljenek. Ha nincs profit, nincs értelme dolgozniuk. Ugyanúgy, ahogy egy munkavállaló sem fog bejárni dolgozni, ha pl. az útiköltsége többe kerül, mint amennyit kap a munkájáért....

Az éttermes érvelésed szerintem azért nem állja meg a helyét, mert az előző bekezdésem teljesen figyelmen kívül hagyja. Miért adná el neked a nagyobb szelet húst, tegyük fel, veszteséggel? Adja el a főnök inkább a luxusautóját, hogy nagyobb szelet húsokat adhasson, mert a vevők többet akarnak kapni, mint amiért fizetni hajlandóak? Ez nekem nem tűnik életszerűnek.

Persze, nem azt mondom, hogy tapsoljunk, ha egy cég le akar húzni minket, de szerintem az sem jó, ha átesünk a ló túloldalára, és az aktuális piaci viszonyoknak nem megfelelő elvárásokat támasztunk.

Voltak mindkét oldalnak olyan húzásai az utóbbi években, amiken rendesen ráncoltam én is a szemöldököm, de éppen nem a mostani MSRP-k vagy MSRP-n számolt $/ FPS. -

HSM

félisten

Szerintem azért egy lényeges szempont, mennyibe kerül egy adott termék előállítása. Pl. az RTX20-as generációnál a 12nm + RT + Tensor egységek miatt igencsak óriásiak lettek a GPU-k, és ezeket nem olcsó gyártani. Így pedig még az is jónak számít szvsz, hogy nem romlott a price/perf mutató. Sajnos nem csinálhatunk úgy, mintha az extra szolgáltatások (Tensor, RT) "ingyen" lennének.

A termék gyártási, támogatási és kifejlesztési költségei is magasabbak tőle, ennek mind meg kell térülnie.

A termék gyártási, támogatási és kifejlesztési költségei is magasabbak tőle, ennek mind meg kell térülnie.Illetve a jelenlegi piaci helyzetben, amikor kb. egy fél éven keresztül elkelt azonnal bármi, amit egyáltalán volt alkatrész miből legyártani, elkelt még jóval MSRP felett is, nehéz elvárni, hogy miért is kellene jelentősen alacsonyabb MSRP-t forszírozniuk a gyártóknak.

Elvileg majd jön még egy sima 6700 is, ott azért vélhetőleg lehet majd költséghatékonyabb, jobb price/perf arányú kártyákat is hozni a csipre.

-

HSM

félisten

"Előző generációhoz érdemes nézni az előrelépést ár/ teljesítmény terén. Gyakorlatilag semmit nem változtattak a $/ FPS számon"

Épp ezt kívántam megjegyezni, ez alapján nem állja meg a helyét, amit a #43263-ban írtál, hogy "nem is törekednek legalább az előző generáció árazását figyelembe venni".

Probléma szvsz akkor lenne, ha romlott volna $/ FPS mutató. Az előállítása is szvsz drágább a 6700XT-nak, több ram, komolyabb hűtő, jóval nagyobb GPU, mégsem drágább jelentősen, mint az 5700XT volt. Az 5700 GPU kb. akkora volt, mint a mostani Navi23....

Az előállítása is szvsz drágább a 6700XT-nak, több ram, komolyabb hűtő, jóval nagyobb GPU, mégsem drágább jelentősen, mint az 5700XT volt. Az 5700 GPU kb. akkora volt, mint a mostani Navi23....

Az RTX2060Super szerintem amúgy korrektül volt árazva a tudásához képest, és a 2070Super is egészen elfogadható árú lett a tempójához és szolgáltatásaihoz képest. De tény, hogy annál a generációnál nem a $/ FPS arány javult, hanem inkább az extralista, pl. RT. Ami szerintem egyébként igen nagy plusz, számomra legalábbis biztosan.

-

HSM

félisten

Ezt amúgy nem egészen értem... Az előző generációban hasonló kaliberű kártya, mint a 6700 az 5700 XT volt, 400 dollár MSRP-vel. Szerintem a jóval nagyobb mag, hozzáadott RT tudás, Infinity Cache és magasabb tempó révén egyáltalán nem tűnik nekem elrugaszkodottnak a 480 dolláros MSRP érte. Ugyanígy a 3060 Ti is 400 dolláron nyitott még a kripto őrület előtt.

Egyébként a 6800-as 580 dolláros MSRP-je is rendben lévőnek tűnik, az 500 dollár MSRP-s 3070-el szemben. Az 5700XT-t itt annyira nem érdemes szerintem alapul venni, mert az egy gyengébb kategóriában versenyzett, sehol nem volt a zöldek akkori csúcsától, míg a 6800-asok azért ott tudnak lenni a 3080-asok nyakán, ha nincs RT, főleg a 6900XT. -

HSM

félisten

Egyébként azt gondolom, az RT-képes konzolok lehetnek ebben (is) az egyik komoly hajtóerő.

Ennek a toldozásnak-foltozásnak sok értelmét nem látom, amit néhány címnél csináltak. Számomra az inkább csalódást keltő, főleg, hogy az FPS-t az oda nem illő, vizuálisan alig észrevehető effekt is szépen tudja enni.Én is így látom, 2-3 év alatt ki fog forrni, aztán már lehet majd látni, mik a valós igények és melyik rendszer a legjobb benne.

#43239 b. : A CP-t nem ismerem, így ehhez nem tudok hozzászólni.

"A szabvány a piacon van már 3 éve."

Hát ezaz. A 3 éve piacon lévő megoldásra (Turing) szabták rá a (PC-s) szabványt. Abba pedig ne is menjünk bele inkább, hogy ez igazából nem SZABVÁNY, hanem egy API.

A konzolokon meg egy másik API van, ami pedig az RDNA2 gombhoz lett szabva.#43240 PuMbA : Nekem akad itthon 6800 XT is, és RTX3060 is, de így sem nagyon foglalkozom vele, mert nem igazán releváns szerintem. Nincs nagyon mivel tesztelni, illetve az API helyzet is kissé zavarosnak tűnik, a szoftverek is csak éppen elkezdték bontogatni a szárnyaikat ebben. Sokkal érdekesebb vonal, hogy az egyes címekben mit sikerül belőle kihozni képminőség és tempó tekintetében. A linkelt DF videóban pl. ez igencsak tetszett, ahogy bemutatja mi történik a színfalak mögött, és ez hogyan hat a végeredményre, összehasonlítva az eredeti játékkal.

-

HSM

félisten

Hát nem tudom, engem eddig csak a Metro Exodus Enhanced verzió győzött meg RT tekintetében. Ugyanakkor abban teljesen vállalhatónak tűnik a 6800XT szereplése "komplett" RT-vel is [link] , nyilván azért az RTX 3080-at nem körözi le.

"szabványos megoldások , Microsoft DXR."

Szabványos, de... [link] [link]

Eléggé a gombhoz varrták a kabátot esete.

-

HSM

félisten

Az RT-s teszteknél, ha már a jövő a téma, szerintem óriási probléma, hogy alig van mivel tesztelni. Illetve amivel lehet is, többnyire még az első generációs RTX-ekre készült, nem igazán tudok olyanról, ami alapjaiban Ampere/RDNA2 optimalizált lenne, arról nem is beszélve, hogy elvileg mindkét gyártó megoldása rendelkezik képességekkel, amit csak a saját függvénykönyvtáraikon keresztül lehet elérni. Ez így elég zavaros víz a jövőre nézve. Ezek alapján én csak annyiban vagyok biztos, hogy az első generációs RTX-ek már nem lesznek gyorsabbak annál RT-ben, mint amilyenek most.

-

HSM

félisten

válasz

paprobert

#43208

üzenetére

paprobert

#43208

üzenetére

"natívnál kisebb render soha nem lesz a monitoromon!"

Személy szerint én maradok a natívnál, eddig bevált.

Ezeknek a technológiáknak a létjogosultságát két esetben látom:

- Nincs elég harapós VGA a gépben a natív felbontáshoz, és még ez ront a legkevesebbet a képen

- Túl nagy a monitor felbontása a méretéhez képest, és úgysem látjuk a különbséget (pl. 4K 28") -

HSM

félisten

Ezt az ígéretet nem lesz nehéz betartani, hogy "lesz kompatibilis szoftver".... Lásd pl. Edge csak a kis magokon. Rá lehet mutatni, hogy van, de én pl. biztosan nem azért vennék csúcs 16 magos processzort, hogy a lassú clusteren kelljen netezzek, kész röhej.

Nem mintha azt használnám netezni, de ez most mindegy.

Nem mintha azt használnám netezni, de ez most mindegy.A valódi kérdés inkább az, lesz-e számottevő mennyiségű szoftver, amit a felhasználók használnak is, és ami értelmesen fogja ezt használni? Ahol a fejlesztő rászánja az időt, hogy értelmesebb dolgok helyett egy újabb módon összetákolt/elbonyolított processzorcsaládra optimalizáljon. Lesz-e érdemi előnye ennek, vagy csak a kompatibilitási bugok? Én biztos nem erre költeném a fejlesztési büdzét, persze, még bohóckodjak +1 profilozóval, meg igazítsam hozzá.

Majd hozzáigazítják ők a CPU-t, hogy gazdaságos legyen fejleszteni rá.

Majd hozzáigazítják ők a CPU-t, hogy gazdaságos legyen fejleszteni rá.

-

HSM

félisten

válasz

hokuszpk

#43154

üzenetére

hokuszpk

#43154

üzenetére

A szoftveresek csak az egyik fele... A másik, hogy a menedzsment nézi a költségeket, és egy szoftvert finomhangolni, főleg jó szoftverfejlesztőkkel nem kis idő és pénz. Így sokszor megáll a dolog ott, hogy elég, ha az elvárható minimumon működik a dolog.

Gondold végig, azért pl. a saját frissítésük whitelistelése a saját antimalware szoftverben nem lett volna szabad pl. túl nagy falat legyen egy amatőr fejlesztőnek sem...Persze, lesznek szoftverek, ahol nem lesz gond az egzotikus felépítés, pl. Cinebench, de biztosan lesznek olyanok is, ahol kész rémálom lesz/lenne a különböző magszámú kombinációkra optimalizálni.

Nem véletlenül olvastam több helyen ARM-on is, hogy sok szoftvernél annyi az optimalizálás, hogy fusson csak az erős magokon, ez a legjobb ár/érték arányú optimalizálás fejlesztői szempontból...

Nem véletlenül olvastam több helyen ARM-on is, hogy sok szoftvernél annyi az optimalizálás, hogy fusson csak az erős magokon, ez a legjobb ár/érték arányú optimalizálás fejlesztői szempontból... -

HSM

félisten

válasz

Petykemano

#43075

üzenetére

Petykemano

#43075

üzenetére

"amelyik desktop számítógépek tízezreit üzemelteti, már nagyonis érdekli, hogy meg lehet-e valahogy spórolni 5-10W-ot."

Ezzel kapcsolatban van egy friss tapasztalatom. A melegre való tekintettel úgy döntöttem, a hűvösebb nappaliból távoli asztalról fogom használni a napi használatú erősebb gépem a 15W-os ultrahordozható vékony laptopomról.

Normál esetben ez azt jelenti, hogy egy jéghideg, szinte terhelés nélküli gép van nálam, a terhelés meg a kellően messze lévő másik gépet éri.

Ezzel szemben mérgesen tapasztaltam, hogy kb. süti a lábam a gép és folyamatosan süvít a hűtés, megnéztem hát, mi történik. Win10 funkciófrissítés, ami a gyakorlatban úgy nézett ki, hogy a gép a maximális turbóján süvít, kimaxolva a CPU 15W-os fogyasztási keretét, egy mag csontra terhelve, és még egy másik mag is szépen kapta az ívet a beépített antimalware folyamattól.

Tehát mit is akarok ebből kihozni? Azt, hogy amíg egy ilyen rendszeres (!), minden egyes win10-es gépet érintő (!!), akár órákig tartó háttérfolyamatot (!!!) nem sikerül még csak annyira sem optimalizálni egy már 2015 vége óta piacon lévő notebook processzorra (!!!! [link] ), hogy ne a maximális turbó órajelen (köztudottan a lehető legkevésbé hatékony működési módja a CPU-nak!) hajtsa közben az amúgy terheletlen CPU-t, miközben ráadásul a saját beépített antimalware szoftver is egészen pontosan 15 percnyi (!!!!!) processzoridőt égetett el az elvileg (???) megbízható frissítés ellenőrzése közben (?!), addig szerintem ez az egész kis magos energiatakarékosság alapú érvelés csak porhintés, mert a probléma gyökere éppen az, hogy vélhetőleg nincs elég idő/pénz optimalizálni, így a jelenlegi egyébként elég komoly energiatakarékossági rendszereket sem használják ki a szoftverek (pl. az említett CPU esetén [link] ), és egy olyan rendszer, ami még ezen felül is plusz optimalizálást igényel az szvsz nem javítani fog tudni ezen, hanem csak rátenni egy lapáttal a bajokra. -

HSM

félisten

"...hogy ott mindegyik mag ugyanolyan késleltetéssel éri el a gyorsítótárait."

A sajátjait igen, de pl. a 3950X-en a nem szomszédos 12 magét viszont relatív igencsak lassan.

Illetve a BOOST is eltérő mértékben pörgeti meg a magokat, Linuxon az is okozott fejfájást [link] ."A hibrid dizájnoknál az kavar be, hogy a két magcsoporton belül is eltérők a magok."

Ezt nem teljesen értem, hogy érted, hogy a magcsoporton belül is eltérőek? Én nem láttam még arról pontos leírást, hogyan tervezik a gyorsítótár hierarchiát/felépítést. -

HSM

félisten

"Default beállításon az Edge böngésző például eleve az Atom magokon fut"

A heterogén dizájnok szépségei kezdődnek...

Ez a megoldás pl. ideális a Lakefield 1 nagy/4 kicsi leosztására, mert ott a nagy mag mire megmozdul a négy kicsi már végzett a feladattal és a TDP is szűkös. De ugyanez a felosztás egy 8+8 magos asztali Alder Lake-en olyan lehet, mintha egy Atomos notebookon neteznél, amikor pedig ott lenne benne a kor színvonalának megfelelőbb CPU-rész is....

"hanem az alkalmazások helyzete, hogy lekezeljék az eltérő magok jelentősen eltérő késleltetését a gyorsítótárakra nézve"

Optimalizálási rémálom, lásd [link] . Nekem már a 3900x/3950x féle sok-CCX-es feldaraboltság sem tetszett hasonló okokból, de míg az AMD nagyjából megoldotta a dolgot az 5000-es szérián, addig itt tovább nő az ütemezési feladat komplexitása."Azt még nem tudni, hogy ebbe a user belenyúlhat-e, vagy el kell fogadni az alkalmazás/OS döntését"

Gondolom a user ha nem tetszik majd (szerencsés esetben) besétálhat a BIOS-ba, és kikapcsolhatja a neki kevésbé szimpatikus magcsoportot, és akkor vett egy 8 magos processzort egy 16 magos árán.![;]](//cdn.rios.hu/dl/s/v1.gif)

-

HSM

félisten

válasz

Habugi

#43098

üzenetére

Habugi

#43098

üzenetére

Pedig szerintem nem elhanyagolható körülmény, hogy nemrég még kinti árakon is 1000 euró felett volt csak ember által is vásárolható mennyiségű elérhető készlet pl. 3070-esekből, ami az itteni magasabb ÁFA miatt alapból drágább lenne nálunk.

Persze így sem mondanám kedvezőnek az itthoni árazást, de azért nem mindegy, mekkora szorzóról beszélünk.

-

HSM

félisten

válasz

Petykemano

#43075

üzenetére

Petykemano

#43075

üzenetére

Utolsó OFF gondolat, tán még elfér... Szvsz itt a probléma, hogy egy Zen3-as mag méréseim szerint turbó nélkül kb. 4-5W Cinebench R15 alatt alaposan megterhelve konnektorból, miközben azért 3,6Ghz-en tisztességes tempót diktál [link] . Ennnek valamekkora részét lehetne legfeljebb megspórolni kis magokkal, ami nevetségesen kevés. Ez már rég nem az a kor, mint annak idején az első atomnál, amikor szénné kellett kopasztani a magot, hogy beleférjen a megálmodott 2,5W-os TDP osztályba az akkori 45nm-es technológián az az egyetlen mai szemmel csigalassú magocska.

-

HSM

félisten

válasz

Petykemano

#43058

üzenetére

Petykemano

#43058

üzenetére

" ... ez szerintem mindig inkább hardver-driven lesz."

Az óriási probléma itt szerintem egyfelől a skálázódás. A szoftverek nem feltétlenül skálázódnak ideálisan egy bizonyos magszám fölé, ez főleg akkor lehet probléma, ha sok kicsi maggal próbálunk helyettesíteni néhány nagyot. Illetve minél több időt (pénzt, a jó szoftverfejlesztő nem olcsó!) kell optimalizálással tölteni (a jó skálázódás sem feltétlen jön magától néhány mag felett) annál kevésbé fognak vele foglalkozni. Pl. fusson minden a nagy magokon, aztán oldd meg.Illetve a szoftverfejlesztés szempontjából óriási gondnak látom, hogy hogyan optimalizálod a kódot, illetve ide tartozik, hogy hogyan optimalizálod az ütemező működését, hogy jól működjön mindenféle heterogén CPU-kon, mindenféle terhelési szituációban. Pl. mi fusson az erős magokon, ha mondjuk több szoftver versenyez értük? Mi rakható át a kis magokra gond nélkül, ha mondjuk üresen áll 10 vagy 15 belőle? Adott esetben külön CPU-típus függő optimalizáció is indokolttá válhat attól függően, miből mennyi van, és milyen arányban vannak egymáshoz képest.

Persze, lehet azt is, hogy majd dinamikusan a leginkább terhelő feladattok menjenek a nagy magokra, de azért az nem feltétlen fogja visszaadni, amit mondjuk egy Cinebench eredmény alapján várnánk.

#43060 Petykemano : A Tremontról azt írták, hogy natív X86, hogy energiát spóroljon. Nem tudom elég-e vagy' van-e lejjebb.

Egy ideig az Atomok in-order magok voltak, hogy még az OoO logikát is megspórolhassák. [link]

Egyébként nem volt az rossz, 2.5W-ból elműködő X86 CPU 45nm-en. -

HSM

félisten

válasz

paprobert

#43053

üzenetére

paprobert

#43053

üzenetére

Attól, hogy ketten is beleugranak a kútba, attól még nem biztos, hogy ez volt a jó döntés...

Elképzelhetőnek tartom, hogy idővel ez lesz a jó irány, de azért sokmindenen elbukhatnak ezek a koncepciók. Pl. az Alder esetén a kis magok eltérő utasításkészlete pl. határozottan nem tűnik jó rajtnak.

-

HSM

félisten

válasz

Petykemano

#41686

üzenetére

Petykemano

#41686

üzenetére

Pedig az izgalmas dolgok 0,95V alatt kezdődnek azokkal a GPU-kkal, amit meg sem néztek. Szerintem brutális, amit tud, nálam 0,85V-on stabil 1100Mhz-en.

[link]

[link]

Az egy egészen más dolog (termékpozicionálás), hogy gyárilag nagyon messze a csip perf/watt optimumától lett megállapítva az órajel. -

HSM

félisten

válasz

gainwardgs

#41510

üzenetére

gainwardgs

#41510

üzenetére

De az erősebb kártyák akár ki is élezhetik az Intel előnyét játékok alatt.

-

-

HSM

félisten

Azért ha a gyártási költség oldalt nézzük az is hozzátartozik, hogy az Nvidia kb. minden szegmensben kisebb, olcsóbban gyártható GPU-kkal jött. Pl. GTX1060 vs. RX580 200 vs. 232mm2. Vagy ami mégdurvább, a Vega56-64, majdnem 500mm2 és HBM2+interposer, míg a konkurens GTX1080 mindössze 314mm2, és a macerás interposer sem kell hozzá.

-

HSM

félisten

válasz

FollowTheORI

#39282

üzenetére

FollowTheORI

#39282

üzenetére

Végignéztem. Nekem nem jött át.

Máshogy néznek ki, ezt én is látom (

), de nem volt egyértelmű, melyik tetszik jobban, vagy melyik valósághűbb. Egyik se tűnt tökéletesnek, csak máshogy.

), de nem volt egyértelmű, melyik tetszik jobban, vagy melyik valósághűbb. Egyik se tűnt tökéletesnek, csak máshogy.

A Metro-nál egyértelműen jobban tetszett az RT alapú változat, de a BFV-nél is. -

HSM

félisten

válasz

Devid_81

#38681

üzenetére

Devid_81

#38681

üzenetére

Pont ezaz.. Rátettek 3 batárvastag ventit 3 vékonyabb helyett. Így nem maradt hely elég lamellának, tehát a nagy ventiknek sok levegőt kell mozgatni ami értelemszerűen hangos. A logós marhaság is pont, legalább vették volna kicsit kissebb méretűre.

Az a szomorú, hogy tényleg nem sok hiányzott, csak kicsit alaposabb átgondolás, hogy egy szuper hűtést kapjon, az anyagot határozottan belerakták hozzá.

-

HSM

félisten

-

HSM

félisten

válasz

Raymond

#38553

üzenetére

Raymond

#38553

üzenetére

lezso6 csinált egy szuper táblázatot róla: [link]

Pl. 1/16-od helyett 1/2-es FP64, vagy az int adattípusok. Mint az arányokból látszik, FP64-ben konkrétan 8X gyorsabb, mint egy azonos konfigú Vega10, illetve utóbbi int-et nem is tud.

Ha a játékokra gondoltál, nem sokat. Ott kb. FP32 és FP16, ami szükséges, de leginkább FP32. Ugyanakkor bizonyos felhasználásokra ezek jól jöhetnek, az inkább tudományos FP64 annyira nem is érdekes, de az int4/8 típusokról volt szó, tán a deep learning algoritmusoknál, de lehet rosszul emlékszem.

(#38554) Devid_81: Igen, elvileg a Navi lesz az utolsó GCN. Nekem amúgy nincs bajom az architektúrával. A ROP-ok lehetnének kicsit sávszél takarékosabbak, ez eléggé megfogja őket szvsz, amúgy szépen mennek, az Rx580-am sem egy csúcs holmi, mégis szépen viszi a FHD monitorom.

-

HSM

félisten

válasz

Petykemano

#38551

üzenetére

Petykemano

#38551

üzenetére

Mielőtt messzemenő következtetéseket vonnánk le, rajtam kívül másnak is feltűnt, hogy NEM UGYANARRÓL A GPU-RÓL beszélünk?!?!

Az még oké, hogy eltekintünk a 2048 és 4096 bites busz "aprócska" különbségeitől, de konkrétan a feldolgozók tudása is bővült, elég komolyan, jópár új képességgel, adattípus támogatásával bővültek. Tehát míg a régi Vega elsősorban a magasabb órajelre próbálta feltornázni a feldolgozók órajelét, itt erősen rámentek új adattípusok támogatására. Ennek pedig egészen biztosan volt ára komplexitásban, ami egészen biztosan kihat az elérhető órajelre is.

És még így is az olvasható le az ábráról, hogy vagy azonos órajel 50%-al kisebb fogyasztással, vagy azonos fogyasztáson +30% órajel. Nem rossz az, ezeket figyelembe véve, még akkor sem, ha nyilván gondosan megválogatott pontokban mérték ezeket a számokat.

-

HSM

félisten

válasz

Devid_81

#38543

üzenetére

Devid_81

#38543

üzenetére

Az elődnél is csak beállítás kértdése... Már gyárilag is elég jó a perf/watt, ha nem tolod ki az égbe a TDP limitjét... [link]

Az Rx580 is hihetetlen takarékos tud lenni akár csak 100-150Mhz-el a gyári órajele alatt. Nem a GCN a bajok fő forrása szvsz, hanem hogy a csipek a komfortzónájuk feletti órajelen vannak gyárilag hajtva.

(#38545) TTomax: A kamra és a csövek elég vadak, de én is inkább vékonyabb ventilátorokat tettem volna vastagabb bordázatra.

-

HSM

félisten

válasz

proci985

#38526

üzenetére

proci985

#38526

üzenetére

1500 dolláros áron startolt a 295x2, ehhez képest az 1000 dolláron indított 2080Ti aprópénz.

A két kisebb válogatott GPU nem biztos, hogy drágább, mint egy óriási nagy, illetve a 295 kutya közönséges, ráadásul alacsony órajelű GDDR5 lapkákkal ment.

Ha megnézed pl. az RTX2060 irdatlan nagy GPU, akár a 350 dolláros "közép" kategóriához, ráadásul drága GDDR6 memóriával...

(#38527) TTomax: A 7990 azért közelsem volt olyan elmeháborodott konstrukció, mint a 295x2.

A két Tahiti GPU összesen sincs akkora, mint egy 2080Ti.

A két Tahiti GPU összesen sincs akkora, mint egy 2080Ti.  Memóriából is csak 2*3GB kellett rá, 384 biten.

Memóriából is csak 2*3GB kellett rá, 384 biten.(#38528) proci985: Ha megnézed, a Tahiti GPU viccesen kicsi a maga 365 mm²-ével a mai holmikhoz képest. Ez a csúcs volt megjelenésekor, ehhez képest ma egy RTX2060 is 445 mm².

Az előző generációs középkategória is csak kb. 200-232 mm² volt (Rx480/580, GTX1060), azért durva, az volt kb egy szokásos középkategóriás GPU méret, a szokásos középkategóriás áron, a szokásos erős középkategóriás 256bit (körüli) hagyományos memóriákkal. Szóval én azért ezt is figyelembe venném... -

-

HSM

félisten

Amúgy azért ennél bonyolultabb a helyzet.

Hülye példa. Jön veled szemben mondjuk egy NPC, majd elsétál melletted, nem biztos, hogy minden irányból látni fogod, mondjuk nem látod alapból hátulról, de ezt a játék nem feltétlen tudja előre, hogy te a következő pillanatban megfordulsz-e avagy sem. Tehát ha a játék előrelátó, az NPC hátuljának adatait is bemásolja akkor is, ha esetleg soha nem lesz szükség rá, így biztosítva, hogy ha hirtelen megfordulsz, akkor a hátulját is le tudja textúrázni lagok nélkül, amihez az kell, hogy az adatok előre ott legyenek előkészítve.

-

HSM

félisten

válasz

Raymond

#38422

üzenetére

Raymond

#38422

üzenetére

Pedig látod, nálam szorgalmasan megtöltögette a 8GB-ot is, FHD-n [link].

Utána meg kis lag, takarítás, és folytatta tovább nagyjából 6GB foglaláson, amíg be nem telt megint a 8GB és kezdődött elölről a ciklus.

Utána meg kis lag, takarítás, és folytatta tovább nagyjából 6GB foglaláson, amíg be nem telt megint a 8GB és kezdődött elölről a ciklus.

Jó lenne amúgy tudni pár dolgot. Pl. mit is csinál pontosan, amikor telik illetve üríti a ramot? Pl. csak a shadow cache-t dobja ki, vagy alacsonyabb textúraminőségre is vált?

(#38423) huskydog17: FPS gondom nem volt az 1350Mhz-re fixált 8GB-os Rx580-al, max grafikán FHD-n.

Talán csak a Motion Blur-t kapcsoltam ki, mert nem szeretem, meg a Chromatic aberration lens effectet, mert az nekem wtf egy játékban.

Talán csak a Motion Blur-t kapcsoltam ki, mert nem szeretem, meg a Chromatic aberration lens effectet, mert az nekem wtf egy játékban.

Szval látom, itt a DF-nál jól ment. De azért én jobban a dolgok mögé néznék, mielőtt kijelentem, hogy nincs itt semmi látnivaló. Nekem sok még a kérdőjel. Nézegetek én is írásokat, amennyire időm engedi, de még megnyugtató válaszokat nem leltem.

-

HSM

félisten

válasz

Raymond

#38408

üzenetére

Raymond

#38408

üzenetére

Elég gyanús, hogy a 1440p-s nekifutásnál "véletlen" éppen az örsön van egy óriási vágás, ahol pont szeret kifogyni... [link]

Amúgy máshol is van egy-egy bereccenés, 1440-en, csak nem olyan durvák.

(#38406) Habugi: Ez csak egy példa. Más játékban is akadtak arra utaló jelek, hogy elkél alá már FHD-n is a 8GB VRAM.

Nekem sajnos akárhogy nézem, kicsit visszás ez a 6GB dolog. Ennél lényegesen gyengébb GPU-kra is került 8GB már évekkel ezelőtt is. De nézhetem úgy is, hogy már egy RX560 képes volt szűk 4GB-nyi VRAM-ot meghajtani, ez meg hányszor gyorsabb GPU?

-

HSM

félisten

válasz

Raymond

#38402

üzenetére

Raymond

#38402

üzenetére

Tudom. Én az átlagnál sokkal háklisabb vagyok a VRM elfogyós belaggolásokra. Amúgy teljesen egyértelmű a szituáció, a linkelt videón is színtisztán látszik 5:53-nál: [link].

200ms-es giga-lag, köszi, nekem ez teljesen elrontja a játékélményt.

Pont ugyanezt tapasztaltam én is a demóban (azt is szépen megeszi), csak 8GB-on nem darált be közel sem ennyire rondán, mikor beteltek a dolgok.

(#38404) PeTeR_33: Nincs alapja. A sima Vega-k is megoldják, bekapcsolod a HBCC módjukat, és megoldja a háttérben okosan 8GB-ból is.

-

HSM

félisten

válasz

huskydog17

#38398

üzenetére

huskydog17

#38398

üzenetére

"VRAM dolog itt nagyon túl van misztifikálva. 1080p-re bőven elegendő a 6 GB."

Ezt a következtetést miből sikerült levonni? Az elérhető anyagok, plusz saját tapasztalatok is azt mutatják, hogy 6GB-al addig vagy jó, míg be nem érsz a rendőörsre... Azaz kb. az első 5 perc, FHD-n. [link]

[link] -

HSM

félisten

válasz

PeTeR_33

#38363

üzenetére

PeTeR_33

#38363

üzenetére

A 2060 mellett szól viszont, hogy ha egy év múlva eladnád, szerintem jobb pénzt kapnál érte, mintha ugyanennyiért 1070-est veszel most.

Én nem foglaltam állást, egyiket sem tartom tökéletes választásnak. [link] Nincs tuti tippem, lehet választani, miben akarod seggberúgni magad. A Pascal ugye előző gen, annak kisebb hiányosságaival, a 2060-ról hiányzik 2GB ram, a 2070 meg arányaiban cefet drága.

Én azért írtam nem refet, mert szerintem kicsit túl-olcsósított a referencia kártya. Kívülről csili-vili, de közben ahol kéne (belül) ott meg inkább kevesebb anyag van, mint több. Ha megnézed pl. a Gaming Z-hez képest, jóval hangosabb is miközben melegebb pedig még a fogyasztása is kisebb, mert visszafogják a szigorúbb TDP limitek: [link].

A 2060-ra elég, az teljesen egyezik [link], a 2070-hez szerintem már kicsit kevés ez.(#38372) b.: Ebben az az érdekes, hogy pl. GDDR5-el nekem nagyon jók a Micron ramokkal a tapasztalataim. Micron-os volt az Rx560-am, és most az Rx580 Nitro-m is, az 1500MHz-es Rx560 memory error nélkül szaladt 2Ghz-es ramórajelen, és a Nitro-n is szépen megy, 2,1Ghz-en még biztosan teljesen stabil.

(#38378) Abu85: Rossz kombináció...

Jobbulást!

Jobbulást! -

HSM

félisten

Minden játék így működik. Pakolja befelé a dolgokat és nem töröl, amíg nem feltétlen szükséges, mert a törlés és utána a memória tartalmának rendezése igen költséges művelet, főleg DX11 alatt, ami általában a művelet idejére mikrolaggokkal jár.

Valamint itt az is lényeges, hogy a játék elején az üres pályákon rohangáltam kb, akciódúsabb részeken simán necces lehet, 6GB alatt ugyanis az átrendezgetések után sem nagyon láttam....

Gondolom, ezért is figyelmeztet a játék, hogy bugok LEHETNEK, hiszen semmi nem garantálja, hogy pont kifogyasztom a 8GB-ot a 12GB-ra ajánlott beállítással, de elképzelhető, és akkor valami nem úgy fog működni, ahogy kéne neki.

Gondolom, ezért is figyelmeztet a játék, hogy bugok LEHETNEK, hiszen semmi nem garantálja, hogy pont kifogyasztom a 8GB-ot a 12GB-ra ajánlott beállítással, de elképzelhető, és akkor valami nem úgy fog működni, ahogy kéne neki."ráadásul fertelmes néhol milyen textúrákat tettek bele pont mikor azzal szeretnék reklámozni a játékot"

Annyira azért nem rossz a helyzet. A játékban kifejezetten feltűnő volt, hogy tele van szépen kidolgozott, éles jó minőségű textúrával. Voltak persze, durván elnagyolt részek is ahogy írod, de ezt nem csodálom, hiszen így is két pofára ette a VRAM-ot, nyilván a kevésbé feltűnő részeken spóroltak, spórolniuk kellett.

A játékban kifejezetten feltűnő volt, hogy tele van szépen kidolgozott, éles jó minőségű textúrával. Voltak persze, durván elnagyolt részek is ahogy írod, de ezt nem csodálom, hiszen így is két pofára ette a VRAM-ot, nyilván a kevésbé feltűnő részeken spóroltak, spórolniuk kellett."Egyébként én is nézegettem videókat róla, [link]az RTX 2060 ban ultra beállításokkal is kifejezetten jó frametime értékeket produkál,5,4 Gb ram használat mellett, hiába üríti gyakrabban a cachet mint mondjuk egy 8 GB karin."

Nekem ebből más jött le. Nézd meg jobban, idáig elfért 6GB-on, vaj sima, és nézd meg azt az 1 percet, miután belépett az épületbe, huss elfogy a 6GB és jól láthatóan jönnek a lagok is innentől: [link]. Főleg 5:53 körül ahogy nézelődik, kifejezetten rossz nézni. Persze, miután átment kisebb folyósokra megint épp jó, szóval elég cérnaszálon függ itt-ott a jó futás.(#38357) PeTeR_33: Sajnos csak demo-m van, ami nem engedett többet, mint egyszer és akkor is csak 30 percet. Ezért nem is tudtam DX12 alatt tesztelni, csak DX11 alatt, nem engedett kilépni és DX12-re váltani sem.

(#38358) b.: Kíváncsi leszek, mit fogsz tapasztalni a Vega-n HBCC-vel, és a 1070-en.

Én a látottakból azt látom, bár játszhatónak tűnik 6GB-oson, de erősen határeset már FHD-n is. A 8GB-os Rx-emen lényegesen kevésbé volt érezhető amikor babrált a Vrammal, és a GPU is vígan repítette FHD max grafikán.

Amivel még lehet amúgy talán trükközni, az a shadow cache, azt kikapcsolva elvileg a GPU terhelés nő, de a VRAM igény csökken.Én még nem tudom, megvegyem-e, így is három teljes játékom van a könyvtáramban végigjátszásra várva. Ha találok olcsón, lehet lecsapok rá, de amúgy tuti nem leszek benne az első vásárlók között.

Elég kevés időm van játszani.

Elég kevés időm van játszani. -

HSM

félisten

Naszóval, erre a 1440P@5GB-ra reagálnék...

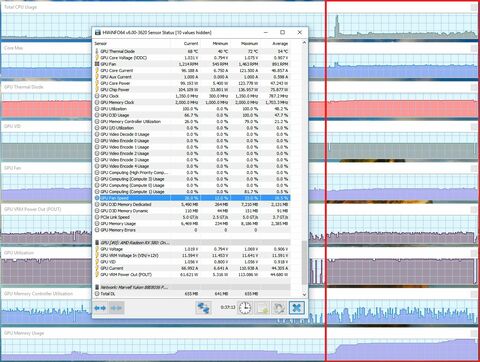

Kipróbáltam én is a játékot, csutkamax DX11 FHD-n, az Rx580 8GB-on.

Nálam is szépen riogatott, hogy ehhez bizony 12GB ram kellene. A kellemes tapasztalat, hogy kevés és minimális lag árán képes volt 8GB-ba belezsúfolni amit a demó 30 percében kellett, és összességében egészen szépen futott.Ugyanakkor az is szépen látszott, hogy pillanatok alatt megtöltötte a 8GB-om, és utána rendszeres VRAM takarítások kellettek kordában tartani a dolgokat.

Amit linkeltél nekem jelenet, hogy hohohó milyen szépen elszalad 5GB VRAM-al is 1440P-n az nálam úgy nézett ki, hogy mire odáig eljutottam már egyszer megtelt a 8GB, és éppen az első takarítás után 6,5GB memóriahasználatot mutatott a mutató....

És ami még nekem nagyon feltűnt, ugyanaz a jelenet a videódban pocsék textúraminőségű 1440P-n mindhárom kártyán [link], ellenben nálam FHD lőve egy képmentést nagyságrendekkel élesebb a kép:

Persze, ez lehet azért is mert én SMAA élsimítást állítottam be, mert ki nem állhatom a TAA és FXAA elmosós képét. Ugyanakkor ekkora difit talán nem kéne okozzon, 1440P-n duplaannyi képpontból egy erősebb mosás után is több kéne megmaradjon elméletileg.

A monitorozási adatok így néztek itt ki:

Mivel azért néha ki-taboltam, bejelöltem azt az egybe részt, aminek a végén a fenti screenshot készült. Szépen látszik, hogy nem sokkal előtte szépen megtelt a 8GB VRAM-om, és volt egy kis ürítés.

Ugyanakkor a játék végig ilyen volt, ahogy mászkáltam, folyamatosan kifogyott a 8GB-ból, majd takarítgatott maga után.

Azért azt szívesen megnéztem volna mondjuk 1440P-n egy 6GB-os kártya mit alkotott volna. Khm, RTX2060.

![;]](//cdn.rios.hu/dl/s/v1.gif)

Amúgy így élőben padló grafikán SMAA-val elég szépen nézett ki a játék, szebben, mint a videókról átjött YT-on.

-

HSM

félisten

válasz

#04430080

#38351

üzenetére

#04430080

#38351

üzenetére

Ilyen szempontból most a többihez képest "jóárasított" RTX2060 vélhetőleg sokat fog tenni a technika terjedéséért. Az a 350 dolláros árcetlijével azért már sokaknak elérhető.

No, meg tényleg nagyon jól kinéző effekteket lehet RT-vel megvalósítani, szóval marketing értékben azért sokat hozzáadhat a címhez, és főleg annál a rétegnél, akiknek azért vélhetőleg telik játékokra is. De tény, még sok víz le fog folyni a Dunán, mire ebből mainstream dolog lesz. Én ezért sem sietek RTX kártyáért még, hiába tetszik amúgy nagyon az RT alapú megvilágítás.

-

HSM

félisten

válasz

PeTeR_33

#38345

üzenetére

PeTeR_33

#38345

üzenetére

Ha a 2070 hullik, akkor sanszosan a 2060 is fog, hiszen ugyanaz a referencia NYÁK, ugyanaz a hűtő, ugyanaz a GPU, ugyanaz a memória (csak kevesebb)...

Én egy jobb hűtős, nem referencia 2070-re céloznék, majd ha kedvezőbbé vált az ára, szépen mennek [link].

Én addig is (míg lesz sok RT játék és normálisan árazott RTX2070-ek) elvagyok a hónapokkal ezelőtt 65K-ért vett Rx580 Nitro+ 8GB-ommal.

![;]](//cdn.rios.hu/dl/s/v1.gif) Addig meg szerintem azt érdemes venni, ami a legjobban kiszolgál, pl most azért lehetnek jóárasított 1070-ek, 1080-ak, Vega-k, de akár 2060-ak is...

Addig meg szerintem azt érdemes venni, ami a legjobban kiszolgál, pl most azért lehetnek jóárasított 1070-ek, 1080-ak, Vega-k, de akár 2060-ak is... -

HSM

félisten

válasz

atok666

#38335

üzenetére

atok666

#38335

üzenetére

Szerintem az, ha mondjuk egy olcsóbb, egyszerű hatmagoson, pl. i5-8400 is meglenne mondjuk egy erős 100FPS.

Egy közepesen erős négymagos, mondjuk 2-3 éves i5-ön meg menne a jelenlegi felállás szerint kb. szűk 50 FPS-el?

Szóval elfogadhatónak találom az igényt, de azért lehetne kedvezőbb.

A 8700K azért egy bitang erős jószág.

A 8700K azért egy bitang erős jószág. -

HSM

félisten

Engem a legjobban a memóriaelfogyásos anomáliák zavarnak, utólagos rajzolás, mikrolaggok, felemás minőségű betöltött textúrapakk...

Az a baj, nem lehet így gondolkozni. Eddig ez volt, nem kaptál új funkciókat, hanem polírozták mindig, ami addig is volt, így nyilván egyre jobb price/perf mutatókat kaptál. Viszont most a plusz fejlesztések nem elsősorban a sebességre, hanem rengeteg tranzisztort megzabáló új funkciókra mentek el, ami közvetlen nem javítja a price/perf arányt.

Olyasmi ez, mint pl. a Vega HBCC módja, csak sokkal látványosabb. Nem látod a sebességében, mégis kaptál egy hasznos szolgáltatást, ami jól jöhet.

A Vega-n ez praktikusan azt jelenti, hogy akkora méretű adathalmazt tudsz vele betölteni, aminél minden más GPU max egy nagy errort tudna renderelni a képre.De nézheted úgy is, hogy az RTX kártyák price/perf mutatója végtelenül jobb, mert a régi kártya is pénzbe kerül, mégis 0FPS-el fut rajta a RT, míg ennél az RTX generáció csak jobb lehet, praktikusan végtelenszer jobb.

-

-

HSM

félisten

Az a baj, hogy a 6GB ram akár FHD-n is necces lehet.

Értelmesebb review-okban emiatt inkáb FHD kártya ként is említik a 2060-t, nem mint 1440P kártya.

Sajnos fordítva is igaz, amit írtál, a sok VRAM nem pótolja a GPU erőt, de a sok GPU erőt is megöli, ha nincs elég VRAM. Sőt, nekem lényegesen jobbak a tapasztalataim a több VRAM/kevesebb GPU felállással, mint amikor a GPU menne, csak szűkösen van mellé a VRAM. Pl. volt ebben részem bőven a 2GB-os 7870 XT-vel (Tahiti-LE), ami ment volna nagyon szépen, ha nem csak 2GB-os lett volna, a 4GB-os RX560-al magasabb képminőséggel tudtam játszani, miközben lényegesen gyengébb GPU....

Ez a baj, látod te is, mekkora jó az RT, de mégsem számítod előrelépésnek, miközben technikai szempontból pont ettől nagyok és drágák az új RTX széria GPU-i....

Mondjuk elvileg jön a 1660, Touring GPU a RT és egyéb extrák nélkül.... Jól árazva abban több fantáziát látok, ha valakinek nem kell az RT, cserébe igen a price/perf... [link]

-

HSM

félisten

válasz

Locutus

#38294

üzenetére

Locutus

#38294

üzenetére

Akkor egy-két opciót átrakok High-ról mediumra, nem halok bele.

Ha nincsenek túltolt MSAA-val megfojtva FHD-n azért elég szépen mennek az Rx580-asok, és nálam a 8GB VRAM is pipa.

Mondjuk ez pont az a cím, amit lehet RT-vel lenne érdemes végigjátszani, ha már belerakták, és még tetszik is. No, ahhoz viszont még gyűjtögetnem kéne egy RTX2070/2080-ra.

-

HSM

félisten

válasz

#04430080

#38288

üzenetére

#04430080

#38288

üzenetére

Bocs, a 64-esre gondoltam. Kicsit fura a táblázat, mert az 56/64 Vega között van mondjuk max 15% sebesség, miközben a 1440P majdnem dupla terhelés a VGA-nak...

Tehát vagy az nem igaz, hogy 1080P 60FPS-re vega56 kell, vagy az, hogy a Vega64 elbírja a 1440P-t 60FPS-el.

-

HSM

félisten

válasz

#04430080

#38286

üzenetére

#04430080

#38286

üzenetére

High grafika megy 8GB ramon egy i7-4770K-n, 60FPS-el. Mi ebben a szélsőséges?

Esélyes, hogy a 8GB RX580-omon is szépen fog menni, ha a Vega56-ot elégnek látják 1440P 60FPS-re. Az pedig azért nem egy horror árú cucc.

Az pedig azért nem egy horror árú cucc.Persze, oké, az i9 kicsit túlzás, azt aláírom. De attól még ajánlhatják, hogy nem feltétlen szükséges.

-

HSM

félisten

Amúgy nekem sem tűnik logikusnak, hogy ilyen jellegű játéknak max minőségen 12GB VRAM kelljen. Csak annyiból fura, hogy ugyanakkor a játék fejlesztőit sem tartom sült bolondnak, minek írnának 12GB-ot, ha 5 is elég?

Ha az igazság valahol a kettő között is van, már az is fájhat pl. a 6GB-os kártyáknak.

Ha az igazság valahol a kettő között is van, már az is fájhat pl. a 6GB-os kártyáknak. -

HSM

félisten

Na, de itt ugyanaz a kérdés fennáll, mint korábban. Honnan tudjuk, hogy a demóba benne vannak a VRAM -igényesebb helyszínek, vagy jelenetek pl?

Akkor ennyit tudunk csak, a demónak elég 5GB VRAM is. A Crysis is ilyen volt anno. Ahol a tesztek voltak, elég volt 512MB ram, csak volt pár pálya, ahol kb nem tudtál vele normálisan játszani, mert laghegy volt minden fordulás.

Ha lesz kis időm, lehet megnézem, milyen.

Az eredetijét meglehetősen kedveltem 20 évvel ezelőtt.

Az eredetijét meglehetősen kedveltem 20 évvel ezelőtt.

-

HSM

félisten

válasz

xEon1337

#38253

üzenetére

xEon1337

#38253

üzenetére

Én sem. De ennek pusztán annyi az oka, hogy nem nagyon foglalkoztam a témával még. A kártya is épphogy be lett jelentve, ilyenkor még azért nem szoktak túl alapos tesztek lenni. Majd idővel meglátjuk.

(#38254) Ribi: Oké, de itt normál üzemi körülményekről van szó.

Szerintem amúgy FHD-ra egy ilyen kártya nagyon túlzás. Persze, belépő FHD RT-re még egész okés lenne, ha bírná, de ez sem volt túl meggyőző a tesztek alapján. Persze, ez a vonatkozás még javulhat, de akár rosszabbodhat is. (Optimalizálás vs. új játékok, akár nagyobb igénnyel.)

Szerintem amúgy FHD-ra egy ilyen kártya nagyon túlzás. Persze, belépő FHD RT-re még egész okés lenne, ha bírná, de ez sem volt túl meggyőző a tesztek alapján. Persze, ez a vonatkozás még javulhat, de akár rosszabbodhat is. (Optimalizálás vs. új játékok, akár nagyobb igénnyel.)

Amúgy ez az álláspont számomra is elfogadható, hogy kis butítás beleférhet a textúráknak, ha jól optimalizált a játék, és találni a 6GB-nak megfelelő beállítást, de ugye ez megint kiszolgáltatottság a fejlesztőknek, ami sosem jó.(#38255) Keldor papa: Nekem amúgy nagyon tetszik az RT. De nem is az agyonhype-olt tükröződésekért, hanem a realisztikus globális megvilágításért, az számomra nagyon ütős. Viszont ahhoz azért nem árt egy kicsit masszívabb GPU, mint a 2060.

Az árak viszont nem tetszenek, főleg a 2070/2080 elég húzós összeg.(#38256) .Z.: Hamarabb vehetsz majd valami több VRAM-osat....

![;]](//cdn.rios.hu/dl/s/v1.gif)

(#38259) Egon: Árban is éppen ennyivel feljebb rakták. 250$ MSRP vs. 350$. Gyakorlatilag a 1070-es MSRP árán jött.

(#38265) b.: Miből gondolod, hogy ez a másfél perc megmutatja, mennyi kell a játéknak? Más jeleneteknek simán lehet nagyobb az igénye is.

-

HSM

félisten

"Az, hogy egy játék kihasználja a rendelkezésre álló memót nem egyenlő azzal, hogy kell is neki."

Akkor mégis mit jelent? Gondolod, unalmában a játék telerakja szeméttel? Ha megtelt az azt jelenti, hogy ideális esetben ennyire van szükség. Persze, némi, kevesebb/több mikrolaggolás mellett lehet variálni, hogy elférjen, és akkor a grafikonok rendben maradnak. [link]

Ha megtelt az azt jelenti, hogy ideális esetben ennyire van szükség. Persze, némi, kevesebb/több mikrolaggolás mellett lehet variálni, hogy elférjen, és akkor a grafikonok rendben maradnak. [link]"Tesztek nem ezt mutatják akkor mégis kinek kellene hinni?"

Én jobban hiszek a tapasztalatoknak, mint a tesztek többségének. Ugyanis hiába néz ki a tesztben jól, ha én használni szeretném.... Hogy téged nem érdekel más tapasztalata, egyéni preferencia.

Ugyanis hiába néz ki a tesztben jól, ha én használni szeretném.... Hogy téged nem érdekel más tapasztalata, egyéni preferencia.

(#38250) Keldor papa: Bizony. Hiánypótlóak a tesztjeik.

Pont ezek a kis bebukdácsolások, amik engem szétidegelnének egy 130K-s kártyán. Ne csinálja, egyszerűen ne, feleennyi pénzért se.Nekem amúgy van egy kis deja vu érzésem még a HD4800-as időkből... Ott is mindenki foggal körömmel ragaszkodott hozzá, hogy elég az 512MB rájuk, hiszen a tesztekben is ezt mérték, aztán még kb én voltam hülyének nézve, hogy 1GB-os 4850-et vettem az 512MB-os helyett, plusz leírtam a tapasztaltakat. Emlékszem, még együtt is tesztelgettünk.

-

HSM

félisten

Rx580 topikban elég sok vita volt a 4GB-os verziók révén a memóriahasználati számokból. Ott azért akadt felhasználói tapasztalat bőven, hogy még az Rx580 is szépen ki tudja használni néhány címben a 8GB ramját, FHD-n.

Vegyünk akkor egy másfélszer erősebb kártyát, mínusz 2GB VRAM-al, amit praktikusan magasabb felbontásban is érdemes használni (FHD vs. WQHD), ahol az adott játék/beállítás memóriafoglalása is magasabb.

Hát nekem ez nem tűnik egy túl kedvező egyenletnek. Az is biztos, hogy 130K-ért nem én leszek, aki ezt ki fogja próbálni.![;]](//cdn.rios.hu/dl/s/v1.gif)

Talán még emlékszel az AMD Fury-X-re, ott is agyig volt szidva 2015-ben (részben jogosan, mivel már akkor is volt 8GB-os R9 390), hogy mennyire gáz, hogy csak 4GB VRAM-al jön... Ez meg egy másfélszer erősebb GPU, és nem sokkal több VRAM-al... Érdekes, hogy erre senki nem ugrik rá. Halkan jegyzem meg, a teszteken a Fury is rendben volt a 4GB-al, ott is inkább a felhasználó visszajelzésekből jött le, hogy azért nem az igazi a 4GB.

-

HSM

félisten

Nem véletlen van 8Gb-os prémium Rx580-am. Olcsó húsnak híg a leve.

Én egészen biztosan nem adnék egy Vega64-et 2060-ért. Ugyanúgy, ahogy nem vennék 4Gb-os Rx580-at sem. Ennyi pénzért nekem nem elfogadhatóak a kevés ramból adódó kompromisszumok és anomáliák.

Ugyanúgy, ahogy nem vennék 4Gb-os Rx580-at sem. Ennyi pénzért nekem nem elfogadhatóak a kevés ramból adódó kompromisszumok és anomáliák.

Jóféle Vega56 viszont már akad 2060 árban. Én inkább azt venném. Vagy várnék kicsit, 2070 olcsósodásra.(#38246) Ribi: Én nem tesztre szoktam kártyát venni, hanem használatra. Nem minden jön át a teszteken. A legtöbb esetben örülni kell, ha legalább egy 1%-os minimum FPS mérésre kerül.

-

HSM

félisten

Fel sem merül benned, hogy esetleg jó okkal drágább ennyivel a 2070?

Értem, ha csak a price/perf mutatót nézed ezt látod, csak sajnos egy VGA minősége szvsz nem írható le ezzel az egy mutatóval. Olcsónak tűnik, mert gyors, de ez azért nem egy olcsó VGA, 130K-ért/350$-ért szerintem ez a 6Gb-os bohóckodás elfogadhatatlan.Egy 1060-ra akkor elég volt a 6GB, főleg 250$ MSRP-vel, ide, ennyiért, most szerintem már kevés. Egy másfélszer gyorsabb GPU-ról beszélünk, és eltelt két és fél év is....

-

HSM

félisten

-

HSM

félisten

válasz

Puma K

#38234

üzenetére

Puma K

#38234

üzenetére

Hmm, úgy látom, a 6GB egészen feljött.

Steam: 1GB: 15,4%, 2GB: 21,2%, 3GB: 8%, 4GB: 18%, 6GB: 11% és 8GB: 11,5%.

No, a játékok beállításai is eszerint lesz optimalizálva. 2, 4GB szinte 100%, hogy lesz bennük, viszont a 6GB, és főleg 3GB-os? Ott azért csábító lehet, hogy annak ne csináljanak külön beállítást, mert 3Gb-oshoz egészen jó a 2GB-os, a 6Gb-oshoz a 4GB-os beállítás, és a 8GB-os mehet a durvább kártyákhoz.A 3GB-os 1060 szerintem katasztrófa, már régóta. Persze, ezzel nem fognak a tulajok dicsekedni.... Ismerősi körben járt egy tesztre, nem sokáig maradt.

Kedvencem, BFV, FHD, 4,5GB VRAM használat: [link]. A rendes 4GB-os kártyák is hasítanak, a 970 és 3GB 1060 már annyira csillog fényesen...."valakinek arra volt pénze"

Akkor lett volna egy 4GB-os Rx480 / Rx570-re is. Nagyságrendekkel jobb vétel lett volna, egyszerűen a 4GB a fentebb tárgyaltak miatt lényegesen előnyösebb választás. A durván túlárazott 1050Ti-t szerintem ne keverjük ide.

Nagyságrendekkel jobb vétel lett volna, egyszerűen a 4GB a fentebb tárgyaltak miatt lényegesen előnyösebb választás. A durván túlárazott 1050Ti-t szerintem ne keverjük ide."Ilyen paraméterekkel, nem kellene hogy egy lapon legyen említve a 2 kártya..."

Nem is érdemes. Teljesen másban erősek, mindkettő tud olyan dolgokat, amitől teljesen padlót foghat a másik.

Adjál egy 12GB VRAM igényű játékot az RTX-nek, és vége. A Vega meg jelenleg nem tud RT-t. Részemről döntetlen. Amúgy a Vega64-nek gyárilag állítgatható a TDP-je, és nagyon szépen elszalad bő 200W-on is, a teljesítmény durván 96%-a is megmarad úgy. [link].

A 6GB VRAM már ma sem elég minden játéknak FHD-n, 3-4 év múlva szerinted mire lesz elég? Költői kérdés, szvsz.....

Nálad a 11GB-os kártyán talán nem olyan égető a VRAM mennyiség, gyakorlatilag abba minden ma létező játék elfér. Ugyanez nagyon nem áll 6GB-ra.

(#38235) ->Raizen<-: Érvelési hiba. Attól, hogy a 6GB kevés 130K-ért, az nem azt jelenti, hogy egy 70K-s kártyára 16GB-ot kellene tenni.

(#38237) Raggie: Köszi!

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Samsung kuponkunyeráló

- OLED TV topic

- AMD FX

- Párduc a gépben: teszten az ASUS ExpertBook Ultra

- Rajzfilmen az életed: Teszten a Dear me, I was...

- The Division 2 (PC, XO, PS4)

- Nintendo Switch

- Milyen okostelefont vegyek?

- Elektromos (hálózati és akkus) kéziszerszámok, tapasztalatok/vásárlás

- iPhone topik

- További aktív témák...

- Telefon felvásárlás!! iPhone 14/iPhone 14 Plus/iPhone 14 Pro/iPhone 14 Pro Max

- Eladó Apple iPhone 12 64GB / 12 hó jótállás

- Apple iPhone 13 Pro 1TB,Átlagos,Dobozaval,12 hónap garanciával

- 3DKRAFT.HU - 3D NYOMTATÁS - AZONNALI ÁRAJÁNLAT - GYORS KIVITELEZÉS - 505+ POZITÍV ÉRTÉKELÉS

- Apple iPhone 12 Mini 64GB, Kártyafüggetlen, 1 Év Garanciával

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

Gyorsan megnéztem, Cinebench R15 nálam -5%-ot veszít a Ryzen 3600-asomon, ha 12 helyett 24 szálon futtatom, és ez messze a legideálisabb eset, mert a Cinebench jól optimalizált, és egy játékkal ellentétben független szálakat futtat. Ehhez képest egy játékban durván borulhat a tempó, ha nem megfelelő a szálak közötti szinkron, ami pedig csúnyán elromolhat, ha nem annyi szál van a CPU-n, amire a játékot optimalizálták. A te példáddal, ha a hang és tárhely kezelés egy szálra kényszerül, és emiatt nem készül el időre az jelentős lassulás lehet, hiába volt a többi szál gyors, végül a képkocka "lassan" fog elkészülni.

Gyorsan megnéztem, Cinebench R15 nálam -5%-ot veszít a Ryzen 3600-asomon, ha 12 helyett 24 szálon futtatom, és ez messze a legideálisabb eset, mert a Cinebench jól optimalizált, és egy játékkal ellentétben független szálakat futtat. Ehhez képest egy játékban durván borulhat a tempó, ha nem megfelelő a szálak közötti szinkron, ami pedig csúnyán elromolhat, ha nem annyi szál van a CPU-n, amire a játékot optimalizálták. A te példáddal, ha a hang és tárhely kezelés egy szálra kényszerül, és emiatt nem készül el időre az jelentős lassulás lehet, hiába volt a többi szál gyors, végül a képkocka "lassan" fog elkészülni.

A Golden Cove amúgy nekem is tetszik így első benchmark eredményre, de a fogyasztás még mindig nem ismert. Ha nagyon torkosan jön csak össze ennyi pont azért az némileg árnyalná a képet. Legalábbis nekem fontos a perf/watt is.

A Golden Cove amúgy nekem is tetszik így első benchmark eredményre, de a fogyasztás még mindig nem ismert. Ha nagyon torkosan jön csak össze ennyi pont azért az némileg árnyalná a képet. Legalábbis nekem fontos a perf/watt is.

![;]](http://cdn.rios.hu/dl/s/v1.gif)