Új hozzászólás Aktív témák

-

Jelenleg úgy néz ki, hogy annyira mégse sikerült ez jól

-

#90933760

törölt tag

válasz

NEOSIGNAL

#149

üzenetére

NEOSIGNAL

#149

üzenetére

Jelenleg mindenképp csúcskártyába kerül, mert még kezdeti szinten van meg a kisebb kártyák nem profitálnak semmit belőle, még fogyasztásilag is alig, kisebb karikon kevesebb ram van és lassabb órajelen is általában, kisebb memóriavezérlővel stb. Nincs akkora fogyasztáskülönbség.

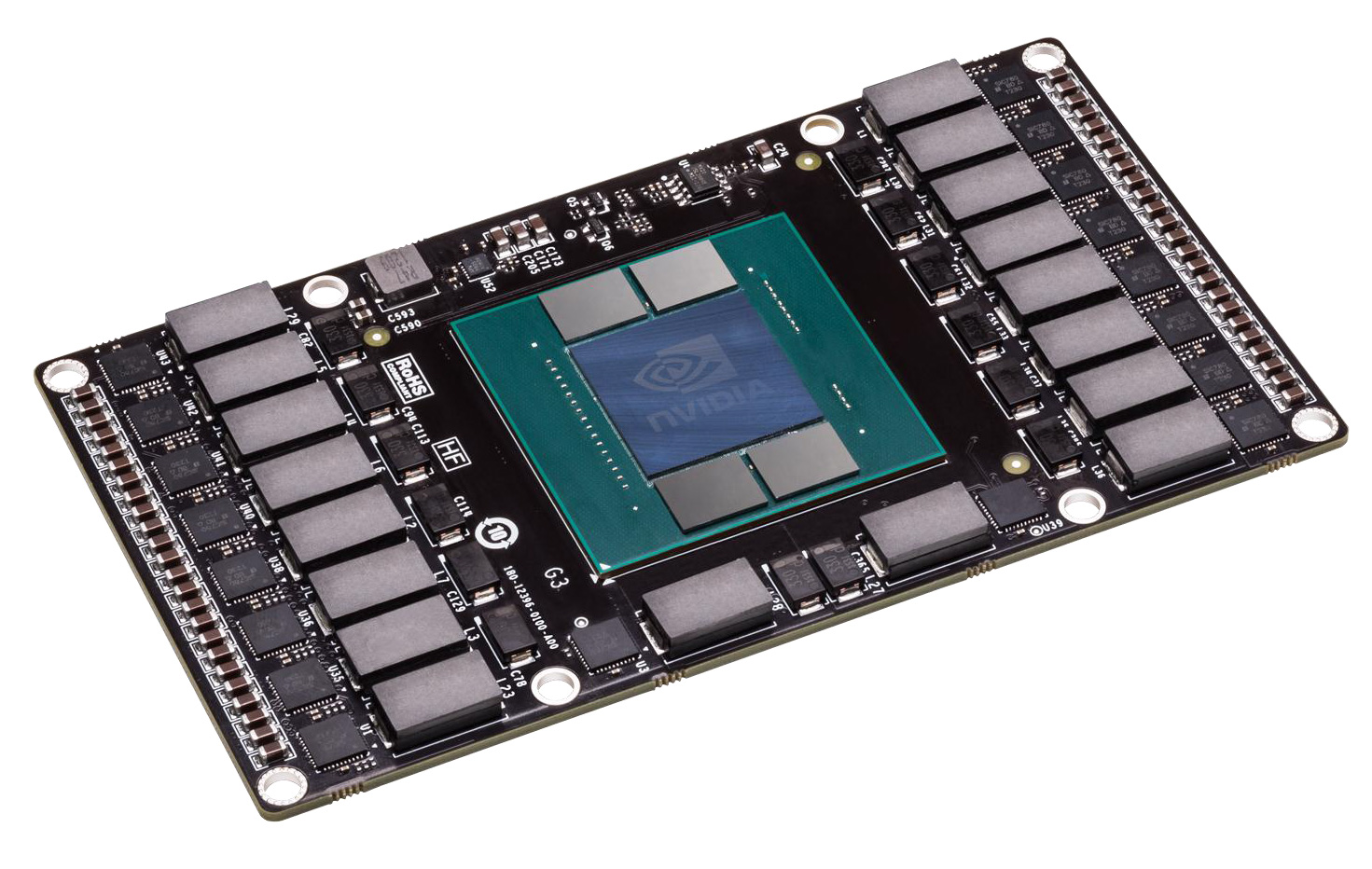

Négyesével vannak a gpu mellett, illetve alattuk a többi. -

#90933760

törölt tag

GDDR5 proci mellé nem valami jó ötlet, hiába adna nagyobb sávszélt vannak hátrányai, azért is kapta a GDDR nevet mert GPU mellé tervezték. Az IGPnek viszont jót tett volna, de ahhoz se került végül. Annak pedig leginkább gyártási költségek lehettek az okai, drága alaplap. És még mindig csak egy HD7750 erősségű kártyával érne fel az egész kóceráj, az árából egy kisebb proci+dVGA és erősebb helyzetben vagy, nincs értelme. Másrészt megint ott volnánk hogy a proci és a gpu külön memóriába irkál.

-

coolpet

senior tag

En mire is vagyok?

Mini ITX lap ~30K Huf

- Integralt AC wifi

- Gigabit lan

- 4x USB 3 Type C

- 2x Sata III 6Gb

- 1x Msata

- DC input

- soros port

- HDMI + DSUB

- 4 magos Pentium 2.00 Ghz, + HD5600 + lapkan integralt 6GB memoria (igp + rendszer)

- 5.1 Audio normalis szuressel

- Passziv hutesMi is kell meg? Ja egy

- haziko ~ 8K

- kulso dugasztap ~ 3K

- Radios bill touchpad ~ 4KSzumma ~ 45K

Megalmodtam, elkeszitik, megveszem. -

Sennalacy

aktív tag

Miért nincs a cikkben HBM 1 és HBM 2 említve... mintha a HBM 1 egy végleges megoldás lenne nem pedig csupán egy kezdő lépés.. Az nVidia nem is hoz ki rá kártyát, ők egyből HBM2-vel nyitnak a Pascal-ban.. Ha már cikk születik a HBM-ről, ezeknek alapból benne kellett volna lenni szerintem bemutatva azt is, hogy mennyivel jobb az egyik a másiknál.

-

Komplikato

veterán

válasz

Mumukuki

#138

üzenetére

Mumukuki

#138

üzenetére

Annak idején jártam úgy UT2004-ben (és sokan mások is), hogy multiban játék közben beragadt a billentyűzet, csak forogni és ugrani lehetett. Már hibáztattak mindent, a kiadót, a drivereket, a videokártyát. Na most akkor a Logitech saját "mindent bele" beállító programját kellett kilőni. Ez azért volt vicces, mert a billentyűzet Logitech volt, de amihez feltette a plusz drivert magának a Logitech saját szoftvere, az egy Logtechnek nézett Saitek egér volt. Persze gyárilag LogiTech egérrel is fagyott. Évekkel később boltosként meg volt egy "nem telepíthető webkamera" probléma elég sok embernél. Szervizesnek kihullott a maradék haja, mire kiderült, hogy az Asus videókártyákhoz, alaplapokhoz és webkamerákhoz adott idióta alkalmazás tehet róla, amivel elvileg multiplayer alatt nézheted a többiek pofáját. Ha sikerült levakarni a gépről, egyből ment minden. Vagy voltak a híres Creativ hangkártya szívások, melyeknek közös jellemzője volt, hogy csak a Creative-nak kellett volna 2-3 sort átírni az INF fájlba, helyette inkább ráfogták a chipsetre, procira, akármire. Szóval vannak ilyenek.

-

Mumukuki

aktív tag

válasz

#32839680

#125

üzenetére

#32839680

#125

üzenetére

Évek óta ismert, hogy ez a hiba jelenség sok esetben pont nem VGA vagy driver hiba, hanem pl amit a kolléga is írt, más hardver.

Futottam már bele úgy ebbe a hibába, mindent kipróbálva tesztelve, alkatrészek cserélve (még nvidia kártya is belepróbált, persze akkor más hiba üzenet jött) is megmaradt a randob BSOD ugyanazzal a driver panasszal, majd a ludas a s1155 foglalat 1db elgörbült lába volt. 2 hét sok órányi szenvedés, plusz 2 másik gép alkatrészeinek csereberéje volt, mire meglett.

Alaplap csere és minden megoldódott, a többi hardver nem változott.Szóval ne a drivert hibáztassuk már egyből...

-

SylverR

senior tag

válasz

#32839680

#136

üzenetére

#32839680

#136

üzenetére

Nade... Van kb 3 havonta új driver, és azokat sem feltétlen muszáj feltenni az új játékoknál, csak néha-néha. Főleg az nvidia által szponzoráltakat. De igazából elég egyszer beállítani a CCC-t mikor telepíted. Utána már nem kell hozzányúlni. Szóval nem értem a problémát.

-

SylverR

senior tag

válasz

Komplikato

#132

üzenetére

Komplikato

#132

üzenetére

Hát, ha nem tudod kivárni azt a 10 másodpercet míg rosszabb esetben betölt a CCC, szerintem add is el a PC-d inkább.

-

válasz

Komplikato

#132

üzenetére

Komplikato

#132

üzenetére

Én az utóbbi fél évben fel sem raktam már a CCC-t (se), csak a driver és annyi.

-

Chrys_

addikt

Sajnos ez sem (mindig) igaz.

Az eddigi kártyáimnál így volt, de a mostani R9 290X-re ez jutott: [link]

A vízkör csak a GPU felett van, a többi részen pedig csak a bordák. A vízkörös rész leszerelhető a hűtőről. Ha egy Furmark tesztet elindítok, akkor 10-20 perc után 103 fok körül lesz a VRM1 hőmérséklete. Emiatt rátettem egy 8cm-s ventilátort a bordázatra (így jó, a fordulatszámot leszabályoztam, egyáltalán nem zavaró).

Van másik hűtő is ehhez a kártyához, de nem éri meg cserélgetni őket (80-110€/db). -

Komplikato

veterán

válasz

#32839680

#125

üzenetére

#32839680

#125

üzenetére

AMD driverben vannak olyan "nagyon fontos" részek, mint az melyik a reklámokat cseréli a CCC-ben, az amelyik adatokat gyűjt rólad és így tovább. Mondjuk attól sem lesz semmi baja, ha a Mom.exe-t és a CCC-t is kilövöd az űrbe, így mondhatjuk a driver fele szemét. Valahogy be lehet állítani a tűzfal programban, hogy ezek el se induljanak, de én kézzel szoktam kilőni a sok hülyeséget. Mióta a hülye Dot Net CCC van az is fél óra mire hajlandó kinyílni, akkor meg minek? Mire használnád megunod a várakozást.

-

ukornel

aktív tag

válasz

#06658560

#66

üzenetére

#06658560

#66

üzenetére

"Ezen állításod, rendszerint szava nem állja meg a helyét."

Rendben, akkor a "

rendszerint" áthúzva, helyette "előfordul".

A lényeg, hogy a GDDR5 hűtése még nem olyan kruciális."Korábban is idéztem, most is, szóval a párbeszéd arról szól."

Nem, én nem erről akartam párbeszédet, köszi. Abban, amit írtál, igazad van.

Az állításom annyi volt, hogy ma még a GDDR5 hűtése nem olyan központi probléma, ergo a tokozás alatti HBM hűtése a GPU fejlett hűtési rendszerének (hőkamra, hőcsövek, víz, nitrogén, amit csak akarunk) nem fog problémát okozni. -

Sebaj Fóbiás

aktív tag

válasz

djculture

#127

üzenetére

djculture

#127

üzenetére

Na de a rambus használatához kellett volna új alaplap, memória-vezérlő, blabla. Az AMD továbbra is PCIe kompatibilis VGA-kat dobozol, csak kurva gyors memóriával. 7 éve fejlesztik, bevethető, jelentős előnyökkel jár a többiek által használt technológiákhoz képest. Mi olyan plusz kellhet a használatához ami nehézségekbe ütközne ha a többiek nem használnák, nem fejlesztenének rá? Ez nem egy olyan új cucc amire mondjuk másképp kellene szoftvereket fejleszteni, és ha csak miattuk kéne akkor nem csinálná senki.

És itt elkalandoztam egy Zengő Team exkluzív sugárhajtómű analógián.

-

djculture

félisten

válasz

Sebaj Fóbiás

#123

üzenetére

Sebaj Fóbiás

#123

üzenetére

Lásd a rambus történetét az is abba bukott bele hogy a többi cég a ddr szabványt kezdte el használni.. De televan a számítástechnika és szórakoztató elektronika ilyen történetekkel mikor egy technológia magára marad egy két cég kinlódik vele a többiek meg elterjesztik az ellenfelét (lásd pl a hd-dvd ma már a kutya se ismeri senki se használja..). A kisajátítás kb megis öli az egészet, egy technológiát csak ugy lehet elterjeszteni ha az adott iparágban szépen lassan mindenki elkezdi alkalmazni. Intelnek is megbukott már jópár új technológiája ezen, avx is eléggé erre tart az ujabb verziója már nem is kerül bele csak szerverprocikba de volt a hdmi ellenfele is az is elment a sülyesztőbe.

-

Balu972

aktív tag

zsírosbödön

-

-

Sebaj Fóbiás

aktív tag

"A HBM áll nyerésre, mert jóval többen támogatják, illetve jobb karakterisztikával rendelkezik. Ha az AMD azt mondaná, hogy a HBM az enyém, akkor a HMC azonnal nyerne és az AMD is vándorolhatna át rá, kidobva 7 évnyi munkát az ablakon."

Miért kéne kidobnia a jobb HBM-et ha a többiek a szarabbat használják?

-

válasz

#32839680

#119

üzenetére

#32839680

#119

üzenetére

Az nem feltétlenül maga a szoftver hibája lehet. Memória, HDD, VGA, CPU (magfeloldás, OC?), érdemes mindent kitesztelni. Sőt, akár tápegység hiba is lehet. Esetleg egy Win újratelepítés, ha sokszor volt a gépben cserélve hardver, főleg ha alaplap is.

9-10 éve csak AMD kártyám van. Volt egy kifejezetten driver hiba valamikor 2011 elején, amikor a 3830/3850 kártyáimmal böngészés vagy Excel közben fagyott a gép, aztán az javítva lett. Itt a thread hozzá, nemzetközi téma volt.

-

Sondi1986

addikt

Én inkább arra lennék kíváncsi hogy HBM előnyei meddig élvezheti az AMD a konkurenciával szembe? Addig mint anno a GDDR5-nél?

Mert az nem sok, tudtommal jövőre jön az nv Pascal HBM2 memóriákkal. -

-

ivarg

tag

válasz

stick007

#113

üzenetére

stick007

#113

üzenetére

Pont az a lényege ennek az egésznek,hogy a fogyasztás csökkenésével legalább a ramok nem fognak annyit fűteni a GPU-t meg eddig is meg kellett hűteni akkora hűtőt tesznek rá amekkorát akarnak, csak nem kell majd egy 4GB Rammal szerelt kártyának repteret építeni a házba.

-

ivarg

tag

válasz

Olajka02

#114

üzenetére

Olajka02

#114

üzenetére

Ezt nevezik előítéletnek,

azért mert 5 éve egyszer valami szarul működött egyszer egy hónapig, evidens, hogy ma is ugyan olyan szar.

azért mert 5 éve egyszer valami szarul működött egyszer egy hónapig, evidens, hogy ma is ugyan olyan szar.

Ez olyan mint amikor valaki erős gépet akar játékra és a ha azt mondod neki, hogy Core i5 vagy i7 akkor kapásból elmondja 8 haverja neki, hogy játékra csak AMD-t mert 10éve is az volt a király. -

Olajka02

aktív tag

válasz

#32839680

#107

üzenetére

#32839680

#107

üzenetére

Én nem értem ezt az AMD driver mizériát.

Az elmúlt 8 évben nekem soha semmi problémám nem volt, pedig csak AMD karikat használtam, minden félét és típusút (Megfordult a kezeim között vagy 20 kölönböző típus különböző gyártóktól).

Most van először NV kártyám.

Soha semmilyen problémám nem volt a kártyákkal, driverrekel.

-

stick007

tag

válasz

djculture

#112

üzenetére

djculture

#112

üzenetére

Az is felmerülhet, hogy a jövőben, az új kártyákat már csak HBM-el adják ki, lesznek itt még érdekességek.

Engem elsősorban az érdekelne, a sorokból azt vettem ki, a kártyának a fizikális mérete csökken, ami persze jó (nem lóg be a HDD keretbe ), mennyire fogja ez befolyásolni az üzemi hőmérsékletet? Nem kell neon, a kártya izzani fog?

), mennyire fogja ez befolyásolni az üzemi hőmérsékletet? Nem kell neon, a kártya izzani fog?

-

djculture

félisten

Ezek szerint lesz a két csúcskártya aranyáron HBM-el a többi meg a 200-as sorozat (aminek jórésze az ös öreg 7xxx sorozatból áll) átnevezgetése lesz ? Az körübelül a buktával egyenlő.. Legtöbb vga a középkategóriában fogy az nvidia már oda is komplett új design-al jött ki, mig az amd majd jön az ezer éves 260x-el átnevezve sőt a 7850 második átvezésével. Nagy ötlet az anyagi bukásra..

-

-

bteebi

veterán

"Benne van a cikkben, hogy már a teljes fogyasztás egyötödét elérte"

Oh thx, nem vettem észre

. Ezek szerint tényleg kifejezetten sokat fogyaszt a memória is

. Ezek szerint tényleg kifejezetten sokat fogyaszt a memória is  , szóval a nagyobb sávszélességen felül is van értelme a HBM-nek. Mondjuk a csúcskártyáknál szerintem eddig se a memória sávszélesség volt a limitáló tényező, de az mindenképp jó dolog, ha néhány 10 W-tal csökkenhet(ne) a fogyasztás. Persze nem biztos, hogy fog csökkenni, jó lesz majd a GPU-nak a plusz keret - mondjuk ez az AMD-nek jól jöhet, az nVidia viszont nagyon jól eltalálta a kártyái hatékonyságát, úgyhogy könnyen lehet, hogy náluk még tovább fog csökkenni a fogyasztás.

, szóval a nagyobb sávszélességen felül is van értelme a HBM-nek. Mondjuk a csúcskártyáknál szerintem eddig se a memória sávszélesség volt a limitáló tényező, de az mindenképp jó dolog, ha néhány 10 W-tal csökkenhet(ne) a fogyasztás. Persze nem biztos, hogy fog csökkenni, jó lesz majd a GPU-nak a plusz keret - mondjuk ez az AMD-nek jól jöhet, az nVidia viszont nagyon jól eltalálta a kártyái hatékonyságát, úgyhogy könnyen lehet, hogy náluk még tovább fog csökkenni a fogyasztás. -

letepem

aktív tag

Ha jól tudom a hbc micron fejlesztés és 2011-ben mutatták be! Hmc is már kiadás előtti állapotban van hasonló felépítéssel. ( interposer, stb). De ha az ötlet beteljesülése után vagy mikor már kezdett megvalósítható formát ölteni, akkor kellett volna sunyiban beadni és nem igazán lehetne ezeket a stackelt memória koncepcióját teljes mértékben lemásolni, feltarthatták volna addig a többi fejlesztést. Kicait olyan apple-ösen. Azt se mondd nekem hogy nincs összefüggés a két technológia között! Kicsit fura a hasonló megközelítés és pont egy időben.

Nem vihetnek egyszerre több iparágat a hátukon tömény profit nélkül.Más: nV milyen hátrányban lesz? Gyártással lesznek problémák, szoftverrel, hardverrel? Ha egyszer sikerűl beépíteni onnantól már célegyenesben vannak. Azt is le merem fogadni, hogy már a pascal is működik és a fiji utódja is. Persze nem biztos végleges verzió, de működik.

-

leviske

veterán

És ezzel adott tokozáson belül nem limitálják le még jobban a lapka lehetséges méretét?

-

mzso

veterán

Most akkor nem a gpu/soc-ra van rárakva a HBM. Először úgy értelmeztem.

Amúgy gondolom így, hogy explicit emlegették a SOC-okat van remény rá, hogy bekerüljön a ZEN APU-kba.

-

Sinesol

veterán

Benne van a cikkben, hogy már a teljes fogyasztás egyötödét elérte és lassan odáig fajulna a helyzet hogy többet fogyaszt a gddr5 mint maga a gpu. Szóval jelenleg egy 250w-os vga-ból 50 watt a memória...az azért sok...

Egyébként az Nvidia ha jól tudom a HBM2-t használja majd, szóval alapból a fejlettebb verzióval kezd, lehet nem is lesz hátrány semmilyen téren. Másrészt meg amekkora sávszélességelőnye van a HBM-nek, ha félgőzön megy még akkor se tudják félig se kihasználni a hatalmas sávszélességet...szóval belefér még ha nem is lesz tökéletes....

Gddr 5-ös korábbi példa nem a legjobb, mert akkor tényleg hátrány volt az alacsony frekvencia, nem volt elég a sávszélesség...itt viszont még félgőzön is sokszorta több lesz mint ami kell...http://wccftech.com/nvidia-pascal-features-mixed-precision-3d-memory-nvlink/

Amúgy ha jól tudom az Nvidia a Jedec tagja, szóval ingyen kapja a HBM-et.

-

repvez

addikt

Nem kijelentettem hanem kérdeztem, hogy mi a különbség ami miatt egy VGA-ra szerelt memoriát nem lehet rendszer memóriaként használni vagy ugy átalakitani. lényegében mindegyik ugyan azt csinálja , adatokat másol és tárol egy ideig.

Tehát mig a rendszer memória még csak 2400mhz körül jár addig a VGA-s 5mhz felett ezért kérdezem , hogy mi miatt nem kompatibilis a 2 eljárás?Igen ott az SSD,de egyelöre az átlag ember mégcsak rendszer meghajtóként használja és nem tárhelyként mivel nem megfizethető az 1TB kivitel. Ott az USB3 is és elméletileg több száz mega az átviteli sebesség, a gyakorlatba meg jó ha az 50et eléri.

-

bteebi

veterán

"A memória lapkák általában egy egyszerű áthidalással adják át a hőt a hűtőbordának, nem hőkamrával és hőcsövekkel, mint a GPU."

Igen. Viszont ha itt jelentősen megnőne a fajlagos hőleadás, akkor akár probléma is lehetne belőle (persze minden bizonnyal nem lesz)."Ha vízhűtésre cseréled, az rendszerint csak a GPU-t hűti, nem?"

Szerintem van olyan, ami a memóriát is, de többnyire tényleg csak a GPU-t szokták, és a memóriákra legfeljebb csak kisebb bordákat tesznek (elég szokott lenni, nem fogyasztanak sokat, és így nem is melegszenek annyira erősen). -

#45185024

törölt tag

Az rég rossz lenne ha nem lenne AMD Exkluzív 7 év közös fejlesztés után...

Az AMD felszippantha a teljes termelői kapacitását A HBM gyártónak még inkább azt mondták hogy az is kevés lesz akadozás várható.

Meg gondolom mivel új technológia és egymásra épülnek a rétegek több lesz az elején a hibás darab is ami növeli az előállítási költséget és csökkenti a gyártott darabszámot. -

UnSkilleD

senior tag

válasz

Komplikato

#91

üzenetére

Komplikato

#91

üzenetére

az intel biztos nem mert ők a saját hmc-jüket vetik majd be

-

Komplikato

veterán

Hülye kérdés, lehet nem ide vág, de az NVidia Pascal és Intel Xeon Phi az nem HBM2-t használ majd?

Az meg elvileg még kisebb helyet foglal meg talán a fogyasztása is jobb, nem?

-

Abu85

HÁZIGAZDA

Dehogy lehet. A Rambus is meghalt. A memória olyan dolog, hogy vagy marad a szabvány, vagy meghall. Mindig ez történik. Most a HBM és a HMC küzd azért, hogy ezek közül kerüljön ki a jövő. A HBM áll nyerésre, mert jóval többen támogatják, illetve jobb karakterisztikával rendelkezik. Ha az AMD azt mondaná, hogy a HBM az enyém, akkor a HMC azonnal nyerne és az AMD is vándorolhatna át rá, kidobva 7 évnyi munkát az ablakon.

(#89) Pepeeeee: Ez azért nem játszik, mert ha valaki így csinálja, akkor 2016-ban sem lesz HBM-je. Másrészt a másolással az a gond, hogy évek alatt lemásolod azt, ahol a konkurens évekkel korábban állt. Ez nem elég jó.

-

#45185024

törölt tag

"A HBM-nek is megvannak a buktatói, amiket az AMD már ismer, míg a többiek jövőre találkoznak velük."

Hát igen csak ez olyan mint az oroszok meg a x86 os kompatibilis CPU, egy meglévő dolgot sokkal könnyebb lemásolni mint kitalálni hogy is legyen.

Megvesz egy AMD kártyát (jaj istenem de szeretném azt a számlát látni Amd pecséttel Nvidia címére ) )

) )

szétszedi és megnézi. Az már úgy működik az a biztos. -

KAMELOT

titán

Kiváncsi leszek én ezekre az új ramokra meg kártyákra mit is fognak produkálni!

-

letepem

aktív tag

Akkor ezen technológia mostani szakaszában drága, mert nem a teljes piac épít rá hanem csak az amd. A jelenlegi drága implementációval is kijön a kártya 7-800 dollár környékén, ami nyilván még olcsóbb lesz mert a hype lecseng, a gyártás is finomodik, így amd exkluzívként is lehetne létjogosultsága. Előny megmarad konkurencia egy az egyben nem násolhat mert levédett+ más buktatókat idéznek elő! Ezzel a szabványosítással csak csökkenni fog ez az általad említett két éves előny. Miért kötelező az a szabvány csak nyomják le a piac torkán, ha tényleg ennyire jó és dörzsölgetik a markukat! Vagy valami kizárólagossagot ki kellene harcolni, hamár saját ötlet(pl bizonyos revíziókat csak az AMD építhet be, vagy újabb verzió esetén 1-2 évvel később kaphatja meg a konkurencia).

Ez így még mindig nem kifizetődő! Hét évet ontották bele a pénzt, megalkották, finomították szabványosítják, míg az ellenfélnek csak két évet kell áthidalnia, ami mint tudjuk pénz kérdése. -

Simon02

tag

válasz

FollowTheORI

#76

üzenetére

FollowTheORI

#76

üzenetére

Érdekes kérdés, amit írsz. Nyilván az a legegyszerűbb válasz, hogy majd meglátjuk. Benne van a pakliban, hogy ráerősítenek ezen a téren, bár ahogy olvastam 4096 shaderről beszélnek, ez majdnem 50%-kal több a Hawaii-nál. Márpedig azonos csíkszélességen maradnak,így azon múlik mennyire tudnak felépítést optimalizálni, mert gondolom nem akarnak egy óriáschip-et a HBM mellé.

-

Abu85

HÁZIGAZDA

Radeon HD 4870-ből volt számos olyan gyárilag tuningolt modell, amelyek elment 4 GHz-ig. Az NV-nél még a GeForce 400-as sorozat sem volt ilyen, csak az 500-asban, amikor az AMD már a harmadik generációs GDDR5 dizájnját hozta. És a GDDR5-ös előny fennmaradt egészen a Kepler megjelenéséig.

Persze az NV-nek nyilván nem volt egyszerű dolga. Kaptak egy specifikációt, amiből helyből kellett valami durvát gurítani, miközben az AMD a temérdek idővel gazdálkodva az első GDDR5 memóriával rendelkező termékhez kipróbálhatott több különféle implementációt, és aszerint dönthettek arról, hogy merre mennek.

A "tudom, hogy merre menjek" és a "sejtem, hogy ez a jó út" között óriási a különbség.

A HBM-nek is megvannak a buktatói, amiket az AMD már ismer, míg a többiek jövőre találkoznak velük. -

V!ck

senior tag

válasz

rambustibi

#59

üzenetére

rambustibi

#59

üzenetére

Low level API mellett a drivernek kb nulla szerepe lesz. Állítólag...

-

Fiery

veterán

"de például az AMD volt az egyetlen cég, amely a kezdetekben képes volt működtetni a teljes rendszert effektív 4 GHz-en. A többiek három évvel az AMD után jutottak el eddig. "

Melyik 2 termek kozott telt el 3 ev? Nem kotozkodni akarok, csak nem ertem.

HD5870: 2009.09.23. GDDR5 @ 4800 MHz (effektiv)

GTX580: 2010.11.09. GDDR5 @ 4008 MHz (effektiv)Tudtommal a 2 gyartonal ezek voltak az elso GDDR5 >= 4 GHz-es termekek. Kozottuk majdnem pontosan 1 ev volt, nem 3 ev.

A "kezdetekben"-t sem ertem. A HD4870 pl. 3.6 GHz effektiv GDDR5-ot hasznalt, ami baratok kozt sem 4 GHz. Vagy mi szamit kezdetekbennek?

-

stick007

tag

Azt a tényt ismerve, hogy 7 éves fejlesztésről van szó, biztos lesz valami párhuzamosan fejlesztett technológia.

-

Abu85

HÁZIGAZDA

A szabadalmakat a JEDEC tagok ingyen felhasználhatják. Ugyanaz ez az egész, mint a GDDR5 esetében, ahol szintén JEDEC szabvány lett a technológia, és minden JEDEC tag építhetett rá.

Az AMD-nek ebből a problémamegoldás számít. Van egy gond, amire kellett egy megoldás. A többiek jöhetnek, hogy lenyomják az árat.

Az már elég előny, hogy két évvel korábban kezdesz el vele kísérletezni. A GDDR5 is csak egy alap volt, de például az AMD volt az egyetlen cég, amely a kezdetekben képes volt működtetni a teljes rendszert effektív 4 GHz-en. A többiek három évvel az AMD után jutottak el eddig. A HBM sem egyszerűbb, és itt is hiányozni fog az a két év, ameddig az AMD játszott vele.

-

az nxzt g10, ami egy vga adapter a cpukhoz készült kompakt vízszettekhez, egy kissé átgondolatlan konstrukció. csak kicsit kellett volna hosszabbra szabni a lemezt, hogy ráérjen az első vrmekre. így a legtöbben kénytelenek sk. bordákat felaggatni rá, és/vagy aktív légárammal hűteni.

a corsair terméke a hg10 már valamivel jobban sikerült, de itt meg a gyári blowerrel, amiből nem tudnak persze egy darabot sem szállítani hozzá, sikerült tökönlőni az egészet. -

Ez azon dől el szerintem, amit én várok, hogy mennyi plussz TMU-t meg ROP-ot hajlandóak rátenni.

Ha tényleg 256/128 lesz, akkor fog profitálni nem kicsit ebből. Főleg 4k alatt, de sok textúrát mozgató játékok alatt is.

Viszont, ha megint spórolósak lesznek és a Hawaii szint körül korlátozzák, akkor alig lesz előrelépés egy két nagyon spéci memória intenzív esetben. És hiába az egész felfokozott várakozás...Szerintem jelenleg ez a gyenge pontja az AMD-nek, nem a shader teljesítmény.

-

Chiller

őstag

-

Az a kérdés hogy mennyit sporolsz az alaplapon emiatt.

Mert ha a memóriát is beviszed interposerbe, akkor rengeteget egyszerűsödik a processzor körüli PCB... sőt... ha beintegrálod a southbridge-et is, nagyon kompakt olcsó lapok jöhetnek hozzá.

Mondjuk egy X99 kategóriás 4 csatornás lapot átváltassz egy ilyenre... szerintem lehet többet spórolsz a lapon mint vesztessz majd a HBM plusszköltségén.Szóval szerintem itt majd az egész rendszer költségét kell nézni, amit egyik oldalt elvesztessz azért cserébe mit nyersz majd a másik oldalon.

Főleg mondjuk szerver piacon sokfoglalatos rendszereknél.

-

Soulles

aktív tag

Azt az AMD nem "merte" közölni.

A durva az egészben az, hogy a 4k-t valószínű egy darab 390x se lesz képes kihajtani.

Ha valaki élvezhető 4k élményre vágyik, akkor marad a 2x390x (talán a 2x390 is elég lesz) vagy a 390X2 dupla GPUs csoda. Na annak az árát ne kérdezd![;]](//cdn.rios.hu/dl/s/v1.gif)

@Pepeeeee

Legutóbbi infók szerint a 380x lesz 400 dollár, 390 pedig 700, de inkább felette.

Ha tudsz frissebbet akkor LINK pls, engem is érdekelne. -

-

#45185024

törölt tag

Az első körben exclusive az Amd a második generációban meg Nvidiának licenszelnie kell a HBM et ergó versenyhátrányból indul ez nem elég ?

-

-

letepem

aktív tag

Csak azt nem értem , hogyha ezt is az AMD/AMD-vel fejlesztette/fejlesztették ki akkor hogy a francba nem él meg a cég pusztán a licencedíjakból? Sőt, ez az egész úgy jön le mintha az AMD nem az ötletgazda, hanem csak az egyik partner cég lenne, miközben a cikk azt írja, hogy az AMD egyik mérnöke hozakodott elő az ötlettel és kezdtek bele a megvalósításba. Ezek után a hynix őket választotta( mint szimpla memóriagyártó), pedig CSAK velük kellett volna dolgozni. Ha ez ekkora volumenű fejlesztés miért nem AMD exkluzív? Miért hagyják, hogy más pl a vidia implementálhassa? Verseny azt követelné, hogy a jó technológiákat megtartsák maguknak és építsék be Apu, soc, cpu mellé vagy "bele" aztán learatják a babérokat egyedül. Míg az nvidia szenved a gddr5-tel és vagy észbekapnak és licencelik ( persze a silányabb verziót) vagy újabb technológia kidolgásához kezdenek látván a konkurencia megoldásat. Szerintem az AMD egy ki@@szott szeretetszolgálat. Más kisajátító technikával már nagyok is lehetnének...

-

#45185024

törölt tag

Csak a 390x/ 390 ben lesz HBM sajnos

A többiben azt csinálják hogy a mostani 4 Gigákat felviszik 8 ra.

ÁTCIMKÉZÉS

Az ár meg ha minden igaz akkor:

300 széria

390 399 US $

390x 599 US $

390x2 1299 US $ -

#06658560

törölt tag

Igen, azt néztem meg.

"Ha vízhűtésre cseréled, az rendszerint csak a GPU-t hűti, nem?"

Ezen állításod, rendszerint szava nem állja meg a helyét.

"Mert abban nem mai gyári hűtés volt"

Jó napot, miről beszélünk aftermarket esetén?

"Az én eredeti állításom az volt, hogy pillanatnyilag nem a memóriák izzasztják meg a hűtést, viszont a HBM nagyobb hűtési igényét már a GPU sokkal kigyúrtabb hűtője tudja kiszolgálni."

Korábban is idéztem, most is, szóval a párbeszéd arról szól. Ha eme gondolatodat visszük tovább, közel sem biztos, hogy igazad lesz- kisebb felületre jut a hő, nyakába a GPU-nak, szóval jobban szűk keresztmetszet lesz a legelső hőátadó felület.

-

Dare2Live

félisten

válasz

SpongyaBob

#60

üzenetére

SpongyaBob

#60

üzenetére

-

ukornel

aktív tag

válasz

#06658560

#56

üzenetére

#06658560

#56

üzenetére

"Megnéztem. A mai gyári hűtések már a VRAM-ot is hűtik zömében, azért vannak a teljes blokkok."

Azt a képet, amit linkeltem? Mert abban nem mai gyári hűtés volt, hanem egy Kraken. Itt jobban látszik, miről van szó.

Nem is arról beszéltem, hogy zömében hűtik-e, vagy mind, vagy egyik sem; hanem azt érzékeltettem, hogy ma is előfordul - úgy tűnik-, hogy VRAM hűtés nélkül marad. Ez lehet, hogy nem ideális, de per pillanat nem kruciális."Magyarul az állításod nem állja meg a helyét."

Melyik állításom?

Az én eredeti állításom az volt, hogy pillanatnyilag nem a memóriák izzasztják meg a hűtést, viszont a HBM nagyobb hűtési igényét már a GPU sokkal kigyúrtabb hűtője tudja kiszolgálni.#57 .mf

"Vannak csak GPU-re való blokkok is, de azoknál is szokott valami kiegészítő hűtés lenni a ramra és fesz-szabikra."Igen, néztem ilyen képeket is most, ezek általában kisméretű bordák, külön venti nélkül.

-

Simon02

tag

Talán a HBM megjelenése megmozdítja a PC iparban a jelenlegi állóvizet!

Viszont néhány "jelentéktelen" részlet kimaradt a HBM memória elterjedésével kapcsolatban, így meg lehetett tartani az össznépi reménykedés napot az AMD mellett. Mégpedig, hogy a következő generációs GPU-k esetén már mind az nvidia mind az AMD kártyáin jelen lesznek! Nem kell messzire menni, egy korábbi hírben már le volt a ph-n írva: [link], de pl a hwsw is lehozta ma: [link]

A ph cikkjében pedig egy másik fontos tény is szerepel. Mégpedig, hogy készül a HBM következő generációja, ami elvileg duplázást jelenteni memória méretben és összeköttetési sebességben. Ugye ez a nem mindegy, mivel mindkét gyártónál ez lesz (valószínűleg) a next gen-ben!

Így maximum abban lehet reménykedni (már aki ezt teszi), hogy az nv-nek nem fog zökkenőmentesen menni az integráció. Az egész kérdés kimerül abban, hogy az AMD-nek lesz-e előnye a 390X (390) alatt (mármint teljesítmény előnyre gondolok, mert a gyártási költségen nem fog faragni az olcsóbb nyák melletti, drága memória)! De mivel az előző GCN csúcsa se volt memória sávszélességben limites (itt van mellettem egy 290X, így pontosan látom), így a gyakorlati előnye csak az alacsonyabb fogyasztás miatt megengedett nagyobb GPU fogyasztás lehet.

Úgy érzem az AMD megint olyan innovációt ért el, aminek más fogja learatni a gyümölcsét...Ja és még egy kérdés: Hogy akarják ezt értelmes keretek között lehűteni?

-

rambustibi

őstag

Szuper megoldás a HBM, a kérdés felmerül, hogy a vga driverét is fejlesztették? Mert a catalyst nem valami tökéletes.

-

.mf

veterán

Kialakítástól függ. A FC (full cover) blokkok a kártya legfőbb melegedő alkatrészeit (gpu, ram, fesz-szabik) lefedik, bordázás a gpu felett van, de a víz útja a többi felett is áthalad. Vannak csak GPU-re való blokkok is, de azoknál is szokott valami kiegészítő hűtés lenni a ramra és fesz-szabikra.

-

MiklosSaS

nagyúr

Jo az otlet, jo a koncepcio. Most mar akkor maradhatnak a 300 W-ot zabalo chipek, orvosoltak a memoriaval.

Jol hangzik amikt olvastam, csak felek...mert ha az AMD innovacio akkor majd olyan 3-4 ev mulva lesz hibamentes...es kb akkor mar nem kell magyarazkodni hogy miert nem ugy megyen mint papiron. De ha ezek melett meg drivert is megtanulnak irni akkor ujra nyeregben lehetnek.

Drukkolok nekiek!

-

creation

senior tag

-

ukornel

aktív tag

"Na a hűtésre én is kíváncsi vagyok! (rögtön ez volt az első, ami megfordult a fejemben, révén, hogy mostani "csúcs" kártyák külön hűtik a memóriákat is!)"

#37 bteebi

"azonos sávszélesség esetén 19-szer kisebb felületen harmad akkora fogyasztás → nagyjából hatszor akkora hőtermelés egységnyi felületen. Ráadásul a sávszélesség nőni fog."Eddig azért nem a memóriák hűtése izzasztotta meg a dVGA-k bordáit. A memória lapkák általában egy egyszerű áthidalással adják át a hőt a hűtőbordának, nem hőkamrával és hőcsövekkel, mint a GPU. Ha vízhűtésre cseréled, az rendszerint csak a GPU-t hűti, nem? (Javítsatok ki, he nem...)

Most a közös tokozásban a memóriák fölül is hőcsövek szállítják majd el a hőt. -

-

.mf

veterán

"Arra azért kiváncsi vagyok, hogy mi miatt nem lehet ezt az eljárást még rendszermemóriaként használni, mert ott ugye nehogy DDR5 hanem mégcsak a 3as szintnél tartunk."

Ácsi, egy kicsit tegyük tisztába a dolgokat. GDDR3 és DDR3 nagyon nem ugyanaz. Sőt, a GDDR3 a DDR2-n alapul, nem a DDR3-on; s tetézem: a GDDR5 pedig a DDR3-on alapul (a GDDR4 is a DDR3-on, nem pedig a DDR4-en alapult).

"Bár még mindig az adattárolás a leglassabb eleme az egész rendszernek. 10 évvel ezelött is kb ugyan anyni időbe telt betölteni meg átmásolni mint mostanság , érezhető javulás nem sok volt."

SSD? Melyik kő alól bújtál elő?

-

Kingcold

aktív tag

Kíváncsian várom, lesz e Zen + HBM kombináció...

Mééé ne lenne?

-

DonToni

aktív tag

-

R.Woodoo

tag

Remélem, hogy a sok pozitiv technikai tulajdonsaga mellett hasznot is fog hozni nekik, masokkal szemben, Jo volt a cikk, thx.

-

Auratech

őstag

A sokmagos architektúrákban a számolási teljesítményre jutó használható memória sávszélesség nem nőtt arányosan a számolási teljesítménnyel. Emiatt van akár 48Mb Cache egy modern prociban.

A jó megoldás a nagyságrendi sávszél növekedés, ami a HMB-vel megvalósulni látszik.

A belső sávszél kábé a prescott pentiumokig volt hasonló (6.4 B/s) a memóriával (ddr400-dual ch- kb 6.4GB/s)

Várom a HMB memóriás alaplapokat, GPU-kat. Valódi előrelépés. -

bteebi

veterán

"Míg a GDDR5 esetében a memória-sávszélesség/fogyasztás arány 10,66 GB/másodperc/watt, addig ez az érték a HBM esetében több mint 35 GB/másodperc/watt ... amíg 1 GB-nyi GDDR5 memória 672 mm²-es területet igényel a VGA-n, addig a HBM esetében 1 GB-nyi kapacitás kijön mindössze 35 mm²-ből, vagyis 19-szer kevesebb hely szükséges ugyanakkora memóriakapacitás kiépítéséhez."

...vagyis azonos sávszélesség esetén 19-szer kisebb felületen harmad akkora fogyasztás → nagyjából hatszor akkora hőtermelés egységnyi felületen. Ráadásul a sávszélesség nőni fog. Mindenesetre nagyon kíváncsi leszek mind a HBM-re, mind pedig az új AMD kártyákra. A legújabb GeForce-ok jóval kevesebbet fogyasztottak, remélem ez (is) meg fog változni.

-

ukornel

aktív tag

Én is tartok ettől. Vagy inkább kíváncsi vagyok.

Mondjuk, a lapkán terpeszkedő eDRAM sem olcsó. Nem véletlenül nyomatja az Intel is a "saját" megoldását (együttműködve a Micronnal), csak az egy kicsit másképp működik, és más a neve (memóriakocka, vagy mi).

Szerk. Megvan: Hybrid Memory Cube

#34 Rubbi

Az nVidiától a Pascal GPU-k állítólag már ilyennel fognak jönni.

-

Chiller

őstag

Nem kell, hogy olcsóbb legyen. Reális ára legyen inkább.

Teszem azt, betennének egy Tonga GPU-t, 8 db jaguar (esetleg Zen) magot (pl 2.5-3 GHz-en), 8GB HBM memóriát, és kész is. Ez ütne minden APU-t, úgy mondjuk (hasraütés) 5 éven át. Meg lehet minden mást is

Na persze 250W-os fogyasztású APU-hoz jó drága alaplap, és spéci hűtés is kellene. Már ha le lehetne gyártani egyáltalán.

De persze lehet elég lenne egy PS4 szintű, ~1200 shaderes "kis" APU is, szerintem az is alázná évekig az intel APU-kat, crystalwell ide vagy oda.

-

O_L_I

őstag

Ezzel a technológiával a mobil SOC-ok mellé is lehet majd rendes sávszéllességű memóriát tenni?

-

Duck663

őstag

"Az AMD egyébként nem feltétlenül tekint a HBM-re abszolút megoldásként, így olyan dizájnokat is vizsgálnak, amelyek a HBM és a DDR4 kombinációi. Ilyen esetben az adott lapka tokozása tartalmazna pár gigabájtnyi rendkívül gyors HBM memóriát, amelyet kiegészítene a tokozáson kívüli, lassabb DDR4 memória, amely viszont akár több száz gigabájtnyi kapacitást is kínálhat."

APU-khoz épp ideális lenne, sőt a következő konzolgenerációhoz is.

-

Jogos a kérdés. Én inkább a cikkben említett HBM+DDR4 kombót tartom ésszerű kombinációnak. Kapjon 1-2GB HBM-et az iGPU, a DDR4 rendszermemória pedig legyen ott mellette, mint eddig is. Ez már nagy dobhat a sebességen, mármint a grafikai megjelenítés terén.

#28 shteer: Biztos nem, mert nem beszélnek magyarul.

-

shteer

titán

válasz

SpongyaBob

#24

üzenetére

SpongyaBob

#24

üzenetére

Gondolod nVidianal karba tett kezzel olvassak a HMB-s ph!-cikket?

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

#45185024

törölt tag

Jó cikk, tiszta, érthető.

Nagyon nagyon várom már a megjelenését.

Ha jól értelmezem minél több a memória annál nagyobb lesz az AMD kártyák előnye.

Pár gigán ez még nem ugrik annyira ki, AMD nek most arra kell gyúrnia hogy minél nagyobb mem es kártyák kerüljenek ki és elolvad az Nvidia Amd TDP közötti különbség... -

ukornel

aktív tag

"Az nVidia használ magasabb órajelű GDDR5 memóriát (1750MHz vs 1250MHz), ennek ellenére kisebb TDP-vel."

Rendre keskenyebb buszon (256 bit, ahol hasonló teljesítményű AMD-s kártya 384 bit, illetve 384 bit vs 512 bit) éri el ezt.

#21 Laja333, #23 Yutani

Sajnos így első körben nem szóltak a hírek arról, hogy APU mellé is tokoznának HBM-et.

Pedig igény lenne rá :-)#24 Rubbi

Az Intelnek is lesz valami hasonlója, csak azt máshogy hívják.

-

Fiery

veterán

Csupan az a kerdes, hogy egy ilyen nagy iGPU-s, HBM-es AMD APU vajon mennyibe kerulne? Olcsobb tudna lenni mondjuk 8 GB integralt HBM-mel, mint egy Broadwell-H + 128 MB eDRAM + 8 GB LPDDR4? Nem tudom a valaszt, tenyleg artatlan kerdes ez, fogalmam sincs, mennyibe fog kerulni egy HBM-es APU eloallitasa...

-

Ezzel a memória típussal komolyan el tudna lépni iGPU teljesítményben az AMD, ha van egy kis esze. Hiszen már most is megvan a komoly számítási kapacitás, csak a memória sávszélesség hiányzik, ami miatt nem tud felnőni az azonos CU-kat tartalmazó asztali verziókhoz.

Ez nagyon jó lenne az egybegépekhez és a laptopokhoz. És akkor az Intelnek igaza lesz, hogy a laptopokban a dGPU elhagyását kérik a gyártóktól. Csak éppen ezen az AMD nyerhetne, ha meggyőző tud lenni teljesítményben.

-

satz18

őstag

Hát ez baromi jól hangzik. Reméljük valami nagyon jó fog kisülni belőle. Talán egyszer eltűnnek a ddr3-as VGA-k is.

-

Laja333

őstag

válasz

Peetee(tm)

#20

üzenetére

Peetee(tm)

#20

üzenetére

Én is az APU-kat várom. Vennék már egy jó kis notebookot.

-

Peetee(tm)

aktív tag

Érdekes cikk, már vártam.

Gőzöm sincs mit hoz a jövő.

Én egy helyen látom jelenleg értelmét az pedig az APU-k ahol eddig hiába pakolták bele jó kis VGA-kat, de a teljesítményük kiaknázatlan maradt.

Szülessen meg minél hamarabb egy APU vele és remélem csodát fogunk látni, jó értelemben.

Nem mellesleg egy kis siker újra ráférne az AMD-re, csakhogy legyen egy kis verseny is. -

-

V!ck

senior tag

Igen ám, de ahol ilyen bődület sebességet használ az nvidia, ott 256bites (a 960 csak 128bites) a kártya, míg az AMD-nél 512bites is van... ilyen komplex rendszerben pedig lehet, hogy arányaiban sokkal magasabb lenne a fogyasztás és nem érné meg, mert nem lenne elég a keret a GPU-nak. Ez csak tipp...

-

Router

őstag

A történelem megismétli önmagát.

-

seolwon

tag

"Ráadásul a fogyasztás a GDDR5 memóriák órajelének, illetve az üzemfeszültségének növelésével csak rosszabb lett, így elértünk arra a pontra, hogy egy 300 wattos TDP fogyasztással rendelkező csúcskártyán a GDDR5 memóriák, illetve a működésükhöz szükséges komponensek elviszik a fogyasztási keret majdnem egyötödét. Ez azt is jelenti, hogy a VGA-kra kisebb fogyasztású GPU-kat lehet építeni, és ez a trend az elmúlt években nagyon is megfigyelhető volt."

Az nVidia használ magasabb órajelű GDDR5 memóriát (1750MHz vs 1250MHz), ennek ellenére kisebb TDP-vel. Szóval az a "nagyon is megfigyelhető trend" hol figyelhető meg pontosan?

-

Kotomicuki

senior tag

Végre, jó pár év késéssel, de megértük ezt is, csak így tovább -> bele a RAM-ot a CPU/GPU/APU-ba, de mentül többet, gyorsabbat és minél szélesebb buszon!

Aztán már csak a háttértár és I/O-rendszerek gyökeres megújítása marad hátra és kész a kora-XXI. századi PC is! -

Angel1981

veterán

TROLL ON

Ez megint egy újabb AMD féle "meglátjátokmajd5évmúlvahúúúúmilyenüberszuperbrutállesz!!!"

Aztán 5 év múlva tücsökciripelés?

TROLL OFF

-

ssppiikkee

tag

A tartósság is fő szempont kell hogy legyen, de ennyi fejlesztéssel töltött év után, nyilvánvaló hogy megbízható konfiguráció születik belőle! És szélesebben körben is érdemes alkalmazni szerintem

-

repvez

addikt

Arra azért kiváncsi vagyok, hogy mi miatt nem lehet ezt az eljárást még rendszermemóriaként használni, mert ott ugye nehogy DDR5 hanem mégcsak a 3as szintnél tartunk.

Bár még mindig az adattárolás a leglassabb eleme az egész rendszernek. 10 évvel ezelött is kb ugyan anyni időbe telt betölteni meg átmásolni mint mostanság , érezhető javulás nem sok volt.

Amugy a jó oldalát leirták a cikkben,de arról elfeledkeztek, hogy hátrányként az egymásra pakolt memoria rétegek és a GPU mag közelébe pakolás az eléggé kis helyre koncentrálja a hőt és igy még nehezebb lesz hatékony hütést késziteni a VGA-ra, mikor már most is eléggé a határon vannak egyes tipusnál.

Ha jól olvastam akkor a 390x-et már vizhütéssel árulják.Kérdés, hogy mennyire megbizható és sérülékeny egy ilyen rendszer.

-

Olajka02

aktív tag

Én csak bele kukkantottam, és az számomra világosan látszik, hogy helyet biztosan meg lehet vele takarítani.

Tehát én úgy gondolom, hogy a videókártyák mérete pl- ez által csökkenhet (nyák alapterülete), a teljesítmény megtartása, vagy növekedése mellett .

De lehet hogy rosszul értelmeztem... -

babkukta

senior tag

nagyon kíváncsi leszek erre a tényleges gyakorlatban!! Ez mind jól néz ki, aláírom! De működjön is így! Valamint kicsit félek még attól (igaz 7 éven át tartott a fejlesztés, de mégis kezdetleges az egész), hogy mennyire lesz hatékony és tartós ez a cucc

-

-

snecy20

nagyúr

Valaki összefoglalná, hogy ez milyen lényeges változásokat hozhatna a jövőben? Nagyon nem sikerült megértenem a cikkből, magas ez nekem.

-

Sondi1986

addikt

A lényeg hogy mennyiért lehet majd licencelni az AMD-től.

-

ukornel

aktív tag

Kíváncsi vagyok, hova fejlődik a HBM.

Valamivel nagyobb kapacitással laptopba, mobilba APU, SOC mellé is ideális lenne, DDR4 nélkül.A HPC szegmens is profitálhatna belőle. Az utóbbi évek csúcstartó szuperszámítógépeit végignézve az látszik, hogy az egy magra eső memória mennyiség biztosítására talán már a mostani HBM implementáció is alkalmas lenne. Némi fejlesztéssel (8 hi, 16 hi?

) pedig megközelítheti az egységnyi számítási teljesítményre eső memóriamennyiség (GB/TFLOPS) legutóbbi trendjeit.

) pedig megközelítheti az egységnyi számítási teljesítményre eső memóriamennyiség (GB/TFLOPS) legutóbbi trendjeit.#2 Sondi1986

Ez JEDEC szabvány, nem?

Új hozzászólás Aktív témák

- iKing.Hu - Nubia Z70 Ultra 5G Black Teljes kijelzős zászlóshajó, AI-erejű teljesítmény

- Honor X7b 128GB, Kártyafüggetlen, 1 Év Garanciával

- iKing.Hu - Samsung Galaxy S25 Edge Prémium dizájn, AI-élmény a zsebedben 12/512 GB

- Macbook Pro 2019 // i5 // 1TB // Számla+Garancia //

- ÁRGARANCIA!Épített KomPhone Ryzen 7 7700X 32/64GB RAM RX 9070 16GB GAMER PC termékbeszámítással

Állásajánlatok

Cég: PCMENTOR SZERVIZ KFT.

Város: Budapest

Cég: CAMERA-PRO Hungary Kft.

Város: Budapest

azért mert 5 éve egyszer valami szarul működött egyszer egy hónapig, evidens, hogy ma is ugyan olyan szar.

azért mert 5 éve egyszer valami szarul működött egyszer egy hónapig, evidens, hogy ma is ugyan olyan szar.

Abból jóval több fogyott, mint az XTX-ből, és 512MB GDDR4 memória volt rajta.

Abból jóval több fogyott, mint az XTX-ből, és 512MB GDDR4 memória volt rajta. . Ezek szerint tényleg kifejezetten sokat fogyaszt a memória is

. Ezek szerint tényleg kifejezetten sokat fogyaszt a memória is  , szóval a nagyobb sávszélességen felül is van értelme a HBM-nek. Mondjuk a csúcskártyáknál szerintem eddig se a memória sávszélesség volt a limitáló tényező, de az mindenképp jó dolog, ha néhány 10 W-tal csökkenhet(ne) a fogyasztás. Persze nem biztos, hogy fog csökkenni, jó lesz majd a GPU-nak a plusz keret - mondjuk ez az AMD-nek jól jöhet, az nVidia viszont nagyon jól eltalálta a kártyái hatékonyságát, úgyhogy könnyen lehet, hogy náluk még tovább fog csökkenni a fogyasztás.

, szóval a nagyobb sávszélességen felül is van értelme a HBM-nek. Mondjuk a csúcskártyáknál szerintem eddig se a memória sávszélesség volt a limitáló tényező, de az mindenképp jó dolog, ha néhány 10 W-tal csökkenhet(ne) a fogyasztás. Persze nem biztos, hogy fog csökkenni, jó lesz majd a GPU-nak a plusz keret - mondjuk ez az AMD-nek jól jöhet, az nVidia viszont nagyon jól eltalálta a kártyái hatékonyságát, úgyhogy könnyen lehet, hogy náluk még tovább fog csökkenni a fogyasztás.

Mondjuk nem tudom, hogy mennyit fogyaszt a GDDR5, de minden bizonnyal nem túl sokat.

Mondjuk nem tudom, hogy mennyit fogyaszt a GDDR5, de minden bizonnyal nem túl sokat.

) )

) )

![;]](http://cdn.rios.hu/dl/s/v1.gif)