-

Fototrend

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

S_x96x_S

őstag

válasz

Busterftw

#61110

üzenetére

Busterftw

#61110

üzenetére

holnap meglátjuk az AMD 2023Q1 -es eredményeket ..

mindenesetre nem árt tudni,

hogy a nVidia lehet, hogy nagy re-brandingot tervez ..![;]](//cdn.rios.hu/dl/s/v1.gif) és dolgozik a quantum GPU-n.

és dolgozik a quantum GPU-n.

1.)

https://www.jonpeddie.com/news/nvidia-renames-company/

Nvidia renames company

Rebrands GPUs as 3dfx.This is not the first rebranding for the company. Several years ago, Taiwanese-born CEO Jen-Hsun Huang rebranded himself as Jensen and identified as Swedish to prevent the company from being invaded by the Chinese People’s Liberation Army.

“The 3dfx brand still has a whole lot of value to us old gamers, but there’s an awful lot of young gamers today who have never heard the name,” said Huang. “This is a chance to bring the name to a whole new generation of players. And let’s face it, GeForce is a dumb name and reminds me of a badly dubbed 1970s Japanese anime TV series featuring Casey Kasem.”

Nvidia also announced plans to release a Founders Edition of the Voodoo 5 6000 for $15,999. Third-party cards from Asus, Gigabyte, and Zotac will also be available for $20,999.2.)

https://www.jonpeddie.com/news/nvidia-reveals-it-is-working-on-a-quantum-gpu/

Nvidia reveals it is working on a quantum GPU

Imagination Technologies is said to have a working prototype."Based on Nvidia’s experimental cryogenically cooled Schrödinger architecture, the company has announced early results on a room-temperature version, the S104.

“It’s still early days,” said Nvidia’s chief scientist, Bill Dally, “and we are still challenged a bit by memory speeds—feeding the beast—but preliminary tests are very encouraging, or not, or both at the same time.”

"Mottó: "A verseny jó!"

-

hahakocka

senior tag

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#61339

üzenetére

Busterftw

#61339

üzenetére

Itt egyetlen képességről van szó, méghozzá a BVH geometriájának streameléséről, vagyis egy adott határoló dobozból egy másikba átlépő sugár nem csak előre beállított, menet közben megváltoztathatatlan geometriai részletességgel dolgozhat, hanem utóbbi dinamikusan módosítható. Ez kellene PC-re is, és akkor ugyanaz az RT effekt nem csak gyorsabban futna, de tizedannyi memóriát is igényelne. Persze a másik megoldás is jó, mehetünk 16 GB-os VRAM-ra, de ez igazából pazarlás marad mindig.

#61338 Yany : Az AMD csak olyan licenc mellett fog fejleszteni, amit a Microsoft egyben átvehet a GDK-ba. Az nem éri meg nekik, hogy az Xboxra külön kell egy másik eljárást fejleszteni.

Manapság egyre több játék csak a GDK-ből építkezik PC-n is, lásd Jedi Survivor. Azért nincs benne más felskálázó csak FSR, mert a GDK nem támogat mást.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

kopi72

aktív tag

válasz

Busterftw

#61373

üzenetére

Busterftw

#61373

üzenetére

Sajnos biztosan tudom, h az egyik most vett M2-t. De nem szokott jatszani, es linuxot hasznal a mac-en is. Raadasul okos, ertelmes embernek ismertem meg, de nagyon elcsodalkoztam ezen amit mondott : "az M2 lenyomja az RTX 4070-et" :-)

Magyarorszag a mosoly orszaga. Akar kiskoruton akar nagykoruton elmenygazdag utazasban lehet resze!

-

hahakocka

senior tag

válasz

Busterftw

#61452

üzenetére

Busterftw

#61452

üzenetére

Működik a marketing az RT és DLSS mindent felülír! A több vramot. az olcsóbb árat, s jó ár értéket, az erősebb rasztert, (4070ti sokszor 20 fps el lassabb 7900 xt nél de RT ben se sokkal jobb amúgy) a SAM ot ha van 5000, 7000 Ryzen proci, az FSR 3 hozhat még valamit nyáron talán.

-

hahakocka

senior tag

válasz

Busterftw

#61454

üzenetére

Busterftw

#61454

üzenetére

Nèzd meg a legnagyobb teszteket S meglszod mennyivel jobb most ár èrtèkben raszter erőben , vramban az Amd S az Intel drivere is folyton aprókat lèp előre. S jön akit èrxekel a Flas az FSR3 is nyàron. Persze erős a Geforce de raszterben nem igazân S àrban meg igen jó drâga. Ezèrt vâlt sorban egy csomó ismerősöm 15 èv utàn NV re sokat spóroltak vele telj hiàby nèlkül , több vrammal .

-

hahakocka

senior tag

válasz

Busterftw

#61456

üzenetére

Busterftw

#61456

üzenetére

Majd meglàtjuk az esetleges csökkenő Nvidia % ban . A Gamer Nexus , HWU stb youtube oldalaknâl nagyon nagyon sok kommentelő ugyanúgy vèlekedett hogy Amd re vâlt a vram S az àr èrtèk okàn. Elèg volt ennyi Nv írtàk. Ez egy olyan tendencia amit eddig nem làttam ekkora mèrtèkben, s tapasztalom is itthon is rokonoknäl, ismerősöknèl olyannál is aki azt hittem sose vesz Amd-t. 8 ève, amikor Amd t vettem újra nekem is elsőre fura volt.

[ Szerkesztve ]

-

szmörlock007

aktív tag

válasz

Busterftw

#61529

üzenetére

Busterftw

#61529

üzenetére

"Ryzen/Epyc fronton nincs semmi új, túl korai lenne next genről beszélni, az AI területén sincs semmi kész úgy látszik amivel az Nvidia ellen lehetne menni a mostani AI lázban."

Hát ez ebben a formában egyáltalán nem igaz, június 13-án lesz a Data Center and AI Technology Premiere, minek mutassanak most AI és szerveres termékeket amikor 2 hét múlva külön erre lesz egy előadás

-

Petykemano

veterán

válasz

Busterftw

#61531

üzenetére

Busterftw

#61531

üzenetére

Valószínűnek tartom, hogy a Mi300-ra fordítják most az erőforrásaikat.

az AI most van felszállóágban. Bizonyára úgy érzik, hogy erre a vonatra most lehet felülni. Itt fél éves késés az egész üzletágat jelentheti, míg a Zen5 fél éves csúszása nem jelent semmit.Szerintem a Compurexre notebbookokokat akartak volna mutogatni, és szerintem az FSR3-at. De mivel az AMD az okosak szerint szoftverben van lemaradve az AI terén is, ezért nem lepődnék meg, ha kiderülne, hogy átcsoportosították oda az erőforrásokat is.

Találgatunk, aztán majd úgyis kiderül..

-

HSM

félisten

válasz

Busterftw

#61551

üzenetére

Busterftw

#61551

üzenetére

Oké, leírom akkor egyszerűbben. Miközben a lassú standardizálási folyamat zajlott az AMD javaslatára, ők gyorsan kihoztak egy gyorsan összelapátolt saját verziót, drágán, hogy még ebből is legyen némi extra profitjuk és úgy tűnjön, kitaláltak valamit, amikor notebookoknál már gyakorlatilag 2008 óta a szabvány része volt ez....

Ez nem innováció, hanem marketing + nem túl felhasználóbarát stratégia. -

PuMbA

titán

válasz

Busterftw

#61555

üzenetére

Busterftw

#61555

üzenetére

Egy javítás. Igaz, hogy 48Hz az alja, de az LFC (Low Frequency Compensation) miatt alatta is működik, mert akkor minimum megduplázza a képkockákat, hogy beférjen 48Hz fölé. Nálam is jól működik NVIDIA-val és 48Hz alatt sincs képtörésem, ugyanolyan sima minden, mint 48Hz felett.

[ Szerkesztve ]

-

S_x96x_S

őstag

válasz

Busterftw

#61555

üzenetére

Busterftw

#61555

üzenetére

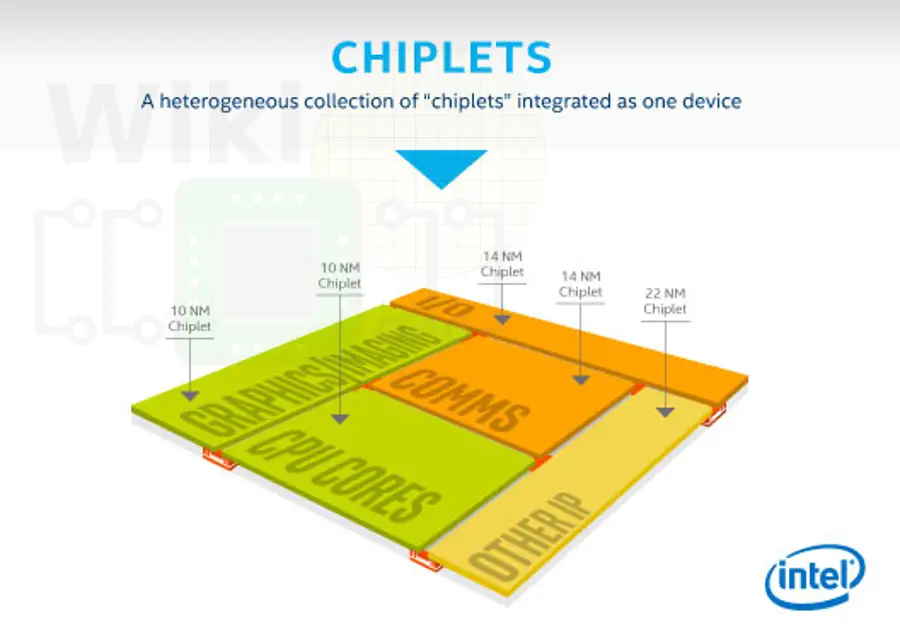

> A chiplet ugye a DARPA CHIPS-tol szarmazik,

> csak az AMD hozta le consumer CPU piacra.a DARPA CHIPS részben egy kőleves program volt.

(2018) Köszi Intel

wikichip: Intel Opens AIB for DARPA’s CHIPS Program as a Royalty-Free Interconnect Standard for Chiplet Architecturesmint a versikében:

Ez elment vadászni,

Ez meglőtte,

Ez hazavitte,

Ez megsütötte,

Ez az iciri-piciri AMD pedig mind megette!azért az AMD sok saját munkát tett bele ; és mivel nem volt más alternativája

elég nagy tétet raktak rá.akkoriban az Intel-nek volt elég jó alternativája a chiplet-re

- és emiatt nem is tettek rá akkora fókuszt mint az AMD.

( nekik ez akkoriban nem volt kényszerhelyzet ; el is aludták ... )Ez kérem szépen ... Technológiamenedzsment ..

( 2018 - Intel Chiplets ... )

[ Szerkesztve ]

Mottó: "A verseny jó!"

-

kisfurko

senior tag

válasz

Busterftw

#61587

üzenetére

Busterftw

#61587

üzenetére

Nem, nem olyan, mert egy szabvány megalkotása jóval hosszabb folyamat, mint egy saját fejlesztés keresztülvitele. A DLSS meg az FSR egyik se szabvány, csak egy implementáció egy adott problémára. Tudom, hogy az nvidia-only emberek számára ez másodlagos, de ha rendes szabványban jön ki a G-Sync tudása, akkor nem lett volna az "én monitorom csak ájemdével megy, az enyimé meg csak envídiával, vennem kell másikat".

-

kisfurko

senior tag

válasz

Busterftw

#61598

üzenetére

Busterftw

#61598

üzenetére

Ezt senki nem mondta. Még egyszer. A G-Sync nem szabvány.

Nem látjuk, hogy a G-Sync dolgait nem akarta-e már korábban az Nvidia a szabvány részévé tenni, amin a többiek meg akadékoskodtak, mert nekik nem jött volna ki a matek, meg az időzítés. Erre Nvidia implementálta a monitorba kerülő modult, hogy a chipjében lévő G-Sync képes hw feature-t be tudja mutatni, és innentől szart nagyívben az egységesítésre, részéről a munka letudva. Mivel főgémerék úgyis az ő portékájukat veszik, ezért sokat nem kockáztattak, a drágulást meg átrakták a monitorgyártókra, akik meg a főgémerekre a prémium érzésért cserébe.

Hogy így volt-e, sosem tudjuk meg, mindenesetre az FPGA használata jól mutatja, hogy nem egy végleges megoldás volt (mert vagy kicsi széria, úgyis jönni fog a "rendes" implementáció a gyártótól, vagy nem elég kiforrott, szükséges az FPGA újrakonfigurációs képessége). -

S_x96x_S

őstag

válasz

Busterftw

#61609

üzenetére

Busterftw

#61609

üzenetére

Az hogy feladta, 90%-ban Geohot-ról szól .. ( és a befektetői hangulatról )

és csak 10%-ban az AMD-ről.Tapasztaltabb emberek - azért 1-2 hónapot foglalkoznak a témával, mielőtt kiállnak a nyilvánosság elé a tervükkel. És nem feltételezik, hogy bármilyen cég hibátlan hardvert készít.

persze az is lehet, hogy valami más ...

pl. egy extrém nagy pénzösszeg tömegvonzása letéritette az eredeti célról![;]](//cdn.rios.hu/dl/s/v1.gif) ..

..

Én az nVidia helyében amúgy megkörnyékeztem volna ..Mottó: "A verseny jó!"

-

S_x96x_S

őstag

válasz

Busterftw

#61822

üzenetére

Busterftw

#61822

üzenetére

> En forditva latom a tapasztalatok alapjan, a nyilt kod kockazat,

ha minden más változatlan, akkor a nyílt kódnak határozott előnye van.

és célszerű azt választani.

Aztán ha fizetsz a licenszért vagy a supportért az már egy külön ügy, de ha komoly a meló akkor fizetsz .. mert ez is a kockáat csökkentésének a módja.én már debuggoltam több olyan rendszert, aminél a két (zárt forásskodú) beszállító egymásra mutogatott, mert volt olyan extrém eset amikor nem müködött együtt ...

és én ezt nevezem kockázatnak ...Mottó: "A verseny jó!"

-

-

hahakocka

senior tag

válasz

Busterftw

#61883

üzenetére

Busterftw

#61883

üzenetére

Mi az off? PuMbA hozzászólásàra reagâltam S bezony neki előtte más VGA volt pont zöld ha jól tudom. De Amd re vàlt azèrt kèrdeztem hogy az arànyvàltás mèrtèke èrződjön a. Előtte Abuèkra egy db hozzászólàssal. . Istenem mi lett itt az utóbbi időkben.. 2007 óta fórumozok ilyet nem tapasztaltam....

Mi az off? PuMbA hozzászólásàra reagâltam S bezony neki előtte más VGA volt pont zöld ha jól tudom. De Amd re vàlt azèrt kèrdeztem hogy az arànyvàltás mèrtèke èrződjön a. Előtte Abuèkra egy db hozzászólàssal. . Istenem mi lett itt az utóbbi időkben.. 2007 óta fórumozok ilyet nem tapasztaltam....

Vigyàzz Kamelot dupla off topikot írtâl kèt Nv kari nèv! Agyrèm.[ Szerkesztve ]

-

Petykemano

veterán

válasz

Busterftw

#61943

üzenetére

Busterftw

#61943

üzenetére

> Semmi konkretumt nem tudni a teljesitmenyrol.

Nemrég volt egy kis buzz a MosaicML által, hogy az általuk kínált szoftverrel hardvergyártófüggetlenséget értek el. A100-zal összehasonlítva 73-80%-os teljestíményszintet értek el. [link]

Ugyanebben a cikkben azt is megemlítik egyébként, hogy a H100 még csak kezd megérkezni az adatközpontokba. Ezzel együtt a lemaradás tény. De sokkal fontosabb szempont, hogy a Mi300 olyan szoftveres környezetbe érkezzen meg - akármilyen teljesítményt is nyújt - ami fogadásra kész, semmint hogy akár nagyobb teljesítménnyel, akár előbb, de úgy legyen elérhető, hogy igazából szoftveres okokból a kutyát sem érdekli. Hosszú még ez az út az AMD-nek.

Találgatunk, aztán majd úgyis kiderül..

-

Yany

addikt

válasz

Busterftw

#61965

üzenetére

Busterftw

#61965

üzenetére

Az vicces volt, amikor az általam egyébként sokra tartott opimumtech-es gyerek bemondta, hogy tök egyforma az NVENC és a Radeonok AV1-es minősége, majd berakott kb. 0.2s-re egy comparison screenshotot és szénné gyalázta az NV minősége az AMD termékét. Ott varakartam a fejem, hogy a mindig korrekt srác hogy tálalhatta ezt így... Az a fura, hogy az AMD még mindig azt hiszi, hogy az fps/$ az egyetlen mutató, ami alapján az emberek GPU-t választanak. Vajon mikor esik le?

szerk.: megvan, ez volt az a video --> [link]

Ez egy random képkocka a pillanatra bevágott anyagából, több képkockát is megnéztem, nem egy kategória a kettő.[ Szerkesztve ]

Építs kötélhidat - https://u3d.as/3078

-

Petykemano

veterán

válasz

Busterftw

#62003

üzenetére

Busterftw

#62003

üzenetére

Hű. Szóval, a kártya még nem került kiadásra, de az, hogy ebből fakadóan annak eredményeiről megjelenő szivárgás csupán egy prototípus eredménye volna: feltételezés, valószínűsítés.

Mint ahogy az, hogy egy feltételezett prototípusról készült méréshez képest a végleges változat majd jobb eredményeket fog produkálni az is: feltételezés, valószínűsítés.

(Mindazonáltal az se bizonyos, ,hogy a feltehetően prototípus kártyákról szóló mérés hiteles.)Volt egy kérdés a napokban, amit fel sem vetettem, nehogy hamis reményeket keltsek. Jobb, ha elfogadjuk, hogy ez a két kártya - az RDNA3 - tényleg ennyit tud. Az eddigi GPU-kal kapcsolatos gyakorlat az, hogy a kiszivárgó teljesítményben nincs pozitív meglepetés, inkább a beharangozott árból hajlandók csippenteni.

Találgatunk, aztán majd úgyis kiderül..

-

hahakocka

senior tag

válasz

Busterftw

#62017

üzenetére

Busterftw

#62017

üzenetére

Blikk bulvár szintre időjârás jóslàsra azèrt ne menjünk le. A Moore Law is dead sràc is kb az a kategória .

3Dmark megannyi szor bizonyította NV S Amd kariknâl is hogy sokszor messze van az àtlag 1080p-1440-4K videójâtèk tesztek eredmènyeitől. Èn ezèrt nem nèzem fontosnak már jó ideje. A friss 4070 st is gyengèbbnek mutatta azt nem lett az.

S mint írtam ez prototípus bármi lehet mèg belőle. Lehet dumâlni róla mik a vàgyâlmok stb persze .b.

Az àr lesz fontos mèg ha pl 400 èrt adnàk S hoznà 4070 alját az durva lenne màrmint a 7700xt. A 7800xt 500-550 el hoznà 4070ti alját az lenne durva de ez kètsèges. Főleg ha lesz 7900 sima is esetleg.[ Szerkesztve ]

-

S_x96x_S

őstag

válasz

Busterftw

#62050

üzenetére

Busterftw

#62050

üzenetére

> Ha egy 4090-nél gyorsabb GPU kerülne a konzolba,

> akkor is a GPU bottleneck lesz nem CPU.Nem minden játék ( ~ játék engine ) egyforma, és léteznek CPU heavy játékok is,

valamint

Továbbá fontos figyelembe venni, hogy nem szabad csak az elmúlt öt év játékainak tendenciái alapján megjósolnunk a következő öt évben megjelenő játékok processzor igényeit. A technológia, és ezen belül a játékipar is, gyorsan fejlődik, ami azt jelenti, hogy a játékok hardverigényei is változnak.És még hozzá kell tenni, hogy a játékok egy része gyakran nem optimálisan van megtervezve a hardver erőforrások kihasználása szempontjából. Ez azt jelenti, hogy több erőforrást használnak, mint amennyi valójában szükséges lenne. Ha a játékfejlesztők több időt tudnának szánni a játékok optimalizálására, az csökkentené a processzorigényt. Azonban ez gyakran időigényes és költséges folyamat, és gyakran gazdasági okok miatt kerülnek mellőzésre ezek a lépések. Emellett a játékosok is elégedettebbek, ha a játékuk gyorsabban, akadások nélkül fut, ami gyakran nagyobb processzorigényt eredményez. Ezért a jövő konzoljainak processzoraival kapcsolatban fontos szem előtt tartani, hogy képesek legyenek kezelni ezeket a nem optimális helyzeteket is.

Nem véletlen, hogy amikor a Sony megkérdezte a fejlesztőket,

a fejlesztők egy része eleve 16 magos procit szeretett volna a PS5-be [1],

és a jelenlegi 8 CPU mag már egy kompromisszum eredménye, az APU miatt.

[1] "How PlayStation 5 Was Built (feat. Mark Cerny) | WIRED"

https://youtu.be/cJkx-OLgLzo?t=298Amúgy a CPU sok helyen be tud segíteni, pl.

- mesterséges intelligencia,

- animáció,

- fizikai modellezés,

- szimuláció terénA PS5 ~ Ryzen 3700 -nek feleltethető meg, persze fontos megjegyezni, hogy eléggé kibelezett a vektoros FP -je , mivel a teljesítménye ~ fele a zen2/zen3-nak.

"In an update from @Nemez (benchmark data from @ashilling), it appears that the FPU on the PS5 (using the 4700S which is basically the same SKU) is significantly slower than the Zen 2 and Zen 3 FPUs powering the Ryzen 3000 and 5000 CPUs, respectively. The vanilla Zen 2/Zen 3 chips are twice as fast as the 4700S (PS5) across most vector FP operations such as AVX256_float, SSE128_float, including add, div, sub, mul, and div." ( forrás )

Vagyis szerintem legalább egy dupla erős mag nem árt a PS5 PRO -ba.

és a dupla erős mag -> nagyobb single core teljesítmény,

ami kell is az UE5-höz, mivel a Ryzen 3600 már jelenleg is CPU limites." This suggests that UE5 performance is more reliant on single-core speed as opposed to exploiting the many cores and threads in a modern PC processor.

...

So where does all of this leave mid-range PCs? Right now at least, the mainstream favourite - the Ryzen 5 3600 - is severely CPU limited, averaging 30fps in static scenes but falling much lower when in movement. With that in mind, how did Epic get the console versions to run better? Well, let's bear in mind that even with specific optimisations, we're still far from a locked 30fps but even so, it seems that Epic's TSR upscaler doesn't deliver quite the same quality level as the PC rendition - meaning either a lower quality TSR or a lower base resolution."

( forrás )Mottó: "A verseny jó!"

-

S_x96x_S

őstag

válasz

Busterftw

#62052

üzenetére

Busterftw

#62052

üzenetére

>> 'This suggests that UE5 performance is more reliant

>> on single-core speed as opposed to

>> exploiting the many cores and threads in a modern PC processor."

> Hát akkor csináljanak erősebb magokat.ebben egyetértünk akkor ..

> Ettől még a bottleneck a GPU lesz, és ne felejtsd el, hogy 8K-ról beszéltél.

Azért kiváncsi lennék, hogy 8K-n a Lumen hibrid ray-tracing enginje

hogyan muzsikálna csak a normál 8x Zen2-es magokkal

( ami FP szempontjából is ki van belezve )

Persze van GPU gyorsítás mellé, de a CPU-t nem lehet kiküszöbölni ..vagyis egy rendszer bottleneck -je, nem állandó .. hanem vándorol.

[ Szerkesztve ]

Mottó: "A verseny jó!"

-

S_x96x_S

őstag

válasz

Busterftw

#62054

üzenetére

Busterftw

#62054

üzenetére

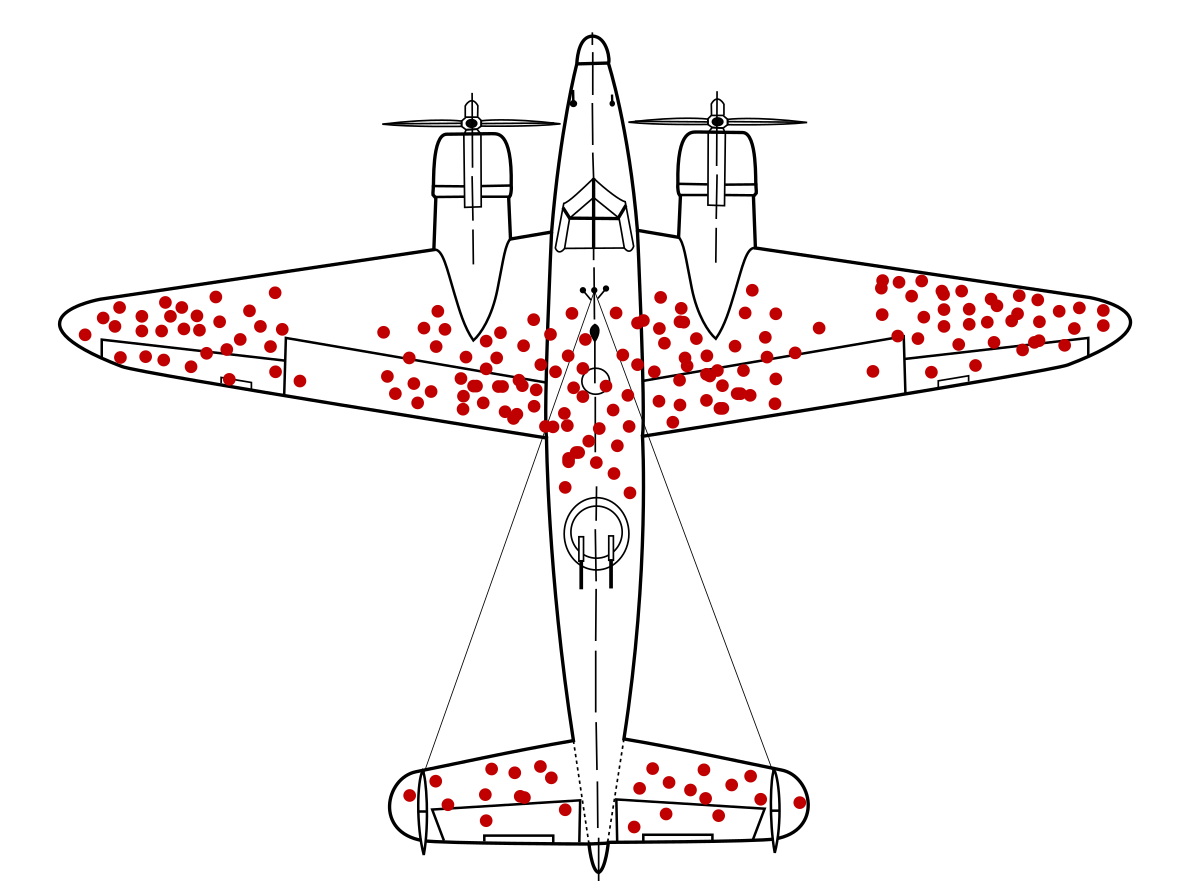

egy GPU-t a gyenge a cpu is visszafoghatja.

egyébként konzol alatt - felhasználóként - nem tudod kimérni, hogy mi a bottleneck.

és ami nem fut, azt nem is adják ki, vagy addig butítják a beállításokat,

amig 30fps stabilan nem jön ..persze ez másrészt fontos infó lenne ..

mert amit észlel egy felhasználó az csak az output

és ebből nem árt óvatosan következtetni.

( ~ survivorship bias )és ezt nem árt tudni egy jó és kiegyensúlyozott game (konzol) tervezésénél.

vagyis hova tegyük az extra erősítést ..

ha a Lumen hibrid ray-tracing engine-ből tanulságot szeretnénk levonni, akkor az az lenne,

hogy mindig lesz a jövőben olyan GPU feature, amit szoftveresen kell támogatni, mivel az aktuális GPU nem támogatja.

Emiatt sose árt egy pici CPU tartalék ;

és ez főleg az életciklus végén lesz igen fontos ..És ha már az életciklus eleján nagyon ki van centizve a cpu,

akkor az életciklus végén borítékolható, hogy nagyon fognak izzadni a fejlesztők ..[ Szerkesztve ]

Mottó: "A verseny jó!"

-

hahakocka

senior tag

válasz

Busterftw

#62026

üzenetére

Busterftw

#62026

üzenetére

Egy prototípus amit nem fogunk tudni megvenni e formàban, nekem Blikk színvonal vitatkozni róla.... Arról vitatkozni amit nem fogunk megvenni e formàban majd ezèrt mert prototípus . Mindegy akkor beszèlgessetek róla max nem olvasom ennyi.

A 4K S 8K felbontásoknâl.az előzőekhez mèrve inkàbb 2-2 , 2-2.5 szer nagyobb ugye vízszintes függőleges mód. Persze összessègèben 4 szer.

[ Szerkesztve ]

-

hahakocka

senior tag

válasz

Busterftw

#62061

üzenetére

Busterftw

#62061

üzenetére

Egyszerű csak nem olvasom addig ezt az alfórumot amíg nem jelentik be az új gpukat. Addig bulvàros prototípus híreken. S a Moore Law is dead, az eddigi valaha volt legjobb jósunk hírein.

Hàla ègnek a YT csatornàmon jó ideje nincsenek trollok. Csak pl a sikeres kritikai gondolkodásról szóló IT S videót megèrtők. -

bitblueduck

senior tag

válasz

Busterftw

#62097

üzenetére

Busterftw

#62097

üzenetére

azért a CP2077 szerintem eléggé jó barátja az nvidia-nak. mennyi hír meg benchmark volt ahol a RTX 3/4000 sorozat aratta a babérokat ezzel?

ha a bethesda nem lő félre akkor a Starfield hasonló lehet az AMD-nek.An open mind is like a fortress with its gates unbarred and unguarded.

-

S_x96x_S

őstag

válasz

Busterftw

#62097

üzenetére

Busterftw

#62097

üzenetére

> Pontosan, az AMD beleöl hatalmas lóvét, erőforrást a kódolásba,

> aztán majd kiderül Nvidia-n gyorsabb lesz a Starfield is.részben hardwares

részben szoftveres okai vannak a teljesítmény különbségnek ..viszont, hogy ott van az "AMD",

akkor a saját bőrén tapasztalhatja az általa tervezett architektúrát ..

vagyis ez amolyan "skin in the game" és az AMD NEM mutogathat a játékfejlesztőkre,remélem annyi mellékhatása lesz,

hogy nem csak felszínesen ( ~ "tünetileg") próbálják kezelni a problémákat,

hanem teljesen kielemzik .. és sok mindent tartósan javítanak ..

vagyis más projektek is nyernek ezzel ..De még hogyha az nVidia RTX 4090 ezek után is gyorsabb lenne,

még mindig lehet érvelni, hogyha az AMD nem folyt volna bele,

akkor a különbség még nagyobb lenne ..a verseny jó ..

Mottó: "A verseny jó!"

-

-

Yany

addikt

válasz

Busterftw

#62217

üzenetére

Busterftw

#62217

üzenetére

Mit jelent, hogy "bedobja a törölközőt"? Ilyen gazdasági fogalom nincs. Átadta a piacot? Puszira? Vagy "rádöbbent", hogy nem elég jó? Vagy nem is tudom, hogy kéne ezt érteni. Egyik ostobább felvetés, mint a másik. Egy vállalkozás egy piacon, amin jelen van, max. elveszti a versenyt, vagy ha jobban tetszik, a csatát, de nem adja oda, mert felébred egy hirtelen álomból, hogy "jaj!". "Odaadja az A piacot mert ott van nekik a B és C" ??? Ez mi? Néha túltoljátok itt ezt a lamentálást, hogy mi történhetett és kvázi személyként tekintetek egy vállalatra.

Építs kötélhidat - https://u3d.as/3078

-

S_x96x_S

őstag

válasz

Busterftw

#62217

üzenetére

Busterftw

#62217

üzenetére

> Az mennyire lehet reális indok, amit pár komment is említ,

> hogy az AMD egyszerűen bedobta a törölközőt

> és feladja a high end szegmens versenyt Nvidiaval.semmenyire ..

de ha úgy fogalmazod meg,

hogy az AMD minden (GPU) fejlesztést az AI-nak és az Mi300 /Mi400-nak rendelt alá ,,

mert az AI high- end szegmensben van a pénz

és az Nvidiát ott lehet érzékenyen betámadni és kiénekelni a sajtot ..

és emiatt a consumer piacra minimálisan fókuszál, akkor az mindenkinek jobban hangzik.hasonló stratégia - mint az Intel ellen is

a zsíros Xeon / szerver piacra ment rá és a budget atom/i3 szegmensre minimálisan fókuszál. Ott se mondod, hogy feladta a versenyt az Intellel ..![;]](//cdn.rios.hu/dl/s/v1.gif)

Mottó: "A verseny jó!"

-

Petykemano

veterán

válasz

Busterftw

#62217

üzenetére

Busterftw

#62217

üzenetére

Szerintem ehhez az szükséges, hogy alapjaiban változzon meg az elképzelés arról, hogy mi eredményez eladást, mindshare-t.

Eddig legalábbis egy erős érvnek számított az, hogy ha egy márka tartósan őrzi a királytermék birtokosa címet, akkor annak kivételességének fénye az alsóbb szegmensbe tartozó termékekre is rávetül - részben azáltal, hogy a terméket eleve jónak gondoljuk, részben a győztes csapathoz húzás miatt. Ebből a szempontból fontos, hogy kinek a kártyája van influencerek, teszterek gépében, akik a legjobbat akarják, nem pedig a "legjobbat, valami magyarázattal"

Az egész chipletezésnek a legfőbb célja - túl azon, hogy különböző gyártástechnológiák használatával lehet spórolni - hogy végső soron nagyobb összlapkaméretet tudsz összerakni, mint monolitikus módon az lehetséges (ide értve a defektarányt is) volna. Az AMD halad ebbe az irányba. Nehezen tudom elképzelni, hogy amúgy technikailag minden kész és alkalmas lenne chipletekből összerakni nagyobb teljesítményű terméket (ami működik is, skálázódik is), de úgy döntenek, hogy "áh, inkább mégse".

Szerintem tehát inkább lehet szó arról, hogy valami nem sikerült. (Esetleg az, hogy egy másik koncepció jobban bevált.)

Találgatunk, aztán majd úgyis kiderül..

-

S_x96x_S

őstag

válasz

Busterftw

#62225

üzenetére

Busterftw

#62225

üzenetére

> Persze a shownak mennie kell, "we love gamers" és "hozhattunk

> volna mi is egy 4090 szintű kártyát de mégsem" duma megy,

> de ők is látják a számokból és a közhangulatból, hogy

> ez így nem megy.azért újabban elég magabiztos az AMD ...

és most is lóugrásban halad,

amit egy egyszerű halandó - aki csak egy megfizethető GPU-t

szeretne ( ráadásul PONT MOST vagy karácsonyra )

teljesen jogosan nem ért meg.az AMD mint cég - globális optimuma más.

és most az AI az a terület .. amire 100%-ban fókuszál.De én az nVidia helyében sem dölnék megelégedetten hátra

.. mert az már látszik, hogy az

AMD hova akar eljutni és mi a stratégiája

és ha az AI chipletes gyorsítás teljesen működik majd,

akkor az a gaming szintre is lecsorog. (RDNA4, RDNA5 )Mottó: "A verseny jó!"

-

PuMbA

titán

válasz

Busterftw

#62246

üzenetére

Busterftw

#62246

üzenetére

Az a baj, hogy az AMD az alsó és közép kategóriában akar versenyezni, de a most kijött 40 játékot tartalmazó RX7600 vs RTX4060 Hardware Unboxed tesztben az látszik, hogy az AMD raszterben egál, RT-ben jóval lassabb és többet fogyaszt, miközben közel azonos áron vannak a boltokban. Eltűnt az AMD előnye, ami az előző generációban még ott volt az RX6600 vs RTX3050 személyében.

[ Szerkesztve ]

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#62255

üzenetére

Busterftw

#62255

üzenetére

Árban drágább csak Instinct MI300A-t venni, mint EPYC+gyorsítót, viszont nem a hardver ára a lényeges a cégeknek, mert az valójában a teljes beruházási költség nem túl nagy része. Amiben erős az MI300A, az a jobb fogyasztás és AI-hoz sokkal jobban illő felépítés. Tehát a TCO-ban már gyorsan visszahozza a hardver az árát, és egy éves távon már az MI300A az olcsóbb. Tehát ha legalább egy évig megtartja a vásárló a hardvert, akkor jobban megéri MI300A-t venni, mint EPYC+gyorsítót.

Alapvetően ez az a két dolog, ami miatt most rácuppant a piac az MI300-ra. Az MI300X-nél a memóriakapacitás a kulcs, míg az MI300A-nál a TCO, meg az a tény, hogy APU-ról van szó.

#62256 b. : Nyilván az MI300A nagy előnye, hogy nem kell átírni a szoftvereket ARM-ra. De ez csak ideiglenes előny, idővel, teszem azt úgy 3-4 éves távon elvész. Az NV-nél a Grace+Hopper ennek az iránynak a nulladik generációja. Ez a bevezető, hogy elkezdődjenek a szoftveres munkálatok.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- Apple Watch

- AMD CPU-k jövője - amit tudni vélünk

- Milyen hagyományos (nem okos-) telefont vegyek?

- World of Tanks - MMO

- Elkészült Oroszország első litográfiai berendezése

- BestBuy ruhás topik

- sziku69: Szólánc.

- Luck Dragon: Asszociációs játék. :)

- sziku69: Fűzzük össze a szavakat :)

- DIGI kábel TV

- További aktív témák...

Állásajánlatok

Cég: Alpha Laptopszerviz Kft.

Város: Pécs

Cég: Ozeki Kft.

Város: Debrecen

![;]](http://cdn.rios.hu/dl/s/v1.gif) és dolgozik a quantum GPU-n.

és dolgozik a quantum GPU-n.

Mi az off? PuMbA hozzászólásàra reagâltam S bezony neki előtte más VGA volt pont zöld ha jól tudom. De Amd re vàlt azèrt kèrdeztem hogy az arànyvàltás mèrtèke èrződjön a. Előtte Abuèkra egy db hozzászólàssal. . Istenem mi lett itt az utóbbi időkben.. 2007 óta fórumozok ilyet nem tapasztaltam....

Mi az off? PuMbA hozzászólásàra reagâltam S bezony neki előtte más VGA volt pont zöld ha jól tudom. De Amd re vàlt azèrt kèrdeztem hogy az arànyvàltás mèrtèke èrződjön a. Előtte Abuèkra egy db hozzászólàssal. . Istenem mi lett itt az utóbbi időkben.. 2007 óta fórumozok ilyet nem tapasztaltam....