-

Fórumok

LOGOUT - lépj ki, lépj be!

LOGOUT reakciók Monologoszféra FototrendGAMEPOD - játék fórumok

PC játékok Konzol játékok MobiljátékokMobilarena - mobil fórumok

Okostelefonok Mobiltelefonok Okosórák Autó+mobil Üzlet és Szolgáltatások Mobilalkalmazások Tartozékok, egyebek Mobilarena blogokPROHARDVER! - hardver fórumok

Notebookok TV & Audió Digitális fényképezés Alaplapok, chipsetek, memóriák Processzorok, tuning Hűtés, házak, tápok, modding Videokártyák Monitorok Adattárolás Multimédia, életmód, 3D nyomtatás Nyomtatók, szkennerek Tabletek, E-bookok PC, mini PC, barebone, szerver Beviteli eszközök Egyéb hardverek PROHARDVER! BlogokIT café - infotech fórumok

Infotech Hálózat, szolgáltatók OS, alkalmazások SzoftverfejlesztésFÁRADT GŐZ - közösségi tér szinte bármiről

Tudomány, oktatás Sport, életmód, utazás, egészség Kultúra, művészet, média Gazdaság, jog Technika, hobbi, otthon Társadalom, közélet Egyéb Lokál PROHARDVER! interaktív

Új hozzászólás Aktív témák

-

BeZol

őstag

BeZol

őstag

Én még nem használom, sőt, a melóhelyen csak nekem nincs github copilotom, mert nekem még mindig nem adtak... Mikor utoljára privátban copilotoztam, akkor még csak beépített chatként volt használható vscode-ban, de ugye azóta van agent mód is.

Most éppen konferencián (Basta) vagyok Frankfurt am Main-ban, és több AI-al kapcsolatos előadás is volt, így gondoltam leírom, mit tapasztaltam (2ezer € volt a jegy).

Többször az volt az érzésem, hogy előadnak vmit, ami szinte semmire sem jó, vagy csak becsomagolnak dolgokat vmibe, elnevezik máshogy, de a végeredmény ugyanott hibázik, éspedig a context mennyiségén és az LLM minőségén, na meg hogy mennyi az annyi a végén... (utóbbiról 0 duma persze)

Aminek értelmét láttam, az a Spec Driven Development:

Specify, Plan, Tasks, Implement.Specify

Előre, szépen részletesen leírod mit mivel hogyan szeretnél. Minél részletesebb, annál jobb lesz az eredmény. Gyakorlatilag produkt manager és architect ha összeülne, hogy miről van szó és azt hogyan kellene megvalósítani (tech stack, mit várunk eredménynek, ezt hogyan teszteljük), akkor jobb helyeken egy ilyesmi dokksit állítanának össze.Plan

Ezután az LLM megtervezi az egészet, és ahol bizonytalan, ott egyeztetsz vele mi legyen pontosan.Tasks

Az LLM létrehoz feladatokat (mintha Jira ticketek lennének).

Szerintem ide tartozik az is, hogy létrehoz olyan Agent-eket, amik frontend, backend, test, stb. specializációra vannak konfigurálva. (mint ahogy a valóságban is szétosztanánk)Implement

Az Agent-ek beindulnak (párhuzamosan akár nagyon sokan), mert a fentebbi dolgokból sok-sok pici feladat készült, ami nem igényel óriási context-et, és mindegyik esélyesen jól is fog elkészülni.

Nekem ez olyan feeling, mint amikor sima kérdezz/felelek esetben kérdezek a kódommal kapcsolatosan valamit, akkor ha csak 2-3 dolog függ össze, az még oké, ha már 4-5 dolog is, akkor esélyesen nem tudja megoldani a problémát, és a vége az, hogy jobban szét kell darabolnom. Gyakorlatilag itt ugyanez a cél, ezért így kicsi falatokkal zajlik a megvalósítás.Az egész mögé természetesen lehet MCP servereket bekötni, hogy ha nem lenne up to date a tudás, akkor legyen honnan legújabb dokksihoz nyúlniuk.

A context7-et ajánlották, merth ingyenes.Több előadás is szólt arról, hogyan hozhatunk létre saját MCP servert, ami végeredményben (sztem) csak annyi, hogy előre definiált specifikációkat/promptokat pakolunk beléjük, és x/y esetben a megfelelő MCP serverről ezt elő is hívjuk.

A legjobb, hogy több esetben még konkrét kérésre sem voltak hajlandók az LLM-ek használni a háttérben futó MCP servert Úgyh nekem ez eléggé béta állapot.

Úgyh nekem ez eléggé béta állapot.Egyik előadó az meg a backend kódba kvázi mint .json bepakolta a promt-jait, aztán az LLM által meghívta az xy függvényt, amihez az xy.json tartozott, és pakolta be magának az LLM az extra context-et a feladathoz.

Ez egyébként egy CQRS Event Source patternes témakör volt.A Spec Driver Developmentes előadó szerint 256k context is kevéske, fél misi kell h rendesen tudjon működni egy zöld projekt esetén, DE ez a zöld demo projekt sem volt egy nagy durranás...

Barnamezős eset passz.Youtube videók alapján pedig úgy lehet ügyeskedni, hogy a spec-eket a legjobb modellekkel iratod, de a végrehajtásokra már az olcsóbb modellek is esélyesen elegek, ha meg vhol mégis elhasalnának, vissza rápakolod arra a részre az okosabbat.

A legegyszerűbb részekre meg akár lokális modellek is jók lehetnek.Valami ügyeskedés is van ilyen nagyobb Agentic development esetén a context-tel és a tokenekkel, de pl. MCP témakörök esetén a kód, amin csináltattak valamit, az kb. 500 token volt, az MCP által hozzápakolt context miatt pedig jött további 4500 token...

Spec Driven Development esetén (meg esélyesen a teljesen agentic mód témakörben) nem tetszik, hogy teli lesz pakolva a projekt .md fájlokkal amikben a specifikációk pihennek ugye, ÉS a specifikáció a source of truth... Nem a kód

Szerintem pár év, és ez lesz az új standard.

A kérdés az, hogy amikor ezek az LLM Agent-ek elakadnak, és muszáj egy programozót ráállítani, akkor a kód mennyire lesz emberileg emészthető struktúrában.Kaptam melóban végre valahára GitHub Copilot licenszet.

Mint kiderült, egyik kollega már rakott össze belső Agent-eket, amik tudják a belső configokat, ergo bármit kérdezel, azonnal 100ezres context körül vagy... Kicsit kellemetlen a havi limittel kapcsolatosan, szóval sima liba pár egymáshoz nem köthető kérdéssel napi 10%-ot összehozni a havi 20€--s csomag keretéből...A válaszok annyira jók, amennyire a mintapéldák + mintakódok meg vannak írva. Mindig van vmilyen eset, ami miatt finomhangolni kell, de idővel egyre tökéletesebbek lesznek.

A "10x developer" több esetben is többre kijött.

A senior kollegákat eddig sem kellett gyakran kérdezgetnem, de most már végképp szinte semmi.

Volt, hogy 30perc alatt megoldottam egy kb. 1,5-2 napos melót.Szóval brutális, és ez csak a Claude Sonnet 4.6 modell volt.

Egyszerűen ég és föld a különbség amiatt, hogy Agent módban használja az ember ezeket.

Ezen felbuzdulva otthon előfizettem a Claude Pro-ra, legeneráltattam egy egyszerű 3 sornyi prompttal egy weboldalt, majd 2 finomhangolás után elfogyott az 5 órás limit, illetve a heti limit 20%-a talán

Mondom akkor jöhet a Max, úgyhogy előfizettem a 200€-sra...

Mondom akkor jöhet a Max, úgyhogy előfizettem a 200€-sra...Első benyomás: lehetetlen kimaxolni.

Aztán challenge accepted alapon a heti limitet most 3nap alatt elértem és elvonási tünetem van még asszony szerint is (kedd 12:00kor resetel)

(kedd 12:00kor resetel)3 sornyi prompttal olyan weboldalt rakott össze 6perc alatt, ami nekem 2-3 hét lenne 8 órás munkával.

Egy másik weboldal esetén jobban specifikálva a dolgokat és pár környi tervezést lenyomva már 2-2,5 óra volt egy másfajta weboldal legenerálása, de ennél már konkrétan azt éreztem, hogy ez akár 2-3 hónapnyi 8órás munka lehetett volna...És kvázi pikk-pakk ott van egy kattingatható weboldal (backend, adatbázis és server nélkül), amit miután teljesen az ízlésedre finomhangoltál, esélyesen pikk-pakk hozzápakolja a hiányzó részeket a komplett csomag érdekében.

Csak ízlésbeli dolgokba tudtam a kódon belül belekötni, egyébként jó volt minden...

Ha meg esetleg nem működne vmi rendesen, ott a playwright mcp, és önellenőrzi magát

Figma mcp is van, ha vki design-okat importálna.Szóval nagyon komoly.

A Max terv miatt végig Opus 4.7 (Max)-ot használtam az 1M context-el.Régen forexeztem vmennyire, jártam tőzsdetanfolyamokra, és akkoriban az volt az érzésem, hogy le kellene automatizálni a stratégiákat, fene sem akar egész nap chartokat bámulni.

Volt is erre akkoriban MetaTrader4-ben megoldás, de nem tudtam akkoriban programozni, ezért volt h 1-2 ötletet leprogramoztattam vkikkel, az persze a végén sosem csinálta pontosan azt amit leírtam (ugye speciális esetekre nem gondoltam, meg ők sem), amik a tesztek során kijöttek és kvázi használhatatlan volt amiért fizettem. Másik probléma volt, hogy a tesztek során a valós költségek sosem voltak figyelembe véve, és kaptál egy szép eredményt, ami kamu volt...Erre most tessék, mondom akkor hadd szóljon.

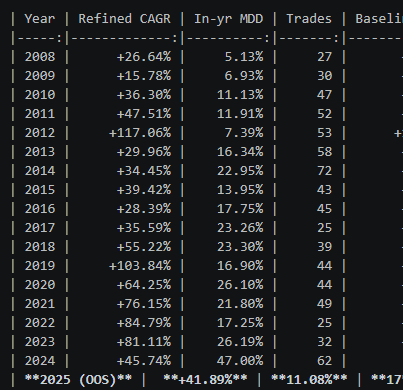

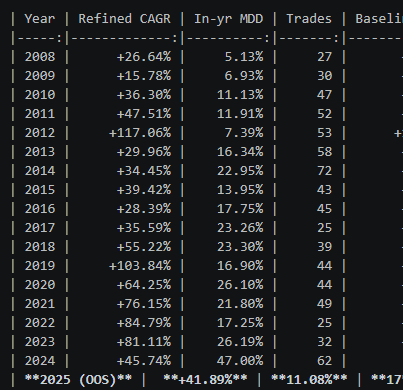

Pythonban megírt egy komplett backtest rendszert, a tapasztalataimat és a saját tudását belerakta, kellett pár önellenőrzés, meg még utólag is jött rá hibákra, de mostanra van egy komplett rendszer amire csak rá kell dobni a stratégiát és kiteszteli mizu. A 9800X3D-met úgy beterheli, hogy ami Cinebench R23-ban 84fokos maximum volt, az itt 92fok (lejjebb is vettem azóta procit 1.18V @5.3GHz-ről -> 1.15V 5.2GHz-re)

(lejjebb is vettem azóta procit 1.18V @5.3GHz-ről -> 1.15V 5.2GHz-re)Leírtam Claude-nak mit szeretnék (évi 100% hozam

), leírta h na persze, legjobbak tudnak talán +30%-ot

), leírta h na persze, legjobbak tudnak talán +30%-ot  , de több napnyi küzdés után most:

, de több napnyi küzdés után most:

Éles brókerre bekötést már megcsináltattam vele (5féle eurusd projektet kezdtem el), ha lesz újra keretem, bekötöm a mostanit is és majd megint visszaellenőriztetem még1xer, hogy biztos jók-e a számok.Ami pedig most lezabálta a tokeneket, az egy counter-strike és battlefield keverék játék egy dust2 szerű pályára

Nem értek a játékfejlesztéshez, de a webfejlesztéses tapasztalatokból ítélve talán itt is megoldható utólag pár további finomhangolási körrel, ha valami mégsem úgy megy ahogy elgondoltam.

Rust-ban írja, olyan dolgokra gondolt már a tervezés során, amik bennem fel sem merültek, viszont a changelist alapján (jelenleg 54ezer soros!) ennél sokkal nagyobb mélységig lement... Most már nem akarom veszni hagyni, mert érdekel mi lesz ebből ingyenes textúrákat és modelleket használva (azóta érkezett blender mcp is, szóval nem izgulok emiatt sem). A lényeg, hogy most az MVP (Minimum Viable Product) készül.Claude szerint: **MVP**: ~11–14 months solo full-time.

Nem tudom milyen solo dev az, aki ért a komplett játékmotorfejlesztéshez (semmi unity, unreal engine nincs, egyedit ír, és Vulkan alapú lesz elvileg), az audio-hoz, a grafikákhoz, animációkhoz, hálózatokhoz, stb.

Ja és úgy csináltatom vele, hogy a végén legyen egy installer, ami egy launcher-t rak fel (mint a steam pl.), a launcherben tudod felrakni a játékot, és automatikusan kapja a frissítéseket. Ergo miután baráti körnek körbeadogatom és leteszteljük h mizu, ha tolok ki bármilyen fejlesztést, megkapja mindenki automatikusan a jövőben is

Hát iszonyat kíváncsi leszek mi sül ki ebből, egyébként ha nem működik, és nagyon rossz, akkor úgyis megy a levesbe, és akkor kövi játékprojektnek egy mobilos játékot célzok majd be, csak előtte körbekérdezem ismerősöket milyenre lenne igény.

Ugye esélyesen semelyik játék nem lenne piacképes, ergo legalább baráti körben szórakozzunk egy jót

A slusszpoén így a végére, hogy a fenti dolgokat mind párhuzamosan egymás mellett csináltattam a Claude-al

Annyi, hogy a játékgenerálásnál a ralph-loop plugint használom, egyébként 5-15percenként csinálni kellett volna valamit, így pedig a "COMPLETE" fázisig megy.Ez a 2-2,5 órás weboldalgenerálás eredménye, ha valakit érdekel:

Kód: [link]

Kattingatható weboldal: [link]

(csak "nyers" weboldal, tehát bármit csinálsz rajta, csak lokálisan a te böngésződben mentődik el addig, amíg újra nem indítod a böngésződet, semmilyen online kommunikáció nem történik benne)Úgyhogy én ámulok és bámulok, és ötletem sincs mi lesz így a programozók jövője, mert a feladatok ellenőrzésére és manuálisabb tesztelésére biztosan nem kell annyi ember mint most.

-

BeZol

őstag

BeZol

őstag

Én még nem használom, sőt, a melóhelyen csak nekem nincs github copilotom, mert nekem még mindig nem adtak... Mikor utoljára privátban copilotoztam, akkor még csak beépített chatként volt használható vscode-ban, de ugye azóta van agent mód is.

Most éppen konferencián (Basta) vagyok Frankfurt am Main-ban, és több AI-al kapcsolatos előadás is volt, így gondoltam leírom, mit tapasztaltam (2ezer € volt a jegy).

Többször az volt az érzésem, hogy előadnak vmit, ami szinte semmire sem jó, vagy csak becsomagolnak dolgokat vmibe, elnevezik máshogy, de a végeredmény ugyanott hibázik, éspedig a context mennyiségén és az LLM minőségén, na meg hogy mennyi az annyi a végén... (utóbbiról 0 duma persze)

Aminek értelmét láttam, az a Spec Driven Development:

Specify, Plan, Tasks, Implement.Specify

Előre, szépen részletesen leírod mit mivel hogyan szeretnél. Minél részletesebb, annál jobb lesz az eredmény. Gyakorlatilag produkt manager és architect ha összeülne, hogy miről van szó és azt hogyan kellene megvalósítani (tech stack, mit várunk eredménynek, ezt hogyan teszteljük), akkor jobb helyeken egy ilyesmi dokksit állítanának össze.Plan

Ezután az LLM megtervezi az egészet, és ahol bizonytalan, ott egyeztetsz vele mi legyen pontosan.Tasks

Az LLM létrehoz feladatokat (mintha Jira ticketek lennének).

Szerintem ide tartozik az is, hogy létrehoz olyan Agent-eket, amik frontend, backend, test, stb. specializációra vannak konfigurálva. (mint ahogy a valóságban is szétosztanánk)Implement

Az Agent-ek beindulnak (párhuzamosan akár nagyon sokan), mert a fentebbi dolgokból sok-sok pici feladat készült, ami nem igényel óriási context-et, és mindegyik esélyesen jól is fog elkészülni.

Nekem ez olyan feeling, mint amikor sima kérdezz/felelek esetben kérdezek a kódommal kapcsolatosan valamit, akkor ha csak 2-3 dolog függ össze, az még oké, ha már 4-5 dolog is, akkor esélyesen nem tudja megoldani a problémát, és a vége az, hogy jobban szét kell darabolnom. Gyakorlatilag itt ugyanez a cél, ezért így kicsi falatokkal zajlik a megvalósítás.Az egész mögé természetesen lehet MCP servereket bekötni, hogy ha nem lenne up to date a tudás, akkor legyen honnan legújabb dokksihoz nyúlniuk.

A context7-et ajánlották, merth ingyenes.Több előadás is szólt arról, hogyan hozhatunk létre saját MCP servert, ami végeredményben (sztem) csak annyi, hogy előre definiált specifikációkat/promptokat pakolunk beléjük, és x/y esetben a megfelelő MCP serverről ezt elő is hívjuk.

A legjobb, hogy több esetben még konkrét kérésre sem voltak hajlandók az LLM-ek használni a háttérben futó MCP servert Úgyh nekem ez eléggé béta állapot.

Úgyh nekem ez eléggé béta állapot.Egyik előadó az meg a backend kódba kvázi mint .json bepakolta a promt-jait, aztán az LLM által meghívta az xy függvényt, amihez az xy.json tartozott, és pakolta be magának az LLM az extra context-et a feladathoz.

Ez egyébként egy CQRS Event Source patternes témakör volt.A Spec Driver Developmentes előadó szerint 256k context is kevéske, fél misi kell h rendesen tudjon működni egy zöld projekt esetén, DE ez a zöld demo projekt sem volt egy nagy durranás...

Barnamezős eset passz.Youtube videók alapján pedig úgy lehet ügyeskedni, hogy a spec-eket a legjobb modellekkel iratod, de a végrehajtásokra már az olcsóbb modellek is esélyesen elegek, ha meg vhol mégis elhasalnának, vissza rápakolod arra a részre az okosabbat.

A legegyszerűbb részekre meg akár lokális modellek is jók lehetnek.Valami ügyeskedés is van ilyen nagyobb Agentic development esetén a context-tel és a tokenekkel, de pl. MCP témakörök esetén a kód, amin csináltattak valamit, az kb. 500 token volt, az MCP által hozzápakolt context miatt pedig jött további 4500 token...

Spec Driven Development esetén (meg esélyesen a teljesen agentic mód témakörben) nem tetszik, hogy teli lesz pakolva a projekt .md fájlokkal amikben a specifikációk pihennek ugye, ÉS a specifikáció a source of truth... Nem a kód

Szerintem pár év, és ez lesz az új standard.

A kérdés az, hogy amikor ezek az LLM Agent-ek elakadnak, és muszáj egy programozót ráállítani, akkor a kód mennyire lesz emberileg emészthető struktúrában.

Új hozzászólás Aktív témák

-

Fórumok

LOGOUT - lépj ki, lépj be!

LOGOUT reakciók Monologoszféra FototrendGAMEPOD - játék fórumok

PC játékok Konzol játékok MobiljátékokMobilarena - mobil fórumok

Okostelefonok Mobiltelefonok Okosórák Autó+mobil Üzlet és Szolgáltatások Mobilalkalmazások Tartozékok, egyebek Mobilarena blogokPROHARDVER! - hardver fórumok

Notebookok TV & Audió Digitális fényképezés Alaplapok, chipsetek, memóriák Processzorok, tuning Hűtés, házak, tápok, modding Videokártyák Monitorok Adattárolás Multimédia, életmód, 3D nyomtatás Nyomtatók, szkennerek Tabletek, E-bookok PC, mini PC, barebone, szerver Beviteli eszközök Egyéb hardverek PROHARDVER! BlogokIT café - infotech fórumok

Infotech Hálózat, szolgáltatók OS, alkalmazások SzoftverfejlesztésFÁRADT GŐZ - közösségi tér szinte bármiről

Tudomány, oktatás Sport, életmód, utazás, egészség Kultúra, művészet, média Gazdaság, jog Technika, hobbi, otthon Társadalom, közélet Egyéb Lokál PROHARDVER! interaktív

- playseat evolution black actifit

- Precision 3560 27% 15.6" FHD IPS i7-1165G7 T500 16GB 512GB NVMe magyar vbill IR kam gar

- Gamer Gép - MSI H610, Intel I5 13600, 16GB DDR4, RTX 3070 Ti, 1TB M.2 SSD, 750W 80+ Gold

- Asztali PC i7 6700 1650 16GB DDR4 512GB SSD

- ASUS TUF Gaming A17 Gamer laptop , R7 6800H , 16GB DDR5 , RTX 3050 Ti

- Bomba ár! Lenovo ThinkPad L390 - i5-8GEN I 16GB I 512SSD I 13,3" FHD I HDMI I Cam I W11 I Gari!

- Lenovo ThinkPad T14s Gen 3 i5-1245U 14" FHD+ 16GB 256GB 1 év teljeskörű garancia

- Samsung Galaxy S26 Ultra 5G 512GB, Kártyafüggetlen, 1 Év Garanciával

- Honor X7b 128GB, Kártyafüggetlen, 1 Év Garanciával

- Sony FDR-AX53 videókamera

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

Úgyh nekem ez eléggé béta állapot.

Úgyh nekem ez eléggé béta állapot.

Mondom akkor jöhet a Max, úgyhogy előfizettem a 200€-sra...

Mondom akkor jöhet a Max, úgyhogy előfizettem a 200€-sra...

), leírta h na persze, legjobbak tudnak talán +30%-ot

), leírta h na persze, legjobbak tudnak talán +30%-ot