Új hozzászólás Aktív témák

-

huskydog17

addikt

válasz

FLATRONW

#46982

üzenetére

FLATRONW

#46982

üzenetére

Az is előfordulhat, illetve talán úgy működik a játék, hogy figyeli a kimeneti felbontást és ahhoz köti a VRAM fogyasztást. Én legalábbis erre tudok tippelni, hogy a rendering felbontás helyett a kimeneti felbontás alapján foglalja a VRAM-ot.

#46983 b.: Erről lemaradtam, továbbá az angolom nem annyira jó, hogy mindent megértsek belőle. Van erről valahol magyar nyelvű leírás, hogy itt mi is történt, miről van szó? Köszi előre is!

-

huskydog17

addikt

CB frissítette a Ratch & Clank tesztjét. Megnézték a legújabb AMD és NVIDIA drivert, továbbá RT alatt az AMD tempót.

Amíg RT nélkül a csúcs Radeon, 7900 XTX pár százalékkal gyorsabb, mint az RTX 4080, addig maximális grafika esetén (maximális RT) masszív lemaradásba kerül, ahol az RTX 4080-as 40%-al gyorsabb. -

huskydog17

addikt

Egy kis érdekesség:

Van egy olyan játék, ami számos új tchnológiát vonultat fel Unreal Engine 5.2-vel és egyetlen ember készítette. Ez a játék a DESORDRE.

Ezeket tudja felmutatni a játék:- Unreal Engine 5.2

- Lumen

- DLSS 3 + FG

- Nvidia RTXDI

- Nvidia Shader Execution Reordering

- FSR & XeSSKésőbb UE 5.3-ra fog átállni.

Kizárólag technikai szempontból azért érdekes ez a játék, mert nem sok alkotásban van RTXDI, ráadásul ugye ezt egy ember csinálta, azaz nem olyan nehéz belerakni egy játékba.

-

huskydog17

addikt

PCGH frissítette a Ratchet & Clank tesztjét, most már Radeonokkal is letesztelték az RT funkciókat.

Csúcs AMD kártya, a 7900XTX pár százalékkal gyorsabb, mint az RTX 4070, de 4K-ban már több, mint 50%-al, mert a 4070-nél kifogy a 12 GB VRAM.

Az új Radeon RX 7900 GRE a 16 GB-os 4060Ti és az RX 6800XT szintjén mozog. -

huskydog17

addikt

Baldur's Gate 3 Benchmark - PCGH Megateszt (33 VGA, 22 CPU)

Még azon rendkívül kevés indie stúdiók tartozik a belga Larian, akik még nem dobták ki a saját fejlesztésű grafikus motorjukat csak hogy Unreal Engine-re válthassanak.

Motor: Divinity 4.0

API: DX11 & Vulkan (Vulkan erősen ajánlott, masszívan növekszik a tempó alatta)

Upscaling technikák: FSR 1.0, DLSS (a készítők szeptemberre ígérik az FSR 2-t)

RT technikák: -A sebesség szerintem elég jó, egy RTX 4060, illetve RX 7600 elegendő 1080p-ben a 60 fps-hez max grafikán. 1080p-n elegendő a 8 GB VRAM a max grafikához. A felett már ajánlott a 10 GB.

CPU fronton a Ryzen 3D procik brutálisan megalázzák az egész mezőnyt, minden más CPU-t nevetségessé tesznek. -

huskydog17

addikt

Összefoglalnék itt néhány független tesztet a Ratchet & Clank PC portjáról:

ComputerBase

PCGH

TPU

TPU Upscaling teszt (DLSS vs FSR vs XeSS)

DigitalFoundryA tesztek írása alatt a játékban nem volt elérhető AMD kártyákon a RT funkció, ezért értelemszerűen nincsenek RT mérések AMD kártyákon.

Az AMD a mai napon kiadta a javított driver-t, ami javítja az RT alatti instabilitást.A játékhoz eddig két patch jött ki, ebben a topicban nagyon szépen össze van foglalva, hogy milyen hibák lettek orvosolva és melyeket kéne még javítani.

-

huskydog17

addikt

válasz

Valdez

#46911

üzenetére

Valdez

#46911

üzenetére

Ha ezt akarod hinni, akkor hidd, én viszont egyrészt nem akarok vakon okosabb lenni a fejlesztőknél, másrészt mivel a Nixxes és az AMD is ugyanúgy instabilitásra hivatkozik, így elhiszem, főleg, hogy a Nixxes a legjobb PC portolás fronton, ők nem tennének ilyet ok nélkül. Szóval egyértelmű bizonyíték hiányában én nem feltételeznék egy Nixxes-ről olyat,hogy kamuznának. Az AMD-ről igen (mert már sokszor volt rá példa), viszont mivel az AMD közleménye tökéletesen összhangban van a Nixxes (Insomniac) közleményével, így most róluk sem feltételezem, hogy hazudnak. Ez azonban teljesen lényegtelen abból a szempontból, hogy az AMD felhasználók ismét erős kompromisszumokra kényszerülnek ennél a játéknál. A kérdés az, hogy meddig.

Egy új drivernél bármilyen hiba, akár regression is bejöhet, ott van például a legutóbbi drivernél a javítási kísérlet az RDNA3 üresjárati fogyasztására is csődöt mondott.

Könnyen lehet (én inkább azt feltételezem), hogy a Nixxes olyan spéci optimalizálást/RT kódot használ, amitől az AMD driver összefossa magát és most megy a háttérben az egyeztetés az AMD driver fejlesztőivel, hogy mit bír még el, hogy ne dobja el magát az egész. Ez is csak egy teória, de mindenesetre abban biztos vagyok, hogy valódi technikai oka van ennek, amint mondtam, a Nixes nem viccből hoz ilyen döntéseket. Ha erre kényszerültek, akkor ott tényleg nagy baj van, viszont idővel majd működni fog AMD-n is.

Ez csak annak kellemetlen, aki most megjelenéskor akarja a játékot AMD GPU-val max grafikán játszani, mert nem lesz rá lehetősége.Amúgy a felhasználók túlnyomó többségét a legkisebb mértékben sem fogja érdekelni, hogy mi van a háttérben, mert ők csak annyit fognak tapasztalni, hogy NV-n megkapják a maximumot, míg AMD-n nem. Mivel ez a játék az idei év egyik legnagyobb dobása PC-n, így ez az AMD-nek ismét egy nagyon kellemetlen gyomros, nem fog jót tenni a mindshare-nek.

-

huskydog17

addikt

Aki kb. 2 óra múlva AMD kártyával szeretne játszani a Ratchet & Clack játékkal, az ne lepődjön meg, hogy minden RT funkció le lesz tiltva, mert az AMD driver még túl instabil ahhoz.

Ennek megfelelően a hivatalos hardver követelményes táblázatból már kis is törölték az AMD VGA-kat a két RT oszlopból. A PCGH csinált egy tök jó összehasonlító képpárt, ahol egy csúszka segítségével lehet összehasonlítani a két táblázatot. Bizony a korábban ajánlott Radeon 6800XT ás 7900XTX törölve lett a táblázatból.

-

huskydog17

addikt

válasz

paprobert

#46851

üzenetére

paprobert

#46851

üzenetére

Logikus, nem lennék meglepve, ha valami ilyesmi történne a jövőben, mert az alapok már adottak ehhez. Bár tippem szerint ez talán jelentősen növelné a játék fejlesztésének idejét és ezzel együtt a költséget is. Ennek ellenére nem lennék meglepve, ha a jövőben majd akadna 1-2 olyan szponzorált játék, ahol lenne az általad is említett Ultra+ szint (mondjuk például a textúrabeállításnál).

-

huskydog17

addikt

A jogi dolog engem mint vásárlót a legkisebb mértékben sem érdekel, de nem is kell hogy érdekeljen, az nem az én dolgom, ezen felül, ha bármi probléma lenne vele, nem implementálták volna a DLS-t több száz játékba köztük rengeteg indie címbe is.

Most belinkeltél egy cikket arról, hogy dll fájlokat hogyan lehet rosszindulatúan kihasználni. Ha ennyire félsz általánosan a DLL fájloktól, akkor kerülj el minden videojátékot a piacon, mert kb minden játék DLL fájlokat használ, továbbá fertőzés esetén nem csak DLL, hanem bármilyen fájlkiterjesztéssel vissza lehet élni, így DLSS esetén általános DLL visszaélésre hivatkozni finoman fogalmazva is csak egy értelmetlen és végtelenül gyenge terelés. Semmi köze a DLSS-hez. Ez inkább paranoia a részedről. Sőt szerintem számítógépet se használj, mert bármilyen fájlt meg lehet fertőzni.

Egyébként a megbízható/ellenőrizhető forráshoz találták ki például az ellenőrzőösszeget is (checksum), továbbá a TPU nem egy századrangú kalóz/crack oldal."Miből gondolod, hogy nem akar? A játékfejlesztő a forráskódból él."

Én azt hittem eladásokból él, de akkor lehet tévedtem. Az eladásokat általában a jó minőség segíti, míg az antikonzumer hozzáállás rontja.

"Te érveltél itt a minőségről."

Akkor nem sikerült megfelelően értelmezni a leírtakat. Egyrészt az upscale technikákról volt szó, azok közül egyértelműen a DLSS adja a legjobb minőséget. Az upscaling nem zárja ki a jó képminőséget ahogy te írod."Komolyabb projektekben a fejlesztők éppen a fekete-dobozokat nem preferálják."

A gyakorlat az ellenkezőjét mutatja.

"Azzal nincs előrébb a fejlesztő, hogy akkor sem tud belenyúlni a működésbe (a DLL-be), ha szükség lenne rá."

Nem is kell, ha out of the box jól működik. Miért gondolod, hogy bele akarnának nyúlni?

"Nemcsak beépíteni kell, hanem utána esetlegesen karbantartani a játék részeként, plusz a jogi szöveg értelmében pl. a betöltő képernyőn is logót elhelyezni és tájékoztatni az Nv-t a használatról."

A karbantartás a DLSS esetén a legegyszerűbb, főleg hogy automatizálni is lehet. A másik dologról pedig idő közben kiderült, hogy nem igaz. Egyébként tegyük fel ha igaz lenne, akkor se értem, hogy téged miért zavar egy brand/cég logó egy olyan helyen ahol sok más logó is van. Neked mi károd keletkezik abból, hogy játékokban brand cég logó van a stáblista végén, ahol több logó is van? A többi nem zavar? Megint azt tudom tanácsolni, hogy minden videojátékot kerülj el, mert mindben van valamilyen brand/cég logó. Ha valaki felhasznál egy más cég szellemi termékét, akkor nem gondolod, hogy úgy a korrekt, hogy illik feltüntetni valahol, hogy egy másik fél technológiáját használják? Szerintem abszolút korrekt elvárás lenne amúgy, de amint kiderült, nem kötelező feltüntetni.

"Nincs. A játék egy végtermék, amit használsz. Valamint abból nem is készülhet általában újabb játék."

Na ezt úgy hívják, hogy kettős mérce. A nagyobb black box érdekes módon nem zavar téged, de a kisebb black box, ami szintén egy szellemi végtermék, amit a készítők a játékélmény növelésére használnak, az már nagyon zavar téged.

Ez egyértelmű kettős mérce, innentől valóban semmi értelme tovább beszélgetni a témáról.Köszi az infókat, legalább őszintén leírtad, hogy képtelen vagy objektívan nézni a dolgot.

-

huskydog17

addikt

"Itt azért felmerülnek problémák, akár jogi, akár biztonsági szempontból."

??? Hogy jön ide ez a téma, mi alapján gondolod ezt? Mindegy is, mert egyrészt nonszensz, másrészt irreleváns ez a gondolat, ugyanis a DLSS az NV saját terméke, nyilván ők azért készítették ilyen felhasználóbarátra és modulárisra, mert nincs jogi akadálya. Ha lenne bármi jogi akadálya, szerinted így tervezték volna? Ennyire ne nézzük már hülyének az NV-t. A másik dolog, hogy a felhasználók, játékosokat a legkisebb mértékben sem érdekli ez a kérdés, ők használni akarják és kész és erre az NV meg is adja a lehetőséget.

"Nyilván látták, hogy a kézi DLL cserélgetés problémás, megoldották, bár azért nem az igazi, hogy csak fejlesztői jóváhagyással működik. Persze, hogy ez mennyire jó, azzal lehetne vitatkozni. "

Tehát a DLSS verzióit mind a fejlesztő, mind a játékosok szabadon változtathatják, e mellé pedig automata frissítésre is van lehetőség. Ennél jobb megoldást én elképzelni sem tudok, de szerintem te sem."Miért kéne átírják?

A nyílt forráskód nem csak az átírás lehetőségéről szól, hanem fontos a könnyebb hibakezelés, és hogy nincsenek külső DLL-ek sem."

A nyílt forráskód nem csak az átírás lehetőségéről szól, hanem fontos a könnyebb hibakezelés, és hogy nincsenek külső DLL-ek sem."

Mert az AMD által szállított kód sok esetben sajnos nagyon gyenge képminőséget ad, és ha ez a helyzet, de te a játékodban FSR-el is jó képminőséget akarsz nyújtani, akkor nincs más lehetőséged, mint átírni a forráskódot, ami nem biztos hogy megéri az időt és energiát. Nincs külső DLL, ahogy nincs semmilyen lehetőség a verziók között egyszerűen váltatni, ahogy ezt elmagyaráztam korábban. Ha nem akarsz forráskóddal szöszmötölni (márpedig a legtöbb játékfejlesztő nagy valószínűséggel nem akar), akkor meg kell elégedj annyival, amit az AMD adott. Ez se a játékfejlesztőnek, se a játékosoknak nem jó."Ahelyett, hogy vennének egy normális videókártyát, amihez nem kellenek ilyen szuboptimális megoldások, és elbírja natívan.... Ha már fontos a minőség, ugyebár."

Ez terelés. Arról van szó, hogy ha a felhasználó upscaling-et szeretne használni, akkor melyikkel jár a legjobban. Itt egyértelműen a DLSS a nyerő. Amúgy meg vicces, hogy azt várod el a felhasználóktól, hogy ha kevés a sebesség, vegyenek rögtön erősebb VGA-t. Akinek kevés az RTX 4090 tempója natív felbontáson (pl.: 4K path tracing stb.), az hogyan vegyen gyorsabb kártyát? Nyilván sehogy.

"Egy kiadónak minden technológia beépítése plusz költség, amit utána karban is kell tartani. Persze, kiszúrásból is kimaradhat, de azért más szempontból ez is egy őrület, hogy ugyanarra a feladatra rakjanak bele 3-féle megoldást is. Aztán meg csodálkozunk, hogy a mai játékok tele vannak feature-ökkel, aztán a fele nem működik kiadáskor...."

Egyrészt sehol nem láttam konkrét számokat, de szerintem te sem, mivel ezek soha nem publikus adatok, az viszont tény, hogy a DLSS-t nagyon egyszerű beépíteni, egy tapasztalt játékkészítő pár perc alatt is be tudja építeni, az pedig nem lehet nagy költség. Ezen felül a Unity motorba már alapból bele is van integrálva natívan, míg UE-hez csak egy plugin kell és kész. A játékba való implementálás pont az FSR-nél problémásabb, időigényesebb. Unity-ban például olyan egyszerű beépíteni, hogy egy indie dev is hamar és könnyen meg tudja oldani.

"Említetted az Nv piaci részesedését, itt azért hozzátenném, hogy a DLSS-hez RTX kártya kell, ami nyilvánvalóan lényegesenen kevesebb, mint a teljes piaci részesedésük. Én ezt is hátránynak látom, a black box jelleg mellett."

Konkrét számokat megint csak nem tudunk, de figyelembe véve, hogy az RTX mobil fronton is jele van, szerintem nem túlzok, ha azt mondom, hogy milliós nagyságrendeben érdemes gondolkodni, továbbá ahol szükség lenne rá, ott a játékosok nagy részének RTX kártyája van, elég csak megnézni az interneten milyen sokan szeretnének DLSS-t olyan játékokba ahol csak FSR-t építettek be, továbbá egyre több modder is foglalkozik ezzel. A black box azért vicces, mert számodra és számomra, mint játékos, mint vásárló a legteljesebb mértékben irreleváns, hiszen már önmagában a játék is számodra egy black box, mert nem látod a forráskódját, de a DLSS forráskódját meg látni akarod? Minek? Mit akarsz vele? Fejlesztői szemmel sincs sok értelme, nem hogy egyszerű felhasználói szemmel. Tehát te elvágnád magad a legjobb minőségű felskálázó technikától csak azért, mert nem kapsz hozzá egy olyan dolgot (forráskód) amivel úgyse tudnál mit kezdeni? Még egyszer érdemes zárójelben megjegyezni, hogy a játék amivel játszol szintén egy black box. Azzal nincs problémád?

-

huskydog17

addikt

Felhasználóbarát:

Ha a játékosnak nem tetszik a fejlesztők által szállított verzió, akkor saját maga (tehát a felhasználó, a játékos) kicserélheti kedve szerint bármelyik verzióra pofon egyszerűen. FSR-nél erre nincs lehetőség, azzal kell beérni, amit a fejlesztő adott (mint konzolon), ezt nem nevezném felhasználóbarátnak. DLSS esetén teljes szabadásgod, átjárhatóságod van a verziók között, FSR-nél nincs. A felvetésedre pedig csak annyit, hogy az NV piaci részesedése 80% körül van, így ebből a szempontból sincs értelme kihagyni a DLSS-t.Frissítés:

DLSS esetében a fejlesztő alkalmazhatja az automata frissítést, ezzel a DLSS teljesen automatikusan lefrissíti magát, a fejlesztőnek nem kell vele foglalkozni. Ez a fejlesztőnek és a játékosnak is jó. FSR-nél ilyen nincs. Ezen felül ott a fentebb említett user friendly design, ahol a játékosok saját maguk azt a verziót használhatják, amelyiket akarják.

FSR-nél a játék készítőjére van bízva, hogy fektet-e időt és energiát az FSR frissítésébe, miközben a DLSS nem csak szebb minőséget ad, de automatizálni is lehet. A gyakorlat is azt mutatja, hogy a legtöbb fejlesztő nem nagyon foglalkozik az FSR frissítésével.Felelősség:

A legtöbb fejlesztő nem szereti a sok felesleges munkát és itt a DLSS megint nagy előny, hiszen out of the box jobb minőséget ad, mint az FSR. Hiába fekete doboz, ha jelenleg az a legjobb a piacon, továbbá a fejlesztők túlnyomó többsége a büdös életben nem fog nekiállni átírni az FSR forráskódját, de még a legtöbb AAA stúdió sem.

Hiába a nyílt forráskód, az FSR only játékokban valamiért mégis sokan próbálkoznak a DLSS-el, nem véletlen. A felhasználóknak inkább a "feketedoboz" kell, mert egyszerűen jobb minőséget ad.

Addig nincs is gond, ha a felhasználó tud választani. A gond akkor van, ha egy játékban kizárólag FSR-t teszik elérhetővé, ezzel csak a játékossal (vásárlóval) szúrnak ki, mert elvágják őket a legjobb minőségű technikától. -

huskydog17

addikt

Nincs ebben semmi meglepő, teljesen logikus lépés az AMD-től, ugyanis az FSR a három IHV specifikus felskálázási eljárás közül a leggyengébb minőséget adja, ezért az AMD-nek nem jó, nem éri meg, ha mindhárom van a játékban, mert akkor az FSR-t a kutya se fogja használni, így még gyorsabban kikopna a köztudatból és kizárólag a konzolokban lenne életképes.

Na most a köztudatban már meglehetősen széles körben elterjedt az a tény, hogy az AMD RT-ben nem versenyképes, ezért valószínűleg megpróbálják nyomni az FSR szekerét, ha már pénzt öltek bele. Ezt viszont csak úgy lehet, hogy DLSS nincs a játékban, így az általuk fizetett PC portokban tiltják a DLSS beépítését, hogy az FSR ne rontsa még jobban a renoméjukat. 1-2 címben engedik a beépítést, hogy a PR csapat mondhassa és hivatkozhasson arra, hogy ők aztán nem blokkolják, ők nyitottak mindenre.

Ez nekem úgy tűnik, mintha ezzel próbálnák az FSR-t a PC portokban lélegeztetőgépen tartani. A gond csak az, hogy ezzel pont a játékosok járnak rosszul, ráadásul sok esetben a moddolt (nem hivatalos) DLSS injektálás is agyonveri minőségben az FSR-t. (Ezt írtad te is.)

Ez számomra józan paraszti logika: ha a mienk nem elég jó, akkor tiltjuk a jobb technika beépítését.Van még egy teóriám, ami üzleti szempontból számomra logikusnak tűnik:

Az AMD a legtöbb szponzorált játékukhoz adnak egy saját embert, egy programozót, aki beleintegrálja a játékba az FSR-t, de cserébe semmilyen más upscale tech nem lehet a játékban.

Néhány játékhoz viszont nem adnak programozót, ott valszeg a fejlesztő saját maga meg tudja oldani az integrálást, ez esetben az AMD itt jóval kevesebbet is fizet, cserébe nem tilthatják más tech beépítését.Persze az AMD mondhatja (és mondja is), hogy a miénk nyílt forráskódú, így a fejlesztőn múlik a minősége, viszont ez egy terelés, mert a gyakorlatban rendkívül kevesen vagy szinte senki nem fog nekiállni átírni az FSR forráskódját úgy, hogy a DLSS out of the box jobb minőséget ad és ráadásul felhasználóbarátabb, a DLSS esetében nem kell foglalkozniuk a frissítéssel, míg FSR esetében minden felelősség a játékfejlesztőké, akkor meg miért vesződjenek vele.

Az AMD azért force-olja az exkluzivitást, mert másba nem tudnak kapaszkodni, egyszerűen nem versenyképes a technológiájuk, így nincs más lehetőségük. Jó nyilván lenne olyan opció, hogy hagyják kihalni a francba, de valószínűleg ezt nem akarják, egyrészt a beleölt pénz miatt, másrészt marketing szempontból egy öngyilkosság lenne: ha a konkurenciának van ilyenje, akkor nekünk is fel kell mutatni valamit (lásd FSR 3 csak ott még rosszabb a helyzet: 7 hónap után még mindig sehol, miközben a konkurencia letarolja a piacot).

-

huskydog17

addikt

Nézzük mit kínál az első 3rd party UE5 játék:

Layers of Fear (2023) Benchmark - PCGH

A sebességre szerintem nem lehet panasz, meglepően jó, de a legjobb hír, hogy a shader compilation akadások végre eltűntek, legalábbis ebben a játékban nincs, viszont traversal akadások vannak továbbra is.

Vicces olvasni az alábbit:

"Bemerkenswert ist auch, wie sparsam das Spiel mit VRAM umgeht. 6 GiByte genügen selbst in WQHD und mit 8 GiByte lässt sich sogar 5K (stets mit TSR Quality) nutzen. Wir gehen davon aus, dass kommende UE5-Spiele mit offener Spielwelt deutlich mehr Grafikspeicher benötigen werden, allerdings zeigt Layers of Fear die (erfreulich hohe) Effizienz bei kleinen Spielwelten auf."Igaz, hogy itt szűk folyosók vannak és nagyon szűk a játéktér, ettől függetlenül vicces belegondolni, hogy korábban a fórumokon sokan jósolták, hogy at UE5 annyira fogja zabálni a VRAM-ot, hogy a 8GB-os kártyákat ki elhet dobni a kukába.

Az első 3rd party játék ezt megcáfolta nem is akárhogyan:

1440p-ig bezárólag elegendő 6 GB VRAM, míg 8GB VRAM még 5K-hoz is elegendő. (TSR Qaulity upscaling mellett és aktív RT mellett)Ezért szoktam mindig nevetni, amikor néhányan megjósolják, hogy így meg úgy lesz, aztán a valóság arcon csapja őket.

-

huskydog17

addikt

Kimaxolt RT effektekkel úgy tűnik elegendő a 8GB VRAM. 1080p rendering felbontás mellett (1440p grafikon) az RTX 3070 és 4060Ti stabilan hozza a 60 fps-t (1% Low sem megy 60 alá). Elég jó PC portnak tűnik, úgy tűnik a Codies odafigyelt a performance-ra.

Sajnos az AMD legújabb drivere visszahozott egy grafikai hibát, amit egyszer már javítottak: hibásan jelennek meg a fák.

Szerintem ahhoz képest, hogy mennyire tele pakolták RT-vel a játékot és köztük DDGI is van, a képkocka-sebességre szerintem nem lehet panasz.

A DLSS Frame Generation és a SER egyelőre még nem működik, de azokat állítólag egy post launch patch-el aktiválják majd.

1440p rendering felbontáshoz (Ultra HD grafikon) már nagyon erősen ajánlott egy RTX 4070Ti. -

huskydog17

addikt

-

huskydog17

addikt

F1 23 will support Ray Tracing Dynamic Diffuse Global Illumination

"Codemasters has detailed the PC graphics settings for F1 23, confirming that the game will take advantage of Ray Tracing Dynamic Diffuse Global Illumination.

This is the first time that an F1 23 game supports Ray Tracing Global Illumination.

Alongside RTDDGI, F1 23 will support Ray Tracing Shadows, Reflections and Ambient Occlusion. So, in theory, these RT effects should noticeably improve the game’s graphics.

Now the good news here is that F1 22 ran silky smooth on PC, even at 4K resolutions. Not only that, but NVIDIA added support for DLSS 3 via a post-launch update."

Engem az F1, mint téma, így a játék a legkisebb mértékben sem érdekel, viszont technikai szempontból nagyon is érdekes lesz, főleg mert nem sok játékban van RTDDGI, nagyon kíváncsi leszek, hogy mit fog tudni mind sebesség, mind képminőség tekintetében. RTDDGI mellett ugye kap még RT Shadow-t, Reflections-t és AO-t is, szóval elég gazdag RT felhozatal lesz benne.(A kép hivatalos Press Release, a TPU is lehozta.)

-

huskydog17

addikt

válasz

Yutani

#46651

üzenetére

Yutani

#46651

üzenetére

Persze, hogy lehet, csak nem nagyon jellemző. A FSR nyílt forráskódú, így minden fejlesztő úgy módosíthatja, ahogy akarja. A kérdés itt az, hogy a legtöbb játékban miért nem sikerült ezt a szintet elérni, pontosabban miért marad el képminőségben a DLSS-től. Itt két lehetőséget/magyarázatot látok:

1. Az FSR 2 out of the box (azaz gyárilag) rossz képstabilitást nyújt és mivel a legtöbb fejlesztő csapat nem tud vagy nem akar foglalkozni a forráskód átírásával, így marad úgy, ahogy az AMD kiadta. Ez esetben a Blizzard mérnökei feltehetően átírták az FSR kódját, hogy jó képstabilitást adjon.

2. Az FSR az izometrikus kamera miatt ebben a játékban alapból sokkal jobban működik (talán ez a kameraszög jobban fekszik a kódnak, ki tudja). Ennek alátámasztására (vagy cáfolására) több izometrikus játékkal kéne összevetni, ahol szintén van FSR 2 és DLSS 2 is.Nem csak a CP2077-ben volt rossz az FSR 2, hanem sok más játékban nagyon rossz temporális képstabilitást nyújt. Ezért is tippelek az első felvázolt lehetőségre. Nyilván az igazságot csak a Blizzard szoftvermérnökei tudják, akik a motort írták és beleintegrálták a felskálázó eljárásokat.

-

huskydog17

addikt

Diablo IV - ComputerBase Benchmark

Egy újabb olyan cím, ahol a felskálázó eljárások brillíroznak és szebb képminőséget nyújtanak, mint a natív felbontás. Itt sikerült az FSR 2-is jó minőségben implementálni, ami viszonylag ritka.

A sebességgel nincs gond, az új motor nagyon gyors, viszont kell alá VRAM bőven. 8 GB talán éppenhogy elég 1080p-hez, de 4K Ultra-hoz 16 GB az ajánlott. Ultra-ról High-ra történő váltás óriási grafikai visszalépést jelent, a textúrák gigantikus különbséget mutatnak a presetek között. E miatt a játék Mediumon már nagyon ronda. -

huskydog17

addikt

válasz

Busterftw

#46633

üzenetére

Busterftw

#46633

üzenetére

És az sem, hogy "More memory matters" - élt kb. 1 hónapot

RTX 4070 launch-nál fontos volt a több VRAM, most már nem az.

-

huskydog17

addikt

válasz

MasterDeeJay

#46629

üzenetére

MasterDeeJay

#46629

üzenetére

Tudtommal konzumer vonalon nem nagyon találkozni 8x PCI-E foglalattal, az alaplapgyártók nem alkalmazzák, az inkább szerver vonalon használatos. Én legalábbis még sosem találkoztam olyan otthonra szánt alaplappal amin 8x csati volt. 16x, 4x és 1x slotokat szoktak alkalmazni a konzumer vonalon, így nagy valószínűséggel emiatt használnak minden 8x VGA-n 16x fizikai csatlakozót, hogy 100%-ban biztosítva legyen a kompatibilitás.

Nyilván lehetne egy slotos is, csak akkor valamelyest hangosabb lenne. -

huskydog17

addikt

válasz

MasterDeeJay

#46627

üzenetére

MasterDeeJay

#46627

üzenetére

8 PCI-E sáv van kivezetve/bekötve a képek alapján.

Szerintem a dual slot rendben van ilyen apró kompakt, 1 ventis hűtő esetén.

A PCI-E tápcsati nélkülözése valóban üdvözlendő. -

huskydog17

addikt

Biostar is another company to offer AMD, NVIDIA and Intel ARC GPUs

Companies that offer AMD, Intel, and NVIDIA GPUS:

Biostar

Gigabyte

MSI

AcerEgy újabb jó hír, a belépés mindig jobb, mint a kilépés.

-

huskydog17

addikt

Arról nem tesznek említést, így nem venném biztosra, hogy használni fogják.

Akár használni fogja a játék, akár nem, erre a PC portra piszkosul kíváncsi leszek, illetve nagyon remélem, hogy jól lesz összerakva, mert ez a játék az eddigi hulladék portokkal ellentétben már érdekel is.

-

huskydog17

addikt

Hoppácska!

Ratchet & Clank: Rift Apart - Features Trailer | PC Games

Most már hivatalos. Jön a PC port és a Nixxes készíti, így végre nagy valószínűséggel ismét egy jó PC portot fogunk látni.

DLSS 3, FSR 2, XeSS támogatás, RT Shadows és RT Reflections, NVIDIA Reflex és DLAA támogatás. Lesz itt minden.

A sok katasztrofális PC port után itt az ideje, hogy a mesterek ismét megmutassák hogyan is kell jól PC-re portolni. Ha ők nem tudnak jó PC portot csinálni, akkor senki. Reméljük ez a port már jó lesz. Figyelembe véve, hogy a Spider Man portok nagyon jók lettek (továbbá a Nixxes-nek van a legtöbb tapasztalata PC portolás terén), így bizakodva várom. -

huskydog17

addikt

válasz

Yutani

#46603

üzenetére

Yutani

#46603

üzenetére

Így van. Azért az durva, hogy még az Intel technikája is jobb képminőséget ad, mint az FSR 2.1, miközben pont az XeSS jött utoljára a három eljárás közül.

Sajnos nagyon sok játékban shimmeringgel az FSR, érdemes megnézni a DF tesztjeit is, azokban is tökéletesen látszik, hogy a játékok többségében az FSR képminőségben meg sem tudja közelíteni a DLSS-t. Nagyon sok példát lehetne felhozni erre. -

huskydog17

addikt

Cyberpunk 2077: XeSS 1.1 vs. FSR 2.1 vs. DLSS 3 Comparison Review - TPU

Csak a szokásos forgatókönyv: képminőség terén a DLSS és XeSS jó, az FSR 2.1 továbbra is versenyképtelen.

DLLS 3 FG képminősége kiváló. -

huskydog17

addikt

válasz

FLATRONW

#46598

üzenetére

FLATRONW

#46598

üzenetére

A beszámoló alapján a grafikai szint megközelítőleg sem indokolja a brutális gépigényt, én személy szerint viszont nem ismerem (nem is fogok soha hozzányúlni, mert alapból a játék témája se érdekel), még korábban néztem meg az első in-engine trailert az mondjuk tényleg jó ronda volt.

Úgy látom már elkezdtek róla özönleni a gameplay videók különböző videósoknál.

A Shadow of Mordor legalább annak idején korrekt PC portot kapott, az még valahogy ki is nézett (nyilván korához képest).

-

huskydog17

addikt

A következő idei technikai katasztrófa PC-n. Csak egy újabb UE4 szemét.

Szerencsémre ez a játék sem érdekel engem.![;]](//cdn.rios.hu/dl/s/v1.gif)

-

huskydog17

addikt

Úgy tűnik a Newegg-nél tökéletesen tisztában vannak azzal, hogy hova való árban egy 8 GB-os VGA.

-

huskydog17

addikt

Egy kis érdekesség, extrém OC piros és zöld oldalról:

A világon először sikerült elérni a 3,8 GHz-es GPU órajelet egy Colorful 4090-el. Tudom, hogy nem a legfrissebb hír, már egy hetes, de nem láttam a PH-n eddig sehol.

RX 7900XTX extrém OC power limit nélkül, 700 Wattot is benyelt a kártya, az azért nem semmi, ehhez már 4 darab 8 pines tápcsati kellene. Itt 3,3-3,4 GHz-ig sikerült jutni.

-

huskydog17

addikt

válasz

Raymond

#46518

üzenetére

Raymond

#46518

üzenetére

"The tip claims that the card is priced at around $249; however, we were unable to independently confirm this information, so take this with a pinch of salt." - Forrás

Ha így lesz, megyek lottózni.

Pár héten belül kiderül az árazás.

$300 fölött a sima 7600-ast szerintem a kutya se vinné, az még viccnek is nagyon rossz lenne. Én továbbra is úgy gondolom, hogy ezért a kártyáért $249 a felső elfogadható határ. -

huskydog17

addikt

A legújabb technikai katasztrófa, a Redfall mind PC-n mind konzolon értékelhetetlen szemét.

Redfall PC - DF Tech Review - Another Unacceptably Poor Port

Redfall Xbox Series X/S - DF Tech Review - Big Issues And Unfulfilled Potential

Úgy tűnik idén a nagy kiadók versenyeznek, hogy ki tudja a legszarabb technikai megvalósítást megcsinálni. A Redfall egy új negatív szintet képvisel, az még hagyján, hogy a performance egy rakás kaki, de a vizuális megjelenítés olyan, mint a hányás. 15 évvel ezelőtt fényévekkel szebb árnyékokat kaptunk, mint ebben a borzalomban. Nekem ismét szerencsém van, hogy a játék a legkisebb mértékben sem érdekel, így ez a f*s port nem érint, viszont a trend nagyon szomorú és egyben aggasztó.

-

huskydog17

addikt

Radeon RX 7600 and GeForce RTX 4060 Ti models from Gigabyte revealed

ASRock preparing Radeon RX 7600 8GB Steel Legend GPU and low-profile Arc A380

Azt hiszem innentől már biztosra vehetjük, hogy a Radeon 7600-as 8 GB VRAM-al érkezik. Most már csak a sebesség és az ár a kérdéses, 200, max 230 dollár még elfogadható lenne érte, a fölött túlárazottnak tekinteném, de tippem szerint 249 dolcsira lövi ezt be az AMD és később érkező, egy esetleges 7600XT pont 300 dolcsi lesz. (Még egyszer, most csak próbáltam reálisan tippelni.)

Ugye itt korábban nagyon sokszor le lett írva, hogy a Navi33 nagyon olcsón gyártható. Hát akkor adják is olcsón. Valószínűleg legkésőbb Computex-en kiderül, hogy mennyire is lesz olcsó az olcsó. -

huskydog17

addikt

Kísért a múlt:

Április közepe táján sok játékos igencsak kellemetlen, sőt bosszantó jelenséggel találhatta szemben magát, ugyanis a Call of Duty Modern Warfare 2 és a Warzone 2 az összes Vega (GCN5) architektúrára épülő VGA-n/IGP-n a Season 3 frissítés telepítése után működésképtelenné vált. Ez kb. 2,5 hete történt, azóta a fejlesztők és az AMD is jelezte már Twitteren, illetve az AMD az AMD fórumon, hogy dolgoznak a hiba elhárításán, eddig azonban még nincs hír arról, hogy mikor lesz a hiba javítva.Források:

MW2 Crash - AMD Forum

Reddit

COD Modern Warfare 2 Season 3 Update Is Breaking The Game For Some AMD Gamers - Hot Hardware

Beenox TwitterRészlet a HotHardware cikkből:

"seems to primarily affect users with AMD Vega-based graphics hardware, meaning not only the original Radeon RX Vega 56 and RX Vega 64 graphics cards but also the Radeon VII and integrated GPUs based on the same architecture. That list includes the integrated GPUs for almost all Ryzen processors, such as the Ryzen 5 5600G and 5000-series mobile processors, even if paired with a discrete NVIDIA GeForce GPU."

Hát...ez gáz. Szerintem a Vega felhasználók lassan már hozzászoktak, hogy valahol mindig szívatják őket.

![;]](//cdn.rios.hu/dl/s/v1.gif)

Továbbá fontos megemlíteni, hogy ennek azért van jelentősége, mert itt nem 1-2 napról van szó, hanem az érintettek heteken keresztül nem tudnak játszani a két említett játékkal. Ez azért nem elhanyagolható időtartam szerintem. -

huskydog17

addikt

válasz

Yutani

#46491

üzenetére

Yutani

#46491

üzenetére

Azok a számok sajnos nem tudják megmutatni se a shader compilation akadásokat, se a traversal akadásokat, se a grafkai hibákat, se a pocsék FSR képminőséget, se a katasztrofális menürendszert, se a kritikán aluli CPU kódot (2 thread) és még sorolhatnánk. Úgy gondolom Alex 10 perc videója tökéletesen reprezentálja mennyire foshalmaz egy PC port lett. Performance részletekbe azért nem ment ő bele, mert annyira sz*r az egész user experience a töménytelen mennyiségű akadással, hogy nincs értelme performance-ról beszélni.

-

huskydog17

addikt

Star Wars Jedi Survivor PC Review: The Worst Triple-A PC Port of 2023... So Far

Döbbenetes, hogy ilyen állapotban pénzt kérnek egy ilyen értékelhetetlen foshalmazért.

Egy újabb UE4 szemét. Ilyen egy totális technikai katasztrófa. Erre is büszke lehet az AMD. -

huskydog17

addikt

válasz

MasterDeeJay

#46471

üzenetére

MasterDeeJay

#46471

üzenetére

Igen, ezt írtam is, hogy kizárólag belépőszintű kategóriát célozzák meg, de nem gaming vonalon.

A 30 Wattos A310-esük (LUMA A310) kiváló HTPC kártya lenne (kiváló GT1030-as utód), csak nem tudom, hogy a driverük mennyire optimális otthoni használatra, mivel ugye ők nem a konzumer vonalra mennek.

Velük együtt már 6 AIB partnere van az Intel-nek:

Acer, Asrock, Gunnir, Gigabyte, Matrox, SparkleSzép lassan növekszik a kék oldal is.

-

huskydog17

addikt

Matrox is visszatér. Ahogy a Sparkle, ők is az Intel oldalán. A Matrox viszont nem a megszokott konzumer piacot célozza meg, hanem inkább professzionális, ipari felhasználást.

Kizárólag belépőszintű, single slot kártyákat dobnak piacra. -

huskydog17

addikt

Dead Island 2 PC - DF Tech Review - Optimised Settings + Performance Tests

Jó látni, hogy végre bővült a DF csapata is egy olyan emberrel, aki PC verziókkal foglalkozik, Alex kapott erősítést, legfőbb ideje volt!

#46462 Raymond: Ezt sajnos nem értem.

-

huskydog17

addikt

Egy kis érdekesség.

Sparkle Re-Enters GPU Market with Intel Arc Alchemist Graphics Cards

Sparkle Returns to the GPU Landscape, With Three Intel Arc GPUsA nevük ismerős lehet, hiszen régen ők NVIDIA kártyákat kínáltak Sparkle Calibre néven.

Most bő 10 év után visszatértek, de a kékek oldalán.

Egyrészt jó látni, hogy egy régi AIB visszatér a piacra, másrészt azt is jó látni, hogy a kékek szép lassan bővíteni tudják az AIB partnerek számát, ami biztató az ARC jövőjét illetően (nagy valószínűséggel nem fogják leállítani az ARC fejlesztéseket). -

huskydog17

addikt

válasz

Yutani

#46458

üzenetére

Yutani

#46458

üzenetére

Igen, ráadásul ez a játék ugye az AMD egyik saját reklámterméke (szponzorált). Az nagy valószínűséggel az AMD döntése volt, hogy mind az RT-t, mind a felskálázási eljárásokat kiherélik, de arra szerintem még ők sem számítottak, hogy néhány VGA kategóriában a tempó messze elmarad az elvárttól. Ez így számukra egy újabb öngól, mármint ez nekik nem a legjobb reklám, hiszen itt a pirosak abszolút semmi előnyt nem tudnak felmutatni a konkurenciával szemben, épp ellenkezőleg, jelenleg csak hátrányuk van. Egy Day-1 patch már jelentősen növelte a tempót, csökkentve ezzel a lemaradást, gondolom majd további patch-ekkel helyrehozzák a sebességet, ha már szerződésük van rá..)

-

huskydog17

addikt

Dead Island 2 Benchmark - Computerbase

Dead Island 2 Benchmark - PCGH

A játékhoz 1440p-ig bezárólag max grafikán bőven elegendő a 8 GB VRAM. 4K maxhoz kell a 10 GB.

Ez tökéletes látható a tesztekben, ugyanis 1440p felbontáson a 12 GB-os Radeon 6700XT nem tudja megközelíteni a 8 GB-os RTX 3070-et.

A játékban nincs DLSS (ahogy RT se), de ez megszokott az AMD szponzorált címektől. A beépített FSR 2.2 nem rossz, de a szokásos problémáival küzd: temporálisan instabil

Felskálázási technikákra szerencsére ebben a játékban nincs is nagyon szükség, mert elég jó lett a sebesség. Nagyjából a papírforma alakul itt is, de az RX 6700XT és RTX 3070 viszonya mellett van még egy kicsit szokatlan jelenség:

Az új RTX 4070 és a 10 GB-os RTX 3080-as FullHD-ban még a csúcs RDNA2-t, a Radeon RX 6950XT-t is megelőzik RT nélkül (PCGH mérés). 1440p-n egálban vannak, míg 4K-ban a 4070-ből "elkezd kifogyni a szufla" és már "csak" a 6800XT tempóját tudja hozni. -

huskydog17

addikt

válasz

Petykemano

#46337

üzenetére

Petykemano

#46337

üzenetére

"Engem nem zavar, hogy az Intel termékeket próbálod népszerűsíteni."

Ezt mi alapján szűrted le? (nem kell válaszolni) Én nem próbálok népszerűsíteni semmit, egy akciós hírt belinkeltem, nem értem ez nálad miért népszerűsítés, na mindegy, hagyjuk, ismét olyat látsz bele a hsz-be ami nincs ott.

Akkor legközelebb nem írok oda átszámított árakat és akkor talán nem lesz értetlenkedés és értelmetlen kötözködés (bár még mindig nem értem hogy ennyire egyszerű evidens dolgon hogy tudsz fennakadni)

"Én csak arra kívántam felhívni a Te és mások figyelmét, hogy az általad alkalmazott átszámítási mód (nem számítva persze a kézközön, vagy ilyen félhivatalos tranzit-házhozszállításos módszereket) nem helyes és ne legyenek túlzott várakozásai a magyar boltokban tapasztalható árakkal kapcsolatban és ne is kezdje el a "felárral dolgozó, lehúzó magyar kisker bandában" keresni a boltban látott és az általad beharangozott árak közötti különbségre a magyarázatot."

Erről beszélek, hogy erről szó nincs, ilyet nem írtam, ezt kizárólag te látod bele a hsz-be, nem értem miért. Itthoni boltok MSRP áron adják az Intel kártyákat, tök jó. Belinkeltem egy olyan külföldi akciót hol MSRP alatti áron lehet venni néhány Intel VGA-t, erre te meg rögtön a fenti dolgokkal állsz elő, holott szó se volt olyanokról, egyszerűen.

Hihetetlen, hogy egy rém egyszerű akció belinkelése alapján te rögtön rosszindulatú háttérszándékokkal vádolsz.

Ha nem tetszik egy hír, akkor lépj túl rajta, de nem tanácsos a másikat mindenféle hülyeséggel gyanúsítgatni, mert belinkel egy érdekességet (azt leírtam ,hogy szerintem milyen szempontból lehet érdekes, de azt is ignoráltad). Én a témát ezzel lezártnak tekintem, mert egyszerűen a semmiről nincs értelme beszélni, főleg úgy, hogy olyan dolgokat hozol fel, amit le se írtam. -

huskydog17

addikt

válasz

Petykemano

#46334

üzenetére

Petykemano

#46334

üzenetére

Huh de nagyon rugózol ezen feleslegesen.

Pofon egyszerű pedig, amint írtam is mindössze a Newegg árait számoltam át Forintra érdekességképpen, hogy ott mennyiért adják. Ahogy írtam is, fogalmam sincs, hogy a Newegg szállít-e ide és mennyiért és őszintén szólva nem is érdekel, mert nem azért írtam, hogy most mindenki vegyen onnan. Az átszámítást csak érdekességképpen említettem meg, hogy ottani ár itthon adott pillanatban mennyi.

Ilyen alacsony áron RTX 3060 (Ti) tempót még nem láttam. Ahogy szintén írtam, nem a mi mérhetetlenül kicsi piacunk a mérvadó, hanem például az amcsi és ott a linkelt árak érvényesek, így ilyen akciókkal az Intel akár számottevő piacot is szerezhet. Ár-érték arányban a fent említett árakkal az ARC A széria igencsak erős lett."Nemrégiben $249 lett az A750 hivatalos ára."

Igen tudom és a linkelt akciók azt jelenti, hogy a Newegg-en MSRP alatti áron lehet vinni az Intel kártyákat.

-

huskydog17

addikt

válasz

Petykemano

#46332

üzenetére

Petykemano

#46332

üzenetére

Ezek alapból bruttó árak. Azt nem tudom, hogy a Newegg szállít-e Magyarországra, mert US-en kívüli országok listájában nagyon kevés van és nincs köztük Hungary, így nem tudom, hogy amennyiben szállítanak ide, akkor mennyibe kerülne a szállítás, azonban nem is feltétlten rólunk van szó, hanem külföldön is sok embernek jó vételek ezek.

-

huskydog17

addikt

Intel Arc A380, A750 and A770 8GB GPUs price slashed, A380 now listed for $120

A750 bruttó 240 dolcsiért igencsak jó ajánlat, átszámítva jelenlegi árfolyamon kb. 88.000 Ft.

Ott van a 8 GB-os A770 is, ami most 270 dolcsi, átszámítva kb. 99.000 Ft.

6GB-os A380 most 120 dolcsi, ami kb. 44.000 Ft

Mindháromból van raktáron. Ilyen árakon sok felhasználónak nagyon jó alternatíva lehet az Arc. A fenti magyar árak nyilván gyorsan változnak, mert ma nagyon gyorsan zuhan a Forint, így a magyar árak a hsz megírása pillanatában voltak csak érvényesek. -

huskydog17

addikt

-

huskydog17

addikt

-

huskydog17

addikt

válasz

bozont

#46237

üzenetére

bozont

#46237

üzenetére

Hogy jön ide a PCI-E 3.0? 5700XT is PCI-E 4.0-ban működik a tesztben.

Az, hogy elég kell, hogy legyen" semmit nem jelent, egyrészt az elmélet és a gyakorlat két különböző dolog, másrészt könnyen lehet hogy a motornak kell a 16 sáv, hogy optimálisan működjön VRAM hiány esetén. Ez nem az első ilyen eset.

Ha a játéknak kevés lenne a sávszél, akkor minden esetben rossz lenne a sebesség és nem csak akkor, ha elfogy a VRAM. Az 1% percentile értékek is azért zuhantak be annyira, mert a 8 sáv csak annyit bír. Felesleges mást belelátni, mint ami. Az RX 5700 XT-nél is elfogy a VRAM, de ott sokkal jobb az 1% érték, mert ott 16 sáv tudja pumpálni az adatokat 8 helyett.

Ez egy klasszikus VRAM hiány probléma, amint írtam nem az első eset amikor a 6600-as szériánál megbosszulja magát a 8 PCI-E sáv.2023-ban ne csodálkozzunk már azon, hogy VRAM hiány esetén kevés lehet a PCI-E 3.0 x16 tempó.

-

huskydog17

addikt

válasz

Yutani

#46234

üzenetére

Yutani

#46234

üzenetére

Pedig szerintem teljesen logikus és nyilvánvaló, nem véletlen írja a CB szerkesztősége is ezt a probléma forrásának.

Minden VGA-t a tesztben PCI-E 4.0-n teszteltek. Minden VGA 16 PCI-E sávval rendelkezik kivéve a 6650-est. Ha a textúrákat visszaveszik, akkor a 6650-en is helyreáll a sebesség. Tipikus VRAM elfogy jelenség.

Ha ebben a játékban max grafikán akarsz játszani, akkor nagyon erősen ajánlott a 16 PCI-E sáv. Nem lenne gond a 6650-nek se, ha az AMD javította volna a memóriatömörítést. Ez már jónéhány generáció óta jobb a zöld oldalon, ez csak egy újabb példa rá.

Az RX 5700XT is pont azért gyorsabb picivel a 6650-nél, mert az 16 PCI-E sávot tud használni.

Mivel az AMD VRAM menedzsmentje kevésbé hatékony, mint a zöldeké, így a piros kártyák jobban rá vanna kényszerítve a PCI-E busz használatára. Egyszerűen ennek a motornak kell a 16 sáv.

Ha az általad említett 128 bit+Infinity Cache kombó lenne a bűnös, akkor nem állna helyre a sebesség a textúraminőség csökkentésével. Csakhogy ez esetben helyreáll a sebesség, mert egyszerűen max textúrákkal kifut a 8 GB-ból. -

huskydog17

addikt

Company of Heroes 3 - ComputerBase teszt

Ha szabad 1-2 észrevételt tenni a teszttel kapcsolatban:

1. a sebességgel semmi gond nincs, még egy sima RTX 3060-as is elegendő a 1080p max gafikához (60 fps). 1440p-ben egy RTX 3060Ti vagy Radeon RX 6700XT is elegendő, sőt egy ARC A770 is. A játékban kiválóan teljesít az Arc A770, ami hozza a 3060Ti tempóját. 4K felbontáshoz egy sima "öreg" RTX 3080 is elegendő.

2. VRAM igény is barátinak mondható: 1440p felbontásig elegendő a 8 GB, kivéve a Radeon RX 6600 szériát* (lásd 3. pont). 4K felbontáson 10 GB kell a max grafikához.

3. Radeon RX 6600 sorozat különösen rosszul teljesít ebben a játékban, aminek egyszerűen a felezett PCI-E sávok az oka. Már 1080p-ben is jelentősen le van maradva egy mezei 3060-tól, de 1440p-ben olyan durván összeomlik a sebesség a 8 PCI-E sáv miatt, hogy még az Arc A770 is bő 80%-al gyorsabb. Ez tehát egy újabb játék, ahol az AMD értelmetlen PCI-E sáv spórolása megbosszulta magát.

4. A játék nem tartalmaz se RT-t, se a három felskálázási eljárást (DLSS,FSR,XeSS), azaz teljes mértékben hagyományos alapokra épül (Essence Engine 5)

5. Frametime-okkal semmi probléma nincs és semmilyen random akadás sincsSzerintem elég korrekt PC verzió lett. Az viszont érdekelne - ez sajnos nincs megemlítve a linkelt cikkben -, hogy a 30 fps animációkat javították -e. Az Age of Empires 4-ben ugye ugyanez a motor van és ott kicsit ciki, hogy az épületek ha összedőlnek, akkor az az animáció csak 30 fps-el megy.

-

huskydog17

addikt

válasz

FLATRONW

#46219

üzenetére

FLATRONW

#46219

üzenetére

Azzal is voltak gondok megjelenéskor. Ott is sok akadás volt, ami erősen függött a CPU-tól, de legalább a VRAM igénye annyira alacsony, hogy még 4K-ban is elegendő a 6 GB.

Azt nem tudom, hogy azóta az akadásokat sikerült-e javítani. Amúgy érdekes módon a Days Gone is pont arra mutat rá, illetve bizonyítja, hogy a Hogwarts-nál valamit kegyetlenül elcsesztek a VRAM használatnál.#46220 b.: A DLSS-el is vannak gondok, sok az úgynevezett smearing jelenség, valószínűleg ez majd javítva lesz, vagy akit zavar, az ki tudja cserélni a DLSS verziót. Szerencsére ebben a címben van olyan jó a sebesség, hogy nem feltétlen szükséges a DLSS. Igen, FSR-ből sajnos csak az első generáció került bele, ezért olyan ocsmány a minősége.

-

huskydog17

addikt

Atomic Heart - ComputerBase teszt

Na tessék, lehet ezt jól is csinálni.

Nincs shader compilation és traversal stuttering, a performance kiváló, miközben az egyik valaha készült legszebb játék. Oh és a VRAM használatról annyit, hogy 8 GB még 4K max grafikához is elegendő. FullHD-hoz pedig 6 GB is elegendő.A játék készítői ezzel alaposan nevetségessé tették a Hogwarts játékot és annak készítőit technikai szempontból.

Ugyan az Atomic Hearts sem tökéletes, de a letöbb UE4 játékhoz viszonyítva ez bizony igen jól sikerült. Végre egy olyan csapat, akik tudják hogyan kell jól kezelni ezt az öreg UE4 motort és figyeltek is annak tipikus problémáira.

Remélem majd a DigitalFoundry is csinál videót hozzá! -

huskydog17

addikt

Returnal PC Teszt - ComputerBase

Meglepően gyors lett a játék, szokatlanul magas a sebesség, de az egészet beárnyékolja a szokásos UE4 stutterfest.

Itt legalább normális VRAM használatot láthatunk. 8 GB VRAM még 1440p-hez is elegendő. 4K+RT kombóhoz pedig 12 GB elegendő.

1080p+RT kombóhoz egy RTX 3060Ti is elegendő a stabil 60 fps-hez.

Ebben a játékban az RT-nek viszont semmi értelme, mert semmit nem tesz hozzá a látványhoz (mert a játék alapból nagyon sötét), cserébe eszi a teljesítményt. Néhány tócsánál az RT Reflection ad különbséget, de a CB ez is ritkán fordul elő, az RT árnyékoknak pedig abszolút semmi értelme, az csak egy checklist feature. A lényeg, hogy ebben a játékban a játékos semmit nem veszít ha kikapcsolja az RT-t (pontosabban nem kapcsolja be).

A grafikon majd bővülni fog, mert nem volt még elég idő minden VGA-t letesztelni, de úgy tűnik, hogy egy sima RTX 3060-as is bőven elegendő lesz 1080p-re a stabil 60 fps-hez (RT nélkül talán még egy 2060-as is).

Nem értem, hogy egy ilyen nagy címeknél, ami mögött rengeteg pénz van, miért kell erőltetni még mindig ezt a hulladék UE4-et, amikor már köztudott évek óta, hogy súlyos gondok vannak vele és évek óta szenvednek emiatt a PC játékosok.

Egy másik szögből nézve a kérdést: ha már mindenképp UE4-en történik a fejlesztés, a készítők egész biztosan tökéletesen tisztában vannak azzal, hogy mekkora rakás fos a motor frame pacing szempontból és mégse tesznek ellene semmit, kiadják ilyen katasztrofális frame pacing-gel aztán majd release után talán megpróbálnak csinálni vele valamit, ha elég nagy backlash-t kap a játék. Miért kell ezt, miért nem lehet rögtön release-re rendbe tenni a frame pacing-et, miért kell szándékosan szopatni a PC playereket? Látjuk rengeteg játéknál, hogy ez szimplán hanyagság, sok olyan játék van, ami így jött ki és néhány nap alatt a készítők belepatcheltek egy shader precompilation-t, ami az akadások nagy részét megszünteti.

Egyszerűen számomra teljesen érthetetlen, hogy miért nem képesek release-re a játékba rakni akár opcionálisan egy shader precompilation-t. Rengeteg problémát megoldana, valamiért mégis megvárják, hogy lesz-e anyázás. Ezen felül az, hogy egy eddig PS5 exkluzív címnél sem foglalkoznak vele, ahol van pénz bőven, finoman fogalmazva nagyon gáz.

Itt most ennyire trágya az UE4, hogy ezt nehéz megtenni vagy egyszerűen az UE4-et alkalmazó játékfejlesztők többsége leszarom hozzáállása okozza a gondot? Másképpen fogalmazva a kérdést: technikai akadálya van vagy emberi hanyagság? Ha technikai akadálya van, mitől lehet az, hogy számos UE4 játéknál néhány nap alatt rendbe tudták tenni az akadásokat (pl. Callisto Protocoll)?

Szerintem pont erről az igencsak súlyos problémáról lenne jó valamilyen cikk itt PH-n, hogy ezt hogyan lehetne végleg felszámolni és mi az oka. -

huskydog17

addikt

válasz

Petykemano

#46187

üzenetére

Petykemano

#46187

üzenetére

Mindegyik elfogyott, ami nem is csoda, ezek elég brutális akciók, főleg a 420 dolláros 3080-as iszonyat jó vétel, így nem csoda, hogy mindet elvitték pár óra alatt. Amúgy szerintem egyéni raktársöprés, ahogy a videocardz is írja:

"However, this is a good sign that even NVIDIA premium retail partners are now expecting to upgrade their inventory to next-gen series, which are hopefully coming in the following weeks."Kár, hogy itthon ilyen akciókat nem nagyon látni. 420 dolcsiért én is gondolkodás nélkül beruháznék egy 3080-ra.

-

huskydog17

addikt

válasz

huskydog17

#46163

üzenetére

huskydog17

#46163

üzenetére

Kiegészítés

Itt a témához kapcsolódó AMD-s Reddit topic:

7900XT white grass and bush rendering issueSajnos még itt sem reagált az AMD.

A játékhoz kapcsolódó további érdekes technikai teszt:

Hogwarts Legacy: FSR 2.1 vs. XeSS vs. DLSS 3 Comparison ReviewAkit csak a konklúzió érdekel:

"Hogwarts Legacy is an action game with a lot of small particle effects on screen during combat, so when using any temporal upscaling solutions, the stability of the image is key to enjoyable gameplay. When using DLSS, the image was stable in motion in all Quality modes, the level of detail rendered in vegetation and tree leaves is improved in comparison to the in-game TAA solution, and small details in the distance, such as thin steel objects, are rendered more correctly and completely. The FSR 2.1 implementation comes with a few compromises in image quality—in favor of performance in most sequences of the game. We spotted excessive shimmering and flickering on character hair, vegetation and tree leaves; they are shimmering even when standing still. This is the same level of shimmering that we've previously seen in The Witcher 3 Wild Hunt with FSR 2.1. XeSS on the other hand, does not have these shimmering issues at all, but XeSS is suffering from ghosting at medium and far distances. Flying birds have black trails behind them, for example. To be fair, DLSS also has these shimmering problems, but only in motion at extreme angles, and with DLSS you have the ability to minimize these issues by upgrading to the newer DLSS version 2.5.1.

The NVIDIA DLSS Frame Generation is excellent, the overall image quality is quite impressive. Even small flying particle effects, such as different varieties of magic spells, are rendered correctly, during with fast movement. However, there's also a few important issues of note. We spotted excessive shimmering and flickering in motion on tree leaves and vegetation at 1440p and below, but it is less pronounced when compared to the FSR 2.1 shimmering issues. Also, as mentioned in our performance review, you can't enable Frame Generation without enabling DLSS first. The issue is that the developers falsely assumed that enabling DLSS 3 Frame Generation, requires enabling DLSS 2 Upscaling, too. If you want to use Frame Generation with DLAA instead of DLSS: enable DLSS in the menu, then enable Frame Generation and only after that enable DLAA. Many other DLSS Frame Generation games that we've tested had issues with the in-game on-screen UI, which had a very jittery look—the DLSS Frame Generation implementation in Hogwarts Legacy does not have this issue."Itt is a megszokott felállás következett be: DLSS adja a legjobb minőséget a három felskálázis metódus közül. FG is kiválóan működik.

-

huskydog17

addikt

A tesztben további érdekesség is van:

"Auf einer Radeon RX 7900 XT sowie einer Radeon RX 7900 XTX gibt es in Hogwarts Legacy bei maximalen Grafikdetails Grafikfehler. Immerhin tauchen diese nicht durchweg auf, sondern „nur“ unter freiem Himmel. Dort sind dann einige Gräser ganz gerne einmal weiß, erst wenn man davor steht, werden sie grün Ob Raytracing an- oder abgeschaltet ist, hat keinerlei Einfluss auf diesen Effekt.

Es ist unklar, in wie weit die Fehler Einfluss auf die Performance haben, jedoch macht es nicht den Anschein. Die Grafikoption „Materialqualität“ ist der Schuldige. Auf „Niedrig“ tritt der Fehler nicht mehr auf."Azaz röviden tömören az AMD jelenlegi aktuális csúcstermékein az aktuálisan legnépszerűbb single player játékban grafikai hibák léphetnek (és lépnek) fel ha a játékban a Material Quality nem Low-ra van állítva.

Ezt a jelenséget egyébként már jelezték az AMD-nek a hivatalos weboldalon is. Ez azért is érdekes, mert Abu állítása szerint a profil már rég ott van a driverben, hónapok óta. Nos, úgy tűnik, hogy az AMD a saját profilját nem tesztelte elég alaposan.A gond megint ott van, hogy a legnépszerűbb játékban az AMD csúcstermékein grafikai hibák jönnek elő, miközben a konkurens termékeken nincs gond. A problémát tetézi, hogy egyrészt az érintett csúcstermékekhez már több exkluzív driver is megjelent, mégse lett javítva, másrészt az AMD a mai napig semmit nem reagált erre, így akit érint a hiba, azok a sötétben tapogatóznak, hogy vajon lesz-e javítás és ha igen mikor, merthogy az AMD annyit se mondott eddig, hogy fapapucs.

Korábban felmerült többször a téma, hogy miért olyan a piaci részesedés amilyen. Nos, az ilyen esetek is hozzátesznek ahhoz, az AMD-nek az ilyeneket el kéne kerülnie. A legtöbb felhasználót nem érdekli a technikai megvalósítás, ha egy felhasználó találkozik például a fent említett grafikai hibával a frissen vásárolt csúcsterméken, jogosan hiheti/gondolhatja azt, hogy a hardverrel van gond, főleg ha tudja hogy a többieknél akiknek mondjuk NV kártyája van, nincs gondjuk. A legtöbb érintett felhasználót nem fogja érdekelni a miért, egyszerűen valamilyen módon megszabadul az RX 7900-tól (akár visszaviszi ha két héten belül van vagy eladja) és vesz NV-t. Az ember nem azért vesz ráadásul csúcsterméket kb. 1000 euróért, hogy Low-ra kelljen állítani az egyik grafikai opciót.

Az ilyen problémás game launch-okat kéne elkerülnie az AMD-nek. Ha ez egy noname indie game lenne, akkor who cares, viszont jelenleg ez egy iszonyat népszerű játék, jelenleg a legnépszerűbb single player játék Steam-en. -

huskydog17

addikt

válasz

bertapet11

#46037

üzenetére

bertapet11

#46037

üzenetére

Na ez viszont nagyon gáz, mármint az AMD-re nézve, ugyanis a mai napig nagyon játékos használ RX 400/500-as szériás VGA-t. Ők most a legújabb "sztár" játékot ki sem tudják próbálni, mert nem indul el, még egy 8 GB-os 2017-ben kiadott RX 580-on sem, miközben a másik tábornál a 2014-es Maxwell szériával legalább ki lehet próbálni. Itt most a lehetőségen van a hangsúly, hiszen a játékból van ingyenes demó és ez most az aktuális trendi cím, így kritikus fontosságú, hogy mi a minimális gépigény és itt minimális alatt azt értem, hogy amin elindul a játék. Így érthető, hogy a Steam adatlapon miért 8 GB-os RDNA kártya van feltüntetve minimális gépigényben, míg NV oldalról egy Pascal kártya (1060). A zöld oldalon a 2014-es Maxwell v2 arch-os kártyákkal is ki lehet próbálni, például a rendkívül népszerű GTX 970-en is működik. AMD oldalon viszont akinek van mondjuk egy 2017-ben kiadott 8 GB-os RX 580, az hoppon marad.

Persze GCN4-el is működésre lehet bírni Vulkan wrapper-rel, de a legtöbb user ilyennel nem fog foglalkozni, mert a többség azt sem tudja mi az hogy API, csak annyit fognak tapasztalni, hogy nem indul el.

Ha pedig figyelembe vesszük, hogy a Steam statisztikában pont az RX 570 és 580 a két legnépszerűbb AMD dVGA, akkor bizony nem túl valószínű, hogy csak 1-2 emberről van szó, hanem nagyságrendekkel többről, azaz nem mondanám elhanyagolhatónak.

Ami hab a tortán, hogy ironikus módon pont egy AMD által szponzorált játék lépte ezt meg.Igazából én csak azt nem értem, hogy ha már az AMD pénzelte ezt a játékot, miért nem szóltak a fejlesztőknek, hogy ne üssék ki a saját DX12_0 Feature Level kártyáikat.

Ha elég nagy lesz a backlash, akkor valószínűleg jön majd egy patch, ami DX12_0 támogatást hoz majd.

-

huskydog17

addikt

Forspoken PC Performance Analysis - DSOG

"As said, Forspoken supports ray-traced shadows and ambient occlusion. However, this is the worst Ray Tracing implementation we’ve seen so far.

Graphics-wise, Forspoken does not look as impressive as its initial in-engine reveal trailer. Its lighting system, in particular, looks as old-gen-ish as it can get.

However, and while the game does not use a dynamic day/night cycle, its pre-baked lighting looks worse than the one from Final Fantasy XV. Hell, it can even look worse than Uncharted 4. And then we have car lights that do not cast shadows. The original Watch_Dogs and Grand Theft Auto 4 had this feature, but Forspoken is suddenly unable to provide such a thing. Some distant objects/textures also look really blurry. And, for a game requiring more than 10GB of VRAM, this is unacceptable.

All in all, Forspoken is a huge technical disappointment. Not only was the game downgraded from its initial reveal, but it also has numerous performance/optimization issues."A Lighting rész tökéletesen egybevág azzal, amit John mondott a DF-nál a PS5 verzióról.

Ez a játék nem csak PC-n, de konzolon is egy technical mess. -

huskydog17

addikt

DF videója a PS5 verzióról.

Bizony, a játéknak vannak gondjai, a motor inkább visszafejlődött a FF XV óta, az AMD Fidelity FX csomag úgy tűnik elég pocsék minőséget ad konzolon is, az AO annyira rossz, hogy a sok éves DX 11-es VXAO jobb minőséget ad.

Ezen felül ha a textúrát High-ra rakod, akkor a motor kb. Quake 2 szintű textúrákat ad 8 GB VRAM mellett, mert High beállításhoz legalább 12 GB VRAM kell, továbbá kameramozgatásnál meghülyül a frametime.

Amúgy szerintem Frey haja egészen jó, legalábbis 4K YT videón keresztül gameplay és átvezetők alatt jónak tűnik, számomra abszolút meggyőző, de lehet, hogy a veszteségmentes képen nem annyira szép, ezt nem tudhatom. A játék elején a macsek viszont nagyon jó lett.Persze az is tény, hogy a DirectStorage 1.0 működik benne, mert veszettül gyors a betöltés, de kérdés, hogy vajon megérte-e az emiatt masszívan megnövekedett VRAM igényért cserébe. Szerintem nem, én arra tippelek, hogy a játékosok többsége inkább várna még néhány plusz másodpercet a szebb textúrákért cserébe.

Ezért a fos PC portért kér el a Square Enix 80 eurót. Szép, még szerencse, hogy engem messze nem érdekel annyira a játék, hogy pénzt adjak érte, egy videósnál kezdtem el nézni a játékot 4K-ban. A játéknak sok gondja van, amire számítani lehetett, hiszen a japánok nem nagyon tudnak PC-re fejleszteni (Capcom kivétel), emiatt engem ez a pocsék PC port nem lep meg. Az is várható volt, hogy a Square Enix-nek sokkal nehezebb dolga lesz PC-n, miután elment tőlük a Nixxes. -

huskydog17

addikt

-

huskydog17

addikt

A helyén kell kezelni a dolgokat. Nyilván az eredetihez képest néz ki észbontóan jól.

"Az Unreal motor sokkal jobban nézett ki már akkor is."

Az Unreal 1 nem is a Quake 1, hanem a Quake 2 ellen ment és attól semmivel nem volt szebb, semmi előnyük nem volt az Unreal motoroknak az akkori id tech motorral szemben látványban.

#45830 gV: Nem, nekem azok se maradtak ki, mármint ismerem azokat is és láttam videókat róluk. A Quake 2 nagyon jól néz ki RT-vel, de a Minecraft végtelenünk ocsmány pixel grafikáját még az RT sem tudja megmenteni. Ez azonban meglehetősen szubjektív dolog, hogy kinek mi jön be.

-

huskydog17

addikt

The Original Quake Gets A Full RT Upgrade - And It's Incredible

Észbontóan jól néz ki, teljesen más játék lett így belőle, a sebességbeli különbség AMD és NV között pedig nagyon finoman fogalmazva extrémen extrém: a 3080 natív 4K-ban duplázza a 6800XT tempóját, upscaling technikával pedig majdnem triplázza úgy, hogy a 3080 magasabb felbontásban renderel. Na ez igazán extrém. 1080p-ben DLSS Quality mellett (720p rendering felbontás) egy sima RTX 2060-as beton stabilan tartja a 60 fps-t, míg egy Radeon 6800XT 1080p rendering felbontásban (FSR Performance mode) a 30-at sem tudja tartani. Ilyen brutális szakadékot még nem láttam.

-

huskydog17

addikt

NVIDIA Responds to Melting Cables, Warranty Concerns, & 12VHPWR Adapter Failures

Ha jól értem, a zöldek minden problémás kártyát cserélnek garanciában, annak ellenére, hogy nem ők tehetnek az egészről. A szabvány egyszerűen nem lett kellő mértékben "hülyebiztosra" tervezve.

-

huskydog17

addikt

válasz

Busterftw

#45728

üzenetére

Busterftw

#45728

üzenetére

Ezen is már sokat gondolkodtam, de végül elvetettem ezt a tervet, mert egyrészt a 10 éves alaplapot is próbálom kímélni (ilyen korban minden üzemképes nap ajándék), másrészt jövő évben úgyis teljesen új, komplett gépet akarok építeni (10-11 év után ideje lesz

), ezt a bő fél évet simán kihúzom a 3470-el, főleg, hogy még sok olyan játék van a bakancslistán, amelyhez bőven elegendő a 3470. Az utolsó fejlesztést néhány héttel ezelőtt eszközöltem amikor 8-ról 16 GB-ra emeltem a RAM mennyiséget (ESO-hoz kevés a 8 GB). Most legalább mind a 4 DIMM foglalat használatban van, kettő üresen állt 10 évig.

), ezt a bő fél évet simán kihúzom a 3470-el, főleg, hogy még sok olyan játék van a bakancslistán, amelyhez bőven elegendő a 3470. Az utolsó fejlesztést néhány héttel ezelőtt eszközöltem amikor 8-ról 16 GB-ra emeltem a RAM mennyiséget (ESO-hoz kevés a 8 GB). Most legalább mind a 4 DIMM foglalat használatban van, kettő üresen állt 10 évig.

A 3770 nem hozna annyit sebességben, hogy megérje most 20k-t kiadni érte úgy, hogy jövőre új gépet veszek. -

huskydog17

addikt

Igen.

"GPU decompression is supported on all DirectX 12 + Shader Model 6.0 GPUs."

Ezen felül speciális GPU optimalizálásokkal még több sebességet lehet nyerni:

"However, one of the benefits of DirectStorage 1.1 is that GPU hardware vendors can provide additional optimizations for their hardware, called metacommands."

Az Intel csinált egy konkrét mérést az Arc A770-el, ami majdnem 3× volt gyorsabb kicsomagolásban, mint egy Core i9-12900K. Ez pedig még csak az első lépcsőfok. Ígéretes.

Az NVIDIA mérései és blog bejegyzése itt található, míg az AMD bejelentése itt.

-

huskydog17

addikt

DirectStorage 1.1 Now Available

Mindhárom GPU gyártó támogatja, innentől a játékfejlesztőknél a labda.

Bő 2 év után el lehet végre kezdeni kihasználni az RTX IO képességeit.

-

huskydog17

addikt

A PCGH-nak abszolút semmi beleszólása nem volt se a driver se a játék kódjába, ők továbbra sem tehetnek arról, hogy AMD alatt ekkora CPU limit van, szóval nem, ők nincsenek benne, ahogy állítod. Furcsa is lenne, ha egy újságíró mondaná meg a fejlesztőknek, hogy hogyan írja meg a játék/driver kódját.

"Kérdés, van-e bármi jelentősége, hogy jóval 200FPS felett, masszív CPU-limittel 1080P-n, hogy az Nv drivere képes egy extra 27% tempóra (RTX3090 vs. 6900XT). Szerintem nincs, az égvilágon semmi."

Nagy valószínűséggel a játék és az AMD programozói is így gondolták annak idején, ezért is állnak meg ott a Radeonok, míg a Geforce-ok szépen mennek tovább. Az, hogy számodra lényegtelen, egy dolog, mások számára nem biztos, hogy az. Egyrészt az olvasó a zöld oldalon ennél a játéknál is releváns információt kap a 130 VGA közti különbségről, míg a piros oldalon csak a Radeon VII-ig van skálázódás, másrészt pedig ha valaki 240 fps felett szeretne játszani ezzel, akkor a zöld oldalon legalább az esélye megvan rá. Ha mondjuk valaki ki akarja próbálni, hogy milyen a játék mondjuk egy 360 Hz-es kijelzőn 300 fps-el, akkor a zöld oldalon megvan rá a lehetősége, mármint ott ki tudja futni magát a játék. A PC platform pont a korlátlan lehetőségekről kéne, hogy szóljon, szóval szerintem pont az a jó, ha a lehetőséget megkapja a játékos.

A teszt lényege, hogy a 130 VGA sebessége összevethető legyen azonos grafikai beállítások mellett, így az 1440p és 4K azonnal ki is esik a játékból, mert akkor több tucat VGA kb 0 fps-t hozna, aminek semmi értelme. -

huskydog17

addikt

válasz

Raggie

#44451

üzenetére

Raggie

#44451

üzenetére

Bioshock 3 esetén egyszerűen az AMD DX11 drivere a ludas (driver overhead), arról a PCGH nem tehet, hogy a vörös oldal ilyen sok teljesítményt hagyott a driver-ben. Ironikus módon ezt a játékot ráadásul az AMD szponzorálta. Lehet látni, hogy a zöld oldal szépen skálázódik, az pedig tény, hogy az AMD nem nagyon foglalkozott a DX11-es driver optimalizálásával, ebben a játékban ez azt eredményezi, hogy a jelenlegi csúcs VGA, a Radeon 6900XT a GTX 1080Ti-al tudja felvenni a versenyt. A játék fejlesztését az AMD is felügyelte, hiszen a Gaming Evolved partnerprogramba is bekerült. Valószínűleg akkor úgy voltak vele, hogy 200 fps-nél több úgyse kell senkinek, csakhogy mára elég látványos lett a driveres teljesítmény-különbség.

A 2016-os Doom még rosszabb lett volna, mert a régi DX11-es VGA-k nem kaptak Vulkan támogatást, így csak OGL alatt lehetne őket összevetni, de ott a Radeonok még hátrébb lennének a pocsék (értsd: borzalmasan lassú) OGL driverük miatt, ami még rosszabb, mint a DX11-es driverük. -

huskydog17

addikt

válasz

Gyuri27

#44448

üzenetére

Gyuri27

#44448

üzenetére

Persze, le is van írva, hogy miért, illetve logikus is, hiszen olyan játékok kellettek, amelyek még a leggyengébb VGA-n (értsd: Radeon HD 5450) is elindul és fut valahogy. Az 5450 még az 1 fps-ért is vért izzad, na most ha ennél frissebb játékokat raknak bele, akkor kb. egy tucat VGA-nál teljesen értékelhetetlen lenne a sebesség (értsd: 0 fps), annak pedig semmi értelme nem lenne. Ezen felül nem csak, hogy futniuk kell a leglassabb DX11-es VGA-kon is, de jól kell skálázódniuk is, ezért esett erre a három játékra a választás, ami szerintem teljesen korrekt, hiszen korukhoz képest népszerű és szép játékok voltak.

Skálázódás pedig még jobb is, mint néhány mai DX12-es címben. -

huskydog17

addikt

Age of Empires 4 DF Tech Review: A Great Game With Technical Issues To Address

Még egy pocsék DX12 implementáció: Single thread, masszív CPU limit és 30 fps animációk, úgy látom erősen visszafelé fejlődünk.

-

huskydog17

addikt

válasz

proci985

#44326

üzenetére

proci985

#44326

üzenetére

Nem volt, hanem még van. Az, hogy nem volt népszerű, a tulajokat nem vigasztalja.

Mindegy is, elkanyarodtunk az eredeti témától, ahogy írtam a hosszú távú támogatás inkább driveres supportot jelent, semmi köze ahhoz, hogy évekkel a piacra dobás után bizonyos játékokban hogyan alakul az erőviszony a konkurenciához képest. Ez az architektúrától és a játék kódjától függ.

A gyakorlatban pedig nem látom, hogy az AMD támogatás terén jobb lenne, épp ellenkezőleg. -

huskydog17

addikt

válasz

proci985

#44323

üzenetére

proci985

#44323

üzenetére

"a Fury Xbol gyakorlatilag nem adtak el kartyat"

Már hogyne adtak volna el belőle. Igaz, hogy egy zsákutca volt a fejlesztés, de attól még nem egy ember vásárolt olyat. Egy kollégám is olyat vett több éve, aztán idén nyáron nem nagyon örült annak, hogy megszűnt a driver support.290X-ek hullottak mint a legyek, nem tudom mit értesz az alatt, hogy jól tartották magukat.

"Kepler papiron tamogatva volt, gyakorlatilag a 780 TI mar evek ota szornyen tartotta magat. az a kartya valaha a 290Xel volt parban."

Nem csak papíron, hanem a gyakorlatban is a GCN1 és Kepler ugyanúgy 9 évig volt támogatva. Te kevered a dolgokat: az, hogy van olyan játék, ahol a 290X gyorsabb, mint a 780Ti az architektúra/optimalizálás kérdése, semmi köze a hosszútávú támogatáshoz, utólag driverrel nem tudják fizikailag módosítani a terméket.

Amúgy a 290X és a 780Ti egálban volt teljesítményben, pár százalékos eltérés lehet játékonként. A két kártya kb. egy időben jött ki (2013 végén), egymás ellenfelei voltak, stimmel. A 780 Ti a 390X ellen is jól tartotta magát, pedig utóbbi 1,5 évvel később jelent meg.

Keplerhez ugyanúgy idén nyárig volt hivatalos driver support, mint az első három GCN generációhoz, vagyis 9 év támogatás mindkét oldalon.Régebben se látom, hogy a piros oldal tovább támogatott volna egy generációt, mint a zöldek. 2010-ben megjelent generációt (Radeon HD 6000) az AMD bő 5 évig támogatta, az NV a GTX 400-es Fermi szériát 8 évig.

-

huskydog17

addikt

válasz

proci985

#44317

üzenetére

proci985

#44317

üzenetére

Mit értesz jobb hosszútávú támogatás alatt?

Az AMD az első három GCN generáció támogatását idén nyár elején leállította, köztük a 2015-ös, 650 dolláros csúcs VGA, Fury X-ét is.

Az NV az 1 évvel idősebb, 2014-es Maxwell generációt a mai napig aktívan támogatja, ők a 9 éves Kepler generáció támogatását állították le nyáron.

Ez alapján nekem inkább az NV hosszú távú támogatása tűnik jobbnak.

-

huskydog17

addikt

Az AMD-nek mostanában nincs szerencséje a Microsoft-tal.

Az RDNA2 VGA-t használók mindenképp várják meg az Adrenalin 21.10.3 driver-t. Bár még azzal is rossz a tempó, de legalább már nem katasztrofális.

Adrenalin 21.10.3 nélkül az RTX 3080-nak 77%-os előnye van a 6800XT-hez képest. Ilyet se mostanában láttunk. Szerintem az AMD nem nagyon fogja reklámozni ezt a játékot.Engem érdekelne itt egy PH-n egy elemző cikk, hogy itt mi is történhetett, szerintem nem csak én lennék rá kíváncsi, főleg, hogy ugye a konzolokban is RDNA2 van.

-

huskydog17

addikt

Egy újabb elcseszett Remaster:

Alan Wake Remaster CB TesztNem elég, hogy a grafikai hibák lépnek fel, a fejlesztőknek sikerült egy új DX12-es leképzővel egy masszív 140 FPS-es CPU limitet csinálniuk, ami a régi verzióban nem volt. Emiatt több olyan helyzet áll elő, ahol a régi verzió DX9-el lényegesen gyorsabb, mint az új, miközben a látvány nagyon minimálisan javult.

A Far Cry 6 után egy újabb szégyenfolt a DX12 implementációk között.Most már értem, hogy a Remedy miért nem hozta ki Steam-re.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

huskydog17

addikt

Far Cry 6 - The Digital Foundry Tech Review

Vannak gondok, továbbá nagyon gáz, hogy a traversal stutter-t 7 év alatt, új leképzővel két cég közösen, együttműködve sem tudta megoldani, ezen felül Alex is belefutott a single core issue-ba, hogy egy magot sokkal jobban terhel a motor, mint a többit, könnyen lehet, hogy ez okozza a traversal stutter-t, fene tudja, de minden esetre gáz.

Talán így már érthetőbb, hogy miért gondolom azt, hogy ezt a motort ki kéne dobni a francba, pedig régen a FC2 és FC4 idején a kedvenc motorom volt játékos szemmel nézve.

NV oldalon vannak gondok a VRAM allokálással, de egy AMD-s cím esetén ez a legkisebb mértékben sem meglepő, ezen csak legyintettem, hogy "nincs itt semmi látnivaló."

Az RT implementáció szerintem az egyik leggyengébb amit eddig láttunk, de ezen sem lepődtem meg, hiszen nyilván az AMD nem akarta, illetve nem engedte, hogy az RDNA2 annyira lemaradjon RT mellett, mint a többi játékban.

A 30 fps cap átvezetőkben nagyon nagyon gáz, főleg annak fényében, hogy a korábbi részekben nem volt ilyen hülyeség, ez egy óriási visszalépés.

Tök jó, visszahozták a fizikát, cserébe kiherélték az átvezetők alatt a framerate-t.

Azért vagyok mérges az Ubira, mert a Far Cry az egyik kedvenc franchise-om (már csak volt), ahogy a Dunia volt az egyik kedvenc grafikus motorom, épp ezért az elmúlt évek szerencsétlenkedései ami a Far Cry és Dunia körül történnek, az végtelenül elszomorít és felbosszant egyszerre. Ez a széria és a motor fényévekkel jobb lehetne, ha az Ubi rendszeresen fejlesztette volna és nem egy helyben toporogna, de sajnos most már elég egyértelmű és nyilvánvaló számomra, hogy szimplán elvonták az erőforrásokat ettől a motortól és most már csak lélegeztetőgépen van, amit a tech partner üzemeltet. Rossz nézni ezt a szenvedést, komolyan.

#44144 Petykemano: Te jó ég, hogy lehet a semmin ennyit lovagolni? Miért ilyen fontos ez? Nem tudom, hogy HSM és te miért akartok mindenáron bolhából elefántot csinálni, de a helyzetet szerintem extrém mértékben túlbonyolítjátok. Igazából végtelenül egyszerű.

Szerintem az AMD is hibázott, főleg, mert ők is hoznak javítást, ez már önmagában elég egyértelmű, hogy náluk sincs minden rendben, továbbá az is egyértelmű, hogy MS-al való együttműködés nem úgy működött, ahogy kellett volna, ebben pedig mindkét fél hibás, szóval az én szememben igen hibázott az AMD ahogy a MS is, ennyi end of story.

Még az a szerencse, hogy én nem vagyok újságíró, így egy linknek adhatok olyan címet, amilyet akarok, akár olyat is, ami egyeseknek clickbait-nek tűnhet, de szerintem lépj túl rajta, én nem vagyok ezzel hajlandó többet foglalkozni. Az a legszomorúbb, hogy egy link elnevezésével foglalkoztok a mögötte lévő tartalom helyett, ami milliószor fontosabb.

Az NV-ről pedig szó se volt, se a hírben ,se a fórumban, nem értem miért hozod fel, a kérdésnek abszolút semmi köze ehhez a témához, elég nonszensz amit írsz. Amint mondtam, totál feleslegesen lovagolsz a semmin. -

huskydog17

addikt

"Ez így félrevezető, mert elismerni a hiba elkövetését szokás, így pedig úgy hangzik, mintha az AMD hibázott volna, amit elismert."

Neked félrevezető, másnak nem, aki elolvassa a lényeget, annak szerintem abszolút nem félrevezető. Mivel az AMD is kiad majd egy frissítést, továbbá egyértelmű, hogy hiba történt a MS-val való együttműködés során, máskülönben ez nem történt volna meg. Szóval ők is hibáztak és a MS is. Elismerték a problémát, javítva lesz, end of story.

Amúgy nem volt itt semmi félreértés, mindössze értelmetlen és helytelen következtetés a kolléga részéről, mert szerinte ha egy oldal valamit nem ír le (amit korábban már leírt), arról nincs tudomása. Ezt fejtettem ki, hogy ez hibás következtetés. -

huskydog17

addikt

A cikknek az a célja, hogy figyelmeztesse a felhasználókat, hogy a 8-nál több maggal rendelkező Ryzen CPU-k esetében sebességvesztés következik be Win11-en, hogy az érintett felhasználók még ne telepítsék az új Windows-t, ha nem muszáj. Ennek a közleménynek NEM az a célja, hogy elismételje azt, hogy 2 éve bevezetett feature pontosan hogyan működik, pontosabban fogalmazva hogyan kéne működni.

Akit ez ilyen mélyen érdekel, az utána tud nézni, de ne várjuk már el, hogy egy figyelmeztető közleményben architekturális elemzés szerepeljen, mert nem reális elvárás.

Az AMD közölte a probléma forrását. Az, hogy te hiányolod a közleményből a feature pontos működési dokumentációját, az csak irreális elvárás a részedről, főleg, hogy az érintett felhasználók min. 99%-át úgysem érdekli, csak az, hogy mikor lesz javítva és hogy van-e létező workaround.

Szóval amit te felhoztál az nem újságírói hiányosság, hanem irreális elvárás a részedről, főleg, hogy maga a gyártó sem tartja fontosnak a feature elismétlését egy ilyen esetben.

Az általad leírtakból továbbra sem derül ki, hogy a CB miért ne lenne tisztán az említett feature működésével, mikor 2 éve ők is leírták, hogy mit csinál. Akit érdekel olvasson vissza és kész.#44141:

"Zen2-ről említés sincs... miért is lenne.. még a végén kiderülne, mi is a probléma valós gyökere."

Az AMD hivatalos közleménye úgy kezdődik, hogy belinkelték a CPU kompatibilitási listát, azon belül a 8-nál több maggal rendelkező CPU-k érintettek, ezt egyértelműen leírták. Mivel a Zen2 is listáz van van, így az is említve van. A probléma valós gyökere is említve van. Attól, hogy a probléma forrásának nincs részletezve az architekturális mélylélektana, attól még a probléma forrása ugyanaz. Irreleváns részletek. Szólj az AMD-nek, hogy nem a valós problémát kommunikálták a világ felé!

Inkább örülnöd kéne, hogy legalább elismerték a hibát és figyelmeztetik a felhasználókat ahelyett, hogy elsunnyognák. -

huskydog17

addikt

Nem értem miből következtetsz arra, hogy nincsenek tisztában a CPPC2-vel, főleg hogy rögtön az első bekezdés megcáfol téged. Szerintem teljesen mást olvastál, mint amit linkeltem.

CB leközölte azt, amit az AMD kiadott közleményben, ott a screenshot is. Akkor az AMD saját közleményéről sem tudod eldönteni, hogy sírjál vagy nevessél? -

huskydog17

addikt

válasz

Gyuri27

#44128

üzenetére

Gyuri27

#44128

üzenetére

Hol állítottam olyat, hogy az AMD hibája? Az AMD elismerte hogy gond van a csúcs Ryzen teljesítményével Win11 alatt, semmi másról nem szól a cikk. A MS már láthatóan dolgozik rajta, a legújabb preview build már valamennyit javított, de még messze van a Win10-es tempó.

Az AMD nyilván nem tud mást tenni, mint hogy Win10-en marasztalja az érintett felhasználókat. -

huskydog17

addikt

válasz

huskydog17

#44119

üzenetére

huskydog17

#44119

üzenetére

Kifelejtetem a felsorolásból a sokat sztárolt HWU tesztjét, de ugyanaz, mint a többinél kb.

-

huskydog17

addikt

Fincsi.

Érdekes módon a többi független tesztelők is belefutottak.

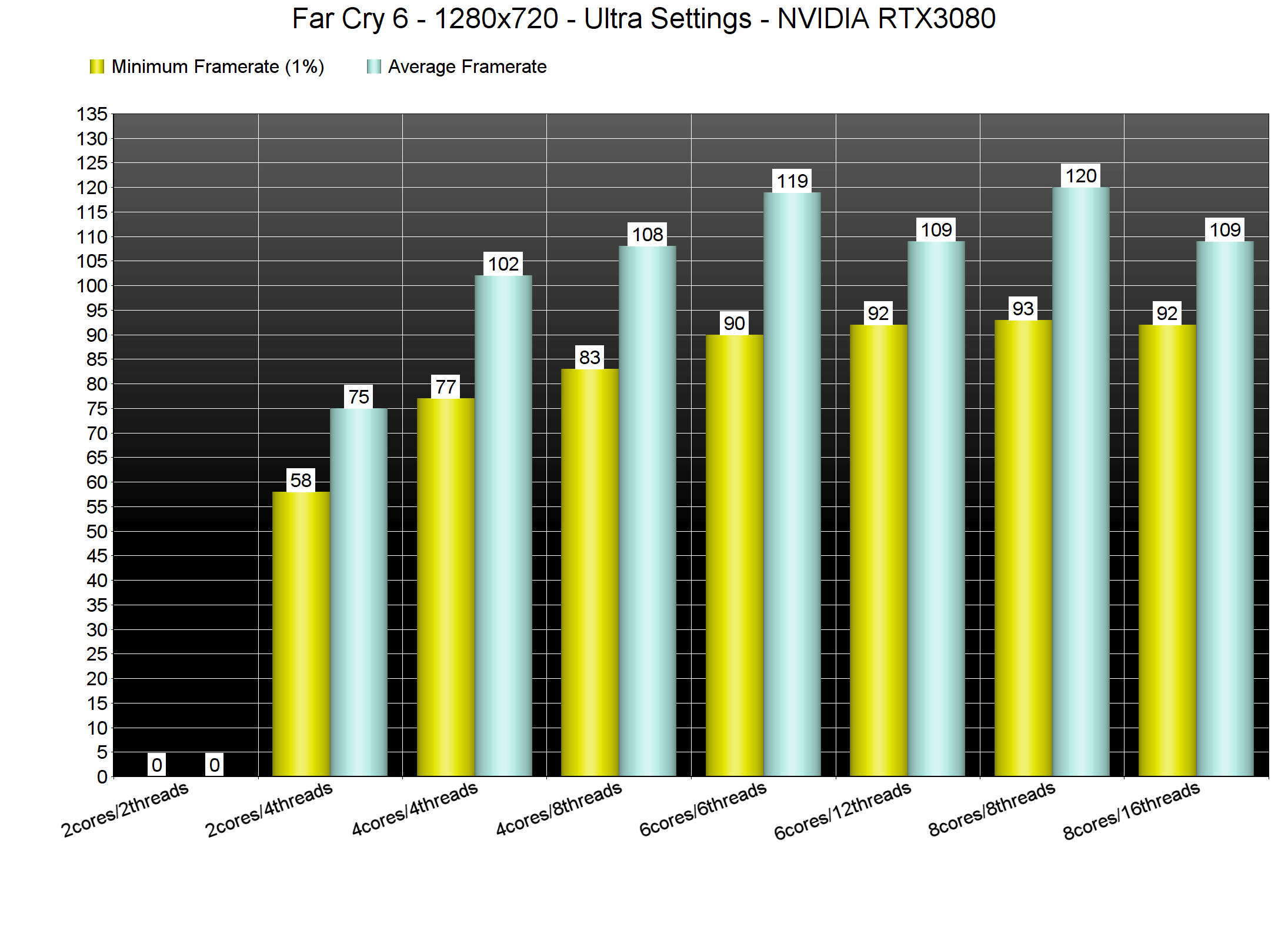

További FC6 tesztek:Úgy látom 6 magnál itt is megáll a tudomány:

-

huskydog17

addikt

válasz

proci985

#44108

üzenetére

proci985

#44108

üzenetére