Új hozzászólás Aktív témák

-

X2N

őstag

válasz

proci985

#50990

üzenetére

proci985

#50990

üzenetére

RX 9070 szintű kártyát tudok elképzelni maximum az új konzolba alacsonyabb fogyasztással, 24-32GB memóriával. Proci fog kapni egy jelentősebb upgrade-et, arra már égetően szükség van mert a PRO se lett erősebb ezen a téren. Már ez is drága lesz, és 2 év legalább mire kijön, addigra meg már nem számít jónak se. Viszont az első natív 4K képes konzol lesz.

-

X2N

őstag

válasz

Busterftw

#50933

üzenetére

Busterftw

#50933

üzenetére

AMD claims DDR5-4800 is within 1% FPS difference of DDR5-6000 on Ryzen 7 9850X3D

Már megint megy a bullsh*t, meg a félinformáció terjesztés.

-

X2N

őstag

válasz

Busterftw

#50922

üzenetére

Busterftw

#50922

üzenetére

Objektíven youtubon is csak az tesztel maximum aki saját pénzéből veszi meg a hardvereket. Linus is le égette már magát mútkor a fabrikált teszteredényeivel, a Hardware Unboxedeseket is lehet kritizálni bőven, múltkor simán DDR5-t ajánlottak DDR4 helyett hogy szerintük jobban megéri, miközben nagyon nem...

Az egész tech youtuber réteggel az a baj hogy már nem is játszanak, csak tesztelnek.

Nagyon más az amikor valaki aktívan játszik egy adott játékkal, és látja hogy mi változik patchenként, ő tudná igazából benchelni reálisan az adott játékot mert ismeri, nem merül ki abban a tudása hogy elindítja a beépített benchmarkot. -

X2N

őstag

Itt egy szórakoztató játék teszt llinux alatt különboző generációs pc-kel.

-

X2N

őstag

válasz

S_x96x_S

#50904

üzenetére

S_x96x_S

#50904

üzenetére

"Just one important thing to note is that I've asked the Minisforum reps at this booth in CES and they told me that they are not expecting the BD395i MAX to enter production phase anytime soon mainly due to RAM supply issues."

Amíg tart a ram mizzéria kár álmodozni.

A framework lapot láttam de ennyiért dugják oda ahova akarják

-

X2N

őstag

válasz

bozont

#50902

üzenetére

bozont

#50902

üzenetére

Mégis a gamerek nagy százaléka veszi a 6000-es ramot az X3D mellé amikor ott még kevésbé számít.

![;]](//cdn.rios.hu/dl/s/v1.gif) Persze hogy az a legoptimálisabb hozzá, úgy van szinkronban, de ha már itt tartunk akkor mért nem monolitikus Intelt vesz akinek nincs pénze X3D procira, vagy nem használja ki? Elvégre játékra lesz használva. Ott sokkal alacsonyabb latency-t el lehet érni és játéknál ez számít, nem az hogy magas az fps-ed, attól lesz vajsima frametime-od.

Persze hogy az a legoptimálisabb hozzá, úgy van szinkronban, de ha már itt tartunk akkor mért nem monolitikus Intelt vesz akinek nincs pénze X3D procira, vagy nem használja ki? Elvégre játékra lesz használva. Ott sokkal alacsonyabb latency-t el lehet érni és játéknál ez számít, nem az hogy magas az fps-ed, attól lesz vajsima frametime-od. -

X2N

őstag

válasz

Raymond

#50900

üzenetére

Raymond

#50900

üzenetére

Nem hát. AMD-n kellene nagyon komolyan leverni hogy a ZEN4 megjelenés óta nem sikerült az alaplapgyártókkal leegyeztetni ezeket a dolgokat(lapomhoz már 28 bios frissítés jött ki megjelenés óta, vicc, komolyan azt gondolják gyártók hogy majd 30x lefogom frissíteni a biost??), és a mai napig döglenek meg emiatt processzorok, meg hogy reklámozzák a felesleges 6000MHz-es EXPO tuningjukat, feleslegesen drága ramkiteket megvásároltatva az emberekkel, minimális teljesítmény plusz-ért. Legjobb esetben is +5% teljesítményt hoz 1080p-n, olyan áron hogy 17W-t elfűt a SOC.

Viszont a single core boost miatt túlfeszelt, és hibázó Intel processzorok meg a tesztelők/Intel miatt van, ennyire prioritást kapott tesztekben a single core 6GHz+ órajel boost. Gondolom meg lett mondva nekik hogy így kell tesztelni mert tudták hogy a userek ettől fognak elájulni.

Engem az energiahatékony rendszerek sokkal jobban érdekelnek már, kipróbálnák egy Ryzen Ai MAX+-t, kár hogy nincs kis méretű alaplapos verzió belőle és horror ára van.

-

X2N

őstag

válasz

bozont

#50898

üzenetére

bozont

#50898

üzenetére

Nem értem, akkor a gyári ajánlott memória beállításokat használják, azaz 5600MHz-en ugyanazokkal az időzítésekkel mérjenek. Vagy akkor legyen rendesen belőve a ram ahogy kell, 6000-re normális időzítésekkel hogy a latency is legalább ~55ns legyen, ez egyáltalán nem elérhetetlen, nekem még egy 5600/CL40-es 96GB-os kitet is sikerült erre a szintre felhúzni, pedig nem volt csoda die, ne ilyen félmegoldásokkal operáljanak, mert 1080p méréseket eléggé fogja torzítani és azt fogják főleg nézni a gamerek. Proci teszteknél ez nem elhanyagolható. Sanszos hogy megint ezét döglenek az X3D-k mert a userek többsége csak megveszi a ramot, és EXPO-val használlja kitudja mikori bios-al ami túlfeszeli a vsoc-ot.

-

X2N

őstag

válasz

KAMELOT

#50893

üzenetére

KAMELOT

#50893

üzenetére

Techpowerupnál néztem most az újabb ryzen proci teszteket, és rendre a ramokat csak a gyári expo-beállításra állítják be, ezekkel tesztelnek:

9950X review:

2x 16 GB DDR5-6000

36-36-36-76

Infinity Fabric @ 2000 MHz

9950X3D review:

2x 16 GB DDR5-6000

28-36-36-76

Infinity Fabric @ 2000 MHz

Aki arra nem képes hogy 16 magos csúcs processzor tesztnél beállítson egy normálisabb időzítést ezeknek a ramoknak pár másodlagos időzítés beállításával,, csak bekapcsolja az EXPO-t bios-ban és ezzel ki is merült a beállítás, az inkább ne is készítsen teszteket. CL36,28-as időzítéssel 67,77ns késleltetés

Tuning rész is kimerül abban mi a maximális órajel cpu-ramokon, semmi optimalizálás. -

X2N

őstag

Elég nagy baj hogy már játékok ilyet igényelnek, és a felhasználók önként és dalolva hagyják is ezt ahogy a mindenféle anti cheat futtatását is a gépükön.

O&O meg addig jó amíg a ms nem módosít valamit minden egyes update-nél. Az se open source, szóval nen tudhatod hogy mit is csinál pontosan a gépeddel, de azért futtasd csak bátran. Gondolom Defendert használsz még, vagy már azt is lekapcsoltad ahogy Steve? -

-

X2N

őstag

Legjobb win a 7-es volt, azóta csak lejtmenet van microslopnál. Semmi olyat nem tud a win11 ami miatt kellene, sőt inkább megkötés mert csomó régebbi hadverre fel se lehet rakni. Persze ez is megkerülhető aztán nem kapsz majd frissítéseket. Ahogy a helyi fiókos buli se fog sokáig tartani.

-

X2N

őstag

Most tart ott a win11 ahol eredetileg lennie kellett volna. 23H-hez képest a 24H2-es update-hozott ~+10% fpst-t. Újabb játékok már gyorsabban futnak 11-en 4-5%-al, ebben sincs semmi meglepő, már egy ideje erre optimalizálják NV-nél a drivereket. Mivel újabb játékokkal teszteltek így pozitív lett az eredmény a win11-fele, régebbi címeknél semmi előnye nincs

![;]](//cdn.rios.hu/dl/s/v1.gif) 9070 XT-vel is meg kellett volna nézni hogy ott is hoz-e valami pluszt a 11 érdekességképpen, illetve nem azzal kezdeni a tesztet hogy rögtön letörölni a Defendert

9070 XT-vel is meg kellett volna nézni hogy ott is hoz-e valami pluszt a 11 érdekességképpen, illetve nem azzal kezdeni a tesztet hogy rögtön letörölni a Defendert  , meg disabledelni a Security mitigations-okat mert az továbbra sem átlag user case. Hadd fusson a coopilot is közben.

, meg disabledelni a Security mitigations-okat mert az továbbra sem átlag user case. Hadd fusson a coopilot is közben. ![;]](//cdn.rios.hu/dl/s/v1.gif)

-

X2N

őstag

Alig várom. Így fog kinézni, Vex csinált már róla videót. 360p->4K

-

X2N

őstag

válasz

Busterftw

#50805

üzenetére

Busterftw

#50805

üzenetére

Akinek RT kell és van rá keret az vegyen zöld kártyát, 5070Ti alá ne is adja ha gamingre kell csak. Itt is látszik fentebb a blender tesztnél hogy nem lehet velük versenyezni, annyira jó az OptiX. Ha pénzt keresel vele, és nem csak hobbizol, nem kérdés egy 5090 a 32GB vramal.

Az RT mindig is a jövő volt, a 70-es évek óta az.

De csak játékra szerintem luxus 5070Ti-nél drágább kártyát venni tőlük.

Az RT-t játékokban én csak érdekesség szempontjából szoktam bekapcsolni, megnézegetni, nem mondtam soha hogy ne lenne értelme csak még nem most. Contol-nál is elképesztően jól nézett ki, és tetszett hogy külön be lehet kapcsolni a tükröződéseket/árnyékokat is, így ilyen részleges RT-vel játszottam végig többször is. AMD-nek is fontos lett az RT mert ciki hogy ennyire le vannak maradva. Ahogy a felskálázás is, én a helyükbe valami saját technológiát fejlesztenék és nem foglalkoznák se a felskálázással, vagy a frame gen-el.

Mondjuk csinálhatnának jobb fizikát/folyadék szimulációt, AI-t játékokba, mi mást lehetne még? Lehetne RT-vel a hangokat szimulálni... Az is hozzátesz az élményhez nem csak a grafika...

Az is hozzátesz az élményhez nem csak a grafika... -

X2N

őstag

Amennyit tud. Ez igazából a probléma, nem a kártya RT teljesítménye.

4-k-s PBR textúrákkal, 8-16K-s HDRI environment mappal azért legyen legaláb 16GB vramod a kártyán, azzal már van esélyed hogy nem fut ki belőle. Vannak olyan pár száz MB-os blender file-ok aminél egy tigris/gepárd modell van csak, de a szőre az fibermesh hair, 24GB már arra is kevés. Amikor már több karakter van hajjal mindennel arra már 32GB memória is kevés, procira kifogja rakni a rendert.

4-k-s PBR textúrákkal, 8-16K-s HDRI environment mappal azért legyen legaláb 16GB vramod a kártyán, azzal már van esélyed hogy nem fut ki belőle. Vannak olyan pár száz MB-os blender file-ok aminél egy tigris/gepárd modell van csak, de a szőre az fibermesh hair, 24GB már arra is kevés. Amikor már több karakter van hajjal mindennel arra már 32GB memória is kevés, procira kifogja rakni a rendert. -

X2N

őstag

válasz

T.Peter

#50798

üzenetére

T.Peter

#50798

üzenetére

"nem csokkenti jatekfejlesztesre az alkalmassagat."

Ez kérdéses, még több dologgal kell az Epic-nek-foglalkoznia, ami nem a game engine rész lesz, több játékfejlesztő stúdiót is kell támogatnia mert mindenki ráállt az UE5-re, így kevesebb idejük marad a saját engine-jüket fejleszteni, plusz ott a Fortnite is amiből ezt az egészet finanszírozni lehetett.Persze hogy jobb az új pipeline mint a régi, de nem úgy érzem hogy az 5.0-ás UE-t az EPIC úgy adta ki ahogy az marketingelték. Kellett már a PBR, a Globan ilumination, lumen/nanite. Az RT még ráért volna.

A felskálázásnak semmi értelme nincs asztali pc-ken.

Csak ront a képminőségen, felesleges az egész ahogy van. Lejjebb kell venni a grafikai beállításokat, vagy új hardvert venni, be lehet állítani minden játékot, tovább is lehet optimalizálni modokkal, ez nem konzol.

Egyedül a handheld konzolok-on van értelme meg mobilos kijelzőkön, ahol nicns teljesítmény se még egy azstali vga-hoz képest se, meg amúgy sem számít a minőség, mert a taknyos, összetapicskolt kijelzőt nézed, ott tényleg fel se tűnik, de nekem 4k monitoron, ami 4x részletesebb képet ad mint amivel jelenleg is az átlag gamer rendelkezik nem kicsit zavaró

-

X2N

őstag

Persze, egyébként használom renderelésre is blenderben. Úgy vettem észre hogy ott ez a +30%-al gyorsabb igazából nem jelent semmit sebességbe, így is villámgyorsan renderel a 16 magos processzorhoz képest, be kell tenni még egy 7900XTX-et a gépbe az közelítőleg felezi a renderelési időt.

Ma 1db 5090 hozza azt renderelésben amit régen ~4db 2080Ti, az már jelentős előrelépésnek tűnik, addig amíg meg nem nézed a fogyasztást.

Ma 1db 5090 hozza azt renderelésben amit régen ~4db 2080Ti, az már jelentős előrelépésnek tűnik, addig amíg meg nem nézed a fogyasztást.Múlkor láttam, ne öljetek meg érte

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

X2N

őstag

Ezt mindenki tudja hogy gyorsabb RT-ben ezen mit kell magyarázni??? ~3 évvel újabb kártya aminél már ez is szempont volt mert le vannak maradva mint a borravaló, mit vártál? Raszterben meg elmarad, és a játékok többsége nem RT-s. Nem azért a pár RT-s jövőbeli címért vettem én se 3+ éve.

Sose vettél volna ilyen kártyát, hát bocs én meg 3+-éve minden maximális beállítások mellett játszok 4K felbontásban, akkor ez volt megvásárolható, ha nem akartál leégő csatis 4090-et 2x-es áron.A 16GB VRAM meg nem lesz gond egészen addig amíg el nem kezded moddolni a játékot, főleg ha alapból natív 4k felbontáson játszol. Mert akkor már kevés lesz. Úgyhogy ne próbáld meg úgy beállítani hogy milyen jó az a kártya, mert nem jobb. Felbontásra választasz kártyát, és nem csak 2-3 évre.

-

X2N

őstag

válasz

T.Peter

#50790

üzenetére

T.Peter

#50790

üzenetére

Részleges, butított RT-t maximum 1080p felbontással, nem egy nagy élmény ha 55-65"-ös TV-re felskálázol egy ilyet.

Nem úgy látom hogy az UE5 már elsődlegesen játékfejlesztőknek szól. Az előző 4-es verzió még igen, az 5-ös már "minden másra is jó" játékfejlesztésen kívül.

Ezt óriási grafikai ugrást én egyenlőre nem látom, csak az optimalizálatlan AAA címek tömkelegét, meg az UE techdemókat amiknek a szintjét még ma se sikerült megközelíteni(még az UE 4-es techdemókét se) az átlag játékfejlesztőnek.

Az upscaler-ről annyit hogy én nem használok ilyet, ahogy TAA-t se 4K 24"-es monitorom van nem is kell AA, natívon minden gyönyörűen néz ki. -

X2N

őstag

Ezt így nem lehet kijelenteni, és jó lenne ha a gyári stock 9070XT-t hasonlítanád a gyári 7900XTX-hez, nem a mostanában megjelent húzott változatokat, a stock 7900XTX-hez ahogy a legtöbb tesztben. Van a 2 kártya között egy jó 10-12% különbség teljesítményben, vagy még több is attól függően melyik verziót hasonlítod.

-

X2N

őstag

Szerintem nem az a lényeg hogy érdekli-e vagy nem a Radeon tulajdonosokat az RT-hanem hogy amíg kimerül abban az RT hogy alapkövetelmény hozzá a felskálázás(DLSS/FSR) és a Frame Gen, valamint csúcskártya kell még az 1080p natívban értelmes fps-el futtatásához frame gen nélkül, addig nincs miről beszélni, kevesek hozzá a kártyák és nem éri meg vele foglalkozni se, még jó ~10 évig, mert a felhasználók elenyésző %-a tudja jelenleg is kihasználni. Az agyon butított RT sem egy nagy élmény, ahol nincs igazán kihasználva az hogy minden fény/árnyék/tükröződés dinamikus lehet, a korábbi statikus, bakelt megvilágításhoz képest. Path tracingről ne is essen szó, az továbbra is irreleváns amennyivel több teljesítmény igénye van, nem realisztikus célkitűzés jelenleg, se 10 év múlva ezekkel a videókoránya teljesítményekkel, meg a 2-3 évente +25% teljesítménnyel az hogy majd PT-el realtime 3D grafikát fogunk futtatni.

Közben meg raszterizációval, Horizon Forbidden West, Senua's Saga: Hellblade II, játékok készülnek a hagyományos global illumination-al amik büntetősen néznek ki, mindössze azért mert nagyon részletes modellek/textúrák vannak, jól bevilágítva. Amíg ilyen limitációk is vannak hogy nem tudunk részletes modelleket/textúrákat kipakolni a képernyőre, mert még Nanite sem tud mindent, pl. vegetációt(csak a mostani újabb 5.x verzióban már) megjeleníteni így addig az RT ne legyen már prioritás. Persze az NV-nek prioritás, meg kell teremteni az eddig nem létező igényt, még akkor is ha ez nem realisztkus célkitűzés, hogy eladhassák a kártyáikat valami újabb feature-el, lásd AI.

Az pedig nem előrelépés azoknak akik régebbi kártyákon vannak, hogy majd bekapcsolhatják a DLSS-t hogy értelmes fps-ekkel tudják futtatni a legújabb optimalizálatlan címeket még rosszabb képminőséggel, kép artifactokkal, mert letolták a fejlesztők torkán is az RT-t, ami egy jelenleg nem kiforrott technológia.

Ebből az egészből a "nyertesek" igazából csak a filmesek akik kaptak egy UE5-t amiben lehet már Path Tracelni is meg LED falakkal-virtuális kamerát mozgatva videózni, ezzel jelentősen közelebb hozza a valós idejű munkát a moziminőségű látványhoz, gyorsítja ezzel a gyártási folyamatot.

-

X2N

őstag

válasz

Busterftw

#50773

üzenetére

Busterftw

#50773

üzenetére

Az az érdekes hogy múltkor is találtam olyan játékot(CS:GO) ami a Techpowerup teszt szerint ilyen 300-360 fps-el ment volna a hardveremen 4K felbontásban, erre nálam 450-500fps is simán megvolt. Ugyanazokkal a beállításokkal, ugyanazzal a pályán, tettem is fel róla képet. Nagyon nem mindegy pl. hány botot teszel be, cpu limites játék. Ha nem ebben a topikban akkor a Radeonos találgatósban. Érdemes lecsekkolni, mert lehetnek eltérések, nem is kevesek, persze ehhez kell egy olyan vga ami ezeket az fps-eket még 4k-n is tudja. Szerepelhetnek rossz mérések is tesztekben, amik eltérhetnek még az előző tesztben mértekhez képest is, meg nem árt ismerni a játékot is, hol milyen teljesítményt tud, ezért nehéz is lehet reprodukálni a teszteket, legyetek résen

-

X2N

őstag

Persze hogy nem vagyunk előrébb, ha nem realisztikus a tesztkörnyezet se amiben mérnek. Akkor mi értelme van az egész mérésnek? Én is lekapcsolhatom a tűzfalat, meg a defendert meg a biztonsági patcheket ahogy Steve, meg minden mást is amit tudok még ebben a rendszerben is, de nem ezt kellene lemérni hanem hogy mindenféle mókolás nélkül mit tud a rendszer.

-

X2N

őstag

-

X2N

őstag

FPS-t limitál, így jóval kisebb az eltérés a mért eredmények közöt ami csalóka is lehet. Azt se felejtsük el hogy ezek friss telepítések, nem 1-2 éve futó rendszerek.

"Ezt sem értem, hogy mi különbség van 1,6GB memória és 1GB memória használat között, ha van bőven memória, mondjuk 32GB. Ugyanolyan kényelmesen és zavartalanul elfér."

Szeretem a bloat mentes oprendszereket, már futottam ki többször is 32GB ramból, még ezzel az optimalizált rendszerrel is, akkor upgradeltem 96GB-ra, nekem ne fusson semmi felesleges a háttérben ami nem kell. még ha csak +500MB, akkor se.

Linuxon a KDE Plasma el van 800MB-al, az baráti. -

X2N

őstag

Még mindig limitál a 9070, nem győzöm hangsúlyozni, a játék összeállítás is elég rossz, multis címek->kapásból kuka.

Ez a Nano11 mit tud a gyári win11 hely képest? Feladatkezelőben mennyi a memória használat, mennyi a cpu-nál a processes? Még Defender sincs ebben a nano11-ben? Az viszont gáz.

Szerk:Na most néztem, nano11, ~106 process, 1.6GB memória, az még mindig sok.

Nálam ReviOS win10-nél ~73 process és még ennél is kevesebb ram használat van. -

X2N

őstag

Mert a felskálázás se tud annyi részletet visszahozni hogy ne legyen mosott a kép így inkább túlélesítik.

A natív felbontás, AA nélkül, retina kijelzővel, az tuti. Nincsenek kép anomáliák. Csak brutál részletes kép.

FLATRONW-En csak azt remélem hogy lesz 8K oled monitor 27-32"-es méretben és majd egyszer eljutunk arra a pontra hogy ezt legalább 144fps-el meg is lehet hajtani mindenféle dlss, AA-nélkül.

-

X2N

őstag

Apa kezdődik.

RTX 5090 Saved From Connector Melting With ASRock’s $40 Cable Despite Pulling 1350WShunt-moddolt MSI RTX 5090 Ventus-on ment 20 kör benchmark és már elkezdett leégni a csatlakozó amit itt sikernek állítanak be

-

X2N

őstag

válasz

Kolbi_30

#50544

üzenetére

Kolbi_30

#50544

üzenetére

Steve-ék csináltak egy 2025-ös évértékelőt/összefoglalót, volt itt minden, hiányzó ropok a leégő csatlakozós nvidia kártyákon, MSRP ártól 20-45%-al drágább Radeon 9000-es kártyák launchkor, nem működö nvidia physx az 50-es kártyákon, meg driver bugok tömkelege mert már az AI írja a drivert az nvidiánál, maga Jensen mondta

Asrockba beleégett ryzenek, tarifák, Asus botnet routerek, Intel leépítés...

Ha az a cél h tönkretegyék a DIY pc piacot jó irányba haladunk. -

X2N

őstag

válasz

T.Peter

#50539

üzenetére

T.Peter

#50539

üzenetére

Tippre nem sok újrahasznosított van. 1-1 komolyabb fegyver modell csak magában 10-15GB-is lehet tömörítés nélkül(új COD-ban pl.)

proci985-Komolyabb szimulátorhoz(Assetto,DCS,Arma) jól jön a 16 mag, nálam 5GHz-en megy, az a sweet spot jó fogyasztással(120W) alulfeszelve (1.15V).

Anno elég komolyan megtuningoltam a 96GB ramot is, de inkább visszatettem gyárira, jobb a békesség. -

X2N

őstag

válasz

T.Peter

#50534

üzenetére

T.Peter

#50534

üzenetére

Már h ne lenne, "a legnagyobb reszet a vram-nak mindig a texturak foglaljak el,"

Meg a helyet is a háttértárolón. Már ha tényleg jó minőségű textúrákról van szó.

Megmutassam a 150GB-os mappámat amiben a 3D rendereléshez vannak modelleim meg textúrák? (most néztem, a 150GB az csak a textúra, +70GB a modell

(most néztem, a 150GB az csak a textúra, +70GB a modell  )

)Persze amikor játékban rá van tolva az antialiasing maximális teljesítménnyel, meg megy a felskálázás akkor adsz a képminőségnek egy jó nagy pofont.

-

X2N

őstag

Amikor megjelent leszedtem, meg felnéztem nexus-ra UE5 konfig file-okért amivel kimaxoltam a grafikát a gyárihoz képest is sokkal jobban nézett ki, messzebbre rajzolta ki a vegetációt, árnyékokat, meg részletesebb volt minden, stb, nem ájultam el még így se tőle, szokásos TAA mosoda, 2-3 óra bőven elég volt belőle hogy mindent kiderítsek ami érdekelt, ez nem stalker, ez egy far cry, stalker skinnel. Nem érte meg akkor a teljes árát így nem vettem meg még. Nézted benne a fákat? Azok nem fák, csak kis termetű fák. Nevetségesen néznek ki, túl kicsik, ráadásul az egész világ fel van nagyítva méretbe...

-

X2N

őstag

55 GB, az elég baráti manapság. TPS-játék, nem kellenek bele nagy felbontású textúrák mint egy FSP-nél, a kamera miatt. Megúszós.

A stalker 2-t tudtam h fel fogod hozni

, arról inkább ne is beszéljünk nem használja ki a nanite-ot a vegetációra, majd ha eléri a 2.0 verziót és az újabb verziós UE-n fut meg az AI life 2.0 benne lesz ahogy megigérték majd ránézek.

, arról inkább ne is beszéljünk nem használja ki a nanite-ot a vegetációra, majd ha eléri a 2.0 verziót és az újabb verziós UE-n fut meg az AI life 2.0 benne lesz ahogy megigérték majd ránézek. -

X2N

őstag

Egyébként ha 4k felbontást nézem akkor még mindig van 10% különbség teljesítménybe a 2 kártya között raszterbe.

Ez az állításod az UE5-el addig lesz igaz amíg nem lesz egy igazán komoly open world játék, mert messzemenő következtetéseket én nem vonnék le a jelenlegi cső játák címekből.

Itt is 13.5GB a vram használat, moddolt CP2077-szeret 20GB felett foglalni, és már készül a CP2077-Chicago UE5-re.![;]](//cdn.rios.hu/dl/s/v1.gif)

-

X2N

őstag

Ha a procikat megnézem akkor a 7800X3D-449$ MSRP-vel jött ki 2023-áprilisban. 330$ körül meg lehetett venni 2024-ben, majd felment az ára 450$-ig 1 évvel később, most se sokkal olcsóbb, 400$.

9800X3D már $479-al nyitott, 2025-ben 470$ csak néha esett be az ára 440-usd-re.

Középkategóriás kártyát(9070XT) ne hasonlítsunk már 7900XTX-hez, nem ugyanaz a kategória. 3 évvel később a generációváltáskor olcsóbb a 9070XT?

Erről szól a fejlesztés. Előző gen csúcsa teljesítményét hozza már az új generációs kártya azon az árszinten. -

X2N

őstag

válasz

Yutani

#50523

üzenetére

Yutani

#50523

üzenetére

Meg nem is omlott össze az a piac amit annyira vártunk a bánya után, nem lett semmi se jelentősen olcsóbb. Az új kártyák(meg a 9000-es X3D proci is) meg már emelt áron jöttek ki még kevesebb teljesítménnyel még több haszontalan feature-el(fake AI frame gen).

Ha a következő generáció is ilyen 20-25% teljesítmény növekedést tud majd felmutatni még több fogyasztással és erre majd valaki azt mondja hogy ez jó generáció lett én kiröhögöm. -

X2N

őstag

válasz

Alogonomus

#50521

üzenetére

Alogonomus

#50521

üzenetére

Mert nem ment fel az ára mocskosul a 3D prociknak?

-

X2N

őstag

válasz

S_x96x_S

#50514

üzenetére

S_x96x_S

#50514

üzenetére

Még nem próbáltam csak a sima Arch-t meg az EndeavourOS-t, számomra inkább az a kérdés hogy mennyire lehet stabilan üzemeltetni hosszútávon, mivel ez is Arch alapú, így ha váltok akkor nem biztos hogy rolling disztró lesz a daily driver. Ha nem muszáj nem szívatom feleslegesen magam.

Videó alapján a CachyOS(nem tudtam hogy ennek az előde egy Intel által fejlesztett Clearlinux disztró volt amiben a sebességre mentek rá)-gyorsabb játékok alatt, de a Bazzite stabilabbban hoz jó teljesítményt -

X2N

őstag

válasz

Alogonomus

#50505

üzenetére

Alogonomus

#50505

üzenetére

Jelenlegi hardverpiaci kilátásokkal, ameddig nem lesznek jól működő MCM dizájnok HBM memóriával megfizethető áron(nem 500-600eFt-ért hanem olcsóbban), értelmes fogyasztással(nem 350W+)addig nem aggódok, el leszek ezzel a kártyával, amíg ezek nem lesznek jelentős ugrás teljesítménybe nem lesz. Szoftveres oldala is problémás lesz a chipletes gpu-knak. Azt is ki kell majd várni nem beszélve erről a win10-11-linux váltásról.

Az ami akkor volt a 1080Ti/2080Ti-vel nem fog lejátszódni újra, nem látok rá esélyt, 3 évvel ezelőtt se láttam, most se. Lassan terelnek mindenkit a cloudra ahol majd akkor emelik a havidíjat a duplájára amikor akarják, meg majd azt is megmondják naponta mennyit használhatod.

![;]](//cdn.rios.hu/dl/s/v1.gif) Fiatalabb generáció meg már nem pc-zik, össze se rak pc-t, ilyen árakon???

Fiatalabb generáció meg már nem pc-zik, össze se rak pc-t, ilyen árakon???Erős az 5090-de ha megnézed a 600W fogyasztást mellé már nem az igazi, engem ilyen kártyák már nem érdekelnek. Még undervoltolva is sokat fogyaszt, ~450W

250-350W az ideális egy erős vga-nak, a nagyobb teljesítmény már problémás. A komplett konzol(PS5) fogyaszt 250W-ot csúcsokba. -

X2N

őstag

A lényeg az hogy neked mi az elfogadható.

A gyártó sz@rik rá amíg nem akarják beperelni. Bírja ki a kártya a 3 évet aztán kalap/kabát.

Nekem nem ez az elképzelésem, én azt szeretném hogy addig legyen jó a kártya amíg teljesen el nem avul, ami az én esetemben 7-10 év lesz a 7900XTX-el. Ezért is vettem ezt csúcskarit 3 évvel ezelőtt megjelenéskor, 4K-ra kellett minél több VRAM-al. Ki akarom próbálni hogy a saját gépemben normális tárolási körülmények között meddig megy egy ilyen kártya úgy hogy nincs sag, mert az oldalára támaszkodik a kártya, normális használat mellett, évi 1x takarítással. Leégős NV kártyával nem volt kedvem kísérletezni, pedig egy 3090-4090 se lett volna rossz, de akkor az egy használt kártya lett volna ismeretlen előélettel.

-

X2N

őstag

Itthon nem biztos h népkártya az 5070 és afölötti nv ezért nem látod. A másik hogy ezek az emberek nem is használják ki igazából azokat a kártyákat. Annyi órát még nem tettek bele. Kevés olyan van aki egy 5090-est 16+ órákon keresztül használ 100%-on, vagy aki egész este renderel majd még napközbe is tolja a gépet. Azt viszont garantálni tudom hogy ha nekiállsz tuningolni egy 5090-est és tartósan 100%-ba terheled úgy hogy 600W- vagy felett fogyaszt nagy valószínűséggel már a garancia ideje alatt lesz égett csatlakozód.

Sok leégett csati van, Ha megnézed a külföldi vga javítós youtuber csatornákat doboz számra küldik nekik a leégett csatlakozós nv kártyákat.

Busterftw-Nézd ez így ide kevés lesz, ha minden gyártónál hullanának az RDNA2 kártyák akkor lenne probléma, de így h egy noname kínai gyártónál van csak egy minimál hibaszázalék ez akár az ő saruk is lehet, akár egy elrontott hűtés leszorító/rosszul megtervezett hűtés, gyenge pcb miatt is lehetnek ilyen problémák nem beszélve a rossz tárolásról. Ez kb annyira probléma ebben a mennyiségben h nem éri meg foglalkozni se a hiba feltárásával.

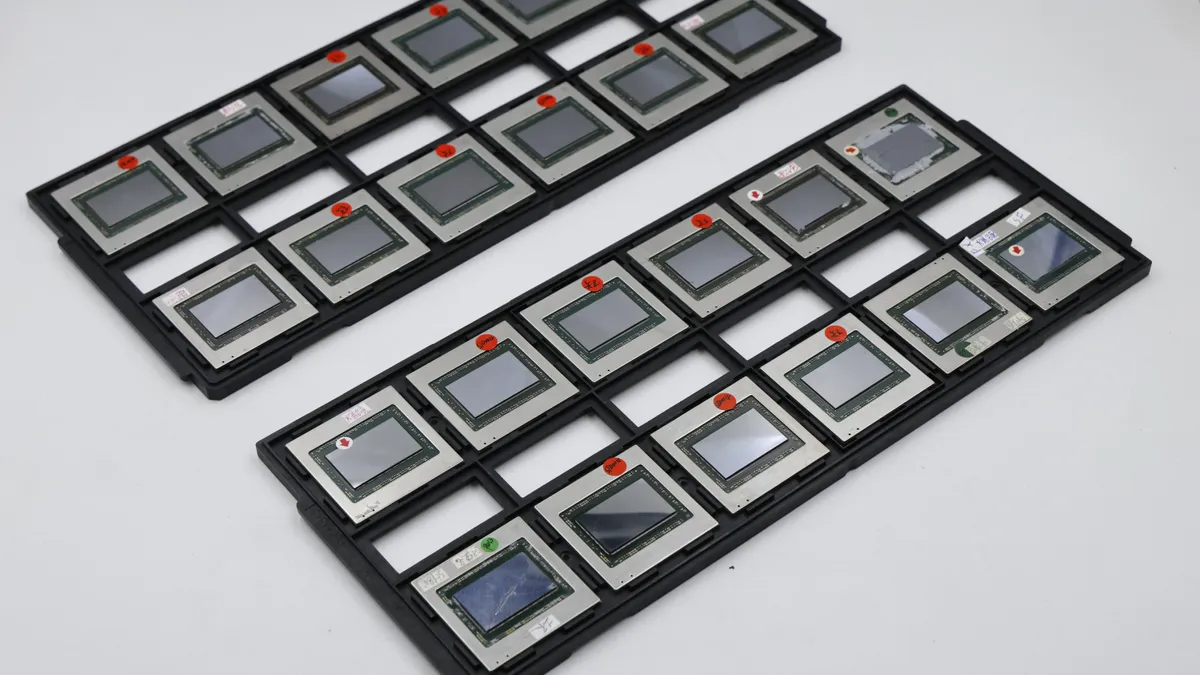

Ahogy az előző Ryzenes problémánál is érdekesnek tartom hogy csak 1 internetes kávézóban hibásodik meg a 150 processzorból a processzorok 10%-a...

Érdemes lenne utánanézni milyen lapokba lettek rakva ezek a processzorok és milyen feszültségekkel üzemelnek. Az a sanda gyanúm hogy a túl magas VSOC feszültség nyírja a procikat, ahogy megjelenéskor is előszeretettel állítgattak be 1.3-1.4V-okat. Majd amikor ment a balhé akkor ezt bios frissítés után 1.3V-ban maximalizálták(elméletben). Manapság 1.2V-al szoktak ezek menni de én nem vagyok róla meggyőződve hogy az X3D-k ennyire bírják ezeket a feszültségeket, a simák lehet jobban bírták, az X3D-lehet háklisabb. -

X2N

őstag

válasz

Yutani

#50493

üzenetére

Yutani

#50493

üzenetére

Úgy hogy a csatlakozóval van a probléma.

A kártyán nincs semmi féle load balancing ugyanis csatlakozónál a pcb-n ha megnézed a vezetősávokat közösítve van a 6-6 érintkező:

A kártyán nincs semmi féle load balancing ugyanis csatlakozónál a pcb-n ha megnézed a vezetősávokat közösítve van a 6-6 érintkező:

Balancing nincsen egyik kártyán se, monitorozás volt a régebbi 3000-es NV kártyákon ahol 2 érpáronként mérő sönt ellenállásokkal monitorozta a teljesítmény felvételt a csatlakozóról a kártya és ha túl lépett egy bizonyos szintet a kártya akkor nem power balanszolás volt(nem balanszol az égvilágon semmit a kártya a vezetéken ez nem áram generátor) hanem power limitálás történt a gpu magon a VRM által, limitálta a kártya a saját teljesítményfelvételét, órajel csökkentéssel együtt, ezért nem melegedett túl a csatlakozó, ezért nem lett rosszabb a hőtágulás miatt az érintkezés és szaladt meg a csatlakozón az áram a rosszabb érintkezés miatt. Az új kártyákon ilyen már nincsen.

Igazából erre az egész monitorozás részre nem is lenne semmi szükség ha egy normális csatlakozó lenne a kártyán. A régi csatlakozónál 8 pines csatlakozónként is van monitorozó rész a kártyákon még úgy is hogy túl van biztosítva 200%-osan a csatlakozó. -

X2N

őstag

"A 3000 széria nem volt ebben érintett ott ez jól működött."

Az hogy ez a széria működött attól még nem lesz jó ez a csatlakozó.

Attól h valami működik még nem biztos hogy jól meg is van tervezve.300-400W-os videokártyákat én nem szeretnék pc-kbe, 300W+ az rengeteg teljesítmény, ott már nem lehet bohóckodni a gyártóknak se.

Évek óta hullanak a Ryzenek, hol ASRockban, hol Asus-ban. Az a szerencséjük hogy nem annyi mint Intelnél a legutóbbi blamánál.

-

X2N

őstag

-

X2N

őstag

válasz

Raymond

#50482

üzenetére

Raymond

#50482

üzenetére

Csak más az amikor részben nyílt a drivered, nem full proprietary. Ha lehet feleslegesen nem nehezítik meg jobb a fejlesztők munkáját. Nem csak a Valve miatt van, GloriousEggroll is fejleszti már egy ideje a Proton-GE, Nobara Project-et, ő se keveset tett hozzá, ahogy a közösség is.

-

X2N

őstag

válasz

Alogonomus

#50480

üzenetére

Alogonomus

#50480

üzenetére

De ha valakinek a szoba dísze a pc akkor mért kell hogy nagy teljesítményű is legyen? Nem lenne jobb egy közepes teljesítményű pici ablakos pc mindenféle csili-vili kijelzővel rgb-s aio-val teljesen hangtalan működéssel? Asztalon is jobban elfér egy ilyen gép.

Én biztos hülyét kapnák ha az asztalon mellettem ott tekerne 12+ ventillátor, meg perifériás látásomba tolná az rgb-t. Nekem egy teljesen zárt rack doboz a pc-m. Semmi fancy nincs benne, nem érdekel a kinézet. Nagy, csak léghűtés van benne a megbízhatóság miatt, most a padlón van feltett oldallappal az asztal mögött. Nincs GPU SAG, meg PCB repedés a PCI csatlakozónál...

Nekem egy teljesen zárt rack doboz a pc-m. Semmi fancy nincs benne, nem érdekel a kinézet. Nagy, csak léghűtés van benne a megbízhatóság miatt, most a padlón van feltett oldallappal az asztal mögött. Nincs GPU SAG, meg PCB repedés a PCI csatlakozónál...Általában a nagy teljesítmény és megbízhatóság az nem jön együtt a csili-vili kinézettel, halk üzemmel, főleg kis-közepes méretbe.

-

X2N

őstag

-

X2N

őstag

válasz

Alogonomus

#50473

üzenetére

Alogonomus

#50473

üzenetére

Hogyne lehetne. 1/3-ad árba van az új csatlakozó a régihez képest.

Fel lehet hozni azt is hogy fizikailag kevesebb helyet foglal a csatlakozó pcb-n de ez már nevetséges kifogás, ahol plusz 2 cm2 pcb sokba kerül(főleg úgy hogy akkora kártyákat gyártanak hogy alig fér be a házba) ott már problémák vannak.

Úgy tudom nem minden kártyájuk ilyen csatlakozós a Sapphire és Asrock-nak így nem volt kötelező ezt a típust választani.

-

X2N

őstag

Gondolom ő is rosszul dugta be.

9 hónapig bírta 600W-ra tervezett csatlakozó a 350W-os kártyával. Csodálatos.

9 hónapig bírta 600W-ra tervezett csatlakozó a 350W-os kártyával. Csodálatos. -

X2N

őstag

-

X2N

őstag

-

X2N

őstag

válasz

proci985

#50446

üzenetére

proci985

#50446

üzenetére

Mindenhol ez van nem csak a programozóknál, játékfejlesztőknél is ugyanez zajlik, a veterán fejlesztők már rég nyugdíjba mentek így nincs aki egy normális játékot letegyen az asztalra évek óta. Az az időszak amiben én felnőttem 1995-2015-ös évek a pc gaming aranykora volt...

-

X2N

őstag

válasz

S_x96x_S

#50441

üzenetére

S_x96x_S

#50441

üzenetére

Mekkora szemétség már hogy 330-360eFt-os kártyát kell venned ha kell 16GB memória, mert a 70-esre nem fért fel 24GB, a 4080-ra meg 32GB. Titan nincs is, pedig az 5090-nek annak kellett volna lennie ECC ramokkal meg a hozzá való driverekkel.

Ezekkel a memória menyiségekkel oké lenne az árazása de így ahogy kiadták nem. De el lett csúsztatva az egész termékpaletta már az előző szériában is, nem érdekli őket már a DIY PC piac, steam statisztika(nem volt soha releváns a valve szerint se) szerint minden rendben van.

Már csak azért is radeont vettem mert ahogy vége lesz a win10-nek a linux support jobb lesz mint a proprietary nvidia driver-el. Persze én meg tudom ezt csinálni mert nem kell se VR meg CUDA

-

X2N

őstag

válasz

Busterftw

#50412

üzenetére

Busterftw

#50412

üzenetére

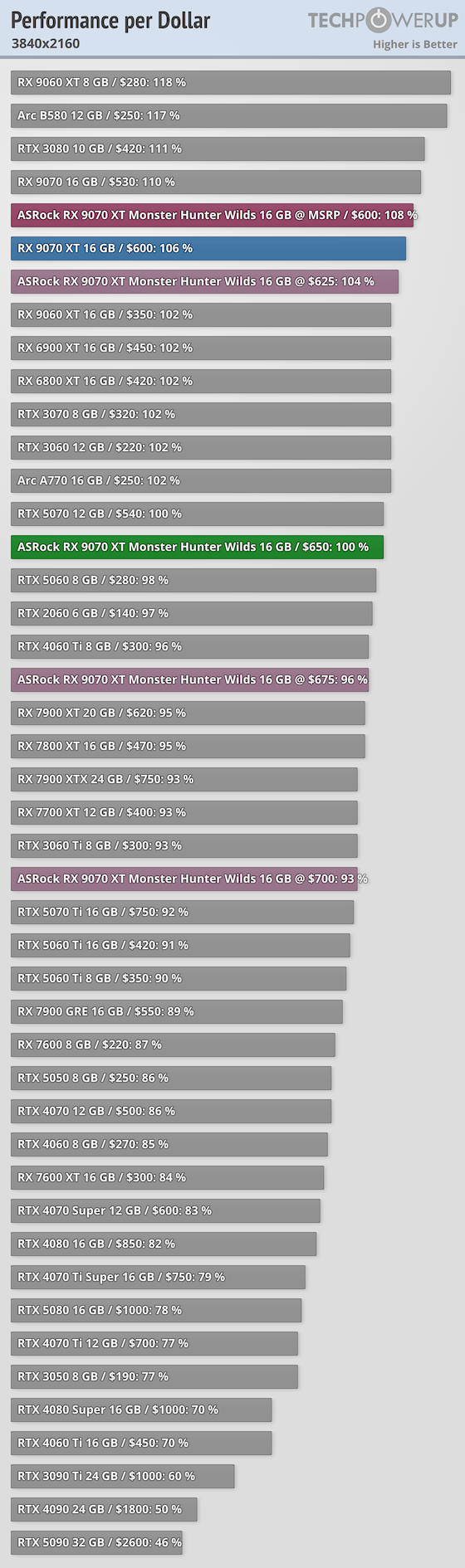

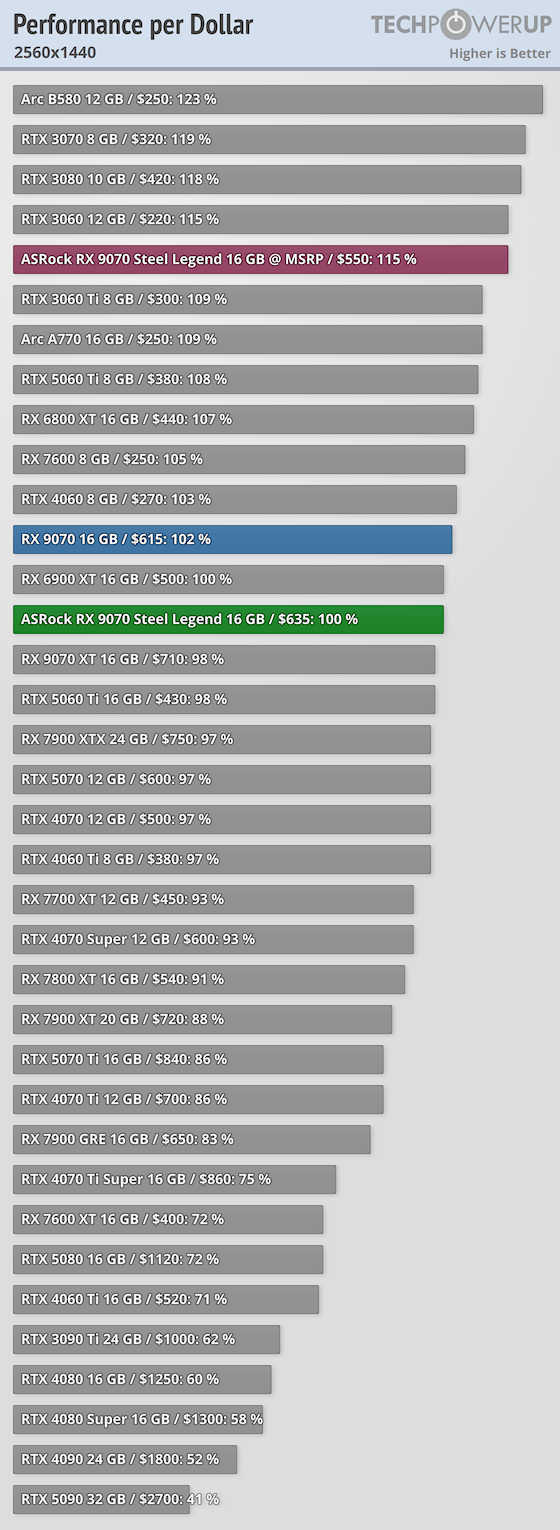

Pedig arról van szó, látszik hogy mi a best buy, 1080p-1440p-re a 9060XT, Arc B580-t érdemes venni, ha meg kell a plusz teljesítmény meg a 16GB VRAM hosszabb távra, vagy 4K felbontásra akkor 9070/9070XT, 50-es szériából egyedül csak az 5070 mondható közepesen jó ár értékűnek, egyébként még a régi 7900XTX-et is jobban megéri megvenni ami sokat elmond az új NV kártyák ár/értékéről....

b.-300k-ért itthon alig használt 5070Ti-t lehet venni azért nem értette Jacek hogy hol veszel ti itthon újonnan ennyiért Prime-ot. Itthon jobb hűtéssel 5070Ti-t ennyiért csak trükközéssel lehet venni.

-

X2N

őstag

válasz

Busterftw

#50394

üzenetére

Busterftw

#50394

üzenetére

Viszont a 9070 elég bestbuy, 16GB ram és erősebb is mint a B850, 9060XT.

1080p grafikont én már nem szoktam nézni(főleg vga választásnál) mert csalóka lehet a proci limit miatt.Plusz 9070-re fel lehet moddolni az XT vbios-t is még több teljesítményért.

Meg nem kell aggódni a leégős csatlakozó miatt se. -

X2N

őstag

válasz

huskydog17

#48680

üzenetére

huskydog17

#48680

üzenetére

Pontosan. Így menne sok játékban csak nincs kihasználva a nyers erő.

-

X2N

őstag

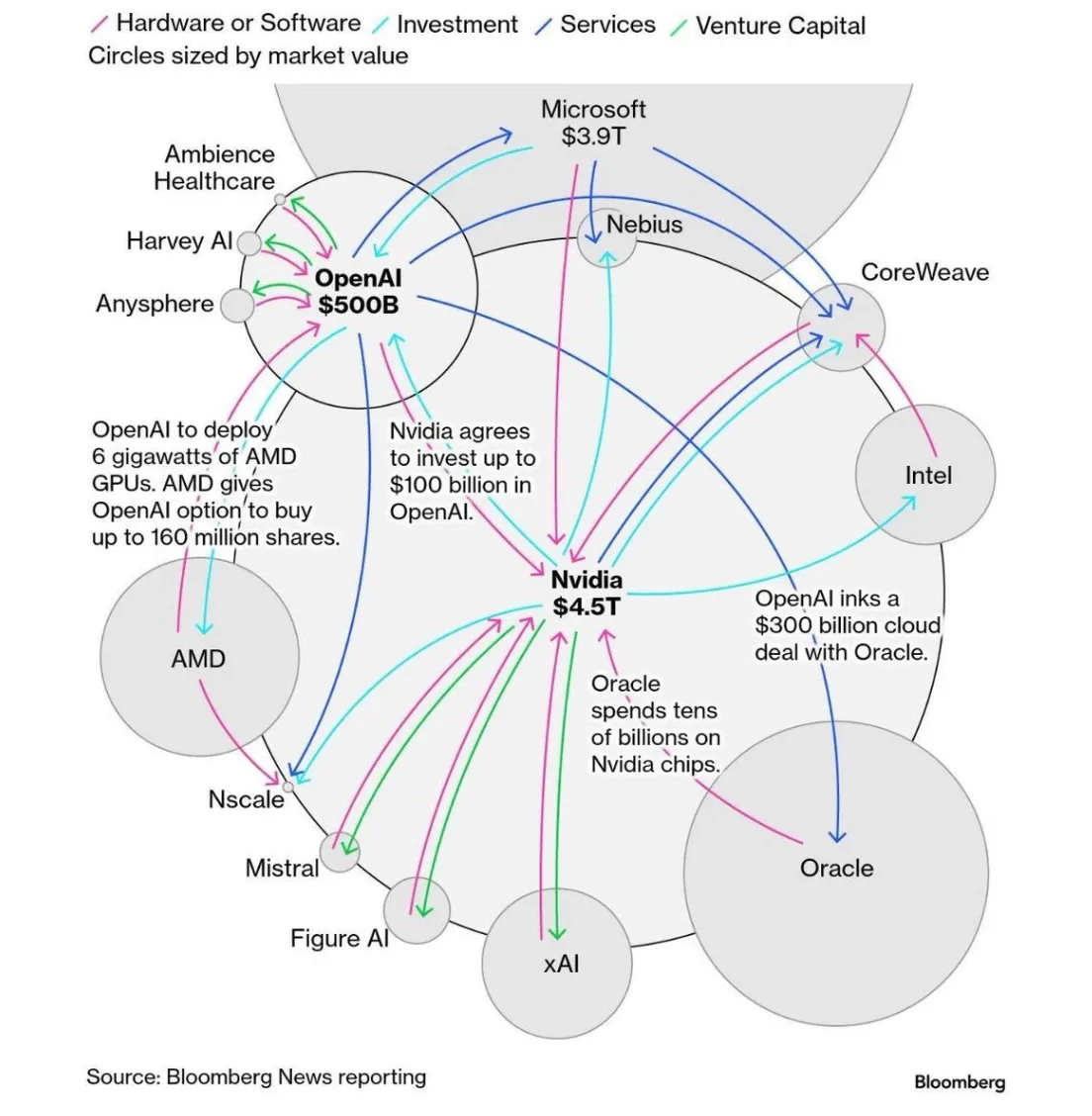

nVidia megvehetné az Intelt.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

X2N

őstag

válasz

huskydog17

#48342

üzenetére

huskydog17

#48342

üzenetére

Amit te "baromi jó és szépnek" tartasz az sajnos nem az, de ne nekem hidd el ezt hanem ha van lehetőséged nézz meg egy 27" 4K-s monitort a tiéd mellet, ezek gyakoribbak nem az olyan monitorok mint az enyém 24" 4K(nem volt ez se méregdrága monitor, 90eFt-ért vettem anno amikor még lehetett kapni hasonló fotós monitorokat). Ez ugyan csak 150-160PPi de 50%-al jobb így is. Ha erre sincs lehetőséged, akkor is nagyon egyszerűen tudom érzékeltetni a képminőségbeli különbséget, nyiss ki egy könyvet és tedd a monitorod mellé. A windows-ban kapcsold ki a betűkön az élsimítást, hasonlítsd össze mennyivel pixelesebb a monitorodon a betűk mint a könyvnél, utána állíts be 200%-os skálázást a kijelzőre windowsban, így már jóval kevésbé lesznek pixelesek a betűk. Na nálam így kell elképzelni a betűk kinézetét alapon...csak fele akkora méretben mint nálad 200%-on. Emiatt nálam 4x részletesebb a kép és nincs szükség se AA-ra se TAA-ra játékokban mert a szemem kevésbé látja már a pixeleket. De a mobiloddal is összehasonlíthatod a monitorod azok mind retina kijelzősek ha megnyitsz rajta egy natív felbontású képet nem látod a recéket rajta mert bőven 300ppi felett vagy 50-60cm nézési távolságból ügye?

Csak h még egy egyszerű példát mondjak, Assetto Corsa Competizione szimulátor, belső nézetből tolom 55" B9 oleden 4K tv-n, ha ezt kirakom a monitoromra ami 24" 4K az aszfalton látom a repedéseket, az aszfaltra festett csíkokat nem látom recésnek...a tv-n pixeles a kép még ha 3m-ről nézem is...

-

X2N

őstag

válasz

huskydog17

#48338

üzenetére

huskydog17

#48338

üzenetére

Ha kell küldök neked tömörítetlen PNG screenshotokat a játékból hogy néz ki, privátban.

-

X2N

őstag

válasz

huskydog17

#48338

üzenetére

huskydog17

#48338

üzenetére

Ez a "shimmering" egy nem létező dolog nagy PPI-s kijelzőn. Nincs semmi féle vibrálás, ha vibrálást látsz akkor nincs elég nagy pixelsűrűség. Ha elkezded butítani TAA-val a képet felejtsd el azt hogy mi a "natív felbontás", ha te 4K natív képre ráteszed a TAA-t akkor az annyira lerontja a képet mintha 1080p-n natívban játszanál TAA nélkül, a TAA mellé ráadásul masszív szelllemképes utánhúzást is kapsz, rendesen borzalmas nézni, teljesen értelmetlen így 4K+TAA-val játszani. Nagy felbontás kell, nagy PPI-vel kis kijelző mérettel, 300PPI vagy fölötte lenne az ideális(24" monitor 5K felbontás, vagy 32" 8K felbontás lehetőleg 120-144Hz-en oleddel hogy a pixel response tim is jó legyen...vagy újfajta fast ips panel-el). Nekem ~180PPI a monitor, kicsit látom a recéket de ez még vállalható kompromisszum. Az amit ti átlag userek használtok ~92PPI(1080p 24", 27" 1440p) egyszerűen borzalmas, arra tényleg kell minden amivel el tudod mosni a recéket...csak így meg felesleges a játékba low-nál feljebb venni a textúrákat mert nem látod amúgy se a 4k-s textúrák részletességét mert post processingel elmosod...

-

X2N

őstag

válasz

huskydog17

#48335

üzenetére

huskydog17

#48335

üzenetére

Nekem natívon mindenféle AA-nélkül tweakelt Engine.ini beállításokkal baromi jól néz ki a játék, ennél már csak akkor nézne ki ha hardware-es tükröződések árnyékok és GI lenne, esetleg Path Tracing mint a CP2077-ben csak akkor ugye nem menne még a 4090-esen sem...

Az viszont sajnálatos hogy a vegetáció nem Nanite-os, látszik a fákon nagyon sajnos hogy nem olyan jók amennyire lehetne. -

X2N

őstag

válasz

huskydog17

#48329

üzenetére

huskydog17

#48329

üzenetére

Nekem 7900XTX-el nem fogyaszt többet vramból 10GB-nál 4K natívon akkor én csinálok rosszul valamit és mégse rossz a radeonok memória kezelése?

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

X2N

őstag

válasz

huskydog17

#48314

üzenetére

huskydog17

#48314

üzenetére

Egy ilyen kaliberű játék szinte sose lesz kész, mindig lehetne javítani rajta valamit.

-

X2N

őstag

válasz

gainwardgs

#48303

üzenetére

gainwardgs

#48303

üzenetére

Jobb lett volna ha maradnak X-ray engine-en?

![;]](//cdn.rios.hu/dl/s/v1.gif)

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Arc Raiders

- Pedzegeti az új Xbox irányát a Microsoft

- gban: Ingyen kellene, de tegnapra

- Milyen billentyűzetet vegyek?

- Gumi és felni topik

- Sweet.tv - internetes TV

- Még a saját szövetségeseivel szemben is fegyverként használná az AI-t az USA

- Milyen belső merevlemezt vegyek?

- Home server / házi szerver építése

- Projektor topic

- További aktív témák...

- ÁRGARANCIA!Épített KomPhone Ryzen 5 7500F 32/64GB RAM RTX 5070 12GB GAMER PC termékbeszámítással

- Endgame Gear & Xtrfy gamer egerek /MZ1/OP1 8K/XM2we/XM1R/XM1 RGB (fehér/fekete/lila)/

- HIBÁTLAN iPhone 15 Pro 128GB Blue Titanium-1 ÉV GARANCIA - Kártyafüggetlen, MS4692, 92% AKKSI

- Apple iPhone 12 Mini 128 GB Fekete 1 év Garancia Beszámítás Házhozszállítás

- BESZÁMÍTÁS! ASRock B450M R5 3600 8GB DDR4 120GB SSD 1TB HDD GTX 1650 Super 4GB Zalman T3 Plus 400W

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

Nekem egy teljesen zárt rack doboz a pc-m. Semmi fancy nincs benne, nem

Nekem egy teljesen zárt rack doboz a pc-m. Semmi fancy nincs benne, nem