Új hozzászólás Aktív témák

-

Abu85

HÁZIGAZDA

válasz

Szatesz.

#1609

üzenetére

Szatesz.

#1609

üzenetére

Ne arra gondolj, hogy mi van most, hanem, hogy mi lesz. Lehet, hogy a TFLOPS-ok nem nagyobbak, de a hatékonyság az már más tészta. Főleg a shared memory teljesítmény, ami a DirectCompute terjedésével egyre nagyobb szerepet kap.

A Kepler tud például bindless textúrázást. A korábbi termékek nem tudnak ilyet. Az AMD GCN-je is tudja ezt, és még PRT-t is, ami hardveres megatextúrázáshoz nagyon jó. Emellett DX11.1-es megoldások az új generációs termékek. Szóval igen. Az új generáció ad extrákat is. Ezeket az elején nem használod, de a hatékonyság akkor is ott lesz.

Nem vetem meg a régi generációt, de ilyen árkategóriában egyértelműen új generációt kell nézni. -

Abu85

HÁZIGAZDA

válasz

Szatesz.

#1605

üzenetére

Szatesz.

#1605

üzenetére

Szerintem ne vegyél két GPU-s karit, amikor már nem számítanak csúcsnak. Vegyél új generációs architektúrát, ami belefér a pénzedbe. GPU-nként minimum legyen 2 GB memória.

Ha csak ez a kettő játszik, akkor a HD 6990 a gyorsabb, és a több memória is emellett van, de mondom többet ér az új generáció, mint a két GPU. -

Abu85

HÁZIGAZDA

válasz

ricshard444

#1592

üzenetére

ricshard444

#1592

üzenetére

Attól függ, hogy a Full HD-hez MSAA is társul-e. Ha igen, akkor nem egy olyan játék lesz, ahol kevés. Ez persze nem jelent rögtön töredék fps-t, de kevesebb lesz, mint lehetne.

2 monitorhoz nem kell átalakító. Háromhoz kell.

A GTX 590 tuningja speciális. Úgy lehet, hogy ne emeld a feszültséget. Ha emeled, akkor csökkenni fog a teljesítmény. [link] - Nagyjából ilyen a helyzet.A VRAM szempontjából a Frostbite 2 motorra épülő játékok lesznek a problémások manapság. Ennek van olyan Deferred Renderje, mely a tempón úgy gyorsít, hogy két pofára eszi a VRAM-ot. De ez is csak akkor jelentős, amikor a Deferred AA aktív. Ezért van amúgy csak 2x és 4x beállítás a BF3-ban, mert 8x AA-val 1,5 GB lenne csak a képkockához tartozó információ 2560x1600-ban. Full HD-ben valamivel több, mint 1 GB VRAM kellene 8x AA-val. És akkor még nincsenek bent a textúrák az objektum geometriái, szóval nehéz ügy ez. Az a kérdés a VRAM-nál, hogy a motor hogyan terhel ... a Frostbite 2 a negatív véglet, míg mondjuk egy Unreal Engine 3 VRAM igénye eléggé kicsi, vagyis ez mondható a pozitív végletnek. Szintén fontos, hogy a motor hogyan kezeli ezt az erőforrást. A Frostbite 2 ebből a szempontból elég jó, így ezért nem halnak meg azok a kártyák amelyek kifutnak a VRAM-ból. Például a Skyrim Creation motorja átlagos VRAM igénnyel rendelkezik, de a menedzsment már nem a legjobb, így többmonitoros módban MSAA-val 2 GB a minimum, vagy jön a 4-6 fps. De még így sem az igazi. 3-4 GB kell ahhoz, hogy ne legyenek erős fps zuhanások.

-

Abu85

HÁZIGAZDA

válasz

ricshard444

#1566

üzenetére

ricshard444

#1566

üzenetére

Ezeken a kártyákon már nincs analóg port. DVI van, vagy HDMI, illetve DisplayPort. A D-Sub már régóta halott. Mindenesetre DVI-ról át lehet alakítani, csak ronda lesz, mert analóg lesz a jel.

-

Abu85

HÁZIGAZDA

A nulla erős szám a hardcore réteg nagyon érdeklődik ezek iránt, mert olyan legális csalást ad a multis FPS-ekben, hogy az vérlázító. Háromszorosára növeli a látószöged, amivel előnyt szerzel. Voltak 2011-ben ebből versenyek. Egy vs. több kijelző. Mindig az a csapat nyert, aki a több kijelzővel nyomult. A legjobb benne, hogy a Punkbuster nem lövi le.

(#1481) ittakary: Idén már megnézzük, de nem ígérem, hogy állandó szereplő lesz. A top cuccoknál mindenképpen tervben van, hogy ilyet is tesztelünk.

-

Abu85

HÁZIGAZDA

-

Abu85

HÁZIGAZDA

válasz

sestertius

#1468

üzenetére

sestertius

#1468

üzenetére

A Dirt 3 egy picit érzékenyebb erre, mert több adatot ad át a GPU-nak számításra. Más játéknál ennyi különbség nem lesz. Sőt konkrétan nem várható eltérés.

-

-

Abu85

HÁZIGAZDA

Egyáltalán van ebből a termékből Rev2? Mert én még gyártótól nem hallottam. Egyedül a VR-Zone írt egyszer róla, hogy lesz, de azóta sincs semmi hivatalos.

-

Abu85

HÁZIGAZDA

Ez csak egy gyűjtemény, hogy melyik partnerprogramon belül melyik DX11-es játék született. Tulajdonképpen nem sok jelentősége van, mert a DX11 megy minden DX11-es kártyán.

Az NVIDIA Surround támogatásához a programon belül ugyanolyan feltételek kellenek, mint az Eyefinityhez. Ha valami jó Eyefinity-vel, akkor az jó Surrounddal is. Ez persze arra is igaz, hogy ha rossz a program támogatása, akkor mindkét technika mellett rossz. Az amit az AMD csinál csak egy minősítésrendszer. Ösztönözve a fejlesztőket arra, hogy minél jobb többmonitoros támogatást készítsenek.

-

Abu85

HÁZIGAZDA

AMD Gaming Evolved:

1. BattleForge (patch)

2. S.T.A.L.K.E.R.: Call of Pripyat

3. DiRT2

4. Battlefield: Bad Company 2 (+kieg.: Vietnam)

5. Aliens vs. Predator

6. Lord of the Rings Online: Shadows of Angmar (patch)

7. Civilization V

8. F1 2010 (patch)

9. Medal of Honor (multiplayer mód)

10. D&D Online: Eberron Unlimited (patch)

11. Dragon Age 2NVIDIA TWIMTBP:

1. Metro 2033

2. Lost Planet 2

3. HAWX 2

4. HomefrontFüggetlen:

1. World of Warcraft: Cataclysm (patch) -

Abu85

HÁZIGAZDA

A Call Of Duty játékok többmonitoros támogatása nem elég az Eyefinity Silver minősítéshez sem. Ez az oldal szigorú szabályok szerint minősíti azokat a játékokat, amelyek támogatják a többmonitoros megjelenítést. Bőven van még olyan játék, ami támogatja a több monitort, de ha nem megy át a vizsgán, akkor nem kap minősítést, és nem kerül fel az oldalra.

Én csak a DX11-es játékok támogatását jegyzem. Ott az AMD 11:4-re áll nyerésre az NV ellenében. Persze a játékok számában. Van még egy független játék is, ami egyik partnerprogramon belül sem volt jegyezve.

-

Abu85

HÁZIGAZDA

válasz

DigitXT

#1085

üzenetére

DigitXT

#1085

üzenetére

Előfordulhat ilyen probléma. [link] Itt van egy Eyefinity gyűjtemény. A Silver fokozat azt jelenti, hogy általánosan jó a három monitor, de lehetnek érdekes gikszerek. Mindig más apróbb hiba. A Gold fokozat azt jelenti, hogy a támogatás hibátlan, minden Eyefinity szintre. Mivel a Surround az Eyefinityt másolja, így arra is jó.

Ezeken kívül még lehet olyan játék, ami megy három monitoron csak nem olyan minőségű a támogatás, hogy az bármiféle minősítést érdemeljen. -

-

Abu85

HÁZIGAZDA

válasz

KillerKollar

#731

üzenetére

KillerKollar

#731

üzenetére

Nem lesz új BIOS.

NVIDIA's reference GTX 590 VBIOS on the production boards has not changed, and we have not provided a new VBIOS to AICs or end users for GTX 590. The original GTX 590 VBIOS that NVIDIA shipped is good for customers to use and we stand fully behind the reliability of the hardware with that VBIOS.

-

Abu85

HÁZIGAZDA

válasz

DeathAdder

#707

üzenetére

DeathAdder

#707

üzenetére

Ilyen nincs. A GTX 590 mindenkinek ugyanaz. A gyártók nem forgalmazhatnak eltérő modellt, mert mindenki azonos gyártósorokról kapja a kártyát. Annyit tehetnek, hogy a hűtőt lecserélik.

Nem tudom, hogy a kávéval mi van. Élelmiszerrel előfordulhat, bár meglepődnék.

Olyanról már hallottam, hogy egy kiadott hardver, konkrétan az Asus Xonar DS hangkarin változtattak a megjelenés óta. Eredetileg JRC 8022B műveleti erősítővel szállították. Azóta ezt olcsóbbra cserélték. De nem az országok miatt változtatták meg, hanem az olcsóbb gyárthatóság miatt.

-

Abu85

HÁZIGAZDA

válasz

Scholes9

#704

üzenetére

Scholes9

#704

üzenetére

Ha elszáll a tesztholmi, akkor elszáll. Erről nem biztos, hogy a tesztelő tehet. Ilyenkor nem szokott nagy probléma történni, szólni kell a tesztholmit biztosító cégnek, hogy kell még egy, de amúgy nincs nagy következménye. Persze nem örül neki a gyártó, mert egyes országokban (például nálunk is), főleg ilyen drága termékek esetében egy kártya fog végigmenni az összes hardveroldalánál. Ergo illik vigyázni rá.

-

Abu85

HÁZIGAZDA

A képhez hozzáfűzve maradjunk annyiban, hogy a Prototype eltérő rendert alkalmaz Geforce-ra és Radeonra. A kártyák csak azt teszik, amit a program mond nekik, ott semmi hiba vagy szándékos butítás nincs, így van a játék leprogramozva. Hogy miért arról a fejlesztőket kell kérdezni.

-

Abu85

HÁZIGAZDA

Én legalább példákkal támasztom alá az állításaimat.

Ó dehogynem:

Rudit például ennél a tesztnél kritizálták: [link] Fórum: [link]

Pedig hidd el ő csak a véleményét mondta el, ami nem tetszett egy fórumozónak. Gondolkozz el rajta ... Lehet, hogy most is ez az eset áll fent?

Lehet, hogy most is ez az eset áll fent?Ez nagyon jó, de mi köze van a vitának ehhez? Nem a kommunikációs technikám képzett. Őszintén szólva nem nehéz vitázni, mert tényeket állítok.

[link] Itt a cikk erről a Sandy Bridge dologról. Idézet: Nagy kérdés még a Sandy Bridge működése egy diszkrét grafikus kártya mellett. Nyilvánvaló, hogy a lapka CPU-s része üzemelni fog, de az IGP a pletykák szerint azonnal lekapcsol, amint egy külső GPU jelenlétét érzékeli.

A pletykák szerint oda van írva.

Ne mentsd fel magad csak azért mert nem vagy szerkesztő ... nézzük is meg ma mi történt: [link]

Idézet: Húú tényleg, erről is lesz főhír a Gamepodon? Hogy gondok vannak a Crysis 2-ben AMD vga-val?

Megírtam a kívánt hírt: [link]

[link] - és ilyen hibátlanul fut a program SLI-n.

És ezek után szerintem nem kell hozzáfűzni semmit a mondandóidhoz. Illetve javaslok egy "sponsored by NV" megjegyzést az aláírásodba.

Az sem volt semmi, amikor a heti Apple hír kapcsán nekem estél: [link]

Én költöttem át a hírt, miközben a hivatalos anyagban szó sem volt Radeonról. [link] Ez is valami kitaláció lehet. Az Apple biztos AMD párti. Nem lehet esetleg, hogy olyan helyen olvastad a hírt ahol az megfelelt az igényeidnek?

Nem lehet esetleg, hogy olyan helyen olvastad a hírt ahol az megfelelt az igényeidnek?  Ja és természetesen megint az én hibám, hogy a hivatalos anyag leírása alapján írtam a híremet. Elképesztő, hogy mit meg nem engedek magamnak.

Ja és természetesen megint az én hibám, hogy a hivatalos anyag leírása alapján írtam a híremet. Elképesztő, hogy mit meg nem engedek magamnak.

-

Abu85

HÁZIGAZDA

Ha ez tényleg így lenne, akkor nem mentettem volna ki anno Core i7-et a TLB-bugból (hasonló volt az AMD Phenomnak is

). [link] Az Intel meg is köszönte, hogy elmagyaráztam a valós helyzetet, szemben más oldalakkal, akik átvették a Fud hülyeségét.

). [link] Az Intel meg is köszönte, hogy elmagyaráztam a valós helyzetet, szemben más oldalakkal, akik átvették a Fud hülyeségét.

Nem is értem, hogy akkor miért nem támadtatok nekem? Talán azért, mert a szájízeteknek megfelelő dolgot írtam? Pedig lehetett volna linkelni, hogy xy nem ilyen rózsaszínben írta meg.

-

Abu85

HÁZIGAZDA

Még várom a Crytek válaszát. Egyelőre csak azt tudom, hogy jön a patch, de mondták, hogy megnézik és ma visszaírnak, mert már tesztelik. Így egyben le lehet írni a problémákra a megoldásokat is.

Természetesen amint megjön a válasz kimegy a hír. Már csak abból a szempontból nem akarunk két hírt írni, hogy egy a hibáról, és egy a megoldásról.

-

Abu85

HÁZIGAZDA

Én nemrég megint gondolkodtam a CF-en. Viszont amikor a tettek mezejére kellett lépni egy GeForce-szal tértem haza. PhysX-re jó.

Ezzel a problémám is megoldódott, mert nincs szabad PCI Express x16 portom, így nem bassza a csőrömet, hogy ott van egy üres hely.

Ezzel a problémám is megoldódott, mert nincs szabad PCI Express x16 portom, így nem bassza a csőrömet, hogy ott van egy üres hely.  Javaslom neked is ezt az elgondolást.

Javaslom neked is ezt az elgondolást.

-

Abu85

HÁZIGAZDA

Ne vitázzatok már a GTX 580-HD 6970-en. Egyértelmű, hogy a GTX 580 gyorsabb. Az is egyértelmű, hogy a HD 6970 olcsóbb. Ennyi. Ez így túl van tárgyalva.

Innentől kezdve racionális döntés a szerint kell hozni, hogy a gyorsabbat akarod, vagy a pénztárca-kímélőbbet (de szép szó

Innentől kezdve racionális döntés a szerint kell hozni, hogy a gyorsabbat akarod, vagy a pénztárca-kímélőbbet (de szép szó  ).

).Fúúú. Tod milyen jó PhysX-re a GTX 580? Javít vagy 5%-ot a GTX 460-hoz képest.

Cyberkind jó srác.

Amúgy a vita az nem pont a rosszabbik megfogalmazás. Lényegében véleménycsere. A vitatkozás, az ami azt jelenti, hogy véleményt cseréltek veszekedéssel.

Amúgy a vita az nem pont a rosszabbik megfogalmazás. Lényegében véleménycsere. A vitatkozás, az ami azt jelenti, hogy véleményt cseréltek veszekedéssel.

-

Abu85

HÁZIGAZDA

Ja, hogy a GF? Ok leesett. Azért azért fontos tudni, hogy az AMD a 28 nm-hez nem jelölte meg a Common Platformot (GlobalFoundries, csak ugye összeálltak az IBM-mel és a Samsunggal a fejlesztésekhez). Egyedül az a biztos, hogy a Deccan platform kicsi Fusion lapkáit készítik gate first technológiával. Ez ugye kizárja a TSMC-t, mert ők gate last eljárást használnak majd.

A GPU-król pusztán spekulációk vannak. Azt mondják, hogy négy lapka lesz, de ebből kettőt a TSMC és kettőt a GF gyárt majd. Aztán, hogy ez mennyire igaz nem tudni.Fogalmazzunk úgy, hogy az alacsony felbontásokban a GeForce, míg a magas felbontásokban magas AA-val az AMD terméke nyer az átlagolt teljesítményt tekintve. Ezután mindenki eldöntheti, hogy melyik fontosabb számára egy csúcskártyánál. Esetleg ide lehet venni a multimonitort, mert mégis extrám teljesítményről beszélünk, ami egy monitor mellé nem biztos, hogy kell. [link] Ezzel kapcsolatban a HardOCP tesztje.

-

Abu85

HÁZIGAZDA

Rocket ezt ne.

Nevetség tárgyává teszed magad. Az R600-ra épülő HD 2900 XT nem volt a világ leggyorsabb grafikus kártyája. A HD 6990 az.

Nevetség tárgyává teszed magad. Az R600-ra épülő HD 2900 XT nem volt a világ leggyorsabb grafikus kártyája. A HD 6990 az.

Miben nem tévedek? A tesszellálás kapcsán. Hát onnan gondolom, hogy ez még most is téma volt a GDC-n. Ha nem lenne számottevő probléma a rasztermotor hatékonysága, akkor nem szenteltek volna neki szerepet az előadásokon.

A fórumozok nem az én dolgaimra reagáltak, hanem a tieidre. El kellene gondolkodni azon, hogy talán nem véletlenül.

Nekem meg két Geforce-om és egy Radeonom van itthon. És akkor mi van változtat ez valamin?

Miért mit gondolsz engem érdekel. A GeForce GTX 580 még mindig a legerősebb egy-GPU-s kártya. Kimondtam. És tudod miért? Mert tény és nem fájt. Mi a probléma?

-

Abu85

HÁZIGAZDA

válasz

proci985

#626

üzenetére

proci985

#626

üzenetére

Ha a Low end kidől, akkor kidől vele a VGA-piac is. Ezt egyszerű megérteni mert az eladások 60%-a 100 dollár alatt történik. Pár powerjúzerért nem fognak fenntartani egy teljes üzletágat.

Az Nv például már mondta, hogy a Maxwell, vagyis a Kepler utáni generáció, már tartalmaz CPU-magokat is. [link]A programozókon fog múlni továbbra is. Heterogén módon kell írni az alkalmazásokat.

-

Abu85

HÁZIGAZDA

És miből gondolod, hogy most nem tévedsz? Látod, ezért szólt neked Pug. Nem bántani akar, csak figyelmeztet, hogy nagyon megváltoztál valamiért. Nem éri meg vérfannak mutatkozni, mert megbélyegeznek. Ez egy jó tanács. Nem bántásból mondom. A régi, igazi rocket sokkal jobb volt hidd el. Nem érdemes a fórum második Ottokájának lenni.

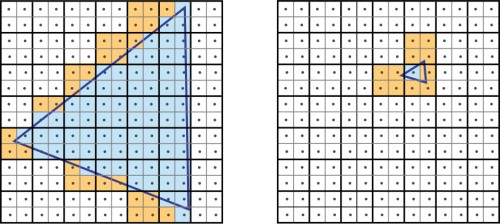

A tesszellálásra gondolsz? Látom nem világosak az alapok. Már linkeltem neked két képet a Heavenből. Egy 16 pixeles és egy 10 pixeles mód. A különbség gyakorlatilag észrevehetetlen, de a sebesség minden hardveren +30-40%. Ez abból adódik, hogy az összes piacon lévő hardver quadrendert használ, így nem mindegy nekik, ha a raszterizálás esetében a számítások felét, vagy csak 10%-át kell eldobni. [link] Ez itt részletezve van, hogy miért történik.

Itt ez a kép. A még elfogadott eset a 16 pixeles háromszög. Ott látható, hogy 104 pixel vizsgálata történik négyes csoportokban. Ebből 76 pixel fedett lesz, míg 28 nem, vagyis a számítások 26%-a volt felesleges. A másik eset az egy pixeles fedés, ahol 12 pixel vizsgálata történik meg, de a számítások közül csak egy pixel lesz fedve, vagyis 11-szer feleslegesen dolgozott a kártya. Ez azt jelenti, hogy a számítások 92%-a feleslegesen történt meg. Ez azért számottevő probléma. A kártyák ettől kifekszenek.

A kártyák ettől kifekszenek.Ha az NV agyontesszellálja a játékot, akkor nem az AMD-vel szúr ki, mert ők szépen driverből visszatesszellálják. Akik viszont megérzik az alacsony teljesítményt, azok a GeForce tulajok, mert nekik a raszter kifekszik és a számítások több mint 50-60%-át el kell dobni.

A HAWX 2-ben sem a tesszellálás a probléma a közhiedelemmel ellentétben. [link] Ezen az oldalon van HAWX 2 teszt tesszellálással és tesszllálás nélkül. Láthatod, hogy a skálázódás 63 és 83% közötti, de a legtöbb termék (az egy GPU-sokra gondolok, hogy egyszerűsítsük a dolgokat) 72-73%-ot veszít a teljesítményből a tesszellálás bekapcsolásával. Ez lenne a gyenge pont? Ne a gyártók anyagának higgy, hanem a független véleményekre adj. De ha az én hozzáértésemet megkérdőjelezed, akkor itt van egy a Beyond3D téma. [link] - gyakorlatilag a tesszellációról szól több oldalon keresztül sok hozzáértő hozzászólással.

-

Abu85

HÁZIGAZDA

válasz

cyberkind

#620

üzenetére

cyberkind

#620

üzenetére

Párszor volt már róla szó. A procimagok száma nem emelhető a végtelenségig, mert a skálázás nem megoldott, és a fogyasztás is csak nő. Heterogén lapkákat kell csinálni. Az Intel komolyan ráfeküdt a GPU fejlesztésére. Az AMD már kombinálgat alapszinten, míg az NV komoly ráfeküdt a CPU fejlesztésére.

Végül APU-t csinál mindenki. A Win8-hoz minden érintettnek egy chipbe integrált platformja lesz. -

Abu85

HÁZIGAZDA

A Crytek elismerte, hogy baj van és lesz javítás. A hivatalos fórumon a teljes 1.2-es listát eléred, én csak a technikai részt vettem ki belőle.

Nyilván a PC megváltozott a címekre hajtani. Idén az NV a Crysis 2-őt hozta. Akinek ez kell vegyen GeForce-ot. Az AMD a Dragon Age 2-őt, a Shogun 2: Total Wart hozta, valamit készült a Dirt 3 és a Deus Ex Human Revolution. Aki ezeken akar játszani vegyen Radeont. Ez ilyen egyszerű.

Megvan a választás lehetősége.

Megvan a választás lehetősége.(#611) Pug: Nem értem miért jó ez neki. Teljesen tönkreteszi az imázsát. De ez ő dolga.

-

Abu85

HÁZIGAZDA

válasz

Whit3Rav3n

#608

üzenetére

Whit3Rav3n

#608

üzenetére

Világos ... baj van az AFR-rel. Ezt a Crytek is elismerte, de nem kell aggódni jön a patch.

-

Abu85

HÁZIGAZDA

válasz

cyberkind

#605

üzenetére

cyberkind

#605

üzenetére

Nem próbáld meggyőzni. Mi itt megpróbáltuk, de menthetetlen. Valami történt vele az utóbbi egy-két hónapban. Fejébe vette, hogy az AMD egy csődtömeg, és nem számít, hogy mit tesznek le az asztalra. Majd idővel visszatér a régi rocket.

-

Abu85

HÁZIGAZDA

Jó az a megoldás, amit az NV alkalmaz, csak nincs jól kalibrálva. A teljesen hardveres megoldás kifejlesztése pedig idő.

(#580) cyberkind: Persze. A kisebb lapka kisebb fogyasztás. De ez is időbe telik.

(#581) DeathAdder: Írj egy jó első hsz-t. Vannak már minták más topikokból.

-

Abu85

HÁZIGAZDA

válasz

cyberkind

#575

üzenetére

cyberkind

#575

üzenetére

Mert a házakat szabvány szerint tervezik. Oda be van kalkulálva, hogy egyes területekről mekkora hőmennyiséget kell elvezetni. Ez a fő ok. A másik pedig az ilyen esetek elkerülése. [link] 300+ watt az irtózatos teljesítmény. Általánosan nem biztonságos, nagyon jól kalibrált túlterhelés elleni védelem kell, olyan ami nagyon gyorsan reagál.

-

Abu85

HÁZIGAZDA

Szerintem nem kell magyarázkodnom és 1000 sort írnom. Nem hiszem, hogy pont én beszélek hülyeséget a fórumon. [link] Olvasd végig, és gondol végig, hogy mi történt azóta. Az AMD nem késte le a Crysis 2 rajtját, és a DX11-et is kivette az NV a Crysis 2 bemutató oldaláról. [link] Eredeti kép: [link]

Nem tudom mi történt veled, de megváltoztál nagyon. Régen a tények embere voltál most pedig dühít valami. Hidd el én nem tehetek arról, hogy a Crysis 2 megjelenésére nem érkezett meg a DX11-es patch, és arról sem tehetek, hogy a HD 6990 március 8-án jelent meg. Arról meg a legkevésbé tehetek, hogy az AMD több DX11-es címen dolgozott eddig. Sajnálom, hogy ha valamivel megbántottalak, de szerintem ezek rajtam kívülálló történések voltak.

Az OEM dolgokról kérdezd meg Gornecket. Ő egy OEM gyártónál dolgozik.

-

Abu85

HÁZIGAZDA

A helyzet az, hogy régen vásárolták is a termékeket Magyarországon. Most már nem ez a helyzet.

Ha megnézed máshol sincs NDA lejártára teszt. A nyugat fontosabb lett. Az viszont érdekelne, hogy miért bulvár a VGA szekció. Mutass egy olyan magyar oldalt, ahol vannak ilyen technikai elemzések.

Esetleg jó lenne egy olyan hírt is elővenni, ami nem állít tényeket.A nagykerek addig nem tudnak mit csinálni, amíg nem kapnak terméket. A GTX 590 is csak jövőhéttől lesz elérhető Magyarországon.

Miért baromság a 300 wattos PCI-SIG határ?

-

Abu85

HÁZIGAZDA

Sajnos a hazai piaccal nem sokan foglalkoznak. Túl kicsik vagyunk. Mi a gyártókon keresztül szerzünk holmit. Ők elégedettek a mérések eredményével. Bár néha nem értenek egyet a minősítéssel. Általában mindig jobbat akarnak, de hát nem osztogathatjuk csak úgy a különösen ajánlott plecsniket.

Gondolom a HD 6990 tetszett minősítése sem lesz kedvelt, mivel mégis a világ leggyorsabb VGA-ja, de az ára az nem semmi.

Gondolom a HD 6990 tetszett minősítése sem lesz kedvelt, mivel mégis a világ leggyorsabb VGA-ja, de az ára az nem semmi.(#522) Mozsa: Nem én kezdtem.

-

Abu85

HÁZIGAZDA

-

Abu85

HÁZIGAZDA

[link] Sajna a Hardware Secretsnek nem jutott. Mondjuk az NV válasza nem semmi. Biztos sok rajongót szereznek ezzel. Jobban jártak volna, ha azt mondják, hogy elkúrtuk és megy a kártya ... bocsi.

-

Abu85

HÁZIGAZDA

Marha jó, hogy egyesek szarnak az NDA-ra. Nagyon sportszerű.

Persze linkeljetek minél többet, nektek nincs megkötve a kezetek.

-

Abu85

HÁZIGAZDA

válasz

matteo_szg

#436

üzenetére

matteo_szg

#436

üzenetére

Köszi!

Azt jó lenne tudni, mert alapvetően a limit mellett logikus a piac szegmentálása. Az NV viszont nyilván erről és a limitről nem beszél. Szerintem nem is fog.

-

Abu85

HÁZIGAZDA

válasz

matteo_szg

#434

üzenetére

matteo_szg

#434

üzenetére

Miért kapható lesz nálunk? Mindenki külföldi fórum arról beszél, hogy az Asus és az EVGA csak az USA-ban lesz elérhető. Ez most igaz vagy sem?

A másik, hogy nagyon limitált lesz az ellátás. Ez mennyire igaz? -

Abu85

HÁZIGAZDA

Elvileg ez a kari nálunk nem lesz beszerezhető, de a többi is ugyanaz a reftermék lesz. Úgy tudom (bár ezt nem erősítették meg), hogy mi hivatalos forrásból MSI-t vagy Zotac-ot kaphatunk.

Hivatalos "Horsepower" 365 watt. Ez valami újfajta TDP mérés lehet.

-

Abu85

HÁZIGAZDA

Az a PowerTune lényege, hogy beállítható egy limit. Legyen mondjuk 300 watt. A kártya vezérlése ezentúl arra törekszik, hogy a termék ezt a fogyasztási értéket ne lépje túl. Ennek megfelelően skálázza az alapórajelet lefelé. Ha ezt a limitet 350 wattra növeled, akkor az órajele kevésbé lesz skálázva. Ha a default órajelen a max fogyasztás 375 watt és a limitet mondjuk 375 watt fölé állítod, akkor lényegében nem történik órajelskálázás, mert a limiten belül van a kártya. Ettől van az hogy a HD 6970-en a 0%-os értéken elért teljesítmény a +20% hatására nem változik. A 0%-os limit is elég a kártyának. Persze ha tuningolod, akkor már mérhető a különbség.

(#160) DeathAdder: Az a kapcsoló a Dual BIOS. Ha elrontod az egyik BIOS frissítését, akkor átkapcsolsz a másik BIOS-ra és a kártya él.

(#161) adamssss: Az a része a dolognak tuning lenne, hiszen a kártyád alapórajelét emelnéd meg. A PowerTune garantált szolgáltatás, mivel az órajel nem nő.

-

Abu85

HÁZIGAZDA

válasz

adamssss

#157

üzenetére

adamssss

#157

üzenetére

A HD 6900-okon már van ilyen PowerTune funkció. A driverben beállíthatod, hogy mennyit szeretnéd, hogy fogyasszon. Ez a technológia lényege. A fogyasztás kontrolálod, és az órajelet a rendszer automatikusan beállítja, úgy, hogy a termék nem lépje túl a kívánt határértéket. Nyilván Ha akarod, akkor a HD 6970 is fogyaszthat 200 wattnál kevesebbet. Annyi a dolgod, hogy a PowerTune kapcsolót -20%-ra állítod. Ilyenkor 160-170 watt lesz a fogyasztása a rendszernek.

Az OEM-eseket marketinggel nem vered át. Ők a plecsnit nézik. Ha megvan, akkor nincs baj, ha nincs, akkor már van.

-

Abu85

HÁZIGAZDA

válasz

DeathAdder

#146

üzenetére

DeathAdder

#146

üzenetére

A HD 6990 esetében a PowerTune legnagyobb beállításával fogyaszt annyit, de a technológia negatív irányban is skálázható, így csak be kell állítani a leskálázást és a két GPU órajele úgy változik, hogy a termék 300 watt alatt maradjon, ha ez az ügyfél igénye. Gyakoraltilag az AMD azt csinálta, hogy belőtte a PwerTune technológiát 300-450 wattra, és majd az ügyfél eldönti, hogy hogyan szeretné használni.

Megmarad a káposzta és a kecske is jóllakik elv. Hasonló dologgal előállhat az NV is.

-

Abu85

HÁZIGAZDA

[link] - Itt a nyereményjáték, de sajnos csak USA és Kanada only.

(#134) hugo chávez: A Frostbite 2.0 radikálisan új elvekre épülő motor. A Deferred Render DirectCompute felületre épül. Nagyon gyors lesz. A főleg VGA nyers számítási kapacitása, illetve a memória mérete és teljesítménye lesz a döntő.

-

Abu85

HÁZIGAZDA

Most nem utaztam.

Arra én is kíváncsi vagyok. Egyelőre csak annyit tudok, hogy lehet majd nyerni, de hogy hogyan azt nem tudom. Holnap fog kiderülni a geforce.com-on.

A DX11 sebességére ki nem kíváncsi?

(#123) rup1u5: Szerintem nagyon a multira koncentráltak. A single valóban nem tűnik ütősnek. Félő, hogy scriptelt csőjáték lett. A Crysis szabadsága már nem jellemzi. Ráadásul a beszámolók szerint 4-5 óra, ami szvsz vicc.

(#124) Landon: Én a Crysis 2-re tippelek. A Rage egyébként nem tűnik vészesnek. Nem használ olyan technikákat, ami kicsinálhatja a kártyák raszterjét.

-

Abu85

HÁZIGAZDA

Lesznek a DX11-nek sebességre is előnyös oldalai. Pár post process gyorsabban fog futni. Ami a lényeg, hogy a játék nagyon skálázható. Gyakorlatilag sok konfigra be lehet állítani a megfelelő grafikát.

-

Abu85

HÁZIGAZDA

Még nem tudni. Mondták, hogy a 3D és a DX11 kód nem végleges. A mérések szerint 10-20%-os esés várható a 3D-ben, de ez javulhat némi optimalizálással. A játék konkrétan kész van, de a technika mögötte még nem teljes. Tovább folyik az optimalizálás. Nyilván ez gyors patcheket sejtet, de manapság ez nem probléma.

-

Abu85

HÁZIGAZDA

-

Abu85

HÁZIGAZDA

Én nem. Nem vagyok kint. Itthonról dolgozom fel az anyagot.

Az információink szerint a gépet a geforce.com-on lehet megnyerni. Azt mondták, hogy holnap lesz kihirdetve mit kell tenni a Crysis 2 demó kapcsán.Ezzel kapcsolatban lelepleződik egy Screen Space Re-Projection Stereo technológia, amit a Crytek dolgozott ki. Lényegében azt jelenti, hogy ezentúl a 3D nem fog fele fps-t hozni, mert nem lesz két teljes kép kiszámolva. Nagyjából 10-20%-ös sebességesésre lehet számítani.

-

Abu85

HÁZIGAZDA

A CeBIT területén belül már ki van állítva egy NV-s Maingear gép. Többmagos Core i7 van benne, pár GB memóriával és három GeForce GTX 580-nal Tri-SLI-be kötve. Full HD+-ban és 3D-ben, DX11-gyel megy. Az NV-sek már játszottak rajta, de holnaptól ki lehet próbálni a résztvevőknek is. Viszonylag folyamatos, és csak néha röccen meg. Ezt a gépet állítólag meg lehet majd nyerni.

Új hozzászólás Aktív témák

- Lexus, Toyota topik

- QNAP hálózati adattárolók (NAS)

- Milyen billentyűzetet vegyek?

- Akciófigyelő: Ajándékokkal érkeztek meg az új Dreame porszívók

- Formula-1

- NVIDIA GeForce RTX 5080 / 5090 (GB203 / 202)

- Entware topik

- Linux kezdőknek

- Apple MacBook

- Befutott a régóta várt, sok P-maggal kitömött, LGA1700-as Core sorozat

- További aktív témák...

- Zotac GTX 1060 Mini 6GB Garanciával!

- Dell Alienware Nvidia Geforce RTX 2080 Super 8GB

- 3év! AKCIÓ! ÚJ ASUS TUF GAMING Geforce RTX 5080 OC Edition 16GB VRAM Ray Tracing DLSS4

- MSI GeForce RTX 5090 VANGUARD SOC /// ÚJ BONTATLAN /// 2028.12.01.-ig GARI /// 2025.12.01. gyártás!

- Asus Dual Geforce RTX 4070 Super OC, garanciális 2027.07.12.

- ÁRGARANCIA!Épített KomPhone Ryzen 7 5700X 16/32/64GB RAM RX 7600 8GB GAMER PC termékbeszámítással

- BESZÁMÍTÁS! ASRock B450M R5 4500 16GB DDR4 512GB SSD GTX 1660 Super 6GB Zalman T3 Plus DeepCool 400W

- AKCIÓ! Intel Core Ultra 5 235 14 mag 14 szál processzor garanciával hibátlan működéssel

- HP EliteBook 830 G5 13,3" i7 8650u, 16GB RAM, SSD, jó akku, számla, 6 hó gar

- DDR4 Szerver RAM felvásárlás - napi árak, elsősorban nagy mennyiségben

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

Lehet, hogy most is ez az eset áll fent?

Lehet, hogy most is ez az eset áll fent?

Nevetség tárgyává teszed magad. Az R600-ra épülő HD 2900 XT nem volt a világ leggyorsabb grafikus kártyája. A HD 6990 az.

Nevetség tárgyává teszed magad. Az R600-ra épülő HD 2900 XT nem volt a világ leggyorsabb grafikus kártyája. A HD 6990 az.

Az utóbbi pár hétben történt valami.

Az utóbbi pár hétben történt valami.

![;]](http://cdn.rios.hu/dl/s/v1.gif)