Új hozzászólás Aktív témák

-

Puma K

nagyúr

válasz

evitiguF

#37597

üzenetére

evitiguF

#37597

üzenetére

A csavarok fejeit kell nézni hogy látsz-e kopást-sérülést rajtuk avagy használati nyomot.

A fekete csavaros kártyákon könnyebb észre venni ha bontották mert rendszerint a vékony fekete festékréteg kicsit meg tud kopni már egy csavarozás után.

A matrica nem jelent semmit. Hajszárítóval-hőlégfúvóval meg lehet melegíteni ami után a ragasztó lágyabbá válik és egy szemöldökcsipesszel simán le lehet szedni.

A ventilátorkábelek elrendezése és a csavarok egyedül amik árulkodóak tudnak lenni.

Keress teszteket (guru3d, techpowerup, techspot) és nézz képeket a kártyákról.

-

Puma K

nagyúr

válasz

DroiDMester

#37487

üzenetére

DroiDMester

#37487

üzenetére

Akkor jól van

-

Puma K

nagyúr

válasz

KAMELOT

#37483

üzenetére

KAMELOT

#37483

üzenetére

Ha ennyire érdekel akkor leírom, hogy haver 2012-ben összerakott játékra szánt gépéből van.

Van akit a régebbi játékok érdekelnek és amit azok nyújtanak élmény elegendő. Így 11 éve vett egy gépet ami azóta kiszolgálja az igényeit ha játszani akarna. Ha meg dolgozik és esetleg utazik is, akkor előveszi a MacBook Air-t.

-

Puma K

nagyúr

válasz

DroiDMester

#37482

üzenetére

DroiDMester

#37482

üzenetére

Remélem mértél vérnyomást meg cukrot miután írtál.

-

Puma K

nagyúr

válasz

boogie84

#37472

üzenetére

boogie84

#37472

üzenetére

Van nálam egy Asus DirectCUII GTX 670 2 GB... 2012-ből.

Úgy megvan hajolva hogy csak na. Mivel még semmilyen alátámasztást nem kapott sem gyárilag sem pedig utólag és backplate is van rajta. De a kártya amúgy hibátlanul működik.

A mellékelt videó címe inkább lehetne: 2x gondold meg mielőtt Gigabyte kártyát vennél

-

Puma K

nagyúr

válasz

Qtya123

#37422

üzenetére

Qtya123

#37422

üzenetére

"Amúgy is az a bajom, hogy az utóbbi években az RDR2 és a CP2077 nálam annyira magasra tette a lécet (de főleg az RDR2), hogy azóta is várom, hogy végre ismét belefussak egy olyan játékba, mint az a kettő."

Mind a két játékot-szériát fejlesztő és kiadó csapatnak rengeteg pénz van a birtokukban.

Adott játékok szérián belül de akár fejlesztői házon belül át tudnak hozni újításokat-fejlesztéseket. Ezért nekik ennyi előnyük van hogy nem csak hogy gyakorlatuk van jó játékot készíteni hanem tudnak a korábbiakra saját mércével még rátenni egy lapáttal, mert van minden szempontból erőforrásuk hogy megvalósítsák azt amit akarnak, mert már az alapok is megvoltak hozzá és nem nulláról kell valamit kitalálniuk és kifejleszteniük.

Vagy már meglévő technológiát megvenni és betenni a saját grafikusmotorjukba-játékukba:

euphoria physics (GTA IV ENGINE)

A kisebb fejlesztőstúdiók nem rendelkeznek annyi emberrel--pénzzel-erőforrással, hogy ezt meglépjék. Mert vagy beláthatatlan ideig tart a fejlesztés vagy a pénzük fogy el a játék összerakása közben.

Számomra a GTA széria a kedvencem.

Emiatt az egy cím miatt hajlandó vagyok gépet fejleszteni, hogy úgy fusson ahogy én azt akarom. Játszottam a legelső verziójával és a későbbiekkel.Emlékszem, hogy mikor a GTA 2 után megjelent a GTA III kb leesett az állunk a haverokkal. Azt sem tudtuk mit akarunk valójában csinálni mert már az akkor annyi szabadságot adott egy 3D világban a kezünkbe, hogy már a puszta kocsikázás vagy más olyan kikapcsolódást-élményt adott a maga mércéjéhez képest ami miatt érdemes volt játszanunk. Nem hogy még küldetéseket csinálni

-

Puma K

nagyúr

válasz

PROTRON

#37362

üzenetére

PROTRON

#37362

üzenetére

Ismerem JayzTwoCents videóit és ezt is ami linkelve lett

Korábban első és ezzel a témával foglalkozó videója az ez volt 5 éve: How to fix video card sag FOR FREE!

Alapból itt a gond az álló gépházban szerelős témával kapcsolatban:

Itt rendszerint nagyobbra vágják a lyukat a számítógépház gyártók többsége és kevés közülük az aki nem csinál feleslegesen nagy kivágásokat. Állítva szerelgetés közben emiatt meg jó hogy elmászik a kártya és lefittyen a sarka...

Az meg megint más téma amit már írtam, hogy ha a gyártó olyan kártyát csinál amin rendes hűtés van és van NYÁK merevítő pl: Asus Strix, MSI Gaming, Nvidia Founders Edition, akkor felesleges az alátámasztás.

Ráadásul erre már régóta odafigyelnek a rendes gyártók:

A 3090/TI Founders Edition-nál meg az I/O részen a fémlapra 3-3 csavarral össze van fogatva a pár de nagy elemekből álló gyári hűtés, hogy egy merev egész tömböt adjon a kártya:

A hajlás megint a házra vezethető vissza vagy arra hogy gyagyi a kártya hűtése és nincs megfelelően megcsinálva aztán ezen spóroltak x dollár centet...

Az új kártyával a gépben és már korábbról fent lévő MSI AB-vel a Windows-on minimum 1 újraindítás ajánlott. Akkor rendesen fog működni.

-

Puma K

nagyúr

válasz

PROTRON

#37356

üzenetére

PROTRON

#37356

üzenetére

A hátsó fémlapnak az I/O részen van rendszerint nekitámasztva merőlegesen a kártya egész hűtése és a NYÁK. Ami mostanra 2 kg felett mozog...

Ha rendes gyártó rendes egyedi hűtésű kártyáját veszed, akkor nem kell ezzel foglalkozni.

Csak annyi a lényeg, hogy rendesen a helyén legyen ahhoz fektetett gépházzal illene berakni ezeket a téglákat... Pont emiatt... Az a 2-3 csavar meg tudja fogni a kártyát.

XFX 7900 GT 2006-ból:

forrás [link]

-

Puma K

nagyúr

válasz

Busterftw

#37340

üzenetére

Busterftw

#37340

üzenetére

Így-így

Ez a baj, hogy sokan ezt elfelejtik számításba venni mikor adott fogyasztású és hőtermelésű hardvert vesznek aminek esetleg nem túl acélos már alapból a hűtése, hogy nincs légmozgás vagy adott hőtermelés mellett elegendő légmozgás. Mert nem olyan a ház kialakítása és még ventilátorokkal sincs megámogatva az egész gépház belsejének a levegőztetése.

-

Puma K

nagyúr

válasz

Találtgyerek

#37192

üzenetére

Találtgyerek

#37192

üzenetére

A Mafia 2 mikor anno megjelent akkor azt egy New Game gomb megnyomása után egyben kitoltam. Kb 10-12 óra alatt megvolt. Közben persze kaja-pia-mosdó megvolt.

-

Puma K

nagyúr

válasz

tupacamaru

#37087

üzenetére

tupacamaru

#37087

üzenetére

"Az EVGA programjába ha beállítottam a LED-eket, utána le is lehetett törölni, mert mindent megjegyzett."

A korábbi verziós Aura Sync is tudja ezt. Anno így kapcsoltam ki az 1070 világítását

Nálam most Windows 10-en az 1.05.28 van fent és ezt használom már 2019 óta.

-

Puma K

nagyúr

válasz

tupacamaru

#37085

üzenetére

tupacamaru

#37085

üzenetére

Nekem is egy régebbit kell használnom az Asus Maximus Hero X-hez meg korábban az Asus Strix GTX 1070-hez, mert egy kalap sz@r volt már akkor is. Amikor meg volt az 1070 akkor alakult át Asus Aura-ból ASUS Armory Create-é...

Szerencsére a hősök nem köpenyt viselnek: Asus Aura Archived Versions - reddit

-

Puma K

nagyúr

Aki korábban VRAM tuning limitbe ütközött volna annak ajánlott:

MSI Afterburner 4.6.5 (Beta 4)

"Increased memory overclocking limit for NVIDIA GeForce RTX 30x0 series graphics cards"

-

Puma K

nagyúr

válasz

PAtr0n

#37054

üzenetére

PAtr0n

#37054

üzenetére

Mindegyik (MSI Afterburner, Asus GPU Tweak, EVGA Precision, ZOTAC FireStorm, SAPPHIRE TriXX, Gigabyte Xtreme Engine Utility, Palit ThunderMaster) az Rivatuner licenceit használja csak más kinézettel és a funkcionalitásuk-tudásuk is változik.

A Rivatuner volt az első VGA tuning szoftver Nvidia kártyákhoz 1997-től napjainkig. A GPU és VRAM csúszkák tologatásán kívül már egymagában is többet tudott.

Ezt az alapot és fokozatosan fejlesztett verziókat vette meg-licenceli az MSI meg a többi cég és húzta rá az Afterburner meg a többiek a többi nevet, kinézetet és adott funkciókat:

Basic Guide to Overclocking using Rivatuner

Anno a Rivatuner-el húztam az akkori GeForce 4 MX440-es kártyámat...

A Riva Tuner Statistics Server-é avanzsált az a része ami az FPS-t meg minden féle adatot kiolvas a játék közben a gépről.

Szóval mindegyik egy kutya. Ha az alapot fejlesztő nem fog pénzt kapni a munkájáért akkor sem az MSI AB, sem az Asus GPU Tweak meg a többi nem fog egy idő után naprakész lenni és nem fog tudni a szoftver mit kezdeni az újabb kártyákkal.

Persze lehet egy ideig ugyan úgy működik majd mert adott szoftveres információkat, kártyán lévő vezérlőket és hozzáférést-elérési utat tudja majd használni a régebbi verziós program újabb kártyák esetén, de szoftverhibákba és egyéb anomáliákba futhat az ember, mert nincs meg a naprakész állapota a szoftvernek.

-

Puma K

nagyúr

válasz

- = Zk = -

#37006

üzenetére

- = Zk = -

#37006

üzenetére

Nem lassítják a régebbi kártyákat a gyártók. Az újabb címek-grafikusmotorok esetén az optimalizálást nem kapják meg ha túl régóta kint van már adott generáció.

A lassításos témával kapcsolatban összesen ezt az 5 évvel ezelőtti (azóta pedig senki nem foglalkozott a témával mert úgy tűnik nincs miért) videót találtam:

IS NVIDIA RUINING YOUR PERFORMANCE?

Ez azóta sem változott. Ha változott volna akkor a reddit és mindenféle tesztoldalak és videósok tömkelege csámcsogna a témán.

-

Puma K

nagyúr

válasz

- = Zk = -

#36989

üzenetére

- = Zk = -

#36989

üzenetére

Ezt még hányszor fogod leírni hogy a tápod nem elég? Mert kezd unalmas lenni. Ráadásul nem is neked válaszolt...

VGA tuning nélkül az adatlapodon lévő táp elég... ha valamelyik keresőt esetleg használnád akkor találnál ilyen bejegyzéseket ahol érdemes végigolvasni a hozzászólásokat: [link]

-

Puma K

nagyúr

-

Puma K

nagyúr

válasz

- = Zk = -

#36956

üzenetére

- = Zk = -

#36956

üzenetére

Mi alá lenne kevés a 9900K?

-

Puma K

nagyúr

Ilyen neve nincs arcokat a béna tesztjeikkel miért nézel?

Vannak rendes tesztek:

- $800 Meh, Nvidia GeForce RTX 4070 Ti Review & Benchmarks

- NVIDIA's Rip-Off - RTX 4070 Ti Review & Benchmarks

- NVIDIA Almost Got Away With This…AGAIN!

- Nvidia is lying to you - RTX 4070 Ti Full Review -

Puma K

nagyúr

válasz

laychi

#36823

üzenetére

laychi

#36823

üzenetére

Ha meg rendesen be van téve a kártya a helyére akkor alátámasztani sem kell.

Videó a témával kapcsolatban: How to fix GPU sag ONCE AND FOR ALL! FREE!

A gépet amúgy is fekve illene szerelni aztán ha ilyenkor odafogatja az ember az I/O részen a VGA-t, akkor felállításkor nem fog elmászni sehonnan. Persze rászakítani sem kell a csavarokat... bitfejjel szoktam 2 ujjal pödrő mozdulattal addig húzni ameddig tudom.

A fekve szerelést még úgy is megcsinálom, hogy 22-23 kg a gépház.

-

Puma K

nagyúr

válasz

- = Zk = -

#36720

üzenetére

- = Zk = -

#36720

üzenetére

Az RT-vel nem foglalkoznék.

Az majd mire olyan szintre "süllyed" mint anno a 16x-os AF és a tesszeláció erőforrásigénye volt az még idő. Talán az RTX 6000-7000 szériánál nem kell majd rá külön figyelni, hogy medium vagy high-ra teszi-e az ember vagy hogy egyáltalán be van-e kapcsolva.

Egyedül a DLSS-nek van értelme, de azt meg külön kellene támogatnia minden címnek.

A nyers erőnél maradva és a mezei grafikánál szerintem a 4080/4090 nem éri meg az árát.

-

Puma K

nagyúr

válasz

-=RelakS=-

#36710

üzenetére

-=RelakS=-

#36710

üzenetére

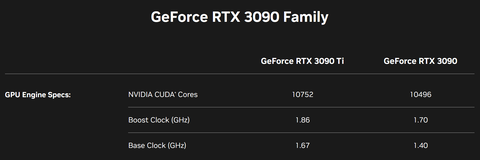

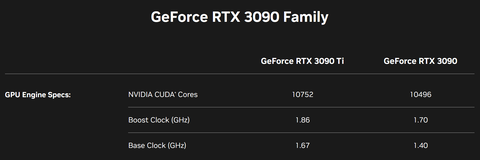

Az Nvidia meghatároz egy 3D HIGH és egy terhelés közben Boost órajelet ami az alábbi:

forrás: GeForce RTX 3090 Family - Full specsAz Nv azt garantálja, hogy az RTX 3090 Founders Edition-on lévő GPU-val szerelt VGA a dobozból kivéve és gépbe téve terhelés közben tudja az alap 1400 MHz-es GPU órajelet.

Az Nvidia VGA-kban lévő kikapcsolhatatlan-megkerülhetetlen GPU Boost ami adott meghatározott feltételek szerint terhelés közben emeli vagy csökkenti a GPU órajelét és feszültségét amit még stabilnak gondol.

Ezért ha módosítja az Nvidia GPU Boost az órajelet, akkor 1700 MHz-re garantáltan felemeli.

Ha(!) benne van még a fogyasztási keretben, gyári értéknél nem több feszültséget kell adnia és a hőmérséklet is adott meghatározott szinten belül marad (minden benne van a Full specs-ben).Az általad linkelt Inno3D 3090 egy az egyben ezeket az értékeket vette át és alkalmazza.

A gyakorlatban meg az mutatkozik meg, hogy az Nvidia GPU Boost tovább tudja emelni terhelés közben a GPU órajelét mint amit adott kártyának megfelelően meghatározott az adott gyártó.

Ezért látod azt, hogy 1695 MHz helyett, 1920 MHz-en ketyeg a GPU órajele.

Vannak olyan kártyák amik gyárilag bármiféle piszkálás nélkül simán felmennek 2000 MHz fölé. Sőt van amelyik akár a 2100 MHz-et is kicsivel alulról közelíti.

-

Puma K

nagyúr

válasz

Laraxior

#36695

üzenetére

Laraxior

#36695

üzenetére

5 órát tettem ma bele és eddig tetszik.

Látványra nem egy RDR2, de azért nem sokkal van alatta.

Az animációk jók.A hangok viszont rohadt jók

Muskétával lövöldöztem meg aztán mások is és az a hang ahogy végig megy az erdőben a lövés hangja. Vagy ahogy a fejszével bele vágsz az ellenségbe... rendesen elhiszem hogy a húsába hatolt az éle

![;]](//cdn.rios.hu/dl/s/v1.gif)

Idén nem terveztem, hogy tovább bővítem a játéklistámat... mert úgy is van elég cím amit elkezdtem, de nem fejeztem be...

Viszont... lehet ezt behúztom 20 EUR-ért

Viszont... lehet ezt behúztom 20 EUR-ért

Annyira nem VGA gyilkos mint számítottam rá.

Kevesebb a maximum-egyszeri fogyasztása a kártyának mint korában Overwatch közben.A New World most is fut a háttérben:

-

Puma K

nagyúr

válasz

Laraxior

#36690

üzenetére

Laraxior

#36690

üzenetére

Kíváncsi vagyok arra a címre mióta megjelent

Ha hazaértem akkor ráengedem a kártyára, de előtte jól bekonfigolom az Nvidia driver-t...

Az FPS limit 165Hz-es monitoromnak megfelelően 162-re lesz belőve az energiamenedzsment meg maximális teljesítmény előnybenrészesítésére

Az FPS limit 165Hz-es monitoromnak megfelelően 162-re lesz belőve az energiamenedzsment meg maximális teljesítmény előnybenrészesítésére ![;]](//cdn.rios.hu/dl/s/v1.gif)

Köszi az infót!

-

Puma K

nagyúr

Ha már otthon ott figyel egy jó teljesítményű és játékra szánt asztali gép, akkor jó hogy a jobbnál jobb játékokat pörgetem rajta. Az egyik ilyen játék: videó

-

Puma K

nagyúr

válasz

Találtgyerek

#36675

üzenetére

Találtgyerek

#36675

üzenetére

Plusz legyen szíves és képernyőmentést készítsen és ne a monitort fotózza.

-

Puma K

nagyúr

válasz

tray86

#36639

üzenetére

tray86

#36639

üzenetére

A többiek amiket idő közben említenek az lehet neked is egyszerűbb és olcsóbb lenne: UV + néhány jobb ventilátor.

Vegyél jófajta ventilátort minél nagyobbat és minél többet aztán tömd meg vele a gépházat. A jó ventilátorból sosem árt ha van.

Korábban, 2018-ban 9db Noiseblocker NB-eLoop B14-PS Black-et vettem. Mikor még csak levegős hűtést használtam, akkor mindegyik használatban volt. Aztán megépítettem a vízhűtést a CPU-ra és azóta 7db forog a gépházban a maradék 2 meg el van téve.

-

Puma K

nagyúr

válasz

tray86

#36629

üzenetére

tray86

#36629

üzenetére

Az a gond hogy az a gépház nem az ilyen hőtermelésű komponens-komponensekhez lett kialakítva amik ráadásul a gépházon belül hányják szét az általuk termelt meleget.

Az a ház alapból a minél halkabb működésre lett kialakítva. Azon belül is olyan hardverekhez amik kevesebbet fogyasztanak mint pl egy RTX 3080.

Ezeket fusd át:

Best PC Cases of 2022: $60 to $300 Airflow, Silence, & Budget Cases

-

Puma K

nagyúr

válasz

DroiDMester

#36605

üzenetére

DroiDMester

#36605

üzenetére

vagy többel... mert nem tud visszahűlni.

vagy többel... mert nem tud visszahűlni.Az nem valami egészséges annyira lehűteni mikor kint nem ritka a 35°C feletti hőmérséklet

-

Puma K

nagyúr

válasz

DroiDMester

#36598

üzenetére

DroiDMester

#36598

üzenetére

Aha most így télen a 21-23°-os szobában-lakásban.

Aztán nyáron mikor a szoba ahol van a gép legalább 28°C-os akkor majd érdekes lesz a történet. -

Puma K

nagyúr

válasz

zebra_hun

#36582

üzenetére

zebra_hun

#36582

üzenetére

Pont ez az hogy nem össze-vissza kell telepíteni, mert ahogy a 1-nél több vírusirtó úgy 1-nél több ventilátorszabályzó program sem jó ha fent van vagy volt mert ha nem gyalulod le teljesen és nem írtod ki minden maradványát (a registry kb a Windows DNS-e) attól még bekavarhat mert a registry-ból az is betöltődik.

Az MSI AB tudja kezelni az EVGA kártyákat is. Mivel az EVGA Precision X is az alapot adó Riva Tuner egy módosítása-licence.

Az alapját adó Riva Tuner-nek édes mindegy ki gyártotta az adott VGA-t. A Riva Tuner-nek avagy mostani nevén Afterburner-nek (vagy akár ASUS GPU Tweak...) csak az a lényeg, hogy az adott ventilátorszabályzásért felelős chip-el tudjon kommunikálni azaz értékeket kiolvasni és szabályozni azokat.

Vagy kézzel kell kipucolni mindenhonnan ha már fent volt x darab vagy friss Windows.

Az RGB módosításhoz viszont rendszerint fel kell rakni az adott VGA-t gyártó saját malware-ét... mert van olyan hogy csak az tud kommunikálni az adott VGA RGB-t vezérlő egységével. Vagy szerencsésebb esetben egy az összes a gépben lévő RGB-t állítgatni képes szoftver tud kommunikálni ezzel a vezérlővel...

-

Puma K

nagyúr

válasz

zebra_hun

#36535

üzenetére

zebra_hun

#36535

üzenetére

Le kell gyalulni az EVGA szutykát registry-ból is meg úgy mindenhonnan a gépről (vagy fel sem kell rakni). MSI AB-ből meg a legfrissebb-legújabb kell ami kezeli-ismeri avagy tudja vezérelni az adott ventilátorvezérlőt az adott kártyán.

MSI AB-vel a Founders Edition 2 ventis kártyámon a ventilátorokat tudom vezérelni egyszerre vagy külön-külön.

Az a gond, hogy a ventilátorszabályzó programok össze tudnak akadni egymással és akkor különféle anomáliákat tudnak okozni. Egyszerre mindig csak egy ventilátorállítgató program legyen fent Windows alól.

Alaplapról állítani a rákötött ventilátorokat BIOS-ból. A VGA ventilátorait MSI AB-el érdemes.

-

Puma K

nagyúr

A FE ezekhez képest egyértelmű, hogy elmarad.

A FE-nek nincs akkora súlya mint azoknak így kevesebb a hőátadó felülete. A nyákja is kisebb és sűrűbb amit át is kellene tudni szellőztetni. Plusz ventilátorból is "csak" 2 van rajta 3 helyett.

Viszont gyári állapotában önmagához képest javítható a használhatósága és a FE-t is lehet UV-zni nem csak azokat amiket írtál.

-

Puma K

nagyúr

Windows alól a BIOS-ban turkáló programok bezavarhatnak. Instabilitási és rendszer problémákat okozhatnak.

Nem javasolt a használatuk. Sem CPU tuninghoz, sem RAM tuninghoz sem pedig mezei ventilátorállításhoz.

Ha magában a BIOS-ban módosítasz mindent akkor gyakorlatilag nincs hibalehetőség.

A gépre meg az alaplap gyártók malware-ja nem hiányzik. -

Puma K

nagyúr

válasz

Zsolteeka

#36176

üzenetére

Zsolteeka

#36176

üzenetére

Érdemes a CPU és VGA órajelein és feszültségein kívül a gépben lévő ventilátorokat fordulatszámát és hőmérsékleti tartományokat is beszabályozni saját igények és elérhető hűtési teljesítmény függvényében.

Értelemszerűen mivel nálad vízhűtés van a CPU-n és a VGA-n amik egy kört alkotnak, így a ventilátorok szabályzását már csak a BIOS-ban tudod elvégezni. Így itt kezdj neki az állításnak.

A BIOS-ban a CPU hőmérséklete a fő szempont ami alapján változik a hűtés-ventilátorok teljesítménye-fordulata. Szerencsés esetben adott alaplapoknál a VGA-GPU is kiválasztható mint tényező vagy másodlagos szempont így ha a GPU melegebb mint a CPU, akkor feljebb megy a ventilátorok fordulata a melegebb GPU miatt.

Ventilátoronként vagy ha használsz ilyet akkor ventilátorvezérlőként az állandó minimum fordulatot állítsd be 41°C-nál akkora RPM-re amit még nem hallasz ki a gépházból. A még nem hallható állandó minimum ventilátorfordulat persze lehet tetszőleges. Lehet akár 51 vagy 61°C. A 100%-os ventilátor fordulatot tedd 90/95°C-ra, de ez lehet 100°C.

Egyszerűen szemléltetve a magam részéről egy ilyen görbére törekszem:

Ahol a koordináta rendszerhez hasonló x és y tengelyes grafikus felületen lehet szabályozni a fordulatot ott úgy szoktam pakolgatni a bogyókat.

Csak az a lényeg, hogy lehet törekedni a minél halkabb működésre, de meg kell támogatni a melegedő hardvert és az átmelegedő vízhűtés radiátorait légmozgással, hogy azért minél több és hűsebb levegő kezdjen el mozogni és cserélődni a radiátoron, a gépházon belül az alkatrészek körül és a meleg meg jusson azért ki a házból.

-

Puma K

nagyúr

Köszi az infót.

Lehet én is berendelek egy fc blokkot meg akkor már egy aktív hátlapot is a hátoldali VRAM-oknak. Csak még méláznom kell a témán, hogy a csövezés az hogyan legyen megoldva...

Most a CPU-ra menő 10/16-os csövek lazára vannak hagyva és ki tudom lógatni a házból a CPU blokkot ha bármi miatt babrálnom kéne a géppel és akár az alaplapot kellene kiemelnem.

De ha meg a leágazást kellene megcsinálnom a CPU kimenő ágából a VGA-ra a VGA-ból akkor azt lehet rövidre kéne hagyni, hogy ne kígyózzon... pedig lehet azt kéne hogy egy picit tekeregjen és akkor nem feszes a csövezés... hanem szerelhető....

Egymagában a CPU-t vizezni egyszerűbb. 2 kört építeni meg még ebbe a batár TT Core V71-ben sem egyszerű... de... nem lehetetlen

Frissen összerakott vízhűtés még a 290 mm hosszú MSI GTX 1080 Ti Gaming X-szel és Z97 + 4790K-val + 32GB/2400MHz DDR3-al:

Aztán ez meg a korábbi állapot az MSI RTX 3070 Ti Gamin X Trio + Z370 + 9900K + 32 GB/3200MHz DDR4-el, mikor meg lett a kártya és aznap este fotóztam félálomban:

Mostani képet még nem csináltam a 3090-el a gépben

-

Puma K

nagyúr

válasz

Zsolteeka

#36038

üzenetére

Zsolteeka

#36038

üzenetére

Szakmai fórumon vagy. Ne keverd már a szezont a fazonnal "öcsém".

A dedós szintet meg te képviseled jelen hozzászólásoddal és sértődöttségeddel aminek hangot adsz. Nem kötelező írni.

Én 2004-ben 2 éven át a regisztrációmig csak olvastam az oldalt és a fórumot, mert nem volt pofám beírni az akkor szintet képviselő emberek hozzászólásai közé...

-

Puma K

nagyúr

válasz

KAMELOT

#35986

üzenetére

KAMELOT

#35986

üzenetére

Az Nvidia driver-ből hozom elő DSR-rel a nagyobb felbontást:

A szorzók a monitorod natív felbontására vonatkoznak.

Így nem kell a bármelyik teljesítménygyilkoló és képet elmosó-homályosító élsimítást használnom.

A felbontásnövelés arányaiban kevesebb erőforrást igényel és más terhelést ad a kártyának mint az azonos vagy kevésbé hatásos mértékű élsimítási eljárások amivel hasonlóan sima éleket de elmosott képminőséget kapsz csökkentett FPS szám mellett...Adott offline-online játékban a magasabban renderelt felbontást ha bírja a gép akkor használom.

Számomra az a lényeg, hogy adott játékban adott elvárt FPS szám mellett recés-fűrészes éleket és életlen grafikájú játékot ne lássak.

-

Puma K

nagyúr

-

Puma K

nagyúr

Ezzel a képpel mit kezdjek?

Nem azt írtam hogy nincs benne védelem vagy hogy nem elég mennyiségű.

Hanem az taglaltam és próbálom sokadjára átvinni, hogy a régi fajta fogyasztással rendelkező hardverekre voltak paraméterezve még a prémium tápok egy része is. Ebbe a régi szórásba bőven beletartozik az a 2012-2014-es használtan vásárolt 760W-os platina táp is.

Korábban a VGA-knak 2D órajelprofiljuk sem volt (pl Windows közben, vagy a VGA számára igen alacsony terhelést jelentő programok esetén stb). Állandóan fix órajelen-feszültségen járt a GPU és a VRAM is onnantól kezdve, hogy megnyomtad a gépházon a bekapcsológombot.

Aztán fejlődtek a VGA-k és lett 2D és 3D GPU órajel profil, hogy fogyasztást takarítsanak meg és feleslegesen ne melegedjen. Ezt automatikusan váltja a VGA aszerint hogy mennyire terheli az adott program a VGA-t.

Aztán lett később 2D, 3D low és 3D high (és a VRAM-nak is lett 2D-3D órajel profilja), mert hogy volt olyan hogy az adott program-játék nem terhelte az adott VGA-t így az fel sem váltott volna 2D órajelről, de az a teljesítmény amit 2D-ben tud a hardver túl kevés lett volna. Ezért lett egy 3D low órajeprofil is.

Aztán innen jutottunk el oda, hogy lett a 3D high órajelprofilnak egy dinamikusan változó értéke. Ezt a 3D high órajelprofilt változtatja az Nvidia GPU Boost.

Ezen módosítottak a tápgyártók és az olyan jellegű fogyasztásgörbére már nem reagálnak a különféle védelmek mint amiket egy jó pár éve már, hogy produkálnak a VGA-k.

-

Puma K

nagyúr

Nem csak az hogy elfáradhatott a belseje, hanem az is szerepet játszik az esetedben, hogy egy régi felépítésű és régi védelemmel rendelkező tápot kötöttél egy sokkal modernebb VGA-ra.

Ennek a modernebb VGA-nak meg mivel terhelés közben a GPU órajele és feszültsége dinamikusan változik a másodperc tört része alatt többször is ez egy régi táp védelme számára azt jelentheti, hogy hirtelen megugrott a fogyasztási igény tehát valami baj lehet és levágja magát-újraindul.

Az egyszeri maximumot meg nem minden esetben tudod szoftveresen monitorozni. Ez az egyszeri maximum érték az ami kiakaszthatja a régi tápok védelmét. Mert ezeket még nem erre a most már pár éve jelen lévő dinaimikusan változó GPU órajel-feszültség-fogyasztás trióra készítették fel.

A lényeg: régi tápot új VGA-val összekötni nem működik a gyakorlatban. Mint ahogy te is tapasztaltad.

Az Nvidia meg nem hülyeségből javasol adott tápot.

Ha meg bizonytalan vagy akkor az adott tápot gyártó-matricázó céget fel kell keresni és meg kell kérdezni, hogy szerintük tapasztalnál-e bármilyen anomáliát a gyakorlatban. Simán kaphatod azt válaszul, hogy nem javasolják mert problémákba ütközhetsz.

-

Puma K

nagyúr

Azt tedd hozzá, hogy az a Seasonic Platinum 760W amit említesz azt 2012-2014-ben vásároltad már használtan: [link]

Ha frissebb vásárlású lett volna az a táp és nem ~10 évvel ezelőtti ahhoz megfelelő belsővel-védelemmel, akkor nem lett volna gondod még azzal a 760W-os táppal sem.

-

Puma K

nagyúr

válasz

nutella1

#35766

üzenetére

nutella1

#35766

üzenetére

Az Nvidia kitett magáért, hogy egy ilyen ritka szar csatlakozót használjon:

rambling about the 12VHPWR failures - videó

38 perces videó de minden másodperce megéri, hogy megnézd.

Erősen ajánlott az Nvidia féle elosztót lecserélni egy harmadik féltől származóra aminél legalább rendesen meg van csinálva az érintkezőfelület és a bekötés...

-

Puma K

nagyúr

válasz

DroiDMester

#35755

üzenetére

DroiDMester

#35755

üzenetére

+1

-

Puma K

nagyúr

válasz

Találtgyerek

#35636

üzenetére

Találtgyerek

#35636

üzenetére

Lehet megmosolyogtató, de nálam az Overwatch volt az aminél elég hamar kibukott ha instabil a tuning.

Persze sok más játékot is próbáltam, de az OW volt az ami az elsők között jelezte (szinte naponta játszok vele) ha túl sok a VRAM tuning: bezöldült-sárgult a képernyő

Ha meg a GPU-nál használt tuning volt az instabil akkor eldobta a játék magát .exe hibával.

-

Puma K

nagyúr

válasz

zebra_hun

#35590

üzenetére

zebra_hun

#35590

üzenetére

A játék jelenlegi verziója 488_64.

Amit linkeltél kép azon 458_64 olvasható. Ha összehasonlítás és tesztelés akkor érdemes lenne azonos verziókkal tesztelni, mert közben a játékot frissítik. Legutóbb szeptember 30-án nyúltak hozzá.

Nálam ennyit tud a fixált órajelű és feszültségű 9900K. A magok órajele 5,1GHz a cache meg 4,5GHz-cen ketyeg. A RAM-ok nem túl acélos 3,2GHz@CL16-osok.

-

Puma K

nagyúr

Nagyon szép

Majdnem hasonló monitorunk van. Neked LG 32GK850F-B nekem LG 32GK850G-B.

Érdemes lehet felrakni a monitorodhoz való Win 10 Driver LG_HDR_QHD_32GK850F_Driver.zip telepítőt.

-

Puma K

nagyúr

válasz

Dzs3ko

#35565

üzenetére

Dzs3ko

#35565

üzenetére

Nem mindegy, hogy terhelés közben a kártya mely részeit terheli az adott program.

Kb csak annyit érsz el a Furmark-al, hogy a VRM szét fűti magát és nem kapsz valós képet a kártya teljesítményéről és valós stabilitásáról.

A GPU nem teljes egészében van terhelve. Az RT és a Tensor magok ilyenkor, egy Furmark közben nem csinálnak semmit. Pedig mostanra azaz érdekes ha ezek is dolgoznak.A Furmark közben a VRM mivel szétmelegszik így a GPU kapásból jobban le fogja dobálni az órajelet-feszültséget... mert a kikapcsolhatatlan-megkerülhetetlen Nvidia GPU Boost teszi a dolgát és az értelmetlenül magas hőmérséklet és fogyasztás miatt vissza is veszi a feszültséget-órajelet.

Tehát nem azt a szituációt szimulálod ami a valóshoz közeli használatot tükrözné. Egy szőrös fánkon nincs sok számolni valója a GPU-nak.

Elindítasz egy bármilyen RTX-et támogató játékot - 3D tesztet és képet kapsz a kártyád teljesítményéről és stabilitásáról.

Az Unigine Superposition is messze van 3DMark naprakészségben és terhelésben: [Version 1.1. - April 2019]

A 3DMark-ot utoljára 2022.10.20-án reszeltek, azaz 6 napja: Major 3DMark updates

A fenti okokat részletezve egy 3090-hez nem jó a Furmark. Írtam, hogy alulfeszeltem a GPU-t. A tápom meg valószínűleg még a régi szériából való amiben még érzékenyebb a védelem amit később javítottak és már nem kapcsol be.

-

Puma K

nagyúr

Ha olyan régi az a táp, akkor nem kérdés, hogy az újabb kártyák adott fogyasztási profiljára túlérzékeny belső védelme kapcsolt be.

Adott régebbi és a nem modernizált belsejű tápok érintettek abban a problémában, hogy az újabb kártyák terhelés közben kiugróan magas egyszeri-pillanatnyi fogyasztását a beépített védelmük nem tolerálta és azonnal újraindultak-lecsapták magukat. Még annak ellenére is lecsapták magukat ha bőven akár néhány száz W-tal még az adott táp teljesítményén belül voltak.

Ezt idővel a táp beleket gyártók is lereagálták ahogy megjelentek ezek az újabb és nagyobb fogyasztású VGA-k.

-

Puma K

nagyúr

A Furmark már egy jó pár éve elavult szoftver.

A 3DMark-ot folyamatosan frissítik újabbnál újabb tesztekkel amik a modernebb kártyákat jobban képes terhelni.

Az én gépemben egy Seasonic Focus Plus 850W Platinum van. Ezt a tápot 2018. januárjában vásároltam.

Azóta pár kártya megfordult nálam. Ilyen például a GTX 1080 Ti ami tuningolva akár 360W-ot is berántott magának, de volt mikor állandó 330W-ot kért terhelés közben. Aztán volt RTX 3070 Ti is amit kiszolgált bármiféle hiba-gond nélkül különféle benchmarkok közben és nem egy játékot 5120x2880-as felbontásban. Szóval terhelést kapott bőven.

Pár hete egy RTX 3090 FE-t tettem a gépbe. Természetesen Furmark-ban nem történik semmi szokatlan, de amint ráengedtem egy NFS Heat-et, Cyberpunk 2077-et, vagy Red Dead Redemption 2-őt adott grafikai beállításokkal rögtön levágta magát a táp.

Szükséges volt egy GPU alulfeszelésre: 0,85v@1800MHz.

Írtam a Seasonic-nak, hogy mi a problémám. Kértek a vásárlásról számlát és a táp tetején lévő matricáról egy képet (ezen látszik a szériaszáma és a pontos típusa). Majd elfogadták a garanciális ügyintézési igényemet és a héten fogom visszaküldeni nekik arra a címre amit ők megadtak.

Mikori vásárlás az a Seasonic Platinum 760W táp?

-

Puma K

nagyúr

RTX 3090 FE in Lianli O1 Vram properly cooled

A fenti linknél a hozzászólásnál valaki ezt említi:

"i redid the back plate pads max is 82/84 now at a 400w load at +950 ram"

és hozzá egy kép:

Lehet én is megnézem, hogy nálam milyen hőmérsékleti értékek lesznek

-

Puma K

nagyúr

Szombaton beszereltem egy RTX 3090 Founders Edition-t a gépembe.

Gyárilag-alapon ezt tudta:

A GPU feszültség terhelés közben 1,062v és az órajel maximum 1950 MHz volt majd innen ment lejjebb ahogy melegedett a kártya.

Játékok közül az NFS Heat-et engedtem először a VGA-ra aminek a menüjébe lépve nem sokkal később újraindult a gép. Utána egy RDR2-t néztem volna meg aminél szintén újraindult. Mindezt egy Seasonic Focus Plus 850W Platinum mellett.

Ezek után a GPU kapott egy egyedi beállítást: 0,85v@1800MHz

Ezzel már mindenféle játék úgy mint Cyberpunk 2077, RDR2, NFS Heat stb-stb-stb hosszú órákon át stabilan ment tegnap és ma is.Superposition-ban pedig ezt tudja a 0,85v@1800MHz:

Utána driver-ben az energiasémát programonként-játékonként ahol ennek láttam értelmét átállítottam "Maximális teljesítmény előnyben részesítése" lehetőségre amivel ezt hozta:

Ez a mai több órás játék+benchmark eredménye:

-

Puma K

nagyúr

válasz

Laraxior

#32963

üzenetére

Laraxior

#32963

üzenetére

Úgy látom a Galax-nál is tesznek arra a trendre a bika kártyáik ellenére, miszerint ha 3 ventilátoros egy VGA, akkor a középsőt a más kettőhöz képest valakik szerint a másik irányba kellene forognia.

-

Puma K

nagyúr

Most vagy nem tudod, hogy lassan 400 Ft 1 euró... vagy csak egy jót szerettél volna orbánozni meg szokás-divat szerint a szülőországodat-anyaföldedet szidni. Esetleg egyszerre a kettőt-hármat.

Amúgy ha tudsz külföldiül vagy a képesség meg van, hogy akár fordítóval de rendelj külföldről, akkor itt nézelődj: [link]

A másik meg az, hogy lehet rossz cikkszámú terméknél ütötte be a dolgozó a 833.450 Ft-ot.

Új hozzászólás Aktív témák

- AMD Radeon RX 6600 8GB (Beszámítás)

- Nvidia geforce rtx 5070 ventus 3x 12gb(vram)

- AZONNAL VÁSÁROLOK RTX 4090 és RTX 5090 videokártyákat! Akár nem működő, hiányos, sérült is lehet!

- MSI GeForce RTX 5090 VANGUARD SOC /// ÚJ BONTATLAN /// 2028.12.01.-ig GARI /// 2025.12.01. gyártás!

- Asus GTX660-DirectCU2 II 2 GB GDDR5 192 bit PCI-E Videokártya

- HIBÁTLAN iPhone 11 64GB White-1 ÉV GARANCIA - Kártyafüggetlen, MS4389, 100% Akksi

- Samsung Galaxy S26 Ultra Spigen tok, üvegfólia

- ÁRGARANCIA!Épített KomPhone Ryzen 5 9600X 32/64GB RAM RTX 5070 12GB GAMER PC termékbeszámítással

- BESZÁMÍTÁS! Gigabyte B650M R7 8700F 64GB DDR5 1TB SSD RTX 5070 Ti 16GB Lian LI LANCOOL207 ADATA 850W

- Xiaomi Mi 11 lite 5G NE 256GB, Kártyafüggetlen, 1 Év Garanciával

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

vagy többel... mert nem tud visszahűlni.

vagy többel... mert nem tud visszahűlni.