Új hozzászólás Aktív témák

-

S_x96x_S

addikt

válasz

Yutani

#49686

üzenetére

Yutani

#49686

üzenetére

> Egyébként érdekes, hogy Borderlands 4 alatt ~20%-kal van

> a 9070 (59 FPS) az 5070 (49 FPS) előtt natív 1080p-ben.

> Egyébként meg a sima GPU tesztekben 7% az átlag.

a sima GPU teszteknél nem limitál annyira a VRAM hiány mint itt.

( 5070 =12GB VRAM vs 9070 = 16GB VRAM )----

de amúgy is a 1080p Badass módhoz ~ 11GB VRAM kell.

és ha be van kapcsolva egyéb FG funkció,

az még ezen kívül igényel extra VRAM-ot.

úgyhogy az RTX 5070 eléggé hamar korlátokba ütközhet. -

S_x96x_S

addikt

válasz

Busterftw

#49620

üzenetére

Busterftw

#49620

üzenetére

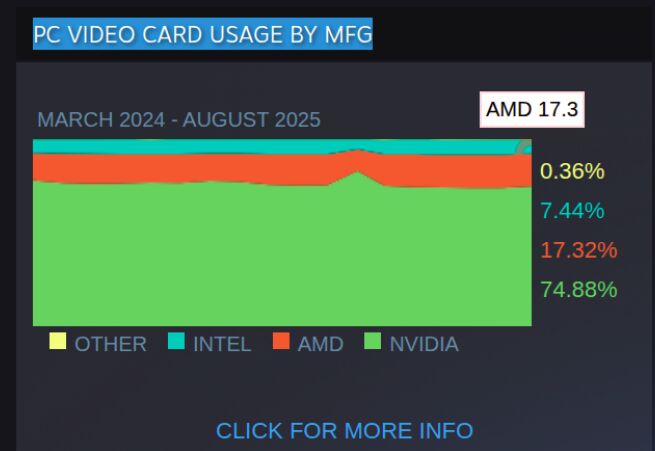

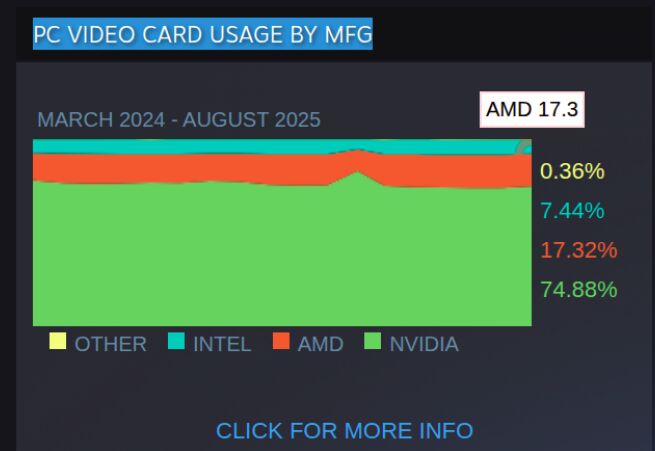

> Teljes a korrelacio, ahogy eddig lenni szokott.

Ha hasonló naptári időszakot nézünk, akkor

a steam ( PC Video card usage ) szerint

az nvidia csökkent Q1 -ről a Q2 -re ;

és csak augusztusban sikerült fordítani.

a JPR - szerint meg az nvidia nőtt Q1-ről Q2 -re.----

Steam ( PC Video card usage ) NVIDIA

Q3

- 74.9% ( Aug-Q3 )

- 73.9% ( Jul-Q3)Q2

- 74.1% ( jun-Q2)

- 74.2% (may-Q2)

- 74.4% (Apr-Q2)Q1

- 75.0% (Mar-Q1)

- 83.1% (Feb-Q1)

- 75.5% (Jan-Q1) -

S_x96x_S

addikt

válasz

Busterftw

#49609

üzenetére

Busterftw

#49609

üzenetére

> Steam jol megmutatja, hogy gamingre nagyon veszik az Nvidiakat,

a steam a használatot mutatja

( és a survey -re való válaszadási hajlandóságot )August 2025 Steam hw survey szerint az AMD PC Video card usage

- 17.3 % ( Aug -Q3 )

- 17.8 % ( jul - Q3 )

- 17.7% ( Jun - Q2 )

- 17.6% (May - Q2 )

- 17.5% (Apr-Q2)Nvidia ( PC Video card usage )

- 74.9% ( Aug-Q3 )

- 73.9% ( Jul-Q3)

- 74.1% ( jun-Q2)

- 74.2% (may-Q2)

- 74.4% (Apr-Q2)az nvidia Steam statisztikánál - máj,jun,jul - csökkenés volt; ( az áprilishoz képest )

az amd -nél meg emelkedés.-------

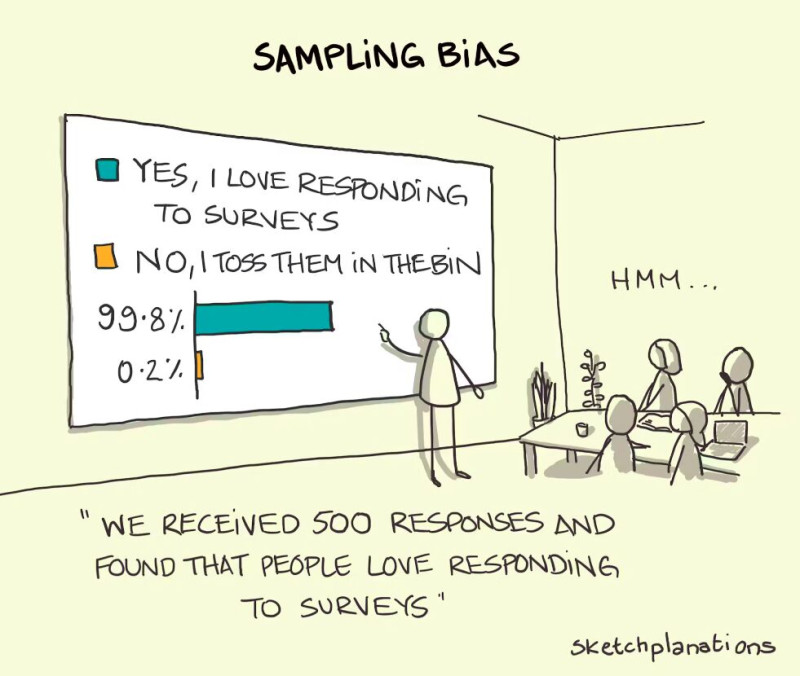

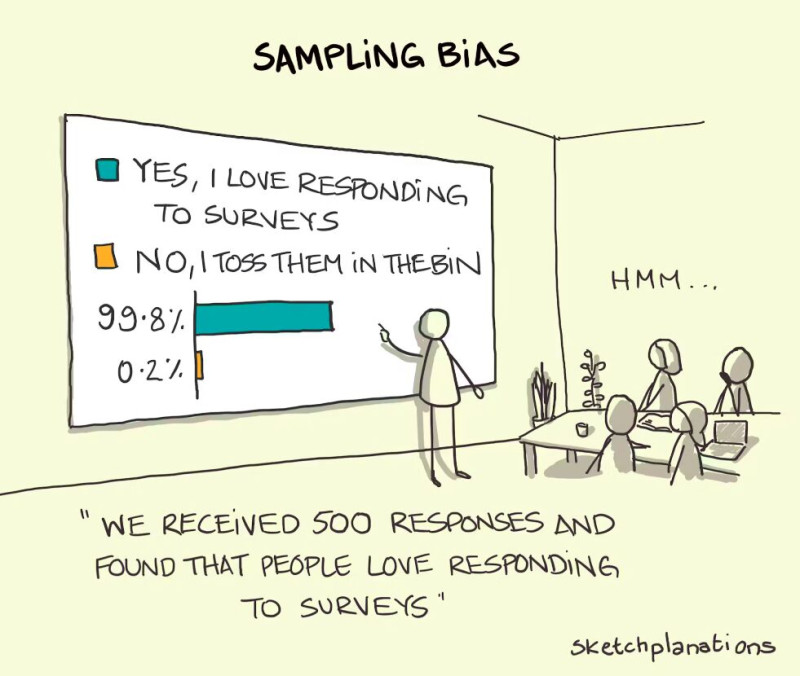

és a válaszadási hajlandóság pedig érdekesen befolyásolhatja az eredményeket,

-

S_x96x_S

addikt

[ pletyka; XBOX Konzol ; AMD Magnus APU; ár ]

"Xbox Next May Cost Twice as Much as PlayStation 6 Due to Magnus APU and Third-Party Stores Support; Xbox PCs Won’t Support Backward Compatibility"

https://wccftech.com/xbox-next-cost-double-playstation-6/"On the other hand, the Xbox next-generation system supporting Steam and GOG games shouldn't have legal issues, and should be feasible on a technical level by running the game inside a virtual machine. However, supporting third-party stores on the system will likely cause the price of the console to be significantly higher than the PlayStation 6, possibly around double, as Microsoft will need to sell the system at a profit without the 30% cut on every game sold on the system and with the added cost of the Magnus APU, which is reportedly a very large APU."

egy linux támogatás - érdekes lenne

Amúgy a Sony PS3 -nál próbálkozott a Linux támogatással, de annak nem lett jó vége. -

S_x96x_S

addikt

válasz

Kolbi_30

#49563

üzenetére

Kolbi_30

#49563

üzenetére

> A szamitogep alapvetoen munkaeszkoz, a konzol meg nem.

> Az mas kerdes, hogy az atlag a gepet jatekra hasznalja..Minden konzol számítógép, de nem minden számítógép konzol

A zx81 ... c64 ... és a mobilok ( ios/android) alapján

hogyha határt akarnánk meghúzni - azt inkább a szabadság fokánál és nem a hardvernél kellene keresni.persze az "öszvérek" a legérdekesebbek:

"Handheld PC for gaming"

ami ránézésre konzol, de megvan a PC szabadsága

GPD WIN 5 - up to 128GB LPDDR5X

és benne a legerősebb x86 -os APU ( Ryzen AI MAX+ 395 ( Strix Halo ) )

16 asztali zen5 maggal + akár 128GB egyesített memóriával

ami munkára is teljesen tökéletes,

hogy ha egy külső monitort és billentyűzetet rákötsz.

és ha - egy AR szemüveggel kombinálod - amin látod a belső képernyőt,

akkor teljesen új lehetőségek nyílnak. ( pl. akár ejtőernyőzés közben tudsz - lokal ai ágens -el programozni ( qwen3-coding ) - vagy akár aknakeresőt játszani - vagy akár a kettőt egyszerre csinálni )És ez még nem is az agyba ültetett chip, amivel a GPU-fanság új definicióját lehetne megalkotni.

Melyik cég (gpu) chipjét ültetnéd az agyadba?![;]](//cdn.rios.hu/dl/s/v1.gif)

( tesla, nvidia, amd, intel, alibaba, huawei ) -

S_x96x_S

addikt

válasz

KAMELOT

#49521

üzenetére

KAMELOT

#49521

üzenetére

Ráadásul ha jól értem, akkor

az új Alibaba chip - NVIDIA ( CUDA? ) sw kompatibilitást is ígér - legalábbis inference-re fókuszálva; persze ez még az első iteráció, és nem lesz sebességbajnok,

de az irányt jól mutatja."Even within China, Huawei’s privileged status is raising some hackles. Many engineers are accustomed to the software and tools that accompany Nvidia’s chips. Huawei, subject to U.S. sanctions, didn’t design its chips to work with the Nvidia platform, whereas Alibaba’s new chip will be compatible with it, meaning engineers can repurpose programs they wrote for Nvidia chips."

"China’s biggest weakness is training AI models, for which U.S. companies rely on the most powerful Nvidia products. Alibaba’s new chip is designed for inference, not training, people familiar with it said."WSJ: Alibaba Creates AI Chip to Help China Fill Nvidia Void

Chinese tech companies spark market exuberance by signaling they are catching up to U.S. ( Updated Aug. 29, 2025 6:31 am ET )és ha jól értem csak az Alibaba legalább - 380 billion Chinese yuan ($53.1 billion) invesztál csak az AI-ba - a következő 3 évben.

( és ~ ekkora összeg az nvidia teljes negyedéves bevétele is ( $46.7 billion )és a Qwen LLM - az Alibaba modellje.

-

S_x96x_S

addikt

válasz

Busterftw

#49513

üzenetére

Busterftw

#49513

üzenetére

> Nem nagyon hívnám ezt versenynek.

USA export-korlátoz,

Kína meg válaszul kvótázik és próbálja erősíteni a saját iparát;

ami persze rövid távon torzítja a piacot,

de közép és hosszú távon ez még jobban felerősíti a kínai AI/GPU-fejlesztést

és a hatása pont az ellenkezője lesz annak,

amit az exportkorlátozási szankciókkal el akartak érni;vagyis ha a kínai ai/gpu cégek megerősödnek - az növeli a versenyt globális szinten.

és ezt még májusban Jensen Huang is megfogalmazta

""""All in all, the export control was a failure," Huang said

...

The U.S. block on sales of advanced AI chips to China has forced companies there to buy semiconductors from Chinese designers such as Huawei, while also spurring China to invest aggressively to develop a supply chain that doesn't rely on manufacturers outside the country.

...

"President Trump realises it's exactly the wrong goal," he said in reference to the prior rules.

From the start of U.S. President Joe Biden's administration, Nvidia's China market share has dropped to 50% from 95%, Huang said."""

-

S_x96x_S

addikt

válasz

Yutani

#49506

üzenetére

Yutani

#49506

üzenetére

> Verseny akkor lesz, amikor nem tetszőlegesen áraznak a gyártók,

Amíg mindkét cég a TSMC-nél gyártat, addig tényleg relativ az ár-verseny.

Viszont, a kínaiak kezdenek begyorsulni - és várhatóan onnan jön majd az új kihívó.

"Shanxi Securities projects that Nvidia’s Chinese market share will decline to 50%–60% within five years, while Chinese competitors will grow to a combined market presence of 40%–50%."

Chinese AI GPU needs and ambitions

Will Nvidia be a minority player in five years?

August 21, 2025

Jon Peddie

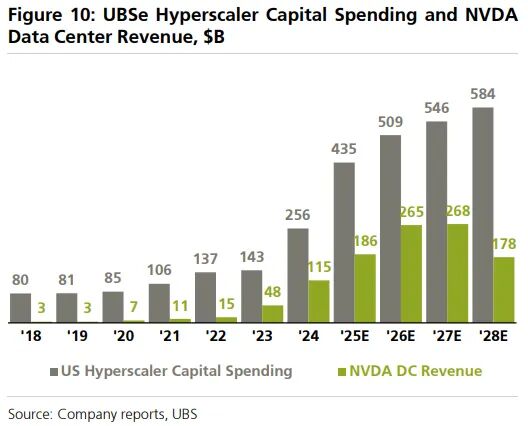

https://www.jonpeddie.com/news/chinese-ai-gpu-needs-and-ambitions/Ettől függetlenül - még lesz 2-3 nagyon jó éve az nvidiának; de utána erős verseny várható.

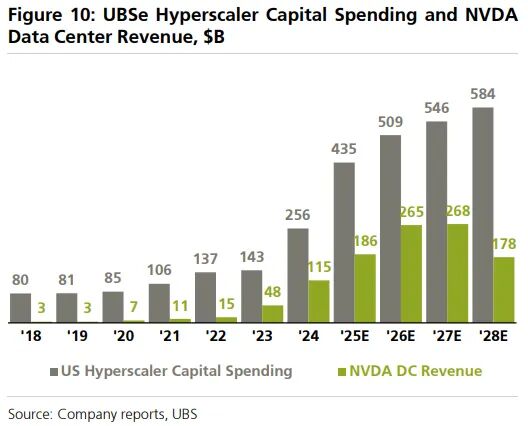

"UBS projects that NVIDIA’s data center revenue will peak in 2027 and start to decline from 2028." https://x.com/Jukanlosreve/status/1959786772503920942

-

S_x96x_S

addikt

> Akkor minek teszed be?

annak a jelzésére tettem be,

- hogy én se értek egyet azzal az állítással , hogy ""senkinek nem kell az 50-es sorozat"

- ráadásul alá is támasztottam - friss- adatokkal --> RTX 5060 ( 50 eladott / hét )

és arra is választ ad, hogy egyik végletes állítás se igaz :- "senkinek nem kell az 50-es sorozat"- "mindenki csak az 50-es sorozatot akarja"és végre kezd kialakulni valamilyen verseny.

-

S_x96x_S

addikt

válasz

Raymond

#49496

üzenetére

Raymond

#49496

üzenetére

> "senkinek nem kell az 50-es sorozat".

megerősítem ... az RTX 50-et veszik

és az AMD is kapaszkodik felfelé ...

( legalábbis egy adott német retail adatai alapján, amiből nem lehet következtetni a globális eladásoktra. )n1. RX 9070 XT ( 760 heti eladott )

n2. RX 9060 XT (520 eladott )

n3. RTX 5070 Ti ( 365 eladott )

n4. RTX 5080 ( 280 eladott )

n5. RTX 5060 Ti ( 160 eladott. )

...

RTX 5060 ( 50 eladott ) <<--- a németek válogatósak."""

GPU Retail Sales Week 34 '25 (mf)

GPU Sales rising.

Unless it is ARC. Mindshare ...ℹ️ Units

AMD: 1500 units sold, 56.93%, ASP: 559

Nvidia: 1115, 42.31%, ASP: 967

Intel: 20, 0.76%, ASP: 290ℹ️ Revenue

AMD: 838344, 43.62%

Nvidia: 1077952, 56.08%

Intel: 5807, 0.3%AMD Dominance:

AMD captures 56.9% of sales, up from 54.6% last week, led by strong performance in high-end models like the RX 9070 XT and RX 9060 XT.Brand Leaders:

XFX and MSI dominate with over 55% combined market share, showing consistent leadership. PowerColor also sees solid growth.VRAM Trends:

16GB remains overwhelmingly popular at 81.6% (up from 79.3%), reflecting demand for memory-intensive applications.Segment Trends:

Next-gen AMD models drive growth, with RX 9070 XT leading at nearly 30%. Total sales increased 4% from last week's 2535, indicating rising market activity, particularly in premium segments.

""" -

S_x96x_S

addikt

( az nvidia "Gaming and AI PC" számviteli kategória kapcsán )

a (szak) sajtó elég lazán kezeli a fogalmakat és

még te is "AI PC" -nek sejteted a dgx spark-ot:

"A vállalat még az idei CES-en leplezte le a Project DIGITS nevű rendszert, amely most megkapta a végleges nevét: DGX Spark. Az otthoni AI-ra kihegyezett koncepció nem változott, így a linkelt hírben leírtak nem módosultak, viszont ennek jön egy nagyobb testvére, DGX Station néven." [ prohardver.hu ]de az is lehet, hogy az nvidia

számviteli szempontból la "Data center" kategóriába sorolja.Persze mivel csúszik a dgx spark rajt ( egyesek már karácsonyt emlegetnek )

egyáltalán nem lehet még tudni - mikor is indulnak a tényleges eladások.

De a gyártás valószínüleg már folyamatban,

és az OEM partnereknél is ott van sok GB10 -es (DGX Spark) chip.

és ezek valahol már szerepelnek is az nvidia beszámolóban.De vajon melyik kategóriában jelennek meg ezek a bevételek?

amúgy az nvidia beszámoló a partnereknek ( ~ viszonteladó, OEM, disztribútor) leszállított termékekből származó bevételt tükrözi,

és nem a végfelhasználók vásárlásait ( ~ fogyasztók , gamerek)valamint a Blackwell -nél a GDDR7 memória chip is növelheti a bevételt,

vagyis nehéz számszerűsíteni az adatokat.Amúgy a jelenlegi "Borderlands 4" promó - valamennyire azt is jelzi,

hogy tele vannak a raktárak, és nincs baj a készletekkel,

vagyis nem kell félni, hogy hiány lesz.

----

Igazából engem ez érdekel:

- melyik (számviteli) kategóriába tartozik a "DGX Spark" ? -

S_x96x_S

addikt

válasz

DudeHUN

#49454

üzenetére

DudeHUN

#49454

üzenetére

> Nem meglepő. Bloombergről köztudott, hogy kínai payrollon vannak.

a Gamernexus szerint a Bloomberg az nVidiától is függ.

( amúgy szerintem egyszerűbb lenne kivágni a Blommberges részeket a videóból, mint meggyőzni egy Bloomberges ügyvédet. )Gamer Nexus: Our Channel Could Be Deleted

https://www.youtube.com/watch?v=tUnRWh4xOCY

"Bloomberg LP filed a copyright strike against GamersNexus on YouTube, targeting our NVIDIA AI GPU Black Market movie that we uploaded last week. The illegitimate and invalid copyright strike abuses the YouTube copyright strike system via a DMCA takedown notice. GamersNexus has filed a counterclaim, sent a demand letter to Bloomberg, and has dug into some possible motives for the illegitimate claim. These include deeper financial ties with NVIDIA, ties to China and Singapore, a failed competing video by Bloomberg, and more." -

S_x96x_S

addikt

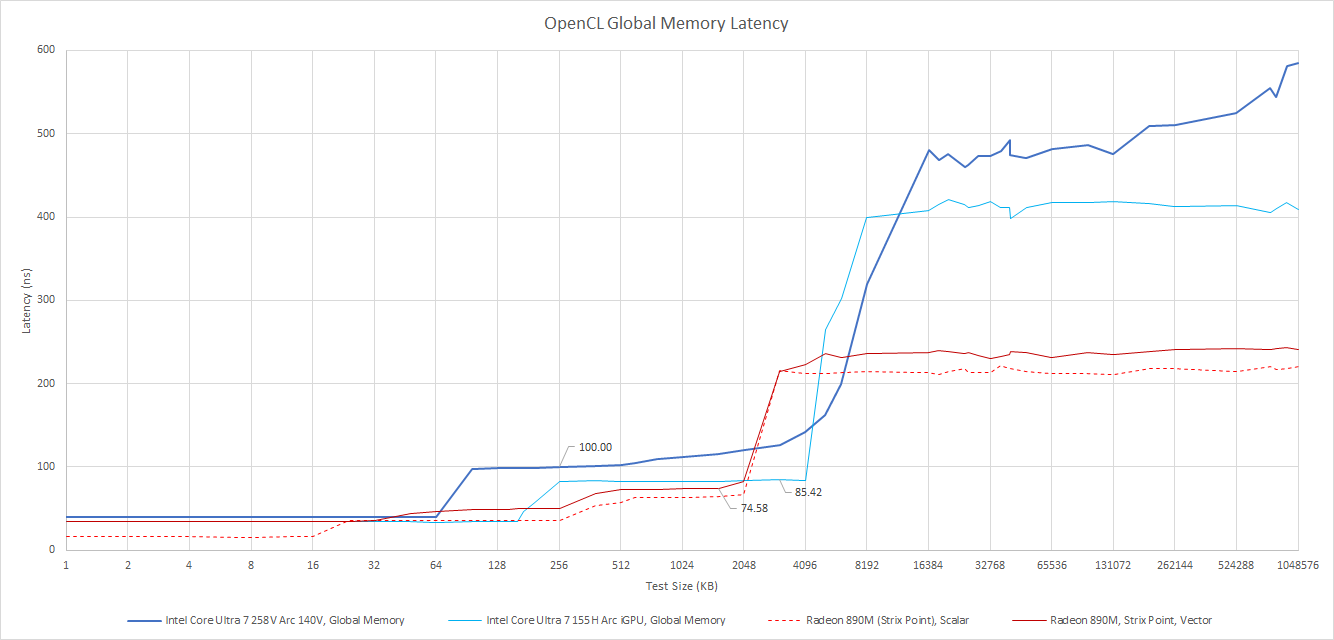

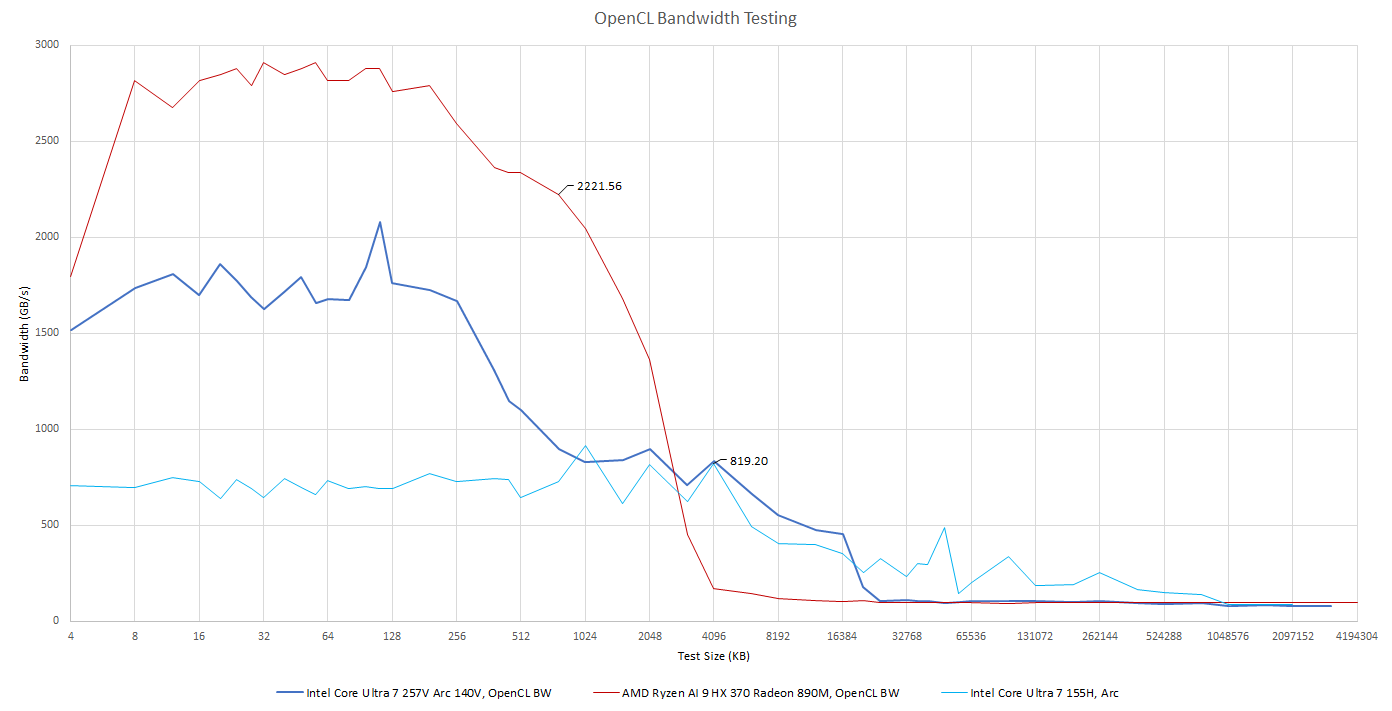

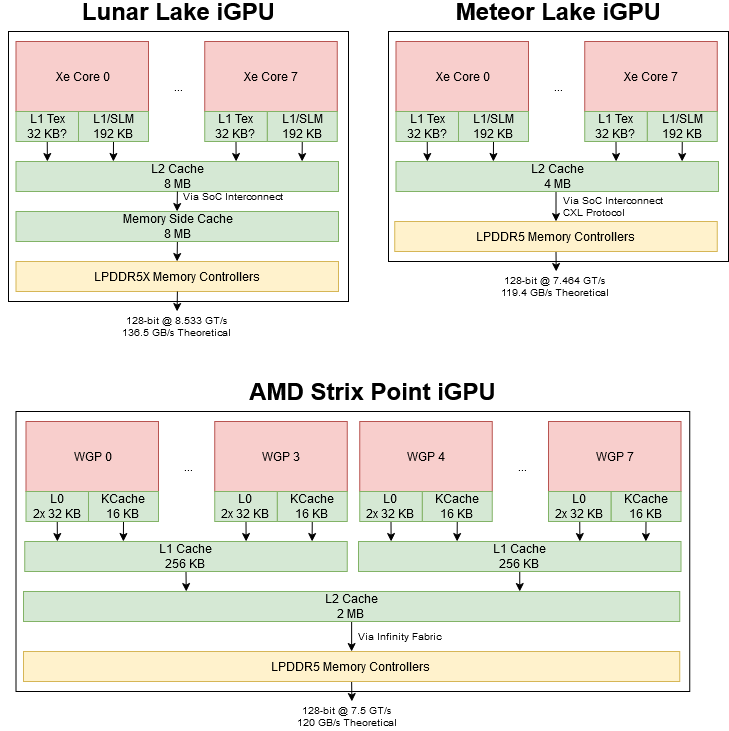

> Csak a képeket nézve a Strix Point a Lunar Lake-hez képest

> nagyon rosszul áll cache-ben minden szintena cache a latency alacsony tartása miatt van;

és az alapján már teljesen más következtetésre lehet jutni.

"Outside the Xe Core, Lunar Lake doubles L2 cache capacity to 8 MB. That’s the biggest L2 cache I’ve seen in a laptop iGPU so far. However, latency has substantially increased over Meteor Lake’s 4 MB L2. Lunar Lake also sees a weird uptick in latency well before the test approaches L2 cache capacity. It’s not address translation latency because testing with a 4 KB stride didn’t show a latency jump until 64 MB, implying a single thread has enough TLB capacity on hand to cover 64 MB."

"AMD’s Strix Point has a smaller but lower latency L2 cache. Even though the L2 is smaller, Strix Point has a lower latency penalty for accessing DRAM. On Lunar Lake and Meteor Lake, a GPU-side DRAM access has over 400 ns of latency. Strix Point’s iGPU can get data from DRAM in under 250 ns. Lunar Lake has a 8 MB memory side cache placed in front of the memory controller, but I can’t clearly measure its performance characteristics."

( via https://chipsandcheese.com/p/lunar-lakes-igpu-debut-of-intels )

-

S_x96x_S

addikt

válasz

paprobert

#48275

üzenetére

paprobert

#48275

üzenetére

> Azt tudom csak elképzelni, hogy az integrált RAM jótékonyan hat az arch

> kihasználtságára, és ettől kilő a teljesítmény a relatíve kis méretben.A lunarLake és az előző generáció között teljesen más tervezési filozófiát

és valószínüleg teljesen más tranzisztor könyvtárt használtak ( TSMC3 vs. INTEL4 )"""

George Cozma:

Again, back to the previous generation, you had a GPU, tile, an SOC tile, and an iGPU tile. On Lunar Lake, that’s now all been reintegrated on to a single die. What was the why move back to a more monolithic design for those parts of the design?

Arik Gihon:

Yeah. So it was a trade off, actually. When you start building the project, you start to think which transistor you want to put on which node. And since we have selected the entry, we could fit, more transistors into entry in one monolithic die. And the second is that it was an optimized die just for a specific segment.

You don’t need to stay for the entire family and up to desktops with that. And also, we could just put all of the transistors, all of the compute transistors, on the same die very close to the memory and therefore gain latency and gain performance. So you both gain good process for all of those as well as for the SoC components and the memory components, and closer to the memory.

George Cozma:

And so then sort of a follow-up to that, why did you leave the what you’re calling the platform controller die, as its own separate die? Was that because the stuff on that die doesn’t scale as well with newer nodes?

Arik Gihon:

It just didn’t need to scale. Those transistors are usually controllers for IOs. They can fit nicely into N6’s process, and the IOs are working there very good. So it was a nice partition.

"""

https://chipsandcheese.com/p/an-interview-with-intels-arik-gihon-about-lunar-lake-at-hot-chips-2024-------

Ami még érdekes lehet az Xe2 és az AMD-s tervezési eltérésekről:

"Lunar Lake’s iGPU: Debut of Intel’s Xe2 Architecture"

https://chipsandcheese.com/p/lunar-lakes-igpu-debut-of-intels

-

S_x96x_S

addikt

válasz

paprobert

#48272

üzenetére

paprobert

#48272

üzenetére

> Lunar Lake 3nm:

> 140mm2 a compute tile, amiből a GPU 25%inkább ~ 33% körül lehet;

pl. a "Display Control Logic" - az NPU tól balra található - a 4E core alatt."Next to the NPU is the Xe2 Battlemage integrated GPU,

which, along with its display and media controller components,

occupies nearly one-third of the Compute tile's die area. "

https://www.guru3d.com/story/intel-lunar-lake-processor-architecture-die-and-pch-annotated/

> Strix Point 4nm:

> 232.5mm2 a teljes lapka, amiből a GPU 30%a reddit-en a strix-point - GPU -t 21% -ra becsülték.

"""

Using the best I can get as the subtraction of 2 rectangles (screenshot limitation), the CPU, GPU, and NPU consume 26%, 21%, and 7% of the die area.

4 RDNA3.5 work groups is 3.7% of the die area. The NPU compute is 2.9%.

""" -

S_x96x_S

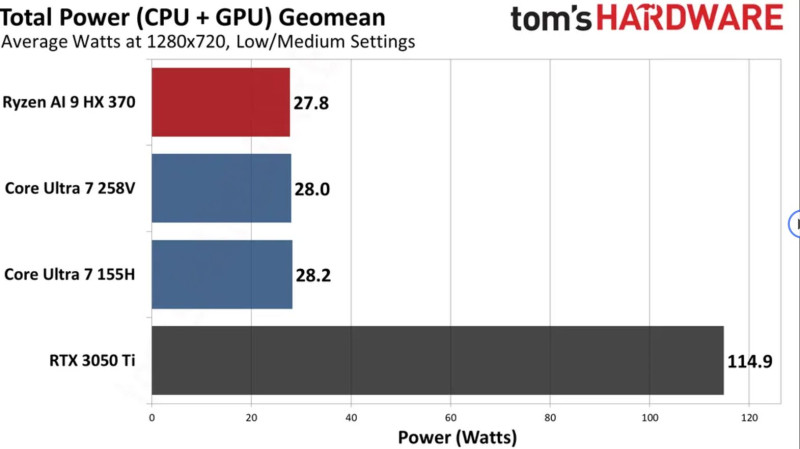

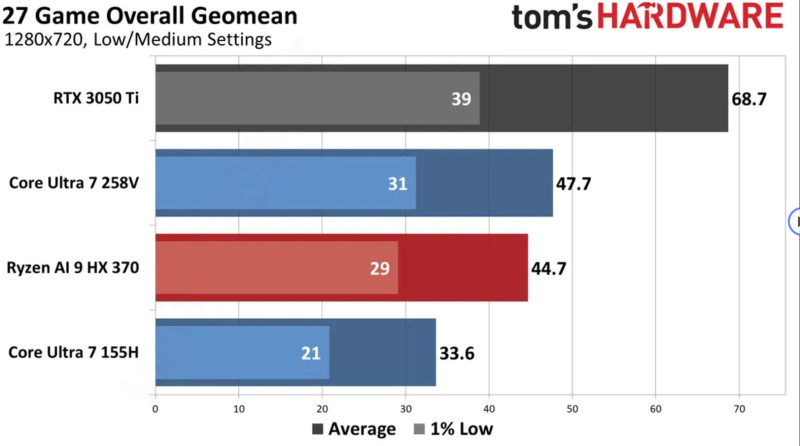

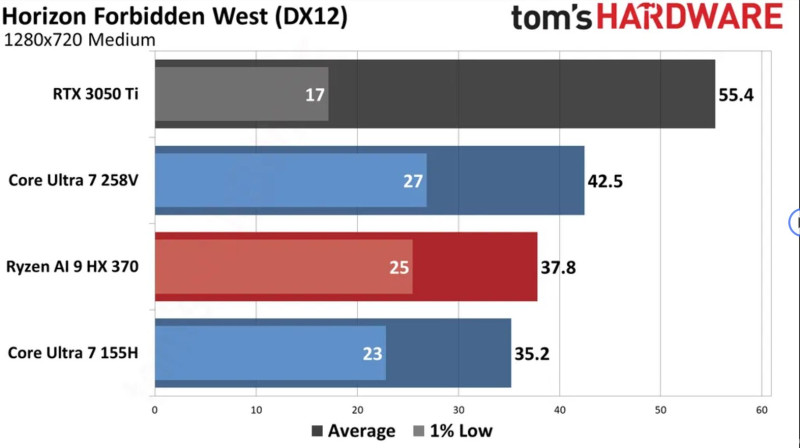

addikt

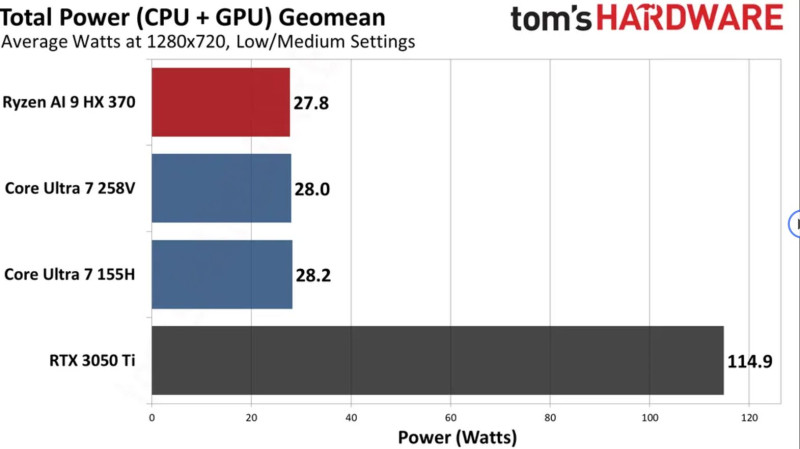

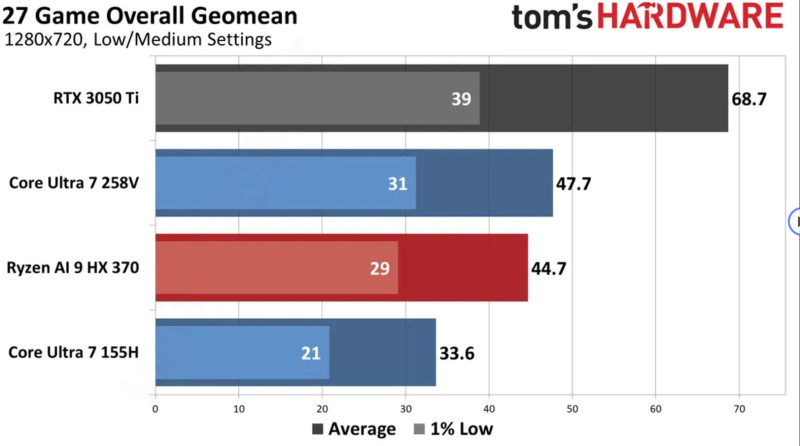

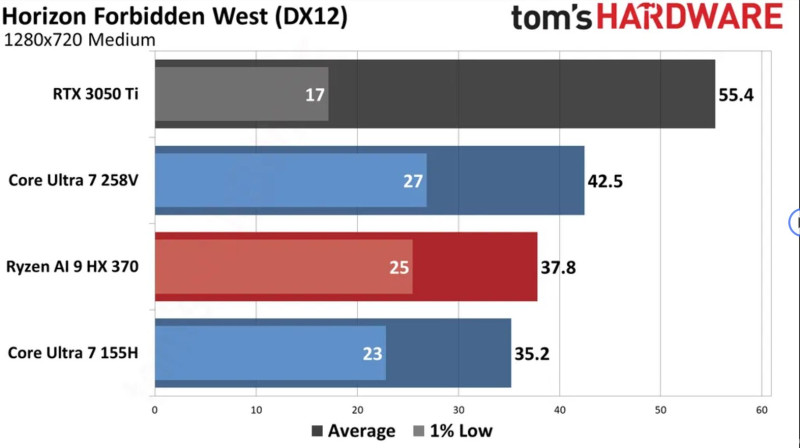

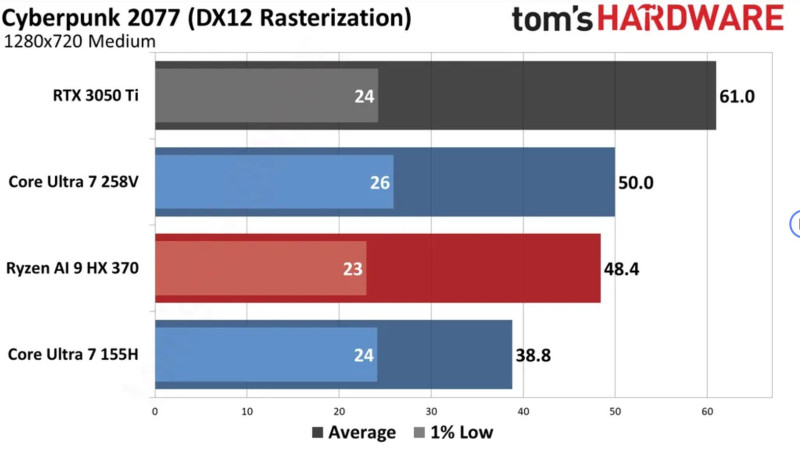

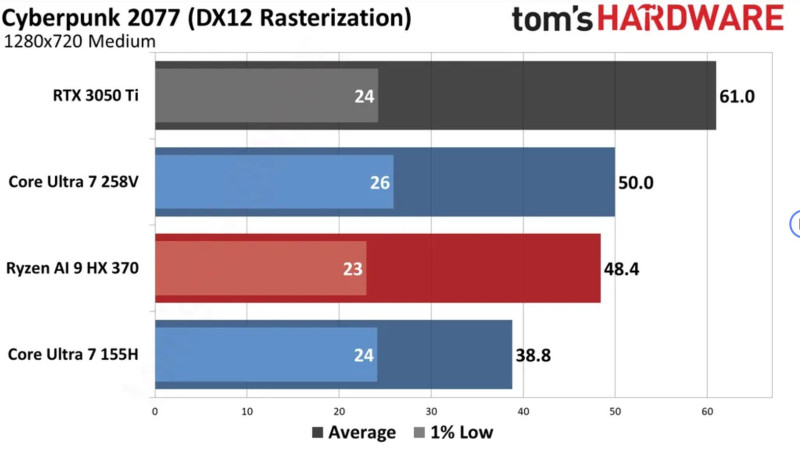

> Miért az RTx 3050 micsoda ,ha nem olcsó GPu megoldás?

az idézett cikk

"Intel takes down AMD in our integrated graphics battle royale — iGPUs are still nowhere near dedicated GPU levels but use much less power"

https://www.tomshardware.com/pc-components/gpus/intel-takes-down-amd-in-our-integrated-graphics-battle-royale

éppen azt fejtegeti, hogy az árához képest

- se teljesítményben

- se fogyasztásban

már nem annyira gazdaságos egy RTX3050;

Persze budget "RTX 3050" - laptop helyett RTX 3050 Ti -el teszteltek:

"We wanted that specifically, or the RTX 3050, just to see how a budget dedicated RTX GPU stands up to the latest integrated solutions."És a grafikonokat látva tényleg nem az a "true budget"

aminek minimális 4GB VRAM - lehet az oka;

ami manapság már nem sok mindenre elég:

"The Last of Us, Part 1, refused to run on the RTX 3050 Ti laptop, showing an "insufficient memory" error. We're not sure if that's purely from the 4GB of VRAM, or if it's the combination of VRAM and system RAM."

--

a cikkből:"""

And then look at the gaming laptop, which uses 39.2W on average for the CPU, and 77.3W on average for the RTX 3050 Ti. We suspect that with a slightly different and newer graphics solution, like the RTX 4050 laptop GPU, performance would be improved thanks to the additional VRAM, and the CPU and system RAM might also hold back the 3050 Ti. But it's still interesting to see just how big the gap is between the iGPU solutions and the dedicated GPU.

Nvidia GPUs can also run in lower power modes, though we did some limited testing with a 30W power limit and found that performance dropped substantially in that case, with the 3050 Ti often falling below the fastest iGPU solution. There's a good reason we never liked the RTX 3050 or 3050 Ti laptop GPUs. Beating a newer iGPU doesn't require much performance, really.

"""

A fogyasztás -

És ez a teljesítmény - 27 játék átlaga :

és pár random ( csersznyézgetve )

-

S_x96x_S

addikt

> RDNA3 (és azt ígérték, hogy 50%-kal jobb lesz).

Pontosabban "up to 50%"

![;]](//cdn.rios.hu/dl/s/v1.gif) -ot ígértek "per watt".

-ot ígértek "per watt"."Experience up to 50% greater performance per watt with AMD RDNA 3, compared to the previous generation AMD RDNA 2."

és az apró betűnél:

"Based on AMD labs testing in November 2022, on a system configured with a Radeon RX 7900 XTX GPU, driver 31.0.14000.24040, AMD Ryzen 9 5900X CPU, 32GB DDR4-3200MHz, ROG CROSSHAIR VIII HERO (WI-FI) motherboard, set to 300W TBP, on Win10 Pro, versus a similarly configured test system with a 300W Radeon 6900 XT GPU and driver 31.0.12019.16007, measuring FPS performance in select titles. Performance per watt is calculated using the manufacturers’ stated total board power (TBP) of the AMD GPUs listed herein. System manufacturers may vary configurations, yielding different results. RX-816."

( https://www.amd.com/en/technologies/rdna.html ) -

S_x96x_S

addikt

válasz

bertapet11

#48250

üzenetére

bertapet11

#48250

üzenetére

> de cserébe gyorsabb is

a verseny jó;

és most már az Intel is szorongatja "budget gpu" fronton az nvidiát,

és emiatt se lesz olcsó nVidia megoldás a jövőben --> mert gazdaságilag nincs értelme.a hivatkozott cikkből:

".... , budget gaming solutions are clearly in sight. Perhaps that's why we haven't really seen any true budget GPU solutions from Nvidia for several years, with the least expensive models often adding several hundred dollars to the price of a PC or laptop."

( via )Persze, hogyha lesz az nVidiának saját desktop-os chipje, ( arm-windows )

akkor ez megváltozhat - és jöhetnek a budget nVidiás megoldások. -

S_x96x_S

addikt

válasz

bertapet11

#48233

üzenetére

bertapet11

#48233

üzenetére

Az Intel egyre versenyképesebb;

és van egy táblázat is a cikkben: AMD Claims Its Ryzen AI 300 APUs Demolish Intel Lunar Lake in Gaming Performance, Over 2x Uplift With FSR 3 In AAA Titles

AMD Claims Its Ryzen AI 300 APUs Demolish Intel Lunar Lake in Gaming Performance, Over 2x Uplift With FSR 3 In AAA Titles -

S_x96x_S

addikt

válasz

huskydog17

#48207

üzenetére

huskydog17

#48207

üzenetére

> Ha elolvasnád a két tesztet, talán rájönnél mekkora marhaságokat hordasz össze

> és miért nincs köze a témához az általad felhozott dolgoknak.mert miért is ?

A két teszt egyáltalán nem vizsgálta az eltérés okát, és magyarázatot se próbált adni.

Én mint egy lehetséges okként adtam meg az eltérő optimalizációt.Egyes Digital foundry tesztek az esetleges minőség különbséget is próbálták ellenőrizni, ami itt egyáltalán nem történt meg.

-

S_x96x_S

addikt

válasz

huskydog17

#48203

üzenetére

huskydog17

#48203

üzenetére

azért írtam, mert szerintem meg fontos

- mindkettő (VRAM, Szponzoráció)> A VRAM témát kár volt ide keverni, kevered a szezont a fazonnal.

Adaptive grafikai optimalizáció már nem újdonság,

amikor a játék dinamikusan beállítja a textúra minőségét

és egyéb grafikai beállításokat, hogy illeszkedjen a VRAM-hoz ( 8GB vs. 12GB vs 16 GB ) , megelőzve ezzel a komoly teljesítménycsökkenést.Hogy ezt ki lehessen zárni, nem árt hasonló VRAM mennyiséggel tesztelni és nem úgy ahogy te javasoltad. ( 12gb vs. 16gb )

-

S_x96x_S

addikt

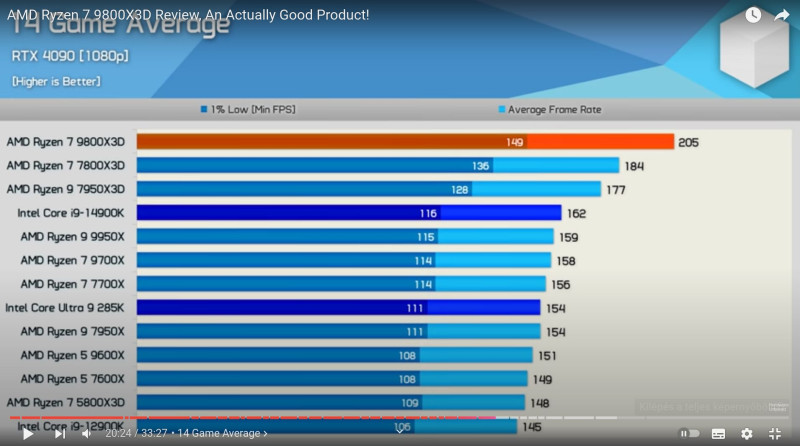

> Vicc, többet fogyaszt mint a 7800X3D és alig gyorsabb...

A HU - "kivételesen" meg van vele elégedve.

https://youtu.be/BcYixjMMHFk?t=1224

https://youtu.be/BcYixjMMHFk?t=1224

-

S_x96x_S

addikt

válasz

huskydog17

#48195

üzenetére

huskydog17

#48195

üzenetére

> Az általad linkelt információknak ..

Több mindenről írtál - pl "Dragon Age: The Veilguard PC Benchmark" - kapcsán,

és mellékeltél 2 tesztet is.A probléma oka lehet:

- az adott játék jobban Nvidia optimalizált

- Automatikus lebutítja a játék az alacsony VRAM esetén a minőséget, emiatt az gyorsabbnak tünik.

- az RDNA3 ( driver, hw ) nem optimális erre

- vagy mindegyik.Az alacsony VRAM például befolyásolhatja az általad említett példát, mivel 16GB VRAM vs. 12GB VRAM - ot hasonlítottál.

"Az RX 6900 XT 1080p-n még a sima RTX 4070-es tempóját sem hozza, de 4K-ban már gyorsabb."

És míg 16 GB VRAM -nál még nem biztos, hogy aktiválódik a grafika automatikus lebutítása, egy 12GB -os-nál már valószínűbb a szoftveres butítás - és az ezzel járó sebességelőny.Amúgy a felvetett probléma érdekes,

de 16GB VRAM -ot kellene 16GB VRAM-al hasonlítani, hogy korrekt legyen

és ki lehessen zárni más dolgokat.A PS5-ös portok amúgy is érdekesek, főleg hogy már PS5 PRO -ra is optimalizáltak, mivel azok több mint 12 GB VRAM-ra vannak optimalizálva;

ráadásul eleve a zen2-es cpu-val kell beérniük a játékoknak -

S_x96x_S

addikt

válasz

huskydog17

#48187

üzenetére

huskydog17

#48187

üzenetére

> Dragon Age: The Veilguard PC Benchmark

> Ez már a sokadik játék, ahol az RDNA3 arch masszív CPU limitbe fut 1080p felbontáson.Jellemzően ez - nVidia optimalizált és szponzorált - PC-s port.

"DLSS 3 Accelerates Performance In Dragon Age: The Veilguard, Horizon Zero Dawn Remastered and Red Dead Redemption This Week"

https://www.nvidia.com/en-us/geforce/news/dragon-age-veilguard-dlss-3-ray-tracing/"Game Ready For Dragon Age: The Veilguard, Featuring DLSS 3, Reflex & Ray Tracing"

https://www.nvidia.com/en-us/geforce/news/gfecnt/202410/dragon-age-veilguard-geforce-game-ready-driver/> 1080p/1440p felbontáshoz leendő a 10-12 GB VRAM.

> 4K maxhoz (beleérte az RT-t is) ajánlott a 16 GB.A VRAM egyre inkább számít,

és a 12GB -os kártyákat hamar kinövik a játékok.

- RTX 4070 Ti GeForce

- RTX 4070 SUPER GeForce

- RTX 4070 -

S_x96x_S

addikt

> épp ezért kéne nagyon beleállniuk Intel oldalról a gamer piacért folytatott versenybe.

az Intel a túlélésért küzd.

focis hasonlattal: a kiesést kell elkerülnie. ( vagy másképpen a csődöt ) és nem az a probléma, hogy nem a dobogós helyen végez.Süllyedés közben felesleges a Titanic fedélzetén átrendezni a székeket,

különösen azért, hogy a high-end gamer piaci szereplők közelebb ültessenek a kapitányhoz.![;]](//cdn.rios.hu/dl/s/v1.gif) Nem az a legfontosabb.

Nem az a legfontosabb.

Elsőként meg kell állítani a süllyedést.Vészhelyzet esetén teljesen mások a prioritások.

-

S_x96x_S

addikt

> Mintha csak a Ferrari kiszállna a Forma 1-ből,

A Volkswagen sem versenyzik a Forma-1-ben.

Az csak a prémium márkák - nagy árrésses - luxusa.Amúgy az AMD ( Lisa Su ) - amióta több pénze van - Forma1 rajongó lett.

valószínüleg ugyanaz a szerepe - mint a magyar focinál - a nagy üzletek ott köttetnek.

( és nem a golf pályán )

https://www.amd.com/en/corporate/sponsorship/mercedes.html

És bár az AMD - nem versenyzik az RDNA4 -el a high-end ben,

mert ebben a körben a market share -re mennek rá,

( és majd az RDNA5 lesz becélozva a csúcsdöntésre )A high-end gaming - csak a piac töredéke:

Mert mennyi az RTX 4090 és az RTX 3090 részaránya ? ~2.0 %

- 4090 : 1.19%

- 3090 : 0.63%Persze a Youtuberek alapján, az a benyomása lehet sokaknak;

hogy az RTX4090 - a gamerek 20-40 %-nak van.

de az csak egy illuzió.-------

és ha tűzoltás van az AMD és az Intel háza tájékán - akkor a high-end gaming piac az amit a relative kis piaci súlya miatt be lehet áldozni.

Steam Hardware & Software Survey: October 2024

https://store.steampowered.com/hwsurvey/videocard/ -

S_x96x_S

addikt

> Akkor hosszútávon a desktop pc-k esetében is a diszkrét artchitektúra megfog szünni?

nem lehet biztosan tudni,

( azért se mert néha egyes technológiák feltámadnak )

de a költséghatékonyság az egylapkás rendszerek felé tol sok mindent.

https://en.wikipedia.org/wiki/System_on_a_chipelső lépésben szerintem inkább olyan lesz mint a

[ mobiltelefonos/notebook-os] integráció - és erős IGP/APU, ami a feladatok 90%-ra elég.Ha az nVidiának lesz saját Desktop platformja, akkor a verseny teljesen átalakul.

Azt is eldöntheti az nVidia, hogy egyes újdonságokat elsőként a saját platformjára hoz ki

és az Intel/AMD/.. platformokat majd később támogatja.

Vagy úgy áraz, hogy a saját platformja felé lejtsen a lejtő.

Persze már régóta az AMD és az Intel is dolgozik a saját egyre fejlettebb IGP-s megoldásain ( főleg a mobil piacot célozva )

és az nVidia tere amúgy is kezd beszűkülni.És a Microsoft is elég sokáig kivárt -

de most már látja, hogy csak az X86 -al nem lesz versenyképes a jövőben - és több lábra kell állnia.

És az Intel sorsa is bizonytalan. -

S_x96x_S

addikt

> Valóban van ráció abban, hogy az NVIDIA beléphet a CPU szegmensbe is?

Az integrált SOC -oké a jövő; az nVidiának is lépni kell.

- 2020 -ban - meg akarta venni az ARM -es chip fejlesztő céget,

( de nem sikerült )- és dolgoznak a saját pc-s chip-jükön is ( a Mediatek -el )

"Nvidia's 'high-end' Arm-based chip for PCs will reportedly go into production in 2025"- A [HPC/DC] : "NVIDIA Grace CPU (arm) " - pedig már kapható.

https://www.nvidia.com/en-eu/data-center/grace-cpu/ -

S_x96x_S

addikt

egységben az erő.

"UALink Consortium poised to compete with Nvidia's NVLink — AMD and Intel-led group opens doors to contributor members"

TomsHW"""

The UALink standard's release in Q1 2025 will line up with the release of version 1 of Ultra Ethernet, and AMD recently announced the industry's first Ultra Ethernet-ready 400GbE card. UALink and Ultra Ethernet are both made up of industry giants seeking to dethrone Nvidia and are almost assured to succeed as open standards in the AI data center space thanks to their wide levels of support. "The work being done by the companies in UALink to create an open, high performance and scalable accelerator fabric is critical for the future of AI," said Forrest Norrod, executive VP and general manager of the Data Center Solutions Group at AMD.

Samsung is likely to be among the first Contributor members of the Consortium, as it announced its intentions to join back in June. The Ultra Ethernet Consortium will also likely see a lot of crossover, and industry giants such as Baidu, Dell, Huawei, IBM, Nokia, Lenovo, Supermicro, and Tencent joined as contributors to UE in the last few months. Nvidia is expected to remain outside of the Consortium, as its NVLink and Infiniband technologies are proprietary and have seen widespread use already thanks to the company's dominance of the AI data center market.

""" -

S_x96x_S

addikt

válasz

Chiller

#48112

üzenetére

Chiller

#48112

üzenetére

(panaszkodás, first world problem)

én a memória áraktól kapok sokkot, legalábbis egyes konfigoknál.

Az Asus ProArt P16 ( Ryzen™ AI 9 HX 370 + RTX4070M(8GB) + OLED )

A 64 GB LPDDR5X on board memóriás változat = ( a 32GB változat + ~700 EUR )

amiből a végén "1 455 990 Ft" lesz.

vagyis a +32GB RAM-ot +700 EUR -ért adják.

És mennyi lesz a StrixHalo 128GB -os verziója?-----

ehhez képest

a MacBook Pro 36GB->96GB ( +60GB = +920 EUR )

már gazdaságosnak tűnik. -

S_x96x_S

addikt

(várhatóan) lesz chiplet GPU - az Inteltől is.

"Intel Files a Patent For “Disaggregated GPU” Design, Are We Going To See “True” Multi-Chiplet GPUs Soon?"

https://wccftech.com/intel-files-patent-disaggregated-gpu-design-true-multi-chiplet-gpus-soon/

-

S_x96x_S

addikt

spekuláció:

"Next-Gen GeForce RTX 50 laptops to rely mainly on older Intel and AMD CPU architectures"

https://videocardz.com/newz/next-gen-geforce-rtx-50-laptops-to-rely-mainly-on-older-intel-and-amd-cpu-architectures

Remélhetőleg - azért lesznek kivételek is. -

S_x96x_S

addikt

> Miért adott ki nem rég az AMD "új" Zen 3-as procikat, mikor már van Zen5?

közgazdaságtan.

+ Hogy növelje a bevételt és a piaci részesedését

+ Mert lehajol a legkisebb fillérért is ( a zsiros dolgok után )

+ és mert csak az AM4-el tud versenyképes - budget - platformot szállítani. ( ahol az alaplap és a memória ára is számít a cpu -val )

+ hogy összezavarja az Intel vásárlókat, emlékeztetve őket - hogy az AM4 platform jó döntés volt. -

S_x96x_S

addikt

válasz

Devid_81

#48101

üzenetére

Devid_81

#48101

üzenetére

> AMD eleve nem tud normalisan arazni, ezt lattuk mar parszor,

Mutass egy céget, aki jól tud árazni -

De úgy hogy szubjektíven nem a saját zsebedhez viszonyítod!Amúgy te milyen módszertannal - áraznál az nVidia/AMD/Intel helyében?

úgy, hogy a rendszer fenntartható legyen hosszú távra!Lehetőleg úgy, hogy:

- a dolgozók is elégedettek legyenek

- a befektetők is elégedettek legyenek

- és a vásárlók is elégedettek legyenekÉs ha nem lehet mindenkit boldoggá tenni, mi legyen a jó választás?

Mert:

- ha a dolgozók is elégedetlenek - elhagyják a céget, annyi a cég jövőjének

- ha a befektetők elégedetlenek - akkor leváltják a menedzsmentet.

- ha a vásárlók elégedetlenek - és nem veszik a terméket : akkor baj van!de ha a vásárlók elégedetlenek ÉS veszik a terméket : akkor nincs akkora baj

-

S_x96x_S

addikt

válasz

paprobert

#48103

üzenetére

paprobert

#48103

üzenetére

> Az Asus vagy a Lenovo szemszögéből persze hogy drágább

> a Lunar, mint egy Celeron vagy egy Mendocino,

> de látni kell hogy közben az almánál milliószámra hordják

> a vásárlók kb. ugyanezt a szintű hardvert (drágábban).Hogy tisztázzuk a félreértést:

Az Asus és a Lenovo

- meglepő módon nem gyárt Apple-t

- és a saját nyeresége érdekli - nem az ami a mások zsebébe csorog.

> Szóval hol megy félre a versenyképesség?

Ez csak egy jelzés, hogyha drága az Intel,

akkor az AMD alapú gyártást fogják jobban preferálni, mert arra lesz jobban kereslet. -

S_x96x_S

addikt

válasz

Devid_81

#48097

üzenetére

Devid_81

#48097

üzenetére

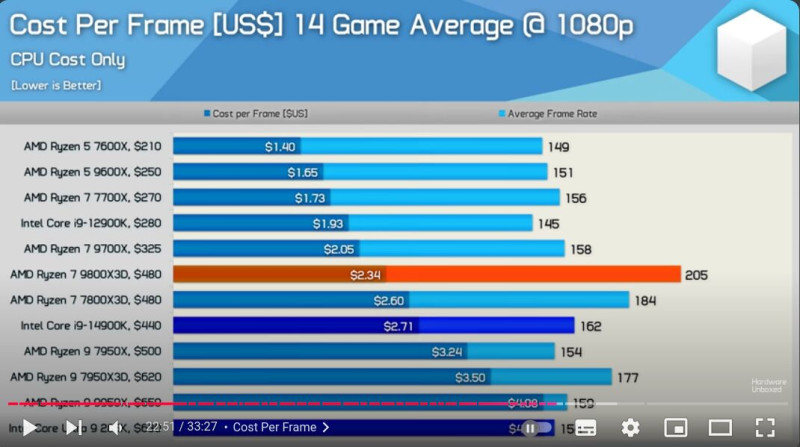

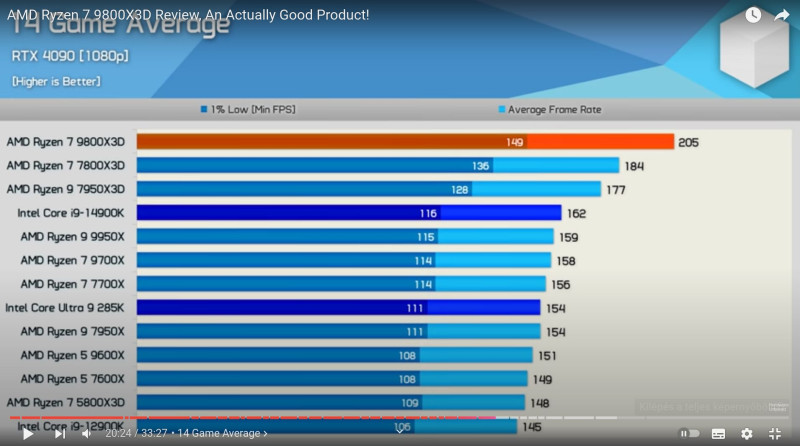

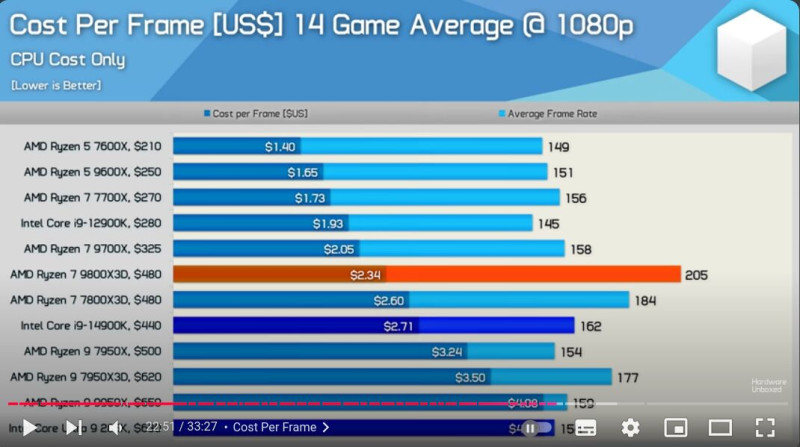

(9800X3D)

> Kar, hogy konkurencia hianyaba ez oda lesz arazva ahova nem szegyellik.Amíg van aki megveszi ilyen áron is, addig ezzel nincs baj.

( és a verseny ezért is jó )Az AMD-nek el kell döntenie,

- hogy eleve hiány legyen és a skalperek fölözzék le a hasznot,

- vagy az árral szabályozza a keresletet, amíg a gyártás utol nem éri a keresletet

- 1-2 hónappal később dobja piacra, amíg tele nem lesznek a raktárak.És kell az AMD-nek is a pénz a zen6/zen7/zen8/... fejlesztésére.

-

S_x96x_S

addikt

> De ezt alá tudod valami méréssel támasztani?

ott van pl. a sakk.

A profi sakkozók jelenleg Threadripper -ben gondolkodnak - hogy legyen teljesítmény az elemzésekhez.

https://stockfishchess.org/pl.

https://www.phoronix.com/review/amd-linux-threadripper-pro-7995wx/7 -

S_x96x_S

addikt

> Gamék nem igazán fognak mostanában 8/16-nál többet használni,

Játéktól és játék motortól függ,

de én azért a közeljövőben várok valamilyen változást.

// persze aki évente cseréli a konfigját, annak oly mindegy ;

// de 3-5 évre már fontos lehet a tartalék.a Civ7 4K -hoz

"CPU: Intel Core i7-14700F / AMD Ryzen 9 5950X" lesz az ajánlott konfig.És az UE 5.4 - már sokkal jobban párhuzamosítja a feladatokat.

"RHI - Render Parallelization"

"Render Thread performance is very often the limiting factor for UE titles. This is because some operations are restricted to this particular thread, even though current platforms and graphics API can do them in parallel. The goal is to improve performance by refactoring the Renderer Hardware Interface (RHI) API to remove these constraints and fully utilize the multithreading capabilities of the target hardware.

We shipped a major refactor of the rendering systems in 5.4 which allows for far greater overlap of work, which in turn permits lower target frame times. In our CitySample testing, the render thread performance is roughly 2x faster in 5.4 as compared to 5.0."

https://dev.epicgames.com/documentation/en-us/unreal-engine/unreal-engine-5.4-release-notes

Az UE5.5 -ben is lesz pár fejlesztés:

https://portal.productboard.com/epicgames/1-unreal-engine-public-roadmap/c/1640-graph-executor-v2

"The new version of the PCG Graph Executor scales better under multithreading applications, and makes it possible to run PCG tasks not bound to the engine frame time. This helps limit the impact of PCG on responsiveness and framerate and improves execution wall-times significantly in both Editor and Runtime use cases." -

S_x96x_S

addikt

> Épp ezaz ami miatt érdekelne, hogy az AMD merre fejleszt tovább.

e cikk:

"A closer look at Intel and AMD's different approaches to gluing together CPUs"

- Epycs or Xeons, more cores = more silicon, and it only gets more complex from here

- While Intel eventually saw the wisdom of AMD's chiplet strategy, its approaches couldn't be more different.

https://www.theregister.com/2024/10/24/intel_amd_packaging/szerint az (AMD) jövő olyan lehet mint az MI300 ,

vagyis moduláris APU alapra - legózni az UDNA és a CCD-s gyorsítókkal.

Ha minden UDNA - akkor RTX 5090 rivális

Ha minden CCD - akkor Xeon rivális."""

Alternatively, the chipmaker could also pack more cores onto a smaller die. However, we suspect that AMD's sixth-gen Epycs could actually end up looking a lot more like its Instinct MI300-series accelerators.

As you may recall, launched alongside the MI300X GPU was an APU that swapped two of the chip's CDNA3 tiles for a trio of CCDs with 24 Zen 4 cores between them. These compute tiles are stacked atop four I/O dies and are connected to a bank of eight HBM3 modules.

Now, again, this is just speculation, but it's not hard to imagine AMD doing something similar, switching out all that memory and GPU dies for additional CCDs instead. Such a design would conceivably benefit from higher bandwidth and lower latencies for die-to-die communications too.

Whether this will actually play out, only time will tell. We don't expect AMD's 6th-gen Epycs to arrive until late 2026

"""vs. Intel

"""

"Intel's I/O dies are also quite a bit skinnier and house a combination of PCIe, CXL, and UPI links for communications with storage, peripherals, and other sockets. Alongside these, we also find a host of accelerators for direct stream (DSA), in-memory analytics (IAA), encrypt/decrypt (QAT), and load balancing.

We're told that the placement of accelerators on the I/O die was done in part to place them closer to the data as it streams in and out of the chip."

"Going off the renderings intel showed off earlier this year, Clearwater Forest could use up to 12 compute dies per package. The use of silicon interposers is by no means new and offers a number of benefits including higher chip-to-chip bandwidth and lower latencies than you'd typically see in an organic substrate. That's quite the departure from the pair of 144-core compute dies found on Intel's highest core count Sierra Forest parts.

"""Az AMD oldalon amire figyelni kell még:

- Strix HALO új IO - die -a.

- És a zen5/Turin - dupla GMI -je.

"""

Looking a bit closer at these results, you’ll notice that the 9575F has significantly higher bandwidth to a CCD compared to the desktop Zen 5 parts. And the reason for this is the 9575F has GMI3-W which means that it has 2 GMI links to the IO die instead of the single GMI link that the 9950X gets.

And this is not only the only change to the GMI links on server. The GMI write link is now 32B per GMI link instead of the 16B per GMI link that you’d see on desktop Zen 5.

"""

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- AKCIÓ!! HP Zbook Studio G8 i7-11850H 32GB 1000GB Nvidia Quadro T1200 400NIT, 100% sRGB Garis!

- Honor 200 Lite 256GB, Kártyafüggetlen, 1 Év Garanciával

- Apple iPhone 11 Pro Max 64GB, Kártyafüggetlen, 1 Év Garanciával

- Apple iPhone 14 Pro / 128GB / Kártyafüggetlen / 12Hó Garancia / Akku: 86%

- BESZÁMÍTÁS! MSI B460M i5 10400F 16GB DDR4 512GB SSD RTX 2060 6GB Zalman S2 TG FSP 600W

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)