Új hozzászólás Aktív témák

-

ffodi

veterán

válasz

DroiDMester

#36930

üzenetére

DroiDMester

#36930

üzenetére

Ennél a példánynál már rég cseréltem volna az árammérő söntöket, beállítva egy kényelmes 600 W körüli limitet.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

ffodi

veterán

válasz

DroiDMester

#36926

üzenetére

DroiDMester

#36926

üzenetére

Persze, ezért írtam, hogy számoljunk 1800 MHz-cel a megadott érték helyett, mert az kb. a valóság ennél a konkrét modellnél.

Egyébként a 2000 MHz@0.85 V erősen átlag feletti példány, valószínű azért is boostol neked ilyen magasra (legjobb suprimom is valamivel 1900 MHz alá boostolt gyárilag) .

-

ffodi

veterán

?!

A kártya gyári boost órajele 1740 MHz (a weboldal szerint). Számoljunk azzal, hogy a valóságban kb. 1800 MHz körülre boostol alapon, ha normálisak a körülmények. A beállított ~1900 MHz a gyárinál legalább 100 MHz-cel magasabb órajel, hogy lesz így ebből 3080 teljesítmény?

Korábbiakra reagálva:

Az alacsonyabb fesz. nem feltétlen zárja ki a magasabb órajeleket. Ezek a kártyák a gyári VGPU-val (ami tipikusan 1 V+) 2-2,1 GHz-es GPU órajelre képesek (ha nincs power limit, le tudod hűteni, stb.), az alap órajelük (boost) pedig 1750-1950 MHz között van típustól függően. A legegyszerűbb és legcélravezetőbb finomhangolás, ha beállítasz egy 2 GHz körüli órajelet, ami lényegében minden esetben OC, majd ehhez beállítod a minimálisan szükséges magfeszültséget, ami kb. 0,95-1 V. Így hűvösebben és kisebb fogyasztással érsz el a gyárinál nagyobb teljesítményt. A fogyasztáscsökkenés persze nem feltétlen számottevő, ha a teljes gép fogyasztására vetíted, de ha tudsz ezzel csökkenteni pár °C-ot a GPU és a VRAM hőmérsékletén már nyertél. Másfelől sok kártyán spórolós hűtés van (mint a szóban forgó Gainward-on), illetve alacsony a max. TDP limit, így utóbbin is tudsz picit segíteni, mondjuk ha bosszant, hogy állandóan dobálja a 15 MHz-es lépcsőket. -

ffodi

veterán

válasz

FingR86

#36777

üzenetére

FingR86

#36777

üzenetére

Emlékeim szerint ez mindig is ilyen volt. Nem mindegy, hogy magát a profilt üresjáratban, vagy terhelés alatt hozod létre/alkalmazod. Ha megfigyeled, ahogy növekszik a GPU hőmérséklete, elkezd a kártya ledobálni 1-2 lépcsőt a GPU órajeléből (egy lépcső = 15 MHz, így működik az NV GPU boost), ez hatással lesz a curve-re is.

Próbáld ki, hogy üresjáratban, amikor ki van hűlve a kártya, létrehozol egy profilt. Alkalmazod, majd elindítasz egy játékot és figyeled az órajeleket. Amikor bemelegedett a kártya (játék futása közben) alkalmazd újra a profilt és ugrani fog. Ezért érdemes terhelés alatt fixálni a profilt, mert akkor jó helyre fog ugrani.

-

ffodi

veterán

Persze, én nem is írtam ilyet, mert "bőven" szerintem sem elég.

Szerk.:

Én pedig erre reagáltam "(használható ~660W)."![;]](//cdn.rios.hu/dl/s/v1.gif)

-

ffodi

veterán

Okoskodni? Mióta okoskodás az, ha kijavítok egy hibás gondolatot?!

Nem foglaltam állást arra vonatkozóan, hogy elég -e vagy sem, de akkor most megteszem...alapon járatva egy 3080/3080Ti-nek általában elég egy normális 750W-os tápegység, feltételezve, hogy nincs mellette más nagy fogyasztó (<~250W). Ha határon vagy a tápoddal a gond a pillanatszerű események hatására szokott előjönni, amikor a kártya pl. néhányszor 100 ms-ra beránt 100W-tal többet, mint amennyit konstans terhelés esetén szokott. Összefoglalva, érdemes nagyobb teljesítményű tápegységet választani hosszútávra, de rövid-középtávon kiszolgálhat a szóban forgó verzió is, amennyiben a fent említett feltételek teljesülnek.A végére egy példa:

Konstans terhelés mellett (ETH bánya) elvitt simán egy 650-es Seasonic Prime 2db 3080-at (2x240W + ~100W a sallang).![;]](//cdn.rios.hu/dl/s/v1.gif)

-

ffodi

veterán

Mit jelent az, hogy használható ~660W? A névleges teljesítmény mindig a DC oldalra vonatkozik, vagyis a használható az 750W ebben az esetben (az, hogy ez hogyan oszlik meg a railek között az más kérdés, illetve feltételezzük, hogy nem valami fos tápról van szó). A hatásfok ott jön képbe, hogy ha x teljesítményt (ahol x <= nevleges*1.1 mondjuk) veszel ki belőle a DC oldalon, akkor mennyit vesz fel a konnektorból... ha tudja a gold specifikációt, akkor max terhelés mellett ez kb. 850-900W lesz a valóságban.

-

ffodi

veterán

válasz

zebra_hun

#35257

üzenetére

zebra_hun

#35257

üzenetére

Egy kevés még maradt benne szerintem, mert ezen az órajelen háromszor egymás után gond nélkül lefutott...érzésre 6200 pont körül lehet a vége kb.

"Pont passzolna sztem az én gépembe, 1440-re".

Minden a matekon múlik.

laychi:

A 12 GB-os 3080 szívás ilyen szempontból, mert ahhoz szerintem nem fogsz találni, a 10 GB-oshoz mintha lett volna valami, de már nem emlékszem. -

ffodi

veterán

válasz

Garsza

#31182

üzenetére

Garsza

#31182

üzenetére

Ha ilyen kicsi a változás, sokszor előfordul, hogy visszaugrik a korábbira. Vagy elölről kezded a beállítást az alap görbével, vagy a 900 mV feletti feszültségértékekhez tartozó pontok közül többet (legalább 5 ) is beállítasz 1950 MHz-re. Utóbbi sajnos nem mindig működik...

-

ffodi

veterán

Ezt nem tudom mire alapozod, mert ez így ebben a formában nem igaz. Mennyit is fogyaszt egy 3080, ami kb. 100 MH/s-kel bányássza az ETH-t? Kb. 220-250 W... és bizony vannak kártyák amiknek a perf/Watt mutatója rosszabb, nem is kell messzebb menni, mert jo példa erre a 3080 Ti, és azzal is bányásznak. Amennyiben pedig a fogyasztás es a hozam különbsége nagy, a fogyasztás nem fog számítani.

-

ffodi

veterán

Az igazán komoly 3DMark eredményhez bizony nyerni kell a lottón (meg kell egy unlock-olt BIOS), de ebben az esetben lényegtelen mennyit fogyaszt a kártya. Valós körülmények között pedig kb. mindegy, hogy 2000 MHz-en vagy 2100 MHz-en megy a GPU, mert ha az első esetben nem elég valahova a másodikban sem lesz az. Emellett minden kártya esetén kicsit más lesz az optimum (teljesítmény/fogyasztás), innentől max. az bosszanthat fel, hogy más miért fogott ki jobb példányt.

Visszatérve a 3DMarkhoz. Egy 3080 Ti-vel simán el lehet érni 22k, vagy afeletti GPU score-t, ilyenkor persze 500 W+-t is meg lehet vele etetni. Amikor megjött a Ti-m csináltam vele pár tesztet az 1000 W-os BIOS-szal. Sokat nem szórakoztam vele, de érzésre benne van a 22k.

-

-

ffodi

veterán

válasz

ForRedGlory

#29352

üzenetére

ForRedGlory

#29352

üzenetére

3080Ti-ből csak LHR-es létezik, szóval a te kártyád esetén egyértelmű.

Egy 3080 esetén pedig a típuskódban (ha direktben nem is, akkor a gyártó oldalán írják) és/vagy a megnevezésben és/vagy a dobozon látszik, hogy LHR. A szóban forgó Asus 3080 esetén a V2 jelzi az LHR-t, ahogy azt korábban említették a kollégák.

-

ffodi

veterán

válasz

skippper

#29178

üzenetére

skippper

#29178

üzenetére

Mint a legtöbb félvezető alapú integrált áramkör, a kártyádon lévő memória IC-k sem szeretik a 100 °C környéki működési hőmérsékletet. Működnek ugyan, de az élettartamuk jelentősen csökkenhet, illetve a magas környezeti/működési hőmérséklet sokszor megnövekedett fogyasztással is párosulhat. Mivel ezeknél a kártyáknál alapvetően hőátadási/hőelvezetési probléma okozza a memória chipek magas hőmérsékletét, így érdemes az említett hibát a problémás hővezető lapok cseréjével orvosolni.

Számszerűen:

- 110 °C-os junction temp. esetén kezdi megvédeni magát a kártya, ekkor elkezdi visszavenni a teljesítményt

- Egy megfelelően kivitelezett hővezető lap cserével akár 20-25 °C is "nyerhető" -

ffodi

veterán

válasz

fahrii

#28954

üzenetére

fahrii

#28954

üzenetére

Suprim-on 2 mm-es hővezető lapok vannak a VRAM-okon, a VRM FET-jeire pedig 1,5 mm-es kell. Felmerülhet a kérdés, hogy miért mondok ilyet, hiszen a linkelt teszt mást ír....nos tapasztalat, padoztam már át 3080 Suprim-et, és 3080 Ti Suprim-et is.

Ezen kívül a többi lapot felesleges cserélni...igen azt is, ami a hátoldalon van (utóbbiakkal csak 3090 esetén érdemes foglalkozni).

Ezen kívül a többi lapot felesleges cserélni...igen azt is, ami a hátoldalon van (utóbbiakkal csak 3090 esetén érdemes foglalkozni).Ha a VRM-en nem cserélsz, akkor egy csomag 80x40-es Gelid Extreme elég a Ti-re (vagy a linkelt Ultimate, bár szerintem érdemes puhább lapokat venni).

Normál esetben menthetőek a gyári hővezető lapok, óvatosan szedd szét, és szétszedés előtt játssz vele 5-10 percet, hogy minden szépen átmelegedjen.

-

ffodi

veterán

válasz

MPowerPH

#28753

üzenetére

MPowerPH

#28753

üzenetére

~2130/22208 MHz.

Nálad mennyin ment itt a 3090?RTM bányászathoz elég jó a TR, de rendes kitermelés mellett (emelt órajelen) az AVX miatt brutál sokat eszik, tartósan nehéz megfogni léggel 300 W+-t.

![;]](//cdn.rios.hu/dl/s/v1.gif)

zebra_hun:

[Aida cache & memory]

[CB R23 24/7-es beállításokkal] -

ffodi

veterán

Pont a TDP keret/limit miatt érdemes undervolt-olni.

Tápcsatlakozók (8pin PCI-E): névlegesen 150 W, a valóságban a csatlakozóknak, kábeleknek és a kontaktoknak kb. 8-10 A a terhelhetőségük erenként/pinenként ezért kb. a névleges dupláját tudnia kell összességében (baj lenne, ha nem így lenne) .

-

ffodi

veterán

Csak emlékeztetőül:

- 5120*1440 = 7372800 pixel

- 3840*2160 = 8294400 pixelA kolléga arra gondolt, hogy az említett ultraszéles monitoron a felbontás kisebb, mint egy 4k kijelző esetében. Emellett a CoD gyenge terhelést jelent a kártyának 4k-ban is hasonlítva pl. a Metrohoz.

-

ffodi

veterán

válasz

Shkiz0

#22730

üzenetére

Shkiz0

#22730

üzenetére

Ja, elég durván.

Egyébként az írásból kimaradt a TuF-nál észrevett +1 kis hiba: A FET-ekre (jobb oldali oszlop) gyárilag felrakott hővezető lap az IC-k 60-70%-át fedte csak.

#22747 Lacielvtárs

Sajnos nem vagyok a közelben.#22763 muxi-muxi

Csak a TuF-on volt szeparált borda a VRAM-oknak, a többi esetben egy nagy kontaktfelület volt a GPU-nak és a RAM-oknak egyaránt. Egyébként jó mindkét megoldás, de azért belátható, hogy a TuF-on az a pici borda önmagában nem birkózik meg a keletkező hővel.

-

ffodi

veterán

válasz

MPowerPH

#22727

üzenetére

MPowerPH

#22727

üzenetére

Ez már így is elég jó.

Más téma:

Utóbbi időben úgy esett, hogy néhány 3080-at (3090-ek még jönnek

![;]](//cdn.rios.hu/dl/s/v1.gif) ) újrapadoztam/újrapasztáztam. Összességében elmondható, hogy a gyártók igénytelen minőségű hővezető lapokat használnak egy 350-400k+-os (tavalyi árakat figyelembe véve) kártyán (szinte kivétel nélkül), a padok lecserélése (megfelelő vastagságúra/hővezető képességűre) pedig minden esetben nagymértékű javulást eredményezett. Fontos megjegyezni, hogy a hátlapokat lehetőség szerint nem bántottam, hiszen ott nincs RAM IC a 3080-on, valamint a később említésre kerülő kártyákon van gyárilag megfelelő hőelvezetés. Továbbá, a GPU felőli oldalon a padcsere kizárólag a VRAM-okon, illetve a tápkör FET-jein történt meg, mert a kondikon és tekercseken elhelyezett hővezető lapok elsősorban csak hézagoló/támasztó szerepet töltenek be, így azok cseréje teljesen felesleges, amennyiben épek (szerintem legalábbis....na jó, az persze igaz, hogy ezek az alkatrészek is átmelegszenek, és minél több hőt tudunk elvinni a NYÁK-ról annál jobb, de erre jó a gyári megoldás is)...alább az eredmények és a tanulság:

) újrapadoztam/újrapasztáztam. Összességében elmondható, hogy a gyártók igénytelen minőségű hővezető lapokat használnak egy 350-400k+-os (tavalyi árakat figyelembe véve) kártyán (szinte kivétel nélkül), a padok lecserélése (megfelelő vastagságúra/hővezető képességűre) pedig minden esetben nagymértékű javulást eredményezett. Fontos megjegyezni, hogy a hátlapokat lehetőség szerint nem bántottam, hiszen ott nincs RAM IC a 3080-on, valamint a később említésre kerülő kártyákon van gyárilag megfelelő hőelvezetés. Továbbá, a GPU felőli oldalon a padcsere kizárólag a VRAM-okon, illetve a tápkör FET-jein történt meg, mert a kondikon és tekercseken elhelyezett hővezető lapok elsősorban csak hézagoló/támasztó szerepet töltenek be, így azok cseréje teljesen felesleges, amennyiben épek (szerintem legalábbis....na jó, az persze igaz, hogy ezek az alkatrészek is átmelegszenek, és minél több hőt tudunk elvinni a NYÁK-ról annál jobb, de erre jó a gyári megoldás is)...alább az eredmények és a tanulság:1. ASUS RTX 3080 TuF

Jó hűtéséről volt híres megjelenéskor, ami részben igaz is, ugyanakkor egy óriási bakit azért sikerült elkövetni a gyártónak:Több helyen is olvastam, hogy a TuF-on a gyári hővezető lapok elég jók, és cseréjük nem hoz érdemi javulást. Szétszedés után vettem észre miért...a fenti képen pirossal jelölt felületek vélhetően azért lettek így kialakítva a külön VRAM és VRM hűtőn, hogy a nagy hűtőblokk ott tudjon "kapcsolódni" hozzá. Alátámasztja ezt az is, hogy az említett hűtőn a hőcsövek ezen a szakaszon egyenesek ("laposak") és ahogy az a maradványokból látható, az egyik oldalon volt is hővezető lap. A gond az, hogy itt egy 3 mm vastag lap volt elhelyezve, ami még össze sem volt nyomva, tehát a hőátadás erősen szuboptimális volt. Mások tapasztalatából kiindulva a kis hőcsöves hűtőbordát le sem szedtem, helyette az alábbiakat követtem el:

- VRM FET-jeire (jobb oldalon) 1,5 mm vastag Thermal Grizzly Minus Pad-et tettem

- A pirossal jelölt részekre két egymásra stackelt 2 mm-es Gelid GP-Extreme-et tettem, így a pad-ek együttes vastagsága ~4 mmEredmény:

VRAM junction temp. ETH bánya mellett (csak mert ez terheli/fűti a legjobban) 20 GHz-es effektív órajelen: 96 °C --> 80 °C2. MSI RTX 3080 Suprim

A hatalmas hűtőborda ellenére sajnos a VRAM-ok hőmérséklete (junction temp.) magasabb volt azonos körülmények között, mint a korábban említett TuF-nál. Itt szétszedéskor semmi "csúnyaságot" nem tapasztaltam, így az alábbi hővezető lapokat cseréltem:

- VRM FET-jeire (mindkét oldalt) 1,5 mm vastag Thermal Grizzly Minus Pad-et tettem

- A VRAM-okra 2 mm vastag Gelid GP-Extreme kerültEredmény:

VRAM junction temp. ETH bánya mellett (csak mert ez terheli/fűti a legjobban) 20 GHz-es effektív órajelen: 98-100 °C --> 74-76°C3. Gigabyte RTX 3080 Aorus Extreme

Röviden és tömören: a legprimitívebb hővezető lapokkal ennél a kártyánál találkoztam. Szétszedés után láthatóvá vált az is, hogy néhánynak semmi szerepe nincs...Lehetne azzal magyarázni, hogy a 3080 Ti-nél majd nem kell új alkatrészlistát bevezetni a pad-eknek, na de akkor is...

Alábbi pad-eket cseréltem:

- VRM FET-jeire 1,5 mm vastag Thermal Grizzly Minus Pad került

- A VRAM-okra 2 mm vastag Gelid GP-Extreme-et helyeztemEredmény:

VRAM junction temp. ETH bánya mellett (csak mert ez terheli/fűti a legjobban) 20 GHz-es effektív órajelen: 104-106 °C --> 74-76°C

Szerk.: Sorry a gyenge minőségű képekért, lámpafénynél fotóztam, kutyafuttában.

-

ffodi

veterán

válasz

echterion

#21882

üzenetére

echterion

#21882

üzenetére

Azok a "sünik" sokat nem érnek így, tegyél a helyükre inkább egy 120-as ventilátort és/vagy vedd le az oldallapot.

#21878:

A megjelölt részen lévő alkatrészek kondenzátorok, nincs szükségük plusz hűtésre. Más kérdés persze, hogy a túloldalon ott a VRM, ami termeli a hőt rendesen, a NYÁK pedig átvezeti a hőt a kérdéses oldalra...igazából maga a design igénytelen, hogy egy ilyen hotspot mögé olyan kvázi zárt felületet terveznek ami inkább beszorítja a hőt, mintsem elvezeti...

-

ffodi

veterán

válasz

abridabri

#21610

üzenetére

abridabri

#21610

üzenetére

Ez most olyan, mintha elfelejtettük volna, hogy honnan jöttünk. A vörösréz hővezetési tényezője egy nagyságrenddel odébb van, mint bármelyik hővezető lapé/pasztáé. Ideális esetben egyébként nem kéne semmilyen plusz hővezető anyag, de ez általában nem kivitelezhető a mechanika toleranciák, a hűtőfelület és az IC-k távolsága és/vagy a két kontaktfelület "simasága" miatt.

Tehát az említett anyagok azért kellenek alapvetően, hogy

- a két kontaktfelület közötti levegőt kitöltsd valamivel, ami jobban vezeti a hőt, mint a levegő

- (tipikusan gap-pad esetén) kompenzáld a toleranciákat (kitöltés mértéke lehet változó mondjuk egy vga memórialapkái és a VRM egyes alkatrészei között, vagy akár az egyes memórialapkák között is...)

- esetlegesen biztosíts elektromos szigetelést a két kontaktfelület közöttA rézlap jobban vezeti a hőt, de fajlagosan drágább, egy themral pad-hez képest abszolút rugalmatlan és még vezeti az áramot is, ezért nem jellemző/ajánlott az alkalmazása ilyen környezetben.

-

ffodi

veterán

Melyik MSI szoftverrel próbáltad (sorry, most nincs kedvem visszaolvasni

)?

)?Nálam az MSI LiveUpdate gond nélkül megtalálta a frissítést, igaz kicsit el van dugva...mert nem a főképernyőn (Live Update) kell megnyomni a 'Scan' gombot, hanem jobb fent a nyilakkal el kell navigálni a 'BIOS' menüig és ott...nagyon igénytelen egy program egyébként...

-

ffodi

veterán

válasz

Laja333

#21235

üzenetére

Laja333

#21235

üzenetére

Ez már jobb kérdés, de ahogy a kolléga is írja, tedd fel az Aorus Engine-t, az megmondja. Vagy trial and error: felrakod az elsőt...ha nem jó, akkor bebootolsz a másik BIOS-ról, kapcsoló vissza, majd flashel-ed a következőt, és így tovább, amíg jó nem lesz.

![;]](//cdn.rios.hu/dl/s/v1.gif)

#21238:

Van arra is, F6 a verziója, ahogy nézem. Az F11/F21 verziók esetén gondolom az a helyzet, hogy valamit utólag tekergettek a kártyákon, ez pedig 1-2 főbb ponton eltérő BIOS-t eredményezhetett, és igen, ezek szerint biztos van, aki F10/F20-as BIOS-szal vette.

-

ffodi

veterán

Elvileg már minden gyártó kiadta a "Resizable BAR" BIOS frissítést, legalábbis az NV oldala szerint (VBIOS Update szekció).

Ahogy nézem:

- Zen2-vel megy- Bányát nem bántja![;]](//cdn.rios.hu/dl/s/v1.gif)

Írja a weboldal...idézem:

"Please note: You can only update to a VBIOS version of the same series.Visual C++2008 is required for this BIOS flash.

If your VBIOS version is:

F1, it can only be updated with VBIOS versions F2-F9.

F10, it can only be updated with VBIOS versions F11-F19.

F20, it can only be updated with VBIOS versions F21-F29." -

-

ffodi

veterán

-

ffodi

veterán

válasz

MPowerPH

#17729

üzenetére

MPowerPH

#17729

üzenetére

A 3090-re lényegében ugyan az vonatkozik, mint a 3080-ra. Ha nem a legszarabb GPU-t nyerted meg, akkor 1950-2000 MHz menni fog 1 V-os VGPU alatt, szóval kb. ekörül érdemes kezdeni. Amikor már látod kb. mit megy stabilan, akkor érdemes ránézni a power limitre, mert elég könnyen ki lehet akasztani a 400-450 W-ot is. Végső soron, ha majd rajt lesz a blokk, akkor mehet rá a KPE BIOS, aminek 1000 W a TDP limitje.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

ffodi

veterán

Második védvonalnak azért ne felejtsd el a bányában is limitálni a power limitet, hátha valami baj lesz, és a driver reset után default limiten fognak menni a kártyák.

Szerk.:

, mert ahhoz még nem kell admin jog, csak az órajelek tekergetéséhez...

, mert ahhoz még nem kell admin jog, csak az órajelek tekergetéséhez...#17582 Krisz0418

Örökélet jó lenne. Ha nem éri semmi csúnya dolog a tápot az élete során (folyamatos túlterhelés, nagy feszültségingadozások a bemeneten, villámcsapás okozta tranziensek, stb.) akkor elég sokáig működőképesek maradnak. Egy idő után persze zörögni kezd a ventilátor, elkezdenek kiszáradni a kondik...ettől végül instabilitás következhet be és meg is érkeztünk. -

ffodi

veterán

válasz

Locutus

#17045

üzenetére

Locutus

#17045

üzenetére

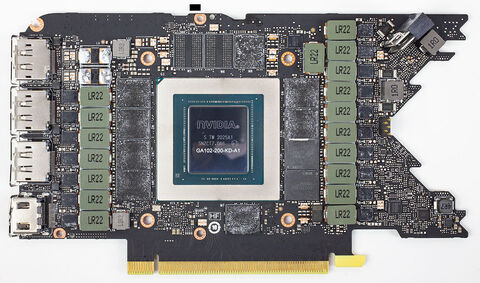

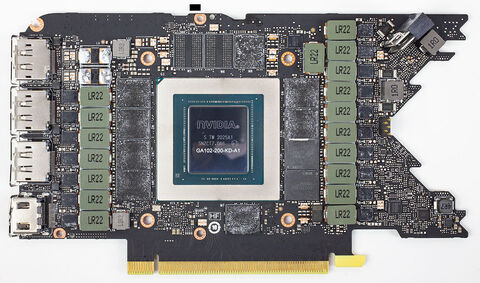

Van azért logika a 12 GB-os verzióban:

A 3080-as NYÁK-on eleve van még két memória IC-nek hely (jelenleg nincs beültetve, az alábbi FE PCB-jét ábrázoló képen bal felül).

Többször lehetett már hallani, hogy a 3080 előállítási költsége relatíve magas a $699-es MSRP-hez képest, így nem lehet rajt akkorát kaszálni, mint mondjuk egy 3090-en. Erre a legegyszerűbb megoldás az, ha csinálnak egy 12 GB-os verziót mondjuk Ti/Super néven és eladják lényegében ugyan azt a műszaki tartalmat $999-ért...

-

ffodi

veterán

válasz

Shkiz0

#16929

üzenetére

Shkiz0

#16929

üzenetére

Köszi az eredményt. Összehasonlításnak itt egy Suprim X eredmény:

Nálam kb. 50 mV-tal több fesz kell neki ugyan ehhez az órajelhez. Ami viszont meglepő számomra, hogy a korábbi TuF 2000 RPM mellett hallhatóan hangosabb volt, mint ez ugyan ilyen fordulat mellett és a hőfokok is elég barátságosak a 400W+ ellenére...igaz a kicsi MSI koraszülött csecsemő méretű, 33,6 cm és közel 2kg.

-

ffodi

veterán

Sikerült végre egy valamire való (Superposition) eredményt összehozni.

2130-2145/21040 MHz

Suprim.

-

ffodi

veterán

válasz

abridabri

#16385

üzenetére

abridabri

#16385

üzenetére

Jöhetnek ez elméleti kalkulátorok, gyakorlatban nézd 70 cm-ről és rájössz, hogy annyira nem kényelmes (főleg mert akkor legalább 1-1,5 m mély asztal is kell hozzá)...de akkor nem általánosítok, nekem ilyen közelről a használhatatlan kategóriába esik.

De, beég és pont. Van OLED-em, és láttam már beégett OLED-et. Simán a winfos tálca ég be mint a huzat, vagy a fullscreen ablakok fejléce...lehet szépíteni a dolgokat, a mai ilyen típusú kijelzők valóban jobban bírják, de csodák továbbra sincsenek

.

. -

ffodi

veterán

válasz

abridabri

#16380

üzenetére

abridabri

#16380

üzenetére

Kinek mi...egy monitort általában elég közelről nézel, míg egy TV-t messzebbről. Ne mondja nekem senki, hogy egy 48"-os kijelzőt kényelmes <1 m-ről nézni, főleg, ha nem hajlított. Ha a PC-t nem csak játékra és filmnézésre használja valaki (hanem mondjuk munkára, netezésre! is), akkor bizony az említett kijelző igencsak hátrányból indul, mind a mérete miatt, mind amiatt, hogy OLED. Ugyanis az OLED (tudomány mai állása szerint) beég a statikus képtől.

-

ffodi

veterán

Felmegy rá, de lényegében semmi haszna. Ha a power limit miatt csinálnád, akkor megkíméllek egy BIOS-cserétől (a nem létező 3. 8pin limitjeit 0-ról beállítja valahova, ami nem fog eredményezni semmi változást, mert az a tápbemenet nem létezik...sőt akár ronthat is, ha a másik 2x8 pin limitje alacsonyabb...). 2x8 pin-es 3080-ak esetén csak a sönt mod a járható út, 3090-ek esetén van egyedül olyan BIOS, ami 2x8 pin-es kártyák esetén érdemi változást tud hozni (1000W KPE BIOS, de ez a 3080-nal nem kompatibilis).

-

ffodi

veterán

Van.

Elég nagy határok között mozoghat a max. VRAM OC (akárcsak a GPU OC) az egyes kártyák esetén (+200-1500 MHz tipikusan, átlagban +800-1000 MHz meg szokott lenni). Ha instabil, akkor a legtöbb esetben csak (erősen) csökkent teljesítményt fogsz észre venni, nem lesznek képhibák. Minél tovább tolod "a határon túl" annál nagyobb lehet a teljesítménycsökkenés.

-

ffodi

veterán

válasz

Sziszifeca

#15945

üzenetére

Sziszifeca

#15945

üzenetére

Kb. 5 perc alatt megtaláltam....hint: a cikkekben csak azokat az oldalakat érdemes átnézni, ahol vélhetően képek is vannak (kép != ábra).

-

ffodi

veterán

válasz

ScomComputer

#15674

üzenetére

ScomComputer

#15674

üzenetére

Nálam fixen power limit van CP2077 alatt (elég durván, és ahogy észrevettem stabilitástesztelésre is kiválóan alkalmas....ami stabil volt FireStrike vagy TimSpy alatt az itt hibázott), igaz én magasabb felbontáson játszom (3440x1440).

-

ffodi

veterán

válasz

Nandusz

#15671

üzenetére

Nandusz

#15671

üzenetére

Az alacsonyabb power limit miatt. Nálad odaadja neki jó eséllyel (közel) azt az órajelet, amit szerettél volna, akkora fesszel, ami a csövön kifér... a kollégánál pedig a magasabb offset azért kell, hogy a VF curve alját jól felemelje, így az alacsonyabb feszültségtartományok esetén is kellően magas órajel lesz a végeredmény (power limit miatt elkezd visszalépkedni a curve mentén...plusz kártyánként életerő lehet a szükséges offset mértéke adott órajelhez) .

-

ffodi

veterán

válasz

2thletme2day

#15004

üzenetére

2thletme2day

#15004

üzenetére

-

ffodi

veterán

Kb. az a sweet spot, amit beállítottál. Ha tényleg stabil 900 mV alatt az 1950 MHz, akkor az egy egész jó példány. 900-950 mV-ig esetleg felmehetsz, hátha találsz még benne néhányszor 10 MHz-et.

Az adott órajelhez a régimódi screenshot-on látható eredmény egyébként kicsit kevés.

-

ffodi

veterán

válasz

Albigator

#13228

üzenetére

Albigator

#13228

üzenetére

Az ugye megvan, hogy amin ti "vitatkoztok" az a kondi lot nr-je, ami a gyártási időt/helyet hivatott kódolni?

![;]](//cdn.rios.hu/dl/s/v1.gif)

Gyártója válogatja milyen kondit tesz rá. A lényeg a típuson, kapacitáson és feszültségen van.

Jelölések (ezeknél a Panasonic kondiknál):

220 = 220 uF

d = 2 V ha jól emlékszem

a többi karakter általában csak a gyártás helyét és idejét jelöli -

ffodi

veterán

válasz

KillerKollar

#12667

üzenetére

KillerKollar

#12667

üzenetére

Defaultban 80%-ot allokál a VRAM-ból...a CoD-oknál már egy ideje így megy, hogy a VRAM 80-90%-át allokálja alap esetben, és vagy config fájlban, vagy mint a BO CW esetén a menüben lehet tekergetni, hogy mit engedsz meg neki. Ha 70%-ra teszed, kb. 7 GB-ot fog lefoglalni.

-

ffodi

veterán

válasz

Cthulhu Dawn

#12421

üzenetére

Cthulhu Dawn

#12421

üzenetére

Persze, de LED off és alacsony ventifordulaton is ez a helyzet.

-

ffodi

veterán

-

ffodi

veterán

válasz

Laja333

#11989

üzenetére

Laja333

#11989

üzenetére

Persze, temetni egyáltalán nem kell, lehet itt még javulás, ahogy a másik oldalon SAM alternatíva, és így tovább.

Ha mindkét kártya a meghirdetett listaáron (vagy akörül) lenne kapható itthon (és lenne rendes készlet), akkor tényleg nehéz lenne választani, mert itt már valóban csak pár specifikus dolog döntene (pl. GSYNC). Szerintem örülni kell annak, hogy végre megint van verseny, alternatíva. Akinek eddig NV volt és váltani akart, az már vett 3080/3090-et, a többiek jól tették, hogy vártak. Ha most kéne kártyát vennem lehetséges, hogy kipróbálnék egy 6800XT-t vagy majd egy 6900XT-t, de mivel már itt figyel a 3080 és meglepetés nem ért ma, így ideje hátradőlni.

-

ffodi

veterán

válasz

venom8888

#11967

üzenetére

venom8888

#11967

üzenetére

Veri? Verésről akkor lehetne beszélni, ha legalább 10-20%-kal lenne jobb mindenhol.

Nézzük a tényeket (több teszt elolvasása alapján), 3080 vs. 6800XT, pro(+), kontra(-), semleges (/):

**3080**

+ Nagy átlagban pár százalékkal (max. 3-4%) erősebb

+ Jobb RT teljesítmény

+ DLSS (erre lesz/készül valami válasz)

+ "Munkára" jobb választás lehet/ Kb. +5-10% tartalék van benne

/ Volt gond a driverekkel (mikor nem volt egy új kártyánál)- Gyárilag elszállt perf/watt, ami alulfeszeléseel nagyrészben orvosolható

- 10GB VRAM

- Drágább, botrányos launch miatt elszállt árak**6800XT**

+ 16GB VRAM

+ Jobb perf/watt

+ Igéretes fícsörök (SAM), bár erre készül valami válasz

+ Új konzolokban is RDNA2 van/ Kb. +5-10% tartalék van benne

/ Kérdés milyenek lesznek a driverek

/ $50-nel olcsóbb, kérdés a valóságban mennyi lesz itthon és milyen készlet lesz belőle- Akár jelentősen gyengébb RT teljesítmény

- OC hatására itt is simán elszáll a fogyasztás (300 W++)

- Idegesítő marketing és az újra előkerült "overclockers dream" -

ffodi

veterán

válasz

gabo423

#11679

üzenetére

gabo423

#11679

üzenetére

Beraktatok 2-2 képet, ugyan azon játékból de különböző helyről/mapról (és még a beállítások is simán lehetnek különbözőek, a "low" ellenére, sőt a vga is, ami ugyancsak nem elenyésző dolog...), és ez alapján szerinted a te processzorod jobb, mert több FPS-ed van, Cshavez szerint, pedig nem feltétlen, mert nála magasabb a GPU kihasználtság. A valóságban egyikőtöknek sincs igaz ebben az esetben, mert ez nem egy korrekt összehasonlítás.

Ahogy már linkelték, a Zen3-as CPU-k single core teljesítménye elég meggyőző, a játékokban adott esetben több FPS-ed lehet (elsősorban alacsony felbontásoknál), mint egy azonos kategóriájú Intel processzorral. Ezek tények, az hogy "rengeteget hagy benne" pedig nettó bullshit. Kicsit többet hagyhat benne, esetleg... Továbbá, ha továbbra is a tényeket nézzük, akkor olyan helyzetben, ahol van eleve 250 FPS-ed az egyikkel, lehet 260 a másikkal, az az abszolút tökmindegy kategória, ugyan ez igaz akkor is, amikor 65 helyett 68...Nyilván vannak határesetek, amikor mondjuk 144 Hz-es monitorod van és szeretnél stabil 141-144 FPS-t, akkor számíthat az a pár %...de ha ott is a határon mozogsz, akkor megint nem az igazi...

-

ffodi

veterán

válasz

#15779328

#11472

üzenetére

#15779328

#11472

üzenetére

Köszi a tesztet.

A GPU órajelek 15 MHz-es lépcsőkben vannak, köztes beállításnál kerekíteni fog lefelé.

A COD BO CW egyébként nem feltétlen jó fogyasztásmérős tesztre (különösen a multi része), mert egy max. közepes terhelést tud csak produkálni a vga számára. Vannak játékok, amivel akár +100-150 Wattot még meg lehet etetni a kártyával (pl. RDR2).

-

ffodi

veterán

A képen látható átlag 60-70%-os terhelés mellett elért kb. <=+10%-os GPU órajel max. boost inkább a semmi extra kategória mintsem "Overclokers Dream" (utóbbi már így is inkább szitokszó, mintsem pozitívum

).

).Mivel a 3080 és 3090 között nincs hatalmas különbség teljesítményben 10-15% max., a 3080-nal is behozhetó ez, főleg ha jobb GPU-t fogsz ki.

-

ffodi

veterán

válasz

ScomComputer

#10501

üzenetére

ScomComputer

#10501

üzenetére

Persze, de nincs kedvem külön profilt csinálni.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

ffodi

veterán

válasz

ScomComputer

#10499

üzenetére

ScomComputer

#10499

üzenetére

Szereti vagy nem, az OC akkor stabil, ha mindenhol stabil.

-

-

ffodi

veterán

Most semmi sem garantálja, hogy az RX6800XT-t nem annyiért (mármint a nyereményilletékkel megnövelve) fogják adni a jelenlegi helyzetre való tekintettel, mint a 3080-at...másfelől szépek ezek a diagramok, amik a hivatalos "marketinges" eredményekből származnak, kíváncsi leszek a valós tesztekben mennyi eltérés lesz ehhez képest.

-

ffodi

veterán

válasz

KAMELOT

#9407

üzenetére

KAMELOT

#9407

üzenetére

Csináltam neked egy tesztet.

3dmark Port Royal default, vga: TuF OC 3080

1. TDP limit 320 W, max. fogyasztás 320 W, vga alapon

GPU: max. 1950 MHz, átlag 1820-1850 MHz

VRAM: 19000 MHz

Eredmény: 110842. TDP limit 375 W (maximum), max. fogyasztás 364 W, vga alapon

GPU: max. 1950 MHz, átlag 1905-1920 MHz

VRAM: 19000 MHz

Eredmény: 113853. TDP limit 375 W (maximum), max. fogyasztás 366 W, vga tuningolva

GPU: max. 2110 MHz, átlag ~2025 MHz

VRAM: 21000 MHz

Eredmény: 12163Minden esetben max. ventifordulaton hajtva, GPU max. hőfok 54°C. A hőfokok, fogyasztás stb. szoftveresen lettek mérve.

A millió dolláros kérdés pedig, hogy lehet, hogy a 2. és 3. teszt ugyan olyan TDP limit és max. fogyasztás mellett jelentősen különböző eredményt produkált? Válasz: Mindegyik esetben 0,95-1,00 V körül kapott a GPU, és ennyi tartalék volt benne (órajelemelés azonos feszültség mellett...). Pontosabban egy kicsi még van benne, mert nem volt kihegyezve. Ha a TDP limitet feljebb tudnám emelni a vga skálázódna tovább, tippre max. 80-100 MHz még lehet a GPU-ban, ezzel további 700-900 pontot összeszedve. Még a végén csinálok egy shunt modot, hogy kiderüljön igazam van -e az utóbbi esetben.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

ffodi

veterán

válasz

Cthulhu Dawn

#9324

üzenetére

Cthulhu Dawn

#9324

üzenetére

Tapasztalatból mondtam, próbáltam TuF-on a Strix BIOS-t...az XC3 esetén pedig az lehetett, hogy ott a gyári BIOS max. PL értéke nem 375 W csak 340/366 W.

Új hozzászólás Aktív témák

- BestBuy topik

- Google Pixel 10a – évismétlés

- Geri Bátyó: Agglegénykonyha 13 – Néhány egyszerű, de finom étel

- Autós topik látogatók beszélgetős, offolós topikja

- Anglia - élmények, tapasztalatok

- Automata kávégépek

- Milyen videókártyát?

- PH!otósok beszélgetős, offolós topikja

- Arc Raiders

- Kerékpárosok, bringások ide!

- További aktív témák...

- EVGA GTX 980 4GB Founders Edition / Beszámítás OK!

- Sapphire PULSE Radeon RX 550 4GB Garanciával!

- Dell Alienware Nvidia Geforce RTX 2080 Super 8GB

- AZONNAL VÁSÁROLOK RTX 4090 és RTX 5090 videokártyákat! Akár nem működő, hiányos, sérült is lehet!

- 3év! AKCIÓ! ÚJ ASUS TUF GAMING Geforce RTX 5080 OC Edition 16GB VRAM Ray Tracing DLSS4

- Telefon felvásárlás!! Samsung Galaxy A16, Samsung Galaxy A26, Samsung Galaxy A36, Samsung Galaxy A56

- Beszámítás! Acer Predator Helios Neo 16 notebook-i9 14900HX 16GB DDR5 1TB SSD RTX 4060 8GB W11

- Samsung Galaxy S24 FE 128GB, Kártyafüggetlen, 1 Év Garanciával

- BESZÁMÍTÁS! Akár részletfizetés 0% THM ÚJ Intel LGA 1700 processzorok 3 év garanciával 27% áfaval

- Apple iPhone 15 128GB Black használt megkímélt 100% akku 6 hónap garancia

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

, mert ahhoz még nem kell admin jog, csak az órajelek tekergetéséhez...

, mert ahhoz még nem kell admin jog, csak az órajelek tekergetéséhez...