Új hozzászólás Aktív témák

-

BeZol

őstag

válasz

ScomComputer

#37795

üzenetére

ScomComputer

#37795

üzenetére

Hálistennek a 2x8pinnek semmi baja, hibátlan maradt a csatlakozóm vége

-

BeZol

őstag

Nem adott képet a GPU, webshop pedig video proof-ot kért, de eddig sosem csinált ilyet előtte... (persze már bedobozoltam, csomagolhattam ki újra) --> [link]

Sok sikert mindenkinek az EVGA kártyákkal

-

BeZol

őstag

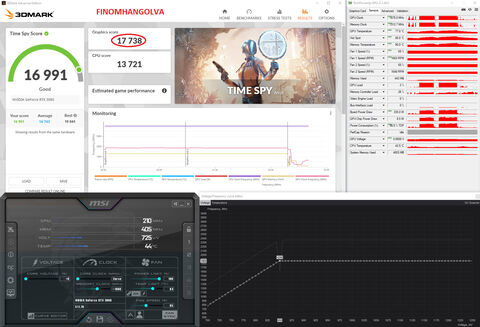

Utókornak iránymutatásnak:

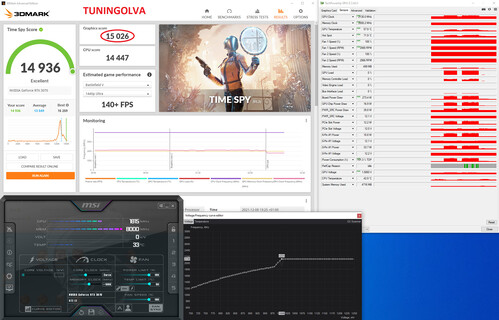

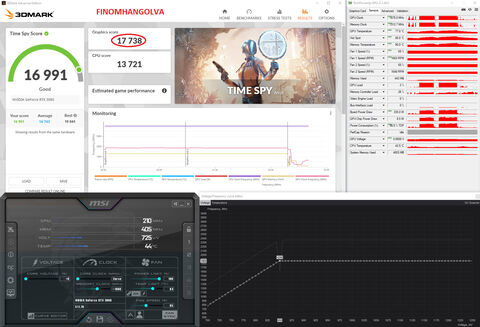

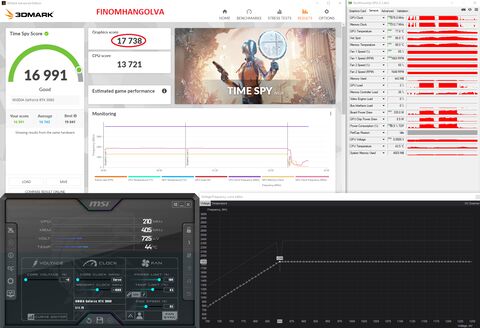

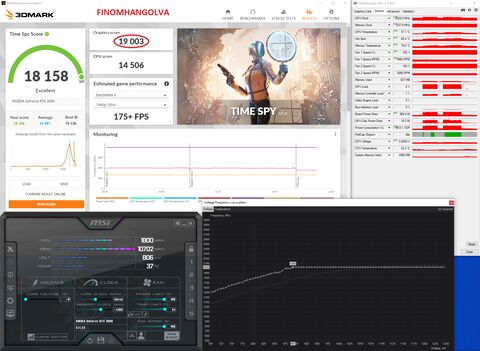

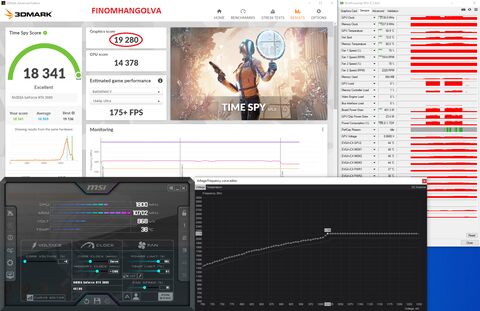

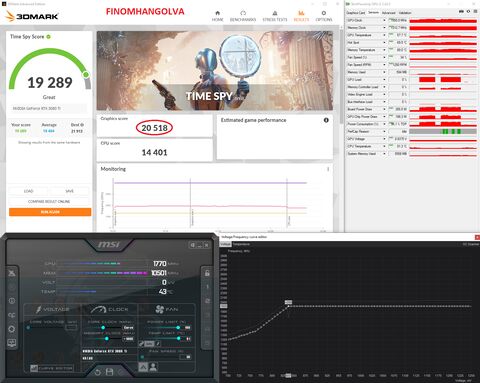

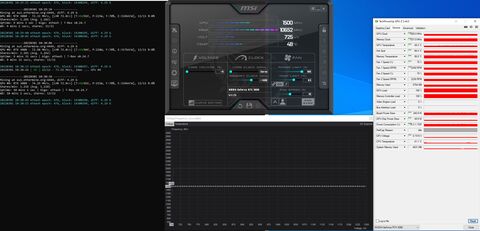

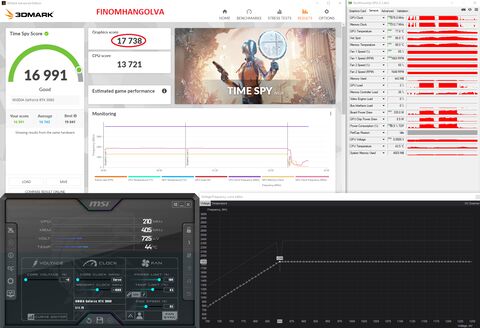

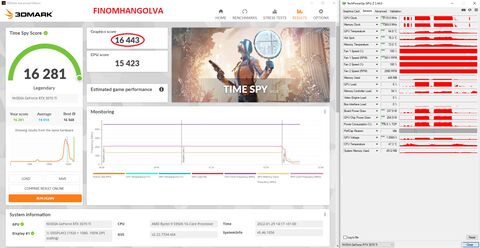

EVGA XC3 BLACK RTX 3080 (LHR) --> nincs rajta backplate, azért "BLACK", de a non-BLACK is ilyen teljesítményű lenne gondolom.

2slot vastag és lapos is.

Alapvetően érdemes alulfeszelni és úgy beoptimalizálni az órajeleket, mert ez a 2slotos hűtés csodákra nem képes, normálisabb hőfokokkal 300-320W közé lehet érdemes finomhangolni 17ezer GS környéke mellett.

Memória-hőfokok sem szépek, úgyh aki bányászna ilyennel, annak hűvös helyen kellene csákányolnia vele.Finomhangolva: (én inkább nem húztam a TDP-kereten, ventin lehet még tekerni persze)

#############################################################

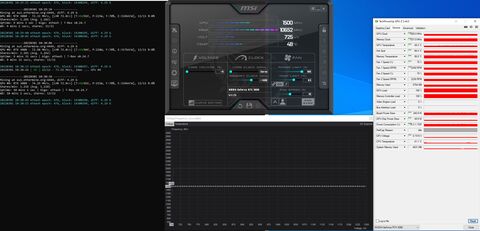

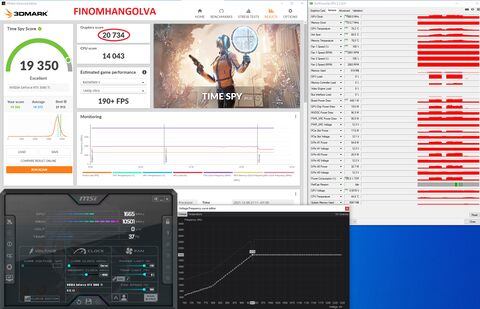

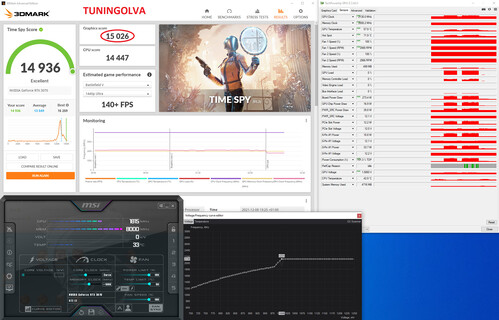

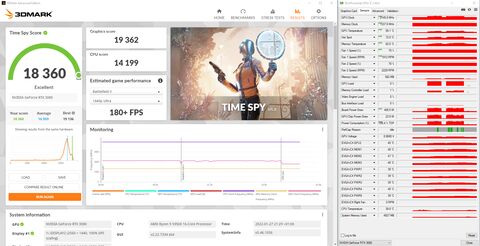

KFA2 RTX 3080 SG 1-Click OC (LHR)Jó vastag, de lapos kártya mint pl. a zotac trinity-k.

Van hozzá egy 4. opcionális venti is, akit érdekel itt talál több infót a kártyáról: [link]

320W a TDP-keret, ami nem állítható feljebb.50% venti (1600rpm) van alapból, nem kapcsolnak le a ventik, nem is kapcsolhatóak le, de 1434rpm-re lejjebb lehet korlátozni.

#######################################################

Bányászoknak memória-hőfokok: (82-86fok +1400-as memóriával)

Számomra igazából kellemes csalódás, sokkal rosszabbra számítottam hőfokokban. -

BeZol

őstag

Engem is csak a Strix-ek tiszteltek meg...

(TUF széria még csak 3060 Ti és 3070 Ti-ből járt nálam, azok nem cw-ztek)

(TUF széria még csak 3060 Ti és 3070 Ti-ből járt nálam, azok nem cw-ztek)Hát csak-csak találnak vmi okosságot a cw-re most már...

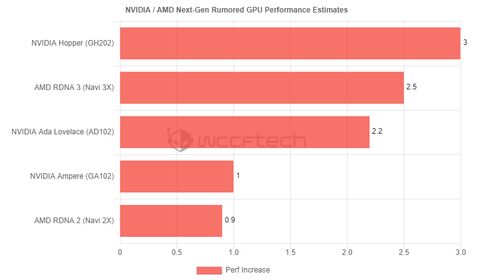

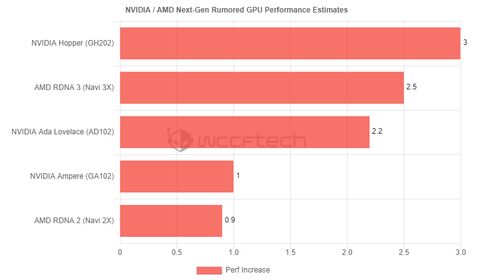

Azért az 5nm-nek lesz jótékony hatása a fogyasztásra és hőtermelésre is, úgyhogy ha még mellé növelnék a chipméretet 600mm2 fölé (826mm2 a GA100 és 1000mm2 lesz a GH100, szóval +20% méretnövekedés bejöhet 720-750mm2-re, és ezek mind monolitikusak!), akkor a hő is könnyebben elvezethető lesz a megnövelt fogyasztás ellenére.Lehet beköszönt az a korszak, hogy csak AIO-s kártyákat lehet majd kapni?

450W még lehűthető léggel.

600W nem igazán, 800W környéke meg végképp nem, ezek sztem vizes kártyák lesznek. -

BeZol

őstag

válasz

Andor22

#31483

üzenetére

Andor22

#31483

üzenetére

Akkor szerencséd volt

4ből 1 ilyen saját merítésem alapján

4ből 1 ilyen saját merítésem alapján

SzlobiG:

kifogtad akkor anno, nálam 1 brutál hangos járt, azt én sem akartam elhinni, hogy lehet vmi ennyire hangos, konkrétan elviselhetetlen volt, de az új tulajnál meg semmi hangja nem volt elvileg...keIdor:

tápegység is, alaplap is számít, de van h menthetetlen a dolog és tényleg a kártyán múlik.

Igazából rá kell próbálni aztán ha jó, maradhat, ha nem jó, vissza kell küldeni a boltba vagy eladni.

Pont emiatt nem mernék használt nagyobb amd-kártyákat venni. -

BeZol

őstag

válasz

SzlobiG

#31479

üzenetére

SzlobiG

#31479

üzenetére

Szóval te azért veszel egy Strix-et ami 450W-os bios-ra kapcsolható, hogy 400W alá feszeld? Ennyi erővel egy TUF is megtenné... De tovább megyek, ott az EVGA XC3 3080-as is, finomhangolva eltekereg még emészhető hőfokokkal hang nélkül (pedig egy lapos vékony kártya a batár strix-hez képest....)

Egy kalap kaki a cw miatt a strix széria, szerencséd volt h kevésbé cw-ző példányt fogtál ki.

Nálam 4db járt, 1 tényleg elég halk volt, 2nek volt hangja, 1 meg elég hangos volt.

6800/6800XT/6900XT vonalon ugyanez van, csak ott a hangos sokkal hangosabb is tud lenni

Én a cw miatt annyira nem is aggódnék, ha válogatott chipesek lennének és 2200MHz-eket tudnának OC-zva, de nálam egyik sem tudta

-

BeZol

őstag

válasz

Garsza

#31461

üzenetére

Garsza

#31461

üzenetére

Ja, szimplán nyomorékul tesztelnek mintha fizetett Nvidia reklám lenne.

SAM/ResizeBar esélyesen OFF-on van náluk (amit most nem is említettek a videóban), ami Nvidia-nak alig hoz, AMD-nek meg sokhelyütt sokat (10-20%-ot is akár), máris +1 részrehajlás Nvidia felé.

Fogtak egy TUF 3080-ast, igaz alulfeszelték... (elvileg, mert ugye semmilyen snitt nincsen ahol látnád az órajeleket és fogyasztásokat!) és összehasonlították egy ref 6900 XT-vel, ami pl. Time Spy alatt (durvább 1440p terhelés) 2280MHz körüli átlagot produkál, míg kb. az összes (nem ulti chipes) custom kártya 2380-2435MHz-en megy le, az ultisok pedig 2500MHz körül... Szép meg minden a refike, csak kb. összes többi 6900 xt ráver min. 5%-ot...

Ha ez meg még mindig nem lett volna elég, fogták a 21.10.2-es (utolsó WHQL driver AMD-nél) drivert és azzal mértek újabb címeket, holott kb havonta 1-3 driver (non-WHQL) érkezik AMD-nél, és simán 15-20% környéki fps-boost van az új játékoknál a régi driverekhez képest.

Nvidia-nak meg berakták az idén feb. 4-én megjelent drivert, szóval kvázi friss driver ment a 4 hónapos ellen sok mostanság megjelent játékkal.Botrányos, ahogy ezek méricskélnek.

Egyébként 6800 XT-t verte enyhén a 3080 megjelenéskor, a 6900 XT pedig +10% teljesítmény.

Az már más tészta, hogy totál máshol mozognak a kártyák TDP-keretei, ha feltekersz egy 6800 XT v. 6900 XT-t 350W-ra ahol a 2x8pines 3080-asok is mozognak, akkor azonnal megint más a leányzó fekvése, mert gyárilag 255-275W körül vannak, és nem 330-340W körül mint a 2x8pines 3080-asok.Valós mérést akarsz, amd topikba dobd be egy saját mérésedet, és majd vki leméri neked a radeon oldalról h valójában mennyi az annyi, mert ezek a netes tesztek nem tudom másképp mondani, szimplán amd-ellenesek

-

BeZol

őstag

válasz

Garsza

#31228

üzenetére

Garsza

#31228

üzenetére

Esélyesen nem tudott többet a kártyád, ahogy nálam sem anno: [link]

Praktikusan a Strix 3070-eseknél "nem létezik" power limit

Az van, amit a gpu és memória-chip tud és kész.Sztem tartogasd a zsugát a next gen-re, ha tényleg jönnek 600W-os kártyák, na azt tényleg érdemes lesz vizezni, én legalábbis akkor vetem magam bele a vizeskedésbe

-

BeZol

őstag

válasz

Garsza

#31231

üzenetére

Garsza

#31231

üzenetére

350W-ból legalább 15.500 Graphics Score-t várnék el egy sima 3070-estől, de inkább 15.800 környékét (world top 100. 15.675 GS).

Ezt 274W-ból tudta egy jobbféle Gigabyte Gaming OC RTX 3070:

Értelem szerűen ezeknek sem optimális olyan sok W mellett dolgoznia, elég gyengén skálázódnak 300W körültől.

Ugye 3080/3080Ti/3090 vonalon is ilyesmi probléma van, hogy 350-400W környéke ami még nagyjából oké, efelett alig van már extra fps, kivéve extrém tuning persze agyonfagyasztva. -

BeZol

őstag

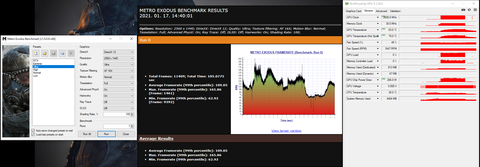

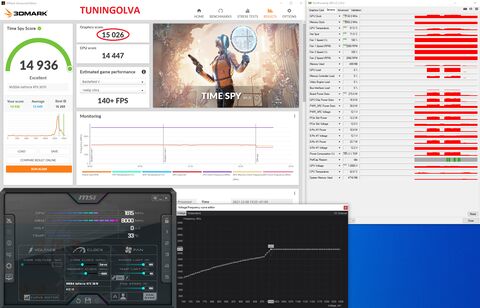

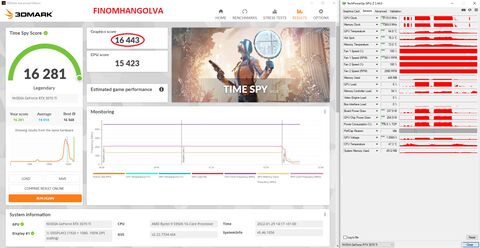

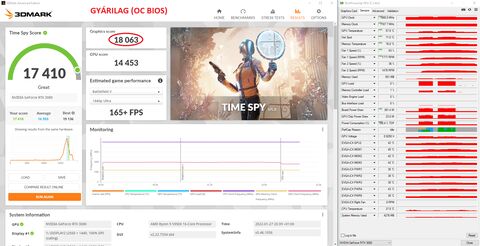

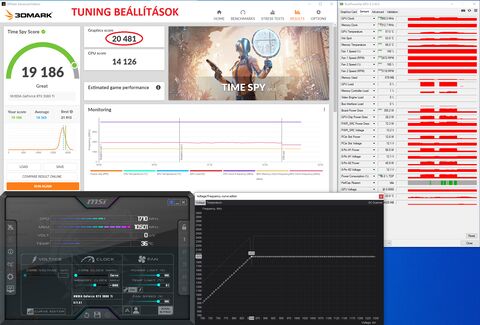

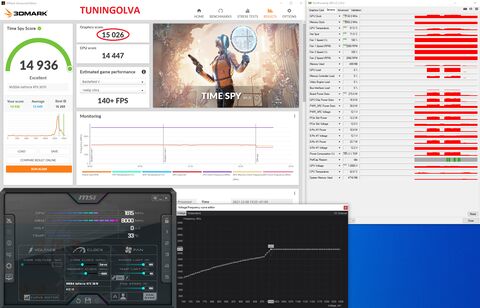

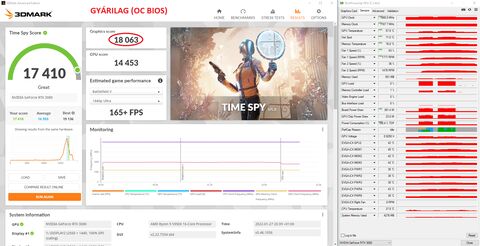

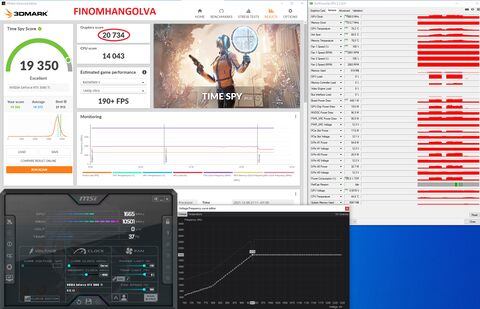

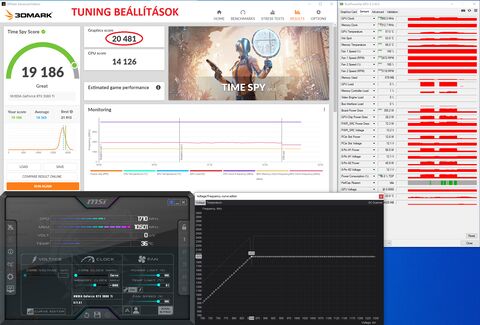

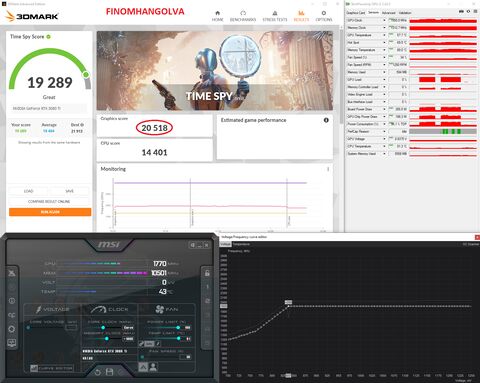

Gigabyte Vision OC RTX 3080 méréseim, utókornak jól jöhet:

Finomhangolva, lévén TDP-kerete nem emelhető: (max ventifordulat odab*sz, jó h kamu)

#############################################################

Érdekesség, hogy az ASUS TUF 3070 Ti (ami a TUF 3080-as hűtését kapta már) hasonló fogyasztással és hasonló ventifordulattal 7-10 fokkal melegebb gpu és gpu-hotspotban:

Mivel ez egy kisebb chip, ezért kisebb helyről kellene azonos hőt elvezetni, ami nem megy annyira, király hűtés ide vagy oda.

3060Ti/3070/3070Ti die-size: 392.5 mm2

3080/3080Ti/3090 die-size: 628.4 mm2Ezek után úgymond megértem, hogy a next gen kártyáknál nagyobb chipméret is lesz, különben a kicsi méretbe zsugorított sok-sok cuccot nem lehetne normálisan levegővel lehűteni.

-

BeZol

őstag

válasz

Találtgyerek

#31058

üzenetére

Találtgyerek

#31058

üzenetére

Áh,

next gen kártyával szeretnék hosszú távra berendezkedni, majd azoknál fogok válogatni

-

BeZol

őstag

Az utókornak, hogy a kereső kidobja, meg lehet érdekel vkit most is

ASUS ROG STRIX RTX 3080 O10G (performance BIOS)

Coil whine itt is van, de a 3 Strix 3080 és 1db Strix 3080 Ti után kijelenthetem, hogy az összes cw-zett nálam, viszont ennyire minimálisan még egyik sem

Az RX 6800/6800XT/6900XT-khez képest pedig kvázi hangtalanul cw-zik, az "átlagos" strix cw-zés pedig a minimum AMD-cw-zés szintje nagyjából

Ugyanakkor csalódott is vagyok, ez a Strix sem képes tartós 2100MHz feletti órajelekre, szimplán a gpu-chip nem bírja, hiába állna rendelkezésre TDP-keret, összecsuklik.

Ennyi pénzért én elvárnám, hogy válogatott chipet tegyenek rá, szóval ez ciki (itt is). -

BeZol

őstag

válasz

-=RelakS=-

#31027

üzenetére

-=RelakS=-

#31027

üzenetére

42" FullHD

bazz ilyen is van

sylex1:

nekm egy időben volt

régi 27" TN 1080p 60Hz,

27" IPS 1440p 144Hz,

27" VA 1440p 240Hz,és később ismerősnél láttam újabb fajta (enyim 2010-es TN-panel volt) TN-panelt 144Hz-el, és az már bőven sokkal szebb képet ad, nem volt olyan fakó szürkés élettelen trutyi...

Az IPS eleve szép volt és minden szögből látni, DE ha úgyis szemből nézed, akkor igazából lényegtelen... Az meg h szebbek a színek őszinte leszek, kb. csak fotók nézegetésénél veszem igazán észre úgy, hogy a 27" TN-emhez mértem!

Az új Samsung 27" VA panelje pedig tényleg fekete a fekete, és a többi szín is sokkal "színesebb", érzésre +1 ugrás a 2015-ben megjelent csúcs-IPS-hez képest, a 240Hz-et is érezgetni, de kb. olyan, mintha egy 500 lóerős autó után beülnél egy 600 lóerősbe. Érezni h gyorsabb de amúgy már az 500 lóerős is teljesen rendben volt. Na kb. hasonló a szitu.

Ezeket gamer-szempontból írtam, egy grafikusnak gondolom más igényei vannak, én pl. azt sem tudom mit jelenthet a 8bit kontra 10bit.A HDR pedig sztem egészségtelen a szemnek, én betiltanám: [link]

-

BeZol

őstag

válasz

-=RelakS=-

#31024

üzenetére

-=RelakS=-

#31024

üzenetére

Ott jön ki h "gáz" a fullHD 27"-on, hogy amikor pl. fps-játékban tartasz egy szöget, áll a kép és várod h megjelenjen az ellenség, akkor annyira fókuszálsz arra a bizonyos pontra, hogy egy idő után a szemed átfókuszál a konkrét pixelekre akarva/akaratlanul, mert ha kicsit is közelebb van a kijelző a fejedhez, akkor bizony szabad szemmel láthatóak a pixelkockák.

Ugyanez van amikor úgymond elbambulsz ahogy nézed a képernyőt és azt veszed észre h a pixelkockákra fókuszált a szemed.

27" 1440p-nél soha egyszer nem történt meg ez velem

FullHD 24-25"-ig, felette

-

BeZol

őstag

válasz

-=RelakS=-

#31022

üzenetére

-=RelakS=-

#31022

üzenetére

Akárhogyis, emlékeim szerint a 360Hz-es monitorok mikor demonstrálva lettek, 2 év múlva lettek kaphatóak... Egyébként meg kenjék a hajukra a 27" fullHD felbontást, és ahogy korábban is írtam és sylex1 most megtapasztalhatta, igen, érezni a 144Hz-hez képest a 240Hz-et is, de igazából nekem mint ex-pro-cs:source játékosnak, nekem ki van ezekre hegyezve a szemem, de ez tényleg közel 0 előrelépés ahhoz képest, mint amikor 60Hz-ről ugrik vki 144Hz-re.

360Hz-es előtt viszont még nem ültem, arra már lehet rábólintanék 144Hz-hez képest, hogy tényleg rendesen adja a feelinget

-

BeZol

őstag

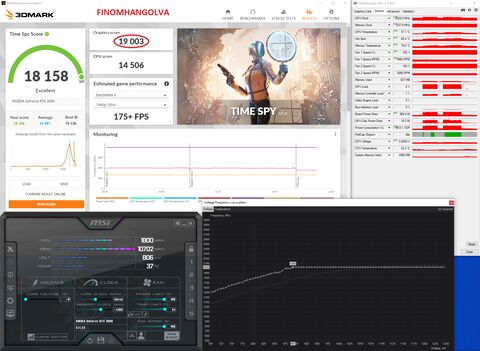

Gyárilag a 380W-ból 1075mV-ig megy, főleg GT1-ben.

Finomhangolásosoknál meg amennyire beállítottam az a max, ebből megy lejjeb a zöld csíkoknál, vagy pont tartja olyankor.

Ez már a szilícium-lottó része, melyik kártya mennyire éhes és ehhez az étvágyhoz amúgy megy is e magas órajelen vagy sem. -

BeZol

őstag

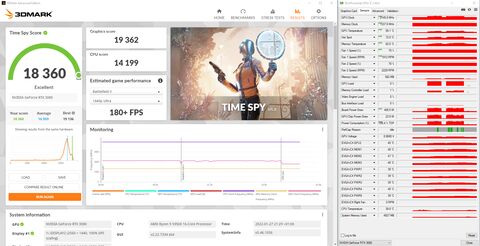

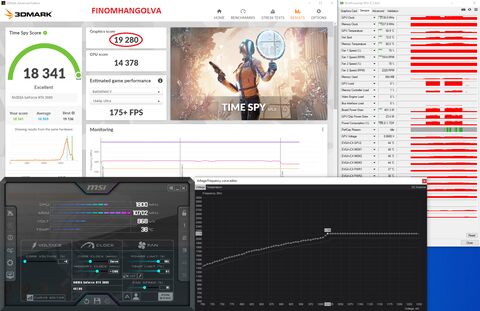

Van normal és OC bios.

Azonnal OC-biosra átrakva mértem, nem a normal-al.Igazából most miattad megtaláltam a 19.362 pontos mérést (msi profil lemaradt róla), itt éppen 868mV az idle, nem 925mV, ne kérdezd miért, pedig ez még XOC bios előtti méricskéből van.

Látom elírtam 19.361 pontra korábban, megyek alszom inkább

XOC eredmények meg ugyanezek csak 412W-nál Shrek-kel talizik.

-

BeZol

őstag

EVGA RTX 3080 FTW3 HYBRID méréseim:

Gyárilag: [link]

OC: 19.361 volt eddig a teteje

Felraktam az XOC bios-t is, 450W-ig kéne mennie, olyan 412W környékénél powerlimitel, pedig +8% helyett +18% a csúszka.

Másoknál is van hasonló probléma külföldi fórumok alapján, és úgy néz ki az LHR-es kártyákat érintheti, a mentes kártyáknál nem problémáztak emiatt.Úgyhogy egyelőre azt látom, hogy 1043mV 2175MHz-en is eltekereg a kártya Time Spy alatt, legalábbis Graphics Test 1 lefut limit nélkül, de GT2-ben annyira powerlimitel, hogy 1018mV 2115MHz fölé nem tudok menni.

Közben meg mások 1100mV-on mértek: 20.324 pontot

-

BeZol

őstag

Még akartam linkelni egy mérést is hozzá, h jóféle példánnyal 450W esetén mire képes így egy evga 3080 ftw3 hybrid: [link] (= szinte a finomhangolt 350W-os 3080 Ti szint)

Esélyesen jövő héten tudok én is benchelni egy ilyet, ill. egy rog strix 3080-ast is, kérdés melyik mennyire lesz tuningbarát

-

BeZol

őstag

válasz

laychi

#30906

üzenetére

laychi

#30906

üzenetére

Alapból 380W egy EVGA FTW3 3080, és ez húzható 400W-ra.

Ha ennél többet akarsz (450W), akkor kell az XOC BIOS, azt pedig pikk-pakk kidobja minden google találat annyi bibivel, hogy még a KR szériára, tehát a non-LHR szériára vonatkozik.

Mivel nyár óta kb. csak KL, tehát LHR-es széria kapható, ezekhez másik BIOS kell, nem jó rájuk a régi non-LHR kártyákhoz tartozó BIOS

.

Az összes XOC BIOS (3090-3080Ti-3080(LHR)-3080) elérhető itt: [link] -

BeZol

őstag

Én egyszerre használok 27" 1440p felbontásű 144Hz és 240Hz-es kijelzőket.

Látni, hogy folyékonyabb a 240Hz-es, de hogy őszinte legyek, alig ad vmi plusszt, pedig én régen versenyszerűen cs-ztem, úgyhogy nekem ezekre nagyon is rá van állva a szemem.

Ha most kéne döntenem új monitor vételén, biztos nem fizetnék 30-50%-os felárat a 240Hz miatt, totál felesleges pénzkidobás volt így utólag

-

BeZol

őstag

válasz

DanielLong

#30833

üzenetére

DanielLong

#30833

üzenetére

Én még nem találkoztam nem cw-ző 6800/6800XT/6900XT-vel, úgyhogy az nem csoda.

2ezres széria nálam kimaradt, de GTX 1080 Ti-ből a Founders Edition kártya (mondjuk ott a ventillátor hangereje kb el is nyomta ) és az MSI Gaming X is cw-zet úgy, hogy a fejhallatóba is átjött a ciripelés, ellenben ez most a cw-ző 6xxx radeonoknál és a cw-ző rog strix 3080 Ti-nél sem fordult elő, pedig ugyanaz a fejhallgató (jack dugós), csak a gép más.

) és az MSI Gaming X is cw-zet úgy, hogy a fejhallatóba is átjött a ciripelés, ellenben ez most a cw-ző 6xxx radeonoknál és a cw-ző rog strix 3080 Ti-nél sem fordult elő, pedig ugyanaz a fejhallgató (jack dugós), csak a gép más.

Egyébként nem feltétlen gáz ha cw-znek, csak a mértéke nagyon nem mindegy.

És igen, áramcsökkentés, alulfeszelés, fps-limitálás, ennél több nincs, csak a többi alkatrész cseréje lenne, de akkor inkább a kártya helyett legyen másik... -

BeZol

őstag

Én ebből tájékozódtam anno: [link]

Én AMD-vonalat ismerem jobban, ott szépen skálázódik játékokban (ha nincs cpu-limit), és ott 2 ill. 3szor annyi lesz minden a 7900 XT-ben mint a 6900 XT-ben most, kérdés a fogyasztás, de mostani széria 200W-ra alulfeszelve még elég szépet domborít, úgyhogy az 1000%, hogy 450W-ból lazán megoldják ezeket az újak és a 2x teljesítmény lazán meg is lesz velük, szóval számomra fő kérdés inkább az, hogy mennyivel mennek majd a 2szeres teljesítmény fölé, és főleg milyen áron.

Nvidia-nál ugye nehezebb, mert a monolitikus chip miatt nem lesz olyan jó a kihozatali arány, tehát biztos drága lesz

Mivel a mostani csúcskártyák 1440p-n már cpu-limitesek, ezekkel már a 4k cpu-limit is meglehet

Szerintem aki ilyenbe beruház, annak olyan jó vétel lesz, mint anno a GTX 1080 Ti fullHD-ra, csak azóta elterjedt az 1440p és lassan haladunk 4k felé.

Gondolom elkövetkező években megyünk 8k és feljebb...

VR-os dolgokat nem vágom, hogy oda mennyire kell a kakaó.Részemről zen4 + 7xxx radeon vagy 4xxx nvidia év végén, aztán 4 évig bottal sem piszkálom gépem, annyi h amd-nél fixen ki kell várni vajon milyen gyerekbetegségek lesznek, mondjuk ezt egy 14napos elállási idő alatt ki lehet tesztelgetni

Utána ahogy írtam rá 2 évre sok újdonságra nem számítanék, csak 4 év múlva

DanielLong:

állj el a vásárlástól, ne szenvedj vele. -

BeZol

őstag

Next gen Nvidia év végén ha hozza a beígért 2,5x sebességet 3090-hez képest, akkor a 4k 144fps meg kell legyen.

Mindez 8nm vs 5nm hozadéka is egyben (azonos x*y méretű chipméretbe 60%-kal több cuccot tudnak begyömöszölni).

Ha utána rá 2 évre még marad az 5nm, akkor kb. 30% erősödést várnék egy "refreshtől".

Viszont amikor lemennek 3nm-re, ott megint durva ugrás lehetséges, kérdés mennyire tudnak jól haladni, de ott simán meglehet megint egy ekkora mértékű ugrás.

Ugye itt ami "trükkös" lehet, hogy AMD már multi-chipes designt fog tolni a 7xxx szériánál év végén (ők 3x sebességről beszélnek 6900 XT-hez képest), Nvidia pedig majd a rákövetkező 5xxx szériánál fog csak (esélyesen AMD hibájájából tanulva, ha lesz hiba persze..., sztem lesz ).

).

Szóval innentől kezdve ezekkel a multi-chipekkel elég szép teljesítményugrást is össze lehet ollózni sok pici chipet összerakva, mint ahogy az történt a ryzen prociknál is (bár ott ugye Intel dominancia miatt nem igazán volt verseny, gpu-knál pedig mostani szériával már igenis van, így h Intel is érkezik, meg aztán végképp el kéne lőnie mindenkinek a puskaporait). -

BeZol

őstag

válasz

laychi

#30811

üzenetére

laychi

#30811

üzenetére

Igen, szégyen, de a poén h nem gyorsult, tehát a gyári 295-300W-os órajelnél megvolt a limit.

2084MHz az average-ed, nekem meg 2127MHz, a strix bios mellett 330W-os fogyival pedig hiába 2205MHz az average-em, nem gyorsult semmit mert memória-limit van:

[link] (2087mhz-ed a 2205mhz-emhez, graphics card résznél nézd)

Úgyhogy nem a fogyasztás a szégyen, mert igazából a gpu gyorsult rendesen, csak a memória megfogott mindent , ezért a graphics score maradt ugyanott mint neked 2085mhz-nél.

, ezért a graphics score maradt ugyanott mint neked 2085mhz-nél.

Ugye a lényeg meg az lenne, hogy vajon 3080/3080Ti/3090 vonalon van-e ilyesmi. -

BeZol

őstag

3070-esnél a +1000 memória kb. 2085MHz-ig jó, afelett +1000 fölé kell menni, és nálam 2115-2130MHz-en javultak a pontok ha +1200-ról +1300-ra húztam (csak hát artifactolt így...), és amikor Strix bios-t tettem az ftw3-asomra és feltekertem a gyári 300W fölé, akkor 2160+MHz-re jutottam, de semmivel sem lett több pontom, mert a +1300-as memória megfogta

Átlag-órajeleket nézzétek:

ftw3 3070: [link]

ftw3 3070 strix bios-al: [link]

Jó kis példány volt ez az ftw3

(330W-ig evett egyébként és itt még nem ismertem annyi trükköt mint manapság)

(330W-ig evett egyébként és itt még nem ismertem annyi trükköt mint manapság)Ha ezt kéne 3080-ra átskálázni, itt 14gbps helyett 19gbps a memória, ez gyári vs gyári értékeken +35,7% sebesség, persze 256bit helyett 326bit van, ez is rágyorsít a dolgokra, de ennyire nem vagyok szakértő h ezt mennyire vegyem be a képletbe

Erre valaki?

Erre valaki?Sima 3060-asnál is hasonló limit van egyébként ugyanilyen órajelek és memória-OC mellett 1:1-ben

Szóval én nem csodáltam, hogy kihozták a 3070 Ti-okat

Mondjuk azt még nem teszteltem így ki memóriára, de majd rálesek, hiszen 19gbps memóriás az is, csak 256biten ugye, és azért szépen tudnak menni, csak még nem járt csúcs-példány belőle nálam, nem tudom a TUF verzió mennyire számít majd annak, azzal rá tudok majd lesni, de ez másik topik lesz ugye![;]](//cdn.rios.hu/dl/s/v1.gif) HUN TOP 1 3070 Ti remélem végre meglesz, 3070-nél nem sikerült

HUN TOP 1 3070 Ti remélem végre meglesz, 3070-nél nem sikerült  (bár ma már sikerülne

(bár ma már sikerülne  )

)AMD 6800 XT / 6900 XT-ken +10MHz memória +100 GS (XTXH chipes 6900 XT-ken pedig csak 2150-ig húzható a gyári 2000-ről), ott nagyon is számít, de ugye az meg csak 16gbps GDDR6 infinity cache-el, amit szintén húzni kell (mármint infinity cache órajelét), mert a gyári 1900MHz-en 24.200 GS-nél "vége". Ennek a húzása egyébként 6700 XT esetén is kell 14.300 ponttól

Na jó, sok az off, de gondoltam ha már memória, leírom én mit tapasztaltam.

Na jó, sok az off, de gondoltam ha már memória, leírom én mit tapasztaltam.Next gen kártyák meg sztem ha nem kapnak HBM3? vagy ilyesmi memóriát, akkor nvidia is inifinity cache-t kell használjon, hogy a 2,5-3szoros teljesítményt le tudják adni, mert kvázi a 15ezer pontnál kifingó 14gbps GDDR6-hoz képest a 16gbps GDDR6 + infinity cache 26ezer pontnál fingik ki (28ezer pont 18gbps memóriás biosú kártyával oldható meg), bár biztos segítene még a memória OC itt, mert az órajelelőnyük nem magyaráz ekkora pontszámelőnyt

Szóval szinte 2szeres sebesség megoldható "azonos" GDDR6 memóriának a sávszélességével infinity cache-t használva.

Szerintem GDDR6X-el ez pont menni fog és max übercsúcs kártya kap HBM3? memóriát.A hét második felében remélem már tudok 3080 és 3070 Ti mérésekkel szolgálni

Edit:

Na akkor már lemérték mások

-

BeZol

őstag

válasz

zebra_hun

#30790

üzenetére

zebra_hun

#30790

üzenetére

Az szép, ez esélyesen szilikonlottó teteje volt, grat a jó példányhoz, főleg ha játékstabil is a setup, akkor bomba-jó.

ffodi:

igen, de józanul átlagos kártyát átlagos kártyához nézve 350W-os 3080 Ti 20.500 GS, 450W-os pedig szilikonlottótól függően 21ezer környéke és felette. Sajnos ha peches vagy (ezek szerint én az voltam), akkor efölé nem jutsz és kész, hiába van Strix-ed.

350W-ból több 3080 Ti is tudta ezt a 20.350-20.550 pont közötti értéket, ami efelett van sajnos lutri és csak azt akartam kihozni az egészből, hogy nem éri meg a többletbefektetést, mert HA szerencsés vagy, akkor 21.500 körül vagy (laychinál 430W-ból) a 20.500-hoz képest, és akkor 355W-os Gigabyte-csúcsfogyihoz képest a 430W +21,13% fogyasztás, mellé pedig kapsz +4,88% teljesítményt. Ismétlem, EZ HA SZERENCSÉS VAGY! (amúgy meg 20.900 környéke 450W-ból

(amúgy meg 20.900 környéke 450W-ból  )

)

Hűtés is hangosabb (kivéve ha vizezed), az egész igazából magát a benchmarkolást és rekordhajszolgatást leszámítva értelmetlen.

Persze így gondolkodva lehet 300W-ra alulfeszelt pontokhoz képest már a 350W is csúnyácska (vki mérhet ilyesmit ha van kedve), de ez már ízlések és pofonok, átlag user MSI AB-t sem ismeri nah

-

BeZol

őstag

Dehogynem, shunt modolva 490W-ig mehetsz 2x8pines kártyákkal

Kérdés akarod-e, és megéri-e.

Sztem botrányosan elszáll a fogyasztás 350W felettől úgy, hogy teljesítményt nem igazán kapsz érte, legalábbis a ROG Strix 3080 Ti-nél ezt tapasztaltam, ami btw jobban ment mint SzlobiG-é... (bár nem tudom mennyire maxoltad ki anno)Ez pont nem a maxos OC-runom a Strix-el (azt nem fotóztam ki, de a lényegi fogyasztás ugyanez):

Ez meg a Gigabyte Gaming OC 3080 Ti 350W-ból:

Ez meg a Gigabyte Aorus Xtreme Waterforce 3080 Ti szintén 350W-ból:

Ezek után nyilvánvaló, hogy csak akkor van értelme 350W fölé menni, ha a szilikonlottón nyertél és bírja is a gpu-chip a magasabb órajeleket, és ha nagyon szerencsés vagy, akkor 2100MHz fölé jutva a 21.500 Graphics Score környéke meglesz.

Hűtés tudja, VRM tudja, de a szilikonlottó dönt a végén

Strix 3070-esem is ilyen volt, 350W ellenére felmosta vele a padlót egy 275W-os gaming oc...

Azt hinné az ember, hogy a hype mögött van valami, hiszen egy STRIX, aztán igazából eddig talán 4db strix kártya járt nálam, mindegyik harmat-gyenge volt

Legutóbbi 3080 Ti meg még cw-zett is... Olyan szintű csalódás az összes, mint az, amikor megláttam mit produkál egy 2ventis asus dual mini hűtés egy 3060 Ti-n (természetesen azt is asus gyártja

Legutóbbi 3080 Ti meg még cw-zett is... Olyan szintű csalódás az összes, mint az, amikor megláttam mit produkál egy 2ventis asus dual mini hűtés egy 3060 Ti-n (természetesen azt is asus gyártja  ).

).Lehet, hogy előző gennél csodákra voltak képesek, de saját tapasztalat alapján egy peták felárat sem érnek.

-

BeZol

őstag

BF1-et és BFV-öt vettem meg utoljára, mindkettő játékot toltam 2-3 hétig, utána meguntam.

Mikor rá 1-2 hónapra újra elővettem kb csak este 19 után volt 4-6szervernél több amin voltak játékosok... Napközben kb. halott volt a játék. Na az új BF-nél gondolom ez halmozottan jelentkezhet, de ti akik megvettétek biztosan jobban tudjátok. -

BeZol

őstag

válasz

laychi

#30577

üzenetére

laychi

#30577

üzenetére

Igen, ezt tudtam én is.

Itt ugye az volt a összevetés érdekessége, hogy ugyanaz a hűtés, ugyanaz a 350W körüli TDP keret, mégis az egyik 3080 másik 3080 Ti, tehát mennyire tudja kifutni magát így a 3080, és mennyire van korlátozva a 3080 Ti, vice versa.

Az eredmény az lett, hogy kb. +10%-kal gyorsabb a 3080 Ti a 3080-asnál azonos 350W TDP-ből gazdálkodva.

Szilikonlottón múlhat h ennél több v. kevesebb a különbség.

A ROG Strix 3080 Ti-m alapján pedig nincs értelme jobban elengedni ezeket, mert +28,5% fogyasztásért (350W vs 450W) kapsz jobb esetben +5% teljesítményt (én példányomnál +1,5% volt konkrétan...).A többi következtetést meg mindenki levonhatja magának, hogy ezek után mely típusokat érdemesebb vásárolni, mert sztem 3080 fölé menni nincs értelme, jobb esetben (4K) nagy TDP-jű modellel van +15%, cserébe talán legalább 30%-kal drágábbak a 3080 Ti-ok.

Ugyanakkor megjegyezném, hogy

RTX 3070-esekkel 15k Graphics Score (275W)

RTX 3070 Ti-vel 15,9k Graphics Score (320W)

érhető el tuningolva (és ezek játékban is stabilak voltak nálam), innen pedig egy 350W TDP-s 3080-as is csupán 12,5-20% teljesítményre van, ami szerintem elenyésző, főleg ha sikerül jó szilikonlottós 3070/3070Ti-s kártyát kifogni és rápakolni egy Strix BIOS-t

![;]](//cdn.rios.hu/dl/s/v1.gif)

Persze Nvidia jól kitalálta ezt, mindenki megtalálja a megfelelő teljesítményszintet, de azért be kell látni, hogy a 3070-eshez képest közel 50%-os felára van egy 3080-asnak, sehogy sem jön ki a matek játékra, csak bányára, míg egy 3060 vs 3070-es esetén 9,5k vs 15k graphics score alapján 58%-kal erősebb egy 3070-es, ugyanakkor bányára meg csak 26%-kal jobb a 3070, ezért itt a gamerek "nyernek" a dolgon, már ha ilyen árazások mellett ezt nyerőnek lehet nevezni.

(legyen azért egy 3060 bench is a számok miatt)

-

BeZol

őstag

Én pedig ahogy ígértem neked, jelentkezem a

Gigabyte AORUS GeForce RTX™ 3080 Ti XTREME WATERFORCE 12G

eredményeimmel:Ugye mindkettőnknél 350W körüli a TDP-keret, jutottál végül 18.150 pont környéke fölé?

Mert ha nem, akkor a stock 17.950 környéke pontodhoz képest nézve plug and play ki van akkor maxolva ennek a kártyának a 3080-as verziója, míg a 3080 Ti-ben van +5% finomhangolási lehetőség.Amúgy ugyanazt tudja, mint a Gigabyte Gaming OC RTX 3080 Ti-om tudta annyi különbséggel, hogy az 1850rpm-ig felpörgött gyárilag, ez meg végig 1250rpm és közben -10fok a gpu.

Ugyanilyen GPU-hőfokhoz 2850rpm-en (100%) forgott a Gaming OC

Side-note: nagyon szépek a fényei. Én világítás-ellenes vagyok, mert "minek" (minden kártyán első dolgom lekapcsolni a fényeket), de ez nagyon adja még nekem is

-

BeZol

őstag

válasz

laychi

#30549

üzenetére

laychi

#30549

üzenetére

Gratula!

Alapvetően viszont legtöbben (sztem) csak Time Spy-t mérnek, ezért itt nincs meg ugyanaz konkurencia. Pl. én sem mértem soha ilyet, csak TS Extreme-et (de az meg már túlságosan durva terhelés), ill. 1-2 Port Royal-t RT miatt, de maradtam a sima TS-nél, sztem ingyenes 3dMark is csak azt tudja, többi fizetős

-

BeZol

őstag

válasz

SzlobiG

#29832

üzenetére

SzlobiG

#29832

üzenetére

Igen, 80-100fps már oké sztem is, de 80 alatt már tutira érezni h "akadozósabb".

Több száz órát toltam eddigi Forzákkal, nálam meg pont ez a releváns, a lövöldéket kiiktattam mostanra. A lényeg h van benchmark, mindenki tudja reprodukálni, aztán lehet itt hasonlítgatni kinél mizu.

laychi:

akkor ugyanaz mint legutóbb, gondolom a 3080-asod sem jut 78-79fölé most sem.

Nvidiákat nem érintette a játék-patch. -

BeZol

őstag

válasz

ForRedGlory

#29794

üzenetére

ForRedGlory

#29794

üzenetére

-

BeZol

őstag

válasz

ForRedGlory

#29814

üzenetére

ForRedGlory

#29814

üzenetére

NVIDIA videókártya mellett vmiért sokkal durvább a cpu-terhelés és az fps sincs ott a szeren, de holnap pattintok be egy Gigabyte Gaming OC RTX 3080 Ti-t és megnézem azzal is az új verziószámot.

Az AMD-vel volt 109 fps is, csak az nem játékstabil, csupán benchstabil.

Levideóztam egyébként mobillal, meg tudod nézni: [link] (zajokért bocsi, feleségem pakolt el tányérokat az asztalról)

(akartam 2. kört futtatni, de az már kifagyott, olyankor nincsen a bench elején az a "beakadás" és +1 fps lehetséges)Amit linkeltél videót, ott szerintem rögzítés közben bencheltek ezért nem jó az fps-e, külön capture cardos 2. gép kell ilyen célokra.

SzlobiG:

csak neki xarrá van tuningolva a 6900Ott a GPU-Z screenshot, látod a fogyasztást, hogy 328W-ig evett, a gyári kitolt TDP pedig 344W ennek a 6900 XT-nek (egyébként 304W)...

Pont h nem megy jól és mégis sok az fps, mert a másik ultimate chipes amd 2885-2985MHz-en ment, és nem 2725-2825-ön...

Azt hittem a korábbi kártya anomáliás volt így utólag, de nem, csak a játék kapott egy frissítést és ezért, de így felmerül h jobban terhel-e ami miatt a korábbi magas órajelek meg nem mennek Egyelőre még nem tiszta számomra sem.

Egyelőre még nem tiszta számomra sem.

A lényeg, hogy nem volt szénné húzva a videókártya, gyárilag ennyit tud, itt nincsen ügyeskedés MorePowerTool-al. -

BeZol

őstag

válasz

ForRedGlory

#29791

üzenetére

ForRedGlory

#29791

üzenetére

-

-

BeZol

őstag

Akinek megvan a Forza Horizon 5 mérne nekem egy OC-profilos 4K extreme presetet?

(3080 Ti és 3090 eredmény érdekelne, és csak tuningolt)

(3080 Ti és 3090 eredmény érdekelne, és csak tuningolt) -

BeZol

őstag

Fekete színű hőpadra tipp, hogy melyik termék lehet?

-

BeZol

őstag

válasz

ForRedGlory

#17713

üzenetére

ForRedGlory

#17713

üzenetére

De, utána kértem, csak ezek szerint elkerülte a figyelmed most meg osztod az észt

Látom böki a csőröd a dolog, de engem érdekel mit hoz ugyanilyen körülmények között egy 3080-as, erre kértem a kedves fórumtársaságot h egy szögegyszerű dolgot teszteljen le és látom az egész topic képtelen rá, legalább te vetted a fáradságot és igen, megcsináltad, de az extra kérésnek a mai napig nem tettél eleget! Persze nem kötelező.

Azért gratulálok a stílusodhoz

-

BeZol

őstag

válasz

ForRedGlory

#17638

üzenetére

ForRedGlory

#17638

üzenetére

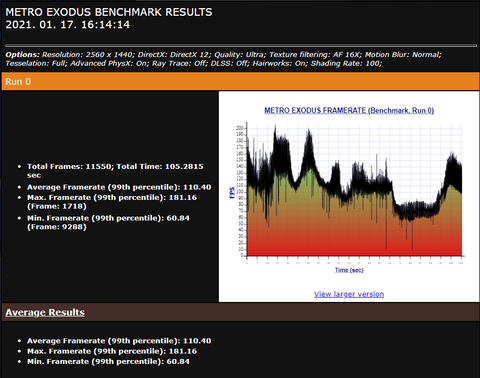

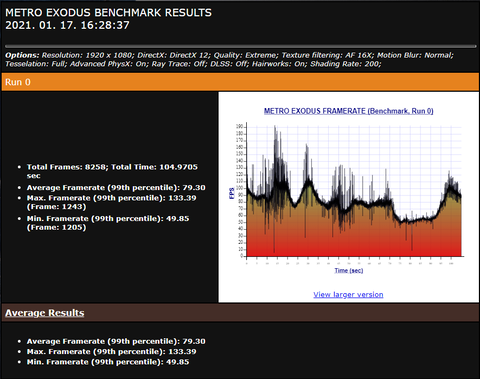

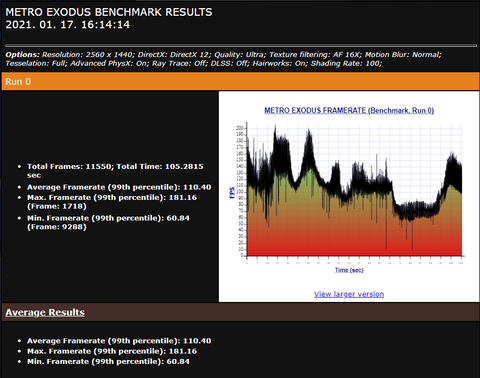

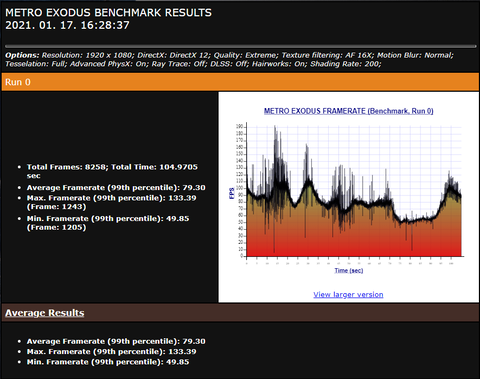

Mivel nem válaszoltál végül milyen beállítással csináltad, csináltam én is egyet más beállítással:

Amit linkeltél 1440p ultra RTX 3080:

-------------------------------------------------------------------------------------------------------------------------------

1080p extreme RTX 3080:

Nálam 4.7GHz-re húzott 8700K van 3866MHz CL17 memóriával, ez esélyesen hatással van a min-max értékekre, emiatt pedig az átlagot is lejjebb húzhatja.

AMD procival SAM is lehetne, az +5-10% extra. Tudom, nvidiának is lesz feb. végén. -

BeZol

őstag

válasz

ForRedGlory

#17638

üzenetére

ForRedGlory

#17638

üzenetére

GPU-Z feszültségi, fogyasztási és órajelértékek lemaradtak

Csinálhatok RT-t is, de őszinte leszek, én eddig wow-ban próbáltam mind nvidia mind amd kártyákon, 30 percen belül mindegyik kártyával asztalra ledobott, 5 sec múlva vissza, és a játék lekapcsolta az RT-t...

Amíg ment addig aláírom volt egy extra képélmény-faktor, de nem volt stabil. Tudom, máshol jól működik de így meh... -

BeZol

őstag

Ezek a netes plug and play tesztek nem igazán relevánsak, mert pontosan olyanok, mint egy K-es Intel proci stock órajelen járatva. Esélyes, hogy a többség így használja, de hogy nincs értelmes keretek között kihasználva a képességük, az is biztos.

A topicban is látom, hogy mindenki finomhangolhat 950mV 2010MHz-re és társai.

A metro exodus benchmark egész könnyedén reprodukálható, csak látom sokan 4K-s kijelzővel mértek és a presetbe is belenyúltak, ezért nem könnyű összehasonlítani. -

BeZol

őstag

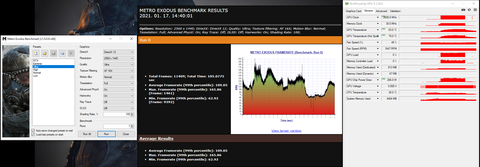

Metro Exodus 1440p Ultra preset i7-8700K @4.7GHz 2x8GB 3866MHz CL17 memória:

1.05V RX 6800 XT (RT OFF) átlag 2600MHz-en futva 2150MHz-es fast timing memóriával:

Jöhetnek hasonló RTX 3080-as benchek, de korábbiakat is linkelhettek! Érdekelne mi az erőviszony.

Konnektorból mérve 450-470W a gép fogyasztása (csak a doboz).

-

BeZol

őstag

válasz

Jocikablack

#16489

üzenetére

Jocikablack

#16489

üzenetére

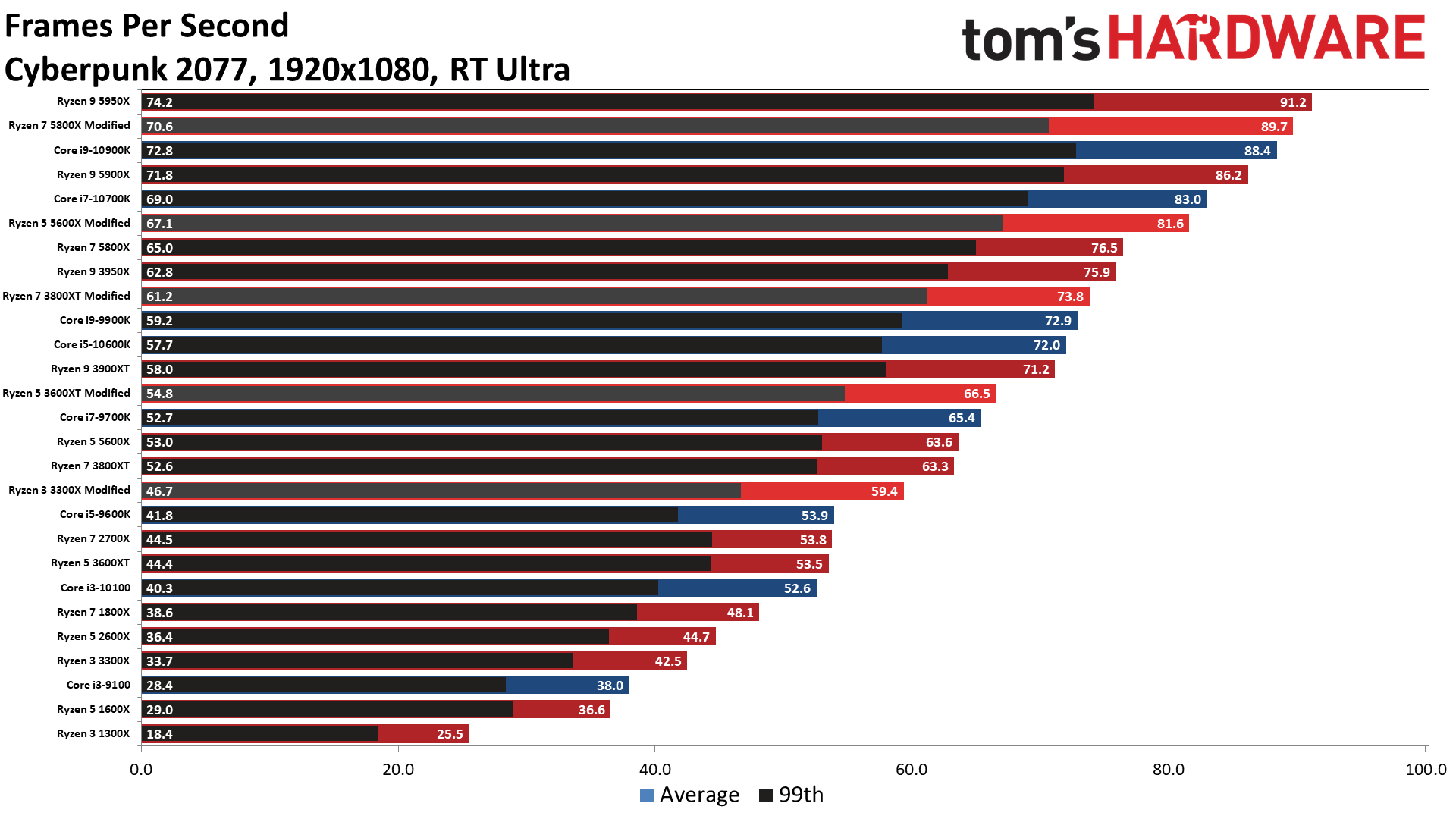

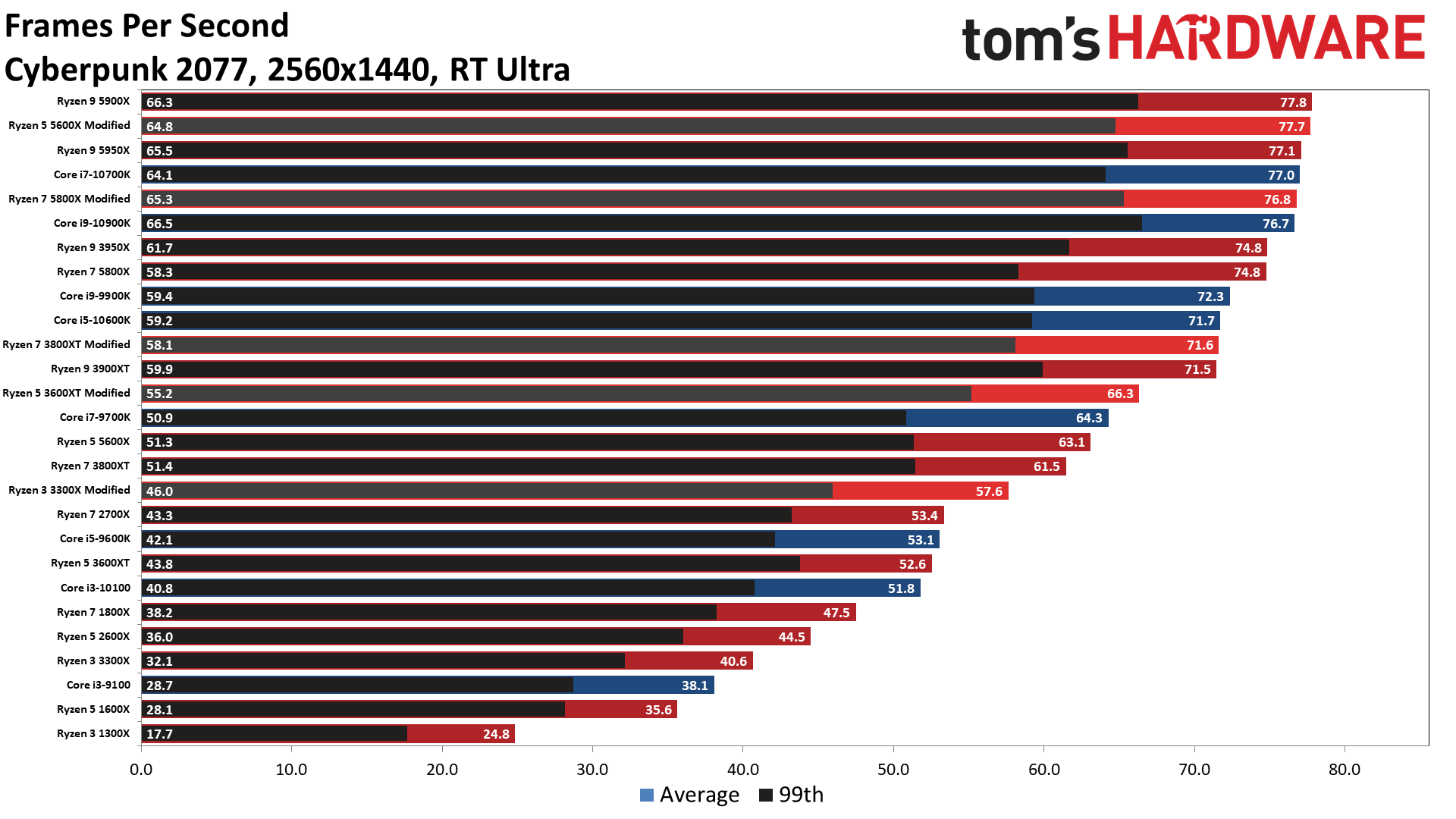

1080p RTX 3090-essel:

1440p:

Teljes cikk: [link]

Ez egyébként konkrétan annak az esete, mikor anno 9700K megjelenése után én továbbra is a 8700K-t ajánlottam mindenkinek.

Persze a sok fórumhuszár nekem esett, hiába mondtam h az oké, h gyárilag magasabb a turbó és ezért nyer a teszteken a 9700K és h forrasztott kupakos már ezért tényleg out of the box mehet jó hűtéssel akár 5GHz is (nem csak 4.7ghz, csak deliddel megy több 8700K-val), de mondom 6szálas optimalizációig órajelet leszámítva (ami K verzió esetén ugye egy szintre hozható az IPC meg ugyanaz) egyforma, 7-8szálig optimalizált játéknál jobb a 9700K a true 8mag miatt, viszont amint 9-12 szálat használ ki egy játék, akkor mehet a levesbe és jobb lesz a 8700K. Magyarul jobban jövőtállóbb a 6/12 mint a 8/8...Aki esetleg nem lenne képben:

A 8700K 6mag12szálas processzor all core 4.3GHz-en megy teljes terhelésen

A 9700K 8mag8szálas már forrasztott kupakos és all core 4.6GHz-en megy teljes terhelésen

A benchmarkokban és játéktesztekben emiatt az órajelkülönbség miatt nyer a 9700K, de mindkét processzor 4.7-5.0GHz közé húzható 24/7 AVX 0 ofsettel.

A 10600K a 8700K "újracsomagolt" változata 4.5GHz-es all core turbo értékkel.

Jocika, a te non-K 9700-asod pedig 4.4GHz-en tud futni teljes terhelésen.Itt meg is jegyezném, hogy stock órajelen tesztelni egy K-s processzort rendben van, DE legyen mellette egy OC-s órajel is ha már tuningolható...

Magyarul a fenti "teszt" eredményeit érdemes felszorozni az extra elérhető órajelek arányában, tehát nyugodtan lehetne számolni gagyibb hűtés esetén is minimum 4.8GHz-es értékekkel, jobb hűtéssel pedig 5GHz-el is.A 10600K eredménye így a stock 4.5GHz-es 1080p eredmény 72-es átlagáról 5GHz-en 80fps lenne.

A 9700K eredménye így a stock 4.6GHz-es 1080p eredmény 65.4-es átlagáról 5GHz-en 71,1 fps lenne.

9900K 4.7GHz stock

10700K 4.7GHz stock

10900K 4.8GHz stockÉs igen, nekem is furcsa miért jobb a 10700K a 9900K-nál mikor kvázi egyformák.

Aki pedig 9900K-ra upgradel mert "lusta" platformot váltani, annak üzenem, hogy a 9900K-t teljes terhelésen nem fogja egy 30-40ezres Z370/390-es alaplap meghajtani, mert a VRM nem fogja bírni 100%-os terhelésnél. Oké, ez sok játékban bőven rendben van mert 20-30%-os terheltségnél fityeg a rendszer, de azért ami késik nem múlik!

Az pedig, hogy 10700K-t vásároljon az ember (ugyanannyiba kerül), igazából olyan szempontból nem többletkiadás, hogy a 10700K-nál és 9900K-nál is csak a 60ezer Ft környéki alaplapok a minimum, amivel tényleg bírja a rendszer a 100% terhelést.

Ergo ha úgy fejleszt vki 9900K-ra, hogy szotyi alaplapja van, az jobban járna akár a teljes platformcserével... De most már érdemes megvárni a 11xxx szériát mert +20% IPC lesz, kérdés már csak a hozzá tartozó órajel (magyarul összteljesítményben a 8/16-os új proci közel hozza majd a 10/20-as 10900K szintjét, de játékokban 100% kihasználtság alatt ez +20% fps-t jelentene azonos órajelen![;]](//cdn.rios.hu/dl/s/v1.gif) )

) -

BeZol

őstag

Én még nem gariztattam náluk, de ÁSZF-jüket elolvasva (azt hiszem okt. 20. a legfrissebb kiadás) én arra lyutottam, hogy ezek az emberek akik ilyen híreket terjesztenek vagy riogatják a népet h ne vegyed meg scalperektől a kártyákat, vagy korábban tényleg ilyen hozzáállása volt az Alza-nak, amíg a fogyasztóvédelem esélyesen rájuk nem szállt, mert már több büntetést is benyeltek ahogy találtam 1-2 cikket vagy hozzászólást a témával kapcsolatosan.

Szóval valós tapasztalatom nincs, ÁSZF is csak annyit ír, hogy elég a rendelésszám/számlaszám, még az eredeti számla bemutatása sem szükséges

-

BeZol

őstag

válasz

-=RelakS=-

#16319

üzenetére

-=RelakS=-

#16319

üzenetére

Ez pontosan ugyanaz, mint mostani RTX kártyáknál, hogy +5% teljesítmény még megvan extra 10-15% fogyasztásból, de további +5% teljesítményhez már +30% fogyasztás kell. Ha megy-megy, de h megéri-e 24/7, kétlem.

Prociknál ugyanez. 8700K is be tud kajolni 220W-ot

![;]](//cdn.rios.hu/dl/s/v1.gif)

8700k - 4.7GHz / 1.20v (delidded)

Prime95 v29.4 AVX Small FFTs (5 mins): 165 watts

Max Core Temp: 67c

8700k - 5.0Ghz / 1.328v (delidded)

Prime95 v29.4 AVX Small FFTs (5 mins): 225 watts

Max Core Temp: 77cJátékfüggő ugye, hogy mekkora terhelést kap egy "szénné" húzott proci, mert ha 100%-ra terhelődne, akkor tényleg lecsapolhatna sok-sok áramot. Gyakorlatilag vannak tesztek, ahol 6/6 100%-ra terhelődik (BF 64fős multik), és sztem már létezik 8/8 100% is (min. fps-es értékek vmelyik játékban elég gyérek, ezért gondolom), a 6/12 még talán nem ér el sehol 100%-os terhelést játékokban.

Videókártya-fogyasztással kapcsolatos történet, ha érdekel vkit:

Referencia RX 5700XT-t használtam (110ért vettem márciusban és 150ért vették meg Karácsony előtti héten fél év garival... ).

).

Elvileg 220W TDP-vel rendelkeznek, a gyári tuningosok azt hiszem 250W környékén is tudnak fogyasztani (régen volt, nem rémlik pontosan).

Gyakorlatilag annyira trágya volt a referencia-hűtés, hogy épphogy 180-185W-os fogyasztás mellett tudta azt, hogy épphogy throttlingolt vagy épphogy nem (gpu hostspot 110fokba belenyalt). A végén undervoltolva és picit downclockolva használtam 150-160W-os fogyasztás mellett úúúúúúgy, hogy a 250W fogyasztású "extrémen" húzott kártyák 10%-ot vertek a kártyámra 4k optimized superposition-ben...Még csak pletykák voltak akkoriban az RX 6xxx szériáról, ami abból állt, hogy 2x annyi cucc lesz benne mint az 5700XT-ben, meg hogy RDNA helyett már RDNA 2 architektúra lesz. Idővel kiderült h ray tracinges magok is lesznek benne emellett, és hát ugye gondolná az ember, hogy RDNA 2 architektúra, biztos gyorsulnak vmit akár azonos órajelen is RDNA 1.0-hoz képest (nvidiánál ezek az "optimalizációk" akár 15%-20%-ot is hoztak anno), mellé 2x cucc és hát biztosan 100%-nál is erősebbek lesznek, talán 120% környéke reális lehet.

Jött a megjelenés, és azt hiszem 85% körüli gyorsulás történt az 5700XT-hez képest 300W körüli fogyasztás mellett.És akkor már biztos van akinek összeállt a kép, tulajdonképpen egy 150W környékére downclockolt RX 5700XT esetén pont kijön a 100% extra teljesítmény, ami a 2x feldogozóegység esetén elvárás is volt, de hogy maga az RDNA 2 az rt magokon kívül semmi más, az is fix, csak marketing bullsh*t.

A lényeg, hogy minden procinak és videókártyának megvan a sweet-spotja, hogy milyen órajelen és milyen feszültséggel érdemes használni, mert bizonyos szint felett exponenciálisan megnő a fogyasztás (ezzel együtt a hőtermelés), és tulajdonképpen semmi értelme az egésznek, mert csak egy rakat pénzt költ az ember akár víz vagy épített vízhűtésre, ne adj isten cryocoolerre (10900K all core 5.8ghz megy vele cpu-z-ben, csak hát 200W-ot fogyaszt ilyenkor csak a hűtő

![;]](//cdn.rios.hu/dl/s/v1.gif) : AIO és épített víz verzió, utóbbiról pedig teszt itt)

: AIO és épített víz verzió, utóbbiról pedig teszt itt)

Gondoltam belinkelem, mert csak idő kérdése, és gpu-khoz is lecsoroghat a technika.Egy szó mint száz, esélyesen a legolcsóbb RTX 3080-assal jár jól az ember:

- hőfok hivatalosan 90 fokig mehet, én biztosan bestabilizálnám 80-85 fokra játékokban (benchmarkban throttlingolhat akár)

- emellé finomhangolnám a ventillátorprofilt, hogy 1600as fordulat fölé ne menjen soha (aki érzékenyebb, viheti lejjebb és, meg hát gyártónként más hangereje is lehet a kártyáknak azonos fordulaton)

- ahhoz, hogy a kártya eleve hűvösebb legyen, érdemes undervoltolni adott MHz-re, és ha netán nem tudná x fordulat mellett tartani a szimpatikus hőfokokat, akkor menni lejjebb a feszültséggel + a hozzá tartozó órajellel.

- a folyamat végén pedig mindenki vissza tudja ellenőrizni, hogy mekkora teljesítményveszteséggel járt a folyamat, cserébe spórolt egy valag pénzt (akár 50+ezer Ft-ot egy gyári oc-s kártyához képest) és halkabb is lett a kártya a gyári értékekhez képest.Még "B"-verzióként léteznek after-market gpu-hűtők, mint pl. az ARTIC Accelero Xtreme IV, ami elvileg "csak" 300W TDP, de pl. van RTX 2080Ti benchmark vele, esélyesen nem lenne vészes hőfok vele egy RTX 3080 esetén sem, kérdés h kompatibilis-e vele persze, csak hát ugye nem mindegyik gyártó engedi az ilyesmit, ezért ez garanciavesztéssel járhat.

Szóval legolcsóbb kártya + mellé 20ezer Ft-ért egy ilyen és öröm boldogság

-

BeZol

őstag

válasz

foxshoxable

#16297

üzenetére

foxshoxable

#16297

üzenetére

vagy kihúzod a kábelt ami csipogtatja a gépházad mini-hangszóróját.

-

BeZol

őstag

válasz

Lord Myn

#2195

üzenetére

Lord Myn

#2195

üzenetére

Ezért kell 1szer venni egy 700+ W-os tápot, és le van tudva jó időre a témakör.

Én 2009-es corsair 750W-os tápot használok mai napig (8700k+5700xt), de előtte kapott crossfire 2kártyás rendszer miatt játékokban 550W-os terhelést is évekig!

Amit te írsz, olyat haverom sem mert bevállalni, pedig 620W-os tápja volt. -

BeZol

őstag

Hiába riogatsz itt ilyesmivel, már vittem vissza alaplapot pont ipon-ba 1 hét használat után, annyi h ülnek 2-3 hetet a pénzeden még utána. Ha meg gyakori ilyen vevő vagy, akkor lehet ki sem szolgálnak egy idő után

Értékcsökkenés akkor lenne, ha pl megkarcolod, de ez teljesen érthető is, de az, hogy bontottá válik a csomagolás és "kipróbálod, használod" úgy, hogy ebből semmi sem látszódik meg a kártyán, akkor nincs miről beszélni.

Mondok neked egy teljesen életszerű példát: megrendeled, kibontod, éééééés nem fér be a gépházba, de pl. nem 1-2szer előfordult, hogy épp annyi dolgunk volt, hogy hiába hoztunk vmit haza vagy hozta haza a postás (most pl covid miatt mi 3 napig minden dobozt "pihentetünk" a fertőtlenítést követően a csecsemő miatt), egyszerűen 3-4 napok is elteltek mire tényleg kibontottuk. Vagy másik példa, mikor pl. szülőkkel vetet vmit az ember, és csak x nap múlva hozzák át a terméket.

User hiba miatti karcoláson kívül mesélj nekem, hogyan bizonyítja bármelyik e-kereskedő, hogy értékcsökkenést kell fizetned?

Ez a kártya eleve sok áramot eszik, lehet a táp nem bírja vkinél és emiatt inkább eláll a vásárlástól. Annyi féle-fajta valós/kamu indok lehet. Ez az a rész, amikor a gyakorlat találkozik a "törvénykezéssel".

A nyuszi-muszi vásárlót persze meg lehet szivatni, de az ilyen embereket az élet más területén is eltapossák

Ezektől függetlenül nekem nem lenne pofám ennyire túlárazott esetben egyáltalán megvenni majd visszavinni. De ha pl. coil-whine-olna, vagy hangosnak ítélném, szintén vinném vissza, és ugye indokolni sem kell. Nem kell és kész. Give my money back

-

BeZol

őstag

Új hozzászólás Aktív témák

- Autós topik

- Kés topik

- NVIDIA® driverek topikja

- Dreame Pilot - Álomhaj, ó!

- Milyen egeret válasszak?

- Xiaomi 17 Ultra - jó az optikája

- Ha az alaplapi hangchipnél jobbra váltanál, itt az új Sound Blaster hangkártya

- Samsung Galaxy S24+ - a személyi asszisztens

- Fejhallgató erősítő és DAC topik

- Egérpad topik

- További aktív témák...

- HIBÁTLAN iPhone 15 128GB Pink-1 ÉV GARANCIA - Kártyafüggetlen, MS4635

- ÁRGARANCIA! Épített KomPhone Ryzen 7 9800X3D 32/64GB RAM RTX 5090 32GB GAMER PC termékbeszámítással

- HIBÁTLAN iPhone SE 2020 64GB Red -1 ÉV GARANCIA - Kártyafüggetlen, MS4366

- Apple iPhone 12 Pro 256GB, Kártyafüggetlen, 1 Év Garanciával

- Prémium! Bambulab bontatlan filamentek (PLA - PETG- ABS) ÁFÁS- számlával eladóak készletről!

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

4ből 1 ilyen saját merítésem alapján

4ből 1 ilyen saját merítésem alapján

![;]](http://cdn.rios.hu/dl/s/v1.gif)

, nem porosodik így nagyon?

, nem porosodik így nagyon?

, ezért a graphics score maradt ugyanott mint neked 2085mhz-nél.

, ezért a graphics score maradt ugyanott mint neked 2085mhz-nél.

Legutóbbi 3080 Ti meg még cw-zett is... Olyan szintű csalódás az összes, mint az, amikor megláttam mit produkál egy 2ventis asus dual mini hűtés egy 3060 Ti-n (természetesen azt is asus gyártja

Legutóbbi 3080 Ti meg még cw-zett is... Olyan szintű csalódás az összes, mint az, amikor megláttam mit produkál egy 2ventis asus dual mini hűtés egy 3060 Ti-n (természetesen azt is asus gyártja