-

Fototrend

OLED Televíziók - témaösszefoglaló

Új hozzászólás Aktív témák

-

janos666

nagyúr

válasz

daneel_hu

#7585

üzenetére

daneel_hu

#7585

üzenetére

... és artifact parádé ... Gyorsul-lassul, nyúlik, szakadozik a mozgés és szögletes foltok lemaradnak a mozgó tárgyakból az új helyük mögött.

Nézzétek meg TrueMotion-el és anélkül hogy gördül be a csaposrobot a Passengers-ben a pult mögött a képbe. Szétszakadozik az arca...

-

janos666

nagyúr

válasz

Bubukain

#7565

üzenetére

Bubukain

#7565

üzenetére

Ha szereted a látványosan alul-szaturált, fakó, eltolódott színeket (és akkor még a látványosan alacsony precizitásról nem is beszéltünk, de az vélethetően nem hiba, hanem az alacsony lag szükségszerű ára, ami SDR módban nem feltűnő, de HDR-ben már könnyebben előjön --- bár ezt cáfolja hogy a TV / Game HDR sem lagol és mégis sokkal simábbak benne a gradiensek, mint a TV módban bármelyik képmóddal, szóval szerintem hiba...), főleg ha elfogadod, hogy a HDR mód sokkal fakóbb, mint az SDR, akkor igen, persze, "jól" működik (kivéve, hogy az 1080p120 bemenetre még így sem, de OK, az tényleg "speciális eset"), mert végül is nézhető, nem kapcsol ki, nem fagy le a készülék, olvashatóak a betűk, csak annyi az egész, hogy szarul fest.

-

janos666

nagyúr

válasz

#72042496

#7556

üzenetére

#72042496

#7556

üzenetére

De HDR játékhoz nem is kell PC mód, ugyan olyan "jó" a TV / Game mód.

Úgysincs 2160p60-ban 10-bit RGB a HDMI sávszél miatt, és hamarabb mondok le a 4:4:4-ről, mint a 10 bitről, mert HDR-ben látványos a banding 8 biten (a jelenlegi Geforece nem ditherel, a Radeon-ok talán igen, de nem próbáltam, még azt se, hogy azok engedik-e egyáltalán a 8bit HDR-t, dither képesség ide vagy oda).Azért teszem idézőjelbe, hogy "jó", mert a TV/Game és TV/Cinema nekem egyformán nem tetszik. Ugyan az a bajuk.

1: Az egyik az agresszív roll-off:

Arra már találtam kiskaput, hogy kézileg felülírjam madVR-el a filmekhez a metaadatot, ezzel kijátszava a roll-off választót (bár nem is hatalmas a különbség 1k és 4k film közt, de azért zavart a tudat), de NVAPI játékhoz (mint pl. a ME:Andromeda PC-n nVidia kártyával) a 10k nit metaadatot nem ilyen egyszerű (a játékprogram küldi ki, az sem jó ha nyitvahagyom a madVR-t a háttérben, mert exclusive módba vált a játék HDR-hez, tehát "csak az övé a monitor").

2: Látványosan sötét színek (chroma a helyén, luma lemaradva)

A Color csúszka egekbehúzása nem megoldás, mert akkor a sötét és közepesen élénk színek lesznek túlszaturáltak, "helyes" 50-es állásban (HDR-ben is 50 lenne az igazi alapérték, mint SDR-ban, csak már feltolta az LG is 555-60 köré a HDR alapértékeket, hogy kompenzáljon valamennyit az Auto színtér hibáján) viszont a közepesen világos színek sötétek, ami a bőrszíneken a legzavaróbb (betegnek / zombinak néznek ki az emberek).

Most épp azzal kínlódom, hogy 3DLUT-al kompenzáljam ezt a két dolgot, de nehéz a WRGB sajátossága miatt (valahol a fényerőskála durván felénél elfogy a szaturált R,G,B és csak a W-t pakolja már mellé), amit elvileg tudhat kezelni, de alapvetően nem erre számít a program, ami véges számú mérési pontból próbálja modellezni az első tippre korrekt RGB monitornak feltételezett kijelző izotróp 3D színterét. Ráadásul még a HDR-hez is hülye még a program olyan szempontból, hogy nem lehet neki azt mondani, hogy ne foglalkozzon a jelen esetben 1000-10000 nit tartománnyal, mert úgysem tud olyat a kijelző, azzal is fecsérli a drága időt és energiát (lehet, hogy küldenem kell borravalót a fejlesztőnek, hogy olja ezt meg

vagy persze kísérletezem és hosszasan készül, excel-ben átalakítom a palettát, stb...).

vagy persze kísérletezem és hosszasan készül, excel-ben átalakítom a palettát, stb...).A bőrszíneket és fényességet már sikerült elkapni, csak a sötétszürkék gyengélkednek (rosszul térképezi fel a mérési pontok közt a Rec 2048 görbe alját amiatt, hogy elpazarolja a mérési pontokat a világos részbe, amit nem is tud megjeleníteni a TV).

A TV saját CMS-e pedig katasztrófa HDR-ben. Épp ezért nem is foglalkozom a TV / Cinema HDR móddal, csak a TV / Game HDR-el, mert alapvetően majdnem ugyan olyan rossz/jó a kettő, az extra beállítási lehetőségek a Cinema-ban pedig csak ártanak (nem is elégséges a problémák orvoslására, és ha tologatok a csúszkákon, akkor durva képhibák jelennek meg -> Régen a 6-os széria korai firmware-eivel még az SDR is ilyen volt, mint ma a HDR a 7-esen...).

Ami még jobb híján érdekes lehet (ha a TV / Game HDR-el nem jutok dűlőre), az a PC / Standard HDR mód: viszonylag szar a precizitás (durva saccra olyan, mint ha 10 helyett 9 bittel menne), de nincs roll-off (ami a TV / Standard-re is igaz, csak az lagol, mint az állat, szóval játékra kilőve), így eleve egy gonddal kevesebb és közvetlen használatra rossz lenne, hogy nem is dolgozik a színkezelés, csak natív színtérben ragad, de PC szotfveres profilozáshoz talán ez jobb is (alapvetően erre van kitalálva a profilozó szotfver, nem arra, hogy a hibás hardware-es emulációkat korrigálja).

-

janos666

nagyúr

A legtöbb ember valóban soha életében nem látja a "nyers RAW"-ot.

///EXTRAOFF///

A teljesen nyers 4 alpixelest nyilván én sem tudtam megnézni 1:1 direktben semmin, de játszogattam már ezzel, hogy abszolút csak a minimális, legelső néhány feldolgozási lépést végignéztem 1:1 kirakva RGB monitoron (mármint, hogy mit látni akkor, ha nincs még a rögzített szenzorétékeken rajta se gamma, se fehéregyensúly, se színtér konvertálás sRGB-be [vagy más hasonlóba], így végigpörgettem egyesével), nem még a későbbi "autotune varázslatok" és extra kézi simogatások.

///EXTRAOFF///De nem is egészen erre gondoltam, illetve még ekkor sincs teljsen igazad.

Egyrészt már egy buta Windows Photo, vagy egy szimpla IrFanView is használható sebességgel összerak egy valamire való sRGB képet egy kisebb RAW-ból (nem, nem beágyazott JPEG-et olvas ki! de biztos nem működik az összes RAW formátummal és nagyobb felbontásokban biztos izzad tőle a komoly PC is, de most nem ez a lényeg).

A bitekhez pedig: elsősorban a fehérbe égésre gondoltam, de ugyan az áll a feketére is: ami már a RAW-ban is be van égve (a szerzorcsatorna is sok-sok 1-es vagy 0-ás értéken áll a szomszédos pixeleken), azt nem hozzák vissza az extra bitek. Szóval itt nem "visszahozás"-ról van szó, hanem hogy a kész sRGB (csúfoljuk úgy, hogy JPEG) file-ban már biztos le van vágva, ami a RAW-ban még talán nincs.

-

janos666

nagyúr

válasz

daneel_hu

#7440

üzenetére

daneel_hu

#7440

üzenetére

Nekem 99%, hogy feltűnt volna, ha dolgozik a TrueMotion, de nem láttam.

Az viszont nemrég feltűnt, hogy SDR és TV módban néha mozgás függvényében sötétíti a képet (mint ha lehúznád az OLEDFényt-t amint elkezd mozogni valami, aztán vissza fel, ha megállt).

Windows asztalon ablakokat tologatva ezerszer könnyebb kiszúrni az ilyet, mint film közben.

Sőt, ha valaki lasabb váltású LCD-ről jön, az hozzá is van szokva valami haosnlóhoz (mikor nem elég gyors az LCD, hogy faltól-falig átváltson két képkocka közt, így fekete-fehér helyett szürke-szürkét rajzol mozgás közben).Ez pont az, amit a Motion Eye Care funkciótól várnék, viszont az nekem eddig szándékosan Ki/Be kapcsolgatva még sohasem látszott működni. Szerintem inkább ez lehet a ludas: önálló életet él, hogy a menüben látható kapcsolóállástól eltérően vagy mégsem vagy mégis működik. Ez picit hasonló érzetet adhat, mint egy laza BFI (csak a korrektség kárára, mert sötétebbnek látod a képet a mozgás függvényében). Ez a még szegény ember BFI-jétől is olcsóbb BFI.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

janos666

nagyúr

Háááát... Én sem vagyok fotós, de ez szeirntem hülyeség.

A bitmélység az precizitás. Mondjuk úgy, hogy lépésközök relatív távolsága, mint hogy csak centiméterekre, vagy milliméterekre is be van osztva az egy méteres vonalzó.

Ebből következik, hogy ha túlexponálsz egy képet, ami azt jelenti, hogy minden szomszédos pixel a csatorna maximális értékét mutatja abban a foltban, abból te semmit nem nyersz vissza.

Amire te gondolsz, az inább a RAW és a már "feldoglozott" sRGB vagy AdobeRGB közti különbség, de inkább az is csak akkor, ha a feldolgozás bűne a clipping (rengeteg automata paraméterrel nem lett szerencséd).

Esetleg még olyan lehet, hogy a szoftver részben és közelítőleg besaccolja, hogy nagyjából mi lehetett a túlexponált képen abból az információból, ami valóban elveszik ha 12+ bitről 8-ra konvertálsz, de az igazából nem sok (még mindig "hibás/sérült" lesz a túlexponált kép, csak szemre jobbnak hat, picit több minden látszik még ki belőle).

Illetve még azzal tud trükközni a szotfver, hogy a fehéregyensúly beállítása előtt még talán nincs minden csatorna túlexponálva, tehát pl. a piros és kék minden pixelen 1 (a 0...1 skálán), de a zöld még kirajzolja a geormetriát és akkor azt újrarajzolja a szomszédos színekkel (te pedig főleg akkor hiszed el, hogy ez jó valamire, ha nem is tudod hogy nézett ki élőben), míg a konvertálások után az utolsó színtérben a beégett résznek már fehérnek kell lennie (mert még hülyébben néz ki, ha pl. lila a túlexponált képen a beégett folt, nem fehér), amit már nem tudsz visszaforgatni, hogy ilyesmikkel játszhass.Amúgy pedig dithereléssel 8 bites monitoron is láthatod a ~16 bites precizitás illúzióját (valahol durván ott áll meg a szemünké).

-

janos666

nagyúr

HDR-hez sohase használd az LG PC módját, totál kuka.

De a Windows csúszka amiatt ugrik vissza, hogy 8 bitre van állítva a driverben a kimenet, és valószínűleg RGB-re is, amibe nem fér be a 10 bit. Allítsd be úgy, hogy a Windows kezeli, vagy tedd kézileg YCC-re és 10 vagy 12 bitre. -

janos666

nagyúr

válasz

daneel_hu

#7361

üzenetére

daneel_hu

#7361

üzenetére

Itt szerintem okoz némi zavart, hogy a fényképészetben és most filmezésben is van egy átfogóbb "szokásos dolog", amit HDR-nek nevezel, és mikor összeveted őket, akkor nem vezeted vissza mindkettőt a közös eredeti kiindulási pontra.

Egyrészt az szerintem pusztán csak technológiai kérdés, hogy több expozíció segítségével tolod ki a dinamikatartományt. Ha van olyan szenzorod, ami egyetlen exponálással is képes "nagy" kontraszt átfogásra (persze ez így egy relatív fogalom), azt is hívhatod HDR-nek.

A másik oldalon pedig akárhonnan jön a HDR kép (egy vagy több exponálás), általában szükséges valamilyen tone mapping, amiben most lényegében csak annyi változott, hogy többszörösére nőtt a megjelenítők szabvány szerint alapul vett tartománya. Eddig pl. ~120 cd/m^2-t feltételezett a szoftver, ha sRGB-be konvertáltál egy HDR képet, és általában nagyjából tényleg ennyire kalibrált monitoron nézegetted és simogattad utána kézzel, most pedig szabványos keretek közt is megteheted, hogy mondjuk Rec 2020 + 2084 formátumba (is) konvertálsz és lesz olyan végfelhasználód, aki meg tudja ezt nézni "helyesen".

Gyakorlatilag ugyan azt csináltad eddig HDR fotózásnál, mint az utóbbi ~10 évben a videojátékok a HDR effektjükkel. Nagy tartományban számoltak és visszatömörítették sRGB-be. A lényegi különbség az volt, hogy mozgóképen volt egy pár másodpercnyi idő, amiben fokozatosan futott át pár mapping paraméter (mikor átmentél sötétből világosba, akkor először beégette a világos részeket és aztán fokozatosan visszahúzta). Pontosabban nyilván ma is csinálja ezt a játék, még az átmeneti részt is, mert ma sem olyan világos egy TV-n a csúcsfény, mint egy vakító nap, szóval ugyan úgy van ilyen dinamikus mapping (már csak azért is, mert ha már kész volt, miért dobták volna el...?).

+ Amit még csinál a legtöbb játék és a PhotoShop (és biztos más hasonló progi is), az a "HDR Bloom", ami "fátylat" gyárt a beégő része köré, hogy ne legyen feltűnő a "vágás". "HDR kijelzőn" (bár ez nem jól definiált fogalom) erre ritkábban van szükség (vagyis szerintem szükség sohasem feltétlenül lenne, úgy értem a tatalomkészítő ritkábban érzi majd szükségét, illetve ritkábban fordul elő a szituáció, ahol ez az effekt "beindul" [ahol elfogy a kijelző --most nagyobb-- skálája]).

De próbád ki, vegyél elő egy RAW file-t, nem is kell feltétlenül több expozíciós (de nem árt, ha alacsony ISO) valami világos jelenettel és konvertáld ilyen "TV-s HDR" formátumba (olyan szoftverrel / beállításokkal, hogy a szoftver félúton is HDR-ben dolgozik), majd nézd meg a HDR TV-den.

A legjobb teszt szerintem az lenne erre a "koncenpciótesztre", ha kihagynánk a PhotoShop-ot és társait, inkább csak rögtön áthúznánk a nyers csatornákat RGB-be egy 3DLUT-alm (absolute mapping).

Csináltam már ilyet tesztképp Rec709-re, és nem igazán tetszett. Most kicsit én is kíváncsi lettem, hogy néz ez ki a HDR TV-ken. -

janos666

nagyúr

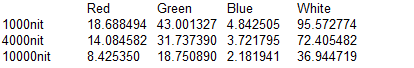

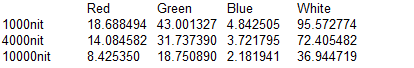

Azért, mert (legalább is a jelenlegi firmware-ekkel a '17-es szérián) egy sötét vagy közepesen visszafogott jelenet a HDR módban 100/100 (OLEDfény/kontraszt) beállításban filmtől függően 1000nit master esetén nagyjából SDR 15/100 környékinek felel meg, 4000nit metadata esetén olyan 10/100-nak, 10000nit master (ez videójáték, filmből ilyet még nem láttam) 5/100-nak.

Ezért van az, hogy én 16/100-al tolom SDR-ban, de 100/100 fölé szeretném húzni HDR-ben, ha 4000nit-es filmet nézek, de főleg, ha játszom. Mondjuk én ezt már megoldottam magamnak egy 3DLUT-al...

[Ma kész lett az új szobám és erre az évre lezártam az "üzleti dolgokat", így lassan talán tényleg végignézek egy filmet vagy játszom 10 percnél többet, mert eddig igazából csak tesztelgettem, mióta megvan a TV.

]

](#7342) Madwe

A HDR az álló és mozgóképen is lényegében ugyan az.

Igazából TV-ken sincs olyan "HDR kijelző" szabvány, amire itt utaálsz, csak HDR kompatibilitásra van többféle szabvány (HDR10, HGL, DolbyVision, Technicolor, stb), amit kiegészít a TV/monitor/projektor világban egy önkényes "UHD Premium Certification", amit kvázi önszántukból követnek a gyártók (nyilván mert érdekük fűződik hozzá, de nem kötelezi rá őket senki, hogy a HDR kompatibilis kijelzőjük az rögtön ilyen Prémium plecsniért is epekedjen).

Egy ilyen Premium certification majdnem olyan, mint egy EISA díj, lényegében maguknak találták ki és odaadják maguknak... Bár ehhez képest meglepően jól működik szerintem (van gyakorlati haszna, nem teljesen üres marketinglogó).

-

janos666

nagyúr

"Gondolhatod hogy mennyi jelentősége van játéknál a 4:4:4 Chroma Subsamplingnak."

Ez részemről csak spekuláció, de szerintem (tapasztalati alapon tippelgetve) az élek mentén látható "recék" (aliasing) hasonlóan viselkednek a chroma subsampling hatására, mint az apró betűk. Szerintem hihetőnek kéne hangzania, hisz lényegében az apró betűk görbe vonalai is némileg töredezett élek, ez is vektorgrafika erősen véges felbontással raszterizálva. Szóval kicsit leegyszerűsítve: mint ha kicsit látványosabbá tenné videojátékokban az aliasing-et a chroma subsampling (kihangsúlyozza a recéket).

Bár ezt 2k-ban figyelgettem, 4k-ban eleve sokkal kevesebb az aliasing, és azzal arányosabban is kevéssé lesz rajta látható a chroma subsampling hatása (ha egyáltalán tényleg van ilyen), szóval kezd tényleg elhanyagolható lenni.

... és persze, ha valaki mindenféle maszatoló post-process anti-alising és motion blur, plusz egyéb effekteket is bekapcsolva hagy a játékon, akkor nagyjából el van maszatolva az aliasing, így nincs is minek potenciálisan sem feltűnnie.

(#7250) OPiiPO --- Hopsz. Most jól, lebuktam! A fél fórum én vagyok!

-

janos666

nagyúr

Én azt vettem ki, hogy te akarod bizonyítani nekem, hogy csak beképzelem, amiket részleteztem (mikor mennyire látom vagy épp nem látom), mert az nem vág teljesen egybe a világról alkotott általános feltételezéseiddel.

A PC módban van 4:4:4 is, TV módban nincs, innen keveredtünk a PC módhoz, illetve onnan, hogy mutattam neked videót a PC módról, mikor azt mondtad nem létezik, csak a képzeletemben. Szóval valahogy így járkálunk körbe körülötte.

-

janos666

nagyúr

Külön jelölt pontokra bontottam, hogy milyen tartalomhoz mennyire tartom fontosnak. (Most egy bekezdésben azt mondod hogy elsőre is értetted, és azt, hogy érthetetlen számodra. Ezért próbáltam kétszer. Nem jártam sikerrel...)

Mert van külön PC és TV mód, néhány különbséggel, és ez a hagyomány, hogy így lehet váltani (sok évvel ezelőtti Samsung TV-ken is volt ilyen, nem újdonság és nem csak az LG-nél van).

Ahogy PuMbA is írja, PC módban fixen tiltva van, ami növeli a lagot, de van más különbség is (nem csak a lag és a 4:4:4, kicsit másképp kezeli a dolgokat). -

janos666

nagyúr

Ezt hogy szűrted le abból a hsz-ből?

Az RGB az mindig 4:4:4, ha esetleg ez maradt ki.

De amúgy kétségtelenül körülményes és komplikált ezeket a mai TV-ket és VGA-kat mindenféle kombinációkban (film-játék \ SDR/HDR) "ideálisan" üzemeltetni, sok kapcsolgatással járhat.PC-n az az ideális, ha mindig RGB Full megy ki a VGA-ból az elérhető legmagasabb bitmélységgel, mert a GPU mindent így számol. A kijelző pedig majd eldob belőle amennyit akar, ha muszáj neki (a saját képességeitől/beállításaitól függően). Csak a szűk HDMI sávszél miatt kell néha kompromisszumot kötnöd, pl. HDR játék esetén.

Filmekhez ezekkel a TV-kkel PC-n mindig használhatsz 2160p23 Full RGB 10-bit módot a TV-n TV/Cinema módhoz is, akár SDR, akár HDR (átfér a HDMI-n).

Játékoknál SDR-hoz is mehet Full RGB, ha 2160p60 mellé 8 bitre állítod. A HDR játéknál kezdődik a baj, ahol 2160p60 YCC 4:2:2-t vagy 4:2:0-t kell használnod 10 bithez (elvben megy a 2160p30 is, csak nincs értelme, mert hibás ezeken a TV-ken HDR-ben a 4:4:4 mód).De igazából, ha szeretnéd minél kevesebbet kapcsolgatni a beállításokat, akkor csak berakod YCC 4:2:0-ra és ott felejted, aztán csak a TV-t kapcsolgatod esetleg SDR-hoz PC módba, HDR-hez TV módba (de ha maximalista vagy, akkor átállítod a VGA-t is Full RGB-re, mikor megteheted SDR-ban).

(Mindig nyugodtan használhatsz 12-bitet 10 helyett, ha engedi kiválasztani a driver, nem lesz rosszabb, bár jobb se.)

-

janos666

nagyúr

TV, monitor ... személygépjármű, kocsi, autó, járgány, verda ...

Néha pislantsunk már át a kartondoboz élén, amiben önszántunkból élünk.

Egy kijelző az egy kijelző.Pontosan leírtam, hogy mire gondolok, mikor látom, de megismétlem:

- filmekhez, de nagyrészt még játékokhoz is placebónak tartom erőltetni

- apró betűs színes szövegek, hátterek esetén az olvashatóság múlhat rajta1: Filmeknél ugye átlag ember eleve nem is lát soha 4:4:4-et, csak ha studioban dolgozik RAW-al (sőt, még ott se biztos, hogy szerkesztés közben 4:4:4 látható a monitoron, mert nem igazán fontos, hogy úgy legyen, hisz úgyis 4:2:0 lesz a történet vége), az pedig már teljesen más téma, hogy lehetne-e értelme megőrizni a teljes láncban a 4:4:4-et, mint hogy miután a tömörített 4:2:0 anyagból jobb vagy rosszabb minőségben 4:4:4-et csinál a lejátszó, akkor van-e értelme átvinni a kijelzőre azt az eredményt (nekem ez a placebó szint: minimálisan talán "érezhető", ha nem is megfogható, de hagyjuk, én nem foglalkozom vele, eleve nem küldök rá semmi csili-vili erőforrás-igényes chroma filtert, energiatakarékos DXVA módban megy, szóval nem kell engem ezért bonszorkányüldözni...).

2: Játékoknál kevertebb a dolog, mert rengeteg féle grafika előfordul. Egyrészt lehetnek bennük apró betűs színes szövegek színes háttereken, amiknek rontja az olvashatóságát, másrészt alkalmanként olyan geometriailag részletgazdag, élénk színes, kontrasztos vonalvezetésű látványelemek, ahol némi "chroma aliasing" formájában megjelenhet a dolog, mint az apró betűkön is (nem annyira szembeötlően, mint a betűkön, de néha itt-ott picit életlenebbnek/pixelesebbnek/recésebbnek tűnnek a dolgok, bár tény és való, hogy 4:4:4-ben is van bőven aliasing és/vagy blur a játékokban, szóval ez csak egy csepp a tengerben, ami az apró hibákat halmozza, nem igazán kritikus ügy). Szóval összességében jobb 4:4:4-ben játszani, ha van rá mód, de persze nyugodtan lehet 4:2:0-ban is, nem vesztesz sokat, jórészt fel sem tűnik akkor sem, ha figyelsz rá.

3: Ha a Windows asztalon átállítom 4:4:4-ből 4:2:2-be, azonnal lesüt a betűkről, hogy függőlegen ki van belük marva egy-egy csíknyi chroma (nekem fénylő sárgás recék szoktak szembeötleni). Ettől még az is jobb, ha átrakom 4:2:0-be, úgy inkább csak kicsit homályosabb/lágyabb hatása van az apró betűknek (mert a függőleges és vízszintes tengely mentén is egyforma a felbontáscsökkenés). Viszont, ha elkezdünk apró színes betűket, vagy szürke betűket élénk színeken nézegetni, akkor zavaró lehet (ha megszokod, akkor könnyen elolvasod még így is, de csak a vak nem látja, hogy nem olyan szépek a betűk, illetve hogy a színkombpozícióktól függően kimondottan néha nehézkes őket elolvasni).

Na... szóval ezeket add össze:

- életszerű tartalmakon is m@rhára k&urvára 'szottul lehet látni szabad szemmel (!!!) a 4:2:2-t, de még 4:2:0-t is (és előbbi egyértelműen rosszabb azokon a tartalmakon, ahol feltűnő), még 4k-ban is

- a fogyasztott tartalmak túlnyomó részén teljesen lényegtelen (de attól még léteznek kivételek, nem kell a szőnyeg alá söpörni)

Az én konklúzióm, hogy az téved nagyobbat, aki erősködik, hogy hanyagoljuk el a 4:4:4-et, hisz életszerű körülmények közt is van látható különbség, még ha kevés is és nem kéne, hogy ettől szakadjon le a TV gyártók profitja, ha 2$-t spórolhatnak a chipset-en.

De ennyi erővel tök jót lehet szórakozni 720p-ben is, minek van akkor 4k? Vagy minek HDR? Rengeteg SDR anyag okozott már sokaknak vizuális orgiát. Sőt, OLED se kell, az LCD is kielégíti a felhasználok 99%-át. Vagy visszaköltözhetnénk barlangokba, mert "régen minden jobb volt".

-

janos666

nagyúr

válasz

Callisto

#7225

üzenetére

Callisto

#7225

üzenetére

... és ezzel megint leesik egy korsó a falról, mióta elkezdtem számolni.

8/10, aztán ignore listára teszem az egész topic-ot.

Tudom mire gondolsz,

(van egy metszéspont, ahol a WRGB már nem tudja követni egyszerre a szaturációt és fényerő is, de fényben még közelebb tud menni a célhoz, ha odateszi az RGB mellé a W-t akkor is, ha az "kifakítja")

de ha olvasnád és értelmeznéd, hogy mire válaszolsz, akkor nem írtad volna ez.Én azt mondtam, hogy sötét és közepesen világos jeleneteknél is fakók a színek. De megfogalmazom másképp is: egy olyan jelenet, amin nincs semmi világosabb elem, mint ami SDR-ba is befér, az is fakóbb HDR forrásból HDR módban, mint ha megnézed ugyan ezt a jelenetet SDR-ból SDR módban.

HDR fórrást HDR módban nézve "hideg, fémes, kopár" hatású az emberek bőrszíne, a növények zöld színe, stb, mindegy milyen világos a jelenet. Sőt, sötét környezetben feltűnőbb, mint világosban.Ehhez műszer vagy referencia monitor sem kell. Szerintem azonnal látszik. De akkor is egyértelmű, ha oda-vissza kapcsolgatod az LG-n a lejátszóddal a HDR és SDR módot (ha a lejátszó tudja helyesen SDR-ba konvertálni a HDR forrást). SDR módban világosabbak a színek, életszerűbbek a bőrszínek, nem szürkék.

Egyszerűen szarul kezeli a színeket a szoftware HDR módban. Hibás a gamup mapping Auto színtérben, illetve azon belül a chroma (x,y) jó helyre kerül, de a luma (Y) már nem.

Nem hardware korlát, mert már csináltam is hozzá 3DLUT-ot, ami kompenzál, és most jó (ha eredendően nem lenne rá képes a kijelző, akkor nem lehetne hozzáhúzni kintről PC szoftverrel manipulálva a bemenetet úgy, hogy jó legyen).(#7227) Ren Hoek

Bocs, nem emlékszem pontosan, mert viszonylag sok féle furát megfordul itt (többféle cég többféle méretű dobozokkal), de szinte mind telefonál legalább 10-20 perccel előtte és megkérdezi jöhet-e már. Csak a garancialeveles herce-hurca maradt meg élénken az emlékeimben és azért írtam, hogy könnyeben futhasd le azt a kört.

-

janos666

nagyúr

válasz

Ren Hoek

#7220

üzenetére

Ren Hoek

#7220

üzenetére

Engem hívtak. Átadták egy futárlevéllel a dobozt, és mondták, hogy a garancialevelet majd vigyem be 1 hónapon belül pecsételtetni. Mikor bevittem úgy 3 héttel később, kaptam egy telefonszámot, hogy mit hívjak fel, hogy hova kell postáznom. Győzködtek, hogy nem kell azt pecsételni, de aztán mégis adtak címet. Miután elpostáztam (egy órán belül), kaptam egy email-t, hogy nem kell pecsételtetni. Pár nap múlva visszapostázták pecsételve.

-

janos666

nagyúr

Tessék, itt a mestermű (elszúrtam a kamera beállítást, de nem veszem újra

):

):

https://youtu.be/KEhtbmxvyXU (Nincs benne 18+, mint pl. az arcom)

Érdekes az, ahogy a 4:4:4 tesztábra villog. Ezt eddig nem figyeltem. TV módban sem mindig csinálja, attól függ mi más van még mellette a képen (és lehet, hogy csak a legutóbbi firmware óta ilyen?).A későbbi megjegyzésed: PC-n számít a 4:4:4, ha netezel vagy játszol, vagy akár csak ha "placebó" minőségben nagyítod fel, pl. madVR-el (vagy drága asztali lejátszóval) a filmekben lévő 4:2:0 chroma-t 4:4:4-re, és meg akarod azt őrizni a TV-ig. Bár ez utóbbin nem szoktam görcsölni (nem véletlen hívtam placebónak) és a játékoknál sem annyira feltűnő a dolog, főleg nem 4k-ban, inkább csak a színes betűkön, vagy színes háttéren lévő fekete betűkön zavaró, néha nehéz ilyenek olvasni ha blur-os a chroma (pl. piros betűk szürke háttéren, amiket valós 4:4:4, pontosabban natív RGB monitorra szántak, szinte olvashatatlan tud lenni TV-n).

Ez az OLED topic majdnem olyan rossz, mint annak idején a plazmás. Már csak a HDMI kábel témát kéne kötelező napirendi ponttá tenni minden szerdára, és ott lennénk a szeren.

Mindenkinek a saját korlátozott felhasználói szokása az abszolút mértékadó és a saját szubjektív preferenciája a nemzetközi mértékegységrendszer etalonja, illetve jobban ért ahhoz, amiről még csak nem is olvasott eleget, mint az aki igen, sőt hosszas saját tapasztalata is van vele. Azok is egymás mellett elbeszélve oktatják ki egymást, akik igazából nagyjából egyetértenek. Szóval tipikus internet chat.

![;]](//cdn.rios.hu/dl/s/v1.gif)

De ne vedd teljesen magadra, ezt az utóbbi pár hét termésére értem, mióta szórványosan követem a topic-ot (és én is tudom magamról, hogy bizonyos témákban ugyan ilyen vagyok néha, hiába próbálok nem ilyen lenni, ez eredendő emberi hiba...). De azért próbálhatnánk néha egy kicsit konstruktívabbak és nyitottabbak lenni egymás felé.

-

janos666

nagyúr

Magához képest azért nagy léptékben halad az LG. A 7-es sorozaton (főleg mióta segített nekik bepöcögtetni a Mozi/Haladó módok alapbeállításait a Technicolor) már pöpec az SDR mód, ami a 6-oson, főleg azok korai firmware verzióival még hasonlóan betegeskedett, mint most a 7-esek a HDR-el. Talán még ezeken is 7-eseken is eljut egy közepesen jó szintre a HDR is, mielőtt leáll a firmware érdemi fejlesztése (általában akkor, amikor megérkezik az N+1 gen, hogy ha nem tetszik a régi, akkor vegyél újat...), főleg hogy a legutóbbi frissítés HDR tekintetben visszalépés volt (szimplán "visszagörgetni" a korábbi állapotra pedig nem tűnik túl nehéznek, legfeljebb a makacsságot kell levetkőzni --- bár már nem emlékszem, nagyon keveset nézegettem a HDR-t, mielőtt frissítettem, csak azt tudom rosszabb, azt nem hogy mennyivel).

Én pedig PC-n tudok neki adni filmekhez és játékokhoz is 3DLUT-al korrekciót (Windows asztalnak nem, de azt meg nem nézem HDR módban).

De átlagfelhasználóknak én is épp azért szoktam Sony-t javasolni (mondjuk többnyire LCD viszonylatban, mert az OLED még új és keveseknek jön szóba az ár miatt), mert jellemzően ezeken a legkorrektebb a gyári Mozi mód alapbeállítása, illetve az otthon egyedül is könnyen elvégezhető beállítások után is ezek a legjobbak (és sok más TV-ből hosszas és műszeres babrálás után se lehet sokkal jobbat kihozni, szóval a Sony-n nincs is már nagyon mit simogatni ilyen nekifutásból se).

-

janos666

nagyúr

Tudom, és PC módod sincs, csak a Játék és Grafika képmód tud teljes chroma-t, illetve azt hiszem csak előbbi ad alacsony lagot, de a mellé nincs teljes értékű színkezelés. Kb. ezek közt sakkozgatva mondtam le a fapados BFI-ről és minusz 170k-ról az LG javára.

De használnál amúgy kettőnél többet teljes értékűen?

TV adáshoz jobb a Coax és CI kártya, vagy gyakorlatilag HDMI 1.0 is elég. E mellé elfér egy medéalejátszó és lemezes lejátszó, vagy lemezes és PC, mindháromnak egyszerre nem látom értelmét (nekem pl. egy szál PC van és kész, még coaxot se dugtam rá, pedig ki akarom majd próbálni).

Ja, és akkor még ott van a WiFi vagy UTP, mint csatlakozás, sokak elégedettek a beépített lejátszókkal (nekem addig volt benne UTP, míg elolvastam a felhasználói feltételeket ).

).~~~ más ~~~

Kicsit bővebben is tanulmányozgattam/méregettem a HDR-t a C7-en. A műszer is azt mondja, hogy fakók a sötét színek, nem csak én láttam olyannak az embereket sötét vagy közepesen világos jelenetekben, mint ha át lennének fagyva, vagy betegek (zombik) lennének, tényleg nincs elég szín az arcbőrükön se.

A színeknek nem is a szaturációja van lefojtva (én először arra gyanakodtam, hogy chroma mapping probléma), hanem a fényességük van lecsúszva a szürkékhez képest. Fura, valahogy úgy van most megcsinálva a HDR mód, hogy "kikiabáljon a színek mögül a fehér", mert az nincs úgy visszafogva, mint a színek. -

janos666

nagyúr

Sok Samsung TV-n volt olyan, hogy csak egy bizonyos porton működött és/vagy csak bizonyos bemeneti formátumokkal. Itt szerintem mindegyik HDMI-n megy és mindenféle formátummal (amit eddig próbáltam, az a HDMI 1 és 2, illetve kazalnyi formátum). De könnyű kipróbálni, mert látványos: példaképp épp ez, hogy kiszürkül a menüben a TrueMotion és RealCinema is.

-

janos666

nagyúr

válasz

daneel_hu

#7196

üzenetére

daneel_hu

#7196

üzenetére

Próbáld már ki a kedvemért, hogy átnevezed PC-re a HDMI-t, hogy úgy milyennek látod a mozgást (PC módban ha akarod se kapcsolod be a TrueMotion-t). Már kértem mástól is, aki ezen spekulált, de nem emlékszem, hogy kipróbálta nekem.

Amúgy ma véletlen bóklászás közben feltűnt, hogy TV módban (bármi, csak nem PC címke a HDMI-n) a Real Cinema okozza a legnagyobb lagot, nekem érzésre még többet, mint a True Motion. Ha ezt is kikapcsolom, már nem is igazán érzem, hogy lassabb lenne a TV/Haladó a TV/Játék vagy PC/akármi módokhoz képest (talán nincs is már így számottevő különbség...? ki kéne mérni...).

Ezt 60Hz bemenetnél láttam, szóval valószínűleg az lehet mögötte, hogy 2-3 képkockát is bufferel a Real Cinema 60Hz-es bemenetből, hogy elemezhesse vajon 2:3 ismételgetett 24Hz van-e benne (hogy ezesetben visszafejtse).

-> Ezt azért is írom neked, hogy esetleg ez is állhat a mögött, ha tényleg jobb nálad a mozgás, ha véletlenül igazából 60Hz-et küld ki a lejátszód 24fps filmnél is, akkor eddig nem találta fel vele magát a TV (ezt leírták a korábbi tesztek, hogy nem fejti vissza 60-ból a 24-et), de most már talán igen (nem tudom, nem is akarom igazából kitesztelni, nem érint, én 24-et küldök rá filmekhez).

-

janos666

nagyúr

válasz

Callisto

#7193

üzenetére

Callisto

#7193

üzenetére

Rengeteget. Sokat vagyok itthon, és ha ébren is vagyok, szinte mindig megy (nagyon ritkán kapcsolgatom le kézzel, mikor határozatlan időre kimegyek a szobából, vagy a házból a közelben, és 1 óra a Windows képernyő kapcsolás, de általában hamar felébresztem legalább rápislantani, viszont attól újraindul 1 óra...).

-

janos666

nagyúr

válasz

Maco7911

#7185

üzenetére

Maco7911

#7185

üzenetére

Standby módot (távkapccsal kikapcsolás, de nem áramtalanítás).

De amire válaszolsz, ott épp arra próbálok utalni, hogy szerintem kár vele foglalkozni. Életszerű otthoni használat mellett nem kell figyelni rá, főleg a "bűvös 4 áráról" kár is tudni (mert hamis következtetéshez vezethet, és a végén még ott ül az ember stopperórával, és görcsösen kikapcsolja ha 4 órához ér, ami hülyeség).

Az egyetlen, amit be kell tartani, hogy ne áramtalanítsd rutinból feleslegesen (ha takarítasz,

vagy napokra elutazol, stb, az megint más, olyankor kihúzhatod).

Ezt is csak azért kell elmondani, mert van, akinek szokása akár automatizálva elvágni az áramot a kütyük elől, mikor nem használja őket (vagy ennyire elhivatott környezetvédő / pénzspórló szellemiségű, hogy néhány Watt is számat neki, vagy az áll mögötte, hogy volt valami túlfeszes/villámcsapásos balesete életében és annak valószínűségét próbálja csökkenteni.... mindenkinek megvannak a saját szokásai/mániái...).Aki pedig "extrém felhasználó", mondjuk egy studio féleség, ahol nem csak hogy komolyabb esélye van kialakulni IR-nek, de ráadásul komolyabb probléma is, ha megtörténik (kritikusabb a zavar, nehezebb ráhagyni, hogy majd éles használat közben eltűnik később) az majd kitapasztalja, hogy milyen körülmények közt mennyire gáz, és hogy próbálja ütemezni a dolgot (pl. manuálisan elindítja a refresh-t ebédszünetben).

Nekem PC monitorként még csak HDR módban volt némi IR, az is hamarabb eltűnt kikapcs nélkül, mint az ilyen szempontból legjobb plazmáról (és plazmába sem égett még be nekem örökre semmi, csak változó időre ragadt be pár dolog), pedig nem babusgatok semmi kütyümet ("mész amíg élsz" módban is hamarabb meg szoktam unni mindent, mint hogy megdöglik, pedig viszonylag sokáig megtartok mindent).

-

janos666

nagyúr

A legegyszerűbben úgy tudod megnézni a 24/60 ugrálást, ha 24Hz-et küldesz a kijelzőre, és annak a menüjében kapcsolgatod Ki/Be azt a kapcsolót, amivel választani lehet, hogy kadenciahelyes legyen, vagy ugráljon. (Nem minden kijelzőn lehet, de sok felkínálja valamilyen formában.)

Ezeken az LG OLED-eken a Real Cinema / Valós Mozi szabályozza: BE állásban minden bemenő képkocka ugyan úgy 5 panelfrissítésen át látható, KI állásban pedig 2:3 arányban jelennek meg a forrás képkockák.

A TrueMotion-t nyilván kapcsold ki ehhez,. illetve nem is tudom, hogy ha a TM aktív, akkor számít-e bármit, hogy hol áll az RC kapcsoló, de mindképp a TM hatása lesz domináns már minimum fokozaton is.)

A másik tényező, ami miatt ez sokaknak nem egyértelmű (a TrueMotion és társai mellett), az az hogy sok TV (beállításoktól függően, de esetenként automatikusan kikapcsolhatatlanul, máskor hibásan bekapcsolva se, de a lényeg, hogy létezik ilyen....) felismeri, ha csak 24 képkocka van a 60Hz bemenetben és automatikusan eldobja a forrásoldalon duplázott képkockákat (tehát újra 24Hz-et csinál a 60-ból, minden káros mellékhatás nélkül, "veszteségmentesen").

Egy másik félreértés lehet még, hogy van aki azt hiszi PC = 60Hz, de a mai VGA-k röhögve küldenek ki bármilyen frekit, amit a kijelzők ismernek, és főleg PC monitorok közt van olyan, ami rengeteg frekvencialépcsőt támogat (többet, mint a TV-k), vagy akár még dinamikus frissítést is tud (Gsync/FreeSync, ami szintén nincs [még] TV-ken, de filmhez nem is kell, csak játéknál lehet haszna).

Na persze kézileg, vagy automatikusan a lejátszószoftvernek át kell váltania a megfelelőre, ha szeretnéd (de itt megint te döntesz, hogy szándékosan 60Hz-en hagyhatod 24fps videóhoz is, vagy átválthatsz 24-re, 60-re, 120-ra, 142-re, stb, bármire ami a "csövön átfér" és fogadja a kijelződ).Még egy: ha bizonytalan vagy, akkor nem árt valahogy duplán ellenőrizni, legyez az asztali BD player, asztali "okoslejátszó", PC, laptop, bármi, hogy tényleg 24Hz-et küld-e ki, pl. úgy, hogy egyszer rákötöd olyan kijelzőre, ami kiírja, hogy mi a bemeneti freki -> sok TV és akár PC monitor is kiírja, de az LG OLED-ek pont nem.

~~~

Szóval ... konklúzióként látható, hogy számtalan ponton és formában billenhet ez az egész oda/vissza, ezért nem kéne túl elhamarkodott következtetéseket levonni. Pl. lehet, hogy aki nem látja, az nem csak vak/igénytelen, hanem a tudtán kívül visszafordítja a TV a 60-ból a 24Hz-et. De persze lehet, hogy tényleg csak nem zavarja az illetőt, mert nem hatalmas különbség (de attól még nem kéne elbagatelizálni azt, ami létezik és lehet tenni ellene különösebb erőfeszítések nélkül, némi odafigyeléssel, hogy mit hogy konfigurálsz forrás/megjelenítő oldalon).

Még arra, amit hozzászerkesztettél: Azért javaslom, hogy a TV-n billentgesd a RealCinema kapcsolót, mert könnyebb észrevenni, ha gyorsan ugyan olyan környezetben csak ez változik, mint ha két teljesen más kijelzőt nézel.

A másik gond: egy hagyományos LCD rogyásig maszatolja a mozgást, ami szintén elfedi ezt (részben vagy egészben, sok mindentől fögg).

-

janos666

nagyúr

válasz

Ren Hoek

#7147

üzenetére

Ren Hoek

#7147

üzenetére

Miért, szerinted 24Hz-es állítom az LG TV-t, mikor netezek vagy játszom rajta?

(A biztonság kedvéért ideírom, hogy alapvetően 60-ra, esetleg 120-ra.)(#7148) Nemir Ombe - Lásd fent + ha 60Hz-en nézed a 24fps-t, nem szappanérzetet kapsz, hanem "remegést" (2:3 arányban egyenetlenül ugrál).

Maco7911 (#7174) üzenetére - Szerintem nem fontos "4 óránként pihentetni". Az csak egy közelítőleg kisakkozott szám, amit beállítottak, hogy ha már legalább 4 óra eltelt, akkor fusson le, mert sűrűbben felesleges (legalább is én csak így látom értelmét az alapján, amit értek abból, hogy mit csinál). Szóval nem kell ott ülni stopperrel és kényszerpihenőket tartani, bár nyilván nem árt más szempontból sem. Otthon szerintem főleg pont az nem hagyja egész éjjel is járni, aki monitornak használja (népszerűbb hobbi TV adáson elaludni, mint játék közben).

-

janos666

nagyúr

Le lehetne vele utánozni, de kár lenne úgy hajtani az OLED-et, mint a plazmát, mert ezt lehetne jobban is. Főleg ne Panaszosan, a Pijó sokkal szebben csinálta a subfield témát (mára már biztos eljutott volna oda a Pana, ha nem álnnak le ők is, de az már más mese). Ne kreáljunk "foszforlagot", ha nem muszáj (amit így hívtunk átfogóan, az nem egészen csak az volt).

Meg kéne nézni, hogy a Samsunk mit csinál a telefonokon, mert olvasható a görgetett szöveg. Vagy elő kéne kaparni a régi prototipus TV-jük, azon is volt BFI.

-

janos666

nagyúr

válasz

Ren Hoek

#7135

üzenetére

Ren Hoek

#7135

üzenetére

Egy néhány lépcsős csúszkára gondoltam, nem kvázi-végtelen precizitásra. Valamire, ami technikailag még viszonylag könnyen megvalósítható (nem több ezer Hz), és nagyjából ésszerűek a határai (mint ahogy írod, túl kicsinek, és túl soknak sincs értelme, mert úgysem látszik, vagy kibírhatatlanul zavaróan vibrál).

Az utolsó bekezdésed nem értem. Miért akarsz még szintetikus blur-t is generálni? Már most is bőven sok van az alacsony fps miatt, nem kell több.

-

janos666

nagyúr

válasz

Ren Hoek

#7117

üzenetére

Ren Hoek

#7117

üzenetére

Mi abban az ördöngösség, hogy felszeletelik időben (egyszerre az összes pixelt) aktív/passzív szakaszokra és arányosan kompenzálják az aktív idő intenzitását? Nyilván mindenképp plusz munka, bizonyos esetekben és szempontokból jobban terhelheti a hardware-t (főleg pl. ha egyszerre akarsz minél világosabb HDR-t és BFI-t is, ráadásul minél kevesebb ABL-el...) és megvannak a fizikai és praktikus korlátai, de biztos lenne valami kompromisszum a lehetetlen elvárások és fizikailag lehetséges állapotok közt, ami jobb mint a 120Hz-es móka vagy a semmi.

Akár az is működne, ha a 120Hz-et jelentősen tovább emelnék, amivel nagyobb lenne a játéktér a "fapados" megoldás számára, de bizonyos szempontból "olcsóbb" lenne inkább magában a panelvezérlőben megvalósítani a "pulzálást", ideális esetben kintről konfigurálhatóan (és még mi is kapnánk egy csúszkát, hogy húzzuk oda, ahol nekünk jó kompromisszumnak tűnik fényerő és mozgásélesség közt).

(#7129) Joshi

Kösz, hogy megnézted és leírtad a véleményed.

-

janos666

nagyúr

24Hz-es filmmel próbáld inkább, az 50Hz TV adás szerintem sohasem lesz "hibátlan" BFI nélkül se (még sohasem próbáltam, nem nézek most semmi 50Hz-et).

Szerk.: most próbaképp tologattam az ablakokat Windows asztalon 50Hz-en, és nem ugrált, szóval lehet hogy át tud váltani 100Hz-re a panel (vagy csak megtévesztő, majd egyszer megnézem alaposabban). Akkor jó lehet az 50Hz adás is, illetve a BFI sem feltétlenül 50+70 ilyenkor, hanem lehet 50+50

-

janos666

nagyúr

válasz

Ren Hoek

#7113

üzenetére

Ren Hoek

#7113

üzenetére

De, 60+60

Pontosabban nem tudom, mikor épp mennyi, de mindig 120Hz-be pakol be X forrás és Y fekete képkockát, amiből nincs sok kombináció (60-nál csak 60+60, esetleg 24, 25, 30 bemeneteknél van játéktér, de nem sok, szerintem gyakorlatilag mindig 60+60, 72+48, 50+70, stb)Az a plazmás 600Hz csak marketing volt (kósza valóságalappal), 60Hz bemenettel 60Hz-en járt az a panel, csak minden frissítés több al-frissítésből rakódott össze (24Hz bemenettel 96, esetleg 72Hz-en jártak, 50Hz bemenettel általában 100Hz-en, esetleg 75-ön).

De ez teljesen mindegy, sőt PDP-nél sokkal bonyolultabb volt ezt finomhangolni, mint LED-es LCD-nél csinálják is, vagy az OLED-nél lehetne. Ésszerű korlátok közt úgy időzítik a felvillanások számát és hosszát, ahogy nekik tetszik (és amit elbír a panel) úgy, hogy abszolút semmi köze a Hz-ekhez.

El lehetne felejteni a Hz-eket, és egyszerűen beállítani, hogy minden képkocka mondjuk 6ms-ig világít és 10ms-ig fekete a képernyő, de azt is, hogy kétszer is felvillan 3 és 3ms-re, közte két 5-5ms szünettel, stb, de akár adhatnak a felhasználónak egy csúszkát, és akkor megy 3/13-tól 13/3-ig oda-vissza. De ezt a fajta BFI-t az LG-nek kéne most csinálni, ők pedig nem foglalkoznak vele, a Sony pedig csak a 120Hz-el játszik.

-

janos666

nagyúr

válasz

dgyuri0123

#7059

üzenetére

dgyuri0123

#7059

üzenetére

Ahogy írtam lentebb, a régebbi LG-nél jobb a magasabb OLEDFény, és inkább a Kontraszt-ot érdemes visszavenni. De összességben amúgy sötétebb is, illetve másképp működik az egész fényerőkezelése (nem egészen ugyan azt csinálják a csúszkák), így nem érdemes így összehasonlítani a számokat generációk közt, főleg nem még a 16 előttieket az az utániakkal.

-

janos666

nagyúr

Nem egyszerű eset, ha a lehető legkompromisszummentesebben szeretnéd monitorként használni ezeket az OLED-eket, illetve kijelzőtől függetlenül is komplikált PC-n HDR-ben játszani.

SDR-hoz a PC mód a legjobb Cinema (vagy ISF/Haladó/Profi) képmóddal: alacsony a lag, de megmarad teljes körű színkezelés, ráadásul még a 24Hz is kadenciahelyes (tehát tulajdonképp sohasem kéne kivenni PC módból, ha csak SDR-ra használod) és még a chroma is átmegy 4:4:4-ben (illetve jól működik az RGB is, azon belül a Full Range is, ami ide ideális).

HDR-hoz viszont jelenleg hibás a PC mód (ironikusan a Cinema itt még rosszabb, mint a Game, de egyik sem igazán jó), bár itt a HDMI-be sem fér be a 4k 4:4:4, szóval igazából nem olyan nagy veszteség kivenni PC módból HDR mozizáshoz vagy HDR játékhoz, amikhez rendre Cinema vagy Game mód passzol (a Cinema így TV módban nagyon lagos).

Illetve online lövöldéhez, mint mondjuk egy kis CS:GO, használhatod az 1080p120 módot is (ott szerintem mindegy is, hogy PC vagy TV módban hagyod, ez kicsit önálló életet él, több minden is "kikapcsol", pl. bukod a komplett gamut mapping-ot akár Rec709-ről, akár Rec2020-ról, illetve totál használhatatlan a HDR, csak SDR-hoz jó és rikítani fognak a színek). Kicsit lágyan nagyít a TV 2k-ról 4k-ra, szóval másra nem használnám ezt a képmódot, csak olyankor, ha sokkal fontosabb a magas frissítési freki, mint a képminőség.

Persze PC-n mindezt még meg lehet fűszerezni szoftveres 3DLUT-okkal. Még nem játszottam vele, de ránézésre teljesen kikupálható lehet a PC/HDR/Game mód, hogy ne kelljen soha váltogatni a PC és TV (illetve Cinema és Game) módok közt. Bár TV módban picit jobb az árnyalatfelbontás is, mint PC módban, szóval talán megéri venni a fáradságot és áttenni TV módba, mikor nem kell a 4:4:4 chroma és alacsony lag (vagy 4k HDR játékhoz úgysem fér bele a 4:4:4 és a Game mód mindig alacsony lagot ad). Sőt, ugyan így rendbe lehetne tenni a TV/HDR módokban is az agresszív SDR range tömörítést (a sötét 4000nit filmeket és még sötétebb 10000nit játékokat).

...

nVidia kártyáknál régi játékokhoz vissza kell tenned a 378.92 driver-t, mert ha ott van a HDR kapcsoló a Windows-ban, akkor nem fognak működni. Az új játékok állítólag már működnek a Windows féle kapcsolóval is, de tippre mennek a régi driver-el is.

Azért lesz sötét a kép, ha átbillented a HDR kapcsolót, mert túl agresszíven tömöríti az SDR régiót az LG, főleg az új firmware-el. Ezt filmeknél nem mindenki veszi észre, illetve az a baj, hogy a Windows asztallal és PC játékokkal 10000nit metadata megy ki, míg filmeknél 1000 vagy 4000, és előbbivel semmi baj nincs és utóbbi is tolerálható, csak a 10k a gáz.

-

janos666

nagyúr

válasz

dgyuri0123

#7018

üzenetére

dgyuri0123

#7018

üzenetére

Nem emlékszem hogy 10-et javasoltam volna. Azt írtam, hogy:

1: Én 18-on használom SDR-ban *, és

2: HDR módban kb. annyira tömöríti az SDR tartományt 4000nit metadata mellett, mint ha nagyjából 10-ig lehúzom SDR módban (és igen, ez nekem is olyan, hogy tolerálható, de nem örülök neki, a 10000nit-hez használt tone mapping pedig már kimondottan zavar is, túl sötét még a plazmához szokott ízlésemnek is).* Az első pár napban 16-ra tettem, majd 17-en állt, most pedig már 18-on. De idő közben volt firmware frissítés, és gondolom az első napokban még számottevőbb változásokat produkál a "pixel frissítés" (a fehéregyensúlyt is arrébb kellett kicsit bökni az első pár hét után).

De amúgy igen, az sem mindegy milyen évjárat. Bár a legnagyobb különbség ilyen szempontból ott lesz, ahol a régin már dolgozik az ABL, az újon pedig még nem.

-

janos666

nagyúr

válasz

Ren Hoek

#6984

üzenetére

Ren Hoek

#6984

üzenetére

Volt több jelentkező, aki gondolkodott rajta, hogy elviszi mondjuk ~10% árengedménnyel így beállítgatva, én pedig gondolkodtam, hogy ha tényleg eljönnének érte, akkor kipróbálnám inkább a Sony A1-et (annak most csökkent az ára, szóval végül ugyan oda jönnék ki, mint ha eredetileg is a Sony-t rendelem be és nem fukarkodom az áron, vagy a 20-40ms közti lag különbségen), de aztán mindenki passzolta (vagy ő is rögtön inkább Sony A1-ért ment [lehet, hogy azért, mert mondtam neki, hogy azt próbálnám ki, ha ezt elviszi

], vagy inkább beérte egy olcsóbb LCD-vel, vagy nem mesélt tovább / vett inkább boltból valamit). Most meg lassan túl öreg lesz, hogy újszerűnek hívjam és közel bolti árat kérjek érte, olcsón pedig nem éri meg eladni (tudom, hogy a Sony-val sem lennék összességében, az árát is figyelembe véve sokkal elégedettebb + újra át kéne esni a pixelhiba-lottón...).

], vagy inkább beérte egy olcsóbb LCD-vel, vagy nem mesélt tovább / vett inkább boltból valamit). Most meg lassan túl öreg lesz, hogy újszerűnek hívjam és közel bolti árat kérjek érte, olcsón pedig nem éri meg eladni (tudom, hogy a Sony-val sem lennék összességében, az árát is figyelembe véve sokkal elégedettebb + újra át kéne esni a pixelhiba-lottón...).Majd egyszer még kipróbálom, hogy ha megszoktam ezt, milyen utána visszamenni a Kuro-hoz. Akár már aktuális is lehetne, csak bonyolult mozgatni (főleg a plazmát).

(#6985) Joshi

Azt a demót én sem tudtam soha lejátszani semmivel, de azóta már "kölcsönözhető" a teljes film is barátságosabb formátumban (persze csak tesztelési célra

![;]](//cdn.rios.hu/dl/s/v1.gif) ).

).Ja, neked olyan nincs. Te a Kontraszt-al és valami "range expander" nevű kapcsolóval tudsz játszani fényerő ügyben (nem ugrik be pontosan, magyar menüben teljesen passzolom).

A BFI-vel játszottál már? Mennyire tűnik vele sötétnek / vibrálónak a kép, illetve mennyire tetszik úgy a mozgás?

Nekem emiatt kókad le máig a szám játék közben, ha forgolódok a kamerával, hogy maszatol az LG a BFI hiánya miatt.

Ugyanakkor tetszik, hogy alacsony a lag (a Sony-n duplája lenne, ami a TV-t illeti [persze máshonnan is adódik hozzá]) és BFI nélkül sokkal tolerálhatóbb a FastSync (ami egyenetlenebb mozgást ad, mint a hagyományos Vsync, de kevesebb lagot ad hozzá), szóval van itt mindennek előnye/hátránya... -

janos666

nagyúr

válasz

dgyuri0123

#6981

üzenetére

dgyuri0123

#6981

üzenetére

SDR-hoz bőven sok a 18, nekem is annyi van most.

Nekem is kellemetlen is volt napig plazma után a 16-18

De kísérletképp fix 100nit-re húztam OFF-olt ABL-el a PDP-n megszokott 90+ABL helyett. Részben sikerült megszokni, viszont most szinte mindig világít a lámpa a szobában, amit plazmával csak ritkán kapcsoltam fel (ahhoz egy kis beszűrődő napfény is elég volt a falakra).Mondjuk HDR játékhoz (fény/kontraszt 100/100) mindenképp le kell nyomni a lámpát, az már zavaróan sötét dinamikus kontraszt nélkül sok jelenetben, mert olyankor 10000nit a metradata , amivel túl agresszív az LG-nél a roll-off.

A dinamikus kontraszt első ránézésre megoldja, viszont a színhelyességet hazavágja, főleg High-on, pedig addig kéne tolni, hogy normális legyen fényerő szempontból. -> Nem tudom, hogy ezt miként éli meg az, aki 20 feletti OLED Fénnyel tolja az SDR-t, mert max 10-es OLED fényű SDR-nak felel meg a 100-as HDR-ben az SDR tartomány.

Fogalmam sincs mit akart ezzel az LG, mert úgysem a sötét jelenetektől fog beégni HDR módban, a csúcsfény pedig most is elérhető a világos foltoknak, amik IR-t tudnak okozni.

-

janos666

nagyúr

Akkor gondolom azt kizárólag a formátumok (metadata / flag) támogatására értette (amit jó lenne rugalmasan kezelni a szabványháború ideje alatt), a sávszélre egyáltalán nem vonatkozik.

Előbbi triviális, példák is vannak rá 1.x időkből. Nyilván bármikor "visszaportolhatóak" a következő szabványok funkciói nemhivatalos, vagy akár "félhivatalos" formában (csak az változik, hogy miként szabad erre hivatkozni), ugyan úgy mint ha teljesen egyedi kiegészítést adna hozzá valaki.

Persze a sávszélt is bármikor meg lehetne emelni (korlátozott mértékben) nem-hivatalosan. "Idiotiautizmus" is szerintem, hogy a 2160p60@4:4:4 az nem egy elterjedt "kvázi-garantált overclock" mód ezeken az OLED-eken is (mint ahogy a PC monitoroknál is van, hogy garanciát ugyan nem vállalnak rá, de nagy betűkkel hirdetik a gyártók, hogy túl lehet vele lépni a szabványos kereteket XY mértékben, ők úgy tervezték, csak nem biztos, hogy a VGA+kábel is bírja mindenkinél, mert nem szabványos, de általában működik), hisz nincs hatalmas hézag (jó minőségű alkatrészekkel és kábelekkel biztos bírná az eszközök >99%-a azt a "tuningot").

A spec szerintem már kész, csak a hitelesítési teszt várat magára (amit linkeltem is), ezért is lenne még fura hivatalosan bejelenteni bármit, hogy támogatja (és úgy néz ki, hogy a CES-ig nem is lesz kész, ezért vagyok pesszimista, hogy '18-ban jönnek a 2.1-es TV-k, főleg hogy kezdettől így nevezik, nem csak későbbi frissítés oldja fel, de az nagyon lutri).

-

janos666

nagyúr

"HDMI állítása szerint, a 2.0b csatlakozóval szerelt készülékek frissíthetők lesznek 2.1-re."

Ezt hol olvastad? Még nem futottam bele, és elsőre elég hihetetlennek hangzik, mivel a 2.0->2.1 az eddigi legnagyobb sávszélugrás a HDMI történetében két verzió közt, ami ezúttal nem csak szimpla órajelemelés, mint ami eddig lényegében mindegyik volt, hanem nő a sávok száma is, illetve változik a kódolás (logikusan inkább ezt kellett volna 2.0-nak nevezni, mert hivatalosan még kábelből is új kell - és vélhetően tényleg ritkán lesz jó a régi).

Persze lehet igaz, de itt egy másik, ami miatt újraértékeltem nemrég a valószínűségét, hogy a '18-as széria már HDMI 2.1-el debütálna:

https://www.hdmi.org/manufacturer/hdmi_2_1/index.aspx

Q: When will the HDMI 2.1 Compliance Test Specification be available?

A: The HDMI 2.1 Compliance Test Specification (CTS) will be available in Q1-Q3 2018.Ez alapján inkább a jövőre megjelenő készülékekre lehet majd igaz, hogy már 2.1 kompatibilis chipset-el jönnek, csak a hitelesítési tesztek hiányában nem írhatják majd még rá a marketinganyagokra, hanem majd egy firmware "feloldja", ha tényleg megfelelt a végleges tesztnek (vagy nemhivatalosan lesz elérhető pár dolog, pl. félhivatalos funkciótámogatás, HFR csak "overclock" jelleggel).

A 2160p60 RGB 10bit sem lenne hatalmas overlock, mégsem akaródzik működni, ha forrás oldalon feloldjuk a TMDS limitet (próbáltam

) ugyan úgy, ahogy az 1080p120 RGB 10bit is hiába fér át már most 18G-n, a '17-es LG TV-k nem sok jót kezdenek vele (SDR-ban butul a színkezelés, HDR nincs). Szóval most sem csak a 18G a korlát, nem feszegetik a húrt, nem tudom mit tudnának kezdeni a 2160p120 10bit-el a lánc további pontjain a '17-es készülékek attól, ha a HDMI részükön megemelnék ~3x-re sávszélt. (Talán van ott bőven fix funkciós feldolgozási korlát, vagy az egekbe szökne a lag az általános feldolgozókon, vagy magas pixelszám és frissítés mellett ormótlan banding lenne...)

) ugyan úgy, ahogy az 1080p120 RGB 10bit is hiába fér át már most 18G-n, a '17-es LG TV-k nem sok jót kezdenek vele (SDR-ban butul a színkezelés, HDR nincs). Szóval most sem csak a 18G a korlát, nem feszegetik a húrt, nem tudom mit tudnának kezdeni a 2160p120 10bit-el a lánc további pontjain a '17-es készülékek attól, ha a HDMI részükön megemelnék ~3x-re sávszélt. (Talán van ott bőven fix funkciós feldolgozási korlát, vagy az egekbe szökne a lag az általános feldolgozókon, vagy magas pixelszám és frissítés mellett ormótlan banding lenne...) -

janos666

nagyúr

Ha külső lejátszóról nézed ezt a filmet (ha nem, de van rá mód, akkor próbaképp tégy így), akkor próbáld meg átnevezni a HDMI bemenetet PC-re, úgy 99.9%, hogy nincs se jóhiszemű tévedésből, se szándékos csalásból úgymond "beragadva" se a TrueMotion Off-tól magasabbra, se a RealCinema On helyett Off-ra, mert a PC mód fixen megkerüli ezeket (pusztán attól, hogy ezek kiszürkülnek a menüben, még mindig be lehetnének kapcsolva csalás/hibaként, de a PC mód eleve olyan, hogy a lag minimalizálás miatt fixen kihagyja azokat a dolgokat, amik jelentős késést okoznak és a TM látványos lagot eredményez TV módban --- és nekem nem tűnt fel, hogy lagolna a PC mód frissítés óta, pedig az feltűnik, ha TV módban felejtem HDR-ezés után, még akkor is ha a TrueMotion ott is ki van kapcsolva).

De amúgy ha erősen koncentrálsz a mozgásélmény hibáira, mindig találsz valamit, akár technológia sajátosságokat LCD-n, PDP, OLED-en egyaránt, de ugyan úgy a 24fps ezektől független nyűgjeit is kiszúrhatod néha (vagy akár találhatsz hibákat a forrásban, mert az sem lehetetlen, főleg ha sok benne a CGI).

Egy példa: még az első egy-két napban egymás alatt/felett állt az LG C7 és a Pio LX5090. Mikor a Passangers-be tekergettem bele, akkor láttam valami nagyon csúnyát. Már kezdtem volna szarozni az LG-t, de megnéztem a Kuro-n is ugyan azt ugyan úgy, és ledöbbentem, hogy majdnem pont ugyan az jön elő (a plazmán csak picit volt jobb a helyzet).

Az egyik jelenetben, ha a kapitány szemébe nézek, úgy mozog átlósan, hogy ha követem a mozgást a képernyőn, akkor egy nagyon fura dolgot vélek látni: mint ha valami hallucináció lenne, "szétcsavarodik" az arca, mint ha zseléből lenne a feje és nyúlik ahogy mozog.

De mint mondtam, ez ilyen az egyik (vélhetően a) legjobb plazmán és a C7-en is (TrueMotion nélkül, és ezt még a 03.xx.xx firmware-el néztem és nyilván a plazmán is kadenciahelyesen ment 24@72Hz-en, illetve interpoláció nélkül...). -

janos666

nagyúr

válasz

Partizan182

#6562

üzenetére

Partizan182

#6562

üzenetére

átbevezni a Hdmi inputot és game mód

Elég az egyik. Ha átnevezed a HDMI-t PC-re, akkor nem kell Game mód, a Cinema/Prof sem lagol (de jobb a képe, mint a Game-nek).

-

janos666

nagyúr

válasz

Ren Hoek

#6525

üzenetére

Ren Hoek

#6525

üzenetére

"Szokható LCD-hez képest.'"

Te is biztos keresed a benzingőz szagú fenyőfaformájú autóillatosítót, mióta nem szivárog már át rendszeresen a szag a motorházból az utastérbe, ugye?

Komolyan ennyire félni attól, hogy egy defekt javul...?

(De még csak nem is teljesen, sőt...)Én bármikor kiperkáltam volna még ~20% felárat a C7 tetejébe, ha azért adtak volna komolyan finomhangolható BF-t (nem csak azt a 60/60 módot, mint a Sony, hanem már a panelvezérlő szintjén állható duty cycle tág keretek közt).

-

janos666

nagyúr

válasz

Batyops

#6256

üzenetére

Batyops

#6256

üzenetére

Régen voltak TV-k, amik vagy egyáltalán nem tudták rendesen kezelni a Full RGB-t (csak nagyjából lehetett odakalapálni Kontraszt/Fényerő csúszkával, de az nem az igazi, csak közelítő megoldás), vagy nem minden képmódban engedték ezt állítani (pl. csak PC módban ment jól így), vagy látszólag be lehetett állítani, de hibázott vele a színkezelés (legtöbbször még ma is visszakonvertál a TV odabent valami YCC szerű színtérbe a képfeldolgozáshoz, és ez nem mindig sikerült jól, már csak azért sem mert sok volt a paraméter, amit csak a legvalószínűbb értékre rögzítettek előre, nem lehetett felismerni a jelből...).

"Igazi" filmlejátszókból érdemes YCC-t kiküldeni, mert a videók mind abban vannak és nem veszteségmentes az YCC és RGB közti konvertálás. De ezt is nehéz így megfogni, mert nem tudatod, valójában mi van a "dobozban" és mit csinálnak vele (lehet hogy teljesen általános jellegű, PC-szerű SoC-ból építenek médialejátszót, lehet hogy videós célokra optimalizált SoC van benne, de lusták voltak speciális API-kat használni natív YCC-hez és mégis RGB-n keresztül megy).

-

janos666

nagyúr

válasz

Batyops

#6251

üzenetére

Batyops

#6251

üzenetére

Játékhoz a Full RGB (teljes, 0-255) az ideális, ami a TV-n a High (magas).

(... aminek semmi értelme, mert 0-255 skálán a 16 magasabb, mint a 0, de...)

PC módban jól működik az Auto is a TV-n (legalább is ha Full RGB jön PC-ből).De a fontosabb, hogy a két oldalon mindkettő ugyan oda legyen beállítva (azt nem biztos, hogy külön alapos vizsgálódás nélkül észreveszed, hogy oda-vissza konvertálgat-e full/limit vagy akár RGB/YCC közt, de az általában feltűnő, ha nem ugyan arra vannak beállítva), illetve hogy ha Auto-n hagyod, akkor ellenőrizd le, hogy tényleg jól működik-e (és ne a Kontraszt / Fényerő csúszkákkal próbáld ezt helyre tolni).

-

janos666

nagyúr

válasz

Dave567

#6225

üzenetére

Dave567

#6225

üzenetére

Ha jó helyen van a két Front és a hallgató, akkor szerintem teljesen értelmetlen az ideálisan elhelyezett center. Ugyanakkor a gyakorlatban nem igazán tudod ideálisan elhelyezni azt a Center-t, mert mert valahol a TV mögött kéne lennie (úgy, hogy ki van lukasztva [vagyis nincs is ott] a TV, egyébként vagy alacsonyabban, vagy magasabban lesz, mint kéne, főleg ha nagy a TV [de a ha kicsit, akkor túl közel ülsz a hangdobozokhoz, és az is baj]). "Kelleni" csak azoknak kell Center, akiknél "össze vissza" állnak a Front-ok és/vagy ülnek a nézők szétszórva, és így kisebb zavart okoz a Center magassági problémája, mint a stereo síkeli torzulása. Ha jól a két front, akkor úgy hallani belőlük a Center-re szánt dolgokat, mint ha magából a TV képernyőből jönne a hang (mint ha egy akusztikailag semleges vászon lenne, mögötte egy Center-el). Ha fel/le szorul a Center a TV alá/fölé, akkor pedig hallani, ahogy vándorol a "forgolódó" hang fel-le (+ tökéletlen szobaakusztika és hasonlók miatt akár a hangszín is jobban változik így).

-

janos666

nagyúr

Csak a lejátszó és AVR közé kell "placebó" kábelt tenni, az ARV és TV közé (vagy ha két külön kábel megy a lejátszóból az AVR-be és a TV-be) mehet bármelyik "high speed", amelyik kézre esik és működik (nem "pislog" a kijelző, nem "szikráznak" a pixelek, nem írja ki a TV, hogy "nincs jel" vagy "ismeretlen formátum" --- ha rossz, azt egyértelműen észre fogod venni).

-

janos666

nagyúr

Miért is próbáltam volna kikapcsolni?

De szerintem félreérted, ezt a felhasználói menüből nem tudod kikapcsolni. Mindig megy az automata, esetleg a szervizmenüben tudsz mókolni vele, de nem látom értelmét.Vagy a képernyő/pixel eltolásra gondolsz (ami a teljes képet tologatja néhány pixellel ide-oda)? Azt persze, kikapcsoltam. (Az is ott van az OLED panel menüben.)

(#6164) torma1981

Mert nem kínálnak fel nekünk olyan módot, mikor minden pixelből copy-paste 4 egyforma lesz, csak valami lágy resample megy még 1080p120-ban is (mikor a legtöbb képfeldolgozás képmódtól/beállítástól függetlenül kikapcsol vagy "fapados módba" vált).

Azt hiszem pár 4k-s Sony LCD-n van olyan képmód/beállítás, ahol nincs remaple, csak "nearest neighbor" (a Sony-nak van saját játékkonzolja, így nekik néha eszükbe jut ilyesmi, de nem tudom hogy az A1 OLED-jük tud-e ilyet).

-

janos666

nagyúr

Tudtommal csak akkor csinálja készenlétben, ha a legutóbbi óta ment legalább 4 órát aktívan (ezt az időt meg lehet nézni, talán még átállítani is a szervizmenüben).

Az a két opció szerintem inkább a rendhagyó felhasználók (PC monitor, kliens monitor, bolti bemutatódarab, stb) részére lett elérhetővé téve, hogy szükség szerint és előre tervezhetően is biztos le lehessen futtatni (pl. egy "kritikus munka" előtt frissen, ha monitornak használják, vagy amint feltűnő IR jelenik meg, ha bemutatódarabnak és "riaszthatja" a vásárlókat).

De én még alig láttam IR-t az enyémen, csak a HDR hozta ki.Amúgy érdekes kérdés mikor és hogy csinálja pontosan. Nekem tippre úgy tűnik, hogy csak azért tart sokáig, mert megvárja míg "kihűl / kisül" (hőmérsékletre, elektromosan, mindkettő...? passz) és akkor fut le a ténylegesen csak pár (másod)perces kis mérés. De az is lehet, hogy tényleg hosszasan mér és mikor lezárásképp végigpásztázza a fehér csík a képernyőt, az csak a folyamat egy utolsó gyors lépése, nem a komplett folyamat.

-

janos666

nagyúr

Windows asztal, jobb klikk képernyő beállítások, méretezés és elrendezés (??? bocs, ~10 éve angol Win-t használok, scale and layout...): 100%-on lesz "eredeti", ez biztos jó 1080-hoz, de szerintem még 1440-hez is.

Én elég közel ülök / jó még a látásom, hogy 100%-on használom 2160-ban, csak a webböngészőben és dokumentumkezelőkben húzom fel 150%-ra szükség szerint. Ez is olyan dolog, hogy mikor 1080-ban neteztem, akkor is "éreztem" már, hogy bizonyos weboldalak design-ja 1440p vagy akár 2160p monitorra van optimalizálva (1080-ban hatalmasak a betűk/gombok, kicsinyíteni kellett 75%-ra, hogy ne legyen kényelmetlen olvasni). Ez ilyen "átmeneti időszak", miután egy évtizeden át 1080p volt a standard, de a monitorok már rég átléptek 1440-be, illetve zajlik a lassú vándorlás 2160-ra...

Amúgy pedig ha érdekel még pár észrevétel/tanács, az utóbbi két hétben teleszemeteltem a topic-ot ennek az OLED-nek a monitorkénti használatával szerzett tapasztalataimmal.

-

janos666

nagyúr

válasz

Ren Hoek

#6156

üzenetére

Ren Hoek

#6156

üzenetére

Az is a retina biológiája, hogy költséghatékonysági és/vagy pusztán gyakorlati fizikai megvalósíthatósági korlátok miatt csak 24, 25, 30, legfeljebb 50, 60 képkockát rögzítenek egy kamerával, teszem azt 100, 120, netán még 240 fps helyett?

Ez a két dolog összefügg. A magas valós fps mellett sem tapasztalsz persistence blur-t, mert nem marad kint ugyan az a képkocka túl sokáig.

Az interpoláció is azt próbálja pótolni, ami a felvétel rögzítésekor (vagy esetleg csak valahol később a csatornában) elveszett, mert nem akarták/tudták a többszörösét elhasználni a filmtekercseknek, HDD rack-eknek, bérelt sávszélességnek, stb (illetve a digitális kameránál sem akart már a gyártó sem "eszement" sávszélességekkel bajlódni, hanem egy kompromisszumot kerestek).

Egyszer majd elérjük a pontot, ahol tényleg nem lesz értelme tovább növelni a felbontást/bitmélységet, és akkor ha még mindig tovább tud fejlődni a technológia (tárhely és sávszélesség, akár a forgatásokon/studio-kban helyben [még az üvegszálas lézeroptikás cuccoknak is van korlátja, mikor vissza kell menni fémre és elektromosságra], de aztán a kiadó/műsorszóró és felhasználó közt is), akkor elindulnak majd felfelé a mintavételi sűrűséggel ebben a dimenzióban is, és jön a 120fps mozi, stb (azokkal együtt, akiknek ma tökéletes a sample-and-hold 24fps is, de majd akkor kell nekik a HFR, mint a falat kenyér az éhezőnek).

-

janos666

nagyúr

válasz

Ren Hoek

#6154

üzenetére

Ren Hoek

#6154

üzenetére

Nyugi, BFI nélkül az OLED is bőven sok persistence motion blur-t ad a képhez.

![;]](//cdn.rios.hu/dl/s/v1.gif)

Nem annyira, de majdnem olyan rossz, mint a legjobb BFI nélküli IPS LCD.

Én sohasem bírtam az ilyen real-time interpolációt (de kísérleteztem olyanokkal is régen, amik órákon át konvertáltak át pár percnyi videóanyagot). Olyan érzés, mint ha hibásan működne az agyam.

Talán mindenki tapasztalt már például erős kialvatlanság esetén kósza kis vizuális hallucinációkat, főleg a periférián... Nekem folyamatosan ilyen érzés az interpoláció alaphangon (mindig olyan, mint ha valami lehetetlen dolog történne a szemem előtt, amit nem feltétlenül látok át tudatosan is, hogy mi a baj, de "érzem", hogy valami nagyon nincs rendben, "mint ha be lennék tépve"). Ráadásul még erre jön rá, hogy adott implementációtól/fokozattól függően gyakran egyértelműen látni konkrét hibákat is ("viccesen" torzuló/nyúló élek, formák, foltok, stb), illetve hogy egyenetlen a mozgás, mint ha mindig gyorsulna/lassulna (mint régen a VHS szalagról filmezés, ha rossz volt a lejátszó, vagy megnyúlt maga a mágnesszalag ->> Tudod, mikor hívtad a szerelőt, vagy nekiálltál te magad megjavítani a gépet ).

). -

janos666

nagyúr

válasz

#94529552

#6117

üzenetére

#94529552

#6117

üzenetére

Tejesen más megalapozott véleménnyel rendelkezni arról, hogy mi lenne az ideális, mint képesnek és hajlandónak lennie arra, hogy a véleményközlés pillanatáig megvalósítani azt saját célra.

(#6118) torma1981

Na, akkor frissítek két héten belül harmadik alkalommal.

Remélem megint újra kell kalibrálni.

(Á, igazából szerintem semmi észlelhető nem változik .06 után, legfeljebb valami SMART dolog, de én az első használathoz még rápattintott UTP kábelt is kirántottam a seggé, miután beleolvastam a használati/adatkezelési feltételekbe. )

) -

janos666

nagyúr

válasz

torma1981

#5835

üzenetére

torma1981

#5835

üzenetére

Játéknál, ha relatívan túl nagy a felbontás a távolsághoz és képátlóhoz képest, azt én úgy hívom "optikai SSAA". Majdnem olyan, mint mikor nagyobb felbontásban renderel a játék a kijelzőétől, csak több szempontból is jobb: ha nem is látod a nagyobb felbontás teljes részletességét, valamivel azért mégis több jön át, illetve jobb, ha "a szemedben olvad össze a recer", mint ha egy "izé" algoritmus csinálja (általában nem tudjuk szabadon váltogatni/paraméterezni azt az algót, csak Ki/Be opciót kapunk, vagy épp mind furán fest, ami beállítható, illetve néha problémás az SSAA kompatibilitás HUD-ok, feliratok, és hasonlók tekintetében).

Lehet, hogy végül engem is ez fog meggyőzni, mert régóta sopánkodom már, hogy zavar az aliasing, de nincs normális AA, csak olyan ami maszatol, vagy persze méreg drága az SSAA, és akkor már inkább natív 4k...

Na meg változnak a játékok is, egyre gazdagabb geometriát és nagyobb felbontású textúrákat kapunk, amik szebben néznek ki nagyobb felbontásban. Régen az egész lombkorona egy nagy átlátszó textúra volt, ma viszont vannak benne tényleges gallyak és levelek, a távoli gallyakon pedig néha 1-2 pixel szélességű vonal adódik, így kisebb felbontásban többször látni olyat, mint ha a gally vége a levegőben lógna és ez "csúszik" mozgás közben).

Szóval ja... függőséget okoz 4k-ban nézegetni a videojátékokat.

-

janos666

nagyúr

válasz

janos666

#5970

üzenetére

janos666

#5970

üzenetére

Hopsz, ez a sor:

HDR játékra ugyan az, mint fent HDR játékra, kivéve hogy OLEDFény 100 helyett 16

** itt HDR szót SDR szóra kellett volna cserélnem, tehát az SDR játék PC címke nélkül ugyan az, mint a HDR játék, csak OLEDFény 16 és nem 100

Azért jobb a PC címke játékra, mert egyrészt 4:4:4, másrészt van korrekt színkezelés az ISF (vagy Cinema) móddal, mégsem lagol (PC címke nélkül lagos az ISF és Mozi mód !).

HDR-ben viszont bugos a PC mód (akár Mozi/Cinema, akár Játék, mindig szar a PC módban a HDR, rossz a gamut mapping: a Rec2020-at Rec709-be tömöríti, amitől a Rec709 színtelen okádék).

-

janos666

nagyúr

válasz

Partizan182

#5963

üzenetére

Partizan182

#5963

üzenetére

Én így használom (sötétben, de inkább tompa lámpával, vagy enyhe, szórt nappali fényben):

SDR film és SDR játék: PC címke + ISF Dark (Haladó éjszaka)

16 |-| 100 |-| 50 |-| 0 |-| 0 |-| 60 |-| 0

Minden szir-szar OFF, Auto színtér

Feketeszint bemenetnek megfelelően (Full-RGB = High, Limit-RGB = YCC = Low)

Fehéregyensúly felső pont: 0 -9 -3HDR filmhez HDMI címke (vagy bármi csak ne PC) + Film/Cinema mód

100 |-| 100 |-| 60 |-| 0 |-| 60 |-| 0

A többi ugyan az, fehéregyensúly felső pont: 0 -8 -2HDR játékra szintén HDMI címke (vagy bármi csak ne PC) + Játék mód

Ugyan az, mint HDR Film, csak a fehéregyensúly: W47Ha túl fárasztó HDMI címkét váltani, akkor:

SDR filmhez minden ugyan az, mint fent SDR filmekhez, kivéve hogy előjön a Real Cinema / Valódi Mozi, ami legyen ON (PC módban ezt OFF-nak írja kiszürkítve, de az olyankor igazából ON !)

HDR játékra ugyan az, mint fent HDR játékra, kivéve hogy OLEDFény 100 helyett 16

A közös beállítások főmenüből:

Energiatakarékosság OFF (sötét szoba) vagy esetleg Alacsony (vegyesen használva)

OPLED panel / Screen Shift (hogy van ez magyarul? képernyő eltolás??) OFF / KI

Méretarány Eredeti / Original és Just Scan ONEzekből, ami fura lehet, az a feketeszint, az logikátlan (a High / Magas kell akkor, ha alacsonyan van számszerűleg a fekete a jelben), illetve hogy a "Just" (magyarul mi ez? "csak"?) mód bekapcsolva jelent 1:1

levágás nélküli módot (sok TV-n a Just az vág az éleken).Illetve még végigjártam a 20 pontot az ISF módban, de azt már tényleg felesleges lenne megosztani, már a fehéregyensúly felső pontját is csak érdekességnek írtam be.

Még annyi, hogy a Kontraszt sokkal "biztonságosabb" 100 helyett 90-en, ha nincs lehúzva pár pont a 2 pontos fehéregyensúly tetején, mint nálam (de lehet, hogy már anélkül sem vág, a szervizmenüben jól látszik, hogy nincs eltolva koppig a "mélyebb" paraméterezés). A HDR Kontraszt mindig maradhat 100.

-

janos666

nagyúr

válasz

dgyuri0123

#5955

üzenetére

dgyuri0123

#5955

üzenetére

Miért enné meg a HDR a panelt? Sok filmben csak néha megy fel egy-egy tenyérnyi folt az SDR tartomány fölé fényerőben (fényforrások a háttérben, csillogások az üvegeken, ilyesmik), vagy esetleg néhány percig világos az egész képernyő nagyja, de utóbbi esetben már dolgozik az ABL (ugyan úgy, mint ha SDR-ban nézed viszonylag magas OLEDFény-el).

Sőt, ha megnézed a lenti táblázatom, ha 4000nit-re fényelt filmet nézel, ezeken a TV-ken jelentősen sötétebb az SDR tartományba eső rész, mint ha SDR módban nézed ugyan azt (1000nit fényelésnél pedig kb. ugyan az).

-

janos666

nagyúr

válasz

dgyuri0123

#5959

üzenetére

dgyuri0123

#5959

üzenetére

Ezt akartam írni, hogy nekem alap a ~300W minőségi SDR-hoz.

-

janos666

nagyúr

Nekem most játékhoz/netezéshez (ég két kis halogén izzó a plafonon) OLEDFény 16, Kontraszt 100 (de 0 -9 -3 a fehéregyensúly, ami így effektíve Kontraszt szempontból durván olyan, mint ha 91-en lenne a Kontraszt 0,0,0 fehéregyensúllyal). Ez ~100 cd/m^2 SDR módban (és így gyakorlatilag nincs ABL), ami bőven sok. A PDP-t ~90 csúcson használtam (és világos weblapokon lehúzott belőle valamennyit az ABL még úgy is, ha meg volt tuningolva). Ha lekapcsolom a lámpát, ez már kicsit erős is (a PDP-vel nem volt gáz lekapcsolni az ABL miatt: nem emlékszem tuning után meddig vágott le, de 68 rémlik teljes képernyős fehérhez).

Amúgy ennyire még nem voltam gondban semmivel, most ezzel az LG - Pio, OLED - PDP monitor kérdéssel. Második hete lesz, hogy naponta háromszor gondolom meg magam, hogy melyik legyen.

-

janos666

nagyúr

válasz

dgyuri0123

#5936

üzenetére

dgyuri0123

#5936

üzenetére

Pár nappal ezelőtt játszottam azzal, hogy feltekertem a Pioneer LX50950H-t csutka 175nit-re és natív színtérre (jócskán DCI-P3 alatti, de Rec709-en azért láthatóan túlnyúló gamut) és egy 3DLUT-on át etettem ugyan azzal a HDR tartalommal, amivel az LG 55C7-et is ("passthrough" módban, megkapta a forrásból a metaadatot, hogy csináljon amit akar -> még nem is tudtam, hogy ennyire érzékeny rá a tone mapping, illetve még a régi firmware-en voltam, ami talán kevésbé volt az, passz), aztán egymás alatt/felett állva nézegettem őket.

Ez az 1000nit-en fényelt The Martian volt. (Végigpörgött az egész film, miközben járkáltam a házban, vagy néha elé is ültem, és a laptopon neteztem, de rá-rá pislogtam a TV-kre.)

Meglepően nagyon hasonlóan nézett ki rajtuk minden olyan jelenet, amiben nem volt semmi feltűnően világos elem (pl. nem nézett bele a kamera egy világító lámpába), illetve ahol volt is, ott is csak a vakító területek néztek ki másképp (a Pio-n beolvasd minden egy nézhető fehér pacába, ami az LG-n vakított, de több geometriai információ volt benne).

Ennek örültem is, mert ez egyrészt azt jelentette, hogy tényleg színhelyes az LG legalább az SDR tartományban (nekem elég jó feltevés, hogy kép ennyire különböző kijelző nem téved egyformán, hanem ha ugyan azt mutatják, akkor az OK), de valamivel többet is tud nyújtani a HDR, mint az SDR.

Csak aztán több filmet is nézegettem, illetve közben frissítettem és újrakalibráltam (amúgy ja, közcélú üzenet: az új firmware-el alapbeállításokon jobb, de a megváltozott "rejtett" paraméterek miatt újra kell kalibrálni az ISF Dark képmódot

), aztán látom, hogy nem mindig fenékig tejfel a HDR sem, mert a Fantastic Beasts (4000nit) például már nem az igazi számomra (még úgy se, hogy a Kuro-t most letámasztottam a sarokba és csak az LG-t nézem, de még nagyjából emlékszem hogy nézett ki a film sima SDR BD-ről).

), aztán látom, hogy nem mindig fenékig tejfel a HDR sem, mert a Fantastic Beasts (4000nit) például már nem az igazi számomra (még úgy se, hogy a Kuro-t most letámasztottam a sarokba és csak az LG-t nézem, de még nagyjából emlékszem hogy nézett ki a film sima SDR BD-ről). -

janos666

nagyúr

válasz

Partizan182

#5899

üzenetére

Partizan182

#5899

üzenetére

Kicsit alaposabban megvizsgálva metadata függő is. Akkor ezért volt az, hogy pl. a Star Trek-be beletekergetve, amit névleges 1000nit-en fényeltek, egyáltalán nem zavart (a mérés alapján nincs is, ami feltűnhetne, teljesen jó), de a Fantastic Beasts-ben, amit 4000-ren, ott már tompának éreztem a sötétebb jeleneteket (és hogy azt lentebb is látni, hogy 94 helyett így már csak 68 nit jön ki, tehát számottevően sötétebb az SDR tartomány, illetve nyilván torzul a tone response is, ami olyasmi, mint SDR készüléken/módban a gamma érték tologatása, ami erősen befolyásolja különböző jelenetek fényességét, kontraszt érzetét...).

Rendere 1000, 4000, 10000 nit csúcsfény metadata (Dynamic Contrast OFF):

Ezt dinamikus kontraszt nélkül egész jól követik a szaturált színek:

-

janos666

nagyúr

válasz

dgyuri0123

#5902

üzenetére

dgyuri0123

#5902

üzenetére

HDR módban egyáltalán nem sok semmi, amit ezek az OLED-ek tudnak.

Ami filmeket eddig néztem, azokat névleges 1000 vagy 4000 csúcsra fényelték, és tényleg van is bennük 700+ tartalom (de nem néztem meg képkockánként, lehet hogy a teljes filmből 10 képkocka, amin 500 fölé megy egy kis folt, és talán oda sem nézel, vagy ez csak a studió logója a film előtt, passz).

Ez elvben azt jelentené, hogy kb. ezt tudja a monitor, amit a studio használ,

tippre szerintem mindig 1000-re kerekítenek, és ahol 1000-ret használnak metaadatnak, ott OLED, ahol 4000-ret, ott LCD monitort használt a studio (és azon belül lehet, hogy valójában mondjuk 870nit a tényleges monitor, mikor névleges 1000-ret adnak meg kerekítve, de ez igazából nem gond, főleg hogy ha 1000 a metadata, az nem jelenti azt, hogy akár csak 500 fölé elmegy bárhol a konkrét tartalom, tehát "mindenki" ugyan azt láthatná elméletben, studioban és otthon is... ELVILEG ...).

... ami azt is jelenti, hogy csak annyira vakít el téged is otthon, mint azt, aki készíti a tartalmat.Ahogy nézelődtem most tesztoldalakon, ez egy trendnek tűnik most több gyártónál, hogy több-kevesebb mértékben eltolják a firmware frissítések a "hard-clip" (abszolút) tone map módtól a "roll off" (tetszőleges egyedi perceptuális) mód felé a tone mapping-et.

Szóval én most az látom, először felült mindenki arra a vonatra, hogy "ezúttal csináljunk mindent úgy, hogy a lehető leginkább ugyan azt lássák a studioban és otthon, amit pedig nem, azt is kezeljük egységesen", de aztán elkezdtek okoskodni, hogy "Mi már az, hogy az OLED-en jobban bebuknak a vakítóan világos területek egy fehér foltba, az LCD-n? Ezt nem lehet!" és inkább eltorzítják össze-vissza mindenhol.

-

janos666

nagyúr

Absolute mapping: minden megy oda, ova való, vagy odacsapódik a legközelebbi pontra. Minden szín, ami megjelenik a forrásban, az vagy 1:1 "helyesen" jelenik meg, vagy jobb híján "beolvad". Ilyenkor csak a nagyon élénk és/vagy nagyon világos színek "sérülnek", amik túllógnak a natív színtéren, amire a készülék képes.

De ne feledjük el, hogy ezeken az LG 7-es szériás OLED-eken minden ilyen szín, ami "kilóg", az már régen sokkal élénkebb/világosabb, mint amire egy Rec709 SDR kijelző képes, tehát már így is több információt kapunk a Rec2020 HDR tartalomból, mint egy Rec709 SDR tartalomból.

Viszont mikor "okos" lesz a gamut mapping, akkor bukjuk a színhelyességet (jelen esetben csak fényerő tekintetben, de ott számottevően) már a Rec709 SDR régióban is, magyarul egy eleve "tompa" (nem túl színes, nem túl világos) jelenet rosszabbul fog kinézni ezen a TV-n, mint egy hagyományos SDR kijelzőn (sötétebb lesz).