Új hozzászólás Aktív témák

-

arcsi84

aktív tag

-

namaste

tag

A CUDA, OpenCL, DX12 egy ideje elérhető, most már a Vulkan is, mind eléggé közvetlen memória hozzáférést biztosít. CUDA kóddal sikerült kimérni a 3.5+0.5GB-ot, a lehetőség adott.

"Jaj azt ne úgy képzeld el, hogy minden négyszer van benne."

Pont ez az ami nem tetszik: egyszer így működik, másszor úgy.Elég sok vörös bundás vérmókus rohangál fel s alá, hát hajrá!

gbors

Beszélünk valamiról, de nem tudjuk honnan indultunk és azt sem tudjuk igaz-e.Mi a keresztirány és mi az "egyenes" irány a különböző GPU-k esetén: GM107 (5 SMM), GM206 (8 SMM), GM204 (16 SMM), GM200 (24 SMM)?

-

namaste

tag

Crossbar: Ez így kevés. Csak te és gbors írjátok, hogy keresztbe felezett sebességű, máshol nem találkoztam vele. A memóriasebességet ki lehetne mérni, elég sokan foglalkoznak GPU programozással (grafika, számítások), valaki biztos belebotlott valami memóriasebesség anomáliába.

Többszörös memória használat: Ha igaz volna, valakinek már találkoznia kellett volna ezzel, óriási botrány lenne. Megint. Egy 4GB kártyára feltöltesz 1GB-nyi adatot és 4GB lett belőle. Ezt képzeld el 3.5GB-os kártyával.

AMD hub: AZ AMD egyszer hubot ír, másszor crossbart. Melyik igaz?

-

Ha nem csal a memóriám, akkor a preferrált backend blokkhoz az SMM clusternek 128-bites busza van, a többihez 64-bites, míg maga a memóriavezérlő szintén 64-bites. Gondolom, a 128-bitnek akkor van értelme, ha a cache-ből jön az adat, hosszan tartó folyamatos olvasás esetén nem kéne szűk keresztmetszetet jelentenie a 64-bites CB-linknek.

Nem tudom, pontosan hogy fest az interleaving-stratégia az egyes adattípusok esetén, de azt nagyobb adattömegek esetén nehezen tudom elképzelni, hogy az egyik backendben van az egész adat, nem pedig szétosztva. Innentől kezdve a duplikálás lehetősége / értelme is kérdőjeles. -

FLATRONW

őstag

Megnéztem én is, így elsőre nem tűnik olyan rossznak. Igaz jelenleg csak belső térben vagyok, de 40-60 fps között megy a játék és simának érzem (minden max, textura: medium, AA: off). Ha valamennyire hinni lehet az Afterburnernek, akkor 200-300 MB-al kevesebb lett a VRAM használat is.

Remélem, hogy külső pályákon is javít majd valamit, főleg úgy hogy még nincs multiadapter (remélem, hogy később ezt is beépítik). -

#85552128

törölt tag

A Strix 980 Ti 1380-as órajele átlagosnak számít, a legnagyobb gyári órajelű kártya meg 1490 fölött megy: MSI GeForce GTX 980 Ti Lightning

Egy kis OC-vel meg 1500 fölé is lehet vinni, na ez már jobban illene az "agyontuningolt" jelző, de megjegyezném, hogy ehhez sem kellett feszültséget emelni...Szerk.:

Az Asus garanciája meg 1291 MHz alapértelmezett módban ha ezt nézzük...

A boost működéséből adódóan meg ettől magasabb lesz (nem kevesebb mint egyeseknél![;]](//cdn.rios.hu/dl/s/v1.gif) ).

). -

TTomax

félisten

Te csak maradj a "garantált" dolgoknál" mi meg majd hajtjuk ami a csövön kifér,procit is vgat is...tehát van a tesztben Fury...

![;]](//cdn.rios.hu/dl/s/v1.gif)

Ui: Nincs azzal semmiféle gond világéletemben igy hajtottam mindent,most is direkt olyan procit vettem ami speed binnelt,megy is a szerencsétlen 4.8GHz-en 24/7 (4930K [link]),sosem voltak stabilitása gondjaim,és mindig jól jöt az a +20-50% teljesítmény amiért egy fillért sem fizettem... igaz nincs ráírva hogy OC dream,meg garanciát sem kapok amivel sokra úgy sem mész...

-

TTomax

félisten

Kit érdekel a gyári tuning????Az én TitanXem megy 1500 felett SLIben...Pont ott lehet megvenni,mint pl a 4,6GHz húzott 4790K-t és barátait,és nincs rájuk írva hogy "OC Dream",nem is reklámozzák, gondolom TE ezért nem találkoztál még ilyesmivel...

"Fury X nincs is a tesztben" ohh wait de Fury szerencsére van... +3%...

(#15060) rupsz

Valamire te igen rosszul emlékszel... 1400 alatt még a refek se nagyon mennek... -

Az MS első akart lenni. Ez valami beteges perverzió lehet náluk.

Tényleg az lehet, mert jelen esetben semmi értelme nem volt. Az elsőségnek akkor van értelme, ha van viszonyítási alapod, akihez képest első vagy. A Hitmannel érdemes elsőnek lenni. Az AotS-sel érdemes elsőnek lenni. Viszont az MS mégis ki a franccal versenyez?

-

TTomax

félisten

A baj az,hogy az egyszeri usereket nem igazán érdeklik a miértek.Nem is igazán kell,hogy érdekelje őket,mert az ö dolguk annyi,hogy kifizessék a vételárat.Az egyszeri usereknek csak annyi jön le az egészből,hogy az első dx12es játék,sz§rul megy az újabb radeonokkal,az egész nyertese a nevető harmadik,aki még több vgat fog eladni,mert bizony az első tesztek komoly marketing nyomokat ejtenek,amit nagyon nehéz feledtetni.

-

TTomax

félisten

Szerintem meg az első dx12es játéknál amit maga az MS adott ki nem vállalható ilyen szintű hiba,ez a mentalitás világosan rávilágit az MS üzletpolitikájára,ahol a hangsuly a PRon van és nem az elvégzett munkán,a dx9 óta egy helyben toporog az api kérdés,a dx10es fiaskót meg ugy gondolják mindenki feledte.Semeddig sem tartott volna betaként kiadni,ez lett volna a helyes és etikus megoldás.

-

#85552128

törölt tag

Attól, hogy megjelenés előtt bejelentették még nem változtat azon, hogy n+1 játék ami nem fut jól AMD-vel, az meg csak bónusz, hogy ez egy DX12-es cím.

De akkor ezentúl már legalább nem megjelenés után derül ki, hanem előre hivatalosan befogják jelenteni és ezzel el lesz intézve, tényleg haladunk... -

velizare

nagyúr

sosem fogom ezt a filózófiát (egy kiteszteld buildbe nyomjunk bele még néhány fixet, azokat teszteljük, és küzben pedig reménykedjünk, hogy nem kúrtunk el vele semmi fontosat) megérteni. baromi nagy kockázatok vannak benne, ennek ellenére az előző munkahelyem már a sokadik cég volt, ahol ezt csinálják.

-

#85552128

törölt tag

Kb. megmutatja az AMD szerepét mint piaci tényező, ha még az MS - az API fejlesztője is hajlandó beáldozni az AMD kártyákat csak azért, hogy első legyen egy remasterrel

De az AMD-nek is hol lehetett az esze amikor hagyta, hogy ez így kikerüljön, inkább futott volna náluk is Async nélkül addig amíg nem sikerül javítani még az is jobb lett volna mint ami most van. -

TTomax

félisten

És ezt hogy nem vették észre?Hisz hibásan fut minden amd vgan,nincs semmi QA osztály az MSnél?Ha ök ekkora hibával kitolják,akkor mit várjunk a többi studiotól?Fogalmazhatok máshogy is,az MS az elsö saját dx12es játékánál,csak pont azt nem csinálta meg és tesztelte le rendesen amtöl igazán dx12...Látod,pontosan ezekröl beszéltem amikor te felhoztad mennyire fog terjedni a dx12,és a fury az életciklusa nagy részét abban tölti le,ez igy volt minden dx váltásnál,egyszerüen időt kell adni,és nem hónapokat hanem éveket.Majd jövőre lesz dx12es játék ahol még érdemes is lesz igazi dx12es kártyát venni,addigra a kepler,maxwell,fiji,mind kuka lesz,ha másért nem a fajlagos teljesitménye miatt...

-

#85552128

törölt tag

A nincs akkora baj a driverrel és szimplán az alkalmazás a hibás kissé ellentétes egymással. Na de majd jövőhéten akkor egyszerre meglesz oldva 3 játék támogatása is

![;]](//cdn.rios.hu/dl/s/v1.gif)

Mondjuk nem is vártam mást, a többségre kitesztelték, a "kisebbség" meg szív, látszik az AO bugon is, hogy abszolút nem teszteltek GCN 1.2 kártyákkal, bár lehet nincs is nekik...

Mindenesetre ott vagyunk ahol eddig, csak driver helyett most driverre és patchre kell várni

Komolyan minek kellett ezt DX12-re kiadni, ha nem értenek hozzá. -

Ugyan a leírtaknak minimális köze van ahhoz, amire válaszként írtad, de ettől függetlenül érdekes

Annyi mindenképpen kiderül belőle, hogy nagyon is foglalkoznak még jópáran a DX11-gyel. Nyilván az AotS esetében senkit nem izgat, mert egyelőre sokkal inkább 3DMarkként tekint rá mindenki, mint játékként. Ill. ha a Vulcan / Mantle renderer használható lesz, akkor valóban nem fog érdekelni senkit a DX11 mód. Kiemelném, hogy "ha"

Az nVidia csőre meg egyrészt szintúgy közömbös, másrészt amit ebbe a dologba beletoltak, az bőven termelt nekik market share-t az elmúlt két évben. Hosszabbra tervezték a termelős periódusát? Tough shit, live with it.

-

Én nem API-kkal játszom, hanem játékokkal. Igen, van már pár játék, ami DX11-ben egészségesebben használja a CPU-t, de nem ez a többség. A DX12-es játékok pedig még mindig "we are nearly there".

(#14770) Habugi: az jó, hogy igyekszel megérteni, de láthatóan nagyon félrement valami. Senki nem beszél arról, hogy a mának kell élni, meg a "ma ereje", pusztán arról van szó, hogy felhasználóként az érdekel, hogy amivel jellemzően játszani akarok (VGA igényes cuccok legnagyobb százalékban 2013 és 2016Q1 között, tehát 1-2 hónap előretekintés belefér), az mit produkál. A 3+ hónap múlva érkező játékokban nyújtott teoretikus teljesítmény az elemző feliratú sapkámban nagyon érdekes, ellenben vásárlóként lesz**om. Szerintem sokkal inkább az a probléma, hogy sokan ezt a két szempontot nem tudjátok elkülöníteni.

(btw. nekem nem hármassal kezdődik az életkorom... már nem ).

). -

Ja, ja, ugyanaz, "csak". Kevés mag mellett "csak" 50%-kal "más" a teljesítmény, több mag mellett pedig "csak" 100%-kal. Említésre is alig méltó, right?

Teljesen mindegy, mit dob ki a magyarázatgyártó gép, ezen a téren trehány volt az AMD, és jópár játékban nVidiával jobb a játékélmény. Hogy erre az AMD megoldása nem a DX11 driver optimalizálása, hanem a DX12, az nekem teljesen OK - ennek viszont sajna van egy "kevés" átfutása. Tudod, egy csomóan itt még mindig ma játszunk, nem holnapután

(#14759) Laja333: azok nem FPS-ek, hanem a DX11-es path relatív teljesítménye a DX12-eshez adott CPU mellett. Gyorsabb CPU-val nagyobb a gap a DX12 javára.

-

imi123

őstag

Ha nem működik valami akkor miért kell kiadni?

Az a baj hogy az ilyen hülye húzásokkal negatív reklámot csinálnak a DX12-nek és a Win 10-nek is.Örökérvényű Bendegúz mondás hogy "az a baj hogy nem a tehénpásztorok irányítják a világot"

Azért a pénzért amit az MS fejesei kapnak ilyen teljesítményt nyújtani... -

Habugi

addikt

Erre értettem nyilván a nap állásának esetleges változását/különbségét de ha megnézed a korábbi, pl FC4-es tesztjeiket, kínosan ügyeltek rá mindig hogy ez ne fordulhasson elő, mindig "fixált" helyzetekben mértek vagy innen indultak, emlékezz pl az autós részre..

Kvázi ha egy adott mentést töltöttek be vagy teszem azt a sztory indulása után járták be adott útvonalat akkor marhára nem kéne máshol állnia a napnak.

Kétlem hogy felvették az egyikkel, visszasétáltak, elmentették VGA-t cseréltek majd onnan folytatták, korábban sosem vétettek ilyen hibát.

Szerintem itt vagy véletlen nem azonos beállításon teszteltek vagy egyikkel-másikkal nem vette be a játék az Applyt, tudom is én..

A tévedés jogát persze fenntartom. -

#85552128

törölt tag

"Az AotS-hez készült press driverbe belekerült csak az még nem publikus."

Én örülök ezeknek a belső infóknak, mindig érdekesek számomra. De megint csak azt tudom mondani, hogy ettől még nem lesz előrébb a "pórnép" aki csak a public drivereket éri el...

Amúgy már március, lassan ideje lenne egy WHQL-nek is, elvégre jobb támogatást és több driver releaset ígértek, csak úgy mondom...

Minden elsimerésem az MS-nek, ehhez a grafikához [link] ilyen gépigényt társítani nem lehetett egyszerű feladat.

-

#85552128

törölt tag

Mit akarsz ezzel mondani ? Mert attól, hogy próbálod kimagyarázni az eredményen nem változtat, ugyanúgy szívás van mint eddig szinte minden launchnál és nem, nincs benne Gameworks sem...

"A multi-engine kódhoz kell egy újabb meghajtó, ha a GPU GCN2 vagy GCN3"

Ja értem, gondolom az AOTS túl nagy falat volt nekik azért nem került bele a múltheti driverbe, de várjuk akkor megint a csodadrivert (ismerős helyzet

![;]](//cdn.rios.hu/dl/s/v1.gif) )

) -

Abu85

HÁZIGAZDA

Annyit hozzátennék, hogy amikor az MS arról beszélt, hogy a DX12-es Xbox One kód PC-re hordozható, akkor az igaz, de itt kifejezetten a DX12-n van a hangsúly. Ugyanakkor az Xbox One rendelkezik egy mono eléréssel, ami tulajdonképpen kizárja az Xbox One operációs rendszerének memóriamenedzsmentjét, illetve a WDDM 2.0-t is. Ilyen formában gyakorlatilag az alkalmazás ~5,2-5,4 GB (ezt nem tudom egészen pontosan mennyi) memóriaterület felett direkten rendelkezhet. Tehát allokálhat területeteket, ezek menedzselését az OS nélkül kezelheti, akár defragmentálhat is, ha elég jó a rendszer, illetve az IGP memóriaelérése is teljesen közvetlen.

(#14511) imi123: Szerintem az MS ezt a motort használja majd arra is. Valószínűleg ezért készítik el ezt az újra kiadást, hogy teszteljék az alapot.

-

Petykemano

veterán

a preempció problémájára legalábbis hardveres tekintetben nem lenne megoldás az Nvidia részéről is egy dual GPU-s megoldás, ahol az egyik GPU számolná a képkockát, a másik meg ügyelne, hogy ha az új jelenet lekérné az időablakot, akkor kitegye a fejmozgás miatti új képkockát?

-

#85552128

törölt tag

Egy MMO azért elég máshogy működik, főleg a wow, aminél 10+ év alatt muszáj volt fejleszteni mást is.

4-5 évig ez a játék nem fog fennmaradni, ezt már a béta alapján megmondom, haa feléig1 évig sikerül aktívan tartani a játékot már "siker" lesz

Ha meg évről évre meg fog újulni akkor a "Full experience" pack pontosan mit is takar (mert a jelenlegiek alapján csak az éven megjelenő tartalmakat...) ? Évente meg kell majd venni mint egy season passt ? Mert kétlem, hogy egyszeri 50€-ért évekig fejlesztenék tartalmat hozzá...

-

#85552128

törölt tag

"A játék az elkövetkező hónapokban is fog fejlődni, ahogy jönnek hozzá a tartalmak. A megjelenésre kiadandó kód egy alap annak érdekében, hogy számos effektet hozzáadhassanak az év során."

Nekem ez nem kész produktum. Se tartalmilag, sem pedig technikailag nem nevezhető annak.

Attól, hogy hivatalosan nem early accessbe került, még nem sok választja el azoktól a játékoktól... -

TTomax

félisten

A GPUOpen,várj csak te nem olvasol Abu85öt a prohardveren?Hiszen azt az AMD hozta el,hogy megmentse a pc gaminget a végzettől.

Mert hát ez az a motor ami majd ugye konzolon is használja végre a low level apit ugye? [link],mert majd erre épül a deus ex is igaz?Végül is akkor minek is írni normális dx11es kódot,hiszen így majd a normálisan megírt dx12es majd azt lehet mondani mennyivel jobb ez nekünk igaz?Mert hát így kell megírni egy Dx11-es játékot,ha jobbra fordulsz 85fps,ha meg balra akkor meg 45... [link].Az a baj az egésszel hogy az előző részt még meg tudták írni normálisan,ott ilyen nem volt...és még jobban is nézett ki.Ez amit kihoztak itt nekünk betaként még egy alfa szintjét sem nagyon éri el...valahogy demonstrálni kell,hogy mitől is jó a dx11,csak picit kilóg a lóláb az én gyomrom nehezen emészti,de akinek tetszik lelke rajta. -

mlinus

őstag

Te mindig ezt mondod, de a valóságban meg egyre többen nyitnak a PC fele, egyre több a japán játék is, ami már a konzolverzióval egy időben jelenik meg, a Microsoftnak pedig lassan csak a Forza marad exkluzív címnek az xboxon.

Azt pedig elhiszem hogy milyen fasza ezekre a konzolkra programozni, de a gyakorlatban ez nem mutatkozik meg. A fentebb említett Dying Light mellett, tessék Hitman PS4 . 60-ról 20-ra leeső fps, bravo.

-

daveoff

veterán

Ha már a témánál vagyunk...

Digital Foundry vs Dying Light: The FollowingTechland's Enhanced Edition is brilliant on PC, but consoles suffer from presentation and performance issues.

PC: By far the best way to play Dying Light

-

daveoff

veterán

A játék megjelenése után kb egy héttel jött a patch, ami már akkor elég jól helyre rakta a teljesítményt, szóval nem vágom miről beszéltek. Gondolom ezzel a játékkal is rengeteget játszottál. Az meg hogy egy év alatt ilyen jól optimalizálják, az nem egyedi eset, ez megszokott folyamat. Örüljünk hogy ennyit foglalkoztak a PC-s porttal. Gondolom kiadhatták volna így is, csak mégsem tették...

-

imi123

őstag

Érdekes hozzá állás.

Adott a lehetőség a minél gyorsabb portolára és a bonyolultabbat választják.

Gondolom ezután is külön cég portolja a Pc-s verziókat.Ugye az most nem komoly hogy házon belül nem osztják meg a tapasztalatokat,kódokat.

Ha így van akkor ugyan ott vagyunk ahol voltnuk. -

-

#85552128

törölt tag

Nem arról van szó, hogy mi szükséges, hanem arról, hogy a piros csúcshardver képtelen így futtatni, mert kevés rajta a vram.

"Eközben simán portolható az Xbox One-ról az alkalmazás, mert ott a Windows 10-en a WDDM 2.0."

Olyan simán hogy inkább vették az Xbox 360-as portot és azt vitték PC-re ?

"ez a program sokkal kisebb erőforrásigénnyel is működőképes lenne, ha nem Xbox 360-ról portoltál volna"

De nem abból portolták. Nem a "Mi lett volna ha..." a lényeg, hanem a jelen.

"Orbitális baromság, hogy neked kell egy 300K-s VGA ereje."

Nem kell, ott van a 390, 100-ért ha csak a textúrákat nézem azokhoz biztos elég, jobban mint a dupla ennyibe kerülő Fury.

És AMD-ből még az sem elég... Szimplán sikerült nekik megint túl optimistán szemlélni a dolgokat és nem jött össze, 1 hónappal ezelőtt még te is azt mondtad, hogy DX12 + W10 exkluzív lesz. -

#85552128

törölt tag

De te mikor érted már meg, hogy ma még szükség van rá ? Nem konzolról van szó, hanem a PC-ről. Majd ha áthozzák azokat a dolgokat akkor lehet azokhoz az igényekhez hardvert fejleszteni, addig meg szem előtt kéne tartani azt is ami _jelenleg_ szükséges.

Kevés a TR PC-s portjának (normális futásához) a 4 GB - igen, jobban fut több VRAM-mal - igen, nincs miről beszélni, szokás szerint beszélhetsz mellé, hogy ez meg az van, de ettől még a helyzet nem változik... Ismét +1 érv a 980 Ti-nek.

-

#85552128

törölt tag

Vagy nem 4 gigát kellett volna rakni egy csúcskártyára és nem lenne semmi probléma, mert "erőből" elvinné, nézőpont kérdése, mert a 390 és 980 Ti tulajok szerint is nekik jól fut Vhigh textúrákkal.

Az meg, hogy mit kellett volna portolni és hasonló kifogások most már lényegtelenek és nem változtatnak azon, hogy ezt a játékot így ahogy van limitálja a 4 GB VRAM és nem úgy néz ki, hogy ez a közeljövőben változna.Ugyanúgy "szenved" a Fiji a 4 GB miatt mint a 970 a 3.5 GB miatt

-

#85552128

törölt tag

Azok a shaderek csak a 4 GB-s kártyán voltak problémásak a 8 GB-s 390 már akkor is stabilabban teljesített.

És nem változott semmi, 4 GB-s Fiji kártyával a játék játszhatatlan Vhigh textúrával. Az, hogy ilyen a memóriakezelés egy dolog (más játéknál eddig csak azért nem jött elő mert alacsonyabb felbontású textúrákat használtak), az AMD nagyon jól tudta mire számíthat mikor 4 GB-s csúcskártyát adott ki... -

#85552128

törölt tag

Mégis nem először láttuk már, hogy a 4 GB-s 980 jobban elvan ugyanannyi memóriával mint a 4 GB-s Nano/Fury/X.

A legutóbbi PCperes TR teszt is ezt bizonyítja.Egyébként meg az AMD is rárakta a 8 gigát a 390-ekre úgyhogy nincs miről beszélni ha megteheti mindkét gyártó megteszi, csak ez ugye a HBM-nél nem játszott. Sőt mindig is több memóriát raktak a kártyáikra mint a konkurencia, csak akkor kezdtek "takarékoskodni" amikor már rá voltak szorulva - a konkurencia meg nincs...

-

MiklosSaS

nagyúr

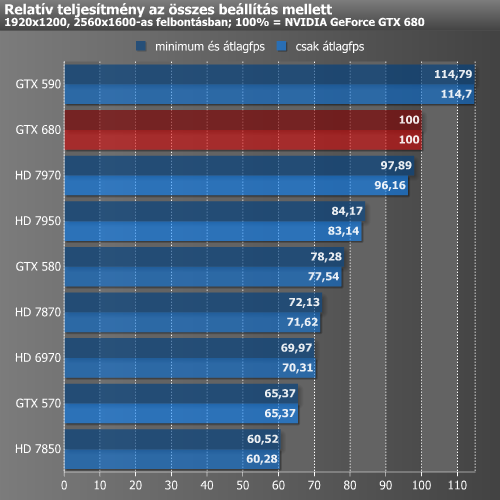

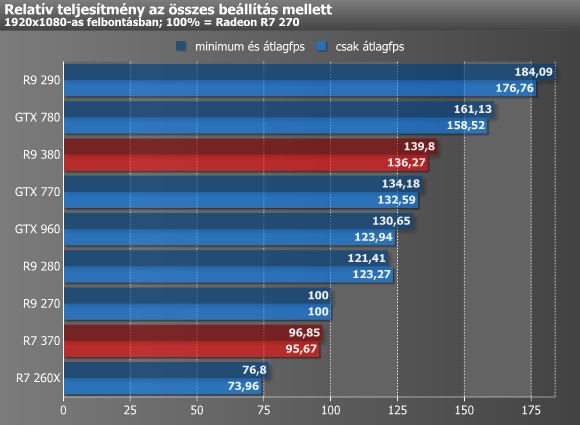

Pedig erdekes dolog. Ugyebar a 380 az egy 285, a 380X az egy 7970 GHz. A 680 anno a 7970-nek volt az ellenfele, ami picivel gyengebb volt a 7970 GHz-tol es picivel erosebb a sima 7970-tol.

Ergo jol lehet latni hogy az AMD kartyak kicsit erosodnek, az NV meg hereli alaposan driverbol. Mivel most a 380 erosebb mint a GTX 770

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Telekom otthoni szolgáltatások (TV, internet, telefon)

- Viccrovat

- Itt a Galaxy S26 széria: az Ultra fejlődött, a másik kettő alig

- Borderlands 4

- Eredeti játékok OFF topik

- Milyen légkondit a lakásba?

- Apple iPhone 17 - alap

- Multimédiás / PC-s hangfalszettek (2.0, 2.1, 5.1)

- The Division 2 (PC, XO, PS4)

- Yettel topik

- További aktív témák...

- AKCIÓ! AMD Ryzen 9 7950X 16 mag 32 szál processzor garanciával hibátlan működéssel

- Corsair VENGEANCE Pro 32GB (4x8GB) DDR4 2800MHz

- Lenovo IdeaPad Slim 3 Ryzen 7 8840HS 15" FHD+ 24GB 1000GB Teljeskörű garancia

- BESZÁMÍTÁS! Intel Core i9 9900K 8 mag 16 szál processzor garanciával hibátlan működéssel

- GYÖNYÖRŰ iPhone 15 Pro Max 256GB White Titanium -1 ÉV GARANCIA - Kártyafüggetlen, MS4694

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

Aki ennyiért vesz egy ilyen szutykot, az tényleg nem normális....

Aki ennyiért vesz egy ilyen szutykot, az tényleg nem normális....