Új hozzászólás Aktív témák

-

GeryFlash

veterán

Jelenleg ott vagyunk hogy nem hogy gyalazas nem lett de konkretan ugyanott van a 7950X3D mint a 13900KS, 5% difik vannak hol az egyiknek hol a masiknak a javara. Mindezt ugy hogy a 7950X3D 700 dollar a 13900KS meg 580 dollar. De legalabb a motherboard olcso az AMD-hez

Hihetetlen hogy 3D cache-sel, 2 szinttel jobb gyartastechnolgiaval is ennyire futja. Azert en meg bizok a szoftveres fixekben, mert ez nagyon elmaradt eddig minden varakozastol. -

FLATRONW

őstag

Szerintem nem. A konzoloknak is nagy előnyük, hogy egy konfigra megy a fejlesztés.

A fejlesztők letesztelik néhány népszerű összeállításon, hibátlan szoftveres háttér mellett a játékukat.

Viszont jóval nagyobb részük van a hibátlan futtatásban a gyártóknak. Egy stabil drivert kell letenni az asztalra, ami minél kevesebb dologgal akad össze. Itt pedig nagy "hátrány" a nagy piaci részesedés. -

Busterftw

nagyúr

16 jatek average-ban kb hibahataron beluli 3-5 fps kulonbseg van.

Azt mar nem emlitem meg, hogy csucsot csuccsal illik osszehasonlitani, ami ugye nem a 4080, hanem a 4090.

Illetve mi ertelme beerni az Nvidiat, ha ilyen orbitalis bugok vannak jatekokban?

Mert ez az user vesz egyet, par jatekban ilyen gany hibak vannak es garantalom neked lecsereli kovetkezore egy Nvidiara. Topikbol van tobb pelda, vagy jatek, vagy driver vagy VR miatt."tehát PC-re Nv-n..."

Erdekes, Abu anno epp azt mondta, hogy kb mindenki Radeonon fejleszt. Illetve RDNA-n, hiszen konzol is kepben van. -

PuMbA

titán

De ilyenje az NVIDIA-nak is van: NVIDIA Nsight Graphics

Ha legörgetsz, akkor ott van pont egy Unreal Engine-es példa is a Hellblade: Senua's Sacrifice személyében.

Ha legörgetsz, akkor ott van pont egy Unreal Engine-es példa is a Hellblade: Senua's Sacrifice személyében. -

Busterftw

nagyúr

Nem csak, hogy jobb kod szulessen:

"elsődlegesen az az előnye, hogy a RenderDoc és a Radeon GPU Profiler együtt fejlődik, és egymáshoz vannak írva. Ilyen formában a fejlesztők számára nagyságrendekkel könnyebb Radeonon fejleszteni, mert van egy debug eszköz, ami tökre jól használható a Radeon profilozójával"

"Tehát ha találsz egy problémát, akkor egy kattintás azt leellenőrizni az AMD profilozójában."Aztan valamiert megis Nvidian fut altalnossagban gyorsabban valami es/vagy kevesebb problemaval. Ha meg hiba van, akkor gyorsabban jon Nvidiatol/fejslztotol megoldas.

-

PuMbA

titán

-

Azért lettek egymásra szabva mert ez egy Microsoft szabvány és Nvidia ehhez tervezte a hardvert. Microsoft kiadta az alapjait és a gyártókra bízta ehhez a hardverek fejlesztését.

Az hogy ez mennyi hibát és rugalmasságot tartalmaz nem tudom, biztos keveset.

Majd évek alatt csiszolódik ezt mutatják a a folyamatosan érkező fejlesztések.

Mi nem került bele? ezt nem értem..

A konzolok az az Xbox lehet maximum és azon belül is a PC + Microsoft címek, mert a Ps nem DXR alapú RT-t használ egyértelműen. Ezért kerül átdolgozásra minden konzol port Pc re kiadás elött..két dolgot árulj el nekem.

első:

Nvidiának mennyiből tartana elhagyni a fixfunkciós részegségeket ( ez kb 7- 10 % amik RT re vannak szánva) és mit nyerne /veszítene azzal ha elhagyná?

Vagy azok mellett miért ne menne rajtuk bármilyen általános RT? hisz szinte az összes RT eljárás amit beemelnek kompatibilis a többi gyártóval....vagy szerinted az Ada-n -Turingon- Amperen nem menne egy általános DXR -t támogató eljárás? Miért ne menne? A IC nincs használva RT re még AMD címeknél sem ,mert nem arra való, hogy BVH-t operáljanak vele. Raszterben erős az Nvidia is , sávszél pedig van rajtuk, a nagy L2 elméletileg ezen segít az Ada-nál.

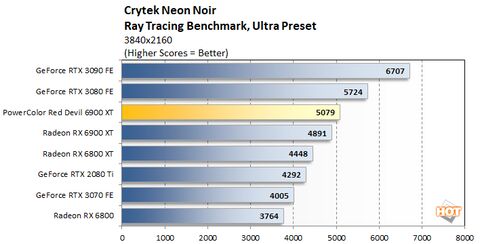

Crytek féle SVOGI ban a Turing széjjel verte a konkurenciát, és az Ampere sem lassult le pedig itt nincs RT mag használva állítólag, kizárólag az AMD gyorsabb tőle de Nvidia nem lassabb vagy kerül az AMD mögé. Ez egy általános eljárás mindenen is fut..

A második:

Azt áruld el nekem ismét leírva már 3x hogy az Intelnél ugyan olyan jól megy a raytracing azonos raszterképességű kártyákon és RX 7000 is sokat fejlődött azokban a címekben amiknél a 6000 gyengélkedik. Hogy lehetséges ez hogy pusztán hardveres fejlesztéssel a szerinted Nvidiára szabott játékokban ennyit gyorsult az AMD és Intel gyorsabb mint az Nvidia? .

igen egymásra vannak szabva az RTX kártyáka DXR hez nem pedig a DXR az RTX hez ez látszik ,hogy pusztán pár hardveres fejlesztéssel beérhető az Nvidia, de annyi hogy AMD lemaradásban volt ezzel 1,5 generációval és most már azt vizionálod hogy hátráltatva vannak, miközben Nvidia már a 3. generációt adja ki DXR re és folyamatosan támogatja általános eljárásokkal amik mennek az összes gyártó kártyáin. . -

PuMbA

titán

Itt az lesz a kérdés megint, hogy kié lesz jobb megoldás és ha a megoldás jó, akkor ki készül el gyorsabban. Az AMD RT API-ja is még idő mire elkészül és az NVIDIA is dolgozik a témán, ahogy írtad is a Micro Mesh-sel például. Ezen kívül ugye az RTXDI-jal, ami a mostani néhány fényes limitet feldolja a DXR keretein belül és AMD-vel is kompatibilis. Ezt a Cyberpunk 2077-ben láthatjuk ez évben, tehát az NVIDIA úgy néz ki az első gyorsítást elhozza nekünk.

-

Az RTX remix AI-t és annak maximális tudását reklámozták vele a modderek részére,de ezt már akkor is lenyilatkozták. [link]

[link] Mi másért nyúlnának hozzá egy 10 éves játékhoz amit amúgy 3.9 euroért frissíthettél ha megvolt ? Miben befolyásolná ez a konkurenciát?

Miben befolyásolná ez a konkurenciát?

igen ezek a limitek a két kártya tudás között léteznek. -

Petykemano

veterán

> L2 miért nem egészen ugyanaz

Nem ugyanaz a funkciójuk, ok. Akkor azt mondod, hogy a ez a compute shaderen futó bejárás azért nem működne jól a méretében közel ugyanakkora L2$-sel rendelkező Nvidia kártyán, mint a GPU cache rendszertől némileg távolságot tartó L3 victim cache-től eltérően, mert utóbbit nem szemeteli tele.

Hát nem tudom. Nem állítom, hogy ne lehetne oylan felhasználási módot találni, amire az egyik jó, de a másik elvérzik tőle, de az eddigiek alapján eléggé kiegyenlítettnek tűnik a meccs.Lehet, hogy ez lesz az első use-case, amin az Nvidia féle L2$ elhasalna, de ha szerinted úgyis implementálják a DXR-féle utat is, akkor igazából mindegy.

-

gV

őstag

2080 100%-on tekerve csak ~155W-ot fogyaszt Portal RTX alatt. míg más játékokban 200+W szóval limitbe a Turing is belefut csak közben még így is játszható vele. most haragudhatnék az nV-re, mert jaj mi ez már, de inkább örülök annak, hogy a 4+ éves már megjelenésekor leírt (pl 720p [link]) uarch még mindig használható és nem kellett visszavennem semmit, csak a szokásos qDLSS-t pDLSS-re állítani. persze volt amikor csak 25fps volt (13. teszt egy pontján), de a Reflex tette a dolgát. nekem nagyszerű élmény volt ilyen pompában végigjátszani újra egy klasszikust.

és ezt az nV-nek köszönhetem.

és ezt az nV-nek köszönhetem. -

PuMbA

titán

Amúgy érdekes, hogy a Witcher 3 cikkben az van írva, hogy DLSS-sel részletesebb a kép, mint natívban:

"When using DLSS, the image was stable in motion in Quality modes, the level of detail rendered in vegetation and tree leaves is greatly improved in comparison to the in-game TAA solution, and small details in the distance, such as fishing nets or thin steel objects, are rendered more correctly and completely."

Valami nem passzol itt, mert a képeken tényleg az ellenkezője látszik.

-

Petykemano

veterán

> Ami miatt hatékonyabban gyorsítótárazható is lesz egyből a BVH struktúra.

Ha csak az AMD rendelkezne nagy méretű cache-sel, akkor érteném, de az Nvidia behozta a lemaradását az L2$ méretének megnövelésével.> Mivel Nv-n egyből ugrik a kötött fixfunkciós egységek használhatósága ekkor.

Ez alapján nagyjából olyan erősorrendnek kéne kialakulnia kb, mint RT mód nélkül, nem?

> Én arra számítok, az AMD mód jól fog futni, míg az Nv-re jönni fog egy hagyományos DXR alapú módMiért gondolod, hogy egy olyan játékban, ahol megcsinálják ezt a programozhatóságot, fognak még foglalkozni azzal is, hogy az Nvidia által prefereált de hardveres erőforrásokban pazarlóbb DXR irányt is implementálják, hacsaknem jár az egyébként komoly teljesítményelőnnyel - persze megfelelő VRAM kapacitás mellett?

-

Petykemano

veterán

> Érdekes lesz a Snowdrop2 is az AMD RT megoldásával.

Úgymond, nem lesz semmi.

Abu leírása alapján én azt szűrtem le, hogy a programozható eljárás abban segít, hogy ne legyen olyan nagy VRAM igénye az eljárásnak. Ebből ugyanúgy profitálhat majd AMD és NVidia kártya is. Elképzelhető, hogy mivel programozott, ezért az Nvidia fixfunkciós hardverei kevésbé/nem lesznek használhatók hozzá. Ez alapján talán egy hardvergyártók szempontjából kiegyensúlyozottabb RT teljesítmény jöhet ki.A "Semmi"-t tehát úgy kell értelmezni, hogy lehet, hogy szoftvertechnológia szempontjából egy hatékonyabb eljárás lesz, mint az NVidia által preferált mód, de mivel többletmunkával jár, ezért idővel ez is bekerül majd más "optimalizáció" jellegű kuriózumok sorába és mivel nem valószínű, hogy itt/emiatt az AMD átvenné az RT teljesítményben a dominanciát, ezért ez egy újabb ok lesz gúnyolódni azon, hogy "Abu technológia blablával ígérte, hogy az AMD átveszi a vezetést és nem lett belőle semmi" (miközben abu csak annyit mondott, hogy ez az eljárás hatékonyabb és az AMD emiatt ezt tartaná követendőnek)

-

Busterftw

nagyúr

-

gejala

őstag

A 2.5.1 DLSS frissítés nagyon jó lett, már nincs élesítés se benne, ghosting minimális. Hogwarts Legacyban kb semmi különbséget nem látok 1440p quality és natív között. Viszont ha kikapcsolom, jó pár beállítást lejjebb kellene venni, de így nem.

A 2.3.x meg 2.4.x branch nagyon homály volt, de most már mindent javítottak.

-

Jatekok alatt azért nem. És az 5700 XT mivel vív ádáz harcot?

A portal az a jaték ami arra világít rá ha ki lenne használva a hardver akkor mit tudna az Ada mennyire lehetne megterhelni.kb 9x gyorsabb elmeletileg mint a 7900 XT RT ben.Ahogy irtad is egy techdemo.De azert van benne az options fulecske, hogy menjen Turingon is lazabbra véve.

Az intel az ARC cal jol megy RT cimekben minden hokuszpok nelkul. -

Kissé elfogult vagy az AMD felé. Abu sok mindent leírt már aztán fele sem igaz.

Baromi unalmas már ez az AMD fanatik szarság amiben az gondoljátok hogy AMD mindig mindenben jobb csak a körülmények áldozata és ez miatt és az tart itt ahol tart és persze RT ben is sokkal jobb lenne csak nincs kihasználva a "programozható bejárás" amit Nvidia amúgy Nvidia meg smafu csak vannak a világban semmit nem tudnak ezekről a dolgokról, de kár hogy Abu nem szól nekik hogy lenne jó RT re hardvert tervezni, mennyivel jobb lenne neki az Nvidiánál hardvertervező mérnökként mint itt a PH-n kibic cikkírónak lenni...Atyavilág, ne már..

ugyan ez az Abu írta 3 éve hogy a DXr 1.1 [link]megváltja a világot és leváltja a szar DXr megoldást és ez már minden is sokkal jobb lesz. és az új hardverekkel idézet tőle " drámaian jobb lesz" a

A másik remek komment 2 évvel ezelöttről

[link]

és a mostani hardverek gyakorlatilag halottak ( lásd Turing kukázása ) és előröl kell kezdeni minden hardver és szoftver fejlesztést.

Abu egy elfogult ember és soha nem fogtok tőle pártatlan véleményt kapni formálja az egész PH-t és a fórumot a saját elképzeléseihez. Szomorú hogy nem láttok át ezen. -

gV

őstag

ha csak beállt volna akkor kevesebbe kerülnének mint amennyibe most kerülnek és amíg nem jöttek addig simán csak túlárazott volt a 4080, a 7900 megjelenésével viszont "jó" ára lett

majd ha jön ilyen és engem is érdekel, akkor lesz valami az amd oldalán, de amíg nincs ilyen marad az, hogy van ami 4080-al megy 7900-al nem

én viszont használom, mert amit látok tetszik.

-

Amúgy a hiba, a keretgenerálás bekapcsolódása a játék menüjének a hibája volt,írta aztán HU, mielőtt elkezdődne a zöld gyíkemberek üldözése.[link]

CB szerintem megint a legjobb tesztet hozza le. Fordítóval németből :[link]

"

A Roxfort Legacy sok grafikus kártya memóriát igényel a textúra maximális részletezéséhez. Pontosabban, ez az első olyan játék a szerkesztőség tesztjében, amely csak 16 GB VRAM-tól működik minden helyzetben probléma nélkül. Még 12 GB esetén is el kell fogadnia a korlátozásokat. Pl. a GeForce RTX 4070 Ti-nek nincs teljesítményproblémája Ultra HD és DLSS minőségben egyébként teljes grafikai minőség mellett, de egyes objektumoknál nem töltődnek be a textúrák, mások rövid időre teljesen eltűnnek, mivel valószínűleg próbálkozik a motor. hogy valahogy megmentsék a helyzetet. Sugárkövetés nélkül 12 GB-tal is működik. 10 GB már sugárkövetés nélkül sem elég DLSS-sel, megfelelő képkockasebesség mellett. Ha a grafikus kártya csak 8 GB-os, WQHD-n, beleértve a DLSS-t is, már sugárkövetés nélkül is láthatóak a kopás jelei, és még Full HD-ben is hiányzik egyik-másik textúra játék közben. Végül a 8 GB és a maximális textúrák nem lehetségesek."

Plusz azt írják több helyen, a játék valamiért egyes CPU kat nem szeret és ütemezési gondokkal küzd, extra módon megterheli az első 4 magot. -

Petykemano

veterán

"Elég káros, amikor óriási meggyőződéssel állít butaságokat valós állítások közé keverve, ráadásul "emberi nyelvezeten". Az esetleges rossz szándékú manipulációk lehetőségét nem is említve....

Persze, ugyanez a veszély fennáll a hagyományos internet/keresők esetében is, de sokkal jobban ellenőrizhető a forrás, mint az Ai-chat esetén."Különös, ezt mintha én mondtam volna. Mondtam is, de asszem nem ezen a fórumon. Csak meglepődtem, mennyire ugyanezt gondolom. Eszembe is jutott Rehoboam, meg a Westworld. Szürreális lehet real life visszahallani a gondolataidat mástól, amit azért tudnak előrejelezni, mert a múltad teljes ismeretével párhuzamos szimulációkban gyorsabban előrejelezhető vagy, mint a saját kémiai neurontranszmittereid.

-

Csupingo

veterán

Az a tény engem nem nyugtat meg, ha jól tudom, gyakran bányászatnál üveghangon izzadnak a memóriák. Több kép is kering a neten, ahol jól látszik, hogy megbarnult, megfeketedett a nyák a memóriák környékén, mert annyira melegedtek.

Aztán meg elég benézni az rx topikba, ahol a bányászat elején nagyon népszerű kártyák új tulajdonosai panaszkodnak. Legegyszerűbb eset: nem lehet drivert telepíteni, 43-as hibakód, mert a kedves eladó a fáradtságot se vette, hogy visszategye az eredeti biost. Durvább esetek: két hét, 1 hónap után meghal a memória a kártyán az új tulajnál. Ez akkor a legfájóbb, ha garancia nélkül vetted, jobb esetben 1 hét próbagarival. -

-

Yutani

nagyúr

Nem felejtettem el, mert nekem nem volt gondom az RX 5700-zal. Rajt után 3 hónappal vettem és használtam több mint 1 évig, és csak kijelző gondom volt (a monitor DP-DVI átalakítója mellé aktív DP-HDMI átalakító kellett a TV-hez), más nem. Persze, hallottam, hogy másnál vannak gondok, de érdekes módon ez elkerült engem.

#45945 imi123: Akkor ez úgy történhetett, hogy fél évvel a start előtt hátradőltek, mondván kész a cucc, majd 1 héttel a release előtt: Ugye, minden rendben a kártyával...? Ób@57dmeg!!!

-

Petykemano

veterán

"Persze, nem lehetetlen, hogy idővel ez változzon, de azért van bennem nagy adag szkeptikusság ezzel kapcsolatban."

Ez akkor fog változni, ha kapcsolat létesül a CCX-ek között.

Ez megvalósulhat úgy is, hogy összeolvad/összeköthetővé válik az L3$ (már ami megmarad belőle, mert elég valószínű, hogy az SRAM-okat kiemelik 3D tokozásra)

De megvalósulhatna akár egy IOD alá/fölé pakolt L4$ módján is.A szkeptikusság jogos.

"Egyébként a tesztben arra jutottak, nem az tűnik a bajnak, hogy erős CPU kellene alá, hanem hogy kevés magra összpontosul a terhelés, és valami más baj is van, mert ugyanazt az RT nélküli képvilágot a DX11 mód lényegesen magasabb FPS-el hozza. Ebből az látszik, inkább a kódbázison lenne még tennivaló a motorban."

Ebben az esetben tulajdonképpen a kérdés tárgytalan.

És ha a limit valóban

- ST terhelés eredménye

- ami nem egy könnyen javítható bug eredménye, hanem ilyen felépítésű a motor és kész

akkor azon lehet, hogy megint sokat segít majd a Zen4 3D -

paprobert

őstag

CF/SLI esetében a frametime konzisztenciával komoly gondok voltak. Ha leátlagoltad Excel-ben, akkor működött, viszont amikor használtad, bizony, akadozott.

A DLSS3-ra azt mondja Alex, hogy kisimult tőle a játék. Innentől kezdve nehéz azt mondani rá, hogy átverés.

Ráadásul az 55 ->110 fps-re duplázás már a DLSS3 sweetspot-ba esik. Egy 30-ról 60-ra duplázás viszont artifactelne, ott értem az aggodalmadat.Ez azt is jelenti, hogy a R5 3600-at ebben a játékban a DLSS3 sem nagyon menti meg a nehéz helyzetekben, illetve csak nagyon nagy jóindulattal, hunyorítva.

-

Yutani

nagyúr

Abu írt olyasmit, hogy korábban csak egy átlag GPU hőmérsékletet kaptunk, amihez képest a hotspot lehetett sokkal melegebb is, de nem tudtunk róla, mert nem volt külön monitorozható. A Navi10-nél jött a monitorozható hotspot, ami a GPU egy olyan része, ami a legjobban melegszik, és az ott lévő szenzor adatait lehet kiolvasni publikusan is.

Biztos vagyok benne, hogy előtte nem volt ilyen hotspot, mivel előtte nem volt közfelháborodás a 110°C tJunction miatt. Ha más nem is, de ez az egy biztos.

-

Raymond

titán

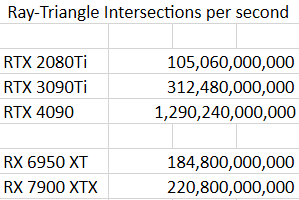

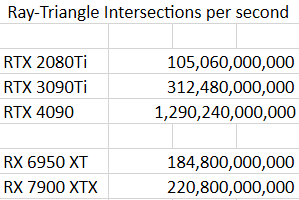

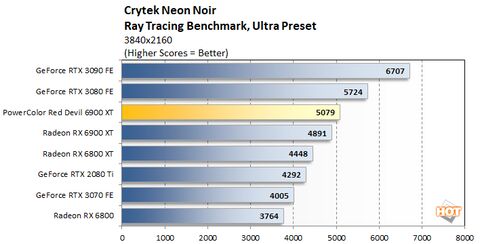

Pedig a linkelt cikk elmagyarazza. Ne a 6900XT-re koncentralj az eredmenyeknel, nezd meg a Turing es az Ampere aranyat. Itt a 2080Ti a sima 3060 szintjen van, pedig az eddigi jatekoknal ez a 3070 es a 3070Ti kozotti szinten volt. Itt sokkal nagyobb a teher az RT kepessegekre igy az Ampere es az Ada elonye jobban latszik.

-

Mivel nem értek hozzá én két lehetőséget látok. Az egyik az, hogy AMD nem adott ki hozzá még driveres támogatást, most lesz 2 nap múlva publikus még a játék és ez majd javulni fog valamelyest, ha nem is sokat.

A másik hogy Nvidia most elengedhette magát ezzel a játékkal mert nem egy olyan új AAA cím, amiben figyelembe kell vennie mindhárom gyártót és azok teljesítményét.

megvették, a már lecsengett de még jól hangzó 15 éves címet és beletették amit lehet megmutatva mi is a valódi eltérés RT terén a két-három gyártó között. Ezért írtam hogy kíváncsi leszek Intelre, mert az ARC-ok fel vannak gyúrva rendesen. Alapból már hozzák több játékban azt amit a 3060-70 RT alatt.

Anno azért születtek elméleti számítások kielemezve az új generációkat az új RT gyorsítot és ebben nincs benne az Nvidia speciális eljárásai, az RTXDI és a ReSTIR GI [link] amit pl a 3060 is támogat.

Egy ilyen elmélet számítás járt twitteren: [link]

de amúgy szerintem szimplán majd hoz AMD driveres támogatást aztán jobb lesz a helyzet.

-

KillerKollar

őstag

Szerintem ha csak visszafogott teljesítmény mellett érhető el biztonságos működés akkor ahány százalék teljesítményt bukok emiatt akkora százalékát kellene visszafizetniük a vételárnak

Amúgy a maga a csatlakozó szar teória azért gyanús nekem picit mert a 3090 Ti is már ezt a csatit használta, annak is 450W volt a hivatalos TDP-je és állítólag tesztek alapján többet is eszik a valóságban mint a 4090 nagyobb power spike-okkal, ott mégsem voltak leolvadt kártyák, legalábbis nem tudok róla, de ha lettek volna a 4090 miatt tuti előkerült volna. Értem, hogy annyira nem volt népszerű kártya 2000$ MSRP, cserébe alig gyorsabb mint egy sima 3090 de már egy ideje 1000$ alatt is meg lehet kapni akár újonnan (USÁban persze, de nálunk is olcsóbb jóval mint volt), úgyhogy mostanában szerintem többen megvették mert már nem olyan rossz vétel. -

Yutani

nagyúr

Az AMD Polaris white paperben ez áll:

HDMI® 2.0b (with HDCP 2.2)

1920x1080 @ 192Hz

2560x1440 @ 96Hz

3840x2160 @ 60Hz (4:2:2)DisplayPort™ 1.4-HDR (with HDCP 2.2)

1920x1080 @ 240Hz

2560x1440 @ 192Hz

3840x2160 @ 96HzThe Polaris architecture includes the latest generation of AMD’s video encode and decode

acceleration engines. The Polaris architecture’s decode accelerator has been upgraded to

handle HEVC/H.265 main10 profile, with support for 3840x2160 resolution at up to 60Hz

with 10-bit color for the HDR content.9 The Polaris architecture has also been updated to

include support for the VP9 codec at up to 4K resolution, which dovetails with YouTube’s

transition to VP9 encoding.

On the encode side, H.264 encode acceleration is carried forward from previousgeneration products at 1080p120, 1440p60 or 2160p30 rates. AMD has worked with a

variety of application vendors—including Plays.tv, AMD Gaming Evolved Powered by

Raptr, and OBS Studio™—to expose this functionality. As streaming platforms and

services transition over to HEVC/H.265 to improve quality and data rates, the Polaris

architecture has also been updated to include H.265 encode acceleration at 1080p240,

1440p120 and 2160p60 rates.Ez most ferdítés? Nem tudom sajnos kipróbálni, tavaly óta van 4k TV-m, Polarisom 2 éve nincs, sőt, már rá sincs kötve a TV a gépre, mert monitoron játszom csak és a TV-vel Serviio-n keresztül nézem a PC-n lévő tartalmat.

-

KAMELOT

titán

Bizony lehetne kicsi pref/watt is, de nem ez lett a cél, éppen megfordult a kocka.

Kicsi nm és nagy fogyasztás. Azért RUMOR-ba TITAN 900W az durva. OC mennyi lesz 1200W-os bios?

Autókhoz meg.....hát igen ott is elég lenne a kicsi suzuki 900kg-val és 4-5L fogyival. Ehelyett veszel 60.000€ 2t feletti elektromos kocsit. Na ennek semmi értelme.

-

Petykemano

veterán

Mindig az utolsó 5-10% okozza az 50-100%-kal magasabb fogyasztást. Sőt, megkockáztatom a pareto elv is érvényes lehet: a teljesítmény felső 20%-a okozza a fogyasztás 80%-át.

Kíváncsi lennék, vajon ez az élet más területein is hasonlóképp van-e. Mármint hogy a ár/érték arány (ár itt most a fogyasztás) görbe nem lineáris

Vajon lehetnének kulturált fogyasztású belsőégésű autóink, ha nem a magas nyomatékért és a 2tonnás biztonságért lennénk hajlandók fizetni?

Lehetnének normális élettartamú eszközök? Az utolsó 20%-os spórolás veszi el a tartósság 80%-át? -

Devid_81

félisten

-

Petykemano

veterán

-

De nem csak nekem.Technikailag ez a kártya visszalépés a kategóriájában még egy RX 580 hoz is.Az hogy bármilyen magyarázattal ezt jóvá hagyjátok az csak megerősítés a gyártók számára hogy hozzák csak a hulladékot.Szerencsére twitteren egyre több oldal ezt leírja.egy kicsontozott rom.A valós ára 100 dollár körül lenne oem kartyanak.Az hogy milyen árakat látsz 1 hétre a 3050 megjelenése után az egy dolog lesz majd jobb is.Az sem egy jó vétel amúgy meg MSRP n sem,tökéletesen megmutatja hogy tolják el a gyártók a kategóriákat.4 Eve 150 ezerert 1070,2 eve 2060 most 3050...

A bolti készlet alakulása nem szabadna hogy jóváhagyja ezt hogy ilyet le lehet tolni 300 eurós áron az emberek torkán mindenféle kifordított magyarázattal főleg nem nektek,akik jobban ra láttok arra mennyire le van butítva minden szempontból ez a VGA.

reszemrol ennyi,le zárhatjuk ,én semmiféle magyarázatot nem tudok elfogadni erre egy 5500XT vagy RX 580 után.

vasarlasra is csak azt ha az embernek egyaltalan nincs tobb penze erre,mint 300 euro vagy 130 ezer forint es kell egy VGA.Egyeb esetben tegyel hozza meg 100 eurot vagy 50 ezret es vegyel mast vagy varj par honapot. -

Alpi.

addikt

Olyasmi, mint amikor a 12GB-os 3060-as 4K Rtx-ben sokkal jobb min. fps-eket tud, mint a 6 GB-os. %-os teljesítményben hihetetlen látványos grafikonokat lehet készíteni.

Az, hogy az fps értékek sokszor csak azért állnak több számjegyből, mert tizedesjegyet is tartalmaznak, az egyáltalán nem lényeges.

Ok, ezek is információk, jó tudni minél többet, de számomra egy nem valós élethelyzetben mutatott gyengeség / erősség minimálisan változtat a termék "valódi" értékén, legalábbis azon, amennyit ki kell fizetni vásárláskor. Az Msrp és a (hazai) árak közti anomáliát hagyjuk is... Valami árral kalkulálni kell, jó(bb) ötlet hiányában marad ez csak apróbetűvel oda kéne írni, hogy a cikk írója, a tesztben szereplő és a valós ár közti bármekkora eltérésért, felelősséget nem vállal.

-

Szerintem es a vilag IT mediaja szerint a 200$ es a 250$ egy kategoria.Ha lenne 8 GB verzio a 6500 bol vagy 4 a 3050 bol a ket kartya kozott meg ennyi sem lenne ,mint anno a RX 570-580 vs 1060 4-8 vs 3-6 .

A polcrol fogyas mint erv es az hogy milyen GPU van a huto alatt szerintem badarsag.Az nvidia kiarulja egy eleve olcsobb(Samsung) gyartasu selejtjet.A samsung allitolag boven alaigert a TSMC hez kepest.

Ezert gyanitom mindket GPU szepen nyereseges ergo itt jol jon az olcsosag.

A mostani helyzet kiforditott.Mindket kartya elerheto annak aki venni akar kb annyival dragabban a 3050 mint amivel tobbet er.Szinte Barmire akarom hasznalni draga es korlatozott a 6500.

Az hogy szertinted a 3050 tul eros ehhez szerintem nem igaz.A fortnite alatt,ahol semmilyen limitacioba nem utkozik a 6500,ott pl egy kategoria a ket kartya.Brutalisan magas orajelekre kepes... -

ez az érvelés szerintem nem jó...

Az 5500Xt az 1650 és az 1660 ellen jött annó ,a legkisebb Turingok ellen,akkor az rendben volt most a 3050 már nem jó mikor egy kategóriában vannak? a 3050 az Ampere 50 es kártyája . Mint az 1050 és az 1650 volt... A 3060 és 3060Ti a 6600- 6600XT kártyákkal vannak egy súlyban és árban az 6500XT pedig a 3050 kártyával. ez ennyit tud , ennyire lett agyonherélve erről senki nem tehet csak a tervezője. Ők úgy gondolták jó lesz ez a 3050 vagy 2060 ellen.

Nem mindegy milyen GPU van agyonvagdosva?vevőt ez érdekli? érdekes hozzáállás hogy a 6500XT nél semmi nincs jobban agyon butítva és nyomorgatva 3 évre visszamenőleg kezdve a 64 bites busztól a hiányos multimédia képeségekig, AV1 dekdolás hiányáig, és a 4 GB ramig és a 8 db PCIE sávig..AZ hogy ez mit jelent CB letesztelte, [link] már pedig aki ilyen kártyát vesz nem feltétlenül PCIE4.0 lapba teszi....

Míg a 3050 minden RTX Ampere tulajdonságból teljes értékű egyedül a teljesítménye sorolja oda ahol van, még is ott van felhozva hogy ez egy agyonvágott GPU...A 4 GB ram nem elég belépőbe sem már főleg 200$MSRP és 275$+ eladási áron erre rávilágít a CB szintén a Witcher 3 ban vagy Igor RDR2 ben mediumon is már.

A 200 dolláros MSRP rendben van 4 GB ramos 64 bites kiherélt kártyáért a 250 dolláros MSRP nincs rendben egy 8 GB ramos 40-50 % kal gyorsabb videókártyáért? ez nekem nagyon nem kerek. Ezt a kártyát nem szabad megvenni mert 1-2 év múlva sem eladni nem lehet sem használni, még medium grafikán sem FHD játékra...Itt most a drágább az olcsóbb hosszú távon. -

keIdor

titán

Bizony, nem GA107 lett, hanem egy GA106 van megvágva egészen 128bit-ig és 2560 core-ig.

GA107-et most nem is csináltak, eddig mindig volt xx7-es GPU.A 6500-al az a baj, hogy 6300-nak vagy 6400-nak kellett volna hívni, így mindenki a másik oldal 50-esével hasonlítja össze, ennyi a baj vele.

-

-

Nem is ezzel,a TDP vel van baj .

Raadasul H.U kifejezetten AMD parti oldal nekik sem mondtak el a tenyet..most azt a par millió live nezot ne is emlitsuk...En is 5800 u/3050 lapost rendeltem,jo cucc,sot a jelenlegi helyzetben a legjobb CPU szerintem,ezekre a trukokkre semmi szukseg nem lett volna, 20-30% elorelepes igy is boven jova teszi a 6800 at.

Ez nagyona konkurenciakra jellemzo es ott elítélt trukk volt sajnos. -

Minden csak az árazástól függ.

Jelenleg az Alder igazi sikerének kerékkötője az hogy nincs alá olcsó alaplap. De majd remélhetőleg az is lesz.

AMD meg fordítva, ott van olcsó lap, de processzor még drága (relative).

Szerintem az árazás (és elérhetőség) finomhangolásán fognak majd "dolgozni" idén mindkét oldalon.

A termékek maguk mindkét oldalon nagyon jók.

-

Raggie

őstag

Hiába mondod ezt, a boltban is felmentek az árak az első hullámhoz képest, nyilván a HA-s eladóknál is felmentek. Ezt nem ők csinálják, csak nyilván nem jótékonyságból árulnak, keresni is akarnak rajta. Csak éppen nem olyan vérlázítóan sokat, mint a boltok...

Nézz körül külföldi webshopokon. Nem az ÁFA különbséggel olcsóbbak a cuccok. Sokkal többel olcsóbbak.

Igazából mindegy is, hogy honnan szerzik az eladandó kártyákat, mert a klasszikus értelembe véve ez már nem scalperség, mivel a boltinál olcsóbban ad el terméket.

Az igazi scalper az, aki a kifogyott vagy épp nem kapható termékeket árulja a boltinál jóval magasabb áron. -

Gyuri27

félisten

Mondtam és mondom is. Mi csinálunk magunkból hülyét.

Csak egy hónapra ülne le mindenki a seggére. Nem venne semmit (se újat, se használtat) azt hiszem fényesre lenne nyalva a seggünk.

De amig ott tartunk, hogy emberek eret vágnak magukon ha nem költhetik a pénz, amig megy a hiszti, hogy nincs x-y kártya (és bármennyibe kerül megveszi) addig nincs miről beszélni.

Holott pc nélkül is van élet. De ha már pc akkor egy olcsó (meglévő) vga-l hardverrel is van élet.

Nyilván nem 4k 144hz, de azért van.

Így abszolult nem sajnálok senkit. Aki nem tud leadni az igényekből az bizony fizesse a hardver értékének a 3-10x-t. -

Raggie

őstag

Az "ilyen scalper ár" alatt azt értettem, hogy abolti ár többszöröséért árult cucc. Ami pl a PS5-el és XBOX-al megy amerikában, meg ami az első nagy hullám alatti tényleges áruhiány alatt volt.

Most is magasak a HA-s árak, de még mindig alacsonyabbak, mint amit a hazai boltok írnak ki. Erre értettem.

#44670Petykemano : igen, nézz szét a geizhals.de-n vagy csak úgy a német webshopokon(pl.: mindfactory, alternate, cyberstore, stb.).

Mindenhol jóval olcsóbban tudsz kártyát venni mint az itthoni voltokban, még a jóó sz@r EUR árfolyam mellett is!! Szóval ez igenis plusz gond az itthoni boltokkal. Nem tudom, hogy a nagykerek milyen áron árusítanak, de attól még létező probléma. Csak erre akartam felhívni a figyelmet. És igenis egyre többen vásárolnak külföldről VGA-t. Pont emiatt. -

Petykemano

veterán

Jó, azért kapitalizmus és kapitalizmus között is van különbség.

A szociális piacgazdaság és az angolszász liberális kapitalizmus nem ugyanaz. Dolog pikantériája az, hogy talán még csak nem is abban különbözik egymástól, hogy mennyire van jelen az állam, hanem hogy a gazdaság mely szereplőit mennyire támogatja, vagy kinek a kedvére tesz. (Persze nincs ilyen személy, hogy állam, mert azt azok vezetik, akiket megválasztunk, viszont a pártok remekül terelik el a tömegek figyelmét ilyen kérdésekről olyanra, hogy változtathasson-e nemet az óvódás a szülei beleegyezése nélkül)Létezik fogyasztóvédelem, ami egy olyan kis szereplőket tömörítő érdekvédelmi szervezet, aminek a célja épp az, hogy az egyenként minden kisembernél nagyobb cég ne mondhassa azt, hogy hát "nem működik a termék, amit kifizettél? Így jártál!"

Létezik versenyhatóság is, amely egy hasonló érdekvédelmi szervezet, aminek meg az lenne a célja, hogy ha egy cég piaci gyakorlata az előzőre hajaz, akkor ne fürödjél be azzal, hogy nincs más választásod mint hogy a következőt is ugyanattól a cégtől veszed. Hogy a választásoddal jutalmazhasd vagy büntethesd a cégek piaci viselkedését. Minél több szereplős egy piac, annál inkább a versenyhatóság és minél kevesebb szereplős egy piac, annál inkább a fogyasztóvédelem szerepe kellene nagyobb legyen.Persze ezt most nem azért mondtam, mert azt gondolnám, hogy scalpering tevékenység ellen a fogyasztóvédelemnek vagy a versenyhatóságnak kellene fellépnie. Lehet, nem tudom. Csak azért említettem ezeket, hogy a tisztességes piaci magatartás elvárására és betartatására léteznek állami szervek (Mégha alulfunkcionálnak is) és nem minden működik azon az elven, hogy az erősebb kutya... Ez a piaci logika, és az állam, mint a polgárok érdekvédelmi szervezetének épp ennek kellene ellentartania.

Tulajdonképpen mi akadályoz meg bárkit abban, hogy bemenjen a teszkóba és felvásárolja az összes wc papírt és ott a parkolóban elkezdje kétszeres-háromszoros áron árulni?

Jó, persze elsőre az ember legyint, hogy majd biztos hoznak majd még készletet. De nem hoznak, vagy ha hoznak, akkor azt is azonnal megveszi a parkolós scalper.

Másodjára az ember legyint, hogy hülye vagy, akkor majd megveszem egy másik boltban. De nem, mert ott is van egy ember, aki már felvásárolta és a parkolóban árulja kétszeres-háromszoros áron.Azt gondolnám, hogy előbb-utóbb valamelyik állami hatóság kimondaná (ad abszurdum bíróság) azt, hogy a hozzáadott érték a különbség a kiskereskedelmi tevékenység és a scalping között. A kiskereskedő hozzáadott értéke a hozzád fizikailag közel levő üzlet, az ügyfélkapcsolat, a garanciális ügyintézés vállalása, a készletezés, vagy ha ez nem, akkor éppen az, hogy alacsonyabb színvonalon, de alacsonyabb költséggel oldja meg másoknál és árelőnyt biztosít a vásárlója számára.Tehát pl a sarki kisboltos is a teszkóban veszi a wc papírt, és másfélszeres áron adja, de mégiscsak nyújtja számodra azt a szolgáltatást, hogy ott van a sarkon. Hogy most ez kinek éri meg, és kinek nem, az vitatható.

Ezzel szemben a scalper begyűjt, piaci készlethiányt idéz elő és drágábban értékesít. Hol van itt a fogyasztó számára a hozzáadott érték? Talán nem tudná megvenni a boltban? Tehát a scalper olyan problémát old meg a tevékenységével, ami nélküle nem létezne. Erre egészen biztosan ki lehet jelenteni, hogy ez tisztességtelen piaci magatartás.Lehet, hogy erre vonatkozólag még nincsenek meg a megfelelő jogszabályok, de lehet értelmezni a helyzetet. A dömping árazás is tiltott, pedig előtte volt olyan tisztán piaci "vállvonogatós" magyarázat, hogy "hát miért ne tehetné meg a madaras teszkó, hogy olcsóbban adja a kenyeret annak előállítási áránál? Az ő pénze bánja, ha veszteséges! Kapitalizmus van, a sarki pék legyen termelékenyebb!"

-

Gyuri27

félisten

Ez a kiadóknak, lap gyártóknak, de még a proci biznisznek is fájni fog hamarosan. De a nagyker, kiskernek is.

Ha nincs vga értelnes áron akkor az userek 90%-a nem fog fejleszteni. Nincs miböl, nem éri meg stb-stb. Ha meg igy van akkor nem kell proci, lap semmi. Ez adja magát. Gyengébb vgan a game se fut rendesen. Ha a népek nem vásárolnak a fentieknek nem lesz bevétel.

Szóval lehet itt a kapitalizmusról beszélni. De ez valami más. Rövid távon valakiknek jó. De a piac egésszére nézve átok. Bele is fog gebedni. -

Petykemano

veterán

Lecserélt kártyák alatt eddig épp az általad említett RX 580-akra gondoltam. És azt is hozzátettem, hogy nem is úgy értve, hogy kiszuperált ócskavasként óccóért megy valami gyerek gépébe, hanem feltörekvő bányászokhoz, aki már lehet, hogy bukik majd rajta, mert drágul az áram, vagy ilyesmi.

De ha azt mondod, hogy nincs ilyen hatás, hiszek neked.Devid_81

"Boldog boldogtalan banyaszik, de oszinten egyetlen embert nem ismerek aki ekozben crypto penzekkel vasarolgat es szamolgatja a ETH/bitcoin bitjeit a crypto wallet-jaban, hogy van-e meg eleg venni belole egy pizzat vagy sem.

Ehhez kepest nagyon sok koca banyaszt ismerek...

Gondolom a legtobb tranzakcio abbol van (es a fee a banyasznak) hogy sokan csak tozsde szeruen fel/le veszik forgatjak a penzuket."

Szerintem ez így van. Persze vannak cégek, amelyek dolgoznak azon, hogy akár kriptót is elfogadjanak. Szerintem persze ennek motivációja nem annyira az, hogy azt gondolják, hogy az milyen modern fizetőeszköz, hanem az a spekuláció, hogy a kriptó, amivel fizettél, idővel majd még többet fog érni.Addig jó nekünk, míg nem használják az emberek. Nem is biztos, hogy lehetne.

Ha nagyon felmenne a tranzakciók száma, könnyen lehet, hogy olyan mértékű tranzakciós díjat kéne fizetni, ami már bőven nem érné meg."Even second-generation cryptocurrencies like Ethereum suffer from limitations in their throughput and scalability. The Bitcoin network can currently only process seven transactions per second and guarantees only 4.6, while ETH can handle between 15-45, this is a roadblock if the usage exceeds this which it occasionally does. The ETH 2.0 network will scale to a potential 100,000 transactions/sec; for comparison, VISA averages 1700 transactions/sec and claims it can do 24,000."

[link] -

Devid_81

félisten

Sajnos jelenleg egyik gyarto sem kimondottan a gamernek kedvez.

Megha a novelt savszel adna is par %-ot a jatekokban, ez a kartya is kint lesz kaparni a tobbiekkel mig a regi 3080-asok EOL-t kapnak es tovabb kaparnak.Szerk (#44661) Petykemano ezen mar en is sokat gondolkodtam, hogy tenyleg meg megeri?

Boldog boldogtalan banyaszik, de oszinten egyetlen embert nem ismerek aki ekozben crypto penzekkel vasarolgat es szamolgatja a ETH/bitcoin bitjeit a crypto wallet-jaban, hogy van-e meg eleg venni belole egy pizzat vagy sem.

Ehhez kepest nagyon sok koca banyaszt ismerek...Gondolom a legtobb tranzakcio abbol van (es a fee a banyasznak) hogy sokan csak tozsde szeruen fel/le veszik forgatjak a penzuket.

-

Petykemano

veterán

"illetve azt is, hogy a 7nm korlátozott, és CPU és APU terén is komoly ellátási hiányok vannak, amik vélhetőleg nagyobb profitú felhasználásai a rendelkezésre álló erőforrásoknak. "

Az AMD által előre lekötött kapacitások tekintetében ez igaz.

De ha ez abszolút értelemben is igaz lenne, akkor az Intel nem tudna a TSMC-nél GPU-kat gyártatni.

(Persze az Intel N6-on gyártat, de az az N7 továbbfejlesztése, ami több EUV layert használ. Nagy eséllyel a korábbi N7 gyártósorokat alakítják át N6-ra. De ha feltételezzük, hogy ez így nem pontos, N7-ről áttervezni N6-ra abból a célból, hogy ott hozzáférhessenek kapacitáshoz elvileg nem olyan nehéz.)Ezzel csak azt akarom mondani, hogy középtávon nem igaz, hogy

"Ha akarnánk se tudnánk többet gyártani ¯\_(ツ)_/¯" -

DLSS nél ilyen jellegű bugok jönnek inkább elő, ami a vékony éleket / vonalakat érinti .

Ez mondjuk egy felerősített példa rá.

Szerintem ahogy írja Raymond LOD vagy VRAM/ cachelési probléma lehet. Állítólag 3060Ti-n demózzák, hogy az elég lesz hozzá minden max RT vel, ezzel az ISV cuccal,de 8 GB ram van ami ekkora tereknél akár problémás is lehet finomítások nélkül.

-

Raymond

titán

Nem, az asset problema a LOD-al. Egy csomo masik helyen is lathatod. Legjobban talan a 2:39-2:41 resznel a ket fanal, csak akkor jon be a torsz felso resze amikor mar nagyon kozel van a kamera. Ami 1:09-nel van pedig arnyek problema, a sziklakhoz kotodik, mas, az eloterben a foldon es a fekvo sziklakon levo arnyeknal latod hogy eleg drasztikus a fade in fade out atmenet a fatorzsnel pedig 1:13-tol latszik igazan hogy a valtozas a sziklaperemtol es annak formajatol fugg.

-

Petykemano

veterán

Új M1(P) vs teszt a HWUB-tól: [link]

Az M1P előnye sok esetben elég tisztességes és ha a fogyasztást is figyelembe veszed, akkor eléggé tekintélyt parancsoló.

Ugyanakkor a a különbség nagyjából akkora, amekkorát egy olyan termék hoz, ami egy új gyártástechnológián készül és amit a tervező nagyon oda akar tenni.

teljesítmény tekintetében az 5nm-es M1P több esetben pariban van az x86-os konkurenciával. Némely esetben a különbség nagyobb, de úgy vettem észre, hogy azok tipikusan azok a helyzetek, amikor képbe kerül egy dGPU is.

Ami a fogyasztást illeti az amd épp most dobta be, hogy az 5nm 2x power efficiency és 2x density. Ha mondjuk 20%-kal magasabb IPC-t számolunk és pontosan ennyivel alacsonyabb turbó órajeleket is egy 5nm-es cpu esetén, akkor egészen biztosan nagyon másként néznének ki az x86-os procik fogyasztási mutatói is.

Nem állítom, hogy na majd jön az AMD 5nm-en és agyonveri az M1-et, de ezek alapján úgy tűnik, hogy a zen4+N5 képességeire vonatkozó racionális várakozások mellett várható, hogy versenyképes terméket fognak tudni lerakni.

Hát persze az igaz, hogy később. Ha mondjuk az AMD-nek 2022 év végén lesz hozzáférése N5-ön APU-kat gyártani, akkor az ugye az M1-hez képest 2, az M1P-hez képest 1 évvel későbbi terméket jelent. De ez a különbség mindig megmarad, amíg az Apple el tudja vinni 1-2 évvel hamarabb a legfejlettebb gyártástechnológiát.

Kár, hogy ebben nem szerepelt még az Alder Lake-P. Lehet, hogy egy karhosszal jobb eredményt nyújtott volna a Cezanne-nál. De az is teljesen nyilvánvaló, hogy az Intel akkor fogja tudni visszavenni az szellemi elsőségét az Apple-től, ha

- a saját gyártástechnológiájával beelőzi a TSMC-t

- bevásárolja magát a TSMC-nél a legújabb gyártástechnológiára az Apple elé.Én egyikre se látok nagy esélyt. Egyrészt az Apple mellényzsebből fel tudná vásárolni az Intelt vagy a TSMC-t. Ezt a financiális lóerőt nehéz volna überelni.

Másrészt arról is volt már szó, hogy a TSMC azért jobb, mert sok a partner. Szerintem egyébként nem biztos hogy csak ez. Hanem mert az Apple financiális lóereje hajtja a kerekeket. -

Petykemano

veterán

Az M1P és M1X kapcsán már nem csak cpukat hasonlítgattak, hanem VGA-t is. Tehát az M1-ig lehet igazad. Itt egyrészről elmondható, hogy az a 10% árkülönbség az érezhetően jobb ST teljesítményért nem nagy ár. Ugyanakkor lehet, hogy sok esetben kerül figyelmen kívül hagyásra, hogy máskülönben almát körtével hasonlítunk, és ha már kell a 16GB, akkor már nem 10% a különbség.

Máskülönben M1P és M1X esetén már ott van a vga is. Ha nem lenne a bányászat, akkor egy 3070/M legfeljebb $500--700-ral dobná meg a noti árát. De most ezek 1100-1200 körül futnak. Legalábbis gondolom, hogy az OEM is emelt áron kapja már. Vagy ha nem, akkor azért adja annyiért, mert ennyiért is elviszik.Akárhogy is, eddig gondolhattad azt, hogy az Apple termékkel válogatottan kiváló hardvert kapsz egyedi szoftverrel, ami azért más módon - akár olcsóbban - megközelíthető

Most viszont tagadhatatlanul és érezhetően nagy előnyű világbajnok hardvert kapsz egyedi szoftverrel, amit még az azonos.árban kapható konkurencia megszorongatni se tud, nemhogy picivel gyengébbet, jóval olcsóbban kínálni.Másként megfogalmazva az Apple árprémiuma nem nőtt, de a az eddigi hajszálnyi előny érezhetőre nőtt.

Nem mintha én ezt tüzetesen vizsgáltam volna, de ez az érzetem a hurráujjongás okával kapcsolatban.

-

Petykemano

veterán

Azt olvastam a másik topicban, hogy az ilyen jellegű összehasonlításoknak az ad létjogosultságot, hogy a kurrens piaci viszonyok (chiphiány, bányászat, üres konténerek, felmondott dokkmunkások és sofőrhiány) miatt az Apple termékei már nem is annyira horror drágák, hogy azt lehessen mondani, hogy jó, tényleg jobb, de más árligában is játszik.

-

Ami meglepő hogy nem csak játékra hanem a felhasználói programok többségében is,pl renderelés , Adobe stb , sok esetben az 5800X fölött van,de néhol az 5950 is megvan.

Nagyon érdekes lett ez a CPU.

Tényleg érdekelne minek köszönheti ezt a szereplést, valahogy ideálisabbnak tűnik az felépítése és mintha a programok is jobban szeretnék ( ha lehet így fogalmazni) mint a z I9-et a jelen esetben, mert arányaiban az sem ver rá annyit, amennyit elvárna az ember a több maggal és nagyobb fogyasztással.Gyuri27: A Tom's tesztben ott van a Win 10 teszt és eredmény is a Win 11 alatt minden esetben.

Linux és Nvidia párosítás nem az igazi .

-

Petykemano

veterán

Igen, ezekben mind igazad van.

Csak arra akartam utalni, hogy ha mondjuk nem 14nm-en, hanem 7nm-en készül az IOD, akkor összességében 240mm2 lenne (monolitikusként persze lehet, hogy meg lehetneszabadulni az IF SerDestől, de ezt most hagyjuk. Ahogy mondtad, a megközelítésnek van előnye és hátránya is)

Elképzelhető, hogy ha nem 8, hanem 16 Gracemont mag lenne benne, akkor is meg tudná közelíteni még értelmes fogyasztás mellett is az 5950X-et, miközben az ADL lapkamérete is azzal kb 240-ra emelkedne.Ez még mindig nem jó. Ideális esetben épphogy azt kéne látnunk, hogy MT teljesítményt az Intel ezzel a megközelítéssel kisebb lapkából és kisebb fogyasztásból hozza ki. Ebből én egyértelmű hátrányt olvasok ki.

Csak arra akartam utalni az okfejtéssel, hogy azért a hátrány nem olyan mértékű, amit MLiD a magok méretének összevetéséből kiolvasott. (GC 2x> zen3 2x> gracemont )

-

Petykemano

veterán

Gondolkodom, hogy vajon miképp lehetne ezt egyetlen értékbe belesűríteni.

De tartok tőle, hogy tényleg nem lehet.A TDP-nek szerintem annak kéne lennie, amit mondtam : tartós terhelés átlagos fogyasztása. És akkor kimérheted, hogy mondjuk 5 perc full terhelés esetén ennyire vesz fel és ami ennél is fontosabb, hogy neked ehhez kell méretezned a hütést. És akkor ha veszel egy 123W TDP-s hűtőt, akkor azt kell lássad, hogy a 123W TDP-s procis tartósan fut a névleges frekvenciáján. És ha kisebb hűtőt teszel rá, throttlingolni fog. Tehát ez a tartós fullos terhelésre lesz hatással. Ha meg jobb hűtőt teszel rá, akkor nem lesz gyorsabb, de örülhetsz,.hogy halk.

De ez az intelnél most a PL1, nem?

És aztán ott van a másik érték, hogy tulajdonképpen mi a maximális teljesítmény, amit a proci benyalhat. És kimérheted, hogy annál magasabbra nem megy. Neked ehhez kell méretezned az alaplapodat. Ha egy 234W-os procihoz 234W-os alaplapot teszel, akkor hozni fogja a névleges turbó értékeket. Hogy meddig, az persze attól függ, hogy Mit bír a hütés. Ha gyengébb alaplapot teszel alá, nem fogja megkapni a szükséges áramot és alul fog teljesíteni a várthoz képest az impulzus -szerű műveletekben

Ez az intelnél most a PL2.

Ebbe az egészbe a Tau kavar bele. Annak szerintem semmi értelme. Hiszen azt, hogy meddig vehet fel PL2 teljesítményt annak kéne meghatároznia, hogy milyen hütés van rajta, vagy anNak, hogy te mint konfiugrátor milyen tartós fogyasztási maximumot szeretnél.

Mit gondolsz, az AMD is áttér a PL1/PL2 definícióra, vagy' maradnak a ködös TDP-nél,.ami igazából semmiről nem mond semmit és semmilyen tényleges értékhez nem kapcsolódik?

-

Petykemano

veterán

Sajnos még csak ez sem. Tartósan is kb. 140W-ot vehet fel, mert ők egy elmés képletből származtatják a TDP-jüket.

Elnézést, igaz.

Ők is dugják fel maguknak a TDP képletüket.

Tulajdonképpen miért nem lehet ráírni, hogy akkor ez a proci 140W-os? Mármint persze azon kívül, hogy a 105W jobban hangzik.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- GIGABYTE XTREME RTX 3080 Ti 12GB GDDR6X Videokártya!

- PC bontás - Thermaltake ház, Fsp 650W, GIGYBYTE AB350M, AMD RYZEN 5 1600x, 16GB DDR4 3000, GTX 1080

- Nvidia GeForce RTX3060 Elite 12Gb

- RTX 5000-ES SZÉRIA ÚJONNAN GARANCIÁLIS ELADÓ TERMÉKEK! 5050, 5060, 5070, 5080, 5090.

- ELKELT - Sapphire PULSE AMD Radeon RX 7900 GRE 16GB - Csere is

- Bomba ár! Dell Latitude E5540 - i3 / i5 I 6-8GB I 320GB I 15,6" HD I HDMI I Cam I W10 I Gari!

- 142 - Lenovo LOQ (15IAX9) - Intel Core i5 i5-12450HX, RTX 4060 (ELKELT)

- Logitech Webkamera MeetUp 120 -os látótér, mikrofon, 4K Ultra HD

- Bomba ár! Lenovo ThinkPad X390: i5-G8 I 8GB I 256SSD I 13,3" FHD I HDMI I Cam I W11 I Gari!

- Bontatlan DJI OSMO Mobile 6 - ez elbírja a 16 pro max-ot!

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

Cég: PCMENTOR SZERVIZ KFT.

Város: Budapest

Miben befolyásolná ez a konkurenciát?

Miben befolyásolná ez a konkurenciát?

és ezt az nV-nek köszönhetem.

és ezt az nV-nek köszönhetem.