Új hozzászólás Aktív témák

-

.LnB

titán

Srácok, múlt hét csütörtökön volt ünneplés vagy megemlékezés a topikban? Csak azért kérdezem, mert múlt hét csütörtökön volt a hetedig évfordulója annak, hogy Abu nem hajlandó tudomást venni a JPR adatairól. Hét éve nem hajlandó még kihírezni se az eredményeiket. Mindezt egy Prohardver nevű oldalon. És akkor a Steam felmérésekről ne is beszéljünk.

Mondjuk biztos jobb is egy elképzelt álomvilágban élni, mint a valóságban.

-

S_x96x_S

addikt

> A kompatibilitás és hogy egy helyről jön a CPU-GPu amit kínált ami kényelmes és kifizetödő és fontos valóban ,ha erre gondolsz,mint sokkal több értéket adott,de valószínűleg nem.

mivel a konzolok ára limitált, emiatt nem lehet elszállni az árban.

> Az Nvidiának ez aprópénz

Inkább stratégia lett volna;

( ahogy az arm felvásárlása is annak indult )

Ha a konzol piacról sikerült volna kiszoritani az AMD-t,

akkor a gaming-ben is kvázi monopolhelyzete lett volna az nvidiának.Amúgy az nvidia is érintett a TEGRA(Nintendo) -val a konzol biznisszel, és a jövőben azt is frissiteni kell ( arm alapú )

Amúgy az XBOX (2023 -as belső MS leak-je tartalmazta,

hogy a next gen xbox : arm vagy zen6 cpu -ban gondolkodnak.

És amikor 2022 elején az nvidia+arm akvizició meghiúsult - az xbox/ps6 konzol bizniszbe való belépés esélye is jelentősen csökkenhetett.> az Intel pedig nem tud erre áldozni semmit.

Az intel elég komolyan vette a PS6 lehetőséget,

a Broadcom egy picivel korábban kiesett."Intel and AMD were the final two contenders in the bidding process for the contract."

Exclusive: How Intel lost the Sony PlayStation business

és hogy mekkora összegben gondolkodott az Intel:

"Sony’s console business could have pumped roughly $30 billion into Intel over the course of the contract, according to Intel’s internal projections, two of the sources said" -

Abu85

HÁZIGAZDA

Akkor kiemelem neked abból, amit bemásoltál: "down 13% from the previous quarter". És nem azért, mert kevesebbet vettek, hanem azért, mert kevesebbet gyártanak. A Q3-ban volt a gyártás a csúcson, ahhoz képest a Q1-ben a deficit közelít a 20%-hoz. Ezért fog Q4-ről Q1-re is csökkenni.

-

Abu85

HÁZIGAZDA

Most másoltad be, hogy az NVIDIA jelentése szerint is csökkent a bevételük. De itt már Q1-ről van szó, ott jelentős a változás, és meg is mondták Q/A-n, hogy szűkös lesz a kínálat legalább két negyedévig még. Egyszerűen nem gyártanak annyit, mint régen. Azt nem tudni, hogy miből van kevés, gondolom GDDR7-ből.

-

Abu85

HÁZIGAZDA

A DLL-t cserélgetheted, de az nem ugyanaz, mint egy adott API esetében driverből cserélni a kódot magát. Ezért van az, hogy ezt a gyártók egységesítették, hogy innentől kezdve ne is kelljen új kódokat kiadni, megcsinálják ezt driverből. Ennek a hátránya persze, hogy eltűnt a natív támogatás a játékokból, mert régi API-kat implementálnak, és onnan mindenki cseréli a kódot az újra.

Ez a lényeg, hogy a limitáció az mesterséges, mert ki tudod venni. Ugyanígy mesterséges lesz az AMD érkező limitációja egy másik játékban.

-

PuMbA

titán

Ezzel a játékkal sajnos vannak gondok NVIDIA oldalon, is mert a hozzá készült driverekkel jelenleg lassan fut: Resident Evil Requiem Driver Comparison and Forced Ray Reconstruction Preset E Testing

Túl sok a furaság, itt egy szándékos NVIDIA üzlet / előnybe helyezés történt, úgy hogy még a saját felhasználóit is kártya cserére buzdítja ezzel a lassulással.

-

Abu85

HÁZIGAZDA

Akkor elárulom, hogy nincs olyan, hogy FSR 4 vagy DLSS 4.5 meg ilyenek. Mind az XeSS-nek, mind a DLSS-nek, mind pedig az FSR-nek van egy API-ja. Ezt kell implementálni. Ez a DLSS esetében a 2.valamennyit jelenti, az AMD-nél az FSR 3.1.4-et, az Intelnél pedig az XeSS 1.valamennyit.

A valóságban nulla cím jön DLSS 4-gyel, FSR 4-gyel, vagy XeSS 2-vel. Az alap API-t implementálják a fejlesztők, vagyis rendre a 2.valemnnyit, a 3.1.valamenyit és az 1.valamennyit. És utána ehhez az API-hoz adják hozzá az újításokat. És pont azért működik a drivereknél is a egyes részeit cserélik ki az eredeti kódnak, mert maga az API kompatibilis előrefelé, vagyis a programban szállított kód ugyanaz, mint a driverben szállított. Tehát olyan technikai értelemben nem létezik, hogy valami natív DLSS 4 vagy natív FSR 4 vagy natív XeSS 2, stb., mert az API az, amit a fejlesztők implementálnak, ami régebbi.

Van megoldásuk erre. Implementálva is van az új Resident Evilben, csak nem aktív, mert ez volt az egyezmény. De pont azért tudják megoldani a modderek, mert az egész egy teljesen mesterséges limit, amit ki lehet kapcsolni. Ugyanez igaz lesz majd arra a játékra, ahol az AMD kérte ezt. Ott is implementálva van az NV megoldása, csak nem lesz aktív a szállított kódban. Valószínűleg ott is be lehet majd kapcsolni, mert az a módszer sokkal komplexebb, mint egy denoiser, de valószínűleg annyit meg tudnak oldani, hogy magát az ellenőrzést kiüssék, és akkor a PT működni fog, csak sokkal lassabban, mert nem kap ML-alapú könnyítést a kód, így mindent számolnia kell. De mondom, az megoldható lesz biztos, hogy magát az ellenőrzést kivegyék, és bekapcsolható legyen a kizárt mód.

Nem mintha sokat veszítenének ezzel az emberek, mert még mindig nem PT first szinten tervezik a játékokat, így sokszor rosszabb a PT minőség, hiszen erre is tervezni kell a tartalmat, és amíg nem erre tervezik, addig ez nem fog jól működni. Majd a következő konzolgenerációtól lehet itt áttörés.

-

Jacek

veterán

En ehez nem ertek, de szelmalomharc ugyis bukjak kinaval szember...

Ez olyan mint amikor "nalunk" a jobboldalra szavaznak mert sok az arab, de amikor megkerdezem hogy az ittlevo 800-1m-val mi a terv akkor neznek akik 5-8 gyereket szulnek svedek meg nem akarnak....

akik 5-8 gyereket szulnek svedek meg nem akarnak....Na ennyi a tech tiltas es a vigyuk haza a gyartast ertelme..

-

-

Abu85

HÁZIGAZDA

Tudtommal - és ez eléggé jó helyről származó infó - az AMD kétféle CCD-t csinál a Zen 6-ra. Az egyik a normál Zen 6 CCD, amiben 12 mag és 48 MB-os L3 cache lesz. A másik elvileg a Zen 6c CCD, amiben 32 darab Zen 6 mag lesz, de nem tudni az L3 cache pontos kapacitását, viszont valószínűleg 64 vagy 96 MB lehet.

Ezek eltérő 3D V-Cache lapkát is kapnak, mert a mostanit mindenképpen át kell tervezni a Fan-out átalakítás miatt. Ezek pontos kapacitása sem ismert, de a kicsi verzióra 96 MB-ot, a nagyra pedig 256 MB-ot mondanak. Valószínű, hogy így jön ki a 2,5 GB-os L3 cache a HPC EPYC-re, amiről szintén van pletyi. -

proci985

MODERÁTOR

Áh, PS5 ha meg is van papíron az 5700XT szintjén, a gyakorlatban bőven nem bír annyit.

Cyberpunkot néztük: RTvel is meglepően elfogadhatóan fut (bár ebben lehet bennevolt a DLP projektor is), nade grafikára (a PChez képest) ronda. Textúrák nem rosszabbak, mint PCn (amit azért manapság már ki szokás cserélni 16+GBs kártyákon), de az effektek... látszik, hogy a geometriát és a shadow mapeket jóval alacsonyabb felbontáson számolja, amitől pl a pálmafák, az árnyékok, meg még pár dolog valami szörnyen néz ki. Az 5700XT az 1440p ultrát (RT nélkül) bírta FSR qualityvel. RT van papíron, gyakorlatilag a PCs RT Psychohoz képest így... hát nem sok.

Vagy a karakterek modelljei közelről érezhetően gyengébbek, ami meg a fél játék.

Lehet egyébként azt kéne, hogy kirakni a PCt is direkt összevetésre, hogy lehet csak a 120" vs 32" jön ki, de anno PCn próbáltam amikor kijött projektoron, és ott is szép volt. Ja igen: 5 éves játék, és már ezt se bírja

Platformexkluzív játék mostanra kb nincs. Ami szuper. Ok, Nintendo kivétel.

Persze, úgy nézve, hogy kerül annyiba, mint egy belépő laptop és lehet rajta játszani, meg nem kell konfolni, úgy jó.

PC piacot senki nem fogja sokkolni.

-

S_x96x_S

addikt

> Az AI az nem egy varázsszó,hogy az AI miatt miatt sokkal optimálisabb. bármit is jelentsen ez a képzeletedben,ez egy marketing maszlag.

most az nvidia marketing maszlagára gondolsz ?

( Jensen : RTX 5070 = RTX 4090 )persze sok minden túl van hype-olva,

de én mélyen hiszek abban,

hogy a GenAI át fog mindent alakítani - még a gaming-et is. -

S_x96x_S

addikt

ha bőven elég lenne - akkor a Sony is igy csinálná ..

de nem igy csinálja.

talán mert a PS6 már a jövő játékaira optimalizál.az AI miatt - sokkal optimálisabb a Sony PS6 architektúrája.

mert a GPU/NPU/CPU - val elérhető lesz a 30GB nagy része.a mostani rendszermemóriás GPU cache - eléggé kompromisszumos a kis VRAM miatt -

emiatt vagy a grafika vagy az AI mellett kell dönteni - és a kettő együtt csak a PS6-nál lehetséges.

( AI alatt nem a grafikai felskálázást értem, hanem az AI ágensekeket és a gaming LLM modelleket ~ 8-24 GB méretben. ) -

S_x96x_S

addikt

szeretném kihangsúlyozni, hogy

a technológiai jövő kiszámíthatlan.Emiatt, a "mai elérhető információk" alapján

csak korlátozottan látjuk,

hogy a jövőből viszanézve - ( az újabb információk alapján ) mi lesz racionális döntés....

Vagyis én a "disruptive innovation" lehetőségét - nem söpörném le azzal az érvvel, hogyha az nvidiának "nem éri meg akkor másnak még úgy sem" ( te irtad )

mert itt épp az a lényeg, hogy egy kisebb erőforrással rendelkező - fortélyosabb cég - más technológiai és üzleti stratégiával és paradigmával - eléggé bele tud ronditani a nagy cég üzletébe.

És ami a nagy cégnek nem éri meg,

az egy lehetőség a többi cégnek, hogy ott növekedjék és megkapaszkodjék.Az nvidia pl. törekszik a 70-80% -os haszonkulcsra - és ami az alatt van az nekik "nem éri" meg;

De más cégeknél más a technológia és üzleti stratégia.---

"According to Christensen, disruptive innovation is the process in which a smaller company, usually with fewer resources, is able to challenge an established business (often called an “incumbent”) by entering at the bottom of the market and continuing to move up-market.

1. Incumbent businesses innovate and develop their products or services in order to appeal to their most demanding and/or profitable customers, ignoring the needs of those downmarket.

2. Entrants target this ignored market segment and gain traction by meeting their needs at a reduced cost compared to what is offered by the incumbent.

3. Incumbents don’t respond to the new entrant, continuing to focus on their more profitable segments.

4. Entrants eventually move upmarket by offering solutions that appeal to the incumbent’s “mainstream” customers.

5. Once the new entrant has begun to attract the incumbent business’s mainstream customers en masse, disruption has occurred.

https://online.hbs.edu/blog/post/4-keys-to-understanding-clayton-christensens-theory-of-disruptive-innovation...

persze az nvidia a nagy haszonkulcsával - rengeteg pénzen ül

és ha valamilyen technológia innovációról le is késik,

akkor a felvásárlás lehetősége - mindig ott lesz mint "B" terv.

( hasonlóan mint a Groq esetén )Vagyis helyesebb úgy nézni az nvidia stratégiáját, hogy azt kell eldönteniük, hogy mi a gazdaságosabb:

- maguk fejlesztik ki

- felvásárolják / licenszelik a technológiát. -

S_x96x_S

addikt

> Most komolyan az üzleti életben nincs ilyen szabályszerűség hogy valami megéri valami nem? milyen butaság ez? Az üzleti életben vagy nyersz valamin vagy nem,ez a dolog ahol ez a szabályszerűség főleg él.

abból - hogy valami

"megéri" vagy "nem éri" meg - egy adott cégnek

(vagy személynek )

nem lehet következtetni, hogy más cégnek ( más embernek ) mennyire éri meg.pl. az AMD-nek megérte a konzol biznisz - az nvidiának meg nem.

De az nvidia meg elég korán az AI -ra fókuszált - és bejött neki.de ott a Groq -esete is;

és még lehet folytatni.

-

S_x96x_S

addikt

> Ha nekik nem éri meg akkor másnak még úgy sem

az ilyen általánosításban nem hiszek,

mert teljesen más az nvidia technológia menedzsmentje

- mint a többi cégé.És nincs meg minden tudás az nvidiánál.

( Nem véletlenül vásárol fel cégeket, fejlesztési csapatokat )És persze ott az AMD chipletes GPU-ja;

Az AMD-nek megéri az nvidiának meg nem.Vagyis nincs olyan szabályszerűség: hogyha az nvidiának nem éri meg, akkor másnak se.

-

S_x96x_S

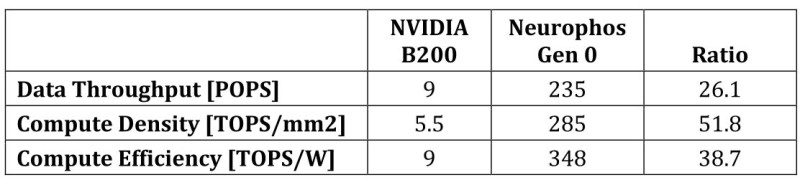

addikt

a lényeg, hogy - később (March 19, 2025 )

Jensen - egyértelműen úgy fogalmazott, hogy

az optikai összeköttetés még nem éri meg az nvidiának.

"Nvidia CEO says power-saving optical chip tech will need to wait for wider use""But Huang told a group of journalists after his speech that while Nvidia examined using it more widely in its flagship GPU chips it had no current plans to do so, because traditional copper connections were "orders of magnitude" more reliable than today's co-packaged optical connections.

"That's not worth it," Huang said of using optical connections directly between GPUs. "We keep playing with that equation. Copper is far better.""a Neurophos - meg ALL-IN -t mondott a fotonikus compute-ra.

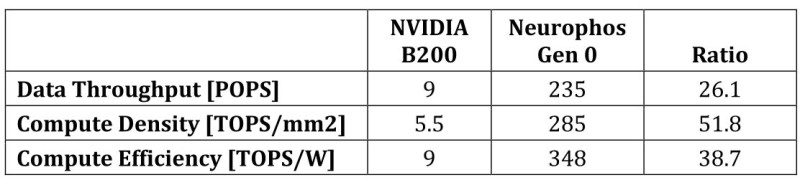

- állítólag van 300 ezzel kapcsolatos patentjük.ráadásul - elég merészet állítanak:

https://www.neurophos.com/whitepapers

"Neurophos’ first generation product OPU will deliver a 1024 x 1024 pixel metasurface array, with 4 bit precision, at 56 GHz. Each vector-matrix multiplication translates to 10242 multiplications and 1024×1023 additions, for a total of 2.1 million operations. This product can perform two such multiplications in parallel, and at 56 GHz this yields a peak 235 Peta Operations per Second (POPS) (2.35×1017) during peak operation while consuming 675 W, corresponding to 348 Tera (3.48×1014) Operations per Second (TOPS) per Watt and a compute density of 285 TOPS/mm2.

In contrast, NVIDIA’s B200 GPU delivers 9 POPS (dense FP4 precision) and consumes approximately 1,000 W. This corresponds to an efficiency of 9 TOPS/W with a compute density of 5.5 TOPS/ mm2.

""" -

S_x96x_S

addikt

Lehetséges,de a meglévő legnagyobb partnerek Miért állnának meg a kapcsolódásnál? Már az Intel is mutatott be ilyen mintadarabot.

nekem a trend a lényeges ;

vagyis pár év múlva a jelenlegi technológián alapuló gyorsítók ( GPU/AI/... )

elavultak lesznek,

ami a jelenlegi nagy GW-os AI beruházások megtérülésébe eléggé bekavar.amúgy - szerinem -

legalább 50 hasonló startup lehet, és ha az nvidia úgy érzi,

hogy ezen a területen lemaradt, akkor majd vesznek 2-3 ilyen startupot. -

"nem tudom miért lett törölve a kommentem"

Semmi gond nem volt a kommenteddel, bekerült egy lánctörlésbe, mert az adok-kapokban ha meghagyok 1-2 árván maradó hozzászólást, akkor a törölt előzmények függvényében értelmetlenül állna magában.

Alogonomus: "Gondolom a "szórásba" belecsúszott véletlenül." Lényegében igen, de nem véletlenül, önmagában álló hozzászólás lett volna a többi között.

-

PuMbA

titán

"raszterben a 7900XTX sokszor elveri a 9070 XT-t "

Ez azért kevésbé számít, mert régebbi / régi motoros játékokban veri el az esetek legnagyobb többségében és ott is 100+ fps felett vagy, tehát most hogy 130 vagy 140 fps-ed van, nem tudod szemmel megmondani a különbséget.

RT-ben viszont többször 25%-kal gyorsabb a 9070XT a 7900XTX-hez képest és mivel RT a jövő, ez számít. A sima 9070-em, ami 220W-ot fogyaszt RT-ben ugyanazt a sebességet hozza, mint a 350W-os 7900XTX, szóval gigantikus az előrelépés ezt nézve. Ugyanígy a jövő a különböző RT kiegészítő technológiák, amit most már nem csak az NVIDIA csinál, hanem az AMD az FSR Redstone-nal: Ray Regeneration, Neural Radiance Cache.

A 16GB VRAM meg nem lesz gond, elnézve, hogy most a 8GB-os VGA-k kezdik az újra virágzásuk korszakát. Az NVIDIA "bejelentette", hogy a 8GB-os 5060 és 5060Ti-ből lesz egy raklapnyi, a többiből meg kevés.

-

X2N

őstag

Szerintem nem az a lényeg hogy érdekli-e vagy nem a Radeon tulajdonosokat az RT-hanem hogy amíg kimerül abban az RT hogy alapkövetelmény hozzá a felskálázás(DLSS/FSR) és a Frame Gen, valamint csúcskártya kell még az 1080p natívban értelmes fps-el futtatásához frame gen nélkül, addig nincs miről beszélni, kevesek hozzá a kártyák és nem éri meg vele foglalkozni se, még jó ~10 évig, mert a felhasználók elenyésző %-a tudja jelenleg is kihasználni. Az agyon butított RT sem egy nagy élmény, ahol nincs igazán kihasználva az hogy minden fény/árnyék/tükröződés dinamikus lehet, a korábbi statikus, bakelt megvilágításhoz képest. Path tracingről ne is essen szó, az továbbra is irreleváns amennyivel több teljesítmény igénye van, nem realisztikus célkitűzés jelenleg, se 10 év múlva ezekkel a videókoránya teljesítményekkel, meg a 2-3 évente +25% teljesítménnyel az hogy majd PT-el realtime 3D grafikát fogunk futtatni.

Közben meg raszterizációval, Horizon Forbidden West, Senua's Saga: Hellblade II, játékok készülnek a hagyományos global illumination-al amik büntetősen néznek ki, mindössze azért mert nagyon részletes modellek/textúrák vannak, jól bevilágítva. Amíg ilyen limitációk is vannak hogy nem tudunk részletes modelleket/textúrákat kipakolni a képernyőre, mert még Nanite sem tud mindent, pl. vegetációt(csak a mostani újabb 5.x verzióban már) megjeleníteni így addig az RT ne legyen már prioritás. Persze az NV-nek prioritás, meg kell teremteni az eddig nem létező igényt, még akkor is ha ez nem realisztkus célkitűzés, hogy eladhassák a kártyáikat valami újabb feature-el, lásd AI.

Az pedig nem előrelépés azoknak akik régebbi kártyákon vannak, hogy majd bekapcsolhatják a DLSS-t hogy értelmes fps-ekkel tudják futtatni a legújabb optimalizálatlan címeket még rosszabb képminőséggel, kép artifactokkal, mert letolták a fejlesztők torkán is az RT-t, ami egy jelenleg nem kiforrott technológia.

Ebből az egészből a "nyertesek" igazából csak a filmesek akik kaptak egy UE5-t amiben lehet már Path Tracelni is meg LED falakkal-virtuális kamerát mozgatva videózni, ezzel jelentősen közelebb hozza a valós idejű munkát a moziminőségű látványhoz, gyorsítja ezzel a gyártási folyamatot.

-

Alogonomus

őstag

Én sem értem, hogy miért lett a hozzászólásod is törölve, mert abban nem volt személyeskedés vagy sértegetés. Gondolom a "szórásba" belecsúszott véletlenül.

A HWU a hivatalos MSRP áron túl rögzíti a valós piaci állapotokat is a kártyatesztjeinél a tényleges ár-érték számokhoz, és a 600 dolláros 9070 XT érkezésekor a 7900 XTX még 900 dollár volt. Jelenleg is itthon 275 ezerért kapható a 9070 XT, míg a 9700 XTX 350 ezertől indul. Bőven kijelenthető, hogy a 9070 XT sokkal kedvezőbb vétel a játékosok túlnyomó többsége számára.

-

Abu85

HÁZIGAZDA

Ezen nem segít. A DLSS-nél az élesítő jó ideje nem a rendszer része. Erről a 2023-as év elején írtunk. [link]

Az eredetileg igaz volt, hogy az NV használt a futószalagon élesítőt, amit speciálisan erre terveztek, de kifejezetten rossz volt a működése, és nem volt értelme megtartani. A fejlesztők, amikor implementálták anno a DLSS-t, akkor ezt a részét helyből nullázták, és külön helyettesítették CAS algoritmussal, mert sokkal jobb minőséget kaptak tőle. Ezért döntött igazából úgy az NVIDIA, hogy akkor ez nem kell bele, mert csak a panasz volt rá. A NIS-t is azért ajánlják, mert az a saját különálló élesítőjük, de kb. minden nagyobb játékban az AMD-féle CAS van alkalmazva, mert jobban működik a NIS-nél. Nyilván ezt az NV nem mondhatja, hogy akkor használjátok az AMD kódját, de a szeparálás pont azt szolgálta, hogy akkor használja mindenki azt, nem kell ragaszkodni a NIS-hez. Emiatt van az, hogy a DLSS nem tartalmaz élesítőt, míg az FSR és az XeSS igen. Az AMD erre egy speciális RCAS implementációt használ, az Intel pedig alapjaiban az AMD-féle CAS, csak Arc GPU-ra optimalizálva.Viszont a DLSS 4-nél a homogén felületek jellegzetes kezelése nem az élesítő miatt van. Ha kikapcsolod, akkor is megmarad a művies hatás, mert maga a helyreállító algoritmus működik úgy, hogy a színben nem elütő képi tartalomba elkezdi belesúlyozni azokat a radikálisan eltérő színű pixeleket, amelyek szintén ott vannak a képen, akár a kép sarkán. Ez a globális konzisztencia okozza azt a fura jelenséget, amire PuMba rákérdezett, és hiába tologatod az élesítőt, nem függ a kettő egymástól. Ahhoz, hogy ez ne legyen a felskálázás része, a transformert kell kikapcsolni, amire például a Cyberpunk 2077 direkt lehetőséget is ad, mert tele van a játék homogén felületekkel, és más módon a fejlesztők nem tudták kezelni a gondot.

Hosszabb távon egyébként jó hír, hogy a Sony dolgozik egy megoldáson, ami direkt erre a problémára reflektál. Eredetileg a PSSR szintén transformer lett volna, de elvetették az ötletet, mert rosszul kezelte a homogén felületeket. Viszont az apró részletek helyreállítása kellene, tehát magáról a tervről nem mondott le a Sony. Amin most dolgoznak az egy frequency domain modell, és ennek pont az a lényege, hogy megmaradjon úgy a globális konzisztencia által biztosított jobb kontrol, hogy közben külön kezelje az alacsony és magas frekvenciájú tartalmat a képen. Ezáltal úgy állíthatók helyre a magas frekvenciájú apró részletek a képi tartalmon, hogy közben nem kell ennek a negatív hatását elszenvedni például az alacsony frekvenciájú bőrfelületeken. Valószínű, hogy rövidebb távon mindegyik felskálázó erre fog elmenni, mert csak nagyon kicsit kell módosítani a mostani hardvereken, hogy igazán hatékonyan fusson (a PS5 Prónak ez a multiprocesszorokat összekötő egyedi koncepciója például helyből alkalmas rá). Eközben megszabadulunk azoktól a képi torzításoktól, amik a mostani felskálázókat jellemzik.

Hosszabb távon egyébként van a Sony-nak egy másik kutatása is, de az szerintem bőven a PS6 érára van tervezve. Annak az a lényege, hogy maga a neuronháló tudja, hogy mi az anyag. Tehát effektíve fel tudja ismerni a képről, hogy az a terület rajta bőrfelület, amaz üveg, ez meg hó, stb. És eszerint konkrétan úgy tudja kezelni ezeket, hogy a helyreállított képen már azt is tudja, hogy a kép egyes részei hogyan viselkednek a fényben.

-

Abu85

HÁZIGAZDA

Én egy szóval sem mondtam, hogy a DLSS 4 rossz, csak azt írtam, hogy a jellegzetes hatásának megvan az oka, ami az elvi működéséből ered. És ez mint írtam nem élesség, hanem a transformer elvi működése által biztosított globális konzisztencia, ami a homogén felületeket túl műviessé teszi.

Az analitikai élesítők ilyet nem csinálnak, mert azok nem dolgoznak a teljes pixeltartományon, hanem van egy szűk tartományuk, implementációtól függően 6-8 pixel, és azon belül teszik a dolgukat. Ráadásul a modern élesítők még kontrasztadaptívak is, jó a NIS éppen nem ilyen, de a CAS például igen, tehát eleve nem torzít jelentősen.

#50660 Callisto : Kicsit vigyázzunk a RIS-szel, mert ha FSR 4-et használunk, akkor tuti RDNA 4-ünk van, és az hardverben implementálta a RIS-t, ami nem ugyanaz az algoritmus, amit a driverben szállít az AMD a többi GPU-ra. A hardveres RIS nagyrészt ugyanúgy működik, de nagyobb a feldolgozási tartománya, tehát az eredmény is jóval pontosabb. Ezért ez a driverben bekapcsolom a RIS-t nem általános érvényű, mert az RDNA 4-en ez számottevően jobb minőségű, mint bármelyik játékban szállított élesítő. A szoftveres megoldásokkal az a gond, hogy nagyon kell figyelni a kernel méretére, mert a sebesség szempontjából optimális, ha csak egy pass alatt lefut, tehát a feldolgozási tartomány méretét nagyban meghatározza az, hogy ne legyen túl regisztergyilkos. A hardverben implementált RIS konkrét célhardver, ott eleve úgy tervezheted magát a fizikai áramkört, hogy a feldolgozási tartomány legyen annyira nagy, amennyire kell. Itt nem számít a terhelés, mert úgysem a shadereket fut.

#50663 T.Peter : Abszolút, ha megpróbálod ugyanazt megcsinálni raszterben, amit RT-ben, akkor valószínű, hogy találsz rá valami trükkös megoldást, főleg a compute shaderek világában, de esélyes, hogy teljesítményben rosszabbul jössz ki vele. Viszont ez nem jelenti azt, hogy nem érdemes trükközni. Az Ubisoft külön csapatot tart arra, hogy kutassák az RT lehető leggyorsabb alkalmazási lehetőségeit. Például a Far Cry 6-ban példásan kombinálták a sugárkövetést a raszteres megoldással. Gyakorlatilag a visszaverődést úgy oldották meg, hogy amíg az minőségi hátrányt nem okoz, addig SSSR-rel működik, ahol pedig ez a technika nem működik jól ott RT-vel. Az eredmény rendkívül hasonló képminőség lett ahhoz, mintha csak RT-t használtak volna, miközben bő 50%-kal gyorsabb lett a hibrid megoldásuk. Ugyanezt eljátszották az árnyékokkal is, bár ott nem nyertek ennyit. Tehát az, hogy van RT nem jelenti azt, hogy nem érdemes optimalizálni és gondolkodni.

-

Abu85

HÁZIGAZDA

Ez nem egy élesítési probléma, hanem a transformer modell alapvető működéséből eredő jelenség, ami kivédhetetlen. Tudom, hogy látszólag élesnek tűnik, de nem az, a gond az, amit leírtam.

#50646 Ancsika99 : Nem lesz. Mint írtam ez pusztán abból eredő tényező, hogy a technológia elvi működése mellékhatásként előhozza a szóban forgó képi jelenséget. Ha az AMD vagy az Intel készít hibrid CNN+transformer modellt, akkor ott is bejátszik majd az az elvi működés, hogy minden elem figyel a többire a feldolgozás során, ami a kellemetlen mellékhatás konkrét okozója.

Ezt fontos megérteni, mert így látszik, hogy ez nem bug, hanem feature, még akkor is, ha nem kellemes a jelenség. Szóval ezt nem az NVIDIA rontja el, hanem az alkalmazott eljárás működési elve ilyen. Persze a transformert sosem képi feldolgozáshoz szánták, de elvi szinten lehetséges.

-

Alogonomus

őstag

Persze figyelmen kívül lehet hagyni a teljesítményfaktort, és mindent beleszámolni amit konzolként adtak ki, de ha a Geforce GT 1010 teljesítményének is csak a felére képes Switch beletartozik, akkor már a handheld vonalon a PSP-től kezdve is beleszámolhatunk mindent, ahogy desktop vonalon a Dreamcast, PS, GameCube, Xbox, Wii is beleszámít. Függetlenül attól, hogy valójában mennyire potens teljesítményre képesek.

A PS5 Pro valós teljesítménye egyébként az RX 7800 XT – RTX 4070 – RTX 3080 szintjén van. -

S_x96x_S

addikt

Ha az általad kiemelt táblázat tartalmazná

a VRAM/$ sort, akkor nem hoztam volna fel.

De nem tartalmazta, és ezért volt a megjegyzés.A táblázat amúgy is csak egy pillanatkép.

Egy adatközpontban 1-3 éves lekötésnél - amúgy is a jövőre fogadsz, és nem a mai benchmarkra. Az AI modellek nőnek, az optimalizációk változnak, de az extra VRAM ad egy rugalmasságot. A ROCm is gyorsan fejlődik vagyis a szoftveres hátrány csökkenhet, de a hardveres VRAM előny megmarad.

Ugyanez a logika érvényes consumer GPU-nál is.

A több VRAM = hosszabb élettartam ; nagyobb rugalmasság. -

S_x96x_S

addikt

nyilvánvalóan ebben a use case -ben ( "Our findings show that NVIDIA B200 does outperform AMD MI355X configurations for dense architectures and smaller MoE models." )

- az nvidiának pillanatynyilag előnye van.De más use casekre ideális lehet az AMD

mivel ugyanakkora árért

- 3x annyi VRAM-ot ad ( 2304GB vs 756GB )

- és extraként - ott van még 128 core CPU + CPU RAM = 3072GB

amúgy VRAM hiányos esetben még a Strix Halo APU (128GB) is lenyomja az RTX 5090 (32GB) -et.

Az AMD MI355-nél még az FP6 -ot preferálnám FP4 helyett,

mert azt kifejezetten kigyúrta az amd extra tranzisztorokkal.---

https://www.oracle.com/cloud/compute/pricing/

8*$8.60

BM.GPU.MI355X.8 8 x AMD MI355X 288GB Matrix Core CDNA 4 AMD Infinity Fabric VRAM = 2304GB CPU core = 128 CPU RAM = 3072GB ; 8 x 7.68TB ; 8 x 1 x 400Gb/sec RDMA

4* $16.00

BM.GPU.GB200.41 4 x Nvidia B200 189GB (NVL72)BlackwellNVIDIA NVLINK VRAM= 756GB ; 4 x 400Gbps InfiniBand $16.00

---------amúgy az Oracle már listázza a GB300 -at ( Blackwell Ultra )

ami több VRAM és gyorsabb hálózat,

és nem is értem, hogy miért nem az szerepel az összehasonlításban.

azzal szemben az AMD-nek csak 2x VRAM előnye lenne.

BM.GPU.GB300.42

4 x Nvidia B300 279GB (NVL72)Blackwell 4 x 800 Gbps $18.00 -

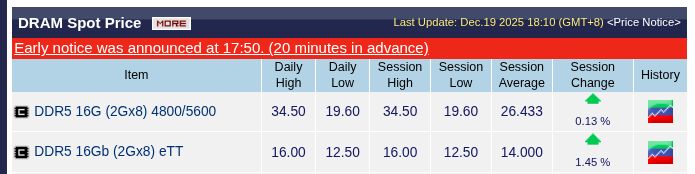

Kolbi_30

őstag

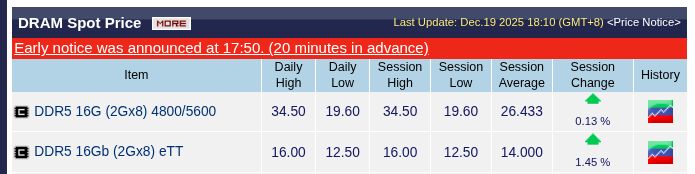

JA 2024.08 raktam ossze a gepemet, multheten gondoltam veszek memoriat, hogy kicsit legyen tobb...akkor 32 giga ddr5 45 ropi volt.. 64es kitet vettem volna alzarol...470k..meg hasonlok...aha koszi..lehet eladom a piicsaba a gepemet a penzt elrakom es hasznalom a laptopot..eleg durva vicc lett ismet a pc hobbi..

-

Alogonomus

őstag

Az egy év múlvát persze úgy értettem, hogy mondjuk majd a 2027-es CES-en bejelentik az új kártyákat, amik valójában persze hónapokkal később kerülnek a boltokba. Kepler is 2027 közepéről írt.

A memóriaárak elszabadulása messze nem annyira érinti a GDDR6-ot használó RX 90-es vonalat.

500-600 ezer nem lesz sem az 5070Ti sem a 9070XT.

A 9070 XT 270 ezres árán is kényelmes nyereségük lehet a gyártóknak és kereskedőknek. A memóriahiány elvileg csak 8 GB-onként 10-20 dollárt emel az árakon, de még ha az végül dupla akkora is lenne, az is csak mondjuk a jelenlegi 330 ezres 5070 TI árakig lökné a 9070 XT árakat.

Az 5070 Ti pedig már a jelenlegi 20% felárral sem igazán kelendő, szóval még 330 ezres 9070 XT árak mellett is legfeljebb szűken 400 ezer lehetne majd.

Az RX 90-es kártyákkal piaci részesedést akarnak szerezni, ezért nem fogják túlságosan drágán árulni. Az RTX 50-es kártyákat pedig azért nem adhatják drágán, mert ott vannak alternatívaként az RX 90-es kártyák.

500-600 ezer környékén legfeljebb az eddig nagyjából csak MLiD által pedzegetett "5080 killer" RX 90-es kártya lehetne majd, ha tényleg érkezik idén év elején. Azzal az állítólag 32 GB-os és az eredeti Navi 48-hoz képest 20%-kal magasabb üzemelési frekvenciára képes áttervezett Navi 48 "v 2.0" GPU-val szerelt kártyával már rámehetnének az 1200-1700 dolláros 5080 piaci szegmensére is egy mondjuk 900 dolláros RX 90(80) kártyával.

A maximalisták számára pedig nyilván megmaradna a pletykák szerint akár pletykált 4-5 ezer dolláros árig is emelkedő 5090. -

X2N

őstag

A lényeg az hogy neked mi az elfogadható.

A gyártó sz@rik rá amíg nem akarják beperelni. Bírja ki a kártya a 3 évet aztán kalap/kabát.

Nekem nem ez az elképzelésem, én azt szeretném hogy addig legyen jó a kártya amíg teljesen el nem avul, ami az én esetemben 7-10 év lesz a 7900XTX-el. Ezért is vettem ezt csúcskarit 3 évvel ezelőtt megjelenéskor, 4K-ra kellett minél több VRAM-al. Ki akarom próbálni hogy a saját gépemben normális tárolási körülmények között meddig megy egy ilyen kártya úgy hogy nincs sag, mert az oldalára támaszkodik a kártya, normális használat mellett, évi 1x takarítással. Leégős NV kártyával nem volt kedvem kísérletezni, pedig egy 3090-4090 se lett volna rossz, de akkor az egy használt kártya lett volna ismeretlen előélettel.

-

X2N

őstag

Itthon nem biztos h népkártya az 5070 és afölötti nv ezért nem látod. A másik hogy ezek az emberek nem is használják ki igazából azokat a kártyákat. Annyi órát még nem tettek bele. Kevés olyan van aki egy 5090-est 16+ órákon keresztül használ 100%-on, vagy aki egész este renderel majd még napközbe is tolja a gépet. Azt viszont garantálni tudom hogy ha nekiállsz tuningolni egy 5090-est és tartósan 100%-ba terheled úgy hogy 600W- vagy felett fogyaszt nagy valószínűséggel már a garancia ideje alatt lesz égett csatlakozód.

Sok leégett csati van, Ha megnézed a külföldi vga javítós youtuber csatornákat doboz számra küldik nekik a leégett csatlakozós nv kártyákat.

Busterftw-Nézd ez így ide kevés lesz, ha minden gyártónál hullanának az RDNA2 kártyák akkor lenne probléma, de így h egy noname kínai gyártónál van csak egy minimál hibaszázalék ez akár az ő saruk is lehet, akár egy elrontott hűtés leszorító/rosszul megtervezett hűtés, gyenge pcb miatt is lehetnek ilyen problémák nem beszélve a rossz tárolásról. Ez kb annyira probléma ebben a mennyiségben h nem éri meg foglalkozni se a hiba feltárásával.

Ahogy az előző Ryzenes problémánál is érdekesnek tartom hogy csak 1 internetes kávézóban hibásodik meg a 150 processzorból a processzorok 10%-a...

Érdemes lenne utánanézni milyen lapokba lettek rakva ezek a processzorok és milyen feszültségekkel üzemelnek. Az a sanda gyanúm hogy a túl magas VSOC feszültség nyírja a procikat, ahogy megjelenéskor is előszeretettel állítgattak be 1.3-1.4V-okat. Majd amikor ment a balhé akkor ezt bios frissítés után 1.3V-ban maximalizálták(elméletben). Manapság 1.2V-al szoktak ezek menni de én nem vagyok róla meggyőződve hogy az X3D-k ennyire bírják ezeket a feszültségeket, a simák lehet jobban bírták, az X3D-lehet háklisabb. -

Nem árt tisztában lenni a tervezési problémákkal. Ugannis elsősorban nem a csatlakozóval van a probléma, hanem a kártyákon spórolnak mivel lespórolják róluk a load balancing-ot. Ezért lehetséges az, hogy a csatlakozó valamelyik tűjének rossz érintkezése esetén a többin veszi fel a kártya az összes szükséges áramot. Ezért hullanak el. A csatlakozó/kábel valóbasn 600W-ra van tervezve, de nem vezetékenként, hanem összesen.

-

X2N

őstag

"A 3000 széria nem volt ebben érintett ott ez jól működött."

Az hogy ez a széria működött attól még nem lesz jó ez a csatlakozó.

Attól h valami működik még nem biztos hogy jól meg is van tervezve.300-400W-os videokártyákat én nem szeretnék pc-kbe, 300W+ az rengeteg teljesítmény, ott már nem lehet bohóckodni a gyártóknak se.

Évek óta hullanak a Ryzenek, hol ASRockban, hol Asus-ban. Az a szerencséjük hogy nem annyi mint Intelnél a legutóbbi blamánál.

-

Alogonomus

őstag

Pontosan erre utaltam. Egyedül a divat követése érdekében van értelme a minél kisebb helyet elfoglaló kábelezésnek.

Aki a számítógépházára nem csak funkcionális eszközként tekint, hanem szobadíszként is, és ezért lehetőleg minél több RGB elemet is belehelyez, nekik hasznos az egyetlen csatlakozós megoldás, hogy azáltal a számítógépházukban elhelyezett divatos elemekből a kábelezés minél kevesebbet takarjon ki. Cserébe pedig bevállalják az egykábeles verzióval járó extra kockázatot.RTX kártyák esetén a középkategóriától kezdve erről nem dönthet a custom gyártó, míg RX kártyák esetén teljesen a custom gyártó döntésén múlik az extra kockázat bevállalása. A döntésük eredményeként pedig kénytelen a Sapphire vagy Asrock vezetés lenyelni azt, hogy az érdeklődők egyre több olyan cikkbe futnak bele, amit újabb Sapphire vagy Asrock kártya tönkremeneteléről írnak, ezzel az érdeklődőket inkább egy másik gyártó RX kártyája felé terelve.

-

S_x96x_S

addikt

Alatta kettővel van a Data center és Cloud szval nem hinném hogy fontossági sorrendet takar

természetes fókuszváltás

és ez valamennyire fontossági sorrendet is takar

( a marketingben is )Most a "Gaming and Creating" a 4. helyen szerepel

[ "Artificial Intelligence", "Design and Simulation", valamint "High-Performance Computing" után. ]Egy régebbi vátozatban

a gaming megelőzte az AI-t és a AI + data centert is.

https://web.archive.org/web/20191231174328/https://www.nvidia.com/en-us/az Nvidia átpozicionálta magát AI vállalattá, a

és a Gaming már másodlagos,

az a szerencse, hogy egységes architektúrát alkalmaznak és az AI valamennyire húzza a gaming-et is// az AMD -nél a szétválasztás utólag már nem volt szerencsés, amit az UDNA -val próbálnak javítani.

-

proci985

MODERÁTOR

Aha, arra, amiatt vállalható, az árán is. Teljesítménye megvan.

Ára horror, de utóbbi hat évben mindennek az. Cserébe a 3 éves 7900XTm jobban tartja magát, mint anno a 290X CF ennyi idősen.

---

Ami para viszont, hogy a fiataloknak nincs pénzük PCt építeni. Ez IT szakembereknél szívás, amikor a képzésben kiderül, hogy sose rakott össze saját PCt.

-

-

Jacek

veterán

Mondom top es low hutest hasonlitasz.

Nincs problema mert ezt mar nehez ertelmes embernek tagadni. En is NV mondtam neked nincs azzal problema.

Azzal van problema ha ezt tagadja valaki, szerintem most meg jobban fog nyilni az ollo arban.De ahogy irtak lejebb ha qhd felbontas van legjobb a 9070 sima.

-

Jacek

veterán

Hogy vettel te uj Primet az alzan 300e-ert? Legolcsobb windrorce ssf 351e.

Na hanolvastal teszteket a Sappgire Pulse a egyik leghalkabb hutessel rendelkezo kartya 25dbi a tpu szerinti tesztben, volt vagy 5 nalam full kuss hibatlan kisnkartya es a legolcsobb.

Ellentetben volt a gepemben Prime 70Ti hat en attol biztos nem ajultam el, kozepszer messze van a top tiertol.Nincs most az alzaban Prime Ti de egyebkent itthon 360e a legolcsobb

Ez 100e dragabb egy pulse XT-nel, es hidd el jobb a Pulse hutesen mint a Prime. -

Jacek

veterán

Az mar regen a mult..

245e vs 340e ez a kulombseg most a heten 9070TUF vs 5070TUF lehet ez tagadni veletlenul atsiklani folotte nagylelkuen

Mennyiert vetted hasznaltan a Primot?

230e-ert adtam el mult heten 9070XT-ben...

70k a kulonbseg e hasznalt vs uj

De hat ezek elhanyagolhato tenyezok tudjuk

-

hokuszpk

nagyúr

a klasszikus közgazdaságtan szerint ilyen esetben ilyenkor újabb szereplőknek kellene a piacralépniük, hogy kielégítsék a keresletet ; csakhogy a chipgyártók pontosan tudják, hogy

- egy új gyár felhúzása k*sokba kerül

- a szükséges technológia fejlesztése k*sokba kerül

- ha valaki mégis bepróbálja, akkor nincs az az isten, hogy ne szegjen meg valami TSMC/Samu/Hynix/Intel/Toshiba/NVidia/Amd/*.* szabadalmi védelmet a fejlesztés során.azaz kb. esélytelen, hogy friss konkurrencia lépjen be, és moderálja az árakat. Max. a Kínaiaban bízhatunk, hogy összelopják a szükséges szellemi tőkét és leszarják a patenteket, ahogy a rendes üzletmenetükben szokták.

-

Abu85

HÁZIGAZDA

Én nem akarok most lufizni, tehát arra nem reagálnék, de pusztán a TSMC szemszögéből az a fő gond, hogy ők ugyan biztosítják a gyártástechnológiát, de ezt ők is úgy teszik, hogy nekik is szükségesek a tömeggyártáshoz szükséges eszköz. Na most ezt ugyanúgy beszállítóktól szerzik, és a beszállítók által biztosított ellátás limitálja azt, hogy mennyire tud bővülni a gyártás. A legtöbb esetben azért, mert a TSMC és a modern chipgyárak által használt csúcstechnológiás berendezések összerakási ideje nagyon sok hónap. Tehát mindegy, hogy a TSMC lát-e az AI-ban fantáziát, az számít, hogy mennyi berendezést tudnak szerezni a partnereiktől a gyáraikba, és alapvetően úgy építik a gyárakat, hogy kb. minden elérhető eszközt megvesznek. Szóval itt egy beszállítói limit van, ami akadályozza a gyártókapacitás bővítését. És pont az a gond, hogy ezen a ponton nagyon nehéz növelni az ellátás sebességét, mert annyira bonyolultak ezek a berendezések, hogy iszonyatosan sok komponensből épülnek fel, és iszonyatosan fontos, hogy amikor leszállítják őket, akkor be legyenek állítva, szuperül működjenek stb. Tehát ez nem pusztán egy gyártási kérdés, itt azért nagyon komoly technikai személyzet van a háttérben, és az ultimate limit egy ponton az elérhető, kellően képzett humánerőforrás lesz. Ebből érthető szerintem, hogy ha a TSMC mondjuk azt mondja holnap, hogy kéne háromszoros kapacitás egy év múlva, akkor sem tudják megcsinálni, mert egyszerűen a legszűkebb keresztmetszetek már így is a limiten dolgoznak.

-

FLATRONW

őstag

Ahogy ismerlek, 150 euro felárnak nem kéne, hogy számítson. Mivel neked is (mint nekem), fontos a jobb RT és PT teljesítmény, a valamivel alacsonyabb fogyasztás, a jobb felskálázás és a többi szoftveres dolog, ennek nem szabadna kérdésnek lenni. Persze ha minden cent számít, akkor nem szóltam semmit.

-

S_x96x_S

addikt

nem tudom - csak feltételezem 2026 első félévére.

az alapján, hogy az nvidia 30-40% -al tervezi visszavágni az RTX 50 termelést, ami számomra nagyobb áremelkedést ( vagy kapacitáshiányt vagy keresletcsökkentést ) feltételez,

mint az amd ( $10 per 8GB) áremelkedéséből fakadó keresletcsökkenés.És az is fontos hír, hogy az nvidia a jövőben nem ad GDDR7-et a GPU-hoz, vagyis az AIB-knek még drágább lehet a GDDR7 memória beszerzése. ( az nvidia által kialkudott árakhoz képest is +10-20% )

persze lehetnek előre nem látott tényezők.

az AMD-nél a túlzott sikeresség lehet a legnagyobb probléma,

pl. nem kötöttek le - több évre előre - annyi GDDR6-os mennyiséget mint amire a piacnak igénye lenne;

persze a 32GB-os R9600 és a 16GB-s RX9060 elég nagy optimizmusról árulkodik;( lesz elég memória - mégha drágább is ;

vagyis 2026 első félévére nem várok túlzott megelepetést ; -

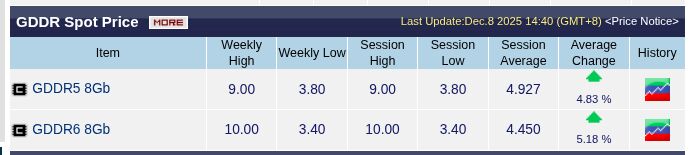

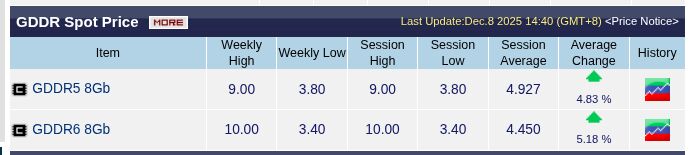

S_x96x_S

addikt

> Én azt gondolom egyáltalán nem lesz kivétel az áremelkedés alól

mindegyik növekszik, de nem egyforma mértékben.

a GDDR7 jobban növekszik mint a GDDR6

vagyis az árkülönbség még nagyobb lesz.onnan lehet tudni, hogy a GDDR7 olcsóbb mint a GDDR6,

hogyha az RTX5050 -et is GDDR7-el fogják adni. -

S_x96x_S

addikt

szerintem az nvidia jobban emelkedik,

ugyhogy ha most akarsz venni, akkor a feláras nvidiával jobban jársz. (1 év múlva eladod és veszel belőle két AMD -t )az AMD már tudjuk hogy emel, az kérdés mennyire szűkíti a jelenlegi ollót az 5070 Ti és a 9070XT között. De igazából a piaci trend úgyis felrántja majd mindkét kártya árát lásd SSD és memória.

Nem egyforma mértékben.

Amig a https://www.dramexchange.com/ - en

nem látható a GDDR7 ( csak a GDDR6 )

adig én a GDDR6-nál kisebb áremelkedést spekulálok.

( GDDR6-ot most már csak az Intel és az AMD gpu-k használnak;

és a desktop NVIDIA GeForce RTX 5050 )

elég életveszélyes a trend ...

lassan a GDDR6 is job árban lesz mint a PC-s DDR5

( és itt most a DDR5 emelkedés miatt sírok )

)

-

KAMELOT

titán

Mivel hosszabb távra veszed, így 5070Ti

60k az 150€ ebben az esetben nem pénz, főleg ha szétosztod legalább 24 hónapra (hogy addig lesz nálad a vga) !

Ha a rambuli már az 5060Ti-t befolyásolja akkor az összes vga-val is ez lesz.

Ezt kilövik a kínálatból, mivel kicsi a haszon rajta. Maradnak a nagyobb kártyák. AMD esetén viszont majd emelni kell az áron, kérdés lesz e elég memória a legyártáshoz.Busterftw: AI játszásról volt szó nem arról, hogy béreled a GPU-t. Mi abban a pláne, hogy valaki játszik helyetted?!

-

S_x96x_S

addikt

-

hokuszpk

nagyúr

akkor idézem.

""Én nem látok képminőség különbséget"

Én meg objektiven igen, szerintem szemészet ajánlott."vagyis ez a két kép a minőségbeli különbségek szemléltetésére van. Az fps annyiból fontos, hogy az RTX 4090 a mindneféle tesztek szerint gyorsabb, mint az RX 9070 XT.

ennek ellenére a képen a Radeonon van több max/avg/min fps ; amit nem lehet másként magyarázni, minthogy a Geforce magasabb felbontáson vagy minőségibb textúrapakkal renderelt. Esetleg a Radeon framegennel ment, a Geforce meg nem. Akármelyik eset igaz, a Radeon képe így valóban rosszabb, de mégis almát a körtével összehasonlítás.*** még ha a KB5066835 -t is beleszamoljuk, akkorsemhiszem, hogy ennyit lassítana az NV zsugán.

-

hokuszpk

nagyúr

azert nezd meg Buster képét.

lehet pillanatfelvetel, de 57/47/35 vs 99/74/71 fps szerintem eleg jelentos.

b verzió, hogy a minosegi bizonyitásra berakott egy olyan kepet, amit az egyik kartya joval nagyobb felbontasban renderelt vagy jobbminosegu texturakkal ; esetleg az also kartya renderelesi minosege le volt butitva.

az is lehet, hogy az egyik egy RTX 3050 a masik meg Radeon 9070XT ; de valahogy ezt tartom a legvaloszinutlenebbnek. / foleg, mert a felso kartya valami 40xx csak nem 4090 ? / -

PuMbA

titán

Persze, az OBS megkerülhetetlen a legtöbbeknek és a YouTube videók pedig sajnos több hónaposak. Például a mostani, szeptember végén kijött 32-es OBS főverzióban lett átállítva az alapértelmezett AMD enkódolási beállítás:

"Updated the default settings for AMD encoders [rhutsAMD]"

Illetve lett AV1 színkódolás is javítva:

"Fixed incorrect color range property setting for AMD AV1 encoder [rhutsAMD]"

Fogalmam sincsen, hogy NVIDIA és az AMD milyen ütemben dolgoznak az OBS-en, de itt sok múlik magán az OBS-en, hogy hogy használja és milyen konfigurációval a gyártói enkódert. Az AMD Software-ben ezt maga az AMD állítja be.

-

PuMbA

titán

"Itt van egy másik videó ami feketén fehéren leírja mi a gáz, ezt ignorálod?"

Ebben a videóban OBS-t hasonlítanak, nem az AMD által tudott videó minőséget

Az általam linkelt videómban el van mondva, hogy OBS-t kihagyva vetette össze a képminőséget és látható is, hogy hasonló minőségeket tudnak a kártyák. Az, hogy az OBS rohadt lassan reagál AMD-s dolgokra, az egy más kérdés és biztosan máshogy is kell beállítani, mint NVIDIA esetén.

Az általam linkelt videómban el van mondva, hogy OBS-t kihagyva vetette össze a képminőséget és látható is, hogy hasonló minőségeket tudnak a kártyák. Az, hogy az OBS rohadt lassan reagál AMD-s dolgokra, az egy más kérdés és biztosan máshogy is kell beállítani, mint NVIDIA esetén."Miért akarod közben bebizonyítani hogy a másik szar? Nem,nem szar. ."

Én? Raktam be egy videót, amiben tények vannak, erre elkezdtétek szétszedni, hogy ezért nem igaz, meg azért és eljutottunk a teljes streamelési ökoszisztémához, aminek már semmi köze az eredeti témához, mert nem bírtatok beletörődni. Továbbra sem értem, hogy miért kéred rajtam számon ugyanazt, amit Ti csináltok.

Jacek: Rá....már tényleg kezdem unni, azt hiszem ma befejeztem. Ez egy jó dátum erre, December 1.

-

Abu85

HÁZIGAZDA

Ez specifikusan az OBS problémája. És látszik a képen, hogy nem is az encode hardvert terheli a feladat, hanem a 3D engine-t. Amiről viszont szó van azok a gyári szoftverek, amelyeket a gyártók fejlesztenek és csomagolnak a driverbe. Technikai megvalósításban messze ezek a leghatékonyabbak. Az, hogy az OBS ezekkel nem tartja a lépést azért van, mert az OBS egész éves büdzséje annyi, amennyit az AMD és az NV egy óra alatt elkölt driverre. Nyilván nem fognak tudni gyári színvonalat kínálni a technológiai megvalósítás terén. Nem is feltétlenül kapják meg ugyanazokat a lehetőségeket a gyártóktól. Ezért is jött a Vulkan video. Csak ez sosem lesz versenyképes a direkt hardvereléréssel, ami megvan az AMD-nek és az NV-nek. És igen, ennek lehet nagy ára a működésben, akár a VRAM kapacitását is jól lefoglalhatja. De ettől technikailag nem kell így lennie, csak nullához közelítő pénzből ennyire futja programszinten.

-

Abu85

HÁZIGAZDA

Ennek semmi köze a memória mennyiségéhez. Maga a streaming nagyjából 100 MB-nyi extra adat csak. Minden más már ott van eleve a VRAM-ban. A problémát nem a memória mennyisége adja, hanem a copy műveleteknél a rendszerek viselkedése, ugyanis máshogy terheli a PCI Express buszt az AMD és az NVIDIA dizájnja. Ahogy fentebb írtam a GeForce nagy copy műveleteket alkalmaz, és addig megszakítás nélkül csak azzal a művelettel foglalkozik, amíg be nem fejeződik, és ez egy nagyobb adatmásoláskor megakasztja a GPU-t. A Radeon burst rendszer, vagyis a teljes nagy műveleteket apró szeletekre bontja. Emiatt amint végez egy szelettel, rögtön be tud szúrni egy compute és/vagy egy graphics parancsot, így a GPU munkavégzése sosem áll le.

Tehát teljesen mindegy, hogy mennyi memóriával veszed a hardvert, az a 100 MB, ami kell némi extra adatnak nem oszt nem szoroz. A PCI Express busz van recording esetén aránytalanul terhelve, és ott a világ összes memóriája sem tud neked segíteni, mert maga a recording koncepciója az, hogy a tárolt adatot írd ki az adattárolára, tehát muszáj kimásolni.

Alapvetően az új generációban már nagyon jó minden szempontból a minőség, és a VRAM sem számít, hacsak nem rossz a program, amit használsz, mert ilyen is van. De ezért kínál gyári cuccot az AMD és az NVIDIA is, mert azok biztosan jók. Az egyetlen valós különbség, hogy másképp lassulnak a gyártók hardverjei, de ez is a PCI Express miatt van. És itt egyébként biztosan befigyel, hogy az 5.0 jobb a 4.0-nál.

-

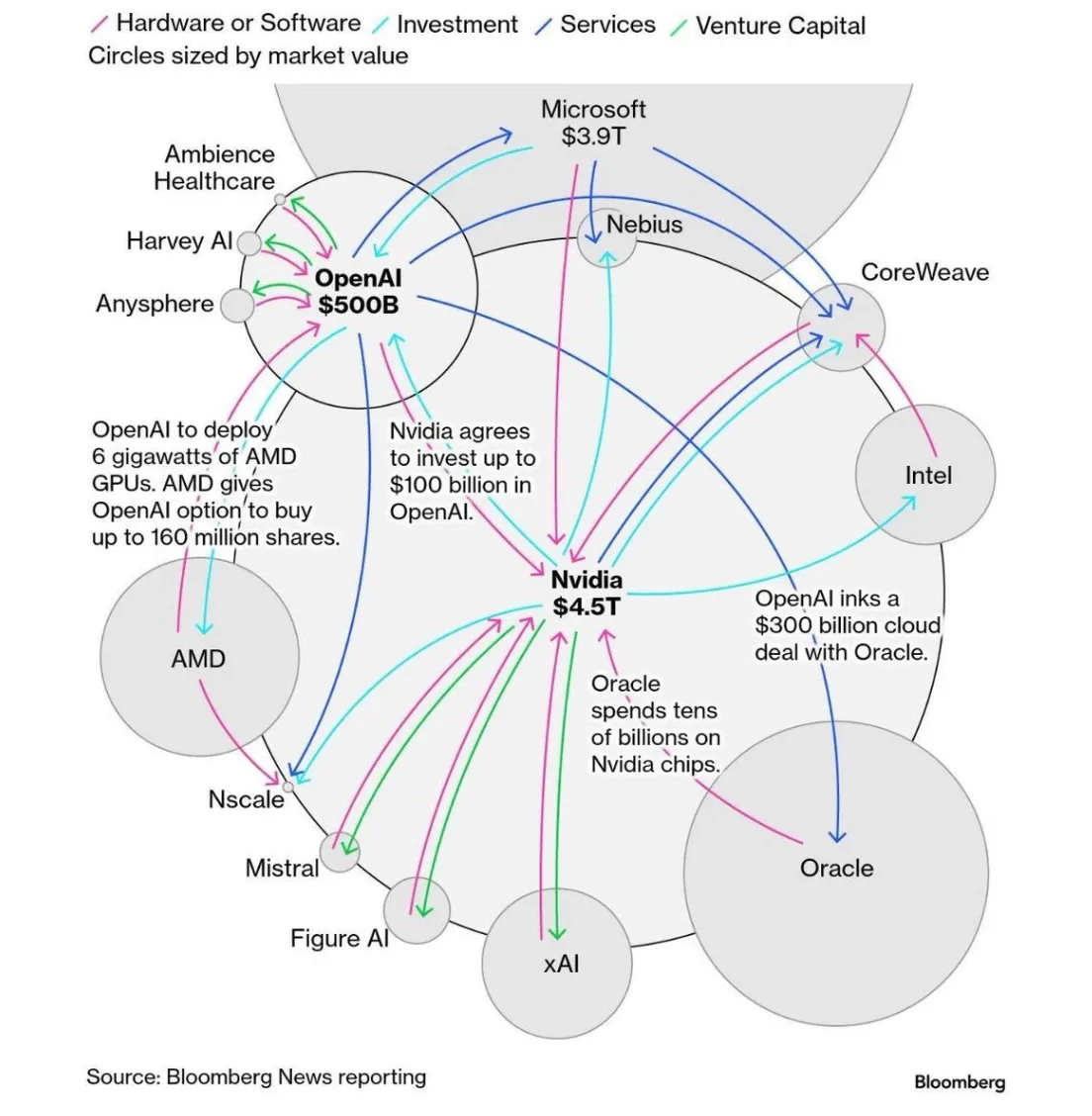

S_x96x_S

addikt

Engedd már el ezta bullshittet hogy mindenben a nagy gonosz Nvidiát látod ... Egy hatalmas f...g már ne haragudj meg. Az Nvidia építette fel ezt a bizniszt.

1.)

Bár az Nvidia építette a piacot ;

és most DOJ-vizsgálat alatt áll

( versenytörvényellenes magatartás gyanúja miatt )

de fontos lehet külön kihangsúlyozni,

hogy önmagában a picaépítés nem ad biankó csekket a tövényszegésre is.

( focis hasonlattal : egy jó focistának se engedélyezett

a szabálytalankodás a pályán ;

és olyan szabály sincs, hogy 10 gól után szabálytalankodhat. )és én ugyanúgy elitélem az ATI szábályszegését is.

( amit amúgy az nvidiával követtek el )

"Acording to the plaintiffs, Nvidia and ATI allegedly violated federal antitrust laws by conspiring “to fix, raise, maintain and stabilize prices of graphics processing chips and cards.” As well, the plaintiffs contended that both Nvidia and ATI were unlawfully colluding “to coordinate new product introductions.” The plaintiffs were seeking “triple damages, attorney fees and the costs under the federal antitrust laws.” The certified class is limited to “all individuals and entities who purchased graphics processing card products online from the defendants’ websites in the United States during the period from December 4, 2002 to November 7, 2007.”

https://www.tomshardware.com/news/Nvidia-ATI-lawsuit-antitrust,6421.htmlVitakozhatunk itt a végtelenségig erről ;

de én kitartok,

hogy lehet tövényesen is versenyezni;2.)

A TPU teljesítményéről lehet és kell is vitatkozgatni,

bár a hivatos review-ket meg kell várni.Papiron amúgy nagyon jó

és bár az is lehet, hogy Sam Altman szőtte az összesküvést;

mindenesetre az nvidia ráharapott a csalira.2025 Junius 10: "Exclusive: OpenAI taps Google in unprecedented cloud deal despite AI rivalry, sources say"

2025 Junius 28: "OpenAI turns to Google's AI chips to power its products, source says"Amúgy az aggódás nem volt alaptalan az nvidia részéről,

mert addigra a GoogleTPU már megszerzett 3 komoly ügyfelet

- "Apple"

- "Anthropic" ( Claude -os cég ; a Google befektető )

- "Safe Superintelligence" ( Ilya Sutskever ; a Google befektető )És lehetséges, hogy a Meta-t ( Facebook anyacégét ) is megszerzi

Valószínüleg az Apple-t volt a legkönyebb meggyőzni,

mert az Apple és az nvidia között

a múltban eléggé elmérgesedett a kapcsolat.> Dylan Patel, akinél nagyobb név azért nem igen van

Amúgy nekem a korábban emlitett

"Ilya Sutskever" 2-3 nagyságrenddel nagyobb név ,

https://en.wikipedia.org/wiki/Ilya_Sutskever

és Google TPU felhasználók. ( "Safe Superintelligence" )

Safe Superintelligence Inc. Uses Google TPUs Instead of Regular GPUs for Next-Generation ModelsAz Nvidia garanciákat akar és vár el tőlük 100milliós befektetésért és a 300 milliós hardver beszállításához és ez az miatt van,mert jensen nem hülye.

Érdekes a friss [ November 27, 2025 ] Reuters cikk,

"Artificial Intelligencer: How Google is borrowing Nvidia’s playbook"

lényegében: a Google a TPU chipjei terjesztéséhez ugyanúgy

ad finanszírozást mint az nvidia ;

És a versnyben már nem csak az ár és a teljesítmény,

hanem a finanszírozás is eléggé hangsúlyos.Vagyis az OpenAI

a Google-től nem csak az nvidia függőség csökkentését vagy nvidia árcsökkentést várt ;

( mert arra a Broadcom és az Amd is megfelelő )

hanem igazából a google pénzét/finanszirozását

ami még vonzóbbá tette a TPU-t.Vagyis az OpenAI csomagot vár ...

[GoogleTPU+Finanszirozás] vs. [NvidiaGPU+Finanszirozás]

Én azt se zárom ki, hogyha a végén mindkettő üzlet megköttetik. -

S_x96x_S

addikt

Valóság meg : [Analysis’ Hardware Benchmarking shows NVIDIA achieving a ~5x tokens-per-dollar advantage over TPU v6e (Trillium), and a ~2x advantage over MI300X, in our key inference cost metric]

ha google 5x sebességre lép előre és ugyan ezen az áron adja mint a V6e modellt ( amit kétlek)akkor is csak utolérné az Nvidia H100 gyorsítót nem hogy előnye lenne.

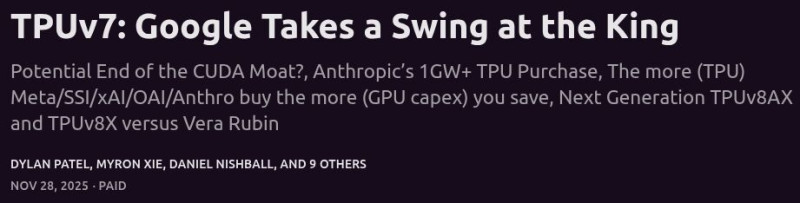

A kedvenc szakértőd ( "Dylan Patel" )

az általam korábban linkelt cikkben

egy külön bekezdést szentelt

az általad linkelt tpu bench kritikájának.https://newsletter.semianalysis.com/p/tpuv7-google-takes-a-swing-at-the?open=false#%C2%A7vllm-tpu-benchmarks-are-not-relevant-yet

"""

vLLM TPU Benchmarks are not relevant yet

This week, there was an new inference benchmark on TPUv6e that dropped claiming that TPUv6e has 5x worst performance per dollar than NVIDIA GPUs. We disagree mainly due to 2 reasons. First of all, this is benchmark is on vLLM on TPUs which was only released an couple month ago thus does not yet have optimized performance. Google internal Gemini workloads & Anthropic workloads work on an internal custom inference stack that has better perf per TCO than NVIDIA GPUs.

Secondly, Aritifical Analysis’s cost per million tokens is using the list price of $2.7/hr/chip for TPUv6e. No major customers of TPUs is paying anywhere close to that much for TPUv6e given the BOM is a tiny fraction of the H100. As everyone knows, most clouds have an high ball list price such that their account sales executives can do “car salesman” tactics and give massive discounts so that the customer thinks they are getting a good deal. The SemiAnalysis AI TCO Model tracks the acutal market rental price of TPUs across all the various contract lengths (1 month, 1 year, 3 years, etc).

"""" -

S_x96x_S

addikt

Mindjárt dobom a linket.

Dylan Patel, akinél nagyobb név azért nem igen van ebben milyen gúnyosan nyilatkozott erről amire most többen( köztük te is ) rácuppantatok. [link] itt meg a humoros verzió: [link]

???

Kérlek nézd meg, hogy ki fő szerzője annak

a cikknek amit belinkeltem [ hsz_50170 ]

és akkor rájösz, hogy "Dylan Patel"

Ő a SemiA cég főnőke

és a saját cikkjét kommentálta a nagy egójával.![;]](//cdn.rios.hu/dl/s/v1.gif)

amúgy szerintem vannak nagyobb nevek.

pl. Jensen Huang neked miért nem jut eszedbe ?

-

S_x96x_S

addikt

ha google 5x sebességre lép előre és ugyan ezen az áron adja mint a V6e modellt ( amit kétlek)akkor is csak utolérné az Nvidia H100 gyorsítót nem hogy előnye lenne.

nyilvánvalóan a gyakorlati döntéseknél

te - se csak 1játék - 1tesztelő által végzett ad-hoc tesztjére

hagyatkozol,

mert sok minden félremehet.És az is tuti biztos,

hogy nem a te linkeden található teszt

alapján döntenek.[ Valószínüleg ]

a Google kiküldött 5-10 szuper fejlesztőt az Anthropic/OpenAI/Meta/*/* -hoz

akik az adott cég LLM modeljét

extrém módon kioptimalizálták

és pariba hozták az nvidiás megoldással,

és emellé tettek még egy vonzó költség ajánlatot,

ami nyilván nem az, amit kisembereknek a honlapon feltüntetnek.Emellé tedd hozzá, hogy az nvidia függést is diverzifikálni lehet ezzel a lépéssel, és igy az adott cégnek lesz alternativája, hogyha

az nvidia duzzogásból büntetni akarja őket.

És ezt nyiltan kommunikálják az ügyfeleknek,

( ~ megfenyegetik )

nehogy más AI céggel is próbálkozzanak,

mert annak következménye lesz.

Persze ezt a fenyegetést/kényszert

- polkorrektül "Agressziv Sales technikának" nevezik,

de annyira túltolta az nvidia,

hogy a hatóságok ( nem csak az USA ) elkezdtek vizsgálódni.

"Here’s why Nvidia’s aggressive sales tactics are in the DOJ’s crosshairs" ( Fortune ; September 4, 2024 )

( a vádak szerint "kötési megállapodásokat" alkalmaz az nvidia (pl. hálózati felszerelést kell venni az AI-chippel együtt),

és kizáró kedvezményeket adnak,

ha a vevők elkerülik a versenytársakat. )Az nvidia hozzáállása, valószínüleg még jobban gyorsítja

a cégek leválását az nvidiáról - amint van egy reális alternativa.

Az OpenAI-t csak erőfeszítéssel "TALÁN" sikerült kimenteni a GoogleTPU markából, ami az OpenAI - negyedik lába lett volna

az ismert másik 3 mellett (NVIDIA | AMD | Broadcom )

Azért csak "TALÁN "- mert még mindog nincs meg a végleges deal,Vajon miért nem akar még

mindig megegyzeni az NVidia és az OpenAI ?

2025-nov-20: "NVIDIA Says There’s No Guarantee OpenAI Will Proceed With the $100 Billion Mega-Deal, But the Firm Remains Disciplined With Its Execution"

amikor az AMD és a Broadcom deal már végleges;Szerintem (==spekuláció) a Google még jobb ajánlatott tett le az OpenAI -nak ; és most megy a további egyezkedés,

hogy az nvidia ad -e újabb kedvezményt.Ettől függetlenül az nvidia termékei műszakilag jók és toppon vannak, viszont egy jobb versenyhelyzet a piacnak és a technikai fejlődésnek is jobb lenne.

( Persze az nvidia az ökosziszitéma feletti kontrollban hisz, és egyre inkább kihagyja a partnereit ; és ennek a taktikának vannak előnyei és hátrányi is )Tanulságos az Intel 10-15 évvel ezelőtti hozzáállása;

ami az akkor monopol helyzetéből akadt. És annek a következménye az Apple - arm -ra váltása

( amint volt alternativa )---

a TREND ....

1.) a hyperscalerek (Microsoft, Google, Meta)

egyre inkább saját AI-chipet fejlesztenek,

csökkentve az nvidia-monopóliumot.

2.) az nvidia bruttó margó csúcsa (80% körül -2025 -ben)

már a múlté, mert a vásárlók alkupozíciója egyre erősödik.Fortune - November 18, 2025

"Nvidia looked invincible. Now it’s showing cracksBy helping fund buyers like OpenAI and CoreWeave, Nvidia is shaping demand for its own chips—along with the risks that come with it." -

S_x96x_S

addikt

> Trump már engedni is fogja sőt már engedi is a Chipek beszállítását.

Még csak konzultál ;

( bár Trump -ot eléggé könnyen befolyásolja a környezete, nehéz megjósolni, hogy mi lesz a döntés eredménye )"The president is consulting "lots of different advisers" in deciding on the potential exports, the report quoted Lutnick as saying."

"Trump weighing advanced Nvidia chip sales to China, Bloomberg News reports" ( nov24 )> Kína Nvidia chipeken tréningel szinte mindent. Most is.

A jövőben ez megváltozik.

Kína mainland -en mindenképpen.És bár néhány kínai cég - rövid távon még külföldön a legkorszerűbb chipekkel traningel ( hogy kikerülje az USA szankciókat ) - de lassan ez is meg fog változni.

Mindegyik nagy kínai AI felhasználó - elég erőssen ösztönözve van ( gazdaságialg és politikailag is ) - hogy hazai AI GPU-t használjon"China's tech giants move AI model training overseas to access Nvidia chips, FT reports"

"""

According to the report, there has been a steady increase in training in offshore locations after U.S. moved to restrict sales of the H20 chip in April.

Chinese companies rely on lease agreements for overseas data centres owned and operated by non-Chinese entities, the newspaper said, noting that DeepSeek, which gathered a large stock of Nvidia chips before the US export bans, was an exception with its model being trained domestically.

Deepseek is also collaborating with domestic chip manufacturers led by Huawei, to optimise and develop the next generation of Chinese AI chips, FT added.

Alibaba, ByteDance, DeepSeek and Huawei did not respond to requests for comment.

""" -

S_x96x_S

addikt

> ez a te képzegésed egy Google TPu hírre,

Nem irtam semmi ilyet,

és nem is képzeltem semmi hasonlót.vagyis csak a te fantáziád - hogy becsődől az nvidia ;

nem kell rám kivetiteni.

Ezt mégis te irtad:> sőt,csődöt jelent és kiszáll a versenyből.

Amúgy miért jelentene csődőt az Nvidia;

Semmi oka sincs rá.A Market share -e viszont jelentősen csökken.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- AKCIÓ! Intel Core Ultra 5 235 14 mag 14 szál processzor garanciával hibátlan működéssel

- 226 - Lenovo LOQ (15IRX10) - Intel Core i7-13650HX, RTX 5060

- Apple iPhone 14 128GB,Újszerű,Dobozaval,12 hónap garanciával

- iPhone X 64Gb akku 100%

- GYÖNYÖRŰ iPhone 14 Plus 128GB Starlight -1 ÉV GARANCIA - Kártyafüggetlen, MS4458

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

akik 5-8 gyereket szulnek svedek meg nem akarnak....

akik 5-8 gyereket szulnek svedek meg nem akarnak....

8x FG gondolom meglesz a 4k-240.

8x FG gondolom meglesz a 4k-240.

)

)

![;]](http://cdn.rios.hu/dl/s/v1.gif)