Új hozzászólás Aktív témák

-

S_x96x_S

addikt

válasz

KAMELOT

#51081

üzenetére

KAMELOT

#51081

üzenetére

> Amikor jön a Rubin

A GTC-n valamit belejelentenek

( Groq LPU ? )"NVIDIA’s CEO to Unveil Chips the “World Has Never Seen Before” at This Year’s GTC, Likely Pointing Toward Rubin or Next-Gen Feynman AI Lineups"

https://wccftech.com/nvidia-ceo-to-unveil-chips-that-the-world-has-never-seen-before/ -

-

S_x96x_S

addikt

válasz

KAMELOT

#51038

üzenetére

KAMELOT

#51038

üzenetére

Ezt így felesleges számolni, mert ha az 5090 mellé teszel egy erős cpu-t akkor még ettől is jobban megy.

milyen erős CPU -ra gondolsz ??

Mert amit belinkeltem azt - ezzel a konfiggal mérték:

[ AMD RYZEN 9 9950X3D![;]](//cdn.rios.hu/dl/s/v1.gif) / X8670E Taichi / 2x 16GB DDR-6000MT/s / WD_BLACKSN850X ]

/ X8670E Taichi / 2x 16GB DDR-6000MT/s / WD_BLACKSN850X ]> Ezt így felesleges számolni,

Én nem hiszem hogy felesleges lenne,

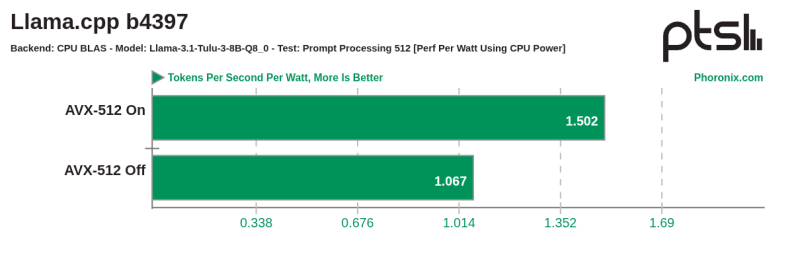

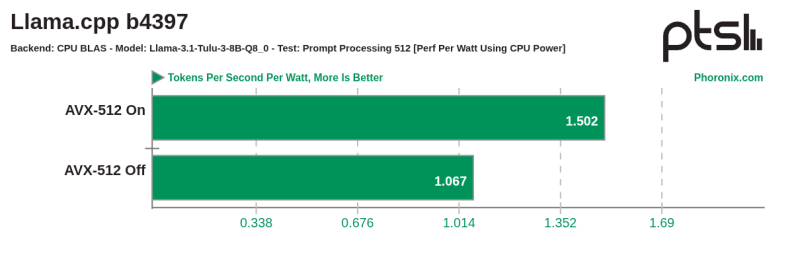

a Phoronix elég jó teszteket szokot készíteni.A legnagyobb probléma, hogy a gyárilag konfigurált CPU / GPU -k

nem mindig a leg-nergiahatékonyabb beállításokkal futnak.És az AVX-512 hatékonyságát is egyszerűen lehet szemléltetni.

( ami sajnos a consumer Intel cpu-kban most még nincs )

-

proci985

MODERÁTOR

válasz

KAMELOT

#50997

üzenetére

KAMELOT

#50997

üzenetére

ja meg a hűtés, meg amikor az egyik idióta app (pl rád gondolok MSI Ledkeeper2) beragad a busy waitben 100%on egy szálon, amit az ütemező szépen eldobál a magok között, én meg nézek, hogy miért 60 fokos a desktopon az 5950X. Úgy, hogy közben a CPUn belül 15 fok van a legmelegebb és leghidegebb mag között.

400Wot talán LN2vel lehet huzamosabb ideig meghűteni desktop CPU méretben, már az is baromi sok.

-

X2N

őstag

válasz

KAMELOT

#50893

üzenetére

KAMELOT

#50893

üzenetére

Techpowerupnál néztem most az újabb ryzen proci teszteket, és rendre a ramokat csak a gyári expo-beállításra állítják be, ezekkel tesztelnek:

9950X review:

2x 16 GB DDR5-6000

36-36-36-76

Infinity Fabric @ 2000 MHz

9950X3D review:

2x 16 GB DDR5-6000

28-36-36-76

Infinity Fabric @ 2000 MHz

Aki arra nem képes hogy 16 magos csúcs processzor tesztnél beállítson egy normálisabb időzítést ezeknek a ramoknak pár másodlagos időzítés beállításával,, csak bekapcsolja az EXPO-t bios-ban és ezzel ki is merült a beállítás, az inkább ne is készítsen teszteket. CL36,28-as időzítéssel 67,77ns késleltetés

Tuning rész is kimerül abban mi a maximális órajel cpu-ramokon, semmi optimalizálás. -

PuMbA

titán

válasz

KAMELOT

#50893

üzenetére

KAMELOT

#50893

üzenetére

AI botokat nem alkalmaznak YouTube komment írásra

De ha erről tudsz mutatni valamit, hogy igaz állítás, akkor megnézném.

De ha erről tudsz mutatni valamit, hogy igaz állítás, akkor megnézném.Továbbra is úgy kóklerezel le embereket / YouTube csatornákat a neten, hogy nem indoklod meg, hogy mit tettek, ami miatt kóklerek, ami nem szép dolog.

-

PuMbA

titán

válasz

KAMELOT

#50863

üzenetére

KAMELOT

#50863

üzenetére

Továbbra sem értelek, ugyanis a DLSS összehasonlításnál a képminőséget kell nézni, azt meg nem lehet mérni számokkal

Ez nem sebesség teszt, így bőven megfelelő, ha csak két kapott képet egymás mellé rakják.

Ez nem sebesség teszt, így bőven megfelelő, ha csak két kapott képet egymás mellé rakják.Másrészt amit WayneGace ír, ez egy csevegős tapasztalatot megosztó fórum, te viszont valamiért totálisan komolyan veszed, mint egy bírósági tárgyalást, ahol bizonyítékokat kell prezentálni, különben a másik direkt hazudik vagy félrevezet. Rossz helyen vagy.

-

WayneGace

őstag

válasz

KAMELOT

#50863

üzenetére

KAMELOT

#50863

üzenetére

Az se egészséges, ha valaki leír valamit és jön rá a válasz, hogy képet rakjál be. Miért? Én értem, hogy nagyérdeműnek szóló videó legyen nagyon részletes, stb., bár arra se vevő mindenki. Itt fórumon bizonygatni akár tök egyszerű dolgokat képpel, mintha valami bírósági tárgyalás lenne, szerintem elégé mutatja, hogy mennyire nem képesek egyes emberek megbízni a másikban. Ami önmagában felveti azt a kérdést, hogy miért. Hiszen, aki nem hajlamos megtéveszteni a másikat, az szerintem jobban megbízik más szavában, nem kell neki képes bizonyíték mindenről.

-

PuMbA

titán

válasz

KAMELOT

#50852

üzenetére

KAMELOT

#50852

üzenetére

Értelek. Ettől függetlenül én hiszek neki, hiszen a Cyberpunk optimalizációs videójában állítottakat a saját gépemen is megcsináltam és pontosan az történt, amit ő a videójában mutatott

Így nincs oka, hogy ne higyjek neki, hiszen még egyszer se csapott be, se más nem számolt be arról az interneten, hogy megbízhatatlan, ergo számomra 100%-osan megbízható ember. Sok értelme úgy se lenne kamu dolgokat mutatnia, mert nézettséget és követőket veszítene az ennyi idő alatt felépített hitelességéből.

Így nincs oka, hogy ne higyjek neki, hiszen még egyszer se csapott be, se más nem számolt be arról az interneten, hogy megbízhatatlan, ergo számomra 100%-osan megbízható ember. Sok értelme úgy se lenne kamu dolgokat mutatnia, mert nézettséget és követőket veszítene az ennyi idő alatt felépített hitelességéből. -

PuMbA

titán

válasz

KAMELOT

#50846

üzenetére

KAMELOT

#50846

üzenetére

Bizalmatlan vagy sajnos az emberekkel szemben, de nagyon. Ezt már megfigyeltem. Te mindenkit folyton ellenőrizgetnél, minden egyes lépést, minden egyes mozdulatot, mert ha egy kis részletről nem számol be valaki akkor kamu

"Hol vannak a gép beállítások, játék beállítások?

Mi köze a DLSS-nek a gép és játék beállításhoz? Semmi, de a leírásában ott a gép összeállítás, amin tesztelte

"Hol van a konfigról egy videó, hogy tényleg azon tesztel?"

Honnan tudod, hogy a DigitalFoundry vagy a Hardware Unboxed is min tesztel? Ők se raknak ki róla videót.

Most kijött a Hardware Unboxed videó és ők is beszámoltak visszafejlődésről, szóval nem mond más dolgokat, mint más BenchmarKing és már sokszor kiderült, hogy igazat mond.

-

Busterftw

nagyúr

válasz

KAMELOT

#50840

üzenetére

KAMELOT

#50840

üzenetére

A teszt es normalis elemezes minimum DigitalFoundry-nal kezdodik.

Nagy atlagban a konkluzioja a 20-30 szerian tapasztalhato lassulast emeli ki, semmi olyan amit eddig nem tudtunk, az emg tul van reagalva. De van ahol nem is ugyanolyan DLSS presetet hasonlit.. A DLSS 4.5 ujra emeli a szintet DLSS 4-rol. -

PuMbA

titán

válasz

KAMELOT

#50840

üzenetére

KAMELOT

#50840

üzenetére

Leírnád, hogy miért nem teszt vagy elemzés? Az első részben tisztán láthatjuk a sebességbeli különbségeket, majd egymás mellett láthatjuk a DLSS 4 és 4.5 képminőségét különböző helyzetekben, ami tökéletes a különbségek megállapításához

Te hogy hasonlítanád össze jobban?

Te hogy hasonlítanád össze jobban? -

S_x96x_S

addikt

válasz

KAMELOT

#50151

üzenetére

KAMELOT

#50151

üzenetére

> Jensen is azért van betojva, nehogy

> a képzett emberek kínai cégekhez menjenek el dolgozni.

Jensen több minden miatt aggódhat.

pl.- A Kínai egyetemeken beszüntetik a CUDA oktatását, használatát.

- Valamint, hogy több erős - államílag támogatott - Nvidia alternativa lép világpiacra - és dömping áron beteritik a világot - olcsó GPU-val.

( amit lehet, hogy részben Magyarországon fognak összeszerelni az EU piacra. ) és ez biztos odavágna a 70%-os nvidia margin -nak.Az Nvidia 2025 H1 -ben volt a csúcson ( market share-ben )

és én nagyon álmodózónak tartom azokat,

akik szerint 2030 -ban

meglesz még az nvidia ~90%-os AI market share-e.Kína is függelenedni akar az nvidiától,

és a nyugati AI cégek is egyre inkább diverzifikálnak. -

Abu85

HÁZIGAZDA

válasz

KAMELOT

#49531

üzenetére

KAMELOT

#49531

üzenetére

Mert a szerver működik, és ami működik az fogyaszt, és a fogyasztásnak ára van. Itt ki lehet számolni, hogy a tipikus munkafolyamaton mekkora lesz ez a fogyasztás, így egységnyi szinten mekkora költség lesz üzemeltetni a szervert. Na most ez Xeonnal több pénz, nem is kicsit.

#49536 : Busterftw : Nem lehet összeomlásra számolni, mert nem várod, hogy megtörténik. Ez nem egy logikus költség. Arra lehet számolni, hogy üzemeltetés mellett mennyibe kerül a fenntartás.

Én PC-n bő fél évig GeForce-ot használtam. Szóval nem ezzel volt a gond. Bár ebben az időszakban többször láttam fekete képernyőt, mint pixelest.

#49532 b. : Én 300-at költöttem PS5-re eddig. És még nem is vettem játékot, mert a PS Pluson jönnek a címek. És még van fél évem a mostani éves előfizetésből. Te azzal a géppel még csak a gépet vetted meg, szoftvert még nem, és a vas maga drágább volt, mint nekem két évnyi szórakozás, miközben még nem szórakoztál semmit.

-

S_x96x_S

addikt

válasz

KAMELOT

#49521

üzenetére

KAMELOT

#49521

üzenetére

Ráadásul ha jól értem, akkor

az új Alibaba chip - NVIDIA ( CUDA? ) sw kompatibilitást is ígér - legalábbis inference-re fókuszálva; persze ez még az első iteráció, és nem lesz sebességbajnok,

de az irányt jól mutatja."Even within China, Huawei’s privileged status is raising some hackles. Many engineers are accustomed to the software and tools that accompany Nvidia’s chips. Huawei, subject to U.S. sanctions, didn’t design its chips to work with the Nvidia platform, whereas Alibaba’s new chip will be compatible with it, meaning engineers can repurpose programs they wrote for Nvidia chips."

"China’s biggest weakness is training AI models, for which U.S. companies rely on the most powerful Nvidia products. Alibaba’s new chip is designed for inference, not training, people familiar with it said."WSJ: Alibaba Creates AI Chip to Help China Fill Nvidia Void

Chinese tech companies spark market exuberance by signaling they are catching up to U.S. ( Updated Aug. 29, 2025 6:31 am ET )és ha jól értem csak az Alibaba legalább - 380 billion Chinese yuan ($53.1 billion) invesztál csak az AI-ba - a következő 3 évben.

( és ~ ekkora összeg az nvidia teljes negyedéves bevétele is ( $46.7 billion )és a Qwen LLM - az Alibaba modellje.

-

PuMbA

titán

válasz

KAMELOT

#49475

üzenetére

KAMELOT

#49475

üzenetére

"Ha meg kihagyod, honnan tudod hogyan megy a játék?"

Onnan, hogy megbízható emberek videóit nézem pl. DigitalFoundry vagy zWORMz Gaming

Ha mindent nekem kéne megnéznem és csinálnom, akkor nem lenne életem és egész nap a gép előtt görnyednék, hiszen szoftverfejlesztőként dolgozok, ami miatt így is sokat ülök előtte és megőrülnék. Más játékok nem akadnak nála, tehát biztos nincs szarul beállítva a gépe, tekintve, hogy évek óta tesztel szinte minden játékot. Ő egy hozzáértő ember, a videóival már régóta bizonyította.

Ha mindent nekem kéne megnéznem és csinálnom, akkor nem lenne életem és egész nap a gép előtt görnyednék, hiszen szoftverfejlesztőként dolgozok, ami miatt így is sokat ülök előtte és megőrülnék. Más játékok nem akadnak nála, tehát biztos nincs szarul beállítva a gépe, tekintve, hogy évek óta tesztel szinte minden játékot. Ő egy hozzáértő ember, a videóival már régóta bizonyította. -

HSM

félisten

válasz

KAMELOT

#45121

üzenetére

KAMELOT

#45121

üzenetére

Szerintem addig volt jó, míg egy erős CPU kijött legfeljebb 100-150W-ból, egy GPU 200-250W-ból.

Főleg, amikor egy pár wattos mobiltelefon is már relatív csodát tesz ahhoz képest, mire voltak képesek 10 évvel ezelőtt. Vagy másik példa, a 23W-os Ryzen 4650U-s notebookom remekül lehet StarCraft2-zni szép grafikával, IGP-vel. Arra célzok, a technológia adott lenne, hogy remek perf/watt arányú termékeink legyenek, de valahogy az emberek többségét mintha nem ez mozgatná meg.#45122 Devid_81 : A 6800XT is egyébként piszok mód bírja az alulfeszt, és meg is hálálja.

Bár itt az AMD-nek is jár egy füles, hogy miért kell ehhez harmadik féltől származó szoftverrel a registry mélyét bújni (MorePowerTool). Bár azért itt van némi szándék legalább a WattMan-ból, hogy tudsz választani előre paraméterezett profilokból is.

Bár itt az AMD-nek is jár egy füles, hogy miért kell ehhez harmadik féltől származó szoftverrel a registry mélyét bújni (MorePowerTool). Bár azért itt van némi szándék legalább a WattMan-ból, hogy tudsz választani előre paraméterezett profilokból is. -

Habugi

addikt

válasz

KAMELOT

#16061

üzenetére

KAMELOT

#16061

üzenetére

Az ilyen-olyan helyekre eldugott configurációs fájlok szerkesztését, melyekben rendszerint 10x annyi grafikára vonatkozó dolgot lehet állítani mint ami ingame menükön keresztül elérhető/hozzáférhető azért a magam részéről baromira nem nevezném programozásnak..

Speciel a Crysis első része óta így írtom a DoF-ot mert gyűlölöm, becsípődésem..

(#16064) stratova:

SárkányUram, teljesen igazad van, várjuk meg, én csak annyit

mondtamállítottam hogy a jelenlegi vRam-hoz mérhető skálázódás mellett is tuti meg lehet oldani azt, hogy ez a csoda effekt eltünjön és a textúra is magasabb legyen, tévedés jogát nyilván fenntartom..

Eredménytől függően amcsiverdás adott esetben majd átküldheti a config fájlokat, belenézek jhóóól. -

stratova

veterán

válasz

KAMELOT

#16061

üzenetére

KAMELOT

#16061

üzenetére

Szvsz legfeljebb valamilyen inicializációs vagy konfigurációs fájlt szerkeszt át a júzer, ha erre van igénye és lehetősége.

Prof. Hablatyológus, éppen azért linkeltem a korábbi három képet, mert nagyon nem az a DX12 max. ami az első pároson szerepelt, de tény, hogy VRAM függvényében automatikusan skálázza / skálázná a program, csak egyelőre kissé lehangoló az így elért eredmény. Azt mondom várjuk meg milyen eredmények születnek Malubitomi gépével.

-

rocket

nagyúr

válasz

KAMELOT

#8841

üzenetére

KAMELOT

#8841

üzenetére

Ne viccelj mar, sokkal tobbet er Fury X, mint 400euro.

#8846: Maxwell-hez kepest biztos nem, Maxwell2-hoz kepest a DP teljesitmenyben beszeltek 10x-rol, de az meg mivel kihereltek a DP teljeitmenyt, hogy beferjen a TSMC 28nm-en a meret limitbe, nem a wow kategoria, foleg ha meg a Fiji DP teljesitmenyet is ide vesszuk.

-

rocket

nagyúr

válasz

KAMELOT

#8831

üzenetére

KAMELOT

#8831

üzenetére

Annyi hozzatartozik a tortenethez, hogy a Fiji nem 28nm-re lett tervezve, az AMD-nek nem volt idoben kesz b terve, az NV-nek volt, de ha a Maxwell compute teljesitmenyet nem tudtak volna megnyirbalni, jo nagy gondban lennenek, es a Fiji magasan ulne 1000$-os sikerkartyakent a tron tetejen, meg hdmi 1.4 meg DX12 FL12_0-vel is.

Pascal ellenfele a Greenland lesz, mivel az AMD-rol van szo a kerdes az mennyit fog kesni ahoz kepest.

#8832: Tenyleg az, az egyetlen aki Titan X verokent allitotta be a Fury X-et megjelenesvelott az a hazigazda volt, aki meg azt is irta, hogy 880$-os AMD altal tervezett art keveslik a partnerek

-

Laja333

őstag

válasz

KAMELOT

#8818

üzenetére

KAMELOT

#8818

üzenetére

Ha csak ennyi, az nagyon gáz. Mert még csak nem is igaz amit írsz.

(#8819) daveoff: Akár hogy is nézem, ez egy levegős Strix Fury. Fury X-ből nem adtak ki levegőset.

-

Abu85

HÁZIGAZDA

válasz

KAMELOT

#8774

üzenetére

KAMELOT

#8774

üzenetére

Amennyire egységes a piac meglátása a jövővel kapcsolatban teljesen mindegy, mert mindenki ugyanarra megy, csak van akinek kevesebb pénze van arra, hogy nagyobb lépéseket tegyen. Például a Crytek is hasonlót csinál. A CryEngine a 3.4-es verzió óta PBR-es, plusz a 3.7-es verzióból már kidobtak minden károsnak tartott grafikai middleware-t.

Megfigyelhető, hogy a nagy GameWorks bástyának tartott UE4 is erre megy. Már egy ideje elszeparálják ezt a middleware-t a főverziótól, így keletkezik egy olyan hátrány, hogy ezek esetenként két verzióegységgel is lemaradnak. Ha nem veszik vissza őket a főverzióba, akkor az nyilván baj, mert nehézkessé válik a használatuk, de az Epic úgy érzi, hogy károsak. Érdekes egyébként, hogy az AndroidWorks ott van a főverzióban, csak azért, mert optimalizálható. -

Chiller

őstag

válasz

KAMELOT

#3918

üzenetére

KAMELOT

#3918

üzenetére

Tettem új wint még a télen, és nem szokásom 2-3 évnél sűrűbben újrarakni. Eléggé jól karba szoktam tartani a rendszeremet.

Az új kártya része az valamennyire jogos, csak hát az nem úgy megy, hogy fogom magam és elköltök x összeget (főleg hogy azért eddig elég volt jobbára az 560 Ti szinte mindenhez nekem).

-

válasz

KAMELOT

#3918

üzenetére

KAMELOT

#3918

üzenetére

Mi van??

Pár hete itt sírt fele banda, mint afürdőskurvák ![;]](//cdn.rios.hu/dl/s/v1.gif)

Nincs ezzel gond, biztos előfordul ez a piros oldalon is valakinél, de azért ne rugaszkodjunk el a valóságtól ennyire.

Már most ilyeneket beszélsz, pedig meg sem jött a 980-ad, akkor mi lesz ha megjön?![;]](//cdn.rios.hu/dl/s/v1.gif)

-

Malibutomi

nagyúr

válasz

KAMELOT

#3424

üzenetére

KAMELOT

#3424

üzenetére

Mégis mit kellett volna lépnie? Kiadja a kártyákat tesztek nélkül? Vagy GPU nélkül ha még nincs legyártva? Vagy memória nélkül, mert Abu azt mondja a HBM-re várnak. Vagy addig álljon ki egy mérnök és táncoljon a webcam előtt 24/7-ben ha még nincsenek kész a kártyák?

Ha minden igaz a 360X jön először most márciusban, aztán sorban a többi.

-

proci985

MODERÁTOR

válasz

KAMELOT

#3421

üzenetére

KAMELOT

#3421

üzenetére

oke, meg egyszer, a 970/980 iszonyatosan le van folytva a refkariknal.

gyakorlatban nonrefnel a TDP 200/230W korul alakul. nezz refteszteket, a kartyak egy resze az alap boost orajelbol visszavett neha, viszont OC modellek egy resze 20%al megy boost fole.

290x kb 300W.

AMD is fejleszt, csak chipet kihozni ido, az nv meg letartolta a piacot a 970el. mas kerdes, hogy ismerosi korben a GTX970ek fele vagy gariban van, vagy megy vissza. mondjuk mi nem igazan vagyunk reprezentativak.

-

HSM

félisten

válasz

KAMELOT

#3372

üzenetére

KAMELOT

#3372

üzenetére

Nem pár FPS volt a különbség.

Tesztelgettem pár programmal, és még 900Mhz-re alulórajelezve is gyorsabbnak bizonyult, mint 1150Mhz-re húzva a 7970, és a fogyasztása is kedvezőbb volt így, mint a széttuningolt 7970-nek.

Tesztelgettem pár programmal, és még 900Mhz-re alulórajelezve is gyorsabbnak bizonyult, mint 1150Mhz-re húzva a 7970, és a fogyasztása is kedvezőbb volt így, mint a széttuningolt 7970-nek.

Drágábbnak drágább volt, ez tény. Mondjuk én ~80 euróból megúsztam a váltást a használt 280X-emhez képest vatta új WindForce3-as 290-re, annyit röhögve megért.A 980 gyors, de nem biztos, hogy megér akkora felárat a 290X-hez képest.

Hogy finoman fogalmazzak. Legalábbis az itthoni 60%-al magasabb új bolti ára a 980-nak elég vicces.

Hogy finoman fogalmazzak. Legalábbis az itthoni 60%-al magasabb új bolti ára a 980-nak elég vicces. -

HSM

félisten

válasz

KAMELOT

#3366

üzenetére

KAMELOT

#3366

üzenetére

A valótlan állításaid:

-"970 még a 290X is veri fele fogyasztással." Nagyon nem fele.

-"AMD új kártyái sem lesznek jobbak és ez eléggé gáz!" Nyilvánvalóan fognak fejlődni, nem a felhőket számolták az elmúlt években.

-"7970-ig okés volt minden utána katasztrófa lett minden!" Semmi baj nincs se a Tongával, se a Hawaii-al. Veled ellentétben nálam járt 290-es kártya, nemcsak 7970.

Veled ellentétben nálam járt 290-es kártya, nemcsak 7970.

-

tejeskifly

aktív tag

válasz

KAMELOT

#1536

üzenetére

KAMELOT

#1536

üzenetére

Mikor adták ki a mantlehoz tartozó végleges drivert? 14.1 BETA, amit azért biggyesztettek oda mögé, mert még nem végleges. Beta driverrel pedig azok próbálkozzanak, akik kísérletező kedvűek. Aki meg elvárja, egy beta drivertől, hogy hibátlan legyen, az gondolkodjon el picit.

Időpontot szerintem csak a dice ígért, hogy mikorra implementáják a manetle api-t. Ez meg is történt, igaz egy hónap csúszással.

Azt meg nehéz elhinni, hogy valaki a mantle miatt várt 4 hónapot már. Ez idő alatt nem tudott játszani a játékkal vagy mi?

-

HSM

félisten

válasz

KAMELOT

#1546

üzenetére

KAMELOT

#1546

üzenetére

Nem kell beleugrani egy új architektúrába egyből, az mindig döcögős, nemcsak az AMD-nél. Tavaly februártól viszont teljesen jól megy, nekem azóta van Tahitim.

Arról pedig igazán mutathatnál valami komolyabb bizonyítékot, hol ígért neked az AMD hibátlan mantle-t januárra. 4 hónapja bejelentették, hogy dolgoznak egy ilyenen, és milyen előnyöket várnak tőle. Ez nem ígéret, hanem egy technológia bejelentése.

Pedig a szoftverfejlesztés mindenhol így megy. Kitalálunk valmit, aztán megcsináljuk, bugtalanítjuk, optimalizáljuk, stb. folyamatosan. Jelenleg a béta állapotban van, aki akarja, már kipróbálhatja. Ennyi. Nem kötelező. Ott a DX mód, ha nem tetszik a mantle.

-

mackosajt

addikt

válasz

KAMELOT

#1536

üzenetére

KAMELOT

#1536

üzenetére

Feltűnt, hogy a 14.1 az BÉTA?

Vagyis nem végleges driver, azaz vannak benne hibák, amiket javítani kell. De ha nem adják ki, akkor a zárt körű tesztelések alatt kevesebb hiba derül ki, és utána meg azzal jönne a sok user, hogy fos a hivatalos driver.

Mellesleg én örülök neki.

A fos 7970-emen +30% FPS növekedést hozott. -

HSM

félisten

válasz

KAMELOT

#1519

üzenetére

KAMELOT

#1519

üzenetére

Ja, látom már, mivel tévesztettél meg.

A Texture fillrate, amivel számoltál a felbontás mellett, miközben a texture fillrate tudtommal nem felbontás függő, az ugyanis azt írja le, a drótvázakra milyen sebességgel tudja ráhúzni a textúrákat.

A Texture fillrate, amivel számoltál a felbontás mellett, miközben a texture fillrate tudtommal nem felbontás függő, az ugyanis azt írja le, a drótvázakra milyen sebességgel tudja ráhúzni a textúrákat.Ellenben a Pixel fillrate (ami a 290 esetén valóban kb. duplája a 280x-nek) az az érték, ami a képernyő pixeleinek a kiszámításának kapacitását írja le, tehát ez a felbontásfüggő paraméter.

Előzményeket olvastam.

-

Malibutomi

nagyúr

válasz

KAMELOT

#1521

üzenetére

KAMELOT

#1521

üzenetére

Mivel kb. a világon ezzel az egy teszttel egyezik az eredményed maradjunk a véletlennél

Hihetőbb, mint hogy ez az egyetlen tesztoldal akik képesek úgy tesztelni, hogy pontosan kiadja a kártyák elméleti maximumát ráadásul multiban, amit ugy nem elehet megismételni pont ugyanúgy....söt a 780-nál még többet is, hisz 91 helyett 99 fps lett.Készséggel elhiszem hogy a számításod helyes. Nem is vitatkozom ezen. A teszt viszont nyilvánvalóan téves, nem írom hogy hibás, nekik így jött ki ez van, ahány tesztoldal annyi eredmény, csak én átlagot szoktam nézni a sokból, és a nagyon nagy többség nem azt mutatja mint ez a teszt. Még azt is elhinném hogy multiban a 780 gyorsabb, ha mondjuk a 99FPS-el szemben állna 95 vagy legyen akár 90, de 99-69 kissé furán hangzik.

-

Malibutomi

nagyúr

válasz

KAMELOT

#1517

üzenetére

KAMELOT

#1517

üzenetére

Akkor pontosan ennyit kellene kapni minden tesztben ha ez igy működne, de mivel a való életben ez 99%-ban igy van, ezért kimondhatjuk, hogy más tényezők sokkal jobban befolyásolják az eredményt mint csak a Gtexel érték, vagyis a számításod még ha helyes is, teljesen felesleges és nem mérvadó.

Kb. mintha két kocsinál csak a lóerő súly arányból kiszámolnád melyik a jobb, aztán a versenypályán mégsem az nyerne, mert van még pár dolog mint gumi, felfüggesztés és egyebek amik befolyásolják a végkimenetelt.

-

Malibutomi

nagyúr

válasz

KAMELOT

#1503

üzenetére

KAMELOT

#1503

üzenetére

A táblázatodból hogy jön ki, hogy a 290X kártya szinte mindenben gyorsabb mint a 780, csak a speckó nv-nek nagyon jól fekvő játékokban tudja esetleg a 780 megelőzni?

Ez alapján a 780-nak mindenhol majd 10%-ot kellene vernie a 290X-re.

Felesleges igy számolgatni szerintem. Főleg egy hibás teszteredmény alapján

-

ricshard444

veterán

-

HSM

félisten

válasz

KAMELOT

#1454

üzenetére

KAMELOT

#1454

üzenetére

Mert az csak bekavar a méréseknél. Akkor ugyanis random várakozási idők kerülnek be attól függően, mikor készült el a kép a vertikális szinkron időpillanatához képest.

Arrról nem is beszélve, mennyire msáhogy jöhet ez ki 50Hz-en, 60-on, 72-n, 120-on vagy 144-en, csak hogy a népszerűbbeket említsem. Az első kettő pl. általam is használt, bár játszani 60-on szoktam, de van, aki 120-on, mert olyan monitora van.Otthoni használatra praktikus lehet a V-sync, de méréseknél nincs helye.

Én mondjuk csak akkor kapcsolom be, ha beton stabillan 70-80 felett van az FPS.

Én mondjuk csak akkor kapcsolom be, ha beton stabillan 70-80 felett van az FPS.

-

ricshard444

veterán

válasz

KAMELOT

#1451

üzenetére

KAMELOT

#1451

üzenetére

Én szóltam a moderátoroknak, mert borzalmas ami itt ment, komolyan, mint egy óvodában.

Védi a játékát és a másik tapsol neki Nem vagyok egy szigorú ember, szeretem a poénkodást, de ahogy sokan megnyilvánulnak az kész szánalom.

Nem vagyok egy szigorú ember, szeretem a poénkodást, de ahogy sokan megnyilvánulnak az kész szánalom.Úgyhogy Nekem írd ezt, Ő csak végzi a munkáját.

-

HSM

félisten

válasz

KAMELOT

#1451

üzenetére

KAMELOT

#1451

üzenetére

Itt vannak repi mérései: [link]

Szerintem az a 25% se pite, ahogy megdobta az FX8350+7970 konfigot! Nem beszélve arról, hogy kisimult a GPU grafikonja!

Arról nem beszélve, hogy így már 100% CPU-limites lett a game, mert ha megnézed, a GPU 11,6ms alatt kinyomta a képet, és a 15ms-es proci diktálja (limitálja) 67-re az FPS-t, a GPU bírná 86-ig!

Míg DX-ben tökéletes vegyes limit, 18ms alatt végez a GPU és CPU is, 55FPS. Úgy már mindjárt vadabb, erősebb procival a Tahiti 56%-ot is gyorsulhatott volna!

Azt pedig igencsak megérzed, ha a VGA 50%-ot gyorsult! De ha csak 20-at, azt is. FPS-ben mindegy, hogy mennyinél, 20FPS-nél is ugyanúgy megérzed, mint 40-nél. Nyilván, ha a monitorod képfrissítési frekvenciáját kimaxoltad, akkor már nem, de az más kérdés.

Ez az 50% gyorsulás minimum 1 HW generáció, amit most a GCN tulajok megkaptak gyakorlatilag ingyen a Mantle játékokban.Kicsit jobban megnézve az adatokat az se rossz, hogy a CPU-n is gyorsított vagy 25%-ot, 19 helyett 15ms volt az átlagos idő, mire elkészült. Az is Intelnél kb. 2 generáció.

(#1453) ricshard444: Én is erősen gondolkoztam moderátor hívásán, mert már rossz volt olvasni a sok szakmaiságot teljesen nélkülöző flémet.

-

Abu85

HÁZIGAZDA

válasz

KAMELOT

#1384

üzenetére

KAMELOT

#1384

üzenetére

Mert az egy hatmagos proci. A BF4 betartja a DX által ajánlott batch countot is, így nem igazán megy 2000 dc/f (egyedi rajzolás/képkocka) fölé. Ennek a DX többletterhelése mellett egy erősebb mag elég. Na most a Mantle ezt többszálúsítja, amitől még mindig nem lesz több a dc/f, de nyolc szálra is szét lehet osztani lineáris skálázódással. Ez hozza az egyik nagy gyorsulást. A másikat a driver szálainak eltűnése jelenti. Ha van 6-8 magod, akkor ez kevésbé érinti a rendszert, mert az OS azért igyekszik szabad erőforrásra ütemezni. Mantle alatt viszont nincs driver szál, tehát nincs olyan láthatatlan folyamat a program számára, ami elvenné az erőforrást.

Nagyon általánosan erős GPU mellett 6-8 maggal 10-30%-os gyorsulás lehetséges, függően a magok teljesítményétől. 2-4 maggal 20-40%-os. -

norb55

őstag

válasz

KAMELOT

#1384

üzenetére

KAMELOT

#1384

üzenetére

Intel procik sokkal okosabban vannak felépitve. AMD procik gyengélkednek. Megnézel egy csomó tesztet az AMD procik valahol 100%-al vannak lemaradva az intel prociktól. Intel proci a leggjobb az VGA kártyák kihajtására.

Ezt már régen is tudtam a Mantle az AMD procikkal fog gyorsúlni sokat.

Erdei88 Nem is tagadom, az vagyok. De tökmindegy, mert hiába választanák AMD-t, nem mutatna fel semmi plusz előrelépést. Emlékszem régen a DX 10.1-re mindenki hogy odavolt. Hogy reklámozta az AMD még a dobozon is rajta volt. Közbe meg semmi nem lett belőle

-

Abu85

HÁZIGAZDA

válasz

KAMELOT

#1381

üzenetére

KAMELOT

#1381

üzenetére

Semmilyen terhet nem vesz át a procitól. Dióhéjban eliminálja a driver szálakat, lecsökkenti a többletterhelést és kiszámítható működést biztosít a fejlesztőknek. Ennyi. Megpróbálom a lehető legérthetőbben leírni. A legtöbb gyorsulás abból ered, hogy a fejlesztők szabadon hozzáférhetnek a látható erőforrásokhoz, és nem mondja nekik valamilyen rejtett körülmény, hogy "Bocs az mégse szabad. Ja hogy már késő? Majd legközelebb talán sikerül összehozni (trollface)...". Aki odament az AMD-hez és kérte a Mantle-t, annak ebből lett elege. Meg persze abból, hogy 2007 óta pofázzák ezt a problémájukat az MS-nek és semmi.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Milyen okostelefont vegyek?

- Path of Exile (ARPG)

- Azonnali informatikai kérdések órája

- Le Mans Ultimate

- A Razer új klaviatúra-zászlóshajóját meglátva biztos félrenyeled a teát

- 5.1, 7.1 és gamer fejhallgatók

- Okos Otthon / Smart Home

- aquark: Zsebszámológépek

- Kés topik

- GoodSpeed: Mutasd magad topic!

- További aktív témák...

- 241 - Lenovo Legion 5 (15IRX10) - Intel Core i7-13650HX, RTX 5060

- AKCIÓ! LENOVO ThinkPad P15 Gen2 munkaállomás - i7 11800H 16GB DDR4 512GB SSD Quadro T1200 4GB W

- HP EliteOne 800 G4 All-in-One i5-8500 16GB 512GB 23.8" Érintőkijelző!! 1 év garancia

- Xiaomi Redmi Note 13 Pro 8/256GB - Kártyafüggetlen, Fekete - 1 Év garanciával

- Apple Mac Pro Workstation Dual Xeon,18GB RAM,WIFI,BT,Profi Munkaállomás és Szerver

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif) / X8670E Taichi / 2x 16GB DDR-6000MT/s / WD_BLACKSN850X ]

/ X8670E Taichi / 2x 16GB DDR-6000MT/s / WD_BLACKSN850X ]

teljesítmény ugyan az....

teljesítmény ugyan az....