Új hozzászólás Aktív témák

-

X2N

őstag

Amennyit tud. Ez igazából a probléma, nem a kártya RT teljesítménye.

4-k-s PBR textúrákkal, 8-16K-s HDRI environment mappal azért legyen legaláb 16GB vramod a kártyán, azzal már van esélyed hogy nem fut ki belőle. Vannak olyan pár száz MB-os blender file-ok aminél egy tigris/gepárd modell van csak, de a szőre az fibermesh hair, 24GB már arra is kevés. Amikor már több karakter van hajjal mindennel arra már 32GB memória is kevés, procira kifogja rakni a rendert.

4-k-s PBR textúrákkal, 8-16K-s HDRI environment mappal azért legyen legaláb 16GB vramod a kártyán, azzal már van esélyed hogy nem fut ki belőle. Vannak olyan pár száz MB-os blender file-ok aminél egy tigris/gepárd modell van csak, de a szőre az fibermesh hair, 24GB már arra is kevés. Amikor már több karakter van hajjal mindennel arra már 32GB memória is kevés, procira kifogja rakni a rendert. -

X2N

őstag

Persze, egyébként használom renderelésre is blenderben. Úgy vettem észre hogy ott ez a +30%-al gyorsabb igazából nem jelent semmit sebességbe, így is villámgyorsan renderel a 16 magos processzorhoz képest, be kell tenni még egy 7900XTX-et a gépbe az közelítőleg felezi a renderelési időt.

Ma 1db 5090 hozza azt renderelésben amit régen ~4db 2080Ti, az már jelentős előrelépésnek tűnik, addig amíg meg nem nézed a fogyasztást.

Ma 1db 5090 hozza azt renderelésben amit régen ~4db 2080Ti, az már jelentős előrelépésnek tűnik, addig amíg meg nem nézed a fogyasztást.Múlkor láttam, ne öljetek meg érte

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

X2N

őstag

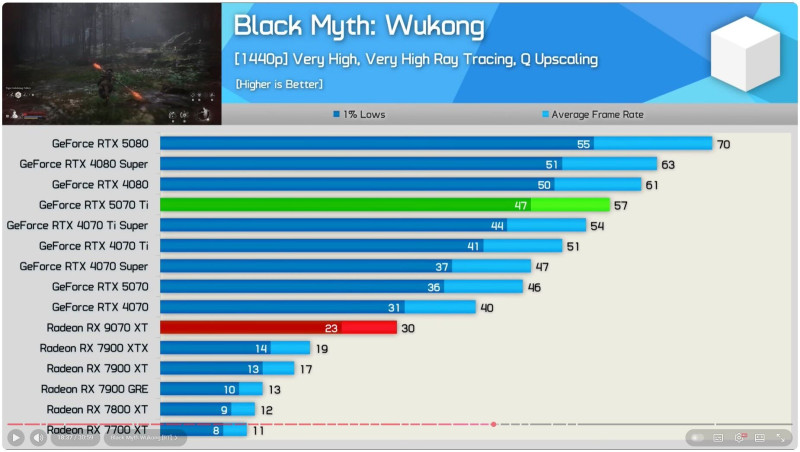

Ezt mindenki tudja hogy gyorsabb RT-ben ezen mit kell magyarázni??? ~3 évvel újabb kártya aminél már ez is szempont volt mert le vannak maradva mint a borravaló, mit vártál? Raszterben meg elmarad, és a játékok többsége nem RT-s. Nem azért a pár RT-s jövőbeli címért vettem én se 3+ éve.

Sose vettél volna ilyen kártyát, hát bocs én meg 3+-éve minden maximális beállítások mellett játszok 4K felbontásban, akkor ez volt megvásárolható, ha nem akartál leégő csatis 4090-et 2x-es áron.A 16GB VRAM meg nem lesz gond egészen addig amíg el nem kezded moddolni a játékot, főleg ha alapból natív 4k felbontáson játszol. Mert akkor már kevés lesz. Úgyhogy ne próbáld meg úgy beállítani hogy milyen jó az a kártya, mert nem jobb. Felbontásra választasz kártyát, és nem csak 2-3 évre.

-

T.Peter

őstag

Erdemes a kulonbsegeket ebben a formaban vedeni? Gyorsabb bizonyos jatekokban az xtx? Igen. Dragabb volt? Igen. Tobb rajta a vram, ami jol jon bizonyos feltetelek teljesulesekor? Igen. Kb ennyit tud felmutatni, minden masban a 9070xt a jobb es meg olcsobb is. Nem erzem, hogy vedeni kene barmelyiket is, mindkettonek megvannak a vevoi.

-

X2N

őstag

Ezt így nem lehet kijelenteni, és jó lenne ha a gyári stock 9070XT-t hasonlítanád a gyári 7900XTX-hez, nem a mostanában megjelent húzott változatokat, a stock 7900XTX-hez ahogy a legtöbb tesztben. Van a 2 kártya között egy jó 10-12% különbség teljesítményben, vagy még több is attól függően melyik verziót hasonlítod.

-

PuMbA

titán

Azt még hozzátenném, hogy a gyakorlatilag nulla izgalmat hozó RDNA3-as bemutatót elnézve én sosem vettem volna RDNA3 kártyát és végül nem is vettem, pedig akkor RDNA2-m volt. Annyira szinte semmi javulást nem hozott az RDNA2-höz képest....a bemutató után egyből az volt a gondolatom, hogy ez bukta lesz. Az lett.

X2N: A gyárit hasonlítottam

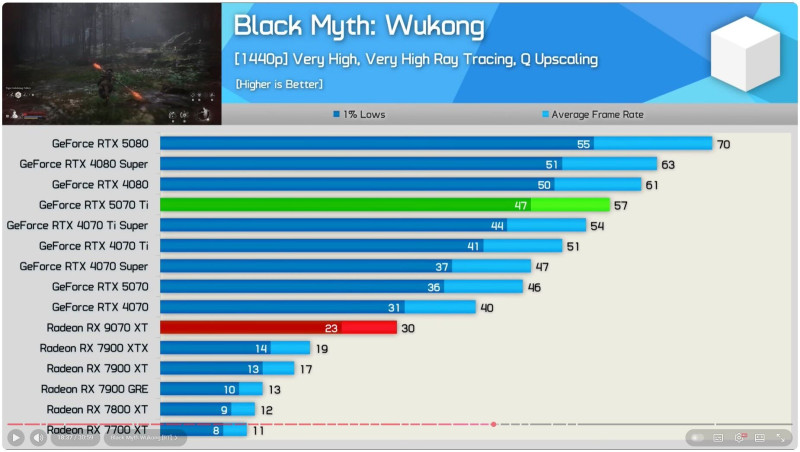

Erősen RT-s vagy PT-s játékokban megvan a 30% különbség is a 9070XT javáíra. Itt 30 kontra 20 fps, tehát 50%:

Erősen RT-s vagy PT-s játékokban megvan a 30% különbség is a 9070XT javáíra. Itt 30 kontra 20 fps, tehát 50%:

-

X2N

őstag

Persze hogy nem vagyunk előrébb, ha nem realisztikus a tesztkörnyezet se amiben mérnek. Akkor mi értelme van az egész mérésnek? Én is lekapcsolhatom a tűzfalat, meg a defendert meg a biztonsági patcheket ahogy Steve, meg minden mást is amit tudok még ebben a rendszerben is, de nem ezt kellene lemérni hanem hogy mindenféle mókolás nélkül mit tud a rendszer.

-

X2N

őstag

FPS-t limitál, így jóval kisebb az eltérés a mért eredmények közöt ami csalóka is lehet. Azt se felejtsük el hogy ezek friss telepítések, nem 1-2 éve futó rendszerek.

"Ezt sem értem, hogy mi különbség van 1,6GB memória és 1GB memória használat között, ha van bőven memória, mondjuk 32GB. Ugyanolyan kényelmesen és zavartalanul elfér."

Szeretem a bloat mentes oprendszereket, már futottam ki többször is 32GB ramból, még ezzel az optimalizált rendszerrel is, akkor upgradeltem 96GB-ra, nekem ne fusson semmi felesleges a háttérben ami nem kell. még ha csak +500MB, akkor se.

Linuxon a KDE Plasma el van 800MB-al, az baráti. -

X2N

őstag

Még mindig limitál a 9070, nem győzöm hangsúlyozni, a játék összeállítás is elég rossz, multis címek->kapásból kuka.

Ez a Nano11 mit tud a gyári win11 hely képest? Feladatkezelőben mennyi a memória használat, mennyi a cpu-nál a processes? Még Defender sincs ebben a nano11-ben? Az viszont gáz.

Szerk:Na most néztem, nano11, ~106 process, 1.6GB memória, az még mindig sok.

Nálam ReviOS win10-nél ~73 process és még ennél is kevesebb ram használat van. -

Alogonomus

őstag

Mivel az AI folyamatokat eleinte lényegében kizárólag CUDA környezetben próbálták kezelni, így az AMD nem is lenne alkalmas a feladatra. Illetve csak ilyen ZLUDA típusú alternatív megoldásokkal, amivel viszont az Nvidia rosszallását vívnák ki a kínai fejlesztők. Ezért nem használnak az AI feladatokra AMD hardvert. A nyilvános projektekhez Nvidia, a védett projektekhez pedig esetleg valami kínai belső hardvert.

-

huskydog17

addikt

És azóta se sikerült felfogniuk a károgóknak, hogy azok játéktesztek és nem GPU tesztek.

Te is tökéletesen láthatod, még az agyon tömörített YT videókban is, hogy a játékok saját TAA algoritmusa meg sem közelíti a DLSS minőségét, ezt még Crizzpy (WormZ) is meg szokta mutatni. Azért őt említem, mert többször írtad, hogy őt szoktad nézni.

Emiatt nem mindegy, hogy egy játékban TAA-t vagy DLSS-t használsz, mert a DLSS jóval alcsonyabb input felbontással is sokkal szebb képet ad, mint a TAA magasabb felbontáson, ez tény, ezt te is milliószor elismerted, szóval számodra is logikusnak kellene tűnjön a CB lépése.

A GPU tesztek továbbra is azonos render felbontáson történnek. -

-

huskydog17

addikt

"Futtatni bírja, de sebességben nem bírja el, mert kisebb felbontást számol, mégis lassul, így értettem"

Ez is marhaság. Még az általad linkelt teszt is megcáfol téged, ott is jó látszik, hogy számos játékban jó a sebesség. A felbontás pedig az lesz, amit beállítasz, nincs olyan, hogy kisebb felbontásban számol, csak akkor, ha úgy állítod be. Azért lassul, mert nincs FP8 támogatás Turing és Ampere szériákban.

"Most az NVIDIA ugyanúgy eldarabozza a megjelenést, ahogy az AMD szokta, tehát először a DLSS 4.5 Super Resolution része jelenik meg, aztán majd jön a DLSS 4.5 többi része. Erre értettem."

Eddig is így volt, most valamiért úgy csinálsz, mintha eddig nem így lett volna. DLSS 3.0 hozta a FG-t, DLSS 3.5 hozta a RR-t, a 4.0 hozta a Transformer modellt és MFG-t.

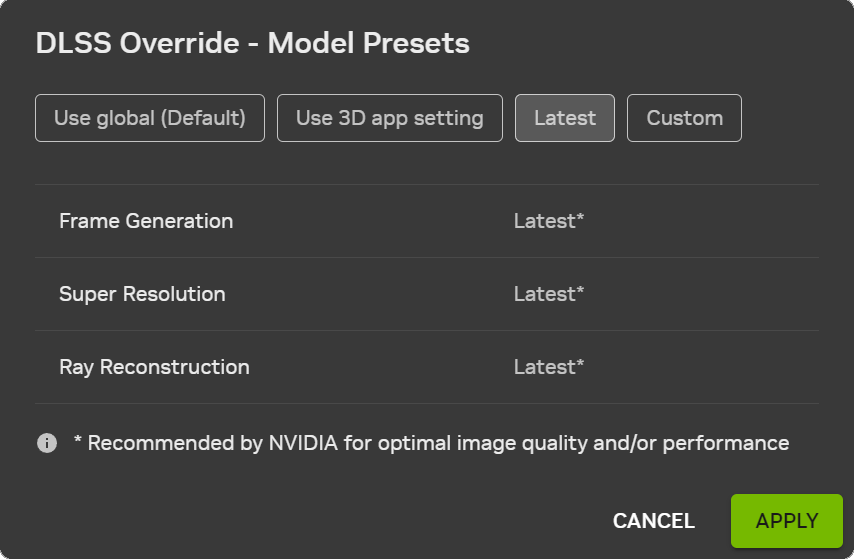

A különbség annyi, hogy az NV-nek már van sok játékban RR és MFG is, míg AMD-nek nincs, így semmilyen szempontból nincs értelme annak, amit írtál."Nem, szerintem feleslegesen bonyolult és hogy ezt a usernek kell állítani az NVIDIA App-ban manuálisan. Te supportáltál már IT vonalon ügyfeleket? Képben vagy, hogy miket nem értenek meg egyszeri felhasználók? Ennél tízszer egyszerűbb dolgokkal gondban vannak."

Nem, nem bonyolult és főleg NEM kell a usereknek átállítani az NV app-ban semmit, ha nem akar, nem kötelező, ahogy az NV app-ot még csak telepíteni sem kötelező. A userek többsége azt sem tudja, mi az, hogy felbontás, csak elenyésző többségük foglalkozik felskálázással manuálisan.

Igen, 15 éve vagyok IT support-ban (szerencsére nem Helpdesk-en), de ennek most az égvilágon semmi köze az egészhez. Te most valóban az NV IT supportjáért aggódsz, hogy nekik túl sok melójuk lesz emiatt? Ez most komoly?

Tehát inkább vágjuk el sok millió felhasználótól a DLSS 4.5 lehetőséget, mert az NV IT supportnak szerinted túl sok dolga lesz emiatt, mert néhány usernek túl bonyolult a +2?

Szerintem az NV sokkal jobban tudja nálad, hogy a supportnak mi okoz gondot és mi nem és hogy mennyire okozna ez gondot nekik.#50719: Sajnos nem tudom értelmezni amt írtál. Ki milyen működést akar megkapni?

"Ha beimplementálják a játékokba a DLSS 4.5-öt, akkor ott a DLSS 4.5 modellje lesz az alapértelmezett, tehát az M. A gyorsabb K modell a DLSS 4 modellje."Ha beimplementálják a játékokba a DLSS 4.5-öt, akkor ott a DLSS 4.5 modellje lesz az alapértelmezett, tehát az M. A gyorsabb K modell a DLSS 4 modellje.

Igen, akkor mégsem olyan bonyolult, megértetted. Akkor mi itt a bonyolult?

-

huskydog17

addikt

"Nem állítottam, hogy nem bírja."

???

Pedig de, szó szerint ezt írtad, ki is másoltam. Nem értem miért tagadod a saját kommentedet na mindegy.

"Pont ezt írtam, hogy ezeket a legújabb preseteket nem ajánlja az NVIDIA a régi kártyákra a jelentős sebességdeficit miatt, mert nem bírják."

Megint nem bírják? Egy kommentedben saját magadnak mondasz ellent. Döntsd már el!

Sehol nem írt olyat az NV, hogy nem ajánlják a DLSS 4.5 használatát Turing és Ampere-hez, csak annyit írtak, hogy jóval nagyobb a sebességdeficit, mint Ada és Blackwell esetén. Az NV továbbá performance és Ultra Performance módhoz ajánlja a 4.5-öt, de ettől el lehet térni, mindenki úgy használja ahogy akarja.#506691:

"zWormZ Gaming csinált RDR2-vel tesztet tegnap és újra kellett csinálnia, mert nem működött a DLSS4.5 Ugyanígy Testing Games csatorna, MxBenchmarkGaming stb. le sincs írva, hogy milyen profillal tesztelnek."

Ugyanígy Testing Games csatorna, MxBenchmarkGaming stb. le sincs írva, hogy milyen profillal tesztelnek."Attól, hogy néhány videós túl hülye vagy túl lusta, hogy utána nézzen a faék egyszerű dolgoknak, illetve túl lusták fontos infókat megadni, az a legkisebb mértékben sem az NV sara. Amúgy Crizzpy (WormZ) csatornáját én is rendszeresen nézem, ő nem teszteket csinál hanem inkább szubjektív élménybeszámolókat, az RDR-2nél ő nézte mbe a dolgokat, amit el is ismert a javított videóban. Érdemes nála az Oblivion Remastered videót is megnézni a témában, ha már szoktad őt nézni, ugyanis ott jóval nagyobb különbséget ad a 4.5, mert eltünteti a ghostingot a kardnál.

Az meg, hogy "NVIDIA is átmegy AMD-be lassan" szintén egy nagy marhaság. Ez akkor lenne igaz, ha a DLSS 4.5 csak és kizárólag Blackwell-en működne, mármint minden modulja, pont úgy, mint ahogy az FSR Redstone RDNA4 exkluzív lett.

Ezzel ellentétben az NV a 7 éves GPU-kat is támogatja, illetve ezekhez a régi GPU-khoz is odaadja a piac legjobb felskálázóját.

Szóval nem, az NV egyáltalán nem megy át AMD-be, épp ellenkezőleg, az NV mutatja meg hogyan kell példaértékű, hosszútávú supportot adni.#50698:

Mindössze annyi változás történt, hogy bejött két új preset, semmi több, amelyek ráadásul egyértelműen ki lettek kommunikálva, hogy mire jók és mihez ajánlottak.

Minden más úgy maradt, ahogy volt. Eddig nem volt túl bonyolult, de a +2 preset már túl bonyolult? Ne nevettess már!

Ha mondjuk bejönne egyszerre több tucat preset és egyikhez se lenne az égvilágon semmilyen infó az NV részéről, hanem csak úgy megjelennének az NV App-ban, akkor talán lehetne azt mondani, hogy esetleg túl sok és kaotikus, de jelenleg úgy néz ki, hogyDLSS 4.0 = Preset K (DLAA, Quality és Balanced módhoz ajánlott)

DLSS 4.5 = Preset M (Performance módhoz ajánlott), L (Ultra Performance módhoz ajánlott)Szerintem ezt még egy értelmes kisiskolás is képes felfogni, főleg mert kiválóan van dokumentálva és kommunikálva, hogy melyik micsoda és mire jó. Akinek ez a végtelenül egyszerű dolog gondot okoz, annál valami más egyéb súlyos gondok vannak.

Az AMD-nél egyébként ugyanez van, csak sokkal szűkebb hardveres támogatással: ott egy játék Redstone kompatibilisnek számít, ha az egész Redstone csomagból csak egy feature-t támogat, akkor is Redstone játék, ha kizárólag egy FSR 3.1 felskálázás van benne, ott is eltérnek a különböző modulok verziószámai. Náluk a Denosier és a RR az első generációnál tart. Ott nem nem kavarnak össze?#50703:

Ez a teszt tökéletesen igazolja, amit már írtam is, hogy Ampere és Turing kártyákon is gond nélkül lehet használni a 4.5-öt , a kijelentéseiddel ellentétben gond nélkül meg tudnak birkózni vele (ez nyilván játék- és beállításfüggő dolog). Még a 7,5 éves 2080Ti is hozza átlagosan a 60 fps-t 1440p Ultra-n M presettel. Nem látok problémát.#50705:

"Az lemaradt, hogy Steve a videó végén megemlítette, amit én is írtam tegnap, hogy a DLSS az egyre több opcióval kezd bonyolulttá és nehezebben következővé válni, hogy a főként régebbi kártya felhasználóknak manuálisan kell presetet állítaniuk, ha maradnának a K profilnál."HUB Steve-nek minden rossz, amit az NV csinál, ezt már rég megszokhattuk. Az, hogy neki is gondot okoz a +2 jól dokumentált preset érkezése, az legfeljebb az ő szellemi problémája, amiről az NV megint csak nem tehet. Ez sokadszorra megerősíti bennem, hogy ne nézzem az ő videóit.

#50707:

"Én csinálnék egy automatizmust vagy egy egyszerű felületet, plusz beállítást (sebesség vagy képminőség) erre az NVIDIA helyében, hogy alapértelmezetten a régi kártyák maradjanak úgy, ahogy voltak és elhúzhatják a csúszkát, aminél leírják, hogy képminőséget kapsz, de a sebesség nem nőni, hanem esni fog."Van ilyen, úgy hívják: NV App

-

Busterftw

nagyúr

Nekunk? 3 napja arrol beszelsz neked ez milyen bonyolult, pedig nem az, meg a fejlesztoknek is egyszeru az ajanlas.

A sebesseg hitet pedig el kell engedni, ahogy HUB is mondta ez kepminoseg nelkul sokat nem jelent. A jobb kepminoseget ado modell miatt mehet a balanced/performance mode, igy nem kell lemondani semmirol sem.

-

PuMbA

titán

Az lemaradt, hogy Steve a videó végén megemlítette, amit én is írtam tegnap, hogy a DLSS az egyre több opcióval kezd bonyolulttá és nehezebben következővé válni, hogy a főként régebbi kártya felhasználóknak manuálisan kell presetet állítaniuk, ha maradnának a K profilnál. Sokan azt se tudják, hogy létezik ilyen, akik nem PC-s szakik.

Talán ezért van az, hogy az AMD vonakodik kiadni az FSR4-et régebbi kártyákra, mert megszűnne az egyszerűség. Tök jó lenne ott lenni egy megbeszélésen, hogy náluk mi a helyzet, hiszen a modell készen van, kiszivárgott.

-

gV

őstag

nekem nincs fent az App, fenti kép innen:

NVIDIA DLSS 4.5 Delivers Major Upgrade With 2nd Gen Transformer Model For Super Resolution & 6X Dynamic Multi Frame Generation | GeForce News | NVIDIA

részletesen leírják amit tudni kell. (nem kell fejlesztői doksikat túrni.)

Choosing The Right Models: DLSS 4.5 Super Resolution adds support for two new presets: Model M and Model L.

Model M is optimized for DLSS Super Resolution Performance mode, and Model L is optimized for 4K DLSS Super Resolution Ultra Performance mode.

While both models are supported for both DLSS Super Resolution Quality and Balanced modes, and DLAA, users will see the best quality vs. performance benefits in Performance and Ultra Performance modes.

Please note that GeForce RTX 20 and 30 Series GPUs lack native FP8 support, so Models M and L carry a heavier performance impact for these GPUs. Users may therefore prefer to remain on Model K (DLSS 4.0), for an optimal balance of performance and image quality. With the NVIDIA app's DLSS Overrides, you control the Model, and the balance between image quality and performance for your PC.

To verify that the intended model is enabled, turn on the NVIDIA app overlay statistics view via Alt+Z > Statistics > Statistics View > DLSS. -

gV

őstag

nem lehet összekeverni. SR presetnek nincs köze az RR-hez. külön van az Appban. a TM SR a J/K a TM RR meg D/E. ha ezt tudja, nem értem miért gondolná bárki, hogy bár maradt a preset betűjel, de mégis TM2-es már az RR is.

szóval eltévedtek már az SR presetekel is, talán bízzák akkor ezt a Digital Foundryra.

-

Lehet állítani rajt . Amúgy igen alapból túl éles,de ha leveszed az élesítést nullára vagy 2-3 fokozatra , úgy jó. Alapból nálam mindíg valahova fél útra tolja a játékok alatt. úgy én sem szeretem , túl éles valóban.

Abu85: A transofrmer jobb minőséget ad játékok alatt , egyszerűen az élesítést mellé kell állítani.

-

Abu85

HÁZIGAZDA

Igen. A Cyberpunk 2077 különösen érzékeny erre, mert nagyon sok homogén felületet használ a dizájnból eredő döntések miatt. Ezért ennél a játéknál a DLSS 4 többségében rosszabb, mint a DLSS 3, így nem akarták a fejlesztők a jobb minőségű variánst kiszedni.

És egyébként az NVIDIA ezt egyáltalán nem tiltja. Tehát nyugodtan lehet implementálni a DLSS 4 mellé a DLSS 3-at, ha a grafikai dizájnnak éppenséggel nem kedvez a transformer modell.

És fontos, hogy ez nem élesség. Annak tűnik, de nem az. Működésbeli koncepcióból eredő torzításról van szó. Ezért érzed azt, hogy a kép egyik részén ennek előnye van, máshol pedig kifejezetten hátrányos a hatás. És már az elvi háttérből tudni, hogy hol előnyös és hol hátrányos, amit a gyakorlat igazol. A Cyberpunk 2077 csak kifejezetten extrém eset a sok homogén felületével, az a DLSS 4-nek rendkívül káros, mert pont ott teljesít rosszul, amiben túráztatja a szóban forgó játék.

-

Abu85

HÁZIGAZDA

Ezt nem az NVIDIA csinálja, hanem maga az alkalmazott módszer. A hagyományos AI felskálázás CNN modell, ami a mintázatokat lokálisan értelmezi, és a felskálázáskor az előzményminták elemzésével végül meghatározza a magasabb felbontású képen a pixelek színét. Ha klasszikus AI felskálázásról beszélünk, akkor a teoretikus natív minőséghez ez lesz a legközelebb, mert a pixelek színének meghatározásánál csak a szomszédos adatok lesznek felhasználva.

A DLSS 4 már egy hibrid modell, ami alapjaiban CNN, de ki van egészítve transformerrel. A transformer egyik jellegzetessége, hogy nem csak lokálisan működik, hanem minden elem figyel a többire a feldolgozás során, ami például nagyon jól jön szövegfeldolgozásnál, vagyis chatbotokhoz, de nagyon kellemetlen dolog a képfeldolgozásnál, mert minden pixelt az összes többire vonatkoztat, aminek a kellemetlen és kivédhetetlen mellékhatása az lesz, hogy kiemeli a kontrasztos éleket és textúrákat.

Ez egyébként nem ismeretlen dolog, az NV is foglalkozott vele régebben. El is mondták, hogy értik ők is a hátrányait. Ergo pontosan tudták, hogy amikor ebbe az irányba elindultak, akkor a DLSS 3-hoz viszonyítva messzebb kerülnek attól az eredménytől, amit a teoretikus natív minőség jelenti, vagyis nem lepte meg őket, hogy a DLSS 4 jobban torzítja a végső képet.

Ami miatt ezt vállalhatták az az, hogy a CNN+transformer egy helyen jobb a hagyományos CNN-nél, mivel az elvi működése jobban kiemeli az apró részleteket. Viszont ezért cserébe számottevően torzítja a homogén felületeken, mint karakter bőre vagy ég, és végeredményben picit zajossá teszi a felskálázott képet.

Tehát az NV tud róla, hogy ez így nem jó, de nem tudják kiszedni belőle, mert a negatív hatások konkrétan az elvi működéséből erednek, és nem azért, és mert ezt így akarják.

#50633 FLATRONW : Nem, itt nem erről van szó. Az emberek csak nem tudják elég jól megfogalmazni, amit látnak. Valójában nem az élesítés a gond, mert nem élesít. Léteznek nagyon jó analitikai kontrasztadaptív élesítők, amelyek ezeket a jelenségeket elő sem hozzák. Amit kritikaként megfogalmaznak egyesek a DLSS 4 kapcsán, az abból ered, hogy a transformer elvi működése által biztosított globális konzisztencia a homogén felületeknek árt. Ez nem egy élességgel kapcsolatos probléma, hanem arról van szó, hogy a DLSS 4 egyszerűen az emberi bőrfelületet rosszabbul tudja felskálázáskor helyreállítani a DLSS 3-hoz viszonyítva, mert ezeknél a felületeknél az lenne a kulcs, hogy a pixel színét ne befolyásolja egy távoli, például a kép legszélén lévő fekete pixel, mert semmi köze hozzá. A DLSS 4 rendszerszintű koncepciója ezt a működésbeli hátrányt nem tudja eliminálni, mindenképpen lesz negatív hatása a homogén felületekre a nem lényeges pixeleknek.

-

X2N

őstag

Mert a felskálázás se tud annyi részletet visszahozni hogy ne legyen mosott a kép így inkább túlélesítik.

A natív felbontás, AA nélkül, retina kijelzővel, az tuti. Nincsenek kép anomáliák. Csak brutál részletes kép.

FLATRONW-En csak azt remélem hogy lesz 8K oled monitor 27-32"-es méretben és majd egyszer eljutunk arra a pontra hogy ezt legalább 144fps-el meg is lehet hajtani mindenféle dlss, AA-nélkül.

-

FLATRONW

őstag

Én inkább úgy fogalmaznék, hogy egyeseknek semmi sem jó. Nem jó, ha a TAA elmossa a képet, nem jó, ha a DLSS rendbe teszi azt.

Szerencsére a többség látja, hogy mekkora ugrásokat is jelentenek a minőségben a félverzió váltások is. Remélem, hogy az NV folytatja ezt az utat, én nagyon elégedett vagyok az eredménnyel. -

PuMbA

titán

Arról megfeledkeztem, hogy 7900XTX-en megy az XeSS, az egy élhető alternatíva tud lenni. Radeon 6700XT-n XeSS-t használtam, egy játékot úgy vittem végig

Mindig is gondolkoztam rajta, hogy igazából az XeSS egyébként a legnagyobb support bajnok, hiszen RTX előtti kártyákon is fut és a képminősége jó:

Mindig is gondolkoztam rajta, hogy igazából az XeSS egyébként a legnagyobb support bajnok, hiszen RTX előtti kártyákon is fut és a képminősége jó:Ray Tracing with The TITAN V and 0 RT Cores - Can It Beat An Entry Level RTX Card?

FSR alternatíva lehet, de mégis második helyre rakom, mert rosszabb a képminőség. Sebességben viszont gyorsabb az XeSS-nél. Szóval ezért is drukkolok az Intelnek, hogy legyen egy harmadik erő, mert az XeSS-t nagyon jól megcsinálta ezzel a hibrid hozzáállással szerintem.

-

huskydog17

addikt

"Most már hivatalos, hogy az új preseteket az RTX2000-res és 3000-res egyáltalán széria nem bírja, az NVIDIA nem ajánlja ezekre a kártyákra."

Ez egy hatalmas marhaság. Szomorú, hogy a cikk alapján ekkora hülyeséget sikerült leszűrnöd.

A Turing és Ampere bírja a DLSS 4.5-öt, ezért lett rajtuk is engedélyezve. Ha nem "bírnák" és az NV nem ajánlaná, akkor nem lennének támogatva. Ezen felül láthatod a DLSS Override táblázatban is, hogy rengeteg olyan játék van, ahol a Turing és Ampere is annyira gyors, hogy még az M és L presettel is megbirkóznának. Nem kizárólag a legújabb Path Tracing játékok léteznek ám, azokon kívül létezik még pár száz DLSS 4.5 kompatibilis játék.

Ezen felül a jelentős sebességdeficit csak M és L presetnél jelentkezik, ami a Performance és Ultra Performance beállítás esetén használandó, minden más beállítás (Quality, Balanced, DLAA) esetén a K preset az aktív. Ezt az NV dokumentáció egyértelműen írja, ezúton is köszi a linket gV kollégának, aki be is rakta képként az ide vonatkozó screenshotot.

Ez amúgy az általad linkelt videocardz cikkben is le van írva, ezért se értem, hogy miért ilyen nagy baromságokra következtettél.Rengeteg olyan játék létezik amelyeknél a Turing és Ampere bőven meg tud birkózni a DLSS 4.5-el, sőt akár még az M és L presettel is ha nagyon kell. Sőt, vannak olyan játékok is, ahol egy sima RTX 2060-as is megbirkózik a DLSS 4.5-el. Sok felhasználó hasznát tudja és hasznát fogja venni az új transformer modellnek Turing és Amperre kártyákkal is, mivel az AMD-vel ellentétben az NVIDIA erre megadta a lehetőséget.

Igen, nyilván lassabb a 4.5-ös, mint a 4.0, mivel ötször komplexebb, ráadásul a Turing és Ampere nem támogatja az FP8-at, de pont azért van az NV App, hogy a játékos eldöntse magának, hogy melyik verziót akarja használni. Az NV inkább a játékosra bízza a döntést, míg az AMD eldöntötte a játékosok helyett, hogy a 2 éves hardvernek is a kukában a helye.Szóval a hivatalos infó az az, hogy a DLSS 4.5 minden RTX kártyán támogatott, mindegyiken lehet használni.

Minden RTX felhasználó megkapta az új technológiát, így 7-8 éves hardverekkel is ki lehet próbálni, ellentétben a piros oldallal, ahol a 2 éves hardver is a kukában landolt és a lehetőséget sem kapták meg az RDNA2/3 tulajok, hogy kipróbálhassák az FSR4-et, pedig ott ugyanaz a helyzet:

Egy RX 7900XTX nagyon sok játékban jó sebességet adna FSR4-el, de az AMD úgy döntött, hogy az nem kell a piros felhasználóknak. Ott ment a duma, hogy nincs FP8 támogatás az RDNA3-ban. Nos, a Turing és Ampere-ben sincs FP8 támogatás, de mégis kaptak DLSS 4.5 támogatást. Na az AMD-nél valóban lehet mondani, hogy nem ajánlják az FSR 4 használatát RDNA4-nél régebbi architektúrákon, hiszen nem is tették leérhetővé, ott igaz lenne az állításod.

Most ott tartunk, hogy egy sima 7 éves RTX 2060-al is szebb képminőséget kaphatsz, mint egy RX 7900XTX-el. Sőt, ha a gyakorlatban a DLSS 4.5- valóban hoz egy újabb ugrást képminőségben, vagyis a független tesztek ezt majd alátámasztják, akkor egy 7 éves RTX 2060-as szebb képminőséget lesz képes adni számos játékban, mint egy legújabb RX 9070 (XT).

Sőt, ha a gyakorlatban a DLSS 4.5- valóban hoz egy újabb ugrást képminőségben, vagyis a független tesztek ezt majd alátámasztják, akkor egy 7 éves RTX 2060-as szebb képminőséget lesz képes adni számos játékban, mint egy legújabb RX 9070 (XT).

Én majd nagyon kíváncsian fogom újra elővenni idén a Shadow of the Tomb Raider-t és ezúttal DLSS 4.5-el fogom újra végig vinni, amit egy RTX 2060 felhasználó is megtehet.

-

huskydog17

addikt

Nem tudom hol milyen mérést látsz, de még nincsenek független tesztek, mert csak pár órája jött ki a driver. Lehet van pár videó, ahol gyorsan összecsaptak valamit, de én megvárnám a normális, jó minőségű független teszteket mielőtt bármilyen következtetést levonnék. A jó teszthez idő kell.

-

S_x96x_S

addikt

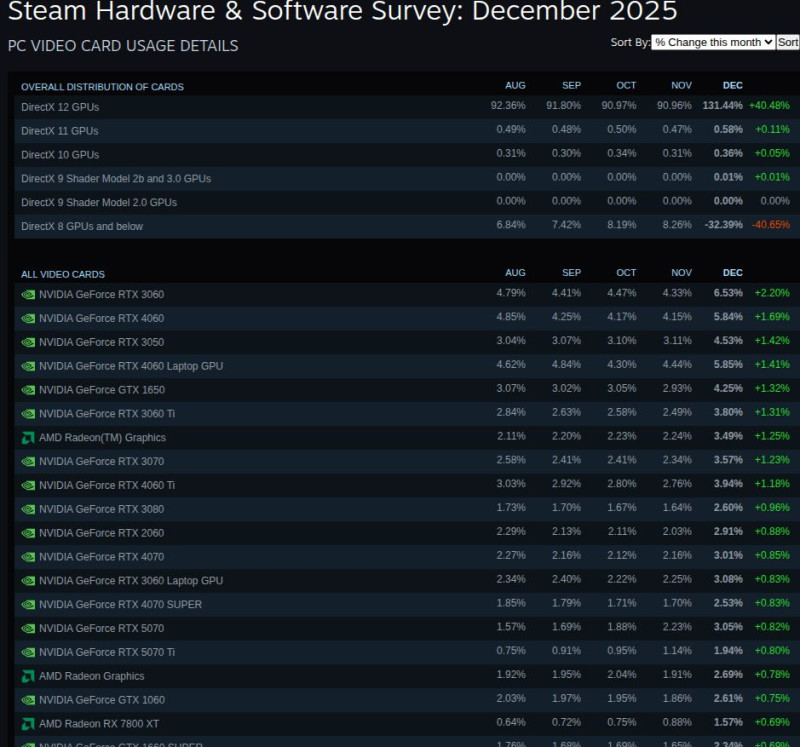

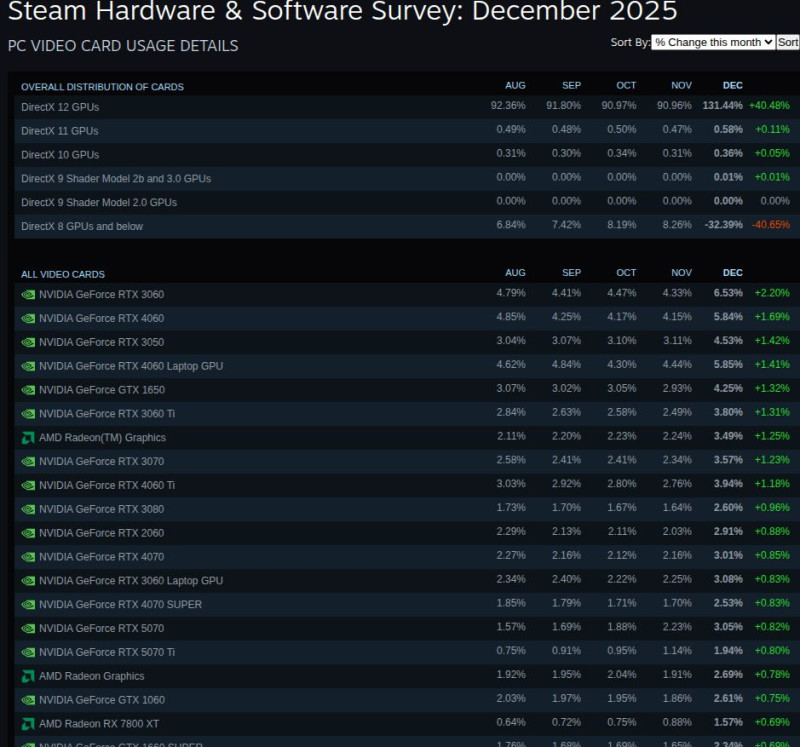

Az biztos, hogy "részleteiben" NEM KORRELÁL

a JPR és a Steam;

Decemberben például 50%-al megnött az RTX 3060.

ami biztos nem korrelál a JPR-el,

mert már nem is gyártja az nvidia.

Persze a mintavételi anomáliák talán magyarázhatják ezt a dolgot,

de a többi számolási anomália miatt akkor is elég furcsa.

A Steam dec. stat. szerint

az 1 hónapos növekedési változások szerint a rangsor

1. RTX 3060; 4.33%-->6.53% ( vagyis 50%-os növekedés! )

2. RTX 4060;

3. RTX 3050;

4. RTX 4060 Laptop GPU;

5. GTX 1650;

... RTX 3060 Ti ; AMD Radeon(TM) Graphics ; RTX 3070 ; RTX 4060 Ti ; RTX 3080 ; RTX 2060 ; RTX 4070 ; RTX 3060 Laptop GPU ; RTX 4070 SUPER ; ( és 15.nek végre egy ) RTX 5070; RTX 5070 Ti ; AMD Radeon Graphics; GTX 1060 ; RX 7800 XT ; GTX 1660 SUPER ; RTX 5080 ; RTX 4050 Laptop GPU; RTX 4070 Ti ; Intel(R) UHD Graphics ; ... ]

Ezeknek a GPU-nak a 95%-a biztos nem szerepel a JPR statisztikában.

https://store.steampowered.com/hwsurvey/videocard/?sort=chg

-

Busterftw

nagyúr

Nem, azt mondom, hogy AMD-nel ugyanugy nem tudod mennyi megy csak jatekra, csak munkara/AI-a es mit csinalsz azzal aki jatszik is es dolgozik, oket hova sorolod?

Erre mar kertem forrast, aztan megy a pislogas utana, de onertekeles es korrekcio az nincs es hozzatok ugyanezt a hasrautott marhasagot ujra es ujra.

Tehat most akkor mi van?

Semmi, forras nulla, lesz valami tereles aztan 1 honap mulva beirod ugyanazt a marhasagot. -

X2N

őstag

Amikor megjelent leszedtem, meg felnéztem nexus-ra UE5 konfig file-okért amivel kimaxoltam a grafikát a gyárihoz képest is sokkal jobban nézett ki, messzebbre rajzolta ki a vegetációt, árnyékokat, meg részletesebb volt minden, stb, nem ájultam el még így se tőle, szokásos TAA mosoda, 2-3 óra bőven elég volt belőle hogy mindent kiderítsek ami érdekelt, ez nem stalker, ez egy far cry, stalker skinnel. Nem érte meg akkor a teljes árát így nem vettem meg még. Nézted benne a fákat? Azok nem fák, csak kis termetű fák. Nevetségesen néznek ki, túl kicsik, ráadásul az egész világ fel van nagyítva méretbe...

-

X2N

őstag

55 GB, az elég baráti manapság. TPS-játék, nem kellenek bele nagy felbontású textúrák mint egy FSP-nél, a kamera miatt. Megúszós.

A stalker 2-t tudtam h fel fogod hozni

, arról inkább ne is beszéljünk nem használja ki a nanite-ot a vegetációra, majd ha eléri a 2.0 verziót és az újabb verziós UE-n fut meg az AI life 2.0 benne lesz ahogy megigérték majd ránézek.

, arról inkább ne is beszéljünk nem használja ki a nanite-ot a vegetációra, majd ha eléri a 2.0 verziót és az újabb verziós UE-n fut meg az AI life 2.0 benne lesz ahogy megigérték majd ránézek. -

X2N

őstag

Ha a procikat megnézem akkor a 7800X3D-449$ MSRP-vel jött ki 2023-áprilisban. 330$ körül meg lehetett venni 2024-ben, majd felment az ára 450$-ig 1 évvel később, most se sokkal olcsóbb, 400$.

9800X3D már $479-al nyitott, 2025-ben 470$ csak néha esett be az ára 440-usd-re.

Középkategóriás kártyát(9070XT) ne hasonlítsunk már 7900XTX-hez, nem ugyanaz a kategória. 3 évvel később a generációváltáskor olcsóbb a 9070XT?

Erről szól a fejlesztés. Előző gen csúcsa teljesítményét hozza már az új generációs kártya azon az árszinten. -

Busterftw

nagyúr

Nem eppen. Szerinte keves a vram, szerinte draga, es nincs konkurencia. Ennyi.

Nem volt sokkal olcsobb, 4080-rol valtottam, tudom.A rosszabb ar/ertek arany nem jelenti azt, hogy garbage. Az Nvidia mindig is lefedte kb 5-10% kulonbseggel a piacot, ebben nincs semmi uj.

Az ar/ertek arany pedig szubjektiv. -

Még ott az 5070 is.

A másik kérdés melyik gyártó fogja bevállalni a kisebb áremelést. Jelenleg jelentősen olcsóbb a 9070 XT az 5070Ti nél, pont ez miatt itt állok a holnapi napi vásárlásom elött , amikor végre összeállt az új konfigom, VGA van vissza és még én is gondolkodom azon megér e nekem plusz 60 ezer forintot egy 5070 Ti egy 9070XT vel szemben, kockáztassak legyen a 9070XT vagy pedig esetleg vegyem a viszonylag jó áron lévő 5070 -et inkább aztán maradjak 12 GB -on.

Ha az áremelkedésnél az Nvidiának eleve nagyobb marzsa hagy benne annyit, hogy nagyon nem szükséges emelnie árat míg az AMD már tudjuk hogy emel, az kérdés mennyire szűkíti a jelenlegi ollót az 5070 Ti és a 9070XT között. De igazából a piaci trend úgyis felrántja majd mindkét kártya árát lásd SSD és memória.A vágott PCIE -szel rendelkező 5060 Ti 16GB eleve egy érthetetlen húzás annak fényében, hogy egy 5070 re rátettek 12 GB vramot ez akkor bullshit hogy nem is értem. Még fordítva lenne értelme, egyetlen 5060Ti SKU 12 GB vrammal aztán jól van ha már spórolunk.

-

S_x96x_S

addikt

Nehéz eldönteni, hogy milyen hatása lesz;

- Sokan lehet, hogy elhalasztják a vásárlást/upgradet,

- vagy fogcsikorgatva kifizetik a drágább [RTX 5070 Ti] -t, vagy maradnak 8GB VRAM-on

- mások a 8GB - helyett az Intel 12GB felé mennek,

- és persze az [RX 9060 XT 16GB] még vonzóbb alternativa lesz.""""

https://x.com/TechEpiphanyYT/status/2001301980690739461

🔥 GPU Retail Sales Week 50 (mf)

Record ARC sales. RDNA 4 dominates. Nvidia earns.ℹ️ Units

AMD: 1545 units sold, 55.28%, ASP: 519

Nvidia: 1140, 40.79%, ASP: 928

Intel: 110, 3.94%, ASP: 231ℹ️ Revenue

AMD: 801747, 42.53%

Nvidia: 1058194, 56.13%

Intel: 25399, 1.35%ℹ️ By GPU

[RX 9070 XT] => 725

[RX 9060 XT] => 595

[RTX 5070 Ti] => 310

[RTX 5080] => 275

[RTX 5060 Ti] => 205

[RTX 5070] => 120

[RTX 5060] => 85

[RX 7600] => 80

[RX 7900 XTX] => 60

[RTX 5090] => 55

[RTX 3050] => 50

[ARC B580] => 40

[ARC A310] => 30

[RTX 3060] => 20

[ARC B570] => 20

[ARC Pro B50] => 20

[RX 6650 XT] => 20

[RX 9070] => 20

[RX 7900 XT] => 20

[RX 7700 XT] => 20

[GT 1030] => 10

[5060 Ti] => 10

[RX 6500 XT] => 5

"""és a kakukktojás/ ( vagy kategorizálási hiba )

"[5060 Ti] => 10" ami inkább RTX 5060 Ti lehet.----

A 49 -heti - itt a mid-range dominált és az AMD revenue share -ben is hozta a 62%-ot

https://x.com/TechEpiphanyYT/status/1998701687964319899

""""

💹 GPU Retail Sales Week 49 (mf)

Mid-range sales are expanding consistently

ℹ️ Units

AMD: 2670 units sold, 69.44%, ASP: 532

Nvidia: 1115, 29%, ASP: 745

Intel: 60, 1.56%, ASP: 200

ℹ️ Revenue

AMD: 1420905, 62.77%

Nvidia: 830652, 36.7%

Intel: 11986, 0.53%

ℹ️ By GPU

RX 9070 XT: 1620 Units (42.13%)

RX 9060 XT: 790 (20.55%)

RTX 5070 Ti: 455 (11.83%)

RTX 5080: 210 (5.46%)

RTX 5070: 175 (4.55%)

RTX 5060 Ti: 120 (3.12%)

RX 7600: 70 (1.82%)

RX 7900 XTX: 60 (1.56%)

RX 9070: 60 (1.56%)

RTX 3050: 60 (1.56%)

RTX 3060: 40 (1.04%)

RTX 5060: 40 (1.04%)

RX 6650 XT: 30 (0.78%)

ARC B580: 20 (0.52%)

ARC A770: 20 (0.52%)

RTX 5090: 15 (0.39%)

ARC A380: 10 (0.26%)

ARC A750: 10 (0.26%)

RX 6500 XT: 10 (0.26%)

RX 7700 XT: 10 (0.26%)

RX 7900 XT: 10 (0.26%)

RX 6400: 10 (0.26%)

"""" -

Alogonomus

őstag

A kérdés olvasásakor az Avatar nekem is beugrott, hiszen állítólag a ray tracing magába az enginebe van beleintegrálva, viszont a Steam szerint a minimum igény egy GTX 1070, ami viszont nagyon nem ray tracing kártya.

Alan Wake 2 is elvileg elfut GTX 1070 vagy RX 5600 XT kártyán.

Star Wars Oulaws detto.Indy az tényleg minimumként is RT-képes kártyát határoz meg.

Doom esetén pedig ki is hangsúlyozzák, hogy "raytracing-capable GPU".Valószínűleg extrém kevés játékhoz kell feltétlenül hardveres ray tracing egységgel rendelkező kártya, mert azzal azért a játékosok hatalmas hányadát eleve kizárják a stúdiók a potenciális vásárlók közül.

-

Busterftw

nagyúr

De mondtam, lásd mi számít a BSR-be. Nem csak az eladott mennyiség, amit te írtál.

"ott van a 9070XT vagy a 3060 azt jelenti, hogy folyamatosan magas eladásokat produkálnak."

Csak adott modellre érvényesen, ami konkrét mennyiség nélkül nem jelent sokat, lásd b. hsz-ét.A gond azzal van, hogy megint rossz konklúziót vonsz le ebből.

-

S_x96x_S

addikt

> az XFX 9070XT-n van 9300 értékelés,

régebben is ez volt a top;

+ valószínüleg jó az ár/teljesítménye

+ sokszor akciózzák

+ csak 1 verzió van ( nem aprózódnak el az értékelések )

=> sokkal több darabot adtak el belőle.Az MSI 3060 -ból meg több al-verzió is van

- ami elaprózza az értékeléseket. ( ventus 2x, ventus 3x, ... ) -

Busterftw

nagyúr

Te beszelsz video minosegrol amikor teljesen ignoraltad eddig?

Kulonbozo jatek felveteleknel ahol mas lehet a teljesitmeny es ugyanolyan video minoseg nelkul ez a video semmilyen formaban nem tenyszeru, se objektiv.Attol, hogy nem ertesz hozza, az nem a mi hibank.

Ugy nagyon nehez konstruktivan vitazni, hogy bedobsz a topikba valami marhasagot aztan amikor nem tetszik a valasz, akkor eltunsz es kesobb folytatod mashol ugyanazt.hokuszpk

A 4K felvetelen is vannak kulonbsegek, epuletek elei vagy a novenyzet.

De a 1440p is ugyanugy relevans, mert Nvidiaval nem ilyen otvar rosszul nez ki, csak ugye azzal takarozik a "tesztelo", hogy itt nem ket kartyat hasonlitunk ossze....

Ha meg nem ugyanazok a beallitasok, akkor nem objektiv az egesz teszt, teljesen rossz a konkluzio.A kiindulopontnak annak kell lennie egy osszehasonlito tesztnel, hogy a video minosege ugyanaz es a benchmark is ugyanaz. De ezt a videoban is elmondja, csak hosunk itt megint csak a cimig jutott, a tartalom ertelmezeseig mar nem.

-

Az OBS az egyik legnépszerűbb platform streamre ,ez van . Lehet kis cég, de ugyan azokat a beállításokat tudod alkalmazni mint Shadowplaynél, például NVENC AV1 60 fps 80 Mbps.

A hasonló az nem jobb és nem ugyan az. És a te videód alapján számomra az Nvidia tűnik a legjobbnak,de ez egy tömörített tartalom, YT.Az mellett írják többen a komment szekcióban hogy 1-2 % körli csökkenéseket tapasztalnak 5070 Ti vagy hasonló kártyákkal nem tudják ezt abszolválni amit afelvétel készítője.

Mindenképpen szükséges lenne más forrásokat és teszteket is megnézni erre ahogy írtad is.Amit beraktál a VS topikba raktad. Teszel hozzá ilyen megjegyzéseket hogy nem látsz különbséget meg meggyilkolja az minimum FPS-t.

Segítek ez a topik VS a megjegyzéseid pedig Vitát generálnak amire joggal reagálhatunk ellenkező véleménnyel.Topik lényege ez... -

ember leírod hogy meggyilkolja a minimum számokat ez egy végletes kijelentés és nem igaz.... Erre nekem aki Nvidia kártyát használ és 10+ éve streamel bólogatnom kellene? Igen igazad van, miközben nem ezt tapasztalom, látom és tudom?

Itt van egy másik videó ami feketén fehéren leírja mi a gáz, ezt ignorálod? [link]Én nem másolok senkit ,saját véleményem van ami mindíg is konzisztens volt, szerintem soha nem azonosítottak másnak, mint ami vagyok,( Nvidia troll, lásd alattad)

Veled szemben akit tavaly kitiltottak az AMD topikból most meg az ellenkezője lettél, az Nvidiába állsz bele folyamatosan.

Miért akarod közben bebizonyítani hogy a másik szar? Nem,nem szar. . -

Busterftw

nagyúr

Nincs egy szinten, ez a te altalad linkelt videon is a konkluzio.

Csak most megy a tereles es a felremagyarazas, szokas szerint.Ez akkor relevans, ha teljesen ugyanaz a benchmark es ugyanaz a video minosege.

Minden mas esetben ez egy hasznalhatatlan "teszt", egy szubjektiv velemeny.Beraksz egy osszehasonlito videot, aztan maga a csavo nem tesztel objektivan es magyaraz, hogy jaj itt nem a ket kartyat akarjuk osszehasonlitani...

Iparagi egyertetes van arrol, hogy minden ami video/streaming/VR stb, az Nvidia jobb. -

Butasag amit írsz.Nem kell elengedni semmit mert ez nem igaz.teljesen szemellenzős lettél,meggyilkolja a minimumszamokat

.Ember este szeretettel várlak a streamemre ,kuldok privátban meghívót aztán nézd meg a meggyilkolást.Meg legalabb bemutatlak masik 7 embernek akikkel 10 eve egyutt jatszunk hogy mi a helyzet. -

PuMbA

titán

Közben Benchmarking csatorna is beírt a videó alá kommentbe, hogy ugyanezt tapasztalja es muszáj capture card-dal fölvennie, mert az NVIDIA legyilkolja a minimum fps számokat.

-

Busterftw

nagyúr

"Ez a két kép nem is ugyanazt ábrázolja…"

Na jo reggelt, pont errol van szo, hogy a teszt nem lehet objektiv, epp ezt mondja a videoban is, hogy a jatek alatti korulmenyeket nem lehet osszehasonlitani es a video minoseget nem hasonlitja ossze....Ha pedig a video minoseg nem ugyanaz, hajadra kenheted a teljesitmenybeli elonyt.

Csak ugye ezt szepen ignoraltad es kihagytad, belefutsz az ujabb ongolokba."Látod lehull a lepel rólad"

Aha, ezert linkelted a "konkluziot" a videobol, mert maskulonben nem jon ki a narrativa.

"Onnan látszik, hogy csak a vita megnyerése a lényeg nálad, hogy pár hozzászólással előtte tettem be egy felvételt az RX9070-emmel, ami tűéles minőségű"

Ember, te hoztad ezt a teszted, akkor most miert menekulsz es terelsz? -

Busterftw

nagyúr

Irreleváns, videó minőség nélkül ez semmit nem jelent, illetve a pontos játék körülményeket sem tudja pontosan szimulálni, erről a videóban is beszél.

Teljesítmény szempontjából pedig ennél a tesztnél nagyon is számíthat a KB5066835.

"Én nem látok képminőség különbséget"

Én meg objektiven igen, szerintem szemészet ajánlott.

-

Nem erről van szó.Arról amit feljebb írtál.

Az első bányászláz alatt a Vega sokkal jobb volt bányászatra mint bármi más a második bányászláz alatt pedig nem sokkal voltak gyengébbek. Tökéletesen vitték a bányászrigekbe a Vega és RDNA2 kártyákat.

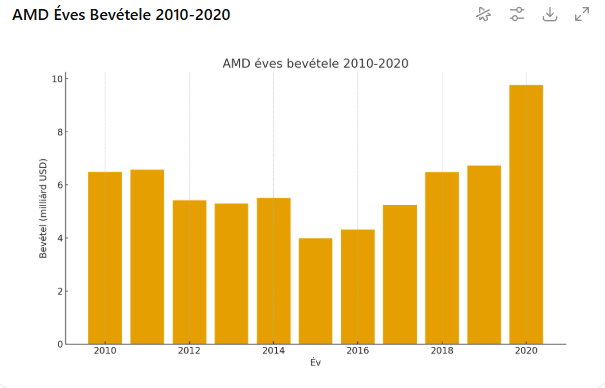

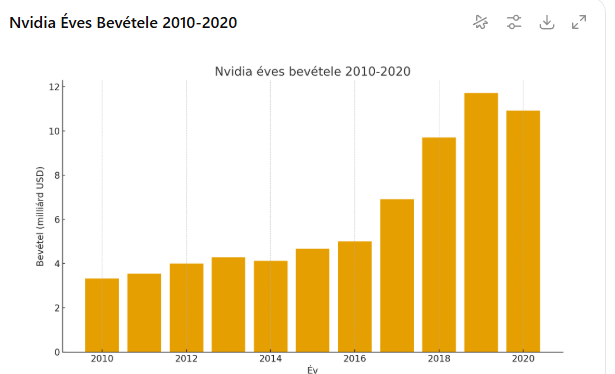

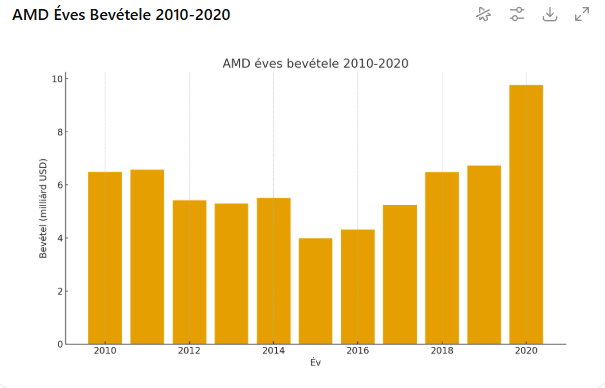

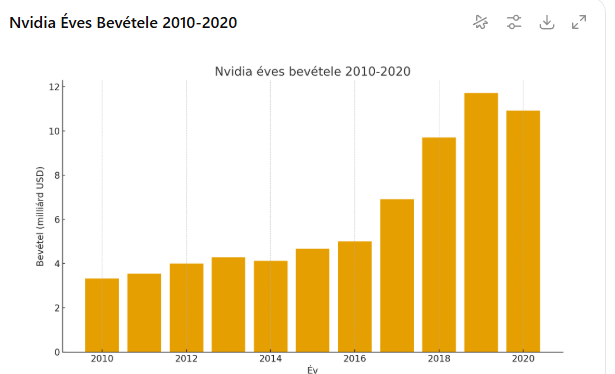

Az hogy az Nvidia stagnált volna 2010 től 2018 ig? 3x akkorára nőtt. AMD

AMD

-

Az első bányaszezon alatt az AMD kártyái vittek mindent és vitték mindenhova őket az Nvidia kis túlzással használhatatlan volt. akkor vitték, ha nem volt AMD...

A második bányaszezon alatt annyira magas volt a Krypto hogy mind az Nvidia hiába volt jobb az AMD kártyáit is ugyan úgy elvitték, egyáltalán nem volt hazsnálhatatlan bányászatra. Úgy beszélsz mint ha az AMD kártyák nem fogytak volna el korlátlan mennyiségben a bányászláz csúcsán.. hetek alatt visszatermelte az extra magas árat egy 6700 XT is.. [link] a z 500 dolláros Vega 64 1000 dollár fölött ment.. [link] -

PuMbA

titán

Mióta bejött a bánya aztán meg az AI, tehát kb. 2021-től taroltak az NVIDIA bevételek és market share. Hogy mi lett volna ezek nélkül, na az jó kérdés, de biztosan lett volna növekedésük így is attól függetlenül, hogy 2010-től 2018-ig stagnált az NVIDIA a bevételek terén.

-

Busterftw

nagyúr

Teljesen mas generacio, mas launchok, ezer masik dolog befolyasolhatja ezeket.

Viszont itt is ugyanaz all fenn, a Mindfactorynal sokkal jobb volt a "reszesedes" mint amit a global mutatott."A kiírás szerint csak a mennyiséget nézik"

Csak nem az osszes eladas alapjan, hanem bizonyos idon belul eladott mennyiseget, ott is van, hogy gyakran frissitik.

"based on recent sales performance, not overall lifetime sales."Ezert tudott egy csavo konyve 5 perc alatt bestseller lenni, mert manipulalta az algoritmust.

-

S_x96x_S

addikt

> "NVIDIA rumored to stop bundling memory with GPUs, squeezing smaller board partners"

Pedig az nvidia gaming bevételét extrém módon megemelte volna a szuper drága memória.

Kiváncsi leszek, hogy a GDDR6 vagy a GDDR7 -et érinti jobban a memória örület.

És 2026 év végén ( visszatekinteve)

mennyire szerencsés lesz az AMD RDNA4 GDDR6 -os választása.Egyrészt az AMD az RDNA4 -el jellemzően több memóriát ad, mivel a 16GB-os GDDR6 -os kártyák eladásai dominálnak,

És a GDDR6 termelés kifutóban van;

de az RTX 50 -hez szükséges GDDR7-esnél meg az AI szívja el a termelő kapacítást,Mindenesetre az olcsó kártyák ( 050 , 060 ) termelését valószínüleg lecsökkentik - mert nem lesz gazdaságos

( nem fogják elbirni az áremelkedést )

""

Just in: AMD and Nvidia are considering discontinuing mid- to low-end gaming GPUs where memory costs account for a large share of the BOM. Taiwanese PC makers such as ASUS are reviewing plans to reduce memory configurations.

""" ( via x.com/Jukanlosreve - 2025-nov-18 ) -

Busterftw

nagyúr

Egyszeruen nem fogod fel az aranyokat, sokadszorra sem es hajtogatod ugyanazt.

Ezek 1-1 boltok par orszagban, ki tudja mekkora mennyiseggel.A best selling listakat is leirtam mar, hogy az algoritmus nem csak a mennyiseget nezi, ezt is fullba ignoralod.

2025 H1-ben a piacra kerulo ~20.8 millio kartyabol ~19.38 millio Nvidia volt.

Tehat a vilag osszes mas orszagaban, az osszes boltba ~1.44 millio Radeon kerult az elso fel evben.

Ebbol ~1000 darab Mindfactory hetente."Nem emlékszek olyanra sose, hogy az MF-nél egy AMD kártya modell ennyire fogyott"

Persze, hogy nem mert fullba write-only vagy, mar hoztam peldat.

Week 38, 2024 (September 22 report)

AMD’s Radeon RX 7800 XT led weekly sales.

AMD captured 45% market share, while NVIDIA held 53.35%.

Week 10, 2021

RX 6700 XT AMD captured 42% market share

Week 3 2022

RX 6500 XT 45% market shareEgyszeruen ez ami van, nem egyedi.

-

Busterftw

nagyúr

Mindfactorynal eddig is jol fogyott a Radeon, a multkor mar linkeltem minden generacioban (RDNA)hasonlo bolti statisztikakat.. Ez a mindfactory bias, hiaba fogytak 50% korul a Radeonok, ez egy toredeknek a toredeke, semmit nem jelent.

Q1-Q2-bol tudjuk, hogy a teljes Radeon mennyiseg ugyanannyi volt, teljesen mindegy, hogy ebbol aztan 1 bolt Radeon szazaleka 45% vagy 55% epp azon a heten.

Felallasban es strategiaban nem valtozott semmi. 15-20% arelony volt eddig is, ami egyszeruen nem eleg, ha nincs paritas.

"de ehhez még 2 jó VGA generáció kell az AMD-től"

Igen ezt hallgatjuk mar jo par generacio ota. Majd a kovetkezo generacio, majd meg ket generacio...

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Kész rémálom lesz Linuxot használni jövőre az USA egyes államaiban

- iPhone topik

- Anglia - élmények, tapasztalatok

- Itt a Galaxy S26 széria: az Ultra fejlődött, a másik kettő alig

- Mikor lesz már jó a Bluetooth? — Bluetooth 6.0 technológia

- Entware topik

- Battlefield 6

- Bittorrent topik

- CADA, Polymobil, és más építőkockák

- Intel Core i5 / i7 / i9 "Alder Lake-Raptor Lake/Refresh" (LGA1700)

- További aktív témák...

- iPhone 16 Pro 128GB Desert Titanium -1 ÉV GARANCIA - Kártyafüggetlen

- GYÖNYÖRŰ iPhone 12 mini 64GB Purple -1 ÉV GARANCIA - Kártyafüggetlen, MS3851

- HIBÁTLAN iPhone 14 Plus 256GB Red-1 ÉV GARANCIA - Kártyafüggetlen, MS4561, 100% AKKSI

- ÁRGARANCIA!Épített KomPhone i7 14700KF 32/64GB RAM RTX 5070 12GB GAMER PC termékbeszámítással

- Újszerű iPhone 14 Plus 128GB Lila független, 100% aksi, 1 ÉV GARANCIA, 14 Napos elállás!

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

Jó kártyák.

Jó kártyák.

4-k-s PBR textúrákkal, 8-16K-s HDRI environment mappal azért legyen legaláb 16GB vramod a kártyán, azzal már van esélyed hogy nem fut ki belőle. Vannak olyan pár száz MB-os blender file-ok aminél egy tigris/gepárd modell van csak, de a szőre az fibermesh hair, 24GB már arra is kevés. Amikor már több karakter van hajjal mindennel arra már 32GB memória is kevés, procira kifogja rakni a rendert.

4-k-s PBR textúrákkal, 8-16K-s HDRI environment mappal azért legyen legaláb 16GB vramod a kártyán, azzal már van esélyed hogy nem fut ki belőle. Vannak olyan pár száz MB-os blender file-ok aminél egy tigris/gepárd modell van csak, de a szőre az fibermesh hair, 24GB már arra is kevés. Amikor már több karakter van hajjal mindennel arra már 32GB memória is kevés, procira kifogja rakni a rendert.![;]](http://cdn.rios.hu/dl/s/v1.gif)

AMD

AMD