-

Fototrend

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Yany

addikt

válasz

Senki9876

#57597

üzenetére

Senki9876

#57597

üzenetére

Sokat (hónapokat(!)) filóztam, hogy a régi (szintén saját config) NAS-omat Synology-ra, vagy ismét sajátra cseréljem és egy szoftver véglegesen eldöntötte a kérdést: StableBit. Iszonyat sokat sórolok vele tárhely-árban, mert ebbe már nem voltam hajlandó vinyót rakni, az SSD-k kiosztását meg eszméletlen jól lehet vele konfigurálni.

Amúgy a vas:

Alaplap: Gigabyte B550I Aorus Pro

CPU: Amd Ryzen 5 5600G

Hűtés: Noctua NH-C14S

RAM: 2x8GB DDR4-3600

Ház: Thermaltake Core V1

Táp: Corsair RM650x (2021)

SSD: 1db Samsung 980 Pro 1TB + 2x2TB Samsung 870 Evo

SW: Win 10 Pro + StableBitA legjobb ház a világon arrra, amire nekem kellett, mert egy 33x33-as polcrendszerbe kellett betegyem és nem csak hogy befér, de tök faszán ki is aknázza a helyet, így fér bele még egy relatív komolyabb VGA is miniITX létére, ráadásul az oldallapjai átrendezhetők.

Párom grafikai "munkaállomása" is hasonló, csak abban 2TB-os az egyetlen Samsung 980 Pro SSD, 32GB RAM-mal fut és 5700G lapul benne. Minden más ugyanaz és hasonlóan egy kocka alakú polcon csücsül.

Ja és 750W-os a tápja ha kell majd bővíteni VGA-val pl.

Ja és 750W-os a tápja ha kell majd bővíteni VGA-val pl.ps.: már kaptam érte, hogy minek ilyen erős vas NAS-ba, de a fő feladata mellett van egyéb dolga is és hamarosan kvázi házi szerverként fogom használni fejlesztéshez is. Amúgy köszi a méltatást.

fun fact: idle-ben (az idő nagy részében) 18~22W-ot húz ki a konnektorból.

-

Senki9876

tag

-

Yany

addikt

válasz

Senki9876

#57594

üzenetére

Senki9876

#57594

üzenetére

Csakhogy a video encode rész már a 6500-ból is hiányzik, miközben évek óta van egy egészen használható QuickSync az Intel IGP-iben. Valamit nagyon nem akar eltalálni az AMD ezen a Low-end/IGP szinten.

Mondom ezt úgy, hogy két darab kocka gép is üzemel idehaza 5600G és 5700G APU-kkal a szívük helyén. Ez itt pl. a NAS:

-

Yutani

nagyúr

válasz

Hellwhatever

#57592

üzenetére

Hellwhatever

#57592

üzenetére

Agronomus alaptézise rég megdőlt, nincs olyan épeszűen összerakott konfig, ahol az AMD oldal elbír egy 40k-s VGA kártyát azonos CPU teljesítmény szinten az Intellel.

-

Hellwhatever

aktív tag

válasz

Petykemano

#57591

üzenetére

Petykemano

#57591

üzenetére

Ebben teljesen egyet értünk, erre a felhasználásra egy 5600G abszolút jó választás.

Csak azért néztem IGP mentes procikat mert az alaptézis az volt hogy ezek mellé kerülne az RX6300 és még így is olcsóbb lenne a konkurencia IGP-s megoldásainál.

-

Petykemano

veterán

válasz

Hellwhatever

#57583

üzenetére

Hellwhatever

#57583

üzenetére

Én 5600X helyett 5600G-t tennék a konfigba, ami 20eFt-tal olcsóbb is és szükségtelenné teszi az RX6300-at. Persze lehet, hogy az 5600G IGP teljesítménye nem éri el az RX6300-ét, de ez az "Intel counterpart" esetén sem volt megfelelőségi szempont, tehát feltételezem, hogy bármilyen képet adó megoldás megfelel.

Persze az igaz lehet, hogy az 5600G CPU teljesítménye nem éri el a 12400-ét. De legalább annyival olcsóbb is. Viszont ez már nem igaz a még szintén potens i3-mal szembeni összehasonlításra. De azt nem tudom, hogy árban és teljesítményben mennyire versenyképes az 5300G

De ez szerintem mind érdektelen. Az RX 6300 célja/racionalitása szerintem nem az AMD-nél keresendő. Az ugyanúgy egy hülye, de legalábbis vitatható érvelés, hogy ez biztosít lehetőséget a legolcsóbb módon a a CPU kimaxolására úgy, hogy a grafikus teljesítmény csak annyira fontos, hogy adjon képet. Az 5600X az 5600G-vel szemben ugyanis nem a CPU kimaxolása.

Na mindegy, ez nem a ravasz és tájékozott prohardver olvasóknak készül.

Szerintem itt csak arról van szó, hogy kellett az OEM-eknek egy olyan olcsó GPU, amit beletehetnek a gépbe, amire árrést számolhatnak fel, akkor is, ha nincs rá szükség. Tehát szerintem fogunk látni RX 6300-at 5600G vagy 5300G mellett is. Ez korábban is megtörtént, akkor is, amikor történetesen az IGP valójában erősebb volt, mint a mellé betett R5 250 meg ilyenek. Egyszerűen azért, mert az OEM spórol 1-2 dollárt azon, ha a 8 vagy 16GB Ram-ot 1 stick formájában helyezi a gépbe. Ezzel persze kiheréli az IGP-t, de mindegy, mert azzal nem lehet eladni egy gépet, hogy nem 1 stick, hanem 2 stick van benne és emiatt jó az IGP. Ezt az emberek nem értik. Milyen videokártya van benne? Nincs benne. Ja, hát akkor az jó szar lehet.

Viszont azt nagyonis rá lehet írni, hogy van benne egy RX 6300. Milyen videokártya van benne? Egy RX 6300. Az nem a legjobb, de hát azért van. A kártyán meg keres még $10-t. Összesen $12-ral jár jobban azzal, hogy lényegében átveri a vásárlót, mintha nem tenné. És lehet, hogy a vásárló is elégedett azzal, hogy a videokártyája mondjuk 50-60%-kal gyorsabb, mint az IGP lehetne. -

Hellwhatever

aktív tag

válasz

olymind1

#57585

üzenetére

olymind1

#57585

üzenetére

Igazad van, a Ryzen 5 4500 59 190 Ft (lappal 76 480 Ft) vs. i3 12100 55 590 Ft (lappal 97 280 Ft) irodai felhasználásra jobb összehasonlítás lett volna. Itt 20 800 Ft-ba kéne beleférnie az RX6300-nak.

#57588: 7 másik lapot látok 50 000 Ft alatt az említett boltnál, lényegében egyik sem változtatna a dolgon. Bőven pariban vannak az általam alapul vett 17 290 Ft-os MSI B450M-A PRO MAX-szal ami ráadásul Basic garis szval valszeg bontott példány.

-

Alogonomus

őstag

válasz

Hellwhatever

#57583

üzenetére

Hellwhatever

#57583

üzenetére

Na az az alaplap pont azért kerül annyiba, mert egy sz*rkupac. Kihasználja, hogy az Intel a minél nagyobb eladott darabszám érdekében mindent jóváhagy, ami legalább az alapfrekvenciára képes. Ezért írtam a teoretikus 60 ezret, mint egy már tényleg használható B660-as alaplap árát, amiben például a i5 12400 már tényleg kifuthatja a 4,4 GHz-es maximumát, nem akad meg 3,4 GHz-nél.

-

bjasq99

tag

Ha jól gondolom (és ha nem talán abu kijavít) akkor a jelenlegi ray tracingnek két fő problémáját tudom

Az egyik az inkoherencia miatti nehezen cacheelhetőség, a másik meg a skálázodás.

Itt a nehezen cacheheelhetőség szerintem azért problémás mert ha többször kell nyulni a memóriához ami nem energia hatékony plusz hiába hogy azt mondjuk, hogy a gpuk jól tolerálják a késleltetést(ami igy is van), de a mai hardverek idejében egyre fontosabb a késleltetés szerepe is, és végül a cache problémához ami öszzefüg a skálázodás problémájával az az hogy a cacheben található elememek sávszélességgel érhetőek el, itt még az sem mindegy hogy a bvh szinteket a cacheben, hogy csoportosítják aki ezekbe is belemerülne van sok cikk egy példa:https://www.intel.com/content/dam/develop/external/us/en/documents/bvh-layout.pdf

Itt a skálázodáshoz hozzátartozik az előbb említett sávszélesség hiány

Ha jól értem akkor az van hogy megfelelő programozhatoság hiányában nem lehet jól skálázni a bejárást tehát fölösleges számításokat kell végezni. Ha az adott sugár nagy utat járt be a nézőponttól akkor is az adott primitivekhez tartozó loadból kell bvh-t generállni ami túl részletes lehet és ebből túl sok a felesleges számítás. Ha jól gondolom akkor az lenne az optimális ha dinamikusan lehetne felépíthető az adott bvh a sugár hosszátol függően, de ezekben nem vagyok teljesen biztos.

És igazából itt lenne az első igazi kérdésem abu85 hogy a bvh felépítés most, hogy zajlik írtad töbször hogy most az van hogy most az összes loadszinthez meg kell csinálni egy bvh-t, tehát ez úgy működik, hogy leképezik így a jelentbe összesen elöfordulható fontos hogy feltételes mert egy rakat flesleges, és amikor a hardver követi a rayt és egy új boxra kerül a ray akkor a shader fogja és belinkeli a memóriából a megfelelő load szintő boxot (vagyis inkább bvh t) vagy nem így, ez egy kicsit ködös.

Előre is köszönöm ! -

válasz

Hellwhatever

#57583

üzenetére

Hellwhatever

#57583

üzenetére

Plusz irodai felhasználásra simán elég egy IGP és 4 mag vagy AMD APU, nem kell oda egetverő processzorerő.

kivéve ha 500 excel táblát kezelnek egyszerre ,de ott meg nem 20 ezer forint difi fog számítani. -

olymind1

senior tag

válasz

Hellwhatever

#57583

üzenetére

Hellwhatever

#57583

üzenetére

Más üzletben 82 ezerért kapható az i5-12500, illetve ha veszel processzor hűtőt akkor 73e ért kapható 12400 tray kivitel is. Vagy 12400f vga nélkül 69e, ha már AMD oldalon sincs vga a procikban.

Meg van sima 5600 is 80 ezerért, meg 5600x 87-88e-ért.

-

bjasq99

tag

válasz

GeryFlash

#57413

üzenetére

GeryFlash

#57413

üzenetére

Bocsánat hogy majd egy hónap késéssel írok erre a kérdésedre és úgy hogy abu már válaszolt rá, de azt veszem észre, hogy a fórumon nagyon sokan csak tflopsokban gondolkodik, ami nagyon nem pontos.

Vegyünk példákat:

az rdna 2 lényegesen kevesebb tflopsból hozza az ampere teljesítményét

a ampere kártyáknak sokkal magasabb a BVH bejárására használt hardver teljesítménye, de kit érdekel, hisz az egy fixfunkciós hardver

a valós teljesítmény sokkal sokkal több dologtól függ mint az hogy hány tflops, annyi tényezőtől amennyit soha! nem fog ez a lap de még a többi lap se.

Ugye az egészet ketté lehet bontani szoftverrészre és hardverrészre, hogy mit engednek meg a keretek.

És a többi raytracinges kérdésekre is reflektálva induljunk ki leegyszerűsített példákból.

Vegyünk egy olyan hardvert ami tele van bvh gyorsítókkal de mondjuk valami miatt ebben a képzelt világban nem létezik bvh generálás, mi marad? a brute force megoldás azaz minden kilött rayt minden primitivre le kell tesztelni, ez a skálázodás szempontjából nagyon nem ideális ugyanis egyenesen arányos a kilött sugarakk számának és primitivek számának szorzatával, pont ezért vannak gyorsítotárstruktúrák mert igy ha egy boxot nem metsz a ray akkor a boxban található primitivekkel nem kell foglalkozni. Így lehet hogy egy összességében kisebb teljesítményű hardver sokkal gyorsabb is lehet ha jobban programozható. És ne jusson senkinek eszébe hogy most erről van szó ez egy leegyszerűsített példa, de a mostanában vitatott téma is hasonló mégpedig a fixfunkciós vagy programozható raytracing esetén igaz itt nem feltétlen csak a skálázodásról van szó, de erről bővebben lejjebb így is hosszú lett ez és bocsánat akinek nagyon gyerekes volt itt a magyarázat -

Hellwhatever

aktív tag

válasz

Alogonomus

#57581

üzenetére

Alogonomus

#57581

üzenetére

Jelenleg az iPonnál 41 690 Ft a legolcsóbb B660-as lap, bele egy i5 12400 ugyanitt 79 690 Ft = 121 380 Ft.

Egy 5600x 97 989 Ft, a legolcsóbb B450-es lap pedig 17 290 Ft = 115 279 Ft.

A két kombó között a különbség 6101 Ft, ebbe kéne beleférnie az RX6300-nak. Ha a két lap közti árdifit nézem akkor 24 400 Ft. Kötve hiszem hogy akár ezen az árszinten mozogna az RX6300.

Szerintem ez a matek nem jön ki.

-

bjasq99

tag

Először is mindenkit üdvözlők! Néhány éve már rendszeresen olvasom a cikkeket és a fórumokat, de idáig hozzászólást nem tettem. Meg kell említenem, hogy ennek a lapnak köszönhetem informatikai tudásom egy jó részét, amit a cikkek és fórumok olvasásából szereztem. Annak reményében, hogy tovább gyarapíthatom saját és mások tudását most megpróbálok bekapcsolódni a fórumok mindennapos menetébe, remélem több mint kevesebb sikerrel.

-

Alogonomus

őstag

válasz

Yutani

#57580

üzenetére

Yutani

#57580

üzenetére

Meglévő AM4-es alaplap esetén ez a "nyamvadék" biztosan olcsóbb, mint egy extra Intel alaplap. Processzort pedig mindkét esetben venni kell. Szóval abban az esetben a kérdés úgy hangzik, hogy az Intel-es alaplap+processzor a drágább, vagy az AMD-s RX6300+processzor.

Új gép építése esetén sem sokkal kedvezőbb a helyzet, mert egy legalább B660-as (60e Ft) alaplap és 12x00-ás processzor párosa versenyez egy B550-es (30e Ft) alaplaphoz és 5x00-ás processzorhoz csapott RX6300-al. Sőt B450-es (20e FT) alaplapban is simán elmegy a Zen3-as processzor. -

Yutani

nagyúr

válasz

Alogonomus

#57578

üzenetére

Alogonomus

#57578

üzenetére

Az AMD teljes értékű processzora + ez a nyamvadék nem drágább együtt, mint egy Intel counterpart?

-

Alogonomus

őstag

Alapvetően szerintem is nevetséges egy ilyen gyenge kártyát kiadni, de egy magyarázata lehet, és az pont az APU-k. Az AMD az extra IGP-t az L3 cache kárára tudja betenni a processzorba, így maga a processzor érezhetően veszít a teljesítményéből. A Zen4 lesz az első, aminél ez nem lesz gond, mert nem a CCX-en belül lesz az IGP.

Szóval jelenleg egy VGA nélküli, de mégis erős gépet csak Intel processzorral lehet építeni. Ezzel a kártyával viszont, ha eléggé olcsón gyártható, akkor AM4 alapon is lehet majd erős gépet összerakni, plusz az Intel processzorokban található IGP-hez képest még ez a kártya is biztosan sokkal erősebb lesz olyan irodai környezetben előforduló feladatokhoz, mint például a felskálázás, többmonitoros kialakítás, Youtube/Twitch/Teams/Zoom/Skype és egyéb adatfolyamok dekódolása.

Szóval talán pont ezzel a kártyával tudja eladni az AMD a teljes értékű processzorait. -

Petykemano

veterán

-

GeryFlash

veterán

válasz

Petykemano

#57568

üzenetére

Petykemano

#57568

üzenetére

Hmm, tehat akkor marad 16 max cores de most mar ezekben is lesz IGP illetve az egyszalas teljesitmeny +15% illetve vegre 5Ghz feletti boost. Azert ez egyelore nem tunik ugrasnak amit e 7nm-->5nm gondoltam volna.

-

Raggie

őstag

válasz

Petykemano

#57568

üzenetére

Petykemano

#57568

üzenetére

Király, köszi!

Az nem teljesen világos, hogy mi is lesz az egzakt különbség az X670 és az X670E chipset között.

Előbbi tárhelyre és VGA-ra tudja majd a PCIE5-öt, míg utóbbi mindenre. Namost mi mindenre kellhet ez még az előbb említett kettőn kívül?

SZERK: vagy ezt úgy kell érteni, hogy M2 SSD-knek lesz egy-két PCIE5-ös hely meg egy PCIE5x16-os bővítő és a többi PCIE az egyik sem lesz 5.0-s? -

-

Petykemano

veterán

-

-FreaK-

veterán

Radeon Preview Driver, 50 Game Benchmark

Wundertreiber™ !

-

olymind1

senior tag

válasz

GeryFlash

#57554

üzenetére

GeryFlash

#57554

üzenetére

Aztán az nV elkezdi árulni RT only társkártyákat, mint a 3dfx, akiket felvásároltak

Windows-nak, böngészésnek, videó lejátszásra meg elég lenne bármelyik prociba integrált iGPU, persze jó kérdés hogy sok 2D-s játék ami D3D-t használ szükség van-e hozzájuk igazából RT-re, vagy mennyire csuklanának össze ezek az új kártyák egy felső nézetes RPG vagy RTS esetén, ahol sok egység lenne és sok (varázs) effekt cikázna össze vissza.

-

válasz

Petykemano

#57538

üzenetére

Petykemano

#57538

üzenetére

Kopite:

"Perf vs 6900XT: over 2x 4k gaming, over 3.5x RT"

nem értem a srácot, egyszer kiábrándító szerinte utána meg ilyeneket ír.

-

Devid_81

félisten

-

Abu85

HÁZIGAZDA

Korábban írtam erről itt: [link]

Tényleg függ attól az egész, hogy miképpen építik be. Az, hogy dupla SIMD még nem sok adat. A VLIW2 már valami. A klasszikus értelmezés tekintve itt két egymástól nem függő SIMD operáció kerülne egy VLIW-be. Tehát klasszikus co-issue rendszerről lenne szó, de nem kizárt, hogy a "cross linked" az cross-lane akar lenni, és akkor ez már trükkös, mert elvileg működhetne kétciklusos kihasználtságlimittel is.

-

Abu erről tudsz valami?Miért merült ez most fel több dián a közelgő RDNA 3 nál több év távlatából?

Módosítják az RT specifikus részegységeket? Vagy tensor alapú műveletekhez?

RDNA 3 @ VLIW2.SuperSIMD cross linked to what i said mny times focus on slide 1 and 2

SideALU -> to aid,vectorized

2 Inst,VLIW2 (because it is from point 1) means from whole host perspective simultan 2 Command because Norm GPU is only one 4 ops per vect -

Petykemano

veterán

válasz

Alogonomus

#57543

üzenetére

Alogonomus

#57543

üzenetére

Most prezentáltuk neked kétféle megközelítésben is, hogy ez a kijelentés miért tekinthető döntően igaznak.

-

-FreaK-

veterán

válasz

Petykemano

#57538

üzenetére

Petykemano

#57538

üzenetére

Ez a 2.7x-es RT teljesítmény hova helyezné a kártyákat a jelenlegi NV típusokkal szemben?

Jól rémlik, hogy csak nagyjából arra lenne elég, hogy utol érje a mostani generációt (hozzá téve, hogy ezt vélhetően csak a csúcsmodell fogja tudni)? -

Alogonomus

őstag

válasz

Petykemano

#57542

üzenetére

Petykemano

#57542

üzenetére

Esetleg az "Egyetértek, az RDNA2 nem hozott a perf/$ mutatóban előrelépést."?

-

Petykemano

veterán

válasz

Alogonomus

#57541

üzenetére

Alogonomus

#57541

üzenetére

> de azért olyat ne olvassunk a fejére, ami nem igaz.

Mi is volt az pontosan, ami a fejére lett olvasva és nem igaz? -

Alogonomus

őstag

válasz

Petykemano

#57540

üzenetére

Petykemano

#57540

üzenetére

Nem védem az AMD-t, csak az igaztalan állításokat nem szeretem. Persze néha én is beleszaladok olyan helyzetbe, amikor igaztalanul vádolok egy céget.

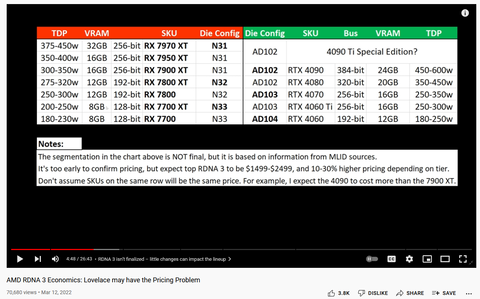

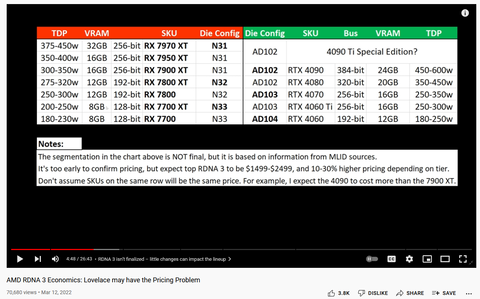

Az AMD ugyanúgy egy saját hasznát kereső nyereségérdekelt vállalat, mint akármelyik versenytársa. Ez tökéletesen megmutatkozik a Threadripper, vagy Epyc árazásán is, és amennyiben az RDNA3 olyan jó lesz, amilyennek a pletykák ígérik, akkor valószínűleg ugyanúgy pofátlanul magasra fogják árazni a Navi31 kártyákat, mert a mindshare állapotától függetlenül vonzóbb lesz egy 300-350 wattos kártya, mint egy 450-600 wattos kártya.

Szóval az AMD egy gátlástalan entitás, de azért olyat ne olvassunk a fejére, ami nem igaz.

-

Petykemano

veterán

válasz

Alogonomus

#57535

üzenetére

Alogonomus

#57535

üzenetére

Én nem értem, hogy mi szükség van ilyen vehemensen védeni a sokmilliárd dolláros cégek érdekeit. Kivéve persze, ha téged ezért megfizetnek. (Abban sincs semmi rossz, az nvidiának és a politikai pártoknak is biztosan vannak fizetett ügynökei a Redditen, meg hasonló oldalakon)

már csak azért sem értem, mert én a megjegyzésemben egy árva szóval nem hibáztattam amiatt az AMD-t, mert az RDNA2 nem hozott előrelépést perf/$ mutatóban. Az okokokat elsősorban a világgazdaságra és a bányászatra vezettem vissza. DE most hogy mondod, azért persze érdemes megjegyezni, hogy az áremelkedés hasznából azért egy kisebb részt - igen - az AMD is lecsippentett magának.

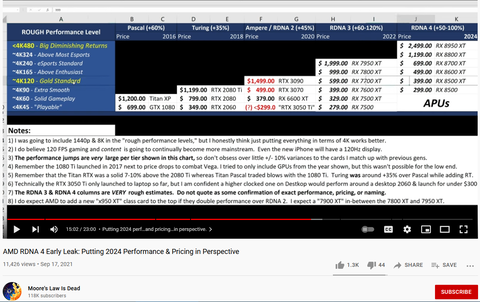

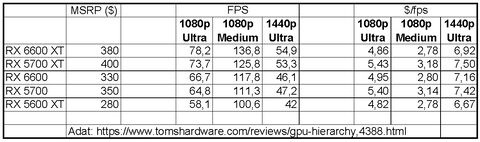

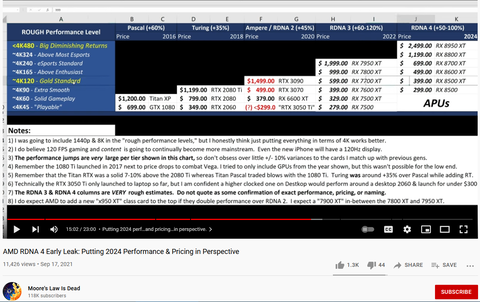

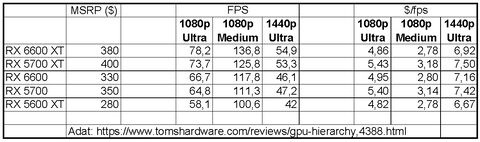

A táblázathoz:

Egyrészt ha úgy nézzük, hogy név szerinti generációróról generációra mi történt, akkor b-nek igaza van: azt láthatta a kedves vásárló, hogy az "ő szegmensében", "amiben vásárolni szokott" amennyivel nőtt a teljesítmény, annyival emelkedett is az ára.Amire Te gondolhatsz az nyilván az, hogy pl az 5700XT szintű teljesítményért 2019-ben $5.43/fps-t kellett fizetni, míg ugyanezért a teljesítményért 2021-ben (papíron) 6600XT néven futó termék formájában már csak 4.86. Ez az 5%-kal nagyobb teljesítmény 5%-kal alacsonyabb áron valóban tekinthető 11%-os perf/$ mutató javulásnak.

Ez azért lényegesen elmarad attól, ami korábban egy-egy generációváltás között kimutatható volt. Ez a változás betudható csupán annak is, hogy alacsonyabb tiereknél kisebb a prémium árazás mértéke.Azonban van egy másik probléma a táblázattal, ami ezt az elméleti számítást lesöpri az asztalról. Persze mondhatod, hogy arról az AMD nem tehet. De az engem nem érdekel, mert én nem azt mondom, hogy az AMD miért felelős, csak azt, hogy a fogyasztó mit érzékelt.

A probléma mégpedig az a táblázattal, hogy a míg az RDNA1 esetén az életciklus elején lehetett a táblázatban is szereplő msrp áron kapni és az életciklusa végén már akár $50-80-is akciókat is nyomtak rá, addig az RDNA2 kártyák életciklusukat a táblázatban szereplő msrp ár 150-200%-os szinjént kezdték a boltban és mostanában, az életciklusuk végén kezdik elérni a táblázatban szerelő msrp árat. (Hidegen hagy, hogy az RDNA2 megjelenését követően is lehetett RDNA1-et kapni még és annak az ára is felment.)

Tehát összességében a fogyasztó nemhogy az általad papíron kimutatott 11%-os perf/$ javulást nem érzékelte, hanem a két generáció közül az aktív életciklus során az RDNA2 lényegesen magasabb árakon volt kapható.

Ez ellen persze az AMD valóban keveset tehetett volna. Abu is mondta, hogy hiába árazták volna $200 vagy $250-ra, akkor is annyiba került volna, amennyibe. Az meg majd most fog kiderülni (talán) a következő hónapok során, hogy Abunak igaza volt-e abban, amikor azt mondta, hogy egy navi 23-at az AMD el tudna adni akár $199-ért is még valamekkora nyereséggel.

-

válasz

Alogonomus

#57537

üzenetére

Alogonomus

#57537

üzenetére

Lehet, hogy én értek félre valamit vagy nem tudom. Ott a táblázatodban hogy 1 FPS az 5600XT nél 4,83$- ba került MSRP re nézve, majd felette ott van hogy a 6600Xt nél 4,86$ .

tehát amennyivel gyorsabb a 6600XT az 5600XT nél annyival drágább , ugyan annyi a perf/ $ értéke. -

Petykemano

veterán

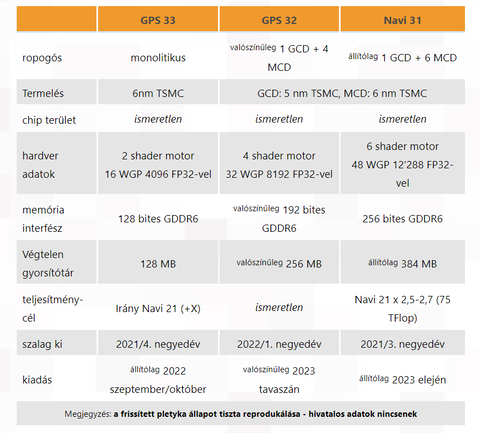

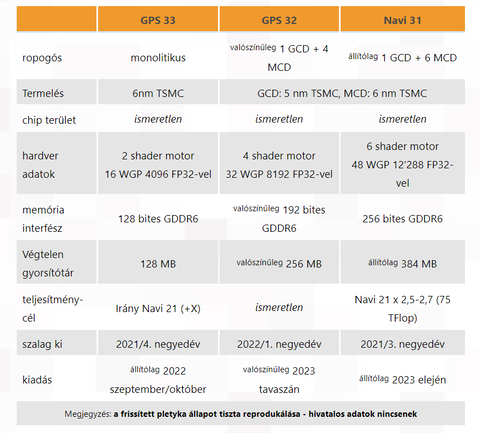

RDNA3 design based on the latest rumors/leaks.

- 1 GCD 5nm, 2x FP32 cores, 1xFP16 cores, 3ghz, 40% die size reduction.

- 386MB L3 64MBx6 MCD @ 4TB/s via TSMC CoWoS IO fabric.

- 24GB GDDR6 @ 768GB/s

- Perf vs 6900XT: 2.25x compute, 2.7x RT, 2.25x 4k gaming.Ez a CoWoS IO Fabric vajon most egy interposer?

(!! Ez a graviton3 !!)

(!! Ez a graviton3 !!) -

Alogonomus

őstag

"A táblázatod pont az igazolja amit Petyke mondott."

Miben igazolja szerinted a táblázatom, hogy nem történt perf/$ előrelépés? Az RDNA1 kártyák stabilan drágábban számoltak ki egy egységnyi fps eredményt a monitorra. RDNA1 drágább is volt, meg gyengébb is volt. Egyedül az RX 6600 veszített az RX 5700 ellen 1440p esetén. -

válasz

Alogonomus

#57535

üzenetére

Alogonomus

#57535

üzenetére

A táblázatod pont az igazolja amit Petyke mondott.

-

Alogonomus

őstag

válasz

Petykemano

#57532

üzenetére

Petykemano

#57532

üzenetére

"Egyetértek, az RDNA2 nem hozott a perf/$ mutatóban előrelépést."

Azért ez így nem igaz. A kártyák hivatalos árai alapján bőven megvolt a perf/$ előrelépés.

Az már a bányászok és a kereskedők sara, hogy sokáig teljesen elszállt árakon lehetett csak kártyát venni. Az RDNA2 egyértelműen előrelépést jelentett a perf/$ mutatóban, és azt csak fokozta, hogy az RDNA1 kártyák ára emelkedett jobban a bányászás hatására, ami elhozta azt az állapotot is, amikor éppen bontatlan 6700 XT kártyát adtak a használt 5700 XT kártyáért. Na abban az esetben tényleg masszív előrelépés történt a perf/$ mutatót illetően.

-

Devid_81

félisten

válasz

Petykemano

#57528

üzenetére

Petykemano

#57528

üzenetére

Nekem szemely szerint mar a mostani allapot is mar tetszik.

Avagy akinek van x*2 VGA-ja, es banyaszik az meg eppen megeri neki.

Viszont mar az arfolyam legalabb annyira "alacsony" , hogy ne vegyek raklap szamra a VGA-kat az uj "befektetok".

Avagy vegre jut a gamernek is valami generacio vegere (!?)Egyebkent ha tippelhetek kovetkezo kor igy fog kinezni, hogy:

NV jnagyon jo lenne banyaszasra (is), de sajnos LHR lesz alapbol mert "we love gamers" - par het es torik es onnan "f*ck gamers" lesz

AMD szinten jo lesz banyaszni (is) es ha esetleg ugy alakul, akkor miert is ne vihetnek toluk is raklap szamra a cuccot? Mert Ok meg sem probaljak a banyat lassitani a cuccon

"We love money more..." jeligevel![;]](//cdn.rios.hu/dl/s/v1.gif)

Azon csodalkozom hogy nem leptek el a piacot a GloFo 14nm-es Vegak valami "sunyi modon"

Gondolom szerzodes/gyartas mire beindult volna sok ido elment volna, es inkabb most kihagytak, volt eleg bevetel a konzolokbol stb.

Pedig a GloFo-t hasznalhattak volna erre, sztem meg a gamerek is orultek volna, hogy ha van elerheto mennyisuegu RDNA 2 de kozben meg a Vegakat viszik kamion szamra banyaba. -

olymind1

senior tag

válasz

Petykemano

#57532

üzenetére

Petykemano

#57532

üzenetére

Azért arra kiváncsi lennék, hogy mennyi lehet a valós legyártási és szállítási költsége egy 6600/XT 8GB-nak, meg egy 6700XT 12GB-nak, amit boltban 350€, 430€ és 570€-ért árulnak. És azért voltak 6600XT-k 650€-ért is, de még a 430-ra is ferde szemmel nézek így az RX5700XT után lassan 3 évvel

Az olcsóbb termékpalettáról nem is beszélve. Szóval én is örülnék ha valami jóságot és előrelépést hozna az AMD elfogadható áron, nem csak a 400$€-s kategóriákban és felül.

Az olcsóbb termékpalettáról nem is beszélve. Szóval én is örülnék ha valami jóságot és előrelépést hozna az AMD elfogadható áron, nem csak a 400$€-s kategóriákban és felül. -

Petykemano

veterán

válasz

olymind1

#57530

üzenetére

olymind1

#57530

üzenetére

Egyetértek, az RDNA2 nem hozott a perf/$ mutatóban előrelépést.

A drágulásnak egyrészről visszavezethető az elmúlt években felborult ellátási láncok, kialakult nyersanyaghiány, dráguló szállítás tényezőkre. A TSMC is árat emel, a szállítás is drágul, a réz is drágább, mint 3 éve.

De az elmúlt években tapasztalt emelkedett árat ezek a tényezők nem magyarázzák teljes mértékben.A nagy kérdés az az, hogy elindul-e valamilyen visszarendeződés.Ez nyilván nem lehet teljes. A GPU-k iránti megnövekedett kereslet ugyanis nem magyaráz mindent a chiphiányból, a nyersanyag árak és szállítási díjak emelkedéséből. Ha holnap beomlana a bánya, ezek a tényezők akkor se változnának érdemben. Ezzel együtt a piaci verseny nagy úr, a portékát el kell adni. Viszont kérdés, hogy ha az eddig tapasztalt emelkedett áron nem viszik a GPU-kat, és amennyiben a kriptovaluta bányászat céljából történő felvásárlás a következő generácitót esetleg nem érintené, akkor megpróbálják-e valahogy leszorítani, vagy csökkentik a volument.

Amennyiben a bányászat nem viszi el a nextgen készleteket, akkor én arra számítanék, hogy nagyobb mértékű teljesítménynövekedés mellé enyhén csalódást keltő kisebb mértékű msrp áremelést rendelnek hozzá. -

olymind1

senior tag

válasz

Petykemano

#57520

üzenetére

Petykemano

#57520

üzenetére

Inkább az a bajom, hogy kitalálnak egy elnevezést, jelen esetben a 600-as végű, pl RX 5600 XT amit árulták 280$-ért, aztán jön a következő generáció, aminek gyorsabbnak kellene lennie mint a jelenleginek (amit teljesít is a 6600(XT) széria), csak aztán jön a hidegzuhany, hogy ja bocs, rácsapunk még egy 100-ast, így lett egy 6600 XT 380$-ért, ami szinte előző generáció 700-as végű eggyel feljebb kategóriába tartozó 5700XT ára, amivel megeggyezik a teljesítménye is, szóval hol a fejlődés?

Persze az ő termékeik meg termékpalettájuk meg úgy árazzák ahogy akarják, csak utána meg ne csodálkozzanak, hogy az emberek fura szemmel néznek rájuk.

Persze az ő termékeik meg termékpalettájuk meg úgy árazzák ahogy akarják, csak utána meg ne csodálkozzanak, hogy az emberek fura szemmel néznek rájuk.

Ez az álszent hozzáállás nem tetszik. Ugyanezt eljátszották a Zen2->3 váltásnál is, Intel válaszolt és érdekes módon egyből kapható 200€-ért 6 magos Zen3 és megérkezett a P/P növekedés előző genhez képest.

-

Abu85

HÁZIGAZDA

Azt használja ki az AMD, hogy leginkább az NV-t vitték a bányába, és nekik innen nehezebb visszaállni a piacra. Tehát az AMD sokkal gyorsabban normalizálni tudja az árakat, mert nem volt annyira kitéve a bánya hatásainak, mint az NVIDIA. Ezért is hülyeség ezt így mérni, mert az NV VGA-k ára még zuhanni fog, csak a bolti GeForce készletek komoly áron lettek megrendelve, és nem lehet egyik napról a másikra megfelezni az eladási árat, mert az kurva nagy zakó a boltnak.

-

Petykemano

veterán

válasz

Devid_81

#57526

üzenetére

Devid_81

#57526

üzenetére

Bánya....

Az elmúlt hetek eseményeivel kapcsolatban én igyekeztem visszafogottan fogalmazni. Egyrészt, mert ugye mindig visszapattanhat. Másrészt meg bár tényleg esett az árfolyam, de a bánya nem omlott be (te sem ezt mondtad, csak mondom) Meglevő kártyákkal a jelenlegi energia árakon is még szolídan megérheti bányászni - még mindig valami $0,02-0,03 / nap / MH - ha csak az energiaárakat nézzük.

Ennek megfelelően nem is csökkent az ETH network hashrate.Szerintem még legalább meg kéne feleződnie az ETH ártfolyamnak ahhoz, hogy elkezdjenek kiszállni az ipari bányászok. Már csak azért is, mert én abban reménykedem, hogy ez a tevékenység világszinten elég jelentős többlet-energia-felhasználással jár és a beomlás meglátszana az energia világpiaci árán is. (Most valaki bizonyára fog jönni is kiigazít, hogy a bányászat csupán 3-4%-a világ energiafelhasználásának és ha holnaptól nem lehetne bányászni, az se látszana meg.)

Viszont ez elég ahhoz, hogy új kártyát - pláne régi szériát - már ne akarjon senki se venni ipari bányászati célra. Most egy ilyen status quo van.

Arra leszek kiváncsi, hogy az új genre majd úgy ugranak-e rá a bányászok, mint éhes malac és hogy kiegészítik-e a kurrens kapacitásokat, vagy lecserélik?

-

Devid_81

félisten

válasz

Petykemano

#57525

üzenetére

Petykemano

#57525

üzenetére

Banya bezuhant, az egyik oldalon hirtelen feltortek a LHR kartyakat 100%-osra, a masik oldal meg probalja velunk elhitetni, hogy Ok jobbak, vegyunk toluk hw-t

Igazabol az van, hogy a banya picit beomlott, nem viszik a kartyakat, a Q2 jelentesekhez meg valamit csinalni kell

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

Petykemano

veterán

Navi31 = Plum Bonito

Gemini board -

válasz

Petykemano

#57521

üzenetére

Petykemano

#57521

üzenetére

Nincs kizárva, hogy ez lesz a forgatókönyv, meg az,sem hogy amúgy simán azt hozza a Navi teljesítényben amit elvárunk. Mint írtam, nem annyira megbízható Kopite sem, plusz az is lehet hogy AMD direkt oltja őket és vezeti félre Nvidiát.

Amúgy ez , amit felvázoltál és ha ez lenne a forgatókönyv kissé összevág azzal amit jensen mondott az MCM ről, hogy először alkoss egy nagy GPU-t aminek kellően nagy teljesítménye van majd kösd össze őket. Tehát lehet , hogy van abban igazság ahogy ő gondolkodik és teljesen előkészíti a monolitikus kialakítással és működéssel az MCM terepét, amit aztán majd " csak " összekapcsol kisebb gyártáson mondjuk 3 nm-n megfelelő tesztelés után.Ami aggasztó az az hogy az új pletykák szerint 2023 ra átcsúsztatták.

Bocs a magyarításért, az eredeti Német : [link]

-

Petykemano

veterán

Nem arról akartalak meggyőzni, hogy az MCM jó-e. Hanem csak arról, hogy nem biztos, hogy az első iteráció jobb, mint amit monolitikusan össze lehet hozni.

Persze csak homályban tapogatózunk, de nekem most egy ilyen kép rajzolódik ki:

Az AMD eredetileg két közepes méretű N5-ön gyártott lapkát akart összefűzni Navi31 néven, ennek egylapkás változata lett volna az N32 és ugyanez az egylapkás (GCD) konstrukció, de N6-on gyártott változat az N33. A megközelítés lelke, hogy az infinity cache és GDDR vezérlők, valamint esetleg a PCIE és más IO cuccok külön gyártott N6 blokkok.

Viszont nem jött össze a két GCD összekapcsolása (lásd Apple)

Ezért létrehoztak egy nagyobb lapkát N5-ön, aminek a teljesímény értelemszerűen elmarad az eredetileg tervezett 2x közepestől, de legalább működik.

Tehát első körben lesz egy kissé csalódást keltő Navi31, meg egy relatív olcsón gyártható jó középkategóriás Navi33. Aztán valamikor később megérkezik a Navi 32, ami a közepes méretű N5-ön gyártott lapkával szerelve érkezik.

Én úgy képzelem, hogy ebből a lapkából kell egy új stepping a hiba javításához. Addig Navi32 néven gyártják a hibásat. Aztán egyszercsak megérkezik a javított lapka és talán az majd kap egy új nevet, mindenesetre később fog befutni a 2 közepes lapkából álló változat.Nem tom már melyik twitterező volt, de nagyon megragadt bennem, amikor bevágta a Graviton3 képét azzal, hogy "Hát így néz ki". Ezután jött a spec csökkentés, ezért erős a meggyőződésem azzal kapcsolatban, hogy 1 GCD-s lesz ebben a körben.

-

Petykemano

veterán

válasz

olymind1

#57518

üzenetére

olymind1

#57518

üzenetére

"5500 128bit,

6600 128bit,

7700 128bit."

Szerintem ezt így nem szabad nézni. Vagy ha mindneképpen a memória alrendszerből akarod deriválni a teljesítményt, akkor muszáj mellétenni a cache méreteket is, hiszen a memória és a cache együtt dolgoznak azon, hogy az adat a feldolgozás helyére kerüljön, rendelkezésre álljon. A memória és a cache is tranzisztort fogyaszt. akár memóriavezérlő, akár SRAM, akár DRAM formájában és az adatmozgatás vagy tárolás pedig mindenképpen energiával jár. Tehát ebből a szempontból elviekben felcserélhető, hogy a feladatot memória sávszélesség növelésével vagy gyorsítótárazással oldod-e meg. Ennek költsége van és a a cél az, hogy a leghatékonyabban tedd.Persze azt értem, és egyet is értek, hogy hogy valami fogódzkodót kell találni, ami alapján az ember megítélni próbálja, hogy palira veszik-e vagy sem.

-

Alogonomus

őstag

válasz

olymind1

#57518

üzenetére

olymind1

#57518

üzenetére

Már valóban régen, de jósolt egyet az árakat illetően, és akkor pont ezt a $600 célárat jelölte meg, bár a 7700XT azért állítólag inkább szinte 6900XT és 3090 szintű teljesítményt fog biztosítani. Persze valószínűleg nem 4K esetén, de amennyiben elég Infinity Cache kerül rá, akkor a 128 bites memóriabusz kisebb felbontásokon nem lesz annyira korlátozó tényező, a 8 GB pedig úgyis szűkös lenne 4K mellé. Főleg kevés lenne a 4K mellé az érkező új DXR és Lumen alapú címekhez.

-

olymind1

senior tag

válasz

Alogonomus

#57514

üzenetére

Alogonomus

#57514

üzenetére

Teljesítményben biztos jók lesznek azok a 7700-as kártyák, csak az nem tetszik, hogy csúsztatják generációról-generációra kategóriáról-kategóriára egyre feljebb a 128bites memória sávszélesség:

5500 128bit,

6600 128bit,

7700 128bit.

Persze az ára nem fogja azt tükrözni, csak a felső kategóriában már majdnem elfogynak a számok, mert annyira felviszik a teljesítményt, meg a hozzá tartozó árakat is.

Ha a 7700XT gyorsabb lesz a 6750XT-től, már ugye gyorsabbnak illene lennie, akkor lehet simán indul majd vagy 580-600$-ról.Mondjuk igaz, árakat nem közöltek, meg nem tudni hogy az YT videós táblázat a valóságot tükrözi-e.

-

válasz

Petykemano

#57516

üzenetére

Petykemano

#57516

üzenetére

Persze én tudom ,engem nem kell meggyőzni hogy ez jó . Meg te is tudod hogy ez egy lépcsőfok, fontos újítás.

De most úgy általában nézd a piacot, akik nem a Ph. hasábjain töltik az idejüket akiből kialakul a piac és a közvélemény.

Plusz nvidiánál nagyon más a helyzet mint CPU téren Intelnél volt .Itt majd össze vetik a két MCM dizájnt is a következő generációnál. -

Petykemano

veterán

"Aki nem technológiai b@zi az azt várja hogy az AMD az MCM dizájnnal olyat hozzon amit nem lehet monolitikussal mikor össze eresztik a két eltérő dizájnt.

Ha sem fogyasztásban, sem teljesítményben, sem árban lesz domináns eltérés akkor több féle értelmezést nyer majd az egész fejlesztés."

Itt azért halkan hozzáteszem, hogy az első MCM designra épülő Epyc sem váltotta valóra az általad említett az MCM designnal kapcsolatos túlzó elvárásokat. Legalábbis első körben nem. -

válasz

Alogonomus

#57514

üzenetére

Alogonomus

#57514

üzenetére

Nem vagyok ebben biztos.Épp ez írtam hogy kopite szerint a 450 wattos verzió is már ott lesz ahol lennie kell a konkurenciához nézve.

A fogyasztásban azonos teljesítmény szinteken szerintem olyan markáns különbségek nem lesznek.

Én azt gondolom, hogy azért írta amit írt mert többet vár(t?) az 5 nm+ 6 nm MCM dizájntól.

Ez nem azt jelenti, hogy nem lenne gyorsabb vagy ilyesmi, csak lehet túl nagyok az elvárások most már a sok hype miatt mindkét oldalon.

Aki nem technológiai b@zi az azt várja hogy az AMD az MCM dizájnnal olyat hozzon amit nem lehet monolitikussal mikor össze eresztik a két eltérő dizájnt.

Ha sem fogyasztásban, sem teljesítményben, sem árban lesz domináns eltérés akkor több féle értelmezést nyer majd az egész fejlesztés.

Nagyon Jó volt a példád arra amire gondolok, Vega vs Pascal.De én azt gondolom hogy terelés megy mindkét oldalról, jól fog sikerülni az AMD, szerintem meglepetés lesz,. lehet ez is egy oka annak hogy siet Nv az Ada kiadással.

-

Alogonomus

őstag

"Ami nekem amúgy furcsa hogy az RDNA2 megjelenése elött ennyivel már azt lehetett olvasni hogy mennyire nagy harc lesz a felső házban"

A szivárgó hírek érkeznek, csak most a hírek alapján a felsőházban várható nagy harc esélyét az alábbi összefoglalás igazából eleve ki is zárja.

Alsóházban még lesz érdemi verseny, de látszólag újra létrejön a régi GCN4/GCN5 vs. Pascal felállás.

Navi33 és AD104 egálban lesz, ahogy volt az RX 560 és a GTX 1050.

Navi32 és AD103 nagyjából a régi RX 580 és GTX 1060, vagy a jelenlegi RDNA2 <-> Ampere helyzetet ismétli, vagyis az egyik oldalon némi fogyasztástöbblettel kihozható egálba a két oldal.

Navi31 és AD102 pedig a régi Vega 56/64 és GTX 1070/80 helyzetet ismétli, vagyis az egyik oldal masszív fogyasztástöbblettel elérheti a másik oldal felsőházas termékeit.Végül pedig az új generáció reálisan megszerezhető GTX 1080 Ti és RTX 2080 Ti csúcskártyáját egy Navi31 alapú termék fogja várhatóan megtestesíteni.

-

válasz

Petykemano

#57512

üzenetére

Petykemano

#57512

üzenetére

"Abban már nem vagyok biztos, hogy mennyivel előtte, de az RDNA2 megjelenése előtt

Kb 4-5 hónap- fél év van vissza a megjelenésig AMD oldalon is vagy annyi sem.

Abu már ilyenkor leírta hogy annyira szoros lesz a verseny a felsőházban amin mindenki meg fog lepődni és amilyen nem volt évek óta.

Tehát már tudta konkrétan mit fog hozni AMD és milyen gyors lesz. Nincs kizárva hogy most is tudja vagy pedig még nincs infó nem tudom, de erre világosan emlékszem. MLID hír volt , ott is leírta a tag a kis fekete hátteres felsorolásával ezt és ahhoz szólt hozzá és írta ezt le."Persze ez lehet, hogy már nem a konkurencia megtévesztése a cél., "

Vagy pedig azért siet Nvidia is és azért kever AMD is, hogy ne essenek vissza az eladások ha tényleg beborul a crypto és bezuhan több tíz/ százezer kártya használt piacra. mert most visszapattant kicsit, de jön az ETH 2 nyáron...

"De gondolod, hogy az Nvidia csinálna egy 600W-os verziót is abból a kártyából mondjuk +5-8%-os teljesítménytöbbletért, ha már a 450W-tal is megvan a garantált győzelem?"

Nem vagyo ebben biztos, hogy csak erről van szó, ez nem egy 3090Ti lesz szerintem.

Kopite az után kezdte ezt el tolni, miután kiírta hogy eltűnt a H202 , azaz a Hopper (MCM?) és abból integrálnak át fejlesztéseket a csúcs GPU ba, ami valószínűleg más kódszámon is fog érkezni...Szerintem az valami más lesz, ismerve Nvidiát.( lehet csak egy Titan, ami mindegy is ) -

Petykemano

veterán

"Ami nekem amúgy furcsa hogy az RDNA2 megjelenése elött ennyivel már azt lehetett olvasni hogy mennyire nagy harc lesz a felső házban , most ez hiányzik egyelőre megjelenés közeledtével egyre jobban és fordul át a hírekben ez a dolog.. vagy nincs konkrét infó még és valóban akadhat pár nehézség és kétesélyes a dolog. "

Abban már nem vagyok biztos, hogy mennyivel előtte, de az RDNA2 megjelenése előtt a BigNavi-val kapcsolatos "józan", "konzervatív" (vagyis nem bilibelógó kézzel tett) becslések épphogy azt jósolták, hogy az AMD kihozhat egy 2080Ti-t kisebb lapkából, kisebb fogyasztással, vagyis egy 3070-nel versengő csúcskártyára lehet képes.Lehet, hogy megkezdődött a "Jebaiting" szezon.

Persze ez lehet, hogy már nem a konkurencia megtévesztése a cél., hanem a vásárló közönségben az "underpromise & overdeliver" érzet kialakítása. Bizonyára kevesebbek morgolódnak a megugró árakon, ha meglepetésszerűen mégiscsak jobb az eredmény, mint amit az utolsó hónapok leakjei alapján várni lehetett."Kopite szerint Nv nem vett vissza, tegnap ugye pont azt írta hogy az eddig pelykált 2,2-2,3x 3090 az nem a legnagyobb Ada hanem "csak" a 450W verzió"

OK. De gondolod, hogy az Nvidia csinálna egy 600W-os verziót is abból a kártyából mondjuk +5-8%-os teljesítménytöbbletért, ha már a 450W-tal is megvan a garantált győzelem?

-

válasz

Petykemano

#57507

üzenetére

Petykemano

#57507

üzenetére

Kopite szerint Nv nem vett vissza, tegnap ugye pont azt írta hogy az eddig pelykált 2,2-2,3x 3090 az nem a legnagyobb Ada hanem "csak" a 450W verzió

-

válasz

Alogonomus

#57509

üzenetére

Alogonomus

#57509

üzenetére

Természetesen nem Jensenre gondolt, mint ember ,hanem Jensen vezetésével a mérnöki gárda vagy Jensen utasítására.

Amúgy ő nem nyilatkozhat egyértelműen ugye ez eléggé köztudott, mint ahogy senki sem, Greymond sem.

Kopite nem elfogult, csupán Nvidia felé jók az értesülései és a kapcsolatai míg Greymondnak az AMD felé. Amúgy minden Amd-s hírnél és leaknél jelen van, kedveli vagy pozitívan szól hozzá, mint ahogy Greymond is fordítva de a találati aránya csupán 70 % körüli ,( egyszer tettem be egy táblázatot erről ide is) azaz amit leír ,annak kb harmada kapufa vagy megváltozik időben az Nvidiánál és csak egy terv marad.

Mint mindig ezekben a topikokban le szoktam írni érdemes nyugtával dícsérni a napot .Ez lehet az hogy AMD nek nem úgy sikerült a chiplet vagy pedig Nvidiának sikerül jól az Ada és jól döntöttek még , hogy kivártak.

De ki tudja.

A másik pedig az is lehet hogy megy a ködösítés pont ezek miatta leakerek miatt és igazából direkt vezetik félre a népet épp ezt pár napja megfogalmaztuk az Nvidiásban .Ami nekem amúgy furcsa hogy az RDNA2 megjelenése elött ennyivel már azt lehetett olvasni hogy mennyire nagy harc lesz a felső házban , most ez hiányzik egyelőre megjelenés közeledtével egyre jobban és fordul át a hírekben ez a dolog.. vagy nincs konkrét infó még és valóban akadhat pár nehézség és kétesélyes a dolog.

-

Alogonomus

őstag

válasz

Petykemano

#57507

üzenetére

Petykemano

#57507

üzenetére

Miután kijött ez a tweet tőle, eléggé fenntartásokkal kezelem már a kinyilatkozásait. A megfogalmazás, hogy "Jensen designed a complex interconnected system" nagyon nem stimmel a műszaki világba. Egy teleevangelista hitszónoktól rendben van az ilyen típusú megfogalmazás, de komoly ember nem fogalmaz úgy, hogy egy komplex megoldást egyetlen ember tervezett meg. Kopite elcsúszott a diplomatikus középállapotból.

-

GeryFlash

veterán

válasz

Petykemano

#57507

üzenetére

Petykemano

#57507

üzenetére

Rakerdeztem

Nem sok ertelme volt a tweetnek igy ebben a formaban.

Nem sok ertelme volt a tweetnek igy ebben a formaban. -

Petykemano

veterán

kopite:

"OK, let's do a new summary.

RTX 4090, AD102-300, 16128FP32, 21Gbps 24G GDDR6X, 450W, ~2x3090.

I am disappointed with RDNA3.

That's all."

Vajon mi történhetett?

Nem jött össze az AMD-nek a chipletezés, gyengébb lesz az RDNA3 az előre beharangozottnál?

Vagy azért csalódott, mert lehetne erősebb is, de nem lesz, mert a legutóbbi visszavett konfiguráció is elég az NVidia ellen?

Vagy Mindkét gyártó visszavett a specifikációkból, amikor kiderült, hogy esetleg csak gamerek fogják venni a portékát?Egyébként tényleg úgy tűnik, mintha az AMD-nem nem jött volna össze a 2 GCD-s megoldás, vagy nincs kész, nem lett jó az interfész, vagy nem jól skálázódott a 2 lapka, vagy ilyesmi, ezért inkább készítettek egy nagyobb lapkát. Ez nem fog változtatni azon, hogy chipletes lesz, mert a memóriavezérlő és/vagy Infinity cache attól még N6-on fog készülni, csak hát egy kisebb teljesítményt fog hozni.

-

FLATRONW

őstag

válasz

Hellwhatever

#57501

üzenetére

Hellwhatever

#57501

üzenetére

Pl. a Wolfenstein New Order OGL 3.2, az menni fog. A SOMA OGL 3.3, az még pont jó. Viszont a SOMA fejlesztőinek legújabb játéka a 2020-as Amnesia Rebirth már 4.0-ás. Eléggé kínos lenne, ha egy ilyen új játék nem indulna el.

Szerintem ez a megkötés egészen biztos hülyeség. -

Abu85

HÁZIGAZDA

válasz

huskydog17

#57504

üzenetére

huskydog17

#57504

üzenetére

Sose jelentette be a Microsoft előre, amikor kivonta a rendszerből az egyik DirectX API-t. Ettől még megtették. A Windows 10 és 11 OS-ben három DirectX API van, 9.L, 11 és 12. Ezeken fut minden, ami DirectX. A dolog úgy működik, hogy létrehoz egy erőforrást az alkalmazás, amelyet becsatol a Windows a kompatibilis layerbe. Emiatt van az, hogy az OpenGL on DirectX 12 esetében is simán OpenGL-nek írják a programok az API-t, de nem azon fut natívan, csak egy olyan erőforrást hoz létre, amit becsatol a Windows a kompatibilis layerbe.

Ugyanaz a problémája a Microsoftnak, mint az Apple-nek volt az OpenGL-lel. Meg amúgy az OpenCL-lel is. Annyira le se szarja a Khronos ezeket, hogy a gyártók nagyon szabadon értelmezik a lehetőségeket. És ez leginkább az AMD-re igaz, amely vállalat a szabványos implementációk mellé tökre nem szabványos alternatívákat is csinál. Lásd OpenCL 2 funkciók 1.2-ben, OpenGL binárist shadert engedő kiterjesztések, stb. Ez a Microsoft és kb. az összes OS fejlesztő oldalán elég nagy baj, mert ugyan az AMD arra hivatkozik, hogy fejlesztői igényeket fed le, de ezekkel közben saját magához láncol programokat. És kurvára sokszor csinálják ezt Embedded és HPC szinten. Ez pedig probléma a Microsoftnak, mert elvileg ugye az OS támogatja az OpenGL-t, egy másik gyártó is, aztán a bináris shaderrel szállított programok meg se nyikkan rajta, sőt sokszor az új AMD hardvereken sem. Ezzel a marhaságával tarolta le az AMD a casino gaming piacot, mert drágább átírni 400 ezer sort, mint kompatibilis hardvert venni legközelebb. De a megoldás az, ha az OpenGL specifikációját a Microsoft egységesíti. Nem lesznek többet ilyen bináris bezárások, specifikáció által tiltott ajtók kinyitva, lesz egy implementáció a DirectX 12-re, és ha arra dolgozik egy szoftverfejlesztő, akkor futni fog a program a DirectX 12-es implementációkon. -

huskydog17

addikt

Ahogy gondoltam, nem tudsz adni forrást, ennyit erről.

Érdekes a régi D3D játékoknál nálam mindig az eredeti D3D verziót írja (amelyik natívan fut) és egyiknél se ír DX11, érdekes is lenne, ha a MS csak úgy az összes több ezer régi játékot átírna DX11-re.

Nyilván sok régi D3D verzióhoz ma már wrapper kell, de nem is azokról van szó, hanem azon állításodról, hogy a natív OGL programok nem fognak elindulni. Erről kértem hivatalos forrást, nem adtál. Amint a MS doksi is írja, natív OGL támogatást nem fogják tiltani, továbbá a Collabora féle cucc nem is a játékokról szól, ezt is leírták.

Az OGL supportot a D3D-vel ellentétben a driver adja, tehát az MS nem is tudná blokkolni a natív futtatást, de miért is akarná. Szólnak az AMD, Intel, NVIDIA triónak, hogy "figyu má, ne rakjatok a driver package-be OGL modult, köszi!", vagy hogy?Szóval hol írja a MS azt, hogy el akarják lehetetleníteni az OGL programok natív futtatását Windows-on? Miért tenné és hogyan?

-

Abu85

HÁZIGAZDA

válasz

huskydog17

#57502

üzenetére

huskydog17

#57502

üzenetére

Elárulom, hogy a Microsoft mindig ezt csinálja. Amint vége egy API támogatásának, hoznak rá egy layert. Ezért fut minden DirectX 5-6-7-8-9 játék a DirectX 9.L-en. Ezért fut minden DirectX 10 játék DirectX 11-en. Egyszerűen a legacy API-kat hasznosabb kiszedni a rendszerből, mert arra nem lenne direkt támogatás, és így lesz ez az OpenGL esetében is, csak az a DirectX 12-re lesz implementálva, mert az az optimális választás hozzá.

A natív támogatást így a gyártók ki tudják vezetni, mert költséges az egészet karbantartani egy maréknyi programért.

Az OpenGL problémája egyébként nem a driver, hanem a program. A gyártók másképp értelmezik a specifikációt, ami addig jó, amíg a Khronos támogatja az API-t, és korrigálják az értelmezési problémákat, de mivel az OpenGL mögül kivették a supportot, így már senki sem egyértelműsíti a vitás kérdéseket. És ilyenkor mi van? Az AMD implementált egy funkciót x módon, az NVIDIA y módon, az Intel pedig z módon. Ki mondja meg, hogy melyik implementáció a szabványos? Senki. Végeredményben a fejlesztőnek mindhármat támogatnia kell, kivéve, ha maga az OpenGL API le lesz implementálva DirectX 12 API-ra, és akkor az AMD, NVIDIA és Intel hardverek is ugyanazt a kódot képesek futtatni, vagyis nem kell háromszor megírni ugyanazt, mert a Khronos már nem foglalkozik a kérdéssel. Na pontosan ezért csinálja ezt a Microsoft. -

huskydog17

addikt

"Az OpenGL-be már senki sem öl erőforrást"

Hm..ezt már hallottuk sok éve a D3D11-ről is aztán beütött a valóság. Amúgy úgy tűnik, hogy mégis megéri egy 8 fős csapatot foglalkoztatni érte, szóval de, még mindig ölnek bele erőforrást (a 8 fős csapat nem ingyen dolgozik).

"mivel a Microsoft azon dolgozik, hogy kizárja az API-nak a támogatását a Windows operációs rendszeren"

Ezt a MS pontosan mikor és hol nyilatkozta? Forrást please!

Én csak annyit találtam, hogy a MS és a Collabora egy új futtatási lehetőséget kínálnak majd OGL-hez D3D12 alatt azok PC-kre, ahol nincs OGL driver telepítve, a hivatalos compatiblity pack is pontosan ezt mondja:

"This compatibility pack allows more of your favorite OpenCL™ and OpenGL® apps to run on a Windows 10 PC that doesn't have OpenCL and OpenGL hardware drivers installed by default."

A Collabora egyik programozója is ezt erősíti meg, ezt mondta:

"Vendors can still build native GL/CL drivers if they want - as you noted, many of them do."Szóval én sehol nem látok infót,m utalást arra, hogy az OGL ki lenne majd zárva, a Collabora féle D3D12 mapping layer ahogy a fejlesztők is és a MS is írják azoknak készül, akiknek nincs natív driver supportjuk, márpedig az AMD, Intel és NV rendelkezik natív OGL supporttal.

Szóval légyszi linkeld be azt a kijelentést a MS-tól, hogy Windows-on lehetetlen lesz natív OGL app futtatása, mert én csak ezzel ellentétes infókat találtam!

"Ezzel egyébként rákényszerítik a szoftverfejlesztőket is arra, hogy javítsák ki a nem szabványos OpenGL kódjaikat, mert a gyártók innentől kezdve nem tudják megtenni drivermachinálással. Amelyik cég nem csinálja meg, annak az alkalmazása futtathatatlan lesz."

Az applikáció fejlesztőjének ehhez semmi köze, mindössze a drivereket kell jól összerakni, nem is várható el, hogy a régi játékokat patcheljék. Ha erre gondolsz, akkor ellentétesen sikerült értelmezni a bejegyzést.

"This means our sources of issues are:

OpenGL driver

D3D12 run-time

D3D12 vendor-driver

Hardware "Tehát ahogy írják is, az applikáció fejlesztője nincs benne a képletben, ez nem is várható el, nincs is értelme, mert natívan továbbra is futni fognak.

"Annyit tudni még, hogy a Microsoft OpenGL 3.3-ig implementálja le az API-t."

Igen, most már biztosan erre gondolsz. Egész pontosan eddig kizárólag az NVIDIA driverek mentek át az OGL 3.3 teszteken.

"Right now, the only configurations we're cleanly passing the OpenGL 3.3 CTS on are WARP (which became conformant on November 24th, 2020), and NVIDIA (which became conformant on February 26th, 2021)."Tehát ki és hol írja azt hogy az OGL programok nem fognak futni natívan Windows-on? Hol ír ilyet a MS?

"This work is all part of Microsoft's effort for getting OpenGL (and OpenCL) working atop Direct3D 12 for use on Windows when lacking native OpenGL/OpenCL driver support as well as with use under WSL." ( [link] )

#57501 Isobutane : Nem kell minden hülyeséget elhinni. Ajánlom figyelmedbe a fentebb taglaltakat.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- ASRock RX 9060 XT 16GB GDDR6 Challenger OC - Új, Bontatlan, 3 év garancia - Eladó!

- ASUS GeForce GTX 660 DirectCU II OC 2GB GDDR5 192bit Videokártya

- ASUS ROG STRIX RADEON RX 6650 XT V2 OC EDITION 8GB GDDR6

- SAPPHIRE RX 9060 XT 16GB GDDR6 NITRO+ - Új, Bontatlan, 3 év garancia - Eladó!

- Gigabyte AORUS GeForce RTX 5080 MASTER ICE 16GB GDDR7

- ÁRGARANCIA!Épített KomPhone Ryzen 7 7800X3D 32/64GB RAM RX 9070 XT 16GB GAMER PC termékbeszámítással

- Azonnali készpénzes Intel i3 i5 i7 i9 12/13/14 gen processzor felvásárlás személyesen / csomagküldés

- HIBÁTLAN iPhone 13 mini 128GB Pink -1 ÉV GARANCIA - Kártyafüggetlen, MS3050, 96% Akkumulátor

- LG 55G2 - 55" OLED evo - 4K 120Hz 1ms - 1100 Nits - NVIDIA G-Sync - FreeSync Premium - HDMI 2.1

- Bomba ár! Acer Travelmate P215 - i5-8GEN I 8GB I 256SSD I 15,6" FHD I Cam I W11 I Garancia!

Állásajánlatok

Cég: NetGo.hu Kft.

Város: Gödöllő

Cég: Promenade Publishing House Kft.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

Az olcsóbb termékpalettáról nem is beszélve. Szóval én is örülnék ha valami jóságot és előrelépést hozna az AMD elfogadható áron, nem csak a 400$€-s kategóriákban és felül.

Az olcsóbb termékpalettáról nem is beszélve. Szóval én is örülnék ha valami jóságot és előrelépést hozna az AMD elfogadható áron, nem csak a 400$€-s kategóriákban és felül. Persze az ő termékeik meg termékpalettájuk meg úgy árazzák ahogy akarják, csak utána meg ne csodálkozzanak, hogy az emberek fura szemmel néznek rájuk.

Persze az ő termékeik meg termékpalettájuk meg úgy árazzák ahogy akarják, csak utána meg ne csodálkozzanak, hogy az emberek fura szemmel néznek rájuk.