-

Fototrend

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

". És az NV erre azzal fog reagálni, hogy véletlenül feltételes elágazások lesznek a támogatott játékok szabványos kódjában."

Mert nekik véletlenek kellenek, mert amúgy nincs pénzük arra, amire AMD nek van?

Ez a véletlen feltételes elágazások Nvidiánál, míg AMD szegény a szabványos Xbox SDK miatt nem tud belerakatni a saját támogatott játékába DLSS-t még viccnek is rossz, még tőled is. Pártatlanság rulez.

Miközben most te magad írtad le hogy mit tervez lépni AMD, miközben itt úgy néz ki egyszerűen driverrel megoldják a gondokat.

Majd mi lesz a sztori, ha 1 hónapon belül mégis csak megoldják az RT problémát ,mert Redditen is azt írják, hogy jelenleg 7000 Radeokon tudnának elfogadható sebességet elérni ,de ott is összeomlások vannak, a kibővített RT szolgáltatások alatt.Amúgy AMD új driverében is benne van ezek szerint AMD is kamuzik? [link]

"

"Application crash or driver timeout may be observed while playing Ratchet & Clank™: Rift Apart with Ray-Tracing and Dynamic Resolution Scaling enabled on some AMD Graphics Products, such as the Radeon™ RX 7900 XTX.""AMD is working with the game developers of Ratchet & Clank™: Rift Apart to resolve some stability issues when Ray-Tracing is enabled"

-

S_x96x_S

addikt

válasz

Busterftw

#62097

üzenetére

Busterftw

#62097

üzenetére

> Pontosan, az AMD beleöl hatalmas lóvét, erőforrást a kódolásba,

> aztán majd kiderül Nvidia-n gyorsabb lesz a Starfield is.részben hardwares

részben szoftveres okai vannak a teljesítmény különbségnek ..viszont, hogy ott van az "AMD",

akkor a saját bőrén tapasztalhatja az általa tervezett architektúrát ..

vagyis ez amolyan "skin in the game" és az AMD NEM mutogathat a játékfejlesztőkre,remélem annyi mellékhatása lesz,

hogy nem csak felszínesen ( ~ "tünetileg") próbálják kezelni a problémákat,

hanem teljesen kielemzik .. és sok mindent tartósan javítanak ..

vagyis más projektek is nyernek ezzel ..De még hogyha az nVidia RTX 4090 ezek után is gyorsabb lenne,

még mindig lehet érvelni, hogyha az AMD nem folyt volna bele,

akkor a különbség még nagyobb lenne ..a verseny jó ..

-

S_x96x_S

addikt

> Csak azt vegyük figyelembe, hogy ez minden esetben a stúdió/kiadó hibája.

> Az AMD és az NV csak kap az alkalmon, ha talál egy-egy kurvát.A kérdés, hogy szükséges-e a versenyhatóságnak beavatkoznia ebben az esetben ?

Mert ha a viselkedés extrém módon hozzájárul a fogyasztói választás korlátozáshoz és a versenyt is korlátozza, akkor talán igen.sajnos ez amolyan szürke zóna ..

és talán a technológiai protekcionizmus kifejezés írja le ..érdekes precedens talán a CPU fronton az Intel fordítói:

amelyek az AMD cpu-nál elfelejtették bekapcsolni az optimalizációkat ..

[ Intel's "cripple AMD" function ( Agner.org ) ] -

Raymond

titán

Csak itt nem azert van benne a letiltas mert valaki lepenzel valakit mint ahogy irod. Egyszeruen nem megy valamiert rendesen es inkabb letiltjak amig nincs megoldva ahelyett hogy hagynak kifagyni a jatekot. Ott az AMD-s release notes-ban is a dolog.

Az pedig nem szemelyeskedes ha leirom hogy szerintem alaptalan suletlenseg amit irtal, marpedig az.

-

Alogonomus

őstag

Biztosan sok kiskaput lehetne találni, ha keresnének.

Szabványos interfészen keresztüli I/O funkciókra például egy duplázott adatautentikációs ciklus előírása, ami máris jelentős extra késleltetést okozna. Persze nem ez a területem, szóval ez esetleg pont nem opció, de biztosan lenne lehetőség a szabvány keretein belül kellemetlenkedni, ha akarnának. -

Abu85

HÁZIGAZDA

válasz

FLATRONW

#62090

üzenetére

FLATRONW

#62090

üzenetére

Éppenséggel lenne választásuk. Attól, hogy reklámpénzt rak beléjük az AMD, még nem kellene a kódokat tőlük szerezni. Csak a Bethesda a könnyebb utat választja. Ha már van egy technikai partnerük, akkor kérik a kódjaikat, mert maguk meg nem akarnak 12000 sornyi memóriamenedzsmentet írni.

Ugyanúgy lenne választása a Nixxesnek is. Nem kell beleírni azt a három sornyi feltételes elágazást, és bekapcsolható a kód.

Választás tehát mindig van, csak ma már többet ér a pénz. Ne tegyünk úgy, hogy nem kurvultak el a stúdiók, holott elkurvultak. Az AMD és az NV csak kihasználja, hogy megvehetők kilóra. Aki pedig rosszul jár az a user, aki végeredményben fizet azért, hogy elméletben jól járjon.

-

Abu85

HÁZIGAZDA

válasz

Alogonomus

#62087

üzenetére

Alogonomus

#62087

üzenetére

Az nem olyan egyszerű, mert az NV VGA-i szabványos interfészen kapcsolódnak. Ezt nem tudják csak úgy "nemszabványosítani" az AGESA-ban.

A szabvány az azért szabvány, mert a gyártó akaratától függetlenül is működni fog.

#62088 FLATRONW : A Starfielddel is főleg NV kártyán fognak játszani, és mégis az AMD-től rendelik bele a teljesítménycentrikus kód nagy részét.

-

FLATRONW

őstag

Ezzel a játékkal PC-n, mint minden mással is, főleg NV kártyákon fognak játszani. Ott kb. minden rendben lesz. Max az AMD kártyák tulajdonosai mennek át konzolra.

Alogonomus: Saját magukkal basznának ki. Én pl. simán visszatérnék Intel platformra és soha többé szóba sem kerülne az AMD.

-

Alogonomus

őstag

Sőt ha a csata tovább durvul, akkor az AMD számára adott a lehetőség az AGESA irányából is "szívatni" az Nvidia kártyáit. Nagyon nem lenne jó, ha ebbe az irányba mozdulna a helyzet, de a hozzászólásod alapján az AMD most már nagyon hajlandónak mutatkozik "felvenni a kesztyűt".

-

Abu85

HÁZIGAZDA

válasz

FLATRONW

#62082

üzenetére

FLATRONW

#62082

üzenetére

A Sony számára pont az a jó, ha a PC-sek alárendeltek maradnak. Minél nagyobb a káosz PC-s szinten, annál nagyobb a PlayStation felé kacsingatók aránya.

#62083 Raymond : A Nixxes teszi bele a feltételes elágazást a kódba, hogy a szabványos kód ne fusson az egyik gyártón. Tehát ehhez 100%-ban a Nixxesnek van köze, hiszen ha ezt nem akarják, akkor csak ki kell venni a feltételes elágazást és kész.

Nem értem, hogy miért személyeskedsz? Állandóan ide viszed a vitát. Erre az alacsony színvonalra sosem fogsz engem levinni, bármennyire is próbálkozol. Egyszerűen nem akarok személyeskedést belevinni, még akkor sem, ha valaki ilyen stratégiával próbálja megnyerni a vitáit, mert másképp képtelen rá. Felőlem mindenki választhatja a könnyebb utat, de annak az egyetlen jutalma az, hogy könnyű.

#62084 FLATRONW : A DLSS az nem ettől függ. Ott az Xbox GDK a gond. Az egy nagyon más FSR verziót használ, mint ami letölthető a GPUOpenről. A Starfielddel nem is ez a gond, hanem az, hogy a D3D12MA és a The Forge. Ez a két komponens, ami leginkább meghatározza a leképező sebességét és a memóriahasználatot, és a szállított kód nagy részét az AMD programozói írták meg. A Bethesda egy megrendelő volt.

-

Abu85

HÁZIGAZDA

Akkora pénzből dolgoznak már, hogy bele tudnak szólni. A Starfieldbe óriási pénzt rakott az AMD. Sose rakott még senki ennyi pénzt egy játékba. És olyan se volt még, hogy a játéknak egy nagyon teljesítménycentrikus kódrészletét konkrétan az egyik gyártó írta volna meg. De úgy néz ki, hogy ez lesz mostantól. A nehéz munka egy részét a cégek kiszervezik, és a kiszervezés alatt elfogadják a gyártói munkát is. Akár úgy, hogy a kód 100%-a jön onnan, anélkül, hogy a többi gyártónak beleszólása lenne. Sőt, ha úgy nézed, akkor a Starfield még rosszabb, mert a The Forge nevű leképező keretrendszer, amit használ a Confetti Interactive tulajdona, és a Confetti Interactive exkluzív technikai partnere az AMD már lassan 10 éve. Tehát a leképezőt ugyan nem az AMD írta, de egy olyan partnerük, amelyik konkrétan az AMD programozóinak szervezi ki a munkát.

-

Raymond

titán

Persze, a Nixxes arrol hires hogy nem tud rendes PC konverziokat kesziteni

Ja varj, nem is, hanem epp az ellenkezoje.

Ja varj, nem is, hanem epp az ellenkezoje.Az hogy az AMD kartyakat kivettek az RT tamogatasbol annak semmi koze a Nixxes-hez vagy az NV-hez. Oka van hogy nincs ott egyelore es ennek az oka az AMD. Ezert is dolgoznak rajta az AMD-vel.

Ez az egesz elso bekezdes megint egy a te fejedben keletkezett suletlenseg:

"A Ratchet & Clank a legfőbb oka annak, amiért a Starfieldnél AMD-exkluzív PC partner lett a Bethesda. Nem lett volna az egészből ilyen jellegű döntés, ha a Nixxes berakja az AMD optimalizálását a játékba, de ha nem, akkor tud az AMD is úgy játszani, hogy kirakják a GeForce optimalizációt a Starfieldből. Aztán majd megunja az NV vagy az AMD, vagy a játékosok, és vesznek AMD-s konzolokat."

Mar eleve a timeline se all osszes ahhoz hogy ugy legyen ahogy irod es az meg csak az alap lenne.

-

-

Abu85

HÁZIGAZDA

Két hónapja van a driverben Ratchet & Clank profil. A legutóbbi csomagban is frissült. Mellesleg driveres gondra nem szoktak tiltani effekteket, mert majd a gyártó javítja, és működni fog a szállított kód automatikusan.

Nem is kell kizárólag velük dolgozniuk. Elég lenne kivenni a feltételes elágazást. Onnantól kezdve meg bekapcsolható az effekt.

Egyre több ilyen lesz amúgy. Szokjatok hozzá, mert az AMD kb. a tízszeresére emelte a düdzséjét, így sorra veszik majd a Starfieldhez hasonló exkluzivitásokat. És az NV erre azzal fog reagálni, hogy véletlenül feltételes elágazások lesznek a támogatott játékok szabványos kódjában. Vagy vesztek mindkét hardverből egyet-egyet a gépbe, vagy konzol.

-

Abu85

HÁZIGAZDA

Ennek annyira ne örüljetek. A Ratchet & Clank a legfőbb oka annak, amiért a Starfieldnél AMD-exkluzív PC partner lett a Bethesda. Nem lett volna az egészből ilyen jellegű döntés, ha a Nixxes berakja az AMD optimalizálását a játékba, de ha nem, akkor tud az AMD is úgy játszani, hogy kirakják a GeForce optimalizációt a Starfieldből. Aztán majd megunja az NV vagy az AMD, vagy a játékosok, és vesznek AMD-s konzolokat.

#62077 PuMbA : A DXR kód teljesen szabványos kód. Akárhogyan fut, futnia kell a DXR-t támogató GPU-kon. Csak akkor nem fut, ha van a program elején egy feltételes elágazás, ami az egyes vendor ID esetében ezt letiltja. Tehát azért kell tenni, hogy ne fusson. Ezt nyugodtan meg lehetne kérdezni tőlük, hogy miért rakták bele a program elejébe a feltételes elágazást? Miért nem hagyták a játékosokat eldönteni, hogy bekapcsolják-e a szabványos kódot?

A dolog mindegy, mert az AMD meg kilóra felvásárolta a Starfieldet, ha már ilyen szintre akarják vinni a meccset, csak ti lesztek azok, akik ezt megszívjátok.

A DLSS a Starfieldnél leginkább arról szól, hogy az Xbox GDK nem olyan FSR verziót tartalmaz, ami könnyen átműthető lenne DLSS-re és XeSS-re. A GPUOpen FSR2 verzió az, amihez jól használható wrapperek vannak. Az Xbox GDK-ban található kód nagyon más. A Starfieldnél sokkal inkább az jelenti majd a problémát, hogy az egész játék memóriamenedzsmentjét az AMD írta meg. Nulla kódot rakott bele a Microsoft vagy a Bethesda. Az AMD konkrétan a megbízott cég ebből a szempontból, és csak úgy átemelték a kódot, amit adtak. Az NV-nek és az Intelnek beleszólása sem volt, noha azt tudni, hogy az Intel rakott a D3D12MA-ba bizonyos optimalizálásokat, csak nem tudni, hogy az AMD azt a verziót szállítja-e a Bethesdának, amiben ezek benne vannak.

-

PuMbA

titán

válasz

Alogonomus

#62076

üzenetére

Alogonomus

#62076

üzenetére

Az NVIDIA oké, hogy reklámozza, de sosem tiltották e mellett semmilyen AMD-s dolog alkalmazását és ezt hivatalosan is kommunikálták

FSR benne van, RT is benne lehetne simán, de az AMD-vel dolgoznak a megoldáson, ez a cég hivatalos közleménye, nem sunyulnak. Az AMD a kérdésesebb, hiszen a Starfield DLSS hiányra, csak egy no comment választ adott.

FSR benne van, RT is benne lehetne simán, de az AMD-vel dolgoznak a megoldáson, ez a cég hivatalos közleménye, nem sunyulnak. Az AMD a kérdésesebb, hiszen a Starfield DLSS hiányra, csak egy no comment választ adott. -

Alogonomus

őstag

A Ratchet & Clank inkább a CP:2077 esetének az új megjelenése szerintem. Ott is megpróbálhatta az Nvidia a kezdeti mesterséges RT-exkluzivitással a Geforce kártyaeladásokat javítani. Reklámozza is teljes gőzzel a saját honlapján az Nvidia a játékot, ahogy tette a CP:2077 esetén is.

Kíváncsi vagyok, hogy a pártatlanság érdekében HUB Tim erről is készít-e egy külön szidalmazó videót, ahogy készített a Starfield állítólagos DLSS-mentességéről.

-

PuMbA

titán

Mekkora előny, hogy a konzolokban AMD GPU van és milyen könnyű és egyszerű az AMD-re programozni, mert open source. Ja, nem

Az AMD csiga lassúsága a gyakorlatban megint megmutatja magát, dolgoznak az ügyön az AMD-vel:

Az AMD csiga lassúsága a gyakorlatban megint megmutatja magát, dolgoznak az ügyön az AMD-vel:”Ratchet & Clank: Rift Apart will not support ray tracing on AMD GPUs at launch, developer Nixxes Software confirmed today.”

-

Alogonomus

őstag

A 4070 Ti és 7900 XT között az átlagos különbség közelebb van a 10%-hoz, de persze az sem egy nagy különbség.

Ez a GRE verzió a gyengébbre sikeredett Navi 31 GCD-k kiszórására készül, így ugyanolyan TDP keretből alacsonyabb órajelre lehetnek képesek. Ugyanolyan TBP esetén a mínusz egy MCD és mínusz 2 memóriachip hatására talán minimálisan több TDP kerek juthat a GCD-re, és így az órajelen esetleg nem kell csökkenteni. -

HSM

félisten

válasz

Alogonomus

#62069

üzenetére

Alogonomus

#62069

üzenetére

A 16 vs 20 GB mellett a sávszélesség is kevesebb és 16MB Infinity Cache is megy a levesbe az egyik MCD-vel. Azért ezeknek is érezhető hatása lehet, már a 7900XT-nek is fájt néha a kiesett MCD az XTX-hez képest. Ha a TDP keret is csökken, akkor az órajel is érezhetően fog, hiszen a 7900XT sem volt TDP ügyileg eleresztve...

-

válasz

Alogonomus

#62069

üzenetére

Alogonomus

#62069

üzenetére

A 4070 Ti ellenfele a 7900XT . 5 % eltérés van a kettő között átlagban.

Bármilyen lassabb SKU felesleges kör a 4070 Ti ellen ,mert azzal a 7900XT nek is konkurencia nem csak a 4070Ti nek.

A 7900XT szerintem teljesen jó ellenfél és jó választás mai felhozatalba, nekem kifejezetten szimpatikus SKU.

Miből veszed hogy csökkentett órajele van vagy fogyasztása?

Mert valami biztos van még a memórián kívül,( IF cache? ) mert ha ugyan az a TDP keret akkor akár még minimálisan gyorsabb is lehetne a GRE mint a7900XT, kivéve sávszél limit esetén. -

Alogonomus

őstag

Azért átnevezésnél komolyabb a különbség, mert a 16 vs. 20 GB az érdemi eltérés.

Amennyiben Kínán kívül is kapható lesz, akkor nagyjából a 4070 Ti valódi ellenfelének szánhatják a fixen csökkentett memóriakapacitás, és talán szintén csökkentett magfrekvencia bevetésével. Amolyan "új" 6800 lesz, csak ezt most nem a 3070/Ti ellenfelének szánják, hanem a 4070 Ti ellenfelének, hogy a sajtó ne a "teljes" 7900 XT-vel vesse össze a 4070 Ti teljesítményét, hanem ezzel a kisebb és nyilván takarékosabb verzióval, ami már nagyjából csak a 4070 Ti teljesítményét hozza majd. -

Raymond

titán

válasz

hahakocka

#62064

üzenetére

hahakocka

#62064

üzenetére

Te vagy szandekosan trollkodsz vagy tenyleg nem vagy kepes agyilag felfogni a topic lenyeget. Ami egyebkent a topic szempontjabol teljesen mindegy es ha tovabb folytatod akkor segiteni fogunk hogy ne a sajat akaraterodon muljon hogy itt hozzaszolsz vagy nem.

Miutan a 7700/7800 termekek megjelennek akkor ez a topic semmit nem fog valtozni ugyanis a kovetkezo meg meg nem jelent termekekrol fog szolni es ugyanaz lesz mint even mar. Mert errol szol a topic.

-

válasz

Komplikato

#62062

üzenetére

Komplikato

#62062

üzenetére

TPU szerint [link] Navi 31, korlátozott TDP-vel. Szerintem kis selejtes GPU-k.

-

hahakocka

őstag

válasz

Busterftw

#62061

üzenetére

Busterftw

#62061

üzenetére

Egyszerű csak nem olvasom addig ezt az alfórumot amíg nem jelentik be az új gpukat. Addig bulvàros prototípus híreken. S a Moore Law is dead, az eddigi valaha volt legjobb jósunk hírein.

Hàla ègnek a YT csatornàmon jó ideje nincsenek trollok. Csak pl a sikeres kritikai gondolkodásról szóló IT S videót megèrtők. -

HSM

félisten

válasz

Komplikato

#62062

üzenetére

Komplikato

#62062

üzenetére

Ezt pletykálták már a 256bites Navi31 verziónál is, hogy kisebb lehet a csomag.... Ami logikus is abból a szempontból, hogy 128 bittel keskenyebb lett a memóriabusz.

Azt nem tudom, ezen mekkora, de Igor már tesztelte, ami vélhetően ennek a professzionális verziója [link] . -

Komplikato

veterán

Elvileg július 28-án jön az RX 7900 GRE (Golden Rabbit Edition

)

)

Hivatalosan még nem tudni, hogy csak kínai belpiacra jön, de valószínű. Viszont ugye jöttek ki képek és ez alapján teljesen más a nyák, mint a nagytesók esetén, ami persze indokolt lehet a 256 bit, meg a kisebb fogyasztás okán. De. Más, kisebb a GPU foglalat is. Szóval megy az agyalás, hogy valamilyen hibrid Navi van rajta. -

-

hahakocka

őstag

válasz

Busterftw

#62026

üzenetére

Busterftw

#62026

üzenetére

Egy prototípus amit nem fogunk tudni megvenni e formàban, nekem Blikk színvonal vitatkozni róla.... Arról vitatkozni amit nem fogunk megvenni e formàban majd ezèrt mert prototípus . Mindegy akkor beszèlgessetek róla max nem olvasom ennyi.

A 4K S 8K felbontásoknâl.az előzőekhez mèrve inkàbb 2-2 , 2-2.5 szer nagyobb ugye vízszintes függőleges mód. Persze összessègèben 4 szer.

-

S_x96x_S

addikt

> Én még azt is elképzelhetőnek tartom,

Várd meg az UE 5.9-et és a PS6-ot .. tényleg nem kell elkapkodni ..

A jó munkához idő kell ..

Unreal Engine 5.3 ( in progress ) Public Roadmap.

https://portal.productboard.com/epicgames/1-unreal-engine-public-roadmap/tabs/88-unreal-engine-5-3-in-progress -

PuMbA

titán

-

S_x96x_S

addikt

válasz

Busterftw

#62054

üzenetére

Busterftw

#62054

üzenetére

egy GPU-t a gyenge a cpu is visszafoghatja.

egyébként konzol alatt - felhasználóként - nem tudod kimérni, hogy mi a bottleneck.

és ami nem fut, azt nem is adják ki, vagy addig butítják a beállításokat,

amig 30fps stabilan nem jön ..persze ez másrészt fontos infó lenne ..

mert amit észlel egy felhasználó az csak az output

és ebből nem árt óvatosan következtetni.

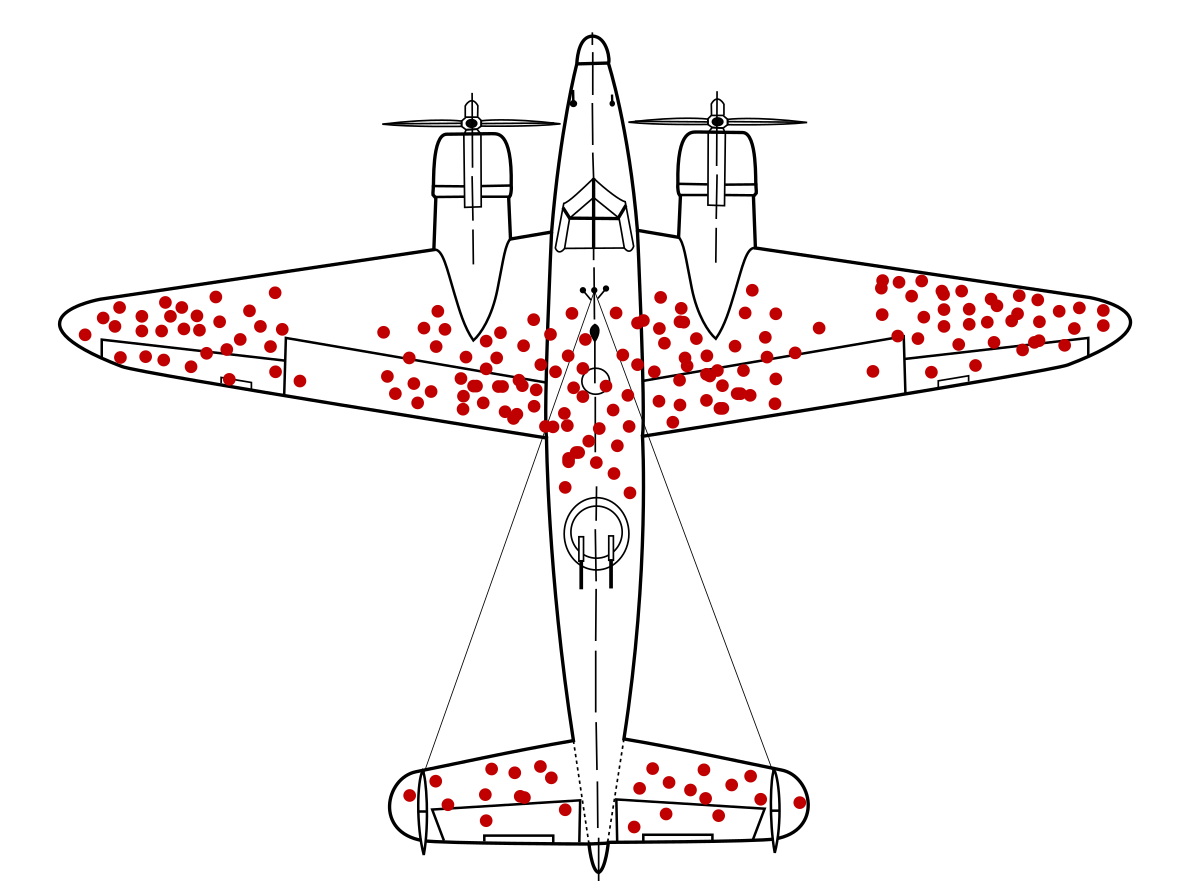

( ~ survivorship bias )és ezt nem árt tudni egy jó és kiegyensúlyozott game (konzol) tervezésénél.

vagyis hova tegyük az extra erősítést ..

ha a Lumen hibrid ray-tracing engine-ből tanulságot szeretnénk levonni, akkor az az lenne,

hogy mindig lesz a jövőben olyan GPU feature, amit szoftveresen kell támogatni, mivel az aktuális GPU nem támogatja.

Emiatt sose árt egy pici CPU tartalék ;

és ez főleg az életciklus végén lesz igen fontos ..És ha már az életciklus eleján nagyon ki van centizve a cpu,

akkor az életciklus végén borítékolható, hogy nagyon fognak izzadni a fejlesztők .. -

S_x96x_S

addikt

válasz

Busterftw

#62052

üzenetére

Busterftw

#62052

üzenetére

>> 'This suggests that UE5 performance is more reliant

>> on single-core speed as opposed to

>> exploiting the many cores and threads in a modern PC processor."

> Hát akkor csináljanak erősebb magokat.ebben egyetértünk akkor ..

> Ettől még a bottleneck a GPU lesz, és ne felejtsd el, hogy 8K-ról beszéltél.

Azért kiváncsi lennék, hogy 8K-n a Lumen hibrid ray-tracing enginje

hogyan muzsikálna csak a normál 8x Zen2-es magokkal

( ami FP szempontjából is ki van belezve )

Persze van GPU gyorsítás mellé, de a CPU-t nem lehet kiküszöbölni ..vagyis egy rendszer bottleneck -je, nem állandó .. hanem vándorol.

-

Busterftw

nagyúr

válasz

S_x96x_S

#62051

üzenetére

S_x96x_S

#62051

üzenetére

A fejlesztések (DirectStorage épp a CPU-t tehermentesíti) nem ezt mutatják ahogyan az elmúlt konzol generációk sem.

Mindig is gpu bottleneck volt és van, elég furcsa lenne act gondolni, hogy ez a közeljövőben nem így lesz.Konzolonál sokkal fontosabb a backwards compatibility, még a PS5 only játékoknál is gond a stabil 4K 30fps sok esetben.

'This suggests that UE5 performance is more reliant on single-core speed as opposed to exploiting the many cores and threads in a modern PC processor."

Hát akkor csináljanak erősebb magokat. Ettől még a bottleneck a GPU lesz, és ne felejtsd el, hogy 8K-ról beszéltél. -

S_x96x_S

addikt

válasz

Busterftw

#62050

üzenetére

Busterftw

#62050

üzenetére

> Ha egy 4090-nél gyorsabb GPU kerülne a konzolba,

> akkor is a GPU bottleneck lesz nem CPU.Nem minden játék ( ~ játék engine ) egyforma, és léteznek CPU heavy játékok is,

valamint

Továbbá fontos figyelembe venni, hogy nem szabad csak az elmúlt öt év játékainak tendenciái alapján megjósolnunk a következő öt évben megjelenő játékok processzor igényeit. A technológia, és ezen belül a játékipar is, gyorsan fejlődik, ami azt jelenti, hogy a játékok hardverigényei is változnak.És még hozzá kell tenni, hogy a játékok egy része gyakran nem optimálisan van megtervezve a hardver erőforrások kihasználása szempontjából. Ez azt jelenti, hogy több erőforrást használnak, mint amennyi valójában szükséges lenne. Ha a játékfejlesztők több időt tudnának szánni a játékok optimalizálására, az csökkentené a processzorigényt. Azonban ez gyakran időigényes és költséges folyamat, és gyakran gazdasági okok miatt kerülnek mellőzésre ezek a lépések. Emellett a játékosok is elégedettebbek, ha a játékuk gyorsabban, akadások nélkül fut, ami gyakran nagyobb processzorigényt eredményez. Ezért a jövő konzoljainak processzoraival kapcsolatban fontos szem előtt tartani, hogy képesek legyenek kezelni ezeket a nem optimális helyzeteket is.

Nem véletlen, hogy amikor a Sony megkérdezte a fejlesztőket,

a fejlesztők egy része eleve 16 magos procit szeretett volna a PS5-be [1],

és a jelenlegi 8 CPU mag már egy kompromisszum eredménye, az APU miatt.

[1] "How PlayStation 5 Was Built (feat. Mark Cerny) | WIRED"

https://youtu.be/cJkx-OLgLzo?t=298Amúgy a CPU sok helyen be tud segíteni, pl.

- mesterséges intelligencia,

- animáció,

- fizikai modellezés,

- szimuláció terénA PS5 ~ Ryzen 3700 -nek feleltethető meg, persze fontos megjegyezni, hogy eléggé kibelezett a vektoros FP -je , mivel a teljesítménye ~ fele a zen2/zen3-nak.

"In an update from @Nemez (benchmark data from @ashilling), it appears that the FPU on the PS5 (using the 4700S which is basically the same SKU) is significantly slower than the Zen 2 and Zen 3 FPUs powering the Ryzen 3000 and 5000 CPUs, respectively. The vanilla Zen 2/Zen 3 chips are twice as fast as the 4700S (PS5) across most vector FP operations such as AVX256_float, SSE128_float, including add, div, sub, mul, and div." ( forrás )

Vagyis szerintem legalább egy dupla erős mag nem árt a PS5 PRO -ba.

és a dupla erős mag -> nagyobb single core teljesítmény,

ami kell is az UE5-höz, mivel a Ryzen 3600 már jelenleg is CPU limites." This suggests that UE5 performance is more reliant on single-core speed as opposed to exploiting the many cores and threads in a modern PC processor.

...

So where does all of this leave mid-range PCs? Right now at least, the mainstream favourite - the Ryzen 5 3600 - is severely CPU limited, averaging 30fps in static scenes but falling much lower when in movement. With that in mind, how did Epic get the console versions to run better? Well, let's bear in mind that even with specific optimisations, we're still far from a locked 30fps but even so, it seems that Epic's TSR upscaler doesn't deliver quite the same quality level as the PC rendition - meaning either a lower quality TSR or a lower base resolution."

( forrás ) -

S_x96x_S

addikt

válasz

paprobert

#62047

üzenetére

paprobert

#62047

üzenetére

> Igen, CPU-ban egész nagy lehetne az ugrás, csak egyelőre értelmét nem látom,

> mert alig van kint játék CPU izzasztó kóddal.1.) 8K -hoz legalább egy dupla erős proci se árt ..

2.) a konzolban APU-van

és az egy power/thermal keretből gazdálkodik ..

vagyis ha a CPU gyorsabban végez, akkor több marad a GPU-nak.

( mert amúgy mindenki csendes konzolt szeretne .. vagyis nem szaladhat meg extrém módon a fogyasztás )lásd phoronix teszt: https://www.phoronix.com/review/amd-ryzen7040-avx512

Vagyis a "frames per second per Watt" -ban az AVX-512 add egy kis pluszt ..> Az AVX512 például Abu által a földig le volt hordva, (addig főleg, amíg az Intel-only

> feature volt), a szilíciumpazarlást kiemelve. Ez nyomós érv a konzolgyártóknál.igen, ... ezért is nem az Intel csinálja a konzolcsipeket.

de az AMD avx-512 implementácóját mindenki dicséri...

( amúgy is az AMD eléggé skót az szilicium terén és nem jellemző rá a szilícium pazarlás )> Viszont a fillérb*szási elv eddig erősebb volt annál,

> hogy ilyen-olyan potenciálisan kihasználatlan funkcióval hizlalják az SoC-t.a konzolon nem kell több különböző architektúrát támogatni,

amiatt a zen2 és a zen4(zen5?) párhuzamosan elfér egymás mellett,

és majd lesz 2 optimalizált konzol bináris .. ( multi-arch ) ahol a teljesítmény megköveteli ..szerintem ki fogják használni a konzolon az avx-512 -öt , hogyha beleteszik ..

-

paprobert

őstag

válasz

Petykemano

#62044

üzenetére

Petykemano

#62044

üzenetére

Igen, CPU-ban egész nagy lehetne az ugrás, csak egyelőre értelmét nem látom, mert alig van kint játék CPU izzasztó kóddal.

"AVX512 és más AI utasítás és/vagy gyorsító beépítése"

Ha van konkrét usecase, akkor ezt látom megtörténni. Viszont a fillérb*szási elv eddig erősebb volt annál, hogy ilyen-olyan potenciálisan kihasználatlan funkcióval hizlalják az SoC-t.

Az AVX512 például Abu által a földig le volt hordva, (addig főleg, amíg az Intel-only feature volt), a szilíciumpazarlást kiemelve. Ez nyomós érv a konzolgyártóknál."A CU-k számát biztos növelik - a pro erről szokott szólni. A pletykák 36-ról 60-ra növelésről szólnak."

A SeriesX már most 52-t hoz. Tehát akkor csak RDNA3-ra átültetés lenne? Az még +30% se.

Nem tiszta, hogy mitől állna össze egy ütős csomag, ami indokolna egy célpiacot forgácsoló típust.Persze ha úgy gondolkodnak, hogy "ki kell hoznunk valamit, mert a másik is hoz", akkor nyomós indok nélkül érkezhet frissített modell, abból építkezve ami épp rendelkezésre áll.

Egyelőre viszont, ilyen közeli megjelenést feltételezve az RDNA3 és az 5nm kombinációja+ szilícium-fukarkodás a lepkefingnél nem kecsegtet sokkal többel.

-

HSM

félisten

válasz

Petykemano

#62031

üzenetére

Petykemano

#62031

üzenetére

"A 2022-es RDNA3 megint gatya."

Azért ezt kicsit erősnek gondolom. Persze, jópár dolog pocsékul lett kivitelezve, főleg a rajtnál (pl. félkész driver), de maga az újítások hasznosak és jók. Gondolok a jobb RT teljesítményre, nagyobb regiszterre/gyorsítótárakra, a sikeresen megvalósított chiplet dizájnra vagy a bevezetett erősen korlátozott, de alacsony tranzisztor igényű dual-issue képességre.

A 7900-as széria nekem tetszett, éppen ott fejlődött az RDNA2-höz képest, ahol arra a legnagyobb szükség volt. -

válasz

S_x96x_S

#62043

üzenetére

S_x96x_S

#62043

üzenetére

Nem a marketing működik, hanem az exkluzív játékok ha csak kicsit jobban fut és jobb minőséget ad akkor azért veszem meg.

Nagyjából sejtjük, hogy a 7900XTX-4090 mire képes 8 K ban ami 4 darab 4K kijelzőnek felelmeg , felsálázással sem igazán elképzelhető ez számomra egy 7700-4060 Ti szintű hardvertől, de jól hangzik. -

Petykemano

veterán

válasz

paprobert

#62040

üzenetére

paprobert

#62040

üzenetére

A zen2->zen5c átmenet szerintem hozzávetőleg 50-60%-os IPC növekedést is jelenthet nem számolva frekvencia növekedéssel. Magszámot nem szokás növelni, de azt esetleg meg lehet kockáztatni, hogy 16 SMT nélküli magot alkalmaznak. Legalábbis volt egy olyan info, hogy magonként lesz megállapítható, hogy van-e SMT.

De ennél szerintem sokkal fontosabb és időszerű az AVX512 és más AI utasítás és/vagy gyorsító beépítése.

A GPU tekintetében szerintem hasznos lesz majd az RDNA3-ban megjelent "béta" fícsörök, mint a szuper tranzisztorsűrűség vagy dual-issue. Lehet, hogy megéljük, hogy az RDNA3 fine wine lesz.

A CU-k számát biztos növelik - a pro erről szokott szólni. A pletykák 36-ról 60-ra növelésről szólnak. Ugyanakkor szerintem az AI mellett megérhetett az RT is, hogy komolyabb támogatást kapjon.De azt is gondolom, hogy a chipletes gyártástéchnológia is van már azon a szinten, hogy konzolban használatba vegyék. Ezzel elérhető, hogy ne legyen olyan drága, vagy épp extra cache-sel lehet felülről megáldani.

Szerintem jóval több potenciál van ebben akár N4P+N6-on gyártva is, mint 30%. És ezek szerintem mind olyan dolgok, amiket a visszafelé kompatibilitás érdekében le lehet tiltani.

-

S_x96x_S

addikt

> Most őszintén ... 8 K + RT ? itt érzed már hogy marketing az egész.

> Meg fogom venni a Ps5 pro-t is mert Playstation,akkor nálad is jól működik a marketing ..

amúgy extra "vas" lesz benne ...És ha a 8K + RT célozzák be akkor talán

a normális 4K -t is sikerül végre elérni.

amúgy minden "hírportál" másképp foglamaz ..

- 'PlayStation 5 Pro will be targeting improved and consistent FPS at 4K resolution'

- '8K “performance mode”'

- 'Accelerated ray tracing'

- 'Improved frames per second (FPS)'

- 'Better FPS stability performance at 4K resolution'

- ...

amúgy lehet, hogy érdemesebb várni a PlayStation 6 -ra : 2028 -

válasz

S_x96x_S

#62041

üzenetére

S_x96x_S

#62041

üzenetére

"Azért a 8K / ray tracing / RDNA3 vagy RDNA3.5 elég csábító lehet"

Most őszintén ... 8 K + RT ? itt érzed már hogy marketing az egész.4 K@60 Hz és egy RX 7900XTX úgy ahogy alkalmas már erre.[link]

Meg fogom venni a Ps5 pro-t is mert Playstation, csak ez a kamu hype nem kellene. -

S_x96x_S

addikt

válasz

paprobert

#62040

üzenetére

paprobert

#62040

üzenetére

> Én még nagyon korainak érzem egy konzol refresh érkezését.

Azért a 8K / ray tracing / RDNA3 vagy RDNA3.5

elég csábító lehet."Speculations also suggest potential support for 8K gaming and high-framerate 4K gameplay."

"Alleged PlayStation 5 Pro console featuring AMD graphics with 30 WGPs, could launch November 2024"

https://videocardz.com/newz/alleged-playstation-5-pro-console-featuring-amd-graphics-with-30-wgps-could-launch-november-2024> Szóval a két korlátozó tényező,

> a megfizethető fejlett node, és nagy GPU-energiahatékonyságbeli ugrás.konzolnál teljesen normális, hogy az elején önköltségi ár alatt adják ..

és jövő év végére a TSMC 3nm -is elég jó állapotban lesz. ( Anandtech )

-

paprobert

őstag

válasz

Petykemano

#62031

üzenetére

Petykemano

#62031

üzenetére

Én még nagyon korainak érzem egy konzol refresh érkezését. Az adott, szolid méretű szilíciumba préselhető sebesség nem mindenhol változott egyenlően a lassan 3 év alatt.

CPU-t tekintve az optimum frekvencia kb. 1GHz-nyit kúszott felfele, valamint a Zen4 IPC-ben jelentős előrelépés.

Viszont még nem láttam olyan címet, ami kihasználta volna akár csak a Zen2-t a konzolokban, azaz mi értelme lenne?A GPU-t vizsgálva az architektúra alig fejlődött, az órajel csak inkrementálisan, az energiahatékonyság majdhogynem visszafejlődött.

Ahhoz, hogy látható teljesítménybeli ugrás legyen, óriás chipet kellene hozni, és új node-on. Ez teljesen irreális egyelőre.Szóval a két korlátozó tényező, a megfizethető fejlett node, és nagy GPU-energiahatékonyságbeli ugrás. Amíg ezek nem állnak rendelkezésre, addig egy refresh kb. +30%-ot tudna az XSX-hez viszonyítva. Ennyiért el sem érdemes kezdeni.

-

PuMbA

titán

Most volt nem rég egy Hardware Unboxed videó, amiben olyan gondolatot mondtak, hogy az NVIDIA-nak előnyt jelenthet, hogy őket nem köti a konzol, tehát például nem kell hardveresen visszafele kompatbilitással foglalkozniuk. Az NVIDIA teljesen szabad, két generáció között simán kidobhat dolgokat az architektúrájába, teljesen átszabhatja. Ez is nagyban hozzájárulhat, hogy ennyire más a célirány / másként működik a két cég.

-

válasz

DudeHUN

#62032

üzenetére

DudeHUN

#62032

üzenetére

Az Xbox 360 tól van PC vonatkozás a konzolokban, ahogy írod, Playstationban pedig a PS3 tól nagyjából, bár az inkább kérdőjel mert a benne lévő Zöld GPU már adott volt .

Gamecube / Nintendo most is teljesen más vonal, semmilyen szinten nem prioritás nekik a PC hardverezettség és fordítva sem ők a cél PC hardver fejlesztésben.A Konzolokban egy jó ár/értékű , olcsón gyártható elégséges teljesítményű megoldás kell,de nem extra csúcs fejlesztés, ez a legnagyobb prioritás szerintem.

Tehát egy Playstationba- Xboxba bekerülő hardver nem jelent többet egy átlagos alsó közpépkategóriás GPU nál ami minden generációban mindegyik cég részéről teljesen jól elérhető.legyen az alapja Polaris, RDNA 1-3 tehát ez nem befolyásolja szerintem a PC-s konkurencia harcot az Nvidia elleni fejlesztést, vagy ha igen, lehet hogy éppen visszafogja AMD-t, hogy figyelembe kell vennie a Konzolokat.Szinte minden extra funkció, amit a konzolok nyújtanak azon felül ,azok külön fejlesztések, lásd Cell proci, vagy dedikált RT egységek eSRAm, Directstorage.

tehát szerintem a konzoloknál a a hardevereknek nincs akkora befolyása a PC iparra, mint az extra szoftveres funkcióknak amit hoznak .

Szerintem AMD egyszerűen piaci szemlélettel fejleszt

petyke felsorolására nekem az a véleményem :_

Polaris :

átlagos volt, középkategória közepe volt a maximuma, a konkurenciához képest, ( Pascal) nem nyújtott többet, előnye az árazása volt . Úgy ahogy, mert Pascal is remek árban volt.

RDNA1: átlagos volt semmiben nem nyújtott semmi extrát.

Plafon a középkategóra közepe volt. Előnye az árazása volt de alapjaiban elavultabb mint a Turing.

RDNA2: Jó volt,de kellett hozzá az hogy Nvidia belefusson a Samsung gyártási nehézségekbe, így 20 % kal elmaradt a tervezett teljesítmény szintől: ha ez nem történik akkor maximum a csúcson nem lett lett volna verseny de a középkategória akkor is nagyon erős lett volna.

RDNA3 : Ugye leírtama teóriámat, hogy Nvidia kellett hozzá hogy ne középkategória legyen a csúcs.

Tehát szerintem AMD a középkategóriára fejleszt elsősorban a legnagyobb célpiacra.

A ps5 pro ha 7700szint lesz akkor is ez látszik az egészből. Azonos szinten nyújtott ár/érték/ teljesítmény számít.

Ez csak az én véleményem, hogy ez nem befolyásolja a PC- s hardveres konkurencia harcot, inkábba PC-s szoftver fejlesztéseket, ami közvetve hatással lehet a hardverekre -

Busterftw

nagyúr

válasz

Petykemano

#62031

üzenetére

Petykemano

#62031

üzenetére

Érdekes de valid elmélet, tovább gondolva, vajon a szoftver "részleg" is ezért érződik bétának?

-

DudeHUN

őstag

Pedig a vörösök GPU gyártó részlege már akkor így állt a konzolokhoz. Az X360 is a jövőben PC-s kártyákon megjelenő képességekkel lett felvértezve. Igazából a 2005-nek azért volt értelme mert vörös hardver már jóval régebb óta van konzolban. Gamecube mondjuk más tészta.

Szóval amit Pletykamano mond már régóta működik. A konzolfejlesztések megdobják a PC-s hardvert is. Nyilván túlzás, hogy nincsen dedikált GPU gyártó banda. De külső szemlélőként valóban magasabb prioritásúnak néz ki amikor konzolba való hardvert is fejleszteni kell. -

Petykemano

veterán

A PS4 talán egyfajta kivétel

Ps4pro 2016 végén jelent meg. Nagyjából.azzal együtt jött a Polaris, ami fogyasztói szemmel nézve (annak ellenére, hogy volt vele probléma, illetve hogy nem verte laposra a konkurenciát) jól sikerült termék volt.

Aztán jött a Vega 2017-ben, Amiről tudjuk, hogy elmaradt megcélzott.ambícióitól.

Az 2019-es RDNA1 nem volt rossz, de nem is kiemelkedő.

A PS5-tel 2020-ban együtt érkező RDNA2 elég versenyképes teljesítménnyel érkezett a teljes termékpalettára.

A 2022-es RDNA3 megint gatya.

Nekem eléggé úgy tűnik, hogy az AMD-nek igazából nincs GPU fejlesztő osztálya, konzol fejlesztői, valamint most már HPC hardverfejlesztői vannak és lehet egy kisebb csapat, amelyik két konzolgeneráció között azt a feladatot kapja, hogy guberáljon össze valamit a két komoly célpiacra készülő fejlesztésekből, ami a GPU piacon használható, vagy legalább bétatesztelhető terméket eredményez.

-

válasz

Petykemano

#62027

üzenetére

Petykemano

#62027

üzenetére

"A konzol után készülő gpu jó szokott lenni, mert szponzorációt kap a fejlesztés"

Eddig kettő konzolgenerációban volt AMD hardver.

Nekem ez a következtetés kissé fura. -

Petykemano

veterán

válasz

Petykemano

#62025

üzenetére

Petykemano

#62025

üzenetére

Az RDNA3.5 vagy inkább az RDNA4 jó lesz.

A konzol után készülő gpu jó szokott lenni, mert szponzorációt kap a fejlesztés.Idővel akár azt a kérdést is feltehetjük, hogy az RDNA3 melyik konzol fejkesztésében lehetett egy Proof of Concept jellegű megálló?

-

Petykemano

veterán

Amd Viola = PS5 Pro

30WGP

KeplerL2 -

hahakocka

őstag

4070 hez írtam a 7700xt T a Tihez pedig közel a 7800 Ast. 7900 xt 15-20% al van feljebb raszterben az új gameknèl a Ti hez kèpest. Lenne ott egy 20-30% difi

Busterftw: Ezek prototípus fèlkèsz vga-s 3Dmark adatok. Nemrèg linkeltèk de az Iponon is van fent egy cikk erről most màr hivatalos Amd partnerek. -

Busterftw

nagyúr

válasz

hahakocka

#62019

üzenetére

hahakocka

#62019

üzenetére

Az hogy te mit erzel fontosnak a te dolgod es teljesen irrelevans.

Errol szol a topik, ha tetszik ha nem.

A 3DMark es a fogyasztasi adatok nem blikk bulvar kategoria, hanem konkret meresek,

amire te gondolsz blikk kategoria ez lenne: early benchmark shows 7800 faster than 4090.Koszi hogy megmondod mirol "dumaljunk".

Spekulalni, saccolni a teljesitmenyt es hova erkezik a kartya teljesen jo a 3DMark es a leaked fogyasztas.

-

hahakocka

őstag

válasz

Busterftw

#62017

üzenetére

Busterftw

#62017

üzenetére

Blikk bulvár szintre időjârás jóslàsra azèrt ne menjünk le. A Moore Law is dead sràc is kb az a kategória .

3Dmark megannyi szor bizonyította NV S Amd kariknâl is hogy sokszor messze van az àtlag 1080p-1440-4K videójâtèk tesztek eredmènyeitől. Èn ezèrt nem nèzem fontosnak már jó ideje. A friss 4070 st is gyengèbbnek mutatta azt nem lett az.

S mint írtam ez prototípus bármi lehet mèg belőle. Lehet dumâlni róla mik a vàgyâlmok stb persze .b.

Az àr lesz fontos mèg ha pl 400 èrt adnàk S hoznà 4070 alját az durva lenne màrmint a 7700xt. A 7800xt 500-550 el hoznà 4070ti alját az lenne durva de ez kètsèges. Főleg ha lesz 7900 sima is esetleg. -

válasz

hahakocka

#62014

üzenetére

hahakocka

#62014

üzenetére

Mondjuk az azért jó infó, hogy a fogyasztás 260 W volt azoknál. AMD bevállal e egy magasabb fogyasztást ?

Én a helyükben rámennék erre ,mert valószínűleg energiahatékonyság terén a 4070 nem hozható nekik , viszont teljesítményben ha gyorsabb és olcsóbb mint a 4060 Ti és 4070 ,akkor némileg javít a renomén. Nem nehéz népszerűbbnek lenni jelenleg mint az 500 euro fölötti 4060 Ti.

Szóval számomra nem a pontszám a kérdéses, hanem az, hogy mennyire fogják elengedni ezeket a fenti mérnöki vagy teszt példányokhoz képest a piacon.

Tudom nem lesz népszerű amit írok, de AMD ha üzletileg jobban akar járni akkor az FSR3-at csak a 7000 szérián teszi aktívvá,( lehet amúgy is így lesz, nem tudom.) -

Busterftw

nagyúr

válasz

hahakocka

#62014

üzenetére

hahakocka

#62014

üzenetére

Nem le vagy felmagasztalas megy, hanem az erkezo SKU kibeszelse/talalgatasa.

Errol szol a topik helo:

"esélylatolgatás, érdekességek, spekulációk, stb"

"lehetőleg minél inkább szakmai keretek között maradva"

Osszehasonlithato 3DMark pontszam es fogyasztasi adatok pedig kimeritik jobban az utobbit, mint barmilyen egymondatos wall of text amit szoktal produkalni.AMD felmagasztalas toled megy, legyen az barmilyen topik.

-

hahakocka

őstag

Szerintem inkább várjuk meg a megjelenést addig minden kb pletykaszintű dolog. A 3Dmark meg mondom sokszor nem valósat mutatta eddig se. Pl a frissebb 4070 nél is gyengébbnek jelzi mint ami lett gamek alatt.

-

Busterftw

nagyúr

válasz

Petykemano

#62006

üzenetére

Petykemano

#62006

üzenetére

Illetve ezt folytatva a "nem prototípus" driver sem garantálja a jobb teljesítményt, főleg nem launchkor.

-

válasz

Petykemano

#62007

üzenetére

Petykemano

#62007

üzenetére

jah ok.

GDDR6X sem volt az amikor kijött, csak aztán 1-2 évre rá megnőtt a sima GDDR6 effektív órajele de a megjelenéskor lényegesen gyorsabb volt az "X" az akkori GDDR6 hoz nézve. ott is a PAM miatt maximális terhelésen igazán hatékony tud lenni. Itt írnak róla:[link] -

HSM

félisten

válasz

Petykemano

#62006

üzenetére

Petykemano

#62006

üzenetére

Megjelenés előtt tulajdonképpen minden kártya prototípus.

Manapság főleg, amikor kis BIOS paraméterezéssel egész sokat lehet ide-oda lökni a teljesítményen a fogyasztás kárára, akár a megjelenés napján is. -

Petykemano

veterán

> Nem Brute force ez.

A brute force kifejezéssel a GDDR6X-et jellemeztem, ahol PAM4-et alkalmaznak. Mindazonáltal nem értek ezekhez, elnézést ha helytelenül ítéltem meg. A kifejezéssel csak arra utaltam, hogy feltételezésem szerint a PAM4 bonyolultabb és bonyolultabban megvalósítható, mint a PAM3. [link] -

Petykemano

veterán

válasz

Busterftw

#62003

üzenetére

Busterftw

#62003

üzenetére

Hű. Szóval, a kártya még nem került kiadásra, de az, hogy ebből fakadóan annak eredményeiről megjelenő szivárgás csupán egy prototípus eredménye volna: feltételezés, valószínűsítés.

Mint ahogy az, hogy egy feltételezett prototípusról készült méréshez képest a végleges változat majd jobb eredményeket fog produkálni az is: feltételezés, valószínűsítés.

(Mindazonáltal az se bizonyos, ,hogy a feltehetően prototípus kártyákról szóló mérés hiteles.)Volt egy kérdés a napokban, amit fel sem vetettem, nehogy hamis reményeket keltsek. Jobb, ha elfogadjuk, hogy ez a két kártya - az RDNA3 - tényleg ennyit tud. Az eddigi GPU-kal kapcsolatos gyakorlat az, hogy a kiszivárgó teljesítményben nincs pozitív meglepetés, inkább a beharangozott árból hajlandók csippenteni.

-

válasz

Petykemano

#61998

üzenetére

Petykemano

#61998

üzenetére

Nem Brute force ez. 32 GHz mellett a PAM 3 miatt sokkal energiahatékonyabb mint a GDDR6 ha maximálisan ki van használva az adatmozgatás, akár 50% is lehet.

-

válasz

hahakocka

#62001

üzenetére

hahakocka

#62001

üzenetére

Hát, ez nem biztos, hogy jó hír mert a fogyasztás éppen lehet hogy magasabb( 260 W) volt a Twitteren bejegyezve mint a végleges spec lesz.

Persze lehet pont ellenkezőleg, hogy növekszik a teljesítmény. Szóval meglátjuk. Szerintem kérdés mennyi OC lehetőség van benne, mert lehet kimaxolják a határra a fogyasztást elengedve, ami ebben a szegmensben még nem feltétlenül nagy gond. -

Busterftw

nagyúr

válasz

Petykemano

#62002

üzenetére

Petykemano

#62002

üzenetére

Gondolom erre hivatkozik, hivatkozas nelkul.

"these are alleged to have been produced by prototype Radeon RX 7700 and Radeon RX 7800 graphics cards"

-

hahakocka

őstag

No kiderült hogy csak prototípusok voltak ezek a 3Dmark eredmènyek. Amúgy igen nagy előny ha a 6000 és kàrtyàkon is megy majd az FSR3. Dlss3 csak Rtx 4000-esen megy.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- Abarth, Alfa Romeo, Fiat, Lancia topik

- Magisk

- Építő/felújító topik

- Válságmódban a Samsung mobildivíziója

- Milyen okostelefont vegyek?

- Nem indul és mi a baja a gépemnek topik

- Audi, Cupra, Seat, Skoda, Volkswagen topik

- Milyen nyomtatót vegyek?

- AMD Ryzen 9 / 7 / 5 / 3 5***(X) "Zen 3" (AM4)

- PROHARDVER! feedback: bugok, problémák, ötletek

- További aktív témák...

- Gainward GeForce RTX 5080 PHOENIX 16GB - Alza garancia 2028.11.08 - BESZÁMÍTOK!

- PALIT RTX 5070 White OC 12GB - 36 hónap garancia

- GIGABYTE RX 9070 XT 16GB GDDR6 GAMING OC ICE - Új, 2 év gari - Eladó!

- GIGABYTE RX 9070 XT 16GB GDDR6 AORUS ELITE OC - Új, 2 év gari - Eladó!

- SAPPHIRE RX 9070 XT 16GB GDDR6 NITRO+ OC - Új, 2 év gari - Eladó!

- Samsung Galaxy S21 független 8/128 akku:96% ÚJSZERŰ

- Telefon felvásárlás! Samsung Galaxy A15, Samsung Galaxy A25, Samsung Galaxy A35, Samsung Galaxy A55

- Dell XPS 15 9500 - 15,6" hibás kijelző, i7 10750H, 8GB RAM, Nvidia GTX 1650 Ti 4GB VGA

- ÚJ AKKU! Ár/ÉRTÉK BAJNOK! Dell Latitude 5330 i3-1215U 6mag! 16GB 512GB 13.3" FHD 1 év gar

- iPhone 11 64GB 100% (3hónap Garancia)- AKCIÓ

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

Ja varj, nem is, hanem epp az ellenkezoje.

Ja varj, nem is, hanem epp az ellenkezoje.

FSR benne van, RT is benne lehetne simán, de az AMD-vel dolgoznak a megoldáson, ez a cég hivatalos közleménye, nem sunyulnak. Az AMD a kérdésesebb, hiszen a Starfield DLSS hiányra, csak egy no comment választ adott.

FSR benne van, RT is benne lehetne simán, de az AMD-vel dolgoznak a megoldáson, ez a cég hivatalos közleménye, nem sunyulnak. Az AMD a kérdésesebb, hiszen a Starfield DLSS hiányra, csak egy no comment választ adott. Az AMD csiga lassúsága a gyakorlatban megint megmutatja magát, dolgoznak az ügyön az AMD-vel:

Az AMD csiga lassúsága a gyakorlatban megint megmutatja magát, dolgoznak az ügyön az AMD-vel:

)

)